Command Palette

Search for a command to run...

IQuest-Coder-V1: Ein Auf Codefluss Trainiertes Modell Zur Verbesserung Der Programmierlogik; Menschliche Gesichtsemotionen: Ein Mehrfach Annotierter Datensatz Zur Erkennung Von Gesichtsemotionen.

Obwohl KI-Codegenerierungswerkzeuge derzeit weit verbreitet sind, stehen sie oft vor Herausforderungen wie einer starren Logik des generierten Codes, unzureichendem Kontextverständnis und Schwierigkeiten bei der Nachahmung realer Entwicklungsprozesse.Viele Modelle lernen nur aus "statischen Momentaufnahmen" von Code-Ausschnitten und haben kein tiefes Verständnis dafür, warum und wie der Code modifiziert werden sollte, was zu einer eingeschränkten Nutzbarkeit des generierten Codes führt.

Darauf aufbauend veröffentlichte das Zhizhi Innovation Research Institute unter der Schirmherrschaft von Jiukun Investment im Januar 2026 die Code-Modellreihe IQuest-Coder-V1.Dieses Modell basiert auf dem einzigartigen Konzept des „Codeflusses“. Seine Kerninnovation besteht darin, dass das Modell aus einer riesigen Menge realer Codeänderungshistorie lernen kann, wodurch es den dynamischen Prozess der Softwareentwicklung wie ein erfahrener Entwickler versteht.Darüber hinaus zeichnet sich der vom Modell generierte Code durch außergewöhnliche Korrektheit, Wartbarkeit und Übereinstimmung mit den Absichten des Entwicklers aus und ist besser in der Lage, komplexe Programmieraufgaben zu bewältigen, die mehrstufige Schlussfolgerungen erfordern.Die Hauptversion verfügt über 40 Milliarden Parameter und verwendet eine Loop-Architektur, die eine interne iterative Codeoptimierung und native Unterstützung für 128K lange Kontexte ermöglicht, was die Fähigkeit zur Bewältigung komplexer Programmieraufgaben deutlich verbessert.

Das Modell „IQuest-Coder-V1“ ist jetzt auf der HyperAI-Website verfügbar. Probieren Sie es aus!

Online-Nutzung:https://go.hyper.ai/vk4K2

Ein kurzer Überblick über die Aktualisierungen der offiziellen Website von hyper.ai vom 12. bis 16. Januar:

* Hochwertige öffentliche Datensätze: 6

* Auswahl an hochwertigen Tutorials: 3

* Interpretation von Community-Artikeln: 3 Artikel

* Beliebte Enzyklopädieeinträge: 5

Top-Konferenzen mit Anmeldefristen im Januar: 8

Besuchen Sie die offizielle Website:hyper.ai

Ausgewählte öffentliche Datensätze

1. Datensatz zu menschlichen Gesichtsausdrücken

„Human Face Emotions“ ist ein Datensatz zur Bildklassifizierung für die Gesichtsausdruckserkennung. Er dient als Grundlage für das Training und die Evaluierung von Forschungsarbeiten im Bereich Computer Vision und Emotionserkennung. Der Datensatz ist nach Emotionskategorien organisiert und umfasst fünf Kategorien von Gesichtsausdrücken mit jeweils über 8.000 Gesichtsbildern. Als Basiseinheit dienen einzelne Gesichtsbilder, die in Ordnern nach Emotionskategorien geordnet sind. Die Bilddaten stammen von verschiedenen öffentlich zugänglichen Online-Plattformen und decken unterschiedliche Personen, Aufnahmebedingungen und Hintergründe ab, was eine hohe Diversität belegt.

Direkte Verwendung:https://go.hyper.ai/Z2ouP

2. GroundingME-Datensatz zur Evaluierung des Verständnisses komplexer Szenen

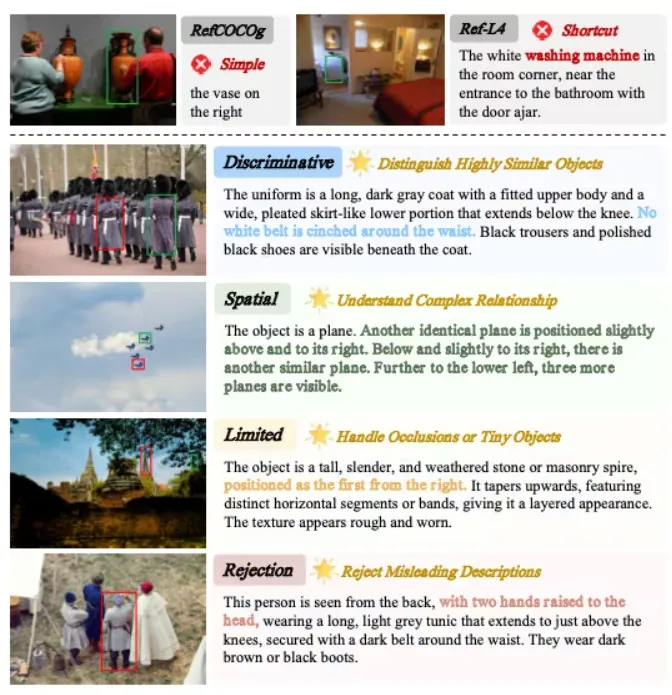

GroundingME ist ein Datensatz zur Evaluierung visueller Referenzen für multimodale große Sprachmodelle (MLLMs), der 2025 von der Tsinghua-Universität in Zusammenarbeit mit Xiaomi und der Universität Hongkong veröffentlicht wurde. Ziel ist die systematische Evaluierung der Fähigkeit des Modells, natürliche Sprache präzise visuellen Zielen in komplexen realen Szenen zuzuordnen. Besonderes Augenmerk liegt dabei auf dem Verständnis und der sicheren Verarbeitung bei mehrdeutigen Referenzen, komplexen räumlichen Beziehungen, kleinen Zielen, Verdeckungen und Situationen ohne Bezugspunkte.

Direkte Verwendung:https://go.hyper.ai/nJSaK

3. Nemotron-Math-v2 Datensatz für mathematische Inferenz

Nemotron-Math-v2 ist ein Datensatz für mathematisches Schlussfolgern, der von der NVIDIA Corporation im Jahr 2025 veröffentlicht wurde. Er wird in erster Linie verwendet, um LLMs für strukturiertes mathematisches Schlussfolgern zu trainieren, die Unterschiede zwischen werkzeuggestütztem Schlussfolgern und reinem sprachlichem Schlussfolgern zu untersuchen und Systeme für lange Kontexte oder mehrspuriges Schlussfolgern zu entwickeln.

Direkte Verwendung:https://go.hyper.ai/6OKuq

4. HydroBASINS Global River Partition Dataset

HydroBASINS ist ein globaler Datensatz zur Flussunterteilung, der auf der hydrologischen Kernschicht von HydroSHEDS basiert und nahtlose globale Flussunterteilungen mit einer räumlichen Auflösung von 15 Bogensekunden bietet. Dieser Datensatz unterstützt hydrologische, ökologische und umweltbezogene Analysen und liefert konsistente, hierarchische Einzugsgebietsgrenzen und Flussnetztopologien. Er eignet sich für eine Vielzahl von Anwendungen, darunter Hydrologie und Wasserwirtschaft, Klima- und Erdsystemmodellierung, Biodiversitäts- und Naturschutzprogramme, Umweltanalysen von Einzugsgebieten, großflächige räumliche Modellierung und GIS-Workflows.

Direkte Verwendung:https://go.hyper.ai/53vN4

5. Datensatz „Batterieausfallflächen“

Battery Failure Surfaces ist ein Simulationsdatensatz für Batterieausfälle, der entwickelt wurde, um den Lebenszyklus und die Ausfallarten von Batterien unter verschiedenen Betriebsbelastungen zu untersuchen. Dieser physikalisch inspirierte synthetische Datensatz simuliert die Zustandsänderungen von Batterien während Lade-Entlade-Zyklen und eignet sich für die Risikomodellierung und die Ermittlung von Sicherheitsgrenzen.

Direkte Verwendung:https://go.hyper.ai/hRapq

6. Globaler Datensatz „Grüne Energieimpulse“

Der Datensatz „Global Green Energy Pulse“ dient der Analyse erneuerbarer Energien in Großstädten weltweit. Er soll Forschern und politischen Entscheidungsträgern helfen, das Potenzial grüner Energie in verschiedenen Städten zu verstehen, insbesondere im Kontext des Übergangs zu klimaneutralen Volkswirtschaften. Der Datensatz bietet eine umfassende Datengrundlage für die Forschung in den Bereichen Zeitreihenprognose, Geodatenanalyse und globale Energieoptimierung.

Direkte Verwendung:https://go.hyper.ai/p8NAY

Ausgewählte öffentliche Tutorials

1. Bereitstellung von IQuest-Coder-V1 mit vLLM+Open WebUI

IQuest-Coder-V1 ist ein fortschrittliches KI-Modell von IQuestLab mit Fokus auf Codegenerierung, -verständnis und -optimierung. Es bietet verschiedene Parameterskalen (7B, 14B, 40B) und Versionen (Instruct, Thinking, Loop), um unterschiedlichen Entwicklungsanforderungen gerecht zu werden. Mithilfe einer mehrstufigen Trainingsstrategie lernt es aus statischen Code-Snippets und gewinnt Erkenntnisse aus dem Codeentwicklungsprozess, wodurch sein Verständnis realer Entwicklungsszenarien deutlich verbessert wird.

Online ausführen:https://go.hyper.ai/vk4K2

2.vLLM+Open WebUI-Bereitstellung von QwenLong-L1.5

QwenLong-L1.5 ist eine Reihe von Modellen für kontextbezogenes Schließen und Speichermanagement, die vom Alibaba Tongyi Lab entwickelt wurden. Dieses Tutorial verwendet QwenLong-L1.5-30B-A3B, ein Dekodierungs-Transformer-Modell mit ca. 30 Milliarden Parametern. Es wurde durch systematisches Nachtraining auf Basis des Modells Qwen3-30B-A3B-Thinking entwickelt und ist als Open Source auf Plattformen wie Hugging Face verfügbar. Es nutzt verschiedene Nachtrainingstechniken, darunter eine Pipeline zur Synthese von Langzeitdaten, stabiles Reinforcement Learning für lange Sequenzen und ein Framework zur Speicheroptimierung für extrem lange Kontexte. Dies führt zu überragenden Ergebnissen in Benchmarks für lange Kontexte. Darüber hinaus wurden diese Fähigkeiten auf allgemeine Anwendungsbereiche übertragen, darunter mathematisches Schließen, Werkzeugnutzung und Konsistenz in langen Dialogen.

Online ausführen:https://go.hyper.ai/6mD9U

3. Qwen-Image-2512: Realistischere Porträts und Naturlandschaften erzeugen

Qwen-Image-2512 ist ein grundlegendes Text-zu-Bild-Modell der Qwen-Image-Serie und eine Ende des Jahres veröffentlichte, verbesserte Version. Dieses Modell ist primär für die Generierung hochwertiger Bilder und die Darstellung komplexer multimodaler Inhalte konzipiert. Im Vergleich zu Vorgängerversionen wurde Qwen-Image-2512 in mehreren Schlüsselbereichen systematisch optimiert, wodurch der Realismus und die Benutzerfreundlichkeit der generierten Bilder deutlich verbessert wurden. Insbesondere die Natürlichkeit der Porträtgenerierung wurde erheblich gesteigert, sodass Gesichtsstruktur, Hauttextur und Lichtverhältnisse realistischeren Fotoeffekten ähneln. In natürlichen Szenen kann das Modell detailliertere Geländetexturen, Vegetationsdetails und hochfrequente Informationen wie Tierfell generieren. Gleichzeitig wurde die Fähigkeit des Modells, Text in Bildern zu generieren und zu formatieren, verbessert, was eine stabilere Darstellung von lesbarem Text und komplexen Textlayouts ermöglicht.

Online ausführen:https://go.hyper.ai/rODFG

Interpretation von Gemeinschaftsartikeln

1. Online-Tutorial | Qwen-Image-2512 Offiziell Open Source: Verabschieden Sie sich vom Plastik-Look von KI-Rohbildern und erzielen Sie realistische Haardarstellung mit einfachen Textbefehlen

Obwohl Open-Source-Bildgenerierungsmodelle schnell Bilder erzeugen können, erreichen sie oft nicht den gewünschten Realismus, insbesondere bei Porträts und komplexen Naturszenen. Generierte Gesichter wirken häufig künstlich oder verschwommen, und die Haut hat keine realistische Textur. Bei Naturlandschaften wirken die Modelle oft steif, wenn es darum geht, die feinen Texturen von Wasser und Vegetation darzustellen. Um dem entgegenzuwirken, hat das Tongyi Lab von Alibaba kürzlich sein Bildgenerierungsmodell der nächsten Generation, Qwen-Image-2512, als Open Source veröffentlicht. Es zeichnet sich durch seine besonderen Merkmale aus und konzentriert sich auf einen Quantensprung in drei Kernbereichen: realistischere menschliche Texturen, feinere natürliche Texturen und eine verbesserte Darstellung komplexer Texte.

Den vollständigen Bericht ansehen:https://go.hyper.ai/S3HJE

2. Die Genauigkeit erreicht 97%! Die Princeton University und andere schlagen MOFSeq-LMM vor, mit dem sich effizient vorhersagen lässt, ob MOFs synthetisiert werden können.

Die freie Energie ist ein entscheidender Indikator für die Beurteilung der thermodynamischen Stabilität und Synthetisierbarkeit von MOFs. Herkömmliche Rechenmethoden sind jedoch bei großen MOF-Datensätzen extrem rechenaufwändig und erschweren somit ein schnelles Screening. Um diese Herausforderung zu bewältigen, entwickelte ein gemeinsames Forschungsteam der Princeton University und der Colorado School of Mines eine effiziente, auf maschinellem Lernen basierende Vorhersagemethode. Diese Methode nutzt ein Large Language Model (LLM), um die freie Energie direkt aus den Struktursequenzen von MOFs vorherzusagen. Dadurch werden die Rechenkosten deutlich reduziert und eine skalierbare, hocheffiziente thermodynamische Bewertung von MOFs ermöglicht. Das Modell zeichnet sich durch hohe Vielseitigkeit aus, ohne dass ein erneutes Training erforderlich ist: Sein F1-Score erreicht 97% bei der Bestimmung, ob die freie Energie des MOFs über oder unter einem empirisch ermittelten Schwellenwert für die Synthetisierbarkeit liegt.

Den vollständigen Bericht ansehen:https://go.hyper.ai/gBEeA

3. ChatGPT verfügt über Hunderte Millionen Nutzer, aber eine Konversionsrate von weniger als 101.300 zahlenden Kunden. Wie lässt sich KI in nachhaltige Gewinne umwandeln?

Seit 2025 rückt die Diskrepanz zwischen massiven Investitionen in künstliche Intelligenz (KI) und deren wirtschaftlichen Erträgen immer stärker in den Fokus der öffentlichen Meinung. Während globale Technologiekonzerne weiterhin auf KI-Infrastruktur und Algorithmenentwicklung setzen und KI als Motor der nächsten industriellen Revolution propagieren, beobachten Kapitalmärkte, Makroanalysten und unabhängige Beobachter zunehmend die Aktienperformance von KI-Unternehmen. Vor diesem Hintergrund hat sich die Bewertung von KI-Investitionen und deren wirtschaftlichen Erträgen von einem technologieorientierten Elitarismus hin zu einer pragmatischen, finanzwirtschaftlichen Analyse verlagert, die sich vor allem auf die beiden Kernsektoren B2B und B2C konzentriert, in denen enorme Kapitalvolumina binden.

Den vollständigen Bericht ansehen:https://go.hyper.ai/hE5yN

Beliebte Enzyklopädieartikel

1. Bilder pro Sekunde (FPS)

2. Bidirektionales Long Short-Term Memory (Bi-LSTM)

3. Verkörperte Navigation

4. RewardMap, ein mehrstufiges Reinforcement-Learning-Framework

5. Raten – Nachdenken – Antworten

Hier sind Hunderte von KI-bezogenen Begriffen zusammengestellt, die Ihnen helfen sollen, „künstliche Intelligenz“ zu verstehen:

Zentrale Verfolgung der wichtigsten wissenschaftlichen KI-Konferenzen:https://go.hyper.ai/event

Das Obige ist der gesamte Inhalt der Auswahl des Herausgebers dieser Woche. Wenn Sie über Ressourcen verfügen, die Sie auf der offiziellen Website von hyper.ai veröffentlichen möchten, können Sie uns auch gerne eine Nachricht hinterlassen oder einen Artikel einreichen!

Bis nächste Woche!