Command Palette

Search for a command to run...

IQuest-Coder-V1: コードフローに基づいてトレーニングされたプログラミング ロジック拡張モデル。Human Face Emotions: 複数の注釈が付けられた顔の感情認識データセット。

現在、AI コード生成ツールは広く使用されていますが、生成されたコード ロジックが硬直している、コンテキストの理解が不十分である、実際の開発プロセスを模倣するのが難しいなどの課題に直面することがよくあります。多くのモデルは、コード スニペットの「静的スナップショット」からのみ学習し、コードを変更する理由と方法についての深い理解が欠けているため、生成されたコードの有用性が制限されます。

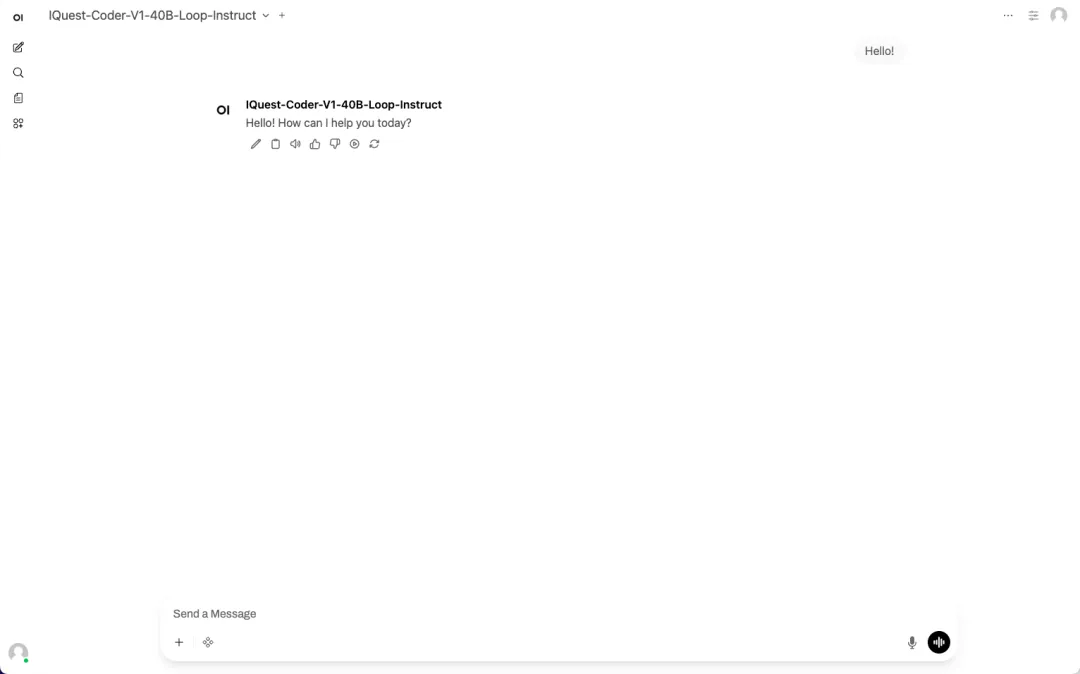

これに基づき、Jiukun Investment傘下のZhizhi Innovation Research Instituteは、2026年1月にIQuest-Coder-V1コードモデルシリーズをリリースしました。このモデルは、「コードフロー」という独自の概念に基づいて構築されています。その革新的な点は、膨大な量の実際のコード変更履歴から学習し、経験豊富な開発者のようにソフトウェアの進化の動的なプロセスを理解できることにあります。さらに、モデルによって生成されたコードは、正確性、保守性、開発者の意図との整合性の点で非常に優れたパフォーマンスを発揮し、複数ステップの推論を必要とする複雑なプログラミング タスクをより適切に処理できます。メインバージョンには 400 億のパラメータがあり、内部反復コード最適化と 128K の長いコンテキストのネイティブ サポートを可能にするループ アーキテクチャを採用しているため、複雑なプログラミング タスクを処理する能力が大幅に向上します。

「IQuest-Coder-V1 モデル」が HyperAI ウェブサイトで公開されました。ぜひお試しください!

オンラインでの使用:https://go.hyper.ai/vk4K2

1月12日から1月16日までのhyper.ai公式サイトの更新内容の概要は次のとおりです。

* 高品質の公開データセット: 6

* 高品質なチュートリアルのセレクション: 3

* コミュニティ記事の解釈:3件

* 人気のある百科事典のエントリ: 5

1月締め切りのトップカンファレンス:8

公式ウェブサイトにアクセスしてください:ハイパーアイ

公開データセットの選択

1. 人間の顔の感情データセット

Human Face Emotionsは、表情認識タスクのための画像分類データセットです。コンピュータービジョンと感情認識の研究のための基礎的なトレーニングデータと評価データを提供することを目的としています。このデータセットは感情カテゴリ別に構成されており、5つの顔感情カテゴリ(それぞれ約8,000枚以上の顔画像サンプル)が含まれています。データセットは個々の顔画像を基本サンプル単位とし、感情カテゴリごとにフォルダ分けされています。画像データは複数の公開オンラインプラットフォームから取得されており、様々な人物、撮影条件、背景シーンをカバーしており、優れた多様性を示しています。

直接使用します:https://go.hyper.ai/Z2ouP

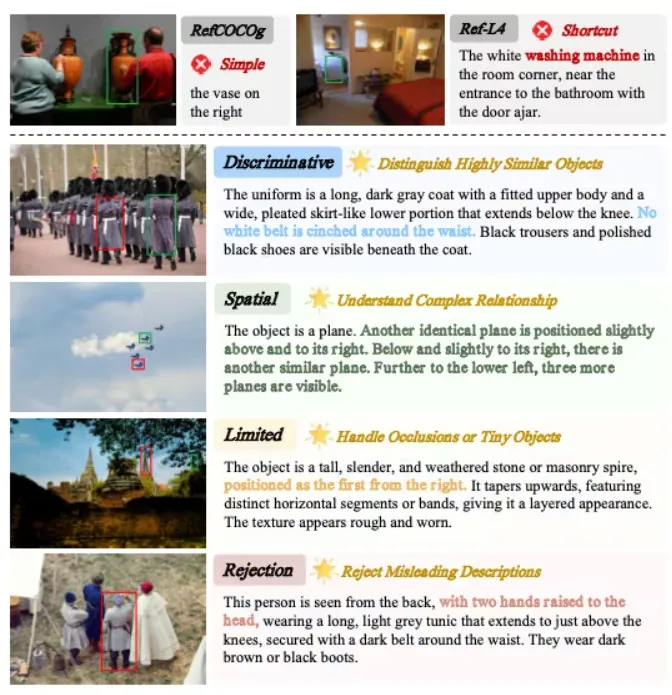

2. GroundingME 複雑シーン理解評価データセット

GroundingMEは、清華大学がXiaomiおよび香港大学と共同で2025年に公開した、マルチモーダル大規模言語モデル(MLLM)の視覚参照評価データセットです。このデータセットは、実世界の複雑なシーンにおいて、自然言語を視覚ターゲットに正確にマッピングするモデルの能力を体系的に評価することを目的としています。特に、曖昧な参照、複雑な空間関係、小さなターゲット、遮蔽、非参照状況における理解と安全性のパフォーマンスに重点を置いています。

直接使用します:https://go.hyper.ai/nJSaK

3. Nemotron-Math-v2 数学推論データセット

Nemotron-Math-v2 は、NVIDIA Corporation が 2025 年にリリースした数学的推論データセットです。これは主に、構造化された数学的推論を実行するための LLM のトレーニング、ツール強化推論と純粋言語推論の違いの研究、および長期コンテキストまたはマルチトラック推論システムの構築に使用されます。

直接使用します:https://go.hyper.ai/6OKuq

4. HydroBASINSグローバル河川区画データセット

HydroBASINSは、HydroSHEDSの水文学コアレイヤーに基づく、全球規模の河川区分データセットです。15秒角の空間解像度で、シームレスな全球河川区分を提供します。このデータセットは、水文学、生態学、環境分析をサポートするように設計されており、一貫性のある階層的な集水域境界と河川ネットワークトポロジを提供します。水文学および水資源、気候および地球システムモデリング、生物多様性および保全プログラム、集水域環境分析、大規模空間モデリング、GISワークフローなど、さまざまなアプリケーションに適しています。

直接使用します:https://go.hyper.ai/53vN4

5. バッテリー故障表面データセット

Battery Failure Surfacesは、様々な動作ストレス下におけるバッテリーのライフサイクルと故障モードを研究するために設計された、バッテリー故障シミュレーションデータセットです。この物理学に着想を得た合成データセットは、充放電サイクル中のバッテリーの状態変化をシミュレートし、リスクモデリングや安全境界の発見に適しています。

直接使用します:https://go.hyper.ai/hRapq

6. グローバルグリーンエネルギーパルスデータセット

グローバル・グリーンエネルギー・パルス・データセットは、世界の主要都市における再生可能エネルギー分析のためのデータセットです。このデータセットは、研究者や政策立案者が、特にネットゼロ経済への移行を進める都市の文脈において、様々な都市のグリーンエネルギーの潜在的可能性を理解するのに役立つことを目的としており、時系列予測、地理空間分析、そして世界のエネルギー最適化に関する研究のための豊富なデータ基盤を提供します。

直接使用します:https://go.hyper.ai/p8NAY

選択された公開チュートリアル

1. vLLM+Open WebUIを使用してIQuest-Coder-V1をデプロイする

IQuest-Coder-V1は、IQuestLabがリリースしたコード生成、理解、最適化に重点を置いた高度なAIモデルです。多様な開発ニーズに対応するため、様々なパラメータスケール(7B、14B、40B)とバージョン(Instruction、Thinking、Loop)を提供しています。「多段階コードフロートレーニング」戦略を採用し、静的コードスニペットから学習することで、コード進化プロセスから知識を獲得し、実際の開発シナリオへの理解を大幅に向上させます。

オンラインで実行:https://go.hyper.ai/vk4K2

2.vLLM+QwenLong-L1.5 の Open WebUI の展開

QwenLong-L1.5は、アリババ同義研究所が発表したロングコンテキスト推論および記憶管理モデルシリーズです。本チュートリアルでは、約300億個のパラメータを持つデコードTransformerモデルであるQwenLong-L1.5-30B-A3Bを使用します。これは、ベースモデルであるQwen3-30B-A3B-Thinkingをベースに体系的な事後学習を経て得られたもので、Hugging Faceなどのプラットフォームでオープンソースとして公開されています。ロングコンテキストデータ合成パイプライン、長いシーケンスのための安定した強化学習、記憶強化のための超ロングコンテキストフレームワークなど、一連の事後学習技術を採用しており、ロングコンテキストベンチマークにおいて優れた性能を発揮します。さらに、これらの能力は、数学的推論、ツールの使用、長時間対話の一貫性といった一般領域タスクにも応用されています。

オンラインで実行:https://go.hyper.ai/6mD9U

3. Qwen-Image-2512: よりリアルな肖像画や自然風景を生成

Qwen-Image-2512は、Qwen-Imageシリーズの基礎となるテキスト画像変換モデルであり、年末にリリースされたアップグレード版です。このモデルは、主に高品質な画像生成と複雑なマルチモーダルコンテンツ表現シナリオ向けに設計されています。以前のバージョンと比較して、Qwen-Image-2512はいくつかの主要な側面で体系的な最適化が行われ、生成された画像の全体的なリアリティと使いやすさが大幅に向上しました。具体的には、ポートレート生成の自然さが大幅に向上し、顔の構造、肌の質感、照明の関係が、よりリアルな写真効果に近づきました。自然シーンでは、より詳細な地形のテクスチャ、植生の詳細、動物の毛皮などの高頻度情報を生成できます。同時に、画像内のテキスト生成とフォーマット機能も向上し、読みやすいテキストと複雑なテキストレイアウトをより安定して表示できるようになりました。

オンラインで実行:https://go.hyper.ai/rODFG

コミュニティ記事の解釈

1. オンラインチュートリアル | Qwen-Image-2512 公式オープンソース: AI RAW画像のプラスチックのような見た目とはお別れ。テキストコマンドだけでリアルなヘアレンダリングを実現

オープンソースの画像生成モデルは画像を迅速に生成できますが、特に肖像画や複雑な自然風景を扱う場合、究極のリアリティを実現するには至らない場合が多くあります。生成された顔はプラスチックのようにぼやけたり、特徴がぼやけたり、肌の質感がリアルに欠けたりすることがよくあります。自然風景の場合、水や植物の繊細な質感を表現する際に、モデルが硬く見えてしまうことがよくあります。この問題に対処するため、アリババのTongyi Labは最近、次世代画像生成モデルであるQwen-Image-2512をオープンソース化しました。その機能は非常に独特で、よりリアルな人間の質感、より繊細な自然物の質感、そして複雑なテキストのより強力なレンダリングという3つのコア機能の飛躍的な向上に重点を置いています。

レポート全体を表示します。https://go.hyper.ai/S3HJE

2. 精度は97%に到達!プリンストン大学らがMOF合成可能かどうかを効率的に予測するMOFSeq-LMMを提案。

自由エネルギーはMOFの熱力学的安定性と合成可能性を評価する上で重要な指標ですが、従来の計算手法は大規模なMOFデータセットに対しては法外なコストがかかり、迅速なスクリーニングを妨げています。この課題に対処するため、プリンストン大学とコロラド鉱山大学の共同研究チームは、効率的な機械学習ベースの予測手法を提案しました。この手法は、大規模言語モデル(LLM)を用いてMOFの構造配列から自由エネルギーを直接予測することで、計算コストを大幅に削減し、ハイスループットでスケーラブルなMOFの熱力学的評価を可能にします。このモデルは再学習を必要とせず、高い汎用性を発揮します。MOFの自由エネルギーが経験に基づく合成可能性閾値を超えているか下回っているかを判定する際のF1スコアは97%に達します。

レポート全体を表示します。https://go.hyper.ai/gBEeA

3. ChatGPTは数億人のユーザーを誇りますが、有料コンバージョン率は10%未満です。AIを持続可能な利益に転換するにはどうすればよいでしょうか?

2025年以降、人工知能(AI)への巨額投資と商業収益の「ギャップ」がますます世論の焦点となっています。一方では、世界的なテクノロジー大手がAIインフラとアルゴリズム開発に引き続き投資し、AIを次世代産業革命の原動力と位置付けています。一方では、資本市場、マクロ経済分析、そして独立系オブザーバーもAI企業の株価動向を注視し始めています。こうした背景から、AI投資と商業収益の評価は、技術エリート主義から実用的な財務分析へと移行し、主に巨額の資本を担うB2BとB2Cという二大中核セクターに焦点を当てています。

レポート全体を表示します。https://go.hyper.ai/hE5yN

人気のある百科事典の項目を厳選

1. 1秒あたりのフレーム数(FPS)

2. 双方向長短期記憶(Bi-LSTM)

3. 具現化されたナビゲーション

4. 多段階強化学習フレームワークRewardMap

5. 推測する – 考える – 答える

ここには何百もの AI 関連の用語がまとめられており、ここで「人工知能」を理解することができます。

主要な人工知能学会をワンストップで追跡:https://go.hyper.ai/event

上記は、今週編集者が選択したすべてのコンテンツです。hyper.ai 公式 Web サイトに掲載したいリソースがある場合は、お気軽にメッセージを残すか、投稿してお知らせください。

また来週お会いしましょう!