Command Palette

Search for a command to run...

Wenn Multimodales Rechnen an Bedeutung Gewinnt: MiniCPM-o-4.5 Deckt Mit Nur 9 Bytes Echtzeit-Bildverständnis Und Textgenerierung Ab; vLLM Omni Unterstützt Gleichzeitig Hochdurchsatz-Bereitstellung Und Serviceorientierte Architektur Sowohl Für Text- Als Auch Für Multimodale Modelle.

An diesem kritischen Punkt, an dem multimodale Großmodelle den Übergang von „brauchbar“ zu „einfach zu bedienen“ vollziehen, gewinnen Parametergröße, Inferenzkosten und Implementierungshürden ebenso an Bedeutung wie die Modellfähigkeiten selbst. Die neueste Version von OpenBMB, MiniCPM-o-4.5,Die vollmodale Funktionalität von Omni basiert auf lediglich 9B Parametern und bietet somit eine optimale Lösung zwischen geringem Speicherbedarf und hoher Leistung.

MiniCPM-o-4.5 nutzt eine einheitliche Architektur zur gemeinsamen Modellierung und Generierung von Ausgaben aus multimodalen Eingaben wie Text und Bildern. Dabei wird die synergistische Optimierung der modalitätsübergreifenden Ausrichtung und der Inferenzeffizienz besonders hervorgehoben. Dank seiner Modellgröße von nur 9 Byte ist es für den Einsatz auf gängigen Consumer-GPUs geeignet und somit im Vergleich zu umfangreichen, proprietären Modellen hinsichtlich Speicherverbrauch und Reaktionszeit benutzerfreundlicher.

derzeit,Die offizielle Website von HyperAI ist jetzt online."MiniCPM-o-4_5: Wallfacer Intelligence Open Source Full-Duplex Full-Modal Model"Kommen Sie und probieren Sie es aus~

Online-Nutzung:https://go.hyper.ai/iOGzO

Ein kurzer Überblick über die Aktualisierungen der offiziellen Website von hyper.ai vom 24. bis 27. Februar:

* Hochwertige öffentliche Datensätze: 3

* Hochwertige Tutorials: 14

* Beliebte Enzyklopädieeinträge: 5

Besuchen Sie die offizielle Website:hyper.ai

Ausgewählte öffentliche Datensätze

1. THINGS-EEG EEG-Datensatz

THINGS-EEG ist ein Elektroenzephalogramm-Datensatz (EEG) für die Objekterkennungsforschung. Er wurde unter anderem vom National Institute of Mental Health der National Institutes of Health (NIH), dem Max-Planck-Institut für Kognitions- und Neurowissenschaften in Deutschland und der Medizinischen Fakultät der Universität Gießen veröffentlicht. Der Datensatz zeichnet die EEG-Aktivität von 50 Probanden beim Betrachten von Objektbildern auf und dient der Analyse der zeitlichen Dynamik und der kognitiven Repräsentationen der Objektverarbeitung.

Direkte Verwendung:https://go.hyper.ai/kqejl

2. THINGS-MEG-Magnetoenzephalographie-Datensatz

THINGS-MEG ist ein Datensatz der Magnetoenzephalographie (MEG) für die Objekterkennungsforschung. Er wurde unter anderem vom National Institute of Mental Health der National Institutes of Health (NIH) in den USA, dem Max-Planck-Institut für Kognitions- und Neurowissenschaften in Deutschland und der Medizinischen Fakultät der Universität Gießen veröffentlicht. Der Datensatz erfasst die elektromagnetische Hirnaktivität im Millisekundenbereich, während Probanden Bilder von Objekten betrachten, und dient der Analyse der zeitlichen Dynamik der Objektverarbeitung.

Direkte Verwendung:https://go.hyper.ai/eBKWI

3. THINGS-fMRI-Datensatz für funktionelle Magnetresonanztomographie

THINGS-fMRI ist ein hochauflösender Datensatz funktioneller Magnetresonanztomographie (fMRT) für die Objekterkennungsforschung. Er wurde unter anderem vom National Institute of Mental Health (NIMH) der National Institutes of Health (NIH) in den USA, dem Max-Planck-Institut für Kognitions- und Neurowissenschaften in Deutschland und der Medizinischen Fakultät der Universität Gießen gemeinsam veröffentlicht. Ziel ist die systematische Charakterisierung der visuellen und semantischen Repräsentation von Objekten in der realen Welt im menschlichen Gehirn.

Direkte Verwendung:https://go.hyper.ai/CRbiA

Ausgewählte öffentliche Tutorials

Diese Woche haben wir drei Arten hochwertiger öffentlicher Tutorials zusammengestellt:

* OCR-Tutorials: 4

* Multimodale Tutorials: 6

* Tutorial zu großen Sprachmodellen: 4 Teile

OCR-Tutorial

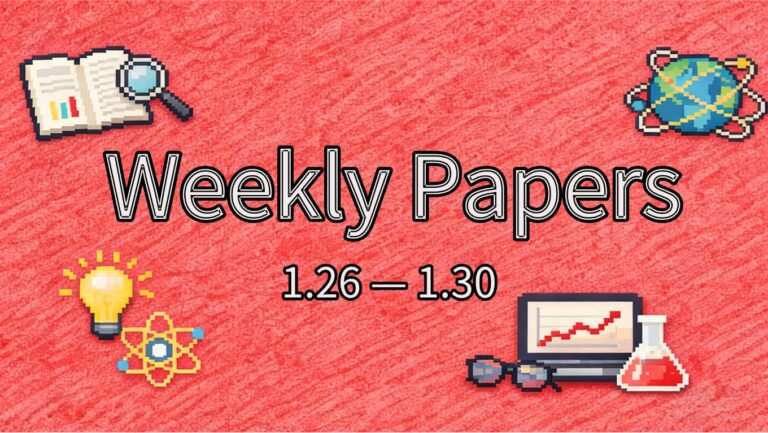

1. GLM-OCR Leichtgewichtiges multimodales OCR-Erkennungssystem

GLM-OCR ist ein schlankes, multimodales OCR-Modell (0,9 B), das im Februar 2026 von Zhipu AI als Open Source veröffentlicht wurde. Es konzentriert sich auf hochpräzise Texterkennung und strukturiertes Parsen in komplexen Dokumenten. Zu seinen Hauptvorteilen zählen geringe Größe, hohe Präzision und einfache Implementierung. Basierend auf einer multimodalen GLM-V-Encoder-Decoder-Architektur integriert es den selbstentwickelten visuellen Encoder CogViT und die RLHF-Optimierung. Im OmniDocBench V1.5-Benchmark erzielte es mit 94,62 Punkten den besten Wert aller bisherigen OCR-Modelle und erreichte eine Leistung, die nahe an die des Gemini-3-Pro heranreicht. Es eignet sich für verschiedene Anwendungsbereiche wie das Parsen von Bürodokumenten, die Erkennung von Formeln in Bildung und Wissenschaft, die Verifizierung von Regierungs- und Finanzdokumenten sowie die Extraktion von Code-Snippets.

Online ausführen:https://go.hyper.ai/kgb3n

2. PaddleOCR-VL-1.5: Lokale OCR basierend auf vLLM

PaddleOCR-VL-1.5 ist eines der multimodalen OCR-Modelle der PaddleOCR-Serie des PaddlePaddle-Teams. Es bietet verbesserte Texterkennung und Layoutanalyse für komplexe Dokumente (Rechnungen, Verträge, Papiere, Scans usw.). Dieses Tutorial nutzt die OpenAI-kompatible Schnittstelle von vLLM, um eine Verbindung zu diesem Modell herzustellen und so den gesamten Prozess vom Hochladen von Bildern bis zur Ausgabe der Erkennungsergebnisse zu realisieren. Mit 0,9 Milliarden Parametern erreicht es eine Genauigkeit der neuen Generation von 94,51 TP3T auf OmniDocBench v1.5.

Online ausführen:https://go.hyper.ai/cea6x

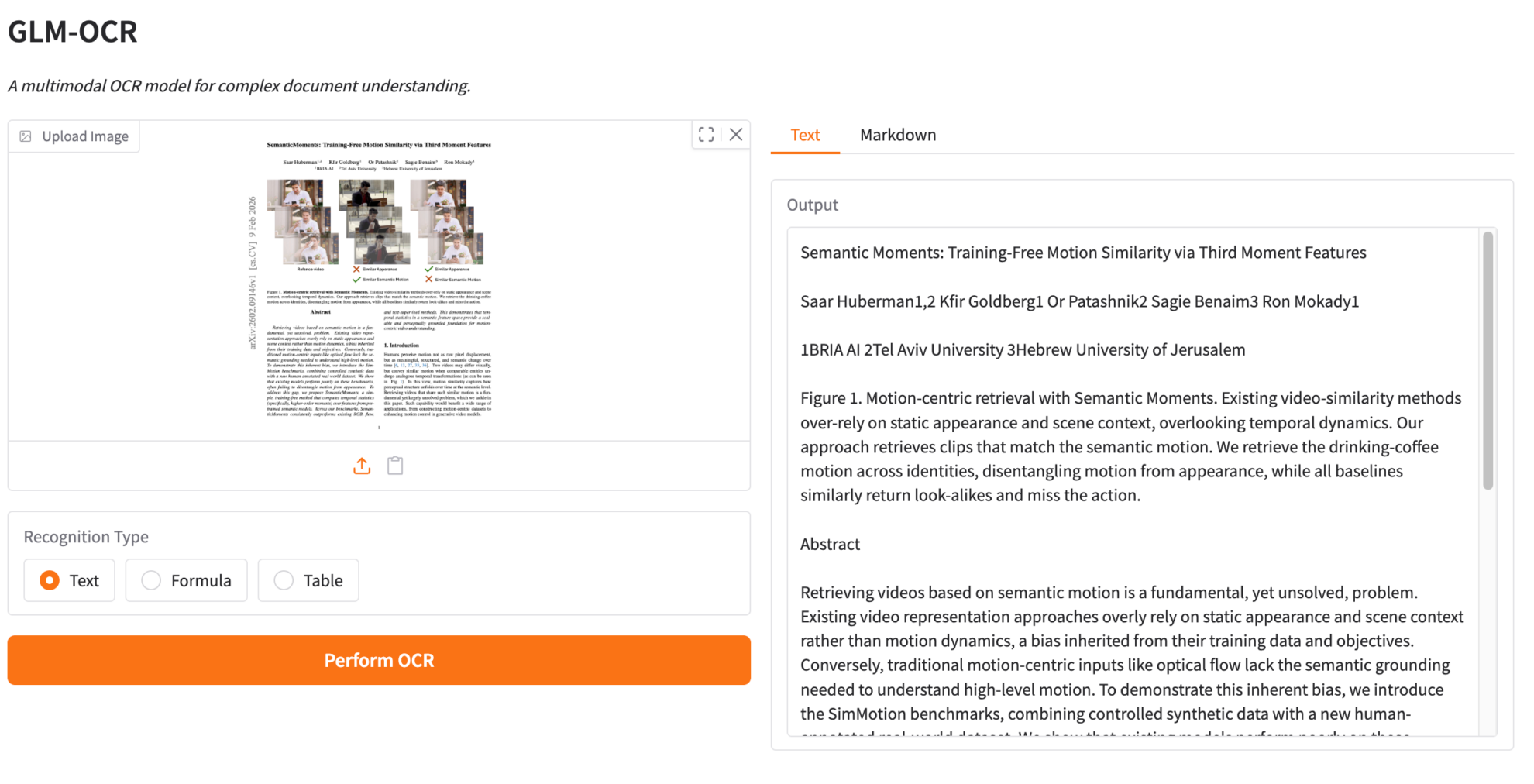

3.LightOnOCR-2-1B Leichtes, leistungsstarkes End-to-End-OCR-Modell

LightOnOCR-2-1B ist das neueste End-to-End-Bildverarbeitungsmodell von LightOn AI. Als Flaggschiff der LightOnOCR-Serie vereint es Dokumentenanalyse und Textgenerierung in einer kompakten Architektur, verfügt über eine Milliarde Parameter und ist auf handelsüblichen GPUs lauffähig. Dieses Modell nutzt eine Vision-Language-Transformer-Architektur und integriert die RLVR-Trainingstechnologie, wodurch eine extrem hohe Erkennungsgenauigkeit und Inferenzgeschwindigkeit erreicht werden. Es wurde speziell für Anwendungen entwickelt, die die Verarbeitung komplexer Dokumente, handgeschriebener Texte und LaTeX-Formeln erfordern.

Online ausführen:https://go.hyper.ai/cLSj5

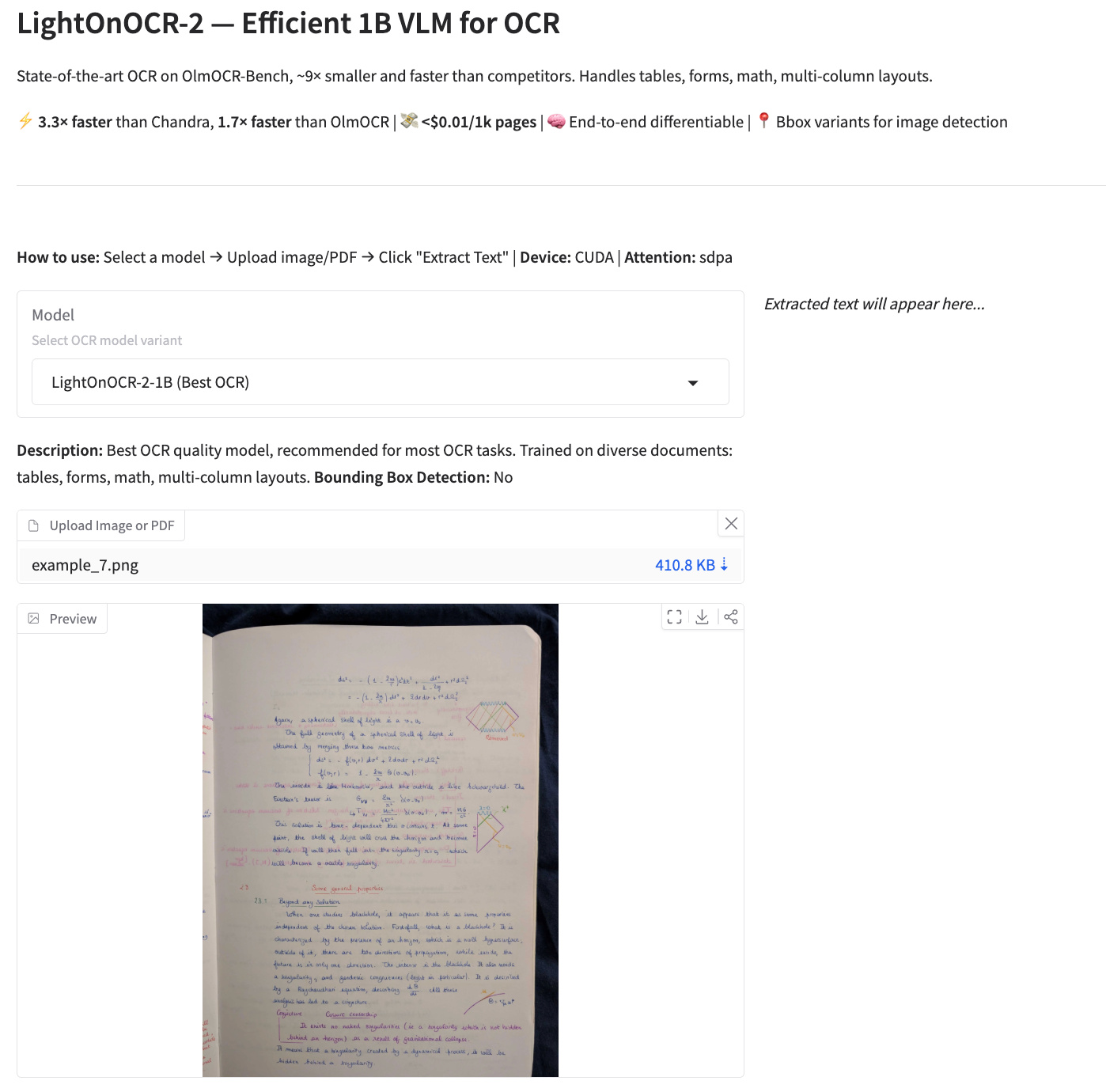

4. DeepSeek-OCR 2 Visueller Kausalfluss

DeepSeek-OCR 2 ist das OCR-Modell der zweiten Generation des DeepSeek-Teams. Durch die Einführung der DeepEncoder V2-Architektur gelingt ein Paradigmenwechsel von statischem Scannen hin zu semantischem Schließen. Das Modell nutzt kausale Stream-Abfragen und einen Dual-Stream-Aufmerksamkeitsmechanismus, der visuelle Token dynamisch neu anordnet, um die natürliche Leselogik komplexer Dokumente präziser nachzubilden. Im OmniDocBench v1.5-Benchmark erzielte das Modell eine Gesamtpunktzahl von 91,09% – eine deutliche Verbesserung gegenüber dem Vorgängermodell. Gleichzeitig wurde die Wiederholungsrate der OCR-Erkennungsergebnisse signifikant reduziert, was einen neuen Weg für die Entwicklung eines vollmodalen Encoders in der Zukunft eröffnet.

Online ausführen:https://go.hyper.ai/iOGzO

Multimodales Tutorial

1. MiniCPM-o-4.5: Das Open-Source-Vollduplex-Vollmodalmodell von Wallfacer Intelligence

MiniCPM-o-4.5 ist ein 9-B-Parameter-Vollmodalmodell, das von Facewall Intelligence und dem Natural Language Processing Lab der Tsinghua-Universität im Februar 2026 als Open Source veröffentlicht wurde. Es nutzt eine durchgängige Architektur mit siglip2, whisper, cozyvoice2 und qwen3-8b. Als branchenweit erstes Modell mit Unterstützung für „Echtzeit-Dialog“ ermöglicht es Vollduplex-Interaktion – Nutzer können gleichzeitig sehen, hören und sprechen und lösen sich damit vom traditionellen, rundenbasierten „Walkie-Talkie“-Modus. Dieses Modell zeichnet sich durch führende visuelle Verständnisfähigkeiten, hyperhumanoide Sprachgenerierung und Sprachklonierung aus. Es unterstützt proaktive Interaktion und Echtzeit-Streaming-Media-Verarbeitung und kann auf Edge-Geräten ausgeführt werden. Es ist mit verschiedenen inländischen Chips wie ascend und Hygon kompatibel und lässt sich effizient mit Frameworks wie llama.cpp und vLLM implementieren.

Online ausführen:https://go.hyper.ai/iOGzO

2.Bereitstellung von Qwen-Image-Edit mit vLLM-Omni

Qwen-Image-Edit ist ein vielseitiges Bildbearbeitungsprogramm von Alibaba. Es bietet sowohl semantische als auch visuelle Bearbeitungsfunktionen und ermöglicht so einfache visuelle Änderungen (wie das Hinzufügen, Löschen oder Ändern von Elementen) als auch komplexe semantische Bearbeitungen (wie das Erstellen von Bildbereichen, das Drehen von Objekten und das Übertragen von Stilen). Das Programm unterstützt die präzise Bearbeitung von chinesischem und englischem Text innerhalb von Bildern, wobei Schriftart, -größe und -stil erhalten bleiben.

Online ausführen:https://go.hyper.ai/4w6XA

3. Schritt 3-VL-10B: Multimodales visuelles Verständnis und grafischer Dialog

Step3-VL-10B ist ein Open-Source-Modell der visuellen Sprachgrundlage, das vom StepFun-Team speziell für multimodale Verständnis- und komplexe Denkaufgaben entwickelt wurde. Es zielt darauf ab, das Verhältnis zwischen Effizienz, Denkfähigkeit und Qualität des visuellen Verständnisses neu zu definieren und eignet sich für multimodale Modelle mit einer begrenzten Parameteranzahl. Trotz seiner geringen Parameteranzahl zeigt dieses Modell überragende Leistungen in der visuellen Wahrnehmung, im komplexen Denken und in der Ausrichtung auf menschliche Anweisungen. Es übertrifft in verschiedenen Benchmarks durchweg Modelle ähnlicher Größe und kann in bestimmten Aufgaben mit Modellen mit 10- bis 20-mal mehr Parametern mithalten.

Online ausführen:https://go.hyper.ai/RqTTW

4. Qwen-Image-2512 mit vLLM-Omni bereitstellen

Qwen-Image-2512 ist ein grundlegendes Text-zu-Bild-Modell der Qwen-Image-Serie, das primär für die Generierung hochwertiger Bilder und die Darstellung komplexer multimodaler Inhalte entwickelt wurde. Der Fokus liegt auf der Verbesserung des Realismus und der Benutzerfreundlichkeit der generierten Bilder. Die Porträtgenerierung wirkt deutlich natürlicher, da Gesichtsstruktur, Hauttextur und Lichtverhältnisse realistischeren Fotografien ähneln. In natürlichen Szenen generiert das Modell detailliertere Geländetexturen, Vegetationsdetails und hochfrequente Informationen wie Tierfell. Auch die Textgenerierung und Typografiefunktionen wurden verbessert, wodurch eine stabilere Darstellung lesbarer Texte und komplexer Schriftarten ermöglicht wird.

Online ausführen:https://go.hyper.ai/JMmhs

5. TurboDiffusion: Bild- und textgesteuertes Videogenerierungssystem

TurboDiffusion ist ein hocheffizientes Videodiffusionsgenerierungssystem, das im Dezember 2025 von einem Team der Tsinghua-Universität entwickelt wurde. Basierend auf der Wan2.1-Architektur für Destillation höherer Ordnung zielt das System darauf ab, die Probleme der langsamen Inferenzgeschwindigkeit und des hohen Verbrauchs an Rechenressourcen bei groß angelegten Videomodellen zu lösen und so das Ziel zu erreichen, qualitativ hochwertige Videos mit minimalem Aufwand zu generieren.

Online ausführen:https://go.hyper.ai/VvyVZ

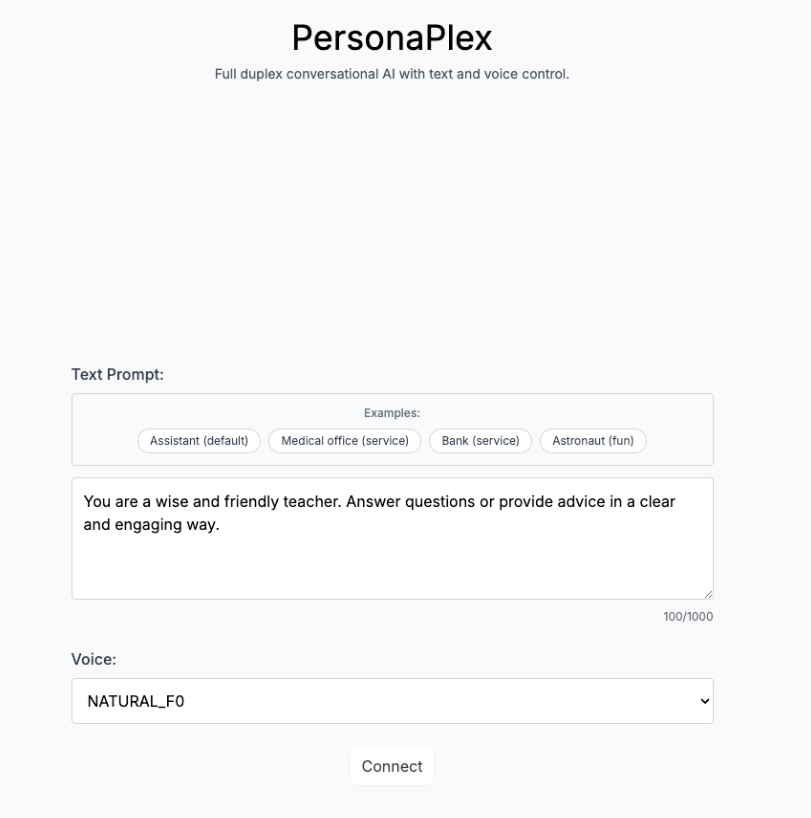

6. Personaplex-7B-v1: Echtzeitdialog und charakterspezifische Sprachschnittstelle

PersonaPlex-7B-v1 ist ein von NVIDIA entwickeltes, multimodales, personalisiertes Dialogmodell mit 7 Milliarden Parametern. Es wurde für Echtzeit-Sprach-/Textinteraktion, Langzeitsimulation der Persona-Konsistenz und multimodale Wahrnehmungsaufgaben konzipiert und zielt darauf ab, ein immersives Rollenspiel- und multimodales Interaktionsdemonstrationssystem mit Reaktionsgeschwindigkeiten im Millisekundenbereich bereitzustellen.

Online ausführen:https://go.hyper.ai/ndoj0

Tutorial zu großen Sprachmodellen

1.llama.cpp+Open WebUI deploy Qwen3-VL-8B-Instruct-GGUF

Qwen3-VL-8B-Instruct-GGUF bietet eine Vielzahl präziser Sprachmodellvarianten und einen dedizierten visuellen MMPROJ-Encoder. Diese Modelle sind mit Tools wie llama.cpp und Ollama kompatibel und eignen sich für eine breite Palette von Hardware, darunter CPUs, NVIDIA-GPUs, Apple Silicon und Intel-GPUs. Qwen3-VL-8B-Instruct-GGUF unterscheidet explizit zwischen Sprach- und visuellen Komponenten im GGUF-Format. Dies ermöglicht Entwicklern die flexible Wahl des Quantisierungsgrades passend zu ihrer Hardware. So werden auch in ressourcenbeschränkten CPU-Umgebungen akzeptable Reaktionszeiten erzielt, während gleichzeitig die Leistung auf Systemen mit GPUs gesteigert wird.

Online ausführen:https://go.hyper.ai/EKryC

2. Jacobi Forcing: Eine schnelle und genaue kausale parallele Dekodierungstechnik

Jacobi Forcing ist eine neuartige Trainingsmethode der Hao AI Labs, die große Sprachmodelle (LLMs) in native kausale Paralleldecoder transformiert. Indem das Modell darauf trainiert wird, verrauschte zukünftige Blöcke entlang seiner eigenen Jacobi-Dekodierungstrajektorie zu verarbeiten, löst diese Methode das Matching-Problem von AR- zu Diffusionsmodellen und erhält gleichzeitig die Integrität der kausalen autoregressiven Grundstruktur.

Online ausführen:https://go.hyper.ai/fIad4

3.vLLM+Open WebUI-Bereitstellung von GLM-4.7-Flash

GLM-4.7-Flash ist ein ressourcenschonendes, multimodales Inferenzmodell, das hohe Leistung und hohen Durchsatz vereint und Chained Thinking (CoT), Tool-Aufrufe und Agentenfunktionen nativ unterstützt. GLM-4.7-Flash nutzt eine Hybrid-Expert-Architektur (MoE) und spärliche Aktivierungsmechanismen, um den Rechenaufwand jeder Inferenz deutlich zu reduzieren und gleichzeitig die Ausdrucksstärke großer Modelle zu erhalten.

Online ausführen:https://go.hyper.ai/a2IN3

4.vLLM+Open WebUI-Bereitstellung von LFM2.5-1.2B-Thinking

LFM2.5-1.2B-Thinking ist ein für Edge-Geräte optimiertes Hybridarchitekturmodell. Als speziell für logische Inferenz optimierte Version der LFM2.5-Serie vereint es die Verarbeitung langer Sequenzen und effiziente Inferenzfunktionen in einer kompakten Architektur. Dieses Modell verfügt über 1,2 Milliarden Parameter und läuft flüssig auf handelsüblichen GPUs und sogar auf Edge-Geräten. Dank einer innovativen Hybridarchitektur (lineares dynamisches System + Aufmerksamkeitsmechanismus) erzielt es eine extrem hohe Speichereffizienz und einen hohen Durchsatz. Es ist speziell für Szenarien konzipiert, die Echtzeit-Inferenz auf dem Gerät erfordern, ohne dabei an Intelligenz einzubüßen.

Online ausführen:https://go.hyper.ai/1XTsV

Interpretation von Gemeinschaftsartikeln

1. Ein europäisches Forschungsteam hat SeaCast vorgeschlagen, ein hochauflösendes regionales Ozeanvorhersagemodell, das 15-Tage-Vorhersagen in nur 20 Sekunden liefern kann.

Unregelmäßige Land-Meer-Verteilung, komplexe Randbedingungen und die Notwendigkeit einer detaillierten Charakterisierung vertikal geschichteter Variablen erschweren die direkte Anpassung bestehender globaler KI-Ozeanmodelle an regionale Aufgaben. Um diesem Problem zu begegnen, entwickelte ein gemeinsames Forschungsteam der Universität Helsinki (Finnland), des Mediterranean Climate Change Research Center und der Universität Salento (Italien) SeaCast, ein Graph-Neuronales-Netzwerk-Modell speziell für die regionale Ozeanvorhersage. Es kann eine 15-Tage-Vorhersage über 18 vertikale Ebenen in einem 1/24°-Gitter in nur 20 Sekunden auf einer einzelnen GPU durchführen.

Den vollständigen Bericht ansehen:https://go.hyper.ai/kRXnE

2. Die Cornell University schlägt ein innovatives KI-Framework zur Entschlüsselung des chemischen Mechanismus hochleitfähiger Lithium-Ionen-Elektrolyte vor und erzielt eine Vorhersagegenauigkeit von über 80 % für %.

Die Chemie von Salz-Lösungsmitteln ist die Grundlage für das Elektrolytverhalten in den meisten Lithium-Ionen-Batteriesystemen. Ihre gezielte Entwicklung wird jedoch durch einen riesigen chemischen Raum mit unzähligen Kombinationsmöglichkeiten und nichtlinearen Struktur-Leistungs-Beziehungen erschwert. Verschärft wird dieses Problem durch die geringe und ungleichmäßige Verteilung experimenteller Daten, was die Generalisierbarkeit von Modellen einschränkt. Ein Forschungsteam der Cornell University hat mit SCAN ein robustes, interpretierbares und dateneffizientes Framework zur Modellierung und Interpretation der Salz-Lösungsmittel-Chemie entwickelt. Dieses Framework verarbeitet effektiv Daten mit langen Ausläufern und erfasst das gesamte Spektrum an Salz-Lösungsmittel-Formulierungen.

Den vollständigen Bericht ansehen:https://go.hyper.ai/OrHIt

3. Eine neue Methode zur Vorhersage der Batterielebensdauer, die von der University of Michigan und anderen vorgeschlagen wurde, reduziert den Verifizierungszyklus um das 40-fache; „Discovery Learning“ spart Auswertungszeit für den 98%.

Eine präzise und effiziente Vorhersage der Batterielebensdauer ist entscheidend für die Forschung und den großflächigen Einsatz von Batterien der nächsten Generation, da sie deren Zuverlässigkeit, Sicherheit und Gesamtlebenszykluskosten direkt bestimmt. Experten von Forschungseinrichtungen wie der University of Michigan haben kürzlich eine innovative Methode des maschinellen Lernens namens „Discovery Learning (DL)“ entwickelt. Diese integriert aktives Lernen, physikalisch beschränktes Lernen und Zero-Shot-Learning auf organische Weise, um ein geschlossenes Lernmodell mit menschenähnlichem Denkvermögen zu schaffen. Unter konservativen Annahmen kann Discovery Learning im Vergleich zu industriellen Verfahren zur Batterielebensdauerprüfung eine Zeitersparnis von 981 TP3T und eine Energieersparnis von 951 TP3T erzielen und den Prüfzyklus von etwa 1.333 Tagen auf 33 Tage verkürzen.

Den vollständigen Bericht ansehen:https://go.hyper.ai/28W2g

4. Zusammenfassung des Papers | Über 100 wichtige Errungenschaften der KI für die Wissenschaft: Ein kurzer Überblick über technologische Innovationen bis 2025

Im vergangenen Jahr hat sich das Verhältnis zwischen KI und wissenschaftlicher Forschung grundlegend und unauffällig gewandelt. Bis 2025 wird KI in der Wissenschaft nicht mehr nur aus vereinzelten technologischen Anwendungen bestehen, sondern sich zu einem klaren, systematischen und wiederverwendbaren Weg für wissenschaftliche Forschung und Innovation entwickeln. KI wird nicht länger nur ein Werkzeug sein, sondern Teil des Forschungsparadigmas werden. HyperAI hat Publikationen aus verschiedenen Bereichen, darunter Medizin, Materialchemie, Meteorologie und Astronomie, zusammengetragen, um Lesern mit unterschiedlichem Hintergrund eine schnelle Suche und Übersicht zu ermöglichen.

Den vollständigen Bericht ansehen:https://go.hyper.ai/FLJGD

Beliebte Enzyklopädieartikel

1. Umgekehrtes Sortieren in Kombination mit RRF

2. Kolmogorov-Arnold-Darstellungssatz

3. Groß angelegtes Multitasking-Sprachverstehen (MMLU)

4. Blackbox-Optimierer

5. Klassenbedingte Wahrscheinlichkeit

Hier sind Hunderte von KI-bezogenen Begriffen zusammengestellt, die Ihnen helfen sollen, „künstliche Intelligenz“ zu verstehen:

Das Obige ist der gesamte Inhalt der Auswahl des Herausgebers dieser Woche. Wenn Sie über Ressourcen verfügen, die Sie auf der offiziellen Website von hyper.ai veröffentlichen möchten, können Sie uns auch gerne eine Nachricht hinterlassen oder einen Artikel einreichen!

Bis nächste Woche!