Command Palette

Search for a command to run...

Wöchentlicher Bericht Zu KI-Veröffentlichungen | NVIDIA Open-Source-Modelle / OpenAI-Benchmarks / Agentensysteme / Kontextbezogene Inferenz... Ein Kurzer Überblick Über KI-Updates

Große Sprachmodelle (LLMs) haben ein erhebliches Potenzial bei der Transformation von Empfehlungssystemen gezeigt – von implizitem Verhaltensmustervergleich hin zu expliziter Intentionenerkennung. RecGPT-V1 leistete Pionierarbeit auf diesem Gebiet, indem es LLM-basierte Inferenz in die Nutzerinteressenanalyse und die Vorhersage von Artikel-Tags integrierte, leidet jedoch unter vier grundlegenden Einschränkungen:

* Geringe Recheneffizienz und kognitive Redundanz über mehrere Denkpfade hinweg;

* Unzureichende Interpretierbarkeit bei der Generierung fester Vorlagen;

* Begrenzte Anwendbarkeit im Rahmen des überwachten Lernparadigmas;

* Einfache, ergebnisorientierte Beurteilungen werden menschlichen Ansprüchen nicht gerecht.

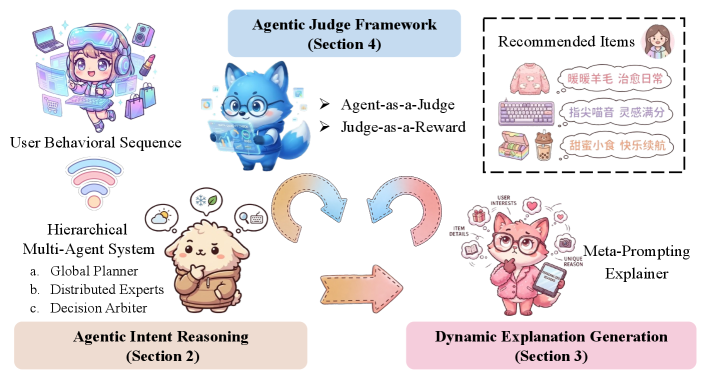

Um bestehende Einschränkungen zu überwinden, hat das Forschungsteam von Alibaba die neueste Version, RecGPT-V2, veröffentlicht. Diese Version beinhaltet vier Kerninnovationen:

* Ein hierarchisches Multiagentensystem entwickeln.

* Ein Meta-Prompting-Framework vorschlagen;

* Einführung eines auf Beschränkungen basierenden Reinforcement-Learning-Mechanismus;

* Entwicklung eines Bewertungsrahmens, der einen Agenten als Richter betrachtet.

RecGPT-V2 hat nicht nur die technische Machbarkeit des Intention-Reasoning auf Basis großer Sprachmodelle bestätigt, sondern auch seine kommerzielle Machbarkeit in groß angelegten industriellen Szenarien unter Beweis gestellt und damit erfolgreich die Lücke zwischen kognitiver Exploration und industrieller Anwendung geschlossen.

Link zum Artikel:https://go.hyper.ai/wftNU

Neueste KI-Artikel:https://go.hyper.ai/hzChC

Um mehr Benutzer über die neuesten Entwicklungen im Bereich der künstlichen Intelligenz in der Wissenschaft zu informieren, wurde auf der offiziellen Website von HyperAI (hyper.ai) jetzt der Bereich „Neueste Artikel“ eingerichtet, in dem täglich hochmoderne KI-Forschungsartikel aktualisiert werden.Hier sind 5 beliebte KI-Artikel, die wir empfehlen, werfen wir einen kurzen Blick auf die bahnbrechenden KI-Errungenschaften dieser Woche ⬇️

Die Zeitungsempfehlung dieser Woche

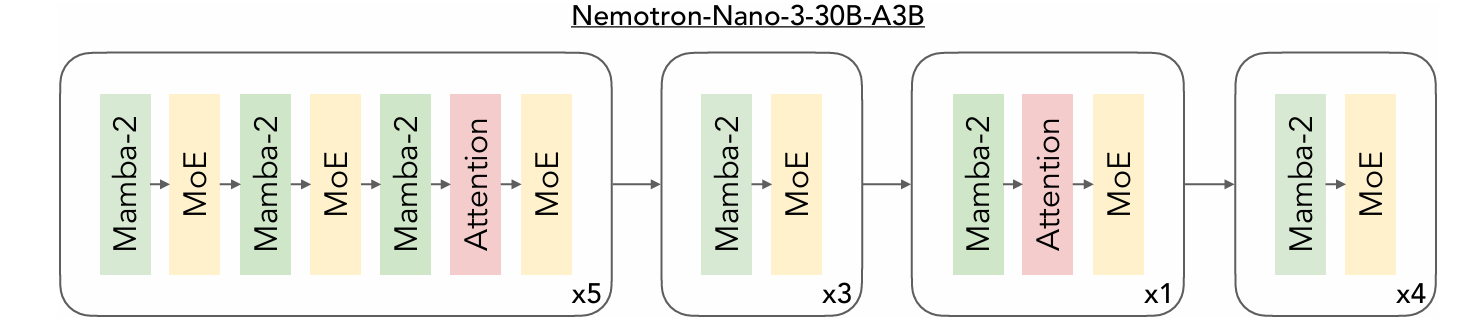

1. Nemotron 3 Nano: Offenes, effizientes Hybridmodell aus Experten und Mamba-Transformer für agentenbasiertes Schließen

Dieser Artikel stellt Nemotron 3 Nano 30B-A3B vor, ein hybrides Mamba-Transformer-Sprachmodell basierend auf einer Mixture-of-Experts-Architektur. Nemotron 3 Nano wurde mit 25 Billionen Text-Tags vortrainiert, darunter über 3 Billionen neue, einzigartige Tags im Vergleich zu Nemotron 2. Anschließend erfolgte ein überwachtes Feintuning und umfangreiches Reinforcement Learning in verschiedenen Umgebungen. Das Modell verbessert das Agentenverhalten, die Schlussfolgerungsfähigkeit und die Dialoginteraktion signifikant und unterstützt Kontextlängen von bis zu 1 Million Tags.

Link zum Artikel:https://go.hyper.ai/LtmY3

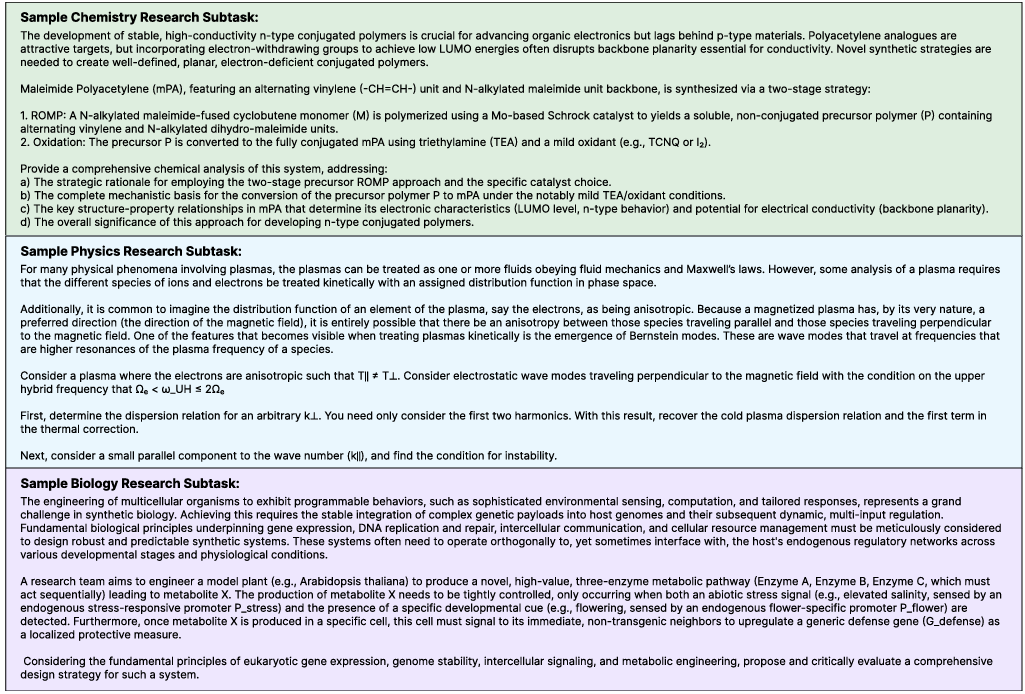

2. Grenzwissenschaften

Diese Arbeit stellt FrontierScience vor, einen Benchmark-Test zur Bewertung der Leistungsfähigkeit künstlicher Intelligenz im wissenschaftlichen Denken auf Expertenniveau. FrontierScience besteht aus zwei Bereichen: (1) dem Olympiade-Bereich, der Aufgaben der Internationalen Mathematik-Olympiaden (IPhO, IChO und IBO) umfasst; und (2) dem Forschungsbereich, der offene Aufgaben auf Doktorandenniveau beinhaltet, die typische Teilprobleme der wissenschaftlichen Forschung repräsentieren.

Link zum Artikel:https://go.hyper.ai/XanPc

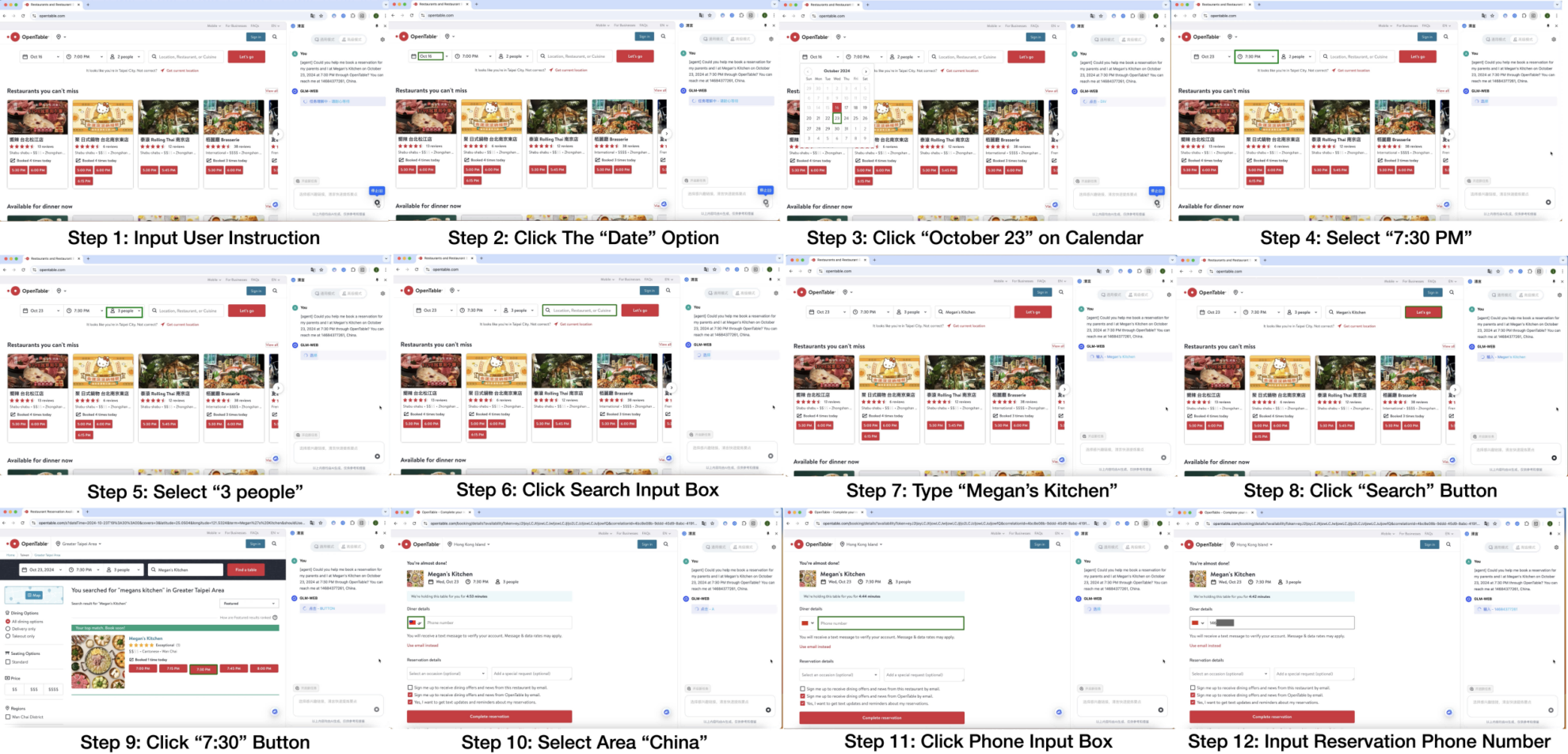

3. AutoGLM: Autonome Foundation Agents für GUIs

Diese Arbeit stellt AutoGLM vor, eine neue Serie innerhalb der ChatGLM-Familie, die als Basisagenten für die autonome Steuerung digitaler Geräte über grafische Benutzeroberflächen (GUIs) konzipiert wurde. Das Forschungsteam entwickelte AutoGLM anhand von Webbrowsern und Mobiltelefonen als typische GUI-Szenarien und schuf so ein praktisches Basisagentensystem für die GUI-Interaktion in realen Anwendungen.

Link zum Artikel:https://go.hyper.ai/SLjro

4. RecGPT-V2 Technischer Bericht

Diese Arbeit stellt RecGPT-V2 vor, das vier Kerninnovationen umfasst: Erstens konstruiert es ein hierarchisches Multiagentensystem; zweitens schlägt es ein Meta-Prompting-Framework vor; drittens führt es einen Mechanismus für eingeschränktes Reinforcement Learning ein; und viertens entwirft es ein Bewertungsframework, das Agenten als Richter einsetzt. RecGPT-V2 beweist nicht nur die technische Machbarkeit von Intention-Reasoning auf Basis großer Sprachmodelle, sondern demonstriert auch seine kommerzielle Anwendbarkeit in groß angelegten industriellen Szenarien und schließt damit erfolgreich die Lücke zwischen kognitiver Exploration und industriellen Anwendungen.

Link zum Artikel:https://go.hyper.ai/TdjZJ

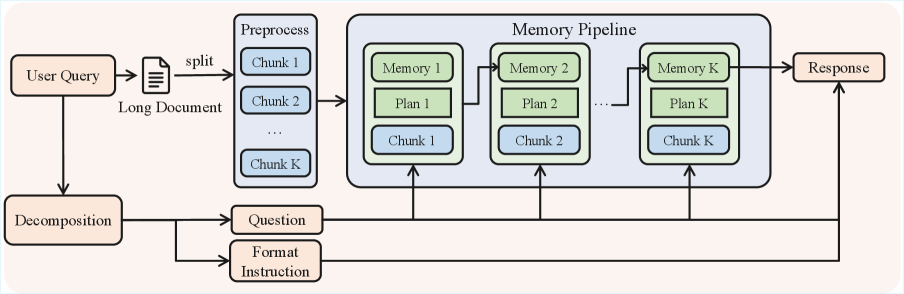

5.Deeper-GXX: Vertiefung beliebiger GNNs

Diese Arbeit stellt QwenLong-L1.5 vor, ein Modell, das durch systematische Innovationen nach dem Training überlegene Fähigkeiten im Kontextschlussfolgern erzielt. Basierend auf der Architektur Qwen3-30B-A3B-Thinking erreicht QwenLong-L1.5 in Benchmarks zum Kontextschlussfolgern vergleichbare Ergebnisse wie GPT-5 und Gemini-2.5-Pro, mit einer durchschnittlichen Verbesserung von 9,90 Punkten gegenüber den Basismodellen. Bei extrem langen Aufgaben (1 bis 4 Millionen Token) erzielt das Memory-Agent-Framework eine signifikante Verbesserung von 9,48 Punkten gegenüber dem Basisagenten.

Link zum Artikel:https://go.hyper.ai/vViJi

Dies ist der gesamte Inhalt der Papierempfehlung dieser Woche. Weitere aktuelle KI-Forschungsarbeiten finden Sie im Bereich „Neueste Arbeiten“ auf der offiziellen Website von hyper.ai.

Wir freuen uns auch über die Einreichung hochwertiger Ergebnisse und Veröffentlichungen durch Forschungsteams. Interessierte können sich im NeuroStar WeChat anmelden (WeChat-ID: Hyperai01).

Bis nächste Woche!