Command Palette

Search for a command to run...

عندما تبدأ الحوسبة متعددة الوسائط في الانطلاق: MiniCPM-o-4.5، بحجم 9 بايت فقط، يغطي فهم الصور في الوقت الحقيقي وتوليد النصوص؛ يدعم vLLM Omni في الوقت نفسه النشر عالي الإنتاجية والبنية الموجهة نحو الخدمة لكل من النصوص والنماذج متعددة الوسائط.

في هذه المرحلة الحرجة، حيث تنتقل النماذج الضخمة متعددة الوسائط من كونها "قابلة للاستخدام" إلى "سهلة الاستخدام"، أصبح حجم المعلمات وتكلفة الاستدلال ومعوقات النشر بنفس أهمية قدرات النموذج. أحدث إصدار من OpenBMB، MiniCPM-o-4.5،تم بناء قدرة Omni الكاملة باستخدام 9B معلمات فقط، مما يوفر حلاً أفضل بين خفة الوزن والأداء العالي.

يستخدم MiniCPM-o-4.5 بنية موحدة لنمذجة وتوليد مخرجات من مدخلات متعددة الوسائط، مثل النصوص والصور، مع التركيز على التحسين التآزري لقدرات المحاذاة بين الوسائط المختلفة وكفاءة الاستدلال. يسمح حجم النموذج البالغ 9 بايت بنشر الاستدلال على وحدات معالجة الرسومات الاستهلاكية الشائعة، مما يجعله أكثر ملاءمة للمهندسين من حيث استخدام الذاكرة وزمن الاستجابة مقارنةً بالنماذج المغلقة المصدر واسعة النطاق.

في الوقت الحالي،الموقع الرسمي لشركة HyperAI متاح الآن."MiniCPM-o-4_5: نموذج Wallfacer Intelligence مفتوح المصدر ثنائي الاتجاه كامل الوضع"تعال وجربها~

الاستخدام عبر الإنترنت:https://go.hyper.ai/iOGzO

نظرة سريعة على تحديثات الموقع الرسمي لشركة hyper.ai من 24 فبراير إلى 27 فبراير:

* مجموعات البيانات العامة عالية الجودة: 3

* دروس تعليمية عالية الجودة: 14

* إدخالات الموسوعة الشعبية: 5

قم بزيارة الموقع الرسمي:هايبر.اي

مجموعات البيانات العامة المختارة

1. مجموعة بيانات تخطيط الدماغ الكهربائي (EEG) من THINGS

THINGS-EEG هي مجموعة بيانات تخطيط كهربية الدماغ (EEG) لأبحاث الإدراك بالأشياء، وقد أصدرها المعهد الوطني للصحة العقلية التابع للمعاهد الوطنية للصحة (NIH)، ومعهد ماكس بلانك للإدراك البشري وعلوم الدماغ في ألمانيا، وكلية الطب بجامعة جيسن، إلى جانب مؤسسات أخرى. تسجل هذه المجموعة نشاط تخطيط كهربية الدماغ لخمسين شخصًا أثناء مشاهدتهم صورًا لأشياء، وتُستخدم لتحليل الديناميكيات الزمنية والتمثيلات الإدراكية لمعالجة الأشياء.

الاستخدام المباشر:https://go.hyper.ai/kqejl

2. مجموعة بيانات تخطيط الدماغ المغناطيسي THINGS-MEG

THINGS-MEG هي مجموعة بيانات تخطيط الدماغ المغناطيسي (MEG) لأبحاث الإدراك البصري للأشياء، وقد أصدرها المعهد الوطني للصحة العقلية التابع للمعاهد الوطنية للصحة في الولايات المتحدة، ومعهد ماكس بلانك للإدراك البشري وعلوم الدماغ في ألمانيا، وكلية الطب بجامعة جيسن، من بين مؤسسات أخرى. تسجل هذه المجموعة النشاط الكهرومغناطيسي للدماغ على مستوى أجزاء من الألف من الثانية عندما يشاهد الأشخاص صورًا لأشياء، وتُستخدم لتحليل الديناميكيات الزمنية لمعالجة الأشياء.

الاستخدام المباشر:https://go.hyper.ai/eBKWI

3. مجموعة بيانات التصوير بالرنين المغناطيسي الوظيفي THINGS-fMRI

تُعدّ THINGS-fMRI مجموعة بيانات تصوير بالرنين المغناطيسي الوظيفي عالية الكثافة لأبحاث الإدراك المكاني، وقد صدرت بالاشتراك بين المعهد الوطني للصحة العقلية التابع للمعاهد الوطنية للصحة في الولايات المتحدة، ومعهد ماكس بلانك للإدراك البشري وعلوم الدماغ في ألمانيا، وكلية الطب بجامعة جيسن، إلى جانب مؤسسات أخرى. وتهدف هذه المجموعة إلى توصيف تمثيل الدماغ البشري البصري والدلالي للأشياء في العالم الحقيقي بشكل منهجي.

الاستخدام المباشر:https://go.hyper.ai/CRbiA

دروس تعليمية عامة مختارة

هذا الأسبوع، قمنا بتجميع 3 أنواع من الدروس التعليمية العامة عالية الجودة:

* دروس تعليمية حول تقنية التعرف الضوئي على الأحرف: 4

* دروس تعليمية متعددة الوسائط: 6

* برنامج تعليمي لنموذج اللغة الكبير: 4 أجزاء

برنامج تعليمي للتعرف الضوئي على الحروف (OCR)

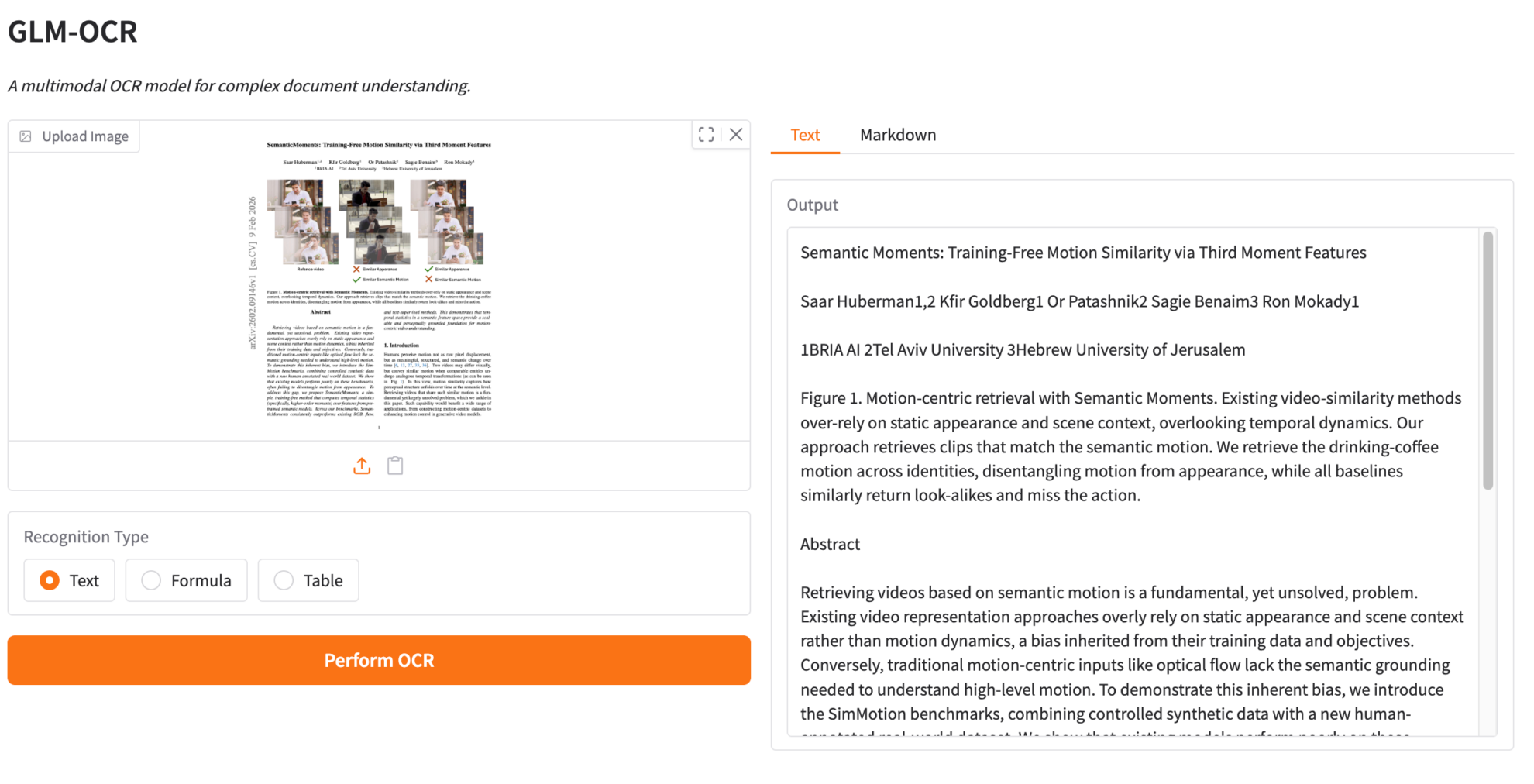

1. نظام التعرف الضوئي على الأحرف متعدد الوسائط خفيف الوزن GLM-OCR

GLM-OCR هو نموذج OCR خفيف الوزن ومتعدد الوسائط (0.9 بايت) أطلقته شركة Zhipu AI كمصدر مفتوح في فبراير 2026، ويركز على التعرف على النصوص بدقة عالية وتحليلها البنيوي في سيناريوهات المستندات المعقدة. تتمثل مزاياه الأساسية في صغر حجمه ودقته العالية وسهولة نشره. يعتمد النموذج على بنية GLM-V متعددة الوسائط (مشفر-مفكك)، ويدمج مشفر CogViT المرئي المطوّر ذاتيًا وتقنية RLHF للتحسين. وقد تصدّر GLM-OCR أحدث معايير الأداء (SOTA) محققًا 94.62 نقطة في معيار OmniDocBench V1.5، محققًا أداءً قريبًا من أداء Gemini-3-Pro. وهو مناسب لسيناريوهات متنوعة مثل تحليل مستندات المكاتب، والتعرف على الصيغ التعليمية والعلمية، والتحقق من المستندات الحكومية والمالية، واستخراج أجزاء من التعليمات البرمجية.

تشغيل عبر الإنترنت:https://go.hyper.ai/kgb3n

2. PaddleOCR-VL-1.5: تقنية التعرف الضوئي على الأحرف المحلية القائمة على vLLM

يُعدّ PaddleOCR-VL-1.5 أحد نماذج التعرّف الضوئي على الأحرف متعددة الوسائط ضمن سلسلة PaddleOCR التي أصدرها فريق PaddlePaddle. يوفر هذا النموذج إمكانيات محسّنة للتعرّف على النصوص وفهم تخطيطها في سيناريوهات المستندات المعقدة (الفواتير، العقود، الأوراق، المستندات الممسوحة ضوئيًا، إلخ). يستخدم هذا الدليل واجهة vLLM المتوافقة مع OpenAI للاتصال بهذا النموذج، مما يُتيح الربط الكامل بين تحميل الصور واستلام نتائج التعرّف. بفضل عدد مُعاملاته البالغ 0.9 مليار، يحقق النموذج دقةً من الجيل الجديد تصل إلى 94.5% على منصة OmniDocBench v1.5.

تشغيل عبر الإنترنت:https://go.hyper.ai/cea6x

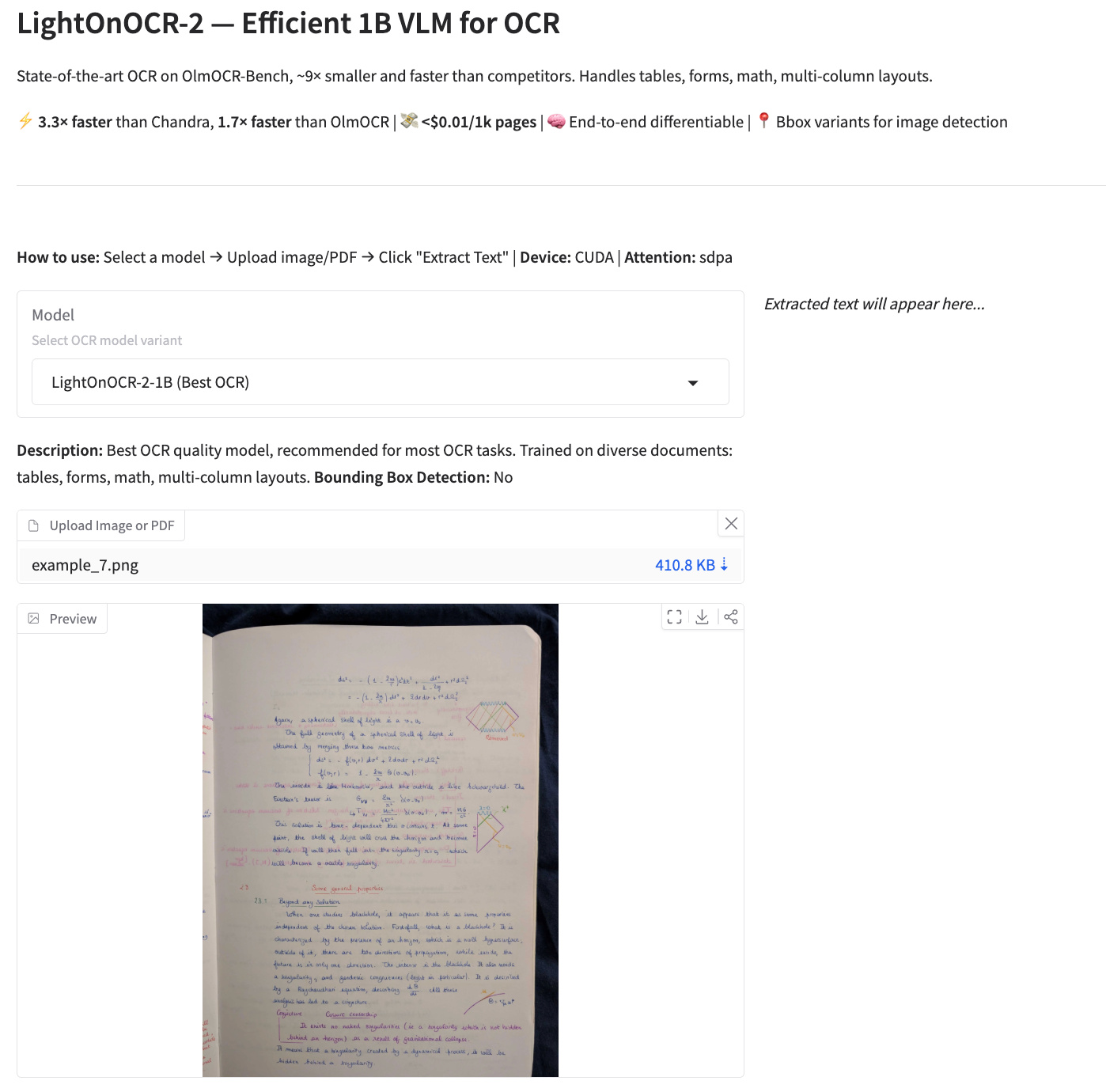

3.جهاز LightOnOCR-2-1B خفيف الوزن وعالي الأداء لتقنية التعرف الضوئي على الأحرف (OCR) الشاملة

يُعدّ LightOnOCR-2-1B أحدث جيل من نماذج اللغة المرئية المتكاملة من LightOn AI. وباعتباره الإصدار الرائد في سلسلة LightOnOCR، فهو يجمع بين فهم المستندات وتوليد النصوص في بنية مدمجة، ويضم مليار مُعامل، ويمكن تشغيله على وحدات معالجة الرسومات (GPU) المُخصصة للمستهلكين. يستخدم هذا النموذج بنية Vision-Language Transformer، ويُدمج تقنية تدريب RLVR، مما يُحقق دقة عالية للغاية في التعرّف وسرعة استدلال فائقة. وهو مُصمم خصيصًا للتطبيقات التي تتطلب معالجة المستندات المُعقدة، والنصوص المكتوبة بخط اليد، وصيغ LaTeX.

تشغيل عبر الإنترنت:https://go.hyper.ai/cLSj5

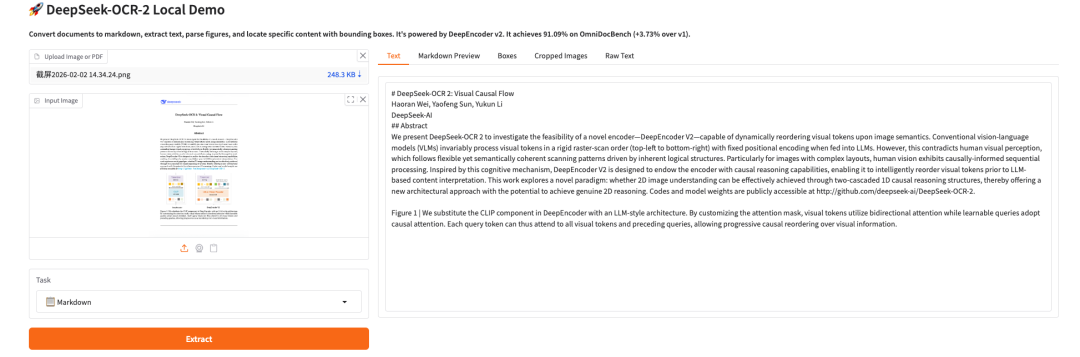

4. DeepSeek-OCR 2 التدفق السببي المرئي

يُعدّ DeepSeek-OCR 2 الجيل الثاني من نماذج التعرّف الضوئي على الأحرف (OCR) التي أطلقها فريق DeepSeek. وبفضل بنية DeepEncoder V2، يُحقق هذا النموذج نقلة نوعية من المسح الثابت إلى الاستدلال الدلالي. يستخدم النموذج استعلام التدفق السببي وآلية انتباه ثنائية التدفق، حيث يُعيد ترتيب الرموز المرئية ديناميكيًا لإعادة إنتاج منطق القراءة الطبيعي للمستندات المعقدة بدقة أكبر. في اختبار OmniDocBench v1.5، حقق النموذج درجة شاملة بلغت 91.09%، وهو تحسن ملحوظ مقارنةً بسابقه، مع تقليل معدل تكرار نتائج التعرّف الضوئي على الأحرف بشكل كبير، مما يفتح آفاقًا جديدة لبناء مُشفّر متعدد الوسائط في المستقبل.

تشغيل عبر الإنترنت:https://go.hyper.ai/iOGzO

برنامج تعليمي متعدد الوسائط

1. MiniCPM-o-4.5: نموذج Wallfacer Intelligence مفتوح المصدر ثنائي الاتجاه وكامل الأنماط

يُعدّ MiniCPM-o-4.5 نموذجًا رائدًا مفتوح المصدر، يتألف من 9 مليارات مُعامل، ويعمل بنظام الوسائط المتعددة، وقد طرحته شركة Facewall Intelligence ومختبر معالجة اللغات الطبيعية بجامعة تسينغهوا في فبراير 2026. يعتمد هذا النموذج على بنية شاملة تستخدم تقنيات siglip2 و whisper و cosyvoice2 و qwen3-8b. وباعتباره أول نموذج في هذا المجال يدعم "الحوار الحر في الوقت الفعلي"، فإنه يحقق تفاعلًا ثنائي الاتجاه، مما يسمح للمستخدمين بالرؤية والسمع والتحدث في آنٍ واحد، متجاوزًا بذلك نمط "التحدث اللاسلكي" التقليدي القائم على الأدوار. يتميز هذا النموذج بقدرات رائدة في فهم الصور، وقدرات فائقة في توليد الكلام الشبيه بالبشر، وقدرات استنساخ الكلام. كما يدعم التفاعل الاستباقي ومعالجة الوسائط المتدفقة في الوقت الفعلي، ويمكن تشغيله على الأجهزة الطرفية. وهو متوافق مع العديد من الرقاقات المصنعة محليًا، مثل ascend و Hygon، ويمكن نشره بكفاءة باستخدام أُطر عمل مثل llama.cpp و vLLM.

تشغيل عبر الإنترنت:https://go.hyper.ai/iOGzO

2.نشر Qwen-Image-Edit باستخدام vLLM-Omni

Qwen-Image-Edit هو برنامج متعدد الاستخدامات لتحرير الصور، أطلقته شركة علي بابا. يتميز هذا البرنامج بقدرات مزدوجة في التحرير الدلالي والبصري، مما يتيح تحرير المظهر البصري البسيط (مثل إضافة العناصر أو حذفها أو تعديلها) والتحرير الدلالي البصري المتقدم (مثل إنشاء عناوين IP وتدوير الكائنات ونقل الأنماط). يدعم البرنامج التحرير الدقيق للنصوص ثنائية اللغة (الصينية والإنجليزية)، حيث يقوم بتعديل النصوص داخل الصور مع الحفاظ على الخط والحجم والنمط الأصليين.

تشغيل عبر الإنترنت:https://go.hyper.ai/4w6XA

3. الخطوة 3-VL-10B: الفهم البصري متعدد الوسائط والحوار الرسومي

Step3-VL-10B هو نموذج مفتوح المصدر لأساسيات اللغة المرئية، طوّره فريق StepFun، وهو مصمم خصيصًا لفهم الوسائط المتعددة ومهام الاستدلال المعقدة. يهدف هذا النموذج إلى إعادة تعريف التوازن بين الكفاءة وقدرة الاستدلال وجودة الفهم المرئي، وهو مناسب للنماذج متعددة الوسائط ذات عدد محدود من المعلمات. على الرغم من صغر حجم معلماته، يُظهر هذا النموذج أداءً فائقًا في الإدراك البصري والاستدلال المعقد ومواءمة التعليمات البشرية. يتفوق باستمرار على نماذج مماثلة في الحجم في العديد من الاختبارات المعيارية، وينافس نماذج تحتوي على معلمات أكثر بعشرة إلى عشرين ضعفًا في بعض المهام.

تشغيل عبر الإنترنت:https://go.hyper.ai/RqTTW

4. نشر Qwen-Image-2512 باستخدام vLLM-Omni

يُعدّ Qwen-Image-2512 نموذجًا أساسيًا لتحويل النصوص إلى صور ضمن سلسلة Qwen-Image، وهو مصمم خصيصًا لإنتاج صور عالية الجودة وعرض محتوى متعدد الوسائط معقد. ويركز على تعزيز واقعية الصور المُولّدة وسهولة استخدامها. يُحسّن توليد الصور الشخصية بشكل ملحوظ من طبيعتها، حيث تُصبح بنية الوجه وملمس البشرة وعلاقات الإضاءة أقرب إلى الصور الفوتوغرافية الواقعية. في المشاهد الطبيعية، يُمكن للنموذج توليد تفاصيل أكثر دقة لتضاريس الأرض، وتفاصيل الغطاء النباتي، ومعلومات عالية التردد مثل فراء الحيوانات. كما تم تحسين قدراته في توليد النصوص والطباعة، مما يُتيح عرضًا أكثر استقرارًا للنصوص المقروءة وأنماط الخطوط المعقدة.

تشغيل عبر الإنترنت:https://go.hyper.ai/JMmhs

5. نظام TurboDiffusion: نظام توليد الفيديو المعتمد على الصور والنصوص

TurboDiffusion هو نظام توليد انتشار الفيديو عالي الكفاءة تم تطويره بواسطة فريق من جامعة تسينغهوا في ديسمبر 2025. يعتمد النظام على بنية Wan2.1 للتقطير عالي الرتبة، ويهدف إلى حل نقاط الضعف المتمثلة في بطء سرعة الاستدلال واستهلاك موارد الحوسبة العالية في نماذج الفيديو واسعة النطاق، وبالتالي تحقيق هدف توليد مقاطع فيديو عالية الجودة بأقل عدد من الخطوات.

تشغيل عبر الإنترنت:https://go.hyper.ai/VvyVZ

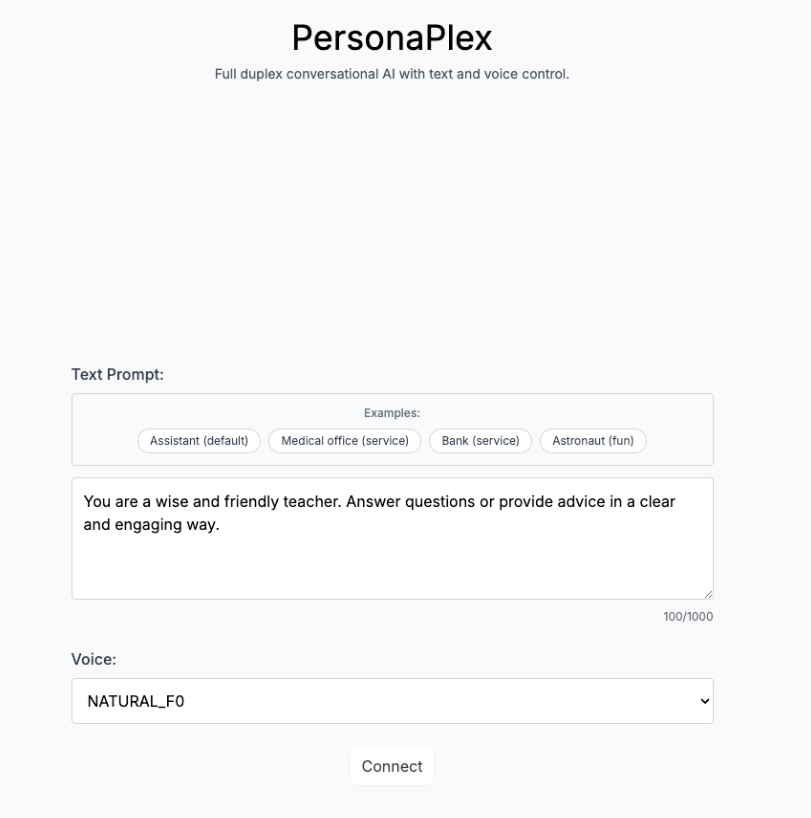

6. بيرسونابلكس-7 بي-الإصدار 1: حوار فوري وواجهة صوتية مخصصة للشخصية

PersonaPlex-7B-v1 هو نموذج حوار شخصي متعدد الوسائط يتكون من 7 مليارات مُعامل، وقد أصدرته شركة NVIDIA. صُمم هذا النموذج للتفاعل الصوتي/النصي في الوقت الفعلي، ومحاكاة اتساق الشخصية على المدى الطويل، ومهام الإدراك متعدد الوسائط، بهدف توفير نظام عرض تفاعلي غامر متعدد الوسائط ولعب الأدوار بسرعة استجابة تصل إلى مستوى أجزاء من الثانية.

تشغيل عبر الإنترنت:https://go.hyper.ai/ndoj0

برنامج تعليمي لنموذج لغة كبير

1.llama.cpp+Open WebUI deploy Qwen3-VL-8B-Instruct-GGUF

يُقدّم Qwen3-VL-8B-Instruct-GGUF مجموعة متنوعة من نماذج اللغة الدقيقة، بالإضافة إلى مُشفّر مرئي مُخصّص لـ MMPROJ. تتوافق هذه النماذج مع أدوات مثل llama.cpp وOllama، وهي مُلائمة لمجموعة واسعة من الأجهزة، بما في ذلك وحدات المعالجة المركزية (CPU)، ووحدات معالجة الرسومات NVIDIA، ومعالجات Apple Silicon، ووحدات معالجة الرسومات Intel. يُميّز Qwen3-VL-8B-Instruct-GGUF بوضوح بين مُكوّنات اللغة والمُكوّنات المرئية في صيغة GGUF. يُتيح هذا للمُطوّرين مرونة اختيار مستوى التكميم المُناسب لأجهزتهم، ما يُحقق أوقات استجابة مقبولة حتى في بيئات وحدات المعالجة المركزية ذات الموارد المحدودة، مع تحسين الأداء على الأنظمة المُجهّزة بوحدات معالجة الرسومات.

تشغيل عبر الإنترنت:https://go.hyper.ai/EKryC

2. تقنية جاكوبي فورسينغ: تقنية فك تشفير متوازية سببية سريعة ودقيقة

تُعدّ تقنية Jacobi Forcing أسلوبًا تدريبيًا مبتكرًا طوّرته شركة Hao AI Labs، حيث تُحوّل نماذج اللغة الكبيرة (LLMs) إلى مُفكّكات شفرة متوازية سببية أصلية. ومن خلال تدريب النموذج على معالجة كتل مستقبلية مشوّشة على طول مسار فك شفرة Jacobi الخاص به، تحلّ هذه التقنية مشكلة المطابقة بين نماذج الانحدار الذاتي ونماذج الانتشار، مع الحفاظ على سلامة بنية العمود الفقري السببية للانحدار الذاتي.

تشغيل عبر الإنترنت:https://go.hyper.ai/fIad4

3.vLLM+Open WebUI نشر GLM-4.7-Flash

يُعدّ GLM-4.7-Flash نموذج استدلال متعدد الوسائط خفيف الوزن، يوازن بين الأداء العالي والإنتاجية العالية، ويدعم بشكل أصلي التفكير المتسلسل (CoT) واستدعاءات الأدوات ووظائف الوكيل. يستخدم GLM-4.7-Flash بنية الخبير الهجين (MoE)، مستفيدًا من آليات التنشيط المتفرقة لتقليل التكلفة الحسابية لكل استدلال بشكل كبير مع الحفاظ على القدرة التعبيرية للنماذج الكبيرة.

تشغيل عبر الإنترنت:https://go.hyper.ai/a2IN3

4. نشر vLLM+Open WebUI لـ LFM2.5-1.2B-Thinking

LFM2.5-1.2B-Thinking هو نموذج معماري هجين مُحسَّن للحوسبة الطرفية. وباعتباره إصدارًا من سلسلة LFM2.5 مُحسَّنًا خصيصًا للاستدلال المنطقي، فإنه يجمع بين معالجة التسلسلات الطويلة وقدرات الاستدلال الفعالة ضمن بنية مُدمجة. يتميز هذا النموذج بـ 1.2 مليار مُعامل، ويمكن تشغيله بسلاسة على وحدات معالجة الرسومات المُخصصة للمستهلكين، وحتى على أجهزة الحوسبة الطرفية. وبفضل استخدامه لبنية هجينة مبتكرة (نظام ديناميكي خطي + آلية الانتباه)، فإنه يحقق كفاءة عالية للغاية في استخدام الذاكرة وإنتاجية فائقة، مُصممة خصيصًا للسيناريوهات التي تتطلب استدلالًا فوريًا على الجهاز دون التضحية بالذكاء.

تشغيل عبر الإنترنت:https://go.hyper.ai/1XTsV

تفسير مقالة المجتمع

1. اقترح فريق بحث أوروبي نموذج SeaCast، وهو نموذج إقليمي عالي الدقة للتنبؤ بالمحيطات يمكنه توفير تنبؤات لمدة 15 يومًا في 20 ثانية فقط.

يُصعّب التوزيع غير المنتظم لليابسة والبحر، وظروف الحدود الجانبية المعقدة، والحاجة إلى توصيف دقيق للمتغيرات الطبقية الرأسية، من تكييف نماذج الذكاء الاصطناعي الحالية للمحيطات على المستوى العالمي مباشرةً مع المهام الإقليمية. ولمعالجة هذه المشكلة، طوّر فريق بحثي مشترك يضم جامعة هلسنكي (فنلندا)، ومركز أبحاث تغير المناخ في البحر الأبيض المتوسط، وجامعة سالنتو (إيطاليا) نموذج SeaCast، وهو نموذج شبكة عصبية بيانية مصمم خصيصًا للتنبؤات الإقليمية للمحيطات. ويستطيع هذا النموذج إكمال تنبؤ لمدة 15 يومًا عبر 18 مستوى رأسيًا ضمن شبكة 1/24 درجة في غضون 20 ثانية فقط على وحدة معالجة رسومية واحدة.

شاهد التقرير الكامل:https://go.hyper.ai/kRXnE

2. تقترح جامعة كورنيل إطار عمل مبتكر للذكاء الاصطناعي لفك شفرة الآلية الكيميائية للإلكتروليتات عالية التوصيل لأيونات الليثيوم، محققة معدل نجاح في التنبؤ يتجاوز 80٪ لـ %.

تُشكّل كيمياء المذيبات الملحية أساس سلوك الإلكتروليت في معظم أنظمة بطاريات الليثيوم أيون، إلا أن تصميمها الأمثل مقيدٌ بمساحة كيميائية واسعة تضم عددًا لا يُحصى من التركيبات وعلاقات غير خطية بين البنية والأداء. وتتفاقم هذه المشكلة بسبب ندرة البيانات التجريبية وتوزيعها غير المتجانس، مما يُعيق قدرة النماذج على التعميم. وقد طوّر فريق بحثي من جامعة كورنيل إطار عمل قويًا وقابلًا للتفسير وفعالًا في استخدام البيانات، أطلق عليه اسم SCAN، لنمذجة وتفسير كيمياء المذيبات الملحية. ويتعامل هذا الإطار بفعالية مع البيانات ذات التوزيع غير المتجانس ويُغطي الطيف الكامل لتركيبات المذيبات الملحية.

شاهد التقرير الكامل:https://go.hyper.ai/OrHIt

3. طريقة جديدة للتنبؤ بعمر البطارية، اقترحتها جامعة ميشيغان وآخرون، تقلل دورة التحقق بمقدار 40 مرة، مما يوفر وقت التقييم لـ 98% باستخدام "التعلم الاستكشافي".

يُعدّ التنبؤ الدقيق والفعّال بعمر دورة البطارية أمرًا بالغ الأهمية لأبحاث وتطبيقات الجيل القادم من البطاريات على نطاق واسع، إذ يُحدّد بشكل مباشر موثوقيتها وسلامتها وتكلفتها الإجمالية. وقد اقترح خبراء من مؤسسات بحثية، مثل جامعة ميشيغان، مؤخرًا طريقةً مبتكرةً للتعلم الآلي تُسمى "التعلم الاستكشافي" (Discovery Learning (DL))، والتي تدمج بسلاسة التعلم النشط والتعلم المقيد فيزيائيًا والتعلم الصفري لبناء إطار عمل للتعلم ذي حلقة مغلقة يُحاكي التفكير البشري. وبافتراضات متحفظة، وبالمقارنة مع عمليات التحقق من عمر البطارية الصناعية، يُمكن للتعلم الاستكشافي توفير 981 TP3T من وقت التقييم وتوفير 951 TP3T من الطاقة، مما يُقلّص دورة التحقق من حوالي 1333 يومًا إلى 33 يومًا.

شاهد التقرير الكامل:https://go.hyper.ai/28W2g

4. ملخص الورقة البحثية | أكثر من 100 إنجاز رئيسي في مجال الذكاء الاصطناعي للعلوم: نظرة عامة سريعة على الابتكارات التكنولوجية بحلول عام 2025

على مدار العام الماضي، شهدت العلاقة بين الذكاء الاصطناعي والبحث العلمي تحولاً عميقاً وهادئاً. وبحلول عام 2025، لن يقتصر استخدام الذكاء الاصطناعي في العلوم على تطبيقات تكنولوجية متفرقة، بل سيتطور إلى مسار واضح ومنهجي وقابل لإعادة الاستخدام للبحث العلمي والابتكار. ولن يكون الذكاء الاصطناعي مجرد أداة، بل سيصبح جزءاً لا يتجزأ من نموذج البحث. وقد جمعت منصة HyperAI أوراقاً بحثية من مجالات متعددة، تشمل الصحة الطبية، وكيمياء المواد، والبحوث المناخية، وعلم الفلك، لتسهيل البحث السريع والمراجعة للقراء من مختلف الخلفيات.

شاهد التقرير الكامل:https://go.hyper.ai/FLJGD

مقالات موسوعية شعبية

1. الفرز العكسي مع RRF

2. نظرية تمثيل كولموغوروف-أرنولد

3. فهم اللغة متعدد المهام على نطاق واسع MMLU

4. مُحسِّنات الصندوق الأسود

5. الاحتمالية الشرطية للفئة

فيما يلي مئات المصطلحات المتعلقة بالذكاء الاصطناعي التي تم تجميعها لمساعدتك على فهم "الذكاء الاصطناعي" هنا:

إن ما ورد أعلاه هو كل محتوى اختيار المحرر لهذا الأسبوع. إذا كان لديك موارد تريد تضمينها على الموقع الرسمي لـ hyper.ai، فنحن نرحب بك أيضًا لترك رسالة أو إرسال مقال لإخبارنا بذلك!

نراكم في الاسبوع القادم!