Command Palette

Search for a command to run...

ملخص البرنامج التعليمي | نماذج صغيرة مفتوحة المصدر تحقق ذكاءً شاملاً يُضاهي GPT-5؛ تقييم شامل للنماذج الشائعة مثل Qwen 3.5/Gemma 4.

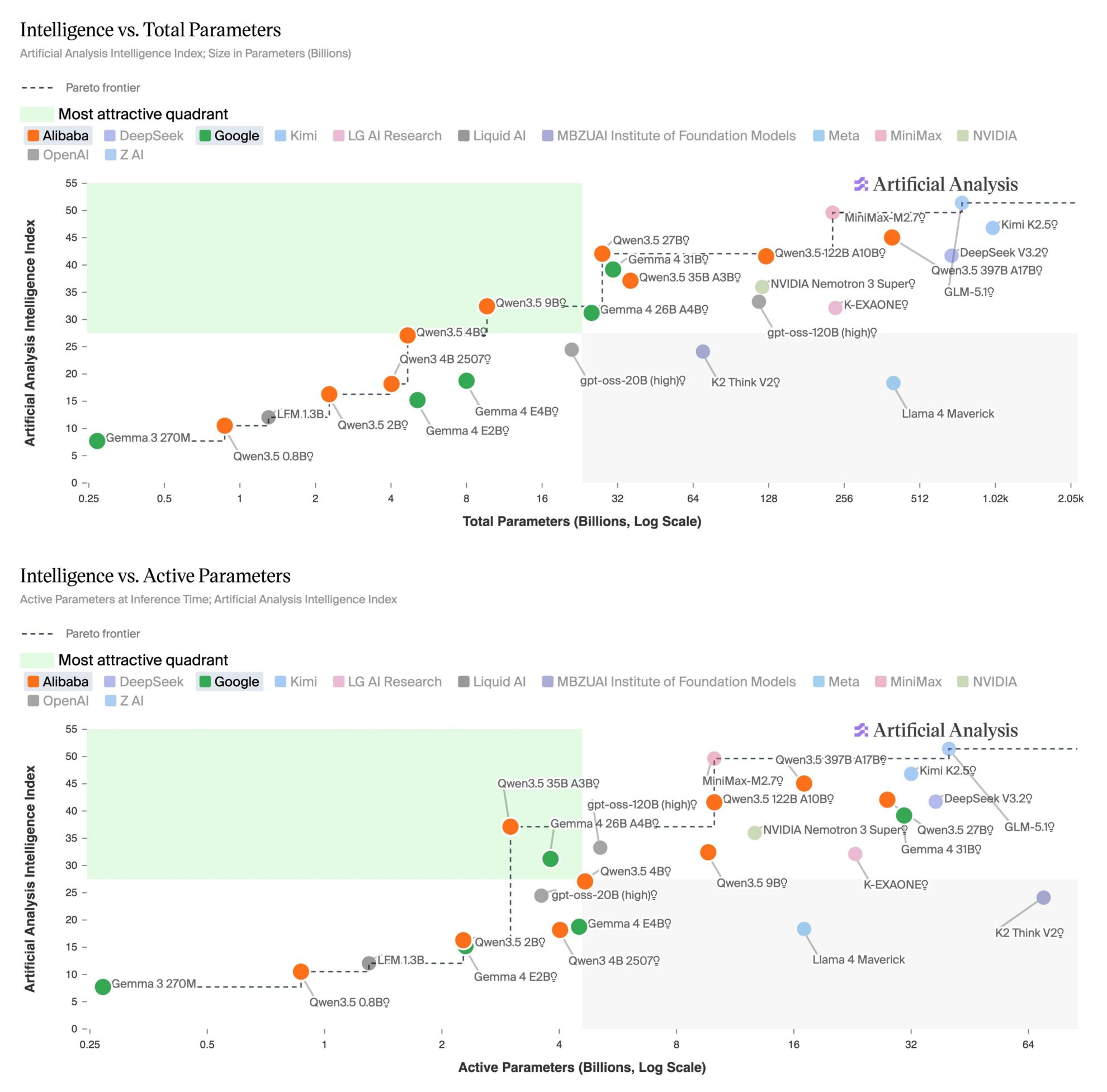

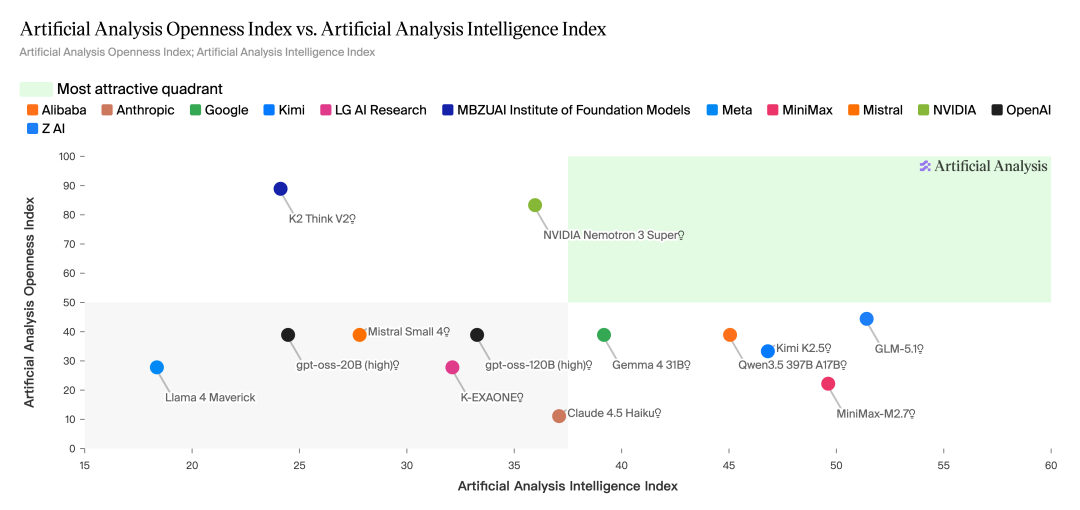

في 14 أبريل، أصدرت منظمة الاختبار المستقلة "التحليل الاصطناعي" تقريرًا مقارنًا حول نماذج المصادر المفتوحة التي يقل حجمها عن 32 بايت، موضحةً أن...لقد لحقت أجهزة Qwen3.5 27B و Gemma 4 31B، وهما نموذجان صغيران الحجم، بجهاز GPT-5 المقابل من حيث الذكاء العام.ومن بينها، سجل Qwen3.5 27B (نسخة الاستدلال) 42 نقطة على مؤشر الذكاء، وهو ما يضاهي GPT-5 (متوسط)؛ وسجل Gemma 4 31B (نسخة الاستدلال) 39 نقطة، وهو ما يطابق GPT-5 (منخفض).

يشير التقرير إلى أن هذا الجيل من نماذج 32B يُظهر تحسينات ملحوظة في القدرة على الاستدلال وأداء الوكيل. حقق Qwen3.5 27B درجة 55 على مؤشر الوكيل، متجاوزًا بذلك GPT-5 (المتوسط) الذي حصل على 46 نقطة؛ كما يتفوق Gemma 4 31B على GPT-5 (المنخفض) في المهام المعقدة مثل TerminalBench Hard وHLE. علاوة على ذلك، يدعم كلا النموذجين المدخلات متعددة الوسائط بشكل أصلي، ويُصنفان ضمن أفضل نماذج المصادر المفتوحة في فئتهما في مهام الفهم البصري مثل MMMU-Pro.

مع ذلك، لا يزال النموذج الأصغر متأخرًا بشكل ملحوظ من حيث دقة المعرفة والتحكم في الوهم. فقد سجل النموذجان -42 و-45 على مؤشر AA-Omniscience على التوالي، بينما سجل النموذج المرتبط بـ GPT-5 -10، مما يدل على استمرار تأثير حجم المعلمات على قدرة الاحتفاظ بالمعرفة.

على مستوى التطبيق العملي، تحسّنت جدوى هذه النماذج بشكل ملحوظ. يمكن تشغيل كلا النموذجين المذكورين أعلاه على معالج NVIDIA H100 واحد، ويمكن نشرهما محليًا على الأجهزة الشخصية من خلال التكميم، مما يسهّل الوصول إليهما. في الوقت نفسه، يلحق مجتمع ترجيح المصادر المفتوحة بالركب سريعًا، حيث تُقلّص النماذج الكبيرة مثل GLM-5.1 الفجوة إلى نتائج من خانة الآحاد.

طوال الوقت،لمساعدة المطورين على البدء بسرعة والتحقق من صحة أحدث نماذج المصادر المفتوحة، تقوم HyperAI بتحديث دفاتر النشر عبر الإنترنت باستمرار للنماذج الشائعة في قسم "الدروس التعليمية" على موقعها الرسمي.تُقدّم هذه المقالة ملخصًا لنماذج المصادر المفتوحة عالية الجودة المذكورة في تقرير التحليل الاصطناعي، بالإضافة إلى شروحات نشرها بنقرة واحدة. انضم إلينا لتجربة الأداء العالي الذي يُضاهي نماذج المصادر المغلقة!

المزيد من الدروس التعليمية عبر الإنترنت:

نرحب بكم لزيارة موقعنا الإلكتروني الرسمي لمزيد من المعلومات:

NVIDIA-Nemotron-3-Super-120B

تم إصدار NVIDIA Nemotron 3 Super NVFP4 بواسطة شركة NVIDIA في مارس 2026. هذا النموذج هو نموذج لغة كبير يحتوي على 120 معلمة إجمالية و12 معلمة تنشيط، ويستخدم بنية LatentMoE الهجينة ويدعم سياقات تصل إلى مليون رمز.

صُمم هذا النموذج لسيناريوهات تتضمن الاستدلال السياقي المطول، وسير عمل الوكلاء، واستدعاء الأدوات، ورموز RAG، والإجابة على الأسئلة ذات الإنتاجية العالية. من حيث التفاعل، يدعم النموذج تفعيل وتعطيل وضع الاستدلال، ويمكنه التبديل بين وضع الإجابة على الأسئلة العادي ووضع الاستدلال المُعزز باستخدام معلمات قالب الدردشة القياسية.

تشغيل عبر الإنترنت:

Qwen3.5-27B-Claude-4.6-Opus–التفكير المُستخلص

في مارس 2026، أتاحت شركة جاك رونغ نموذج استدلال عالي الأداء مفتوح المصدر، وهو Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled. يعتمد هذا النموذج على بنية Qwen3.5-27B، ويدمج قدرات استدلال متقدمة مستمدة من Claude-4.6 وOpus. مع الحفاظ على قدرات فهم اللغة والتعبير القوية الأصلية، يُحسّن هذا النموذج بشكل ملحوظ أداء حل المشكلات المعقدة والتفاعل الحواري متعدد الأدوار.

على مستوى القدرات الأساسية، يُحقق هذا النموذج ترقية شاملة في القدرة على الاستدلال من خلال إدخال تقنية تقطير سلسلة الأفكار عالية الجودة، مما يجعله متميزًا بشكل خاص في سيناريوهات مثل الاشتقاق الرياضي، والتحليل المنطقي، والتخطيط واتخاذ القرارات، وتجزئة المهام متعددة الخطوات. بالمقارنة مع النماذج التقليدية، لا يقتصر دور هذا النظام على توليد الإجابات فحسب، بل يحلل المشكلات خطوة بخطوة بطريقة منظمة، ويُجزئ المهام المعقدة إلى خطوات منطقية واضحة وقابلة للتنفيذ، مما يُحسّن استقرار الاستدلال العام وموثوقية النتائج.

تشغيل عبر الإنترنت:

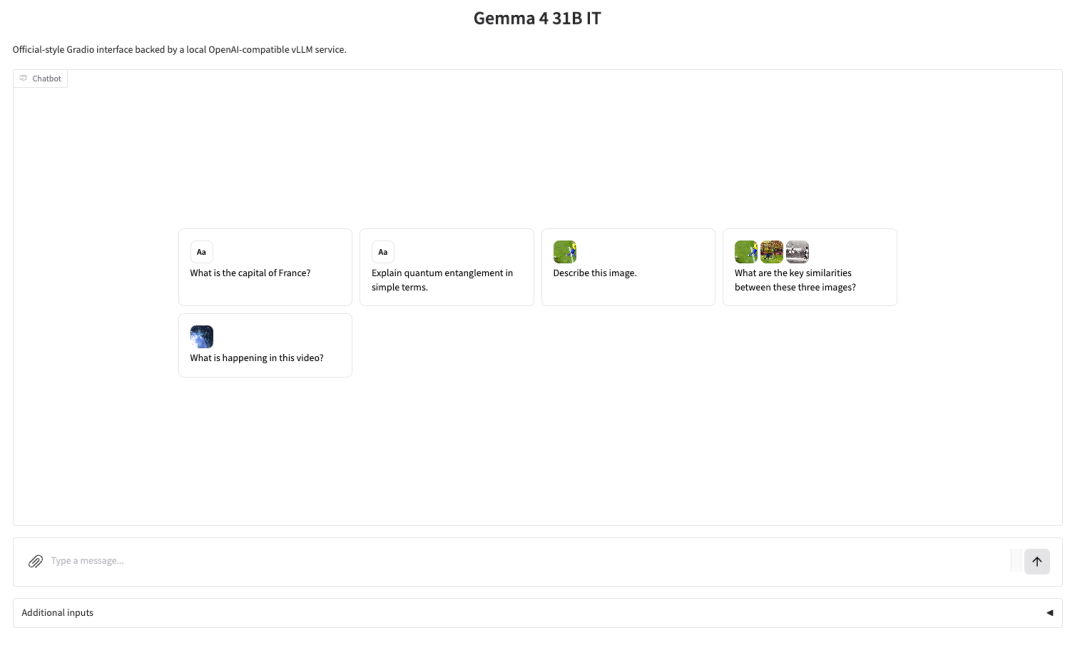

جيما-4-31ب-إت

لم تكتف نماذج سلسلة Gemma 4 مفتوحة المصدر من Google DeepMind، والمبنية على نفس نظام التكنولوجيا الخاص بـ Gemini 3، بالتصنيف ضمن أفضل ثلاثة نماذج في لوحة متصدري Arena AI، بل حققت أيضًا أداءً قريبًا من أداء النماذج الأكبر حجمًا أو حتى متجاوزة له، مع نطاق معلمات أصغر بكثير من منافسيها.

من منظور تصميم المنتج، لا يُعدّ Gemma 4 نموذجًا واحدًا، بل نظامًا متعدد الأحجام يشمل E2B وE4B و26B وA4B وصولًا إلى 31B، ما يجعله مناسبًا لسيناريوهات مختلفة كالأجهزة المحمولة، والأنظمة المحلية، وبيئات الحوسبة عالية الأداء. ومن بينها، يتميز الإصدار 31B، الذي يُمثّل أعلى مستوى أداء في هذه السلسلة، بقدرات تُضاهي حتى Qwen 3.5 397B.

فيما يتعلق بسيناريوهات التطبيق، يدعم الإصدار 31B إدخال وإخراج الصور والنصوص، ويحتوي على نافذة سياقية تتسع لما يصل إلى 256 ألف رمز، ويدعم بشكل أصلي الاستدلال واستدعاءات الدوال ومطالبات النظام. كما يدعم أكثر من 140 لغة، مما يجعله فعالاً في سيناريوهات مثل الإجابة على الأسئلة بجودة عالية، والمساعدة في كتابة التعليمات البرمجية، وخدمات الوكلاء.

تشغيل عبر الإنترنت:

نشر وحدة المعالجة المركزية Qwen3.5-9B-GGUF

Qwen3.5 هو جيل جديد من نماذج اللغة متعددة الوسائط واسعة النطاق، أطلقه فريق تونغي تشيان وين التابع لشركة علي بابا. يدعم هذا النموذج إدخال النصوص والصور، ويُنتج مخرجات نصية، ويستهدف مهامًا مثل الحوار، والاستدلال، والبرمجة، والفهم البصري. ومن بين هذه النماذج، يُعد Qwen3.5-9B الإصدار ذو الـ 9 مليارات مُعامل من هذه السلسلة، والذي يُحقق توازنًا بين الإمكانيات وتكلفة النشر، وهو مناسب للاستدلال في بيئات محدودة الموارد، سواءً على الحافة أو محليًا.

في هذا الدرس، سنستخدم أوزان GGUF المُقدمة من المجتمع (النسخة الكمية Q4_K_M) وندمجها مع مُشفّر مرئي (ملف mmproj GGUF). سنبدأ خدمة خلفية متوافقة مع واجهة OpenAI عبر ملف llama.cpp ونتصل بـ OpenWebUI لتوفير واجهة تفاعلية عبر المتصفح.

تشغيل عبر الإنترنت:

ابحث عن المزيد من الدروس التعليمية الشائعة: