Command Palette

Search for a command to run...

Rapide Et Précis ! Cohere Publie Un Modèle De Transcription Open Source ; Analyse Précise De Scénarios Complexes : Le Modèle De Langage Visuel Chandra-ocr-2 Permet Une Reconnaissance Optique De Caractères (OCR) précise.

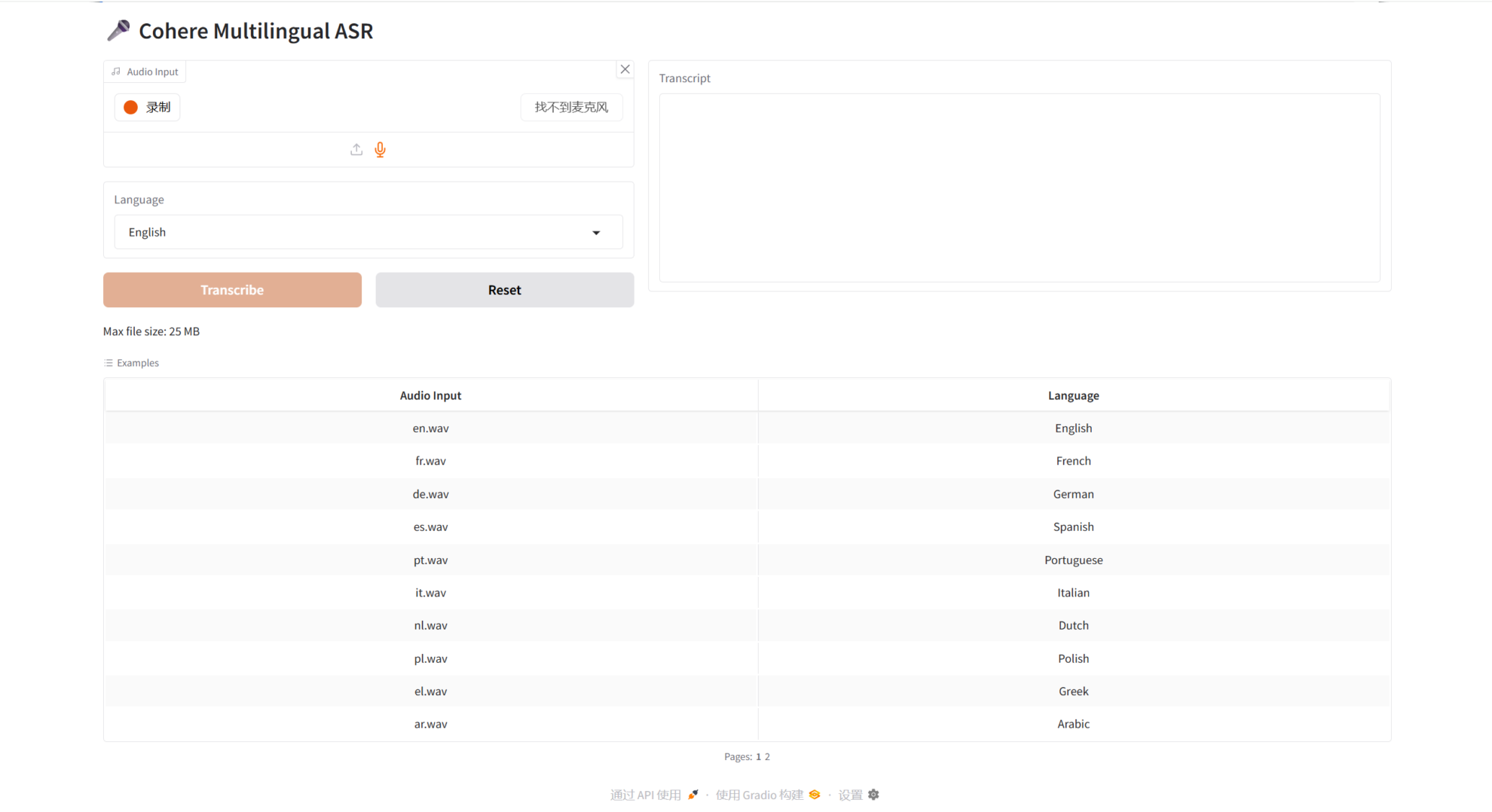

Dans le contexte actuel d'accélération de la transformation numérique mondiale, les données vocales sont devenues une nouvelle source de valeur ajoutée pour les entreprises. Cependant, la question de savoir comment surmonter les obstacles liés au coût d'inférence et à la vitesse de traitement tout en garantissant une transcription précise reste un problème non résolu. Cohere a publié un modèle de reconnaissance vocale open-source, Cohere-transcribe-03-2026, en mars 2026.Ce modèle de transcription dédié, avec ses 2 milliards de paramètres, est léger, très productif et très précis, établissant une nouvelle norme technique pour le « traitement précis de la parole » à l'ère des grands modèles.

La caractéristique la plus remarquable de Cohere-transcribe est son extrême efficacité et précision d'inférence. L'équipe de R&D a adopté une architecture encodeur-décodeur asymétrique, concentrant plus de 901 TP3T de puissance de calcul sur l'encodeur Fast-Conformer. Ceci réduit considérablement la charge de calcul de l'inférence autorégressive grâce à un décodeur simplifié, résolvant ainsi les problèmes de coûts de déploiement élevés et de temps de réponse lents des modèles de reconnaissance automatique de la parole (ASR) traditionnels.

En matière d'ingénierie des données, elle repose sur 500 000 heures de paires de transcriptions vocales soigneusement sélectionnées.En combinant des processus de nettoyage propriétaires et l'augmentation de données synthétiques par de multiples analyses d'erreurs, le modèle a développé une capacité de reconnaissance vocale exceptionnelle, même dans les environnements bruyants. Il est également doté d'un mécanisme de ponctuation personnalisable et flexible, capable d'ajouter automatiquement la ponctuation ou d'ajuster la mise en forme selon les besoins de l'utilisateur. Ceci résout non seulement le problème de l'absence de ponctuation dans de nombreuses données originales, mais garantit également une lecture fluide et naturelle du texte généré, alliant ainsi rapidité et précision.

Le site web d'HyperAI propose désormais le « Cohere Transcribe Open Source Lightweight Speech Model », alors n'hésitez pas à l'essayer !

Utilisation en ligne :https://go.hyper.ai/DonpU

Aperçu rapide des mises à jour du site web officiel d'hyper.ai du 6 au 12 avril :

* Jeux de données publics de haute qualité : 4

* Une sélection de tutoriels de haute qualité : 9

* Analyse des articles de la communauté : 2 articles

* Entrées d'encyclopédie populaire : 5

Principales conférences avec des dates limites en avril : 3

Visitez le site officiel :hyper.ai

Ensembles de données publiques sélectionnés

1. Ensemble de données ToolACE Complex Tool Learning Dialogue

ToolACE est un jeu de données automatisé pour l'apprentissage d'outils, publié en 2024 par l'Université Jiao Tong de Shanghai en collaboration avec l'Université des sciences et technologies de Chine, le laboratoire Huawei Noah's Ark et d'autres institutions. Ce jeu de données vise à générer des données d'apprentissage d'outils précises, complexes et diversifiées, répondant ainsi aux difficultés pratiques liées à l'apprentissage d'outils, telles que la qualité insuffisante des données et la diversité limitée des scénarios.

Utilisation directe :https://go.hyper.ai/RDx6d

2. Ensemble de données de référence culturelles latino-américaines CHOCLO

Le jeu de données CHOCLO est un jeu de données de référence conçu pour évaluer les performances des modèles de langage sur des tâches impliquant des connaissances culturelles latino-américaines. Il vise à évaluer la précision des modèles de langage dans la représentation de la culture latino-américaine, en s'intéressant particulièrement aux problèmes concrets rencontrés lors de l'entraînement et de la production des modèles, tels que la sous-représentation, les omissions et les biais liés à la culture de la région.

Utilisation directe :https://go.hyper.ai/dnYtT

3. Ensemble de données de référence pour la recherche interdisciplinaire approfondie DRACO

DRACO (Cross-Domain Deep Research Accuracy, Completeness, and Objectivity Benchmark Dataset) est un jeu de données publié par l'équipe Perplexity pour évaluer les tâches de recherche complexes. Il comprend 100 tâches de recherche complexes couvrant 40 pays et régions sur cinq continents. Ces tâches relèvent de 10 grands domaines d'application, dont la finance, le commerce/la comparaison de produits, le monde universitaire et la technologie. Chaque tâche est un problème d'analyse et de recherche d'informations multi-étapes et multi-sources, assorti de critères d'évaluation conçus et validés par 26 experts du domaine.

Utilisation directe :https://go.hyper.ai/SdAUn

4. COCO-2017 - Jeu de données de détection d'images vietnamiennes

COCO-2017-Vietnamese est un jeu de données d'extension de localisation vietnamienne basé sur le jeu de données Microsoft Common Objects in Context (COCO) 2017, maintenu et publié avec soin par la communauté AI Enthusiasm. Ce jeu de données fournit des traductions vietnamiennes de haute qualité des légendes d'images originales en anglais, offrant ainsi un jeu de données de référence bilingue complet, adapté à des tâches telles que la génération automatique de légendes d'images et l'apprentissage multimodal.

Utilisation directe :https://go.hyper.ai/KSv2V

Tutoriels publics sélectionnés

1. Cohere Transcribe : un modèle de parole open source et léger

Cohere Transcribe est un modèle de reconnaissance vocale léger, mis à disposition en open source par Cohere en mars 2026. Ce modèle, doté de 2 milliards de paramètres, est conçu spécifiquement pour les appareils périphériques et vise à pallier les problèmes de latence liés à la taille importante des modèles de reconnaissance vocale précédents. Cohere Transcribe a été entraîné sur 14 langues, dont le chinois, le japonais, le français et l'hébreu.

Exécutez en ligne :https://go.hyper.ai/DonpU

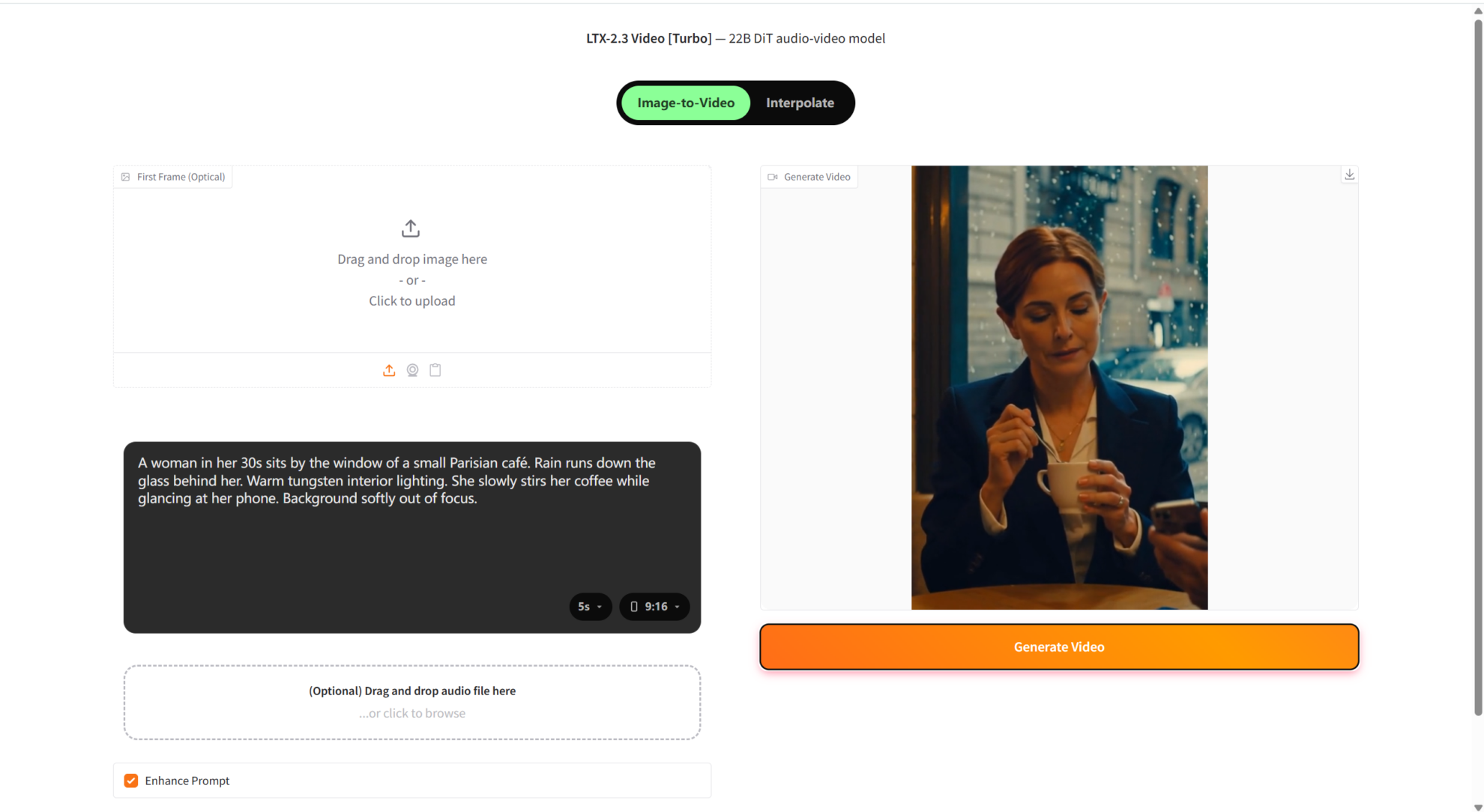

2. Générateur vidéo LTX-2.3-turbo

LTX-2.3-turbo est un modèle de génération vidéo open source publié par Lightricks en mars 2026, conçu pour repousser les limites des capacités de génération vidéo open source. Ce modèle utilise une architecture de transformateur de diffusion avancée et la combine à des capacités de compréhension multimodale pour générer du contenu vidéo multi-résolution de haute qualité.

Exécutez en ligne :https://go.hyper.ai/tkiw4

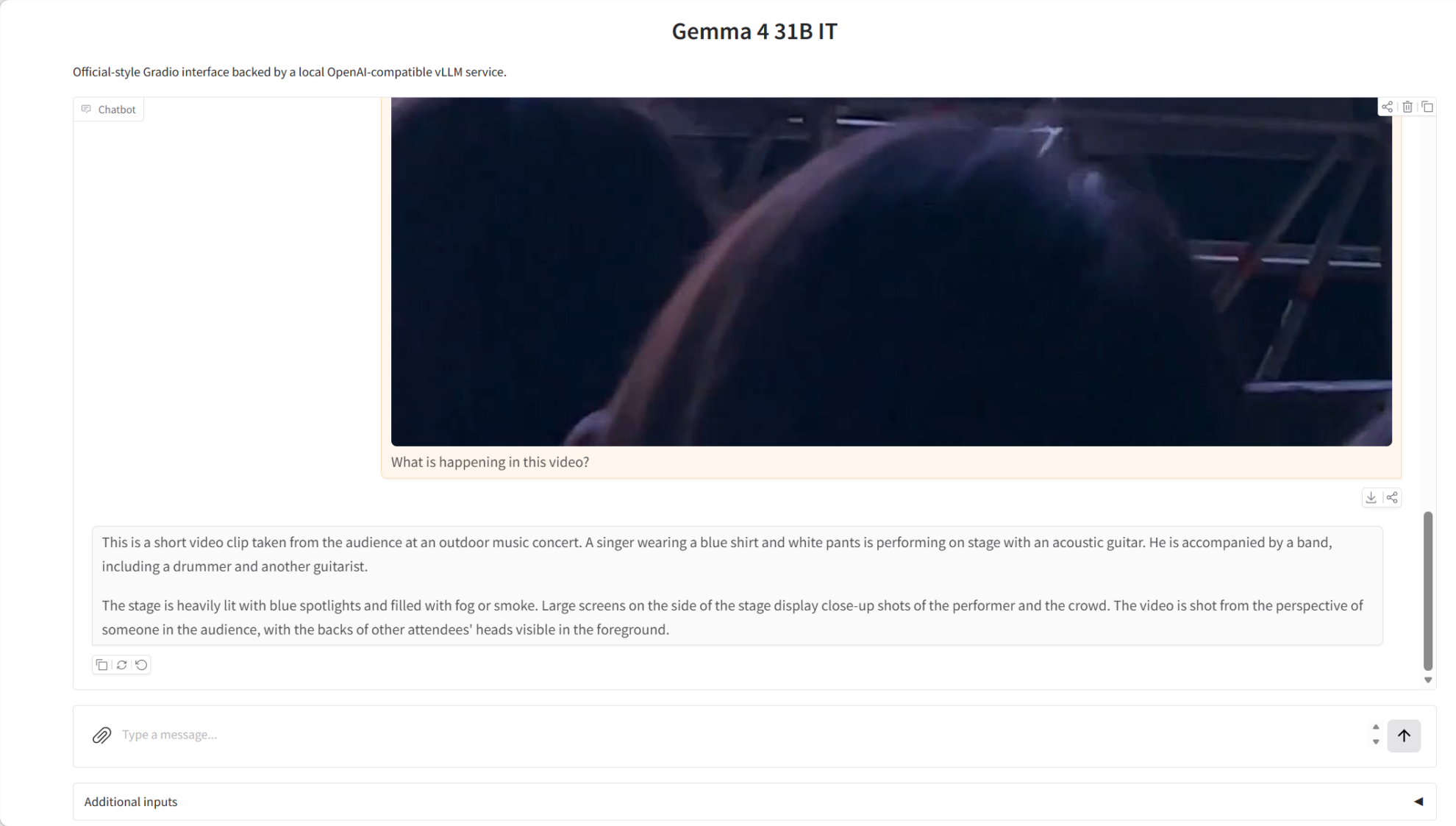

3. Déploiement en un clic de Gemma-4-31B-it

Gemma 4 31B IT, développé par Google DeepMind et lancé le 2 avril 2026, est un modèle à forte intensité d'instructions de 3,1 milliards de bits appartenant à la série Gemma 4. Il prend en charge la saisie de texte et d'images, ainsi que la sortie de texte, offre une fenêtre de contexte pouvant contenir jusqu'à 256 000 mots et intègre nativement l'inférence, les appels de fonctions et les indications système. Il est ainsi idéal pour répondre à des questions de haute qualité, assister le développeur et fournir des services d'agents. Compatible avec plus de 140 langages de programmation, il est principalement conçu pour l'inférence, la programmation, les flux de travail d'agents et les tâches de compréhension multimodale.

Exécutez en ligne :https://go.hyper.ai/RLgK9

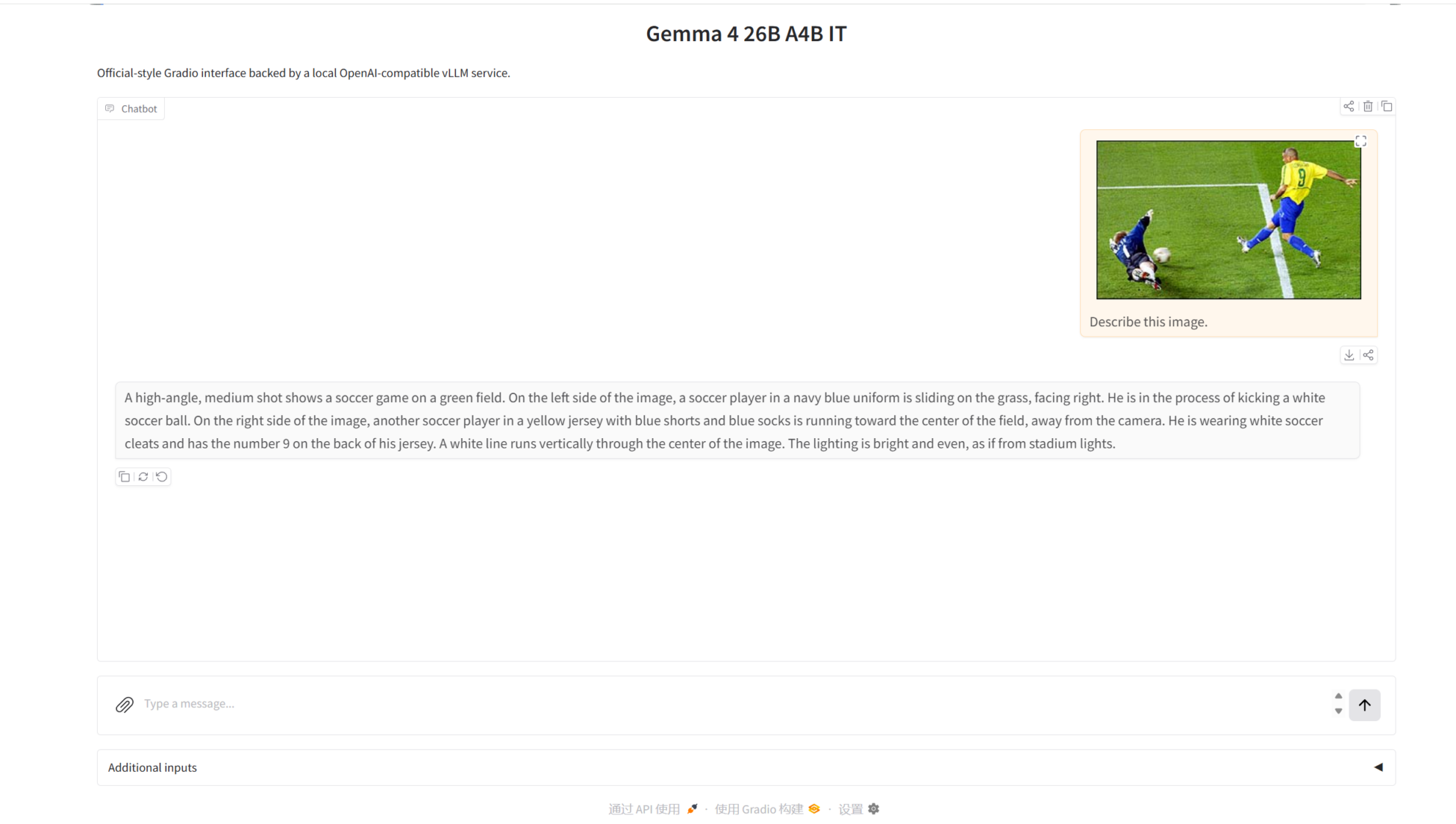

4. Déploiement en un clic de gemma-4-26B-A4B-it

Gemma 4 26B A4B IT, développé par Google DeepMind, a été lancé le 2 avril 2026. Il prend en charge la saisie de texte et d'images, ainsi que la sortie de texte, avec une fenêtre de contexte pouvant contenir jusqu'à 256 000 mots. Il intègre nativement l'inférence, les appels de fonctions et les suggestions système, ce qui le rend idéal pour répondre à des questions de haute qualité, l'assistance au codage et les services d'agents. Il prend en charge plus de 140 langues et est principalement conçu pour l'inférence, la programmation, les flux de travail d'agents et les tâches de compréhension multimodale.

Exécutez en ligne :https://go.hyper.ai/blUyh

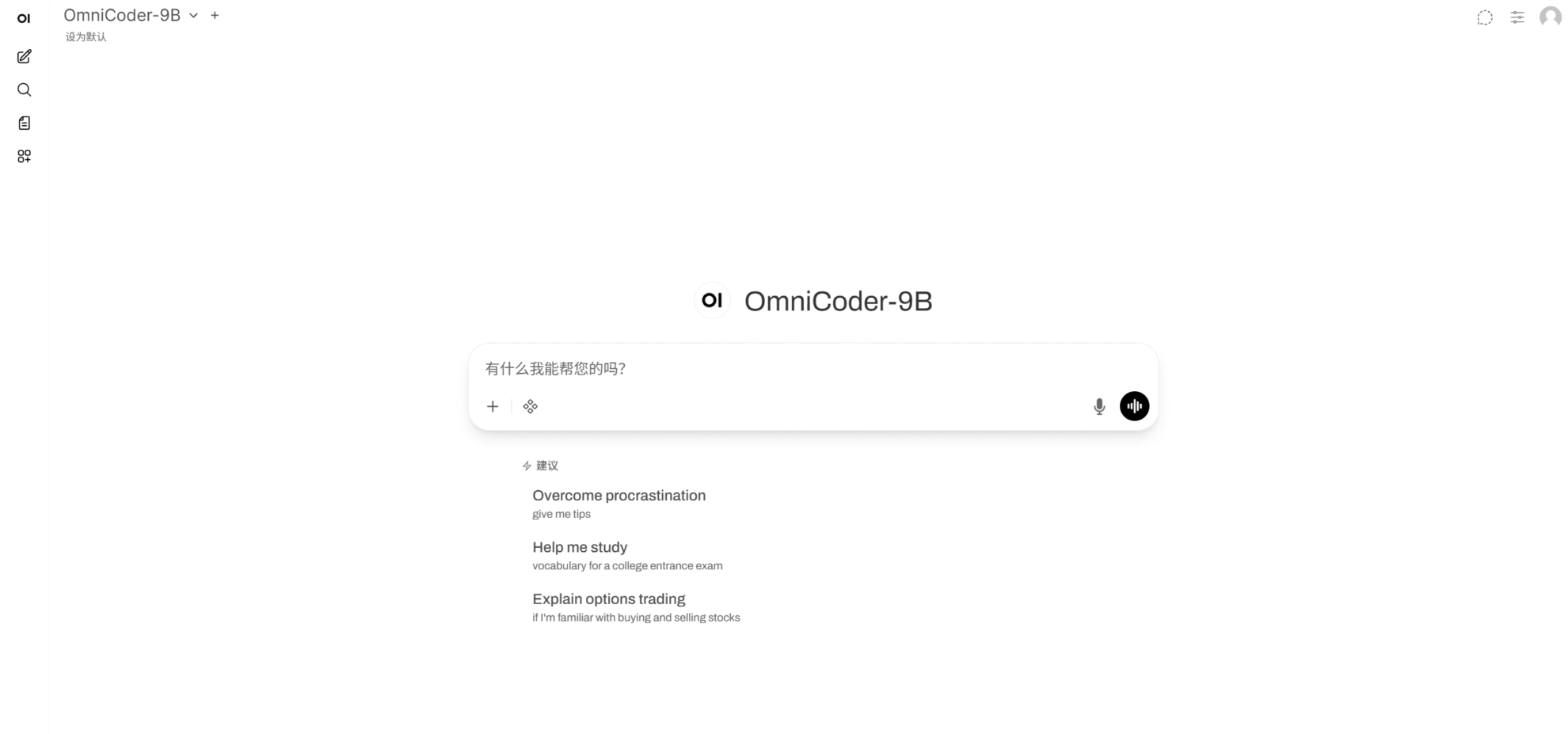

5. OmniCoder-9B : Pour les tâches de codage d’agents

OmniCoder-9B, publié par Teslatate en septembre 2025, est un modèle de proxy de codage à 9 paramètres basé sur une architecture hybride Qwen3.5-9B. Cet assistant de codage open source peut être déployé sur un seul GPU. OmniCoder-9B est spécifiquement optimisé pour les flux de travail de développement logiciel réels, en mettant l'accent sur l'inférence cohérente en plusieurs étapes, les opérations terminales, l'utilisation d'outils et les processus de modification de code. Il est particulièrement adapté aux tâches de codage nécessitant compréhension, modification et vérification, plutôt qu'à celles qui ne fournissent qu'une seule réponse.

Exécutez en ligne :https://go.hyper.ai/LfNz9

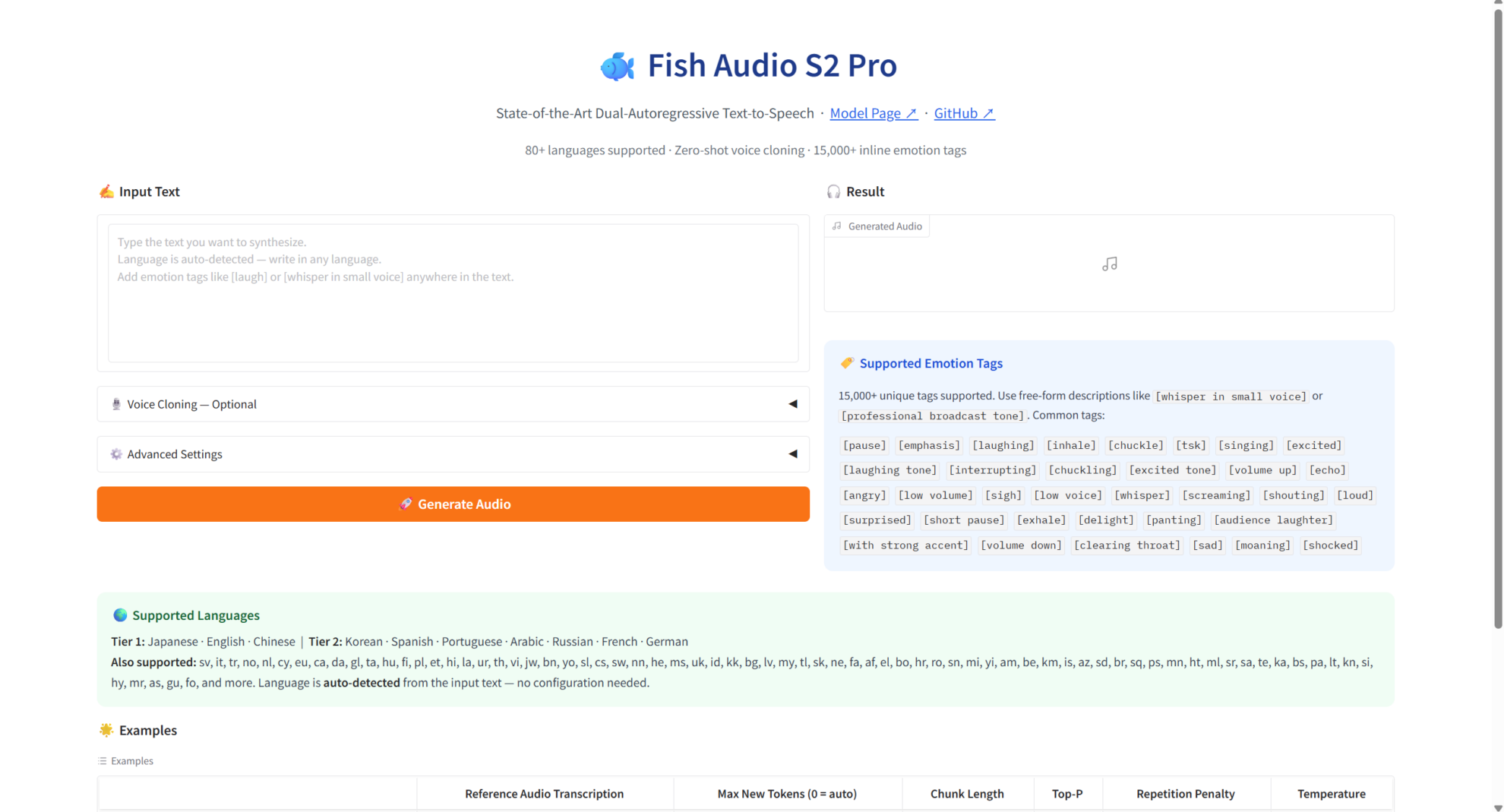

6. Fish Audio S2-Pro : Commande vocale en langage naturel avec reconnaissance des émotions.

En mars 2026, Fish Audio a lancé FishAudio-S2-Pro, un modèle de synthèse vocale (TTS) Dual-AR (double autorégressif) de bout en bout doté de 5 milliards de paramètres (4 milliards d'autorégressifs lents et 400 millions d'autorégressifs rapides). Ce modèle est optimisé pour des applications telles que la synthèse vocale multilingue, le clonage vocal personnalisé et la génération de parole émotionnelle. Il est spécifiquement conçu pour les tâches de synthèse vocale exigeant un rendu naturel et une grande précision.

Exécutez en ligne :https://go.hyper.ai/QEAJZ

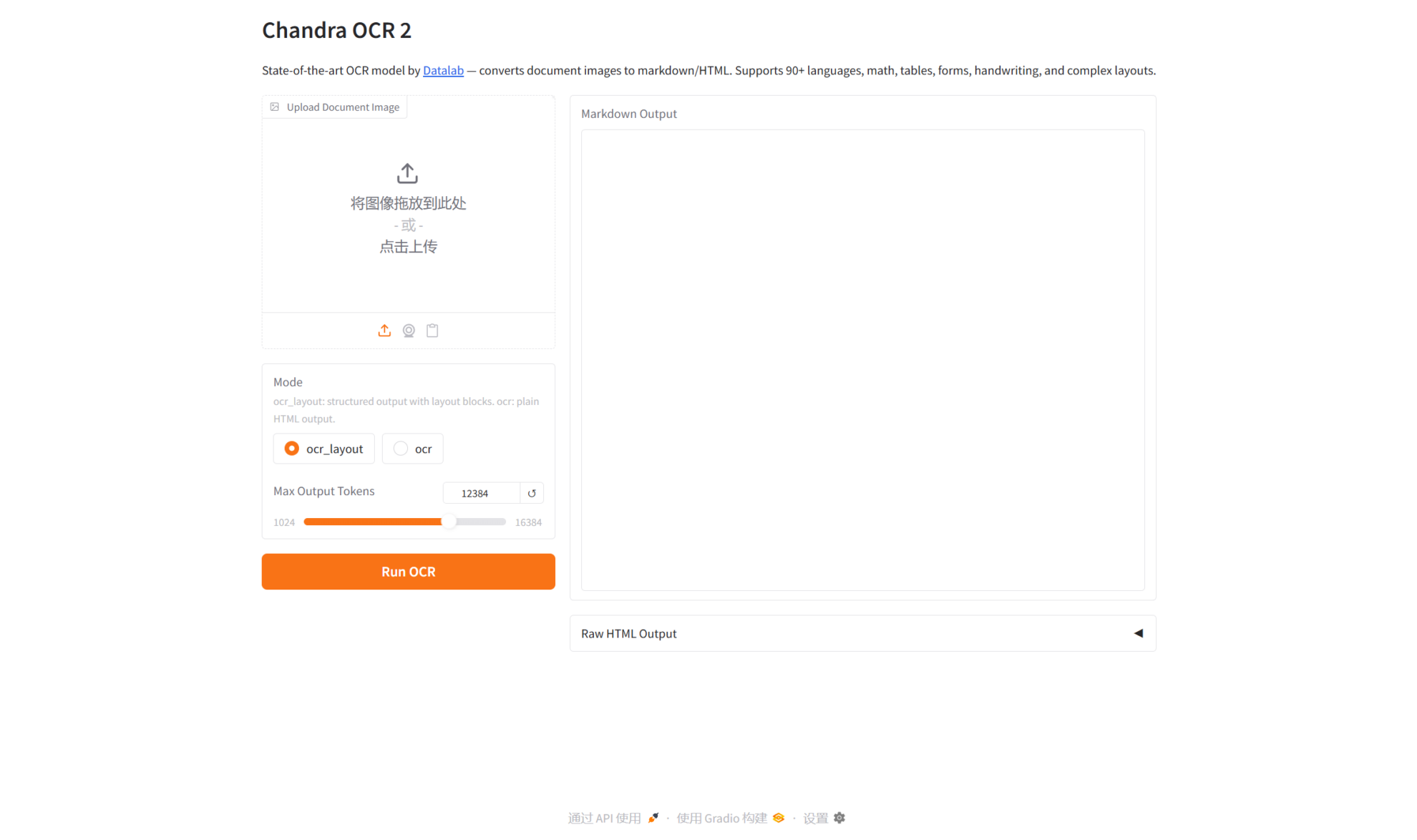

7. Chandra-ocr-2 convertit avec précision le contenu mathématique/de tableur/manuscrit en contenu structuré.

Chandra-ocr-2 est un système de reconnaissance optique de caractères de nouvelle génération, lancé par l'équipe Datalab en mars 2026. Il se concentre sur la reconnaissance de texte et la production de résultats structurés dans des environnements complexes. Ce modèle est optimisé grâce à une technologie avancée de pré-entraînement du langage visuel, ce qui lui permet de reconnaître intelligemment le contenu des images téléchargées et de renvoyer des résultats textuels formatés.

Exécutez en ligne :https://go.hyper.ai/3KobP

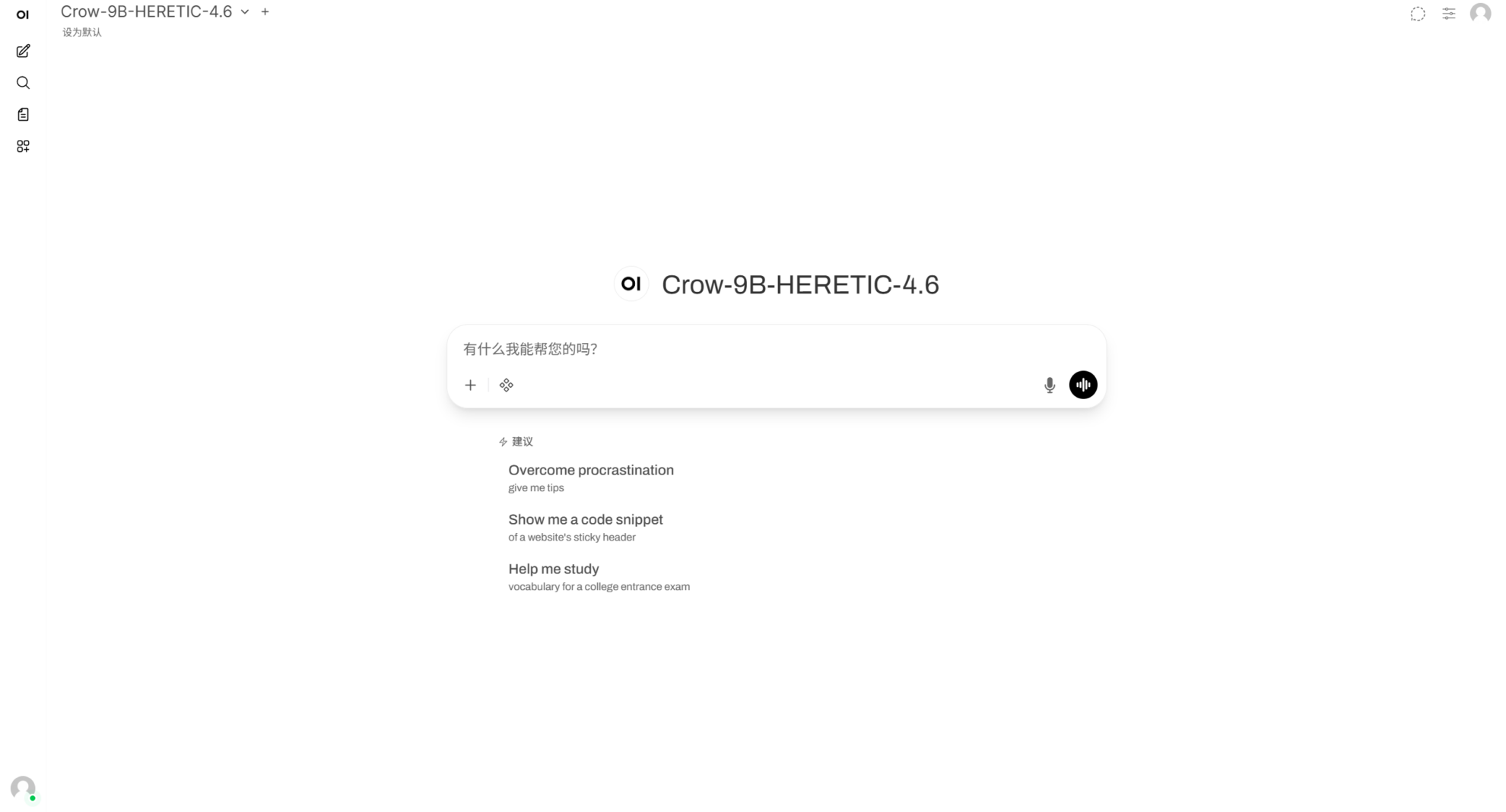

8. Crow-9B-HERETIC-4.6 : Un modèle de dialogue invoqué localement

Crow-9B-HERETIC-4.6, développé par Crownelius et sorti en 2025, est un modèle basé sur l'architecture Qwen 3.5. Ce modèle, doté de 9 paramètres, est distribué sous forme de LLM distillé. Il est optimisé pour des tâches telles que le dialogue général de haute qualité, le raisonnement logique, la rédaction de textes longs, l'assistance à la programmation et les interactions à plusieurs tours de parole. En tant que modèle de langage local de grande taille privilégiant la clarté, l'exhaustivité et la structuration des réponses, Crow-9B-HERETIC-4.6 convient parfaitement comme assistant intelligent général, outil d'apprentissage et modèle de génération de texte.

Exécutez en ligne :https://go.hyper.ai/DrpSp

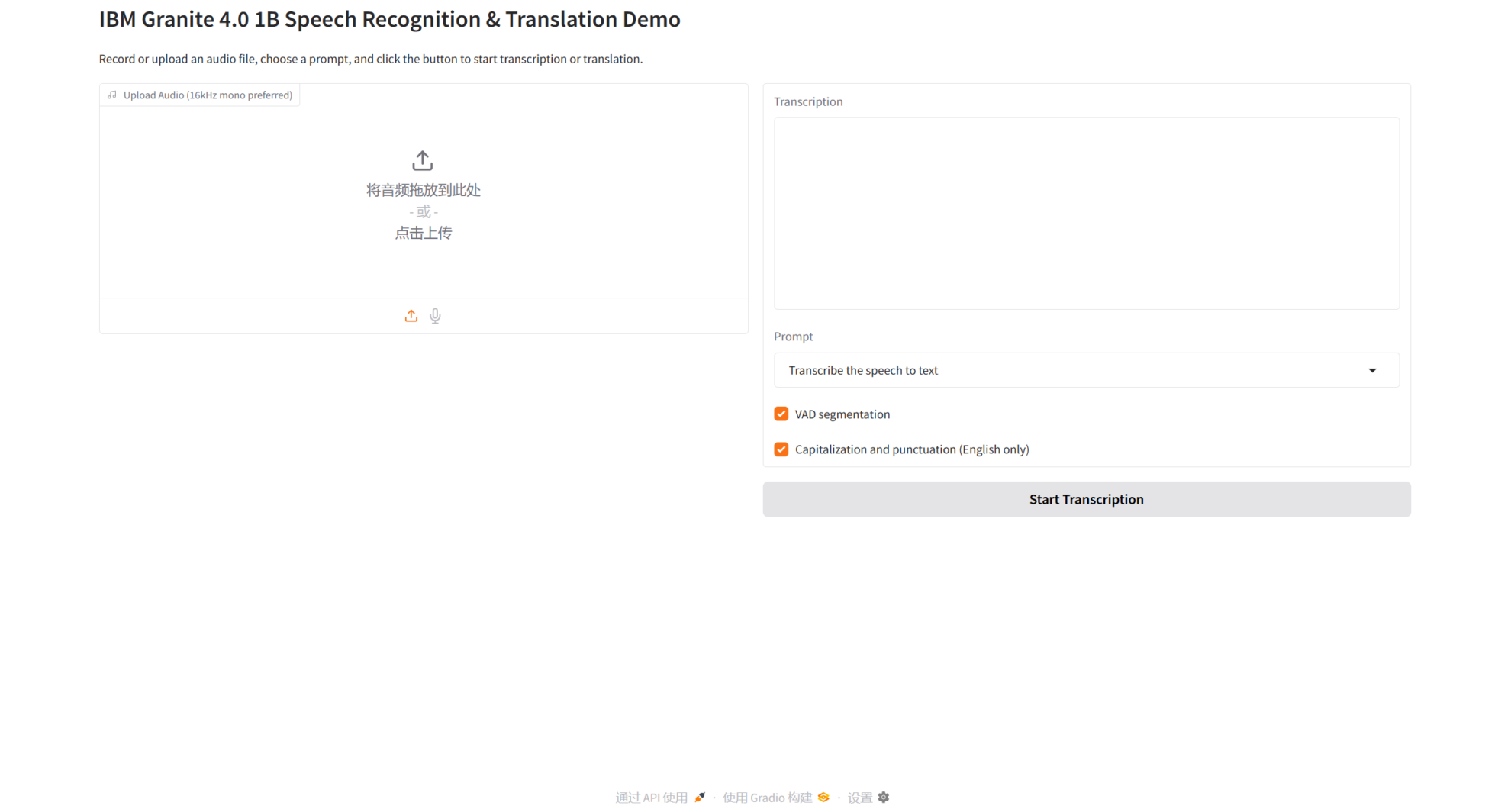

9. Granite 4.0 1B Speech : Déploiement de la reconnaissance et de la traduction vocales hors ligne

IBM Granite a lancé Granite 4.0 1B Speech en mars 2026. Ce modèle vocal compact, doté d'environ un milliard de paramètres, est conçu pour la reconnaissance vocale automatique multilingue et la traduction vocale bidirectionnelle. Il prend en charge plusieurs langues, dont l'anglais, le français, l'allemand, l'espagnol, le portugais et le japonais. Ce modèle est optimisé pour les appareils aux ressources limitées et convient parfaitement aux flux de travail de services hors ligne reposant sur des répertoires pondérés locaux et des interfaces de service standardisées.

Exécutez en ligne :https://go.hyper.ai/kzFhl

Interprétation des articles communautaires

1. L'université Cornell a développé EMSeek, une plateforme multi-agents capable de transformer des images de microscope électronique en informations sur les matériaux en seulement 2 à 5 minutes.

Une équipe de recherche de l'Université Cornell a proposé EMSeek, une plateforme multi-agents modulaire dotée de capacités de traçage de sources. Les résultats d'évaluation sur 20 systèmes de matériaux et cinq catégories de tâches montrent qu'elle atteint une vitesse environ deux fois supérieure et une précision accrue par rapport à Segment Anything pour les tâches de segmentation. De plus, avec un étalonnage utilisant seulement 21 données étiquetées TP3T, elle égale, voire surpasse, les performances de modèles mono-expert performants sur trois jeux de données de prédiction de propriétés hors distribution. Une requête complète ne prend que 2 à 5 minutes par image, soit environ 50 fois plus rapide qu'un flux de travail réalisé par un expert.

Voir le rapport complet :https://go.hyper.ai/1OlNI

2. En obtenant une accélération de l'inférence de 1,4 à 3,7 fois, le MIT propose DRiffusion pour surmonter le goulot d'étranglement de la latence d'échantillonnage des modèles de diffusion.

Des chercheurs du MIT ont proposé le modèle de diffusion DRiffusion, une version améliorée qui combine les avantages des méthodes systémiques et mathématiques pour obtenir une accélération significative sans compromettre la qualité de la génération. Ce modèle offre une solution novatrice pour concilier haute fidélité et efficacité d'échantillonnage dans les modèles de diffusion.

Voir le rapport complet :https://go.hyper.ai/lbzzK

Articles populaires de l'encyclopédie

1. Compétences

2. Sous-ajustement

3. Glitch Token (terme utilisé pour décrire un terme lié aux bugs)

4. Vérité de base

5. Fusion de rangs réciproques

Voici des centaines de termes liés à l'IA compilés pour vous aider à comprendre « l'intelligence artificielle » ici :

Voici tout le contenu de la sélection de l’éditeur de cette semaine. Si vous avez des ressources que vous souhaitez inclure sur le site officiel hyper.ai, vous êtes également invités à laisser un message ou à soumettre un article pour nous le dire !

À la semaine prochaine !