Command Palette

Search for a command to run...

Tutoriel En Ligne | Modification Intensive d'une Seule Carte Disponible ; MiniCPM-V-4.6 Open-source, Modèle De Bord 1.3B Prenant En Charge La Compréhension d'images/de vidéos/OCR/dialogue Multimodal À Plusieurs tours.

Ces dernières années, l'industrie de l'IA a été presque entièrement dominée par le concept de loi d'échelle. Plus le nombre de paramètres et le volume de données d'entraînement sont importants, plus le modèle semble se rapprocher de l'« intelligence générale ». Des centaines de milliards aux billions de paramètres, les grands modèles ont constamment repoussé les limites de notre conception du raisonnement et de la connaissance du monde, et ont également fait de l'« accumulation de puissance de calcul et de la mise à l'échelle » la voie de développement privilégiée de l'industrie.

Mais à mesure que l'IA commence réellement à être appliquée dans l'industrie, un véritable problème émerge progressivement :Tous les scénarios ne nécessitent pas le déploiement de supermodèles dans des centres de données cloud.Les coûts d'inférence élevés, la latence réseau incontrôlable et les risques croissants liés à la confidentialité des données constituent des goulots d'étranglement dans l'approche par modélisation « vaste et complète ». Le « triangle impossible » entre performance, rapidité et coût est devenu un problème que la démocratisation de l'IA doit résoudre.

Ainsi, une tendance apparemment contre-intuitive a commencé à émerger : les modèles avec des paramètres plus petits ont démontré une efficacité et une rentabilité supérieures dans un nombre croissant de scénarios réels, notamment dans les dispositifs périphériques et les environnements industriels à haute concurrence.Les modèles légers prennent en charge des tâches fondamentales telles que la reconnaissance optique de caractères (OCR), la réponse aux questions par image et la reconnaissance d'intention.Elles peuvent fonctionner hors ligne sur des appareils mobiles à des vitesses de l'ordre de la milliseconde, et gèrent également le routage et la réduction des coûts au sein du système RAG, devenant ainsi une infrastructure cruciale pour la véritable mise en œuvre des applications d'IA.

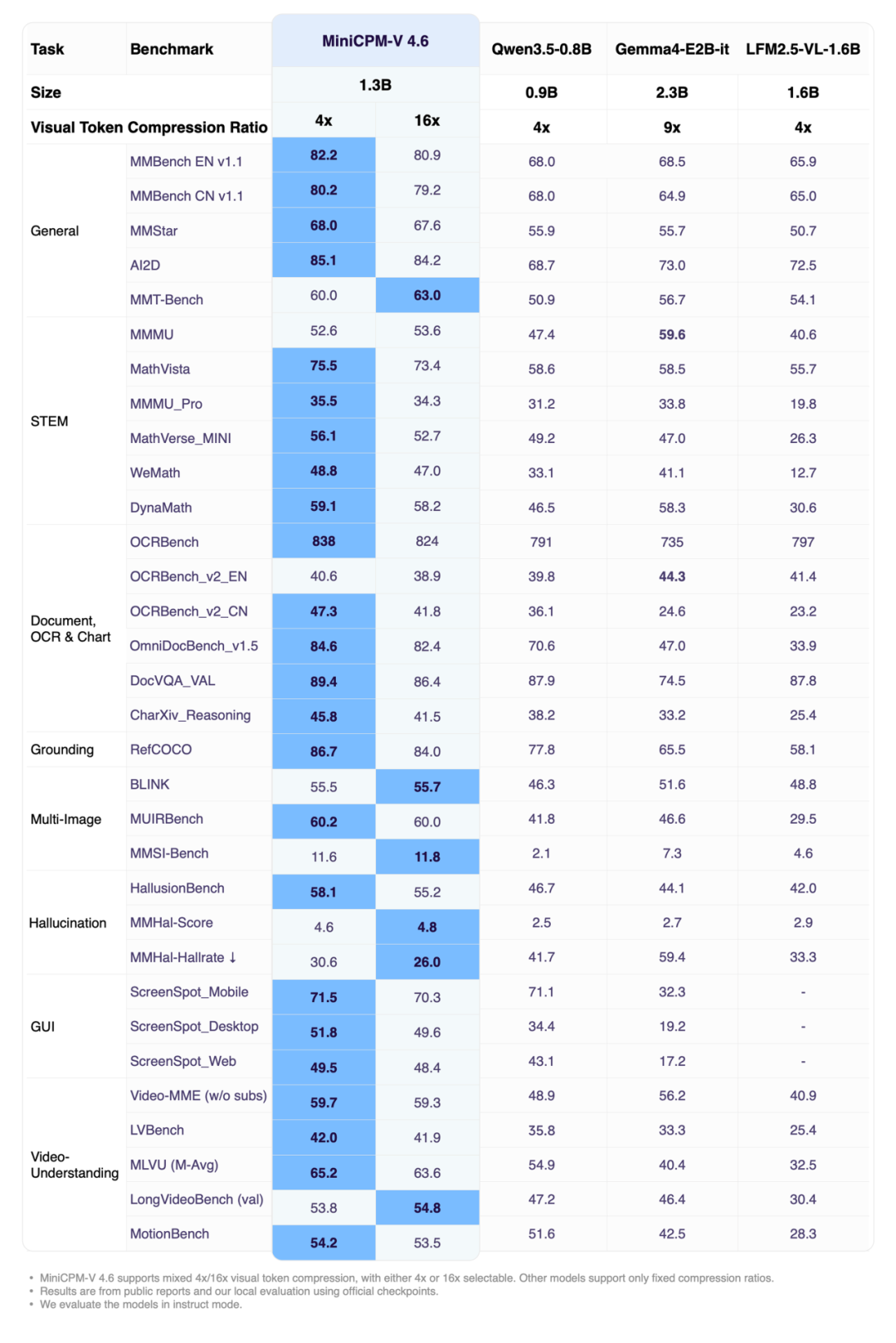

Récemment, Facewall Intelligence, l'Université Tsinghua et OpenBMB ont conjointement publié en open source le modèle multimodal de nouvelle génération MiniCPM-V 4.6. Ce modèle ne comporte qu'environ 1,3 milliard de paramètres, mais il prend en charge la compréhension d'images, la compréhension vidéo, la reconnaissance optique de caractères (OCR) et les capacités de dialogue multimodal à plusieurs tours, et a surpassé d'autres modèles du même niveau dans de multiples évaluations.

Il convient de noter que la carte modèle officielle fournit une solution d'inférence AutoProcessor et AutoModelForImageTextToText basée sur Transformers, qui convient à la vérification rapide et au prototypage d'applications dans un environnement GPU unique.

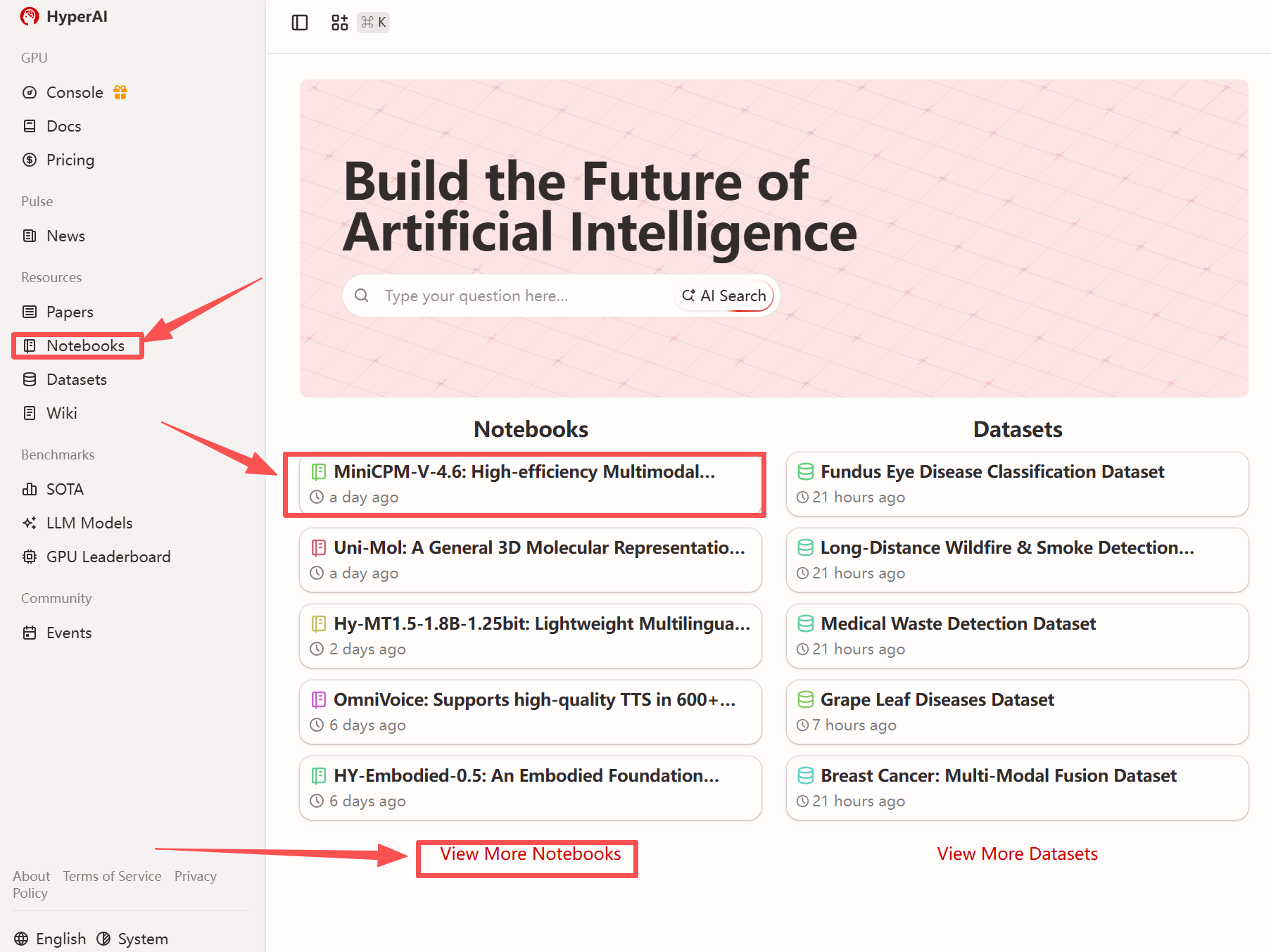

Pour permettre aux développeurs du monde entier de prendre rapidement en main ce modèle léger, HyperAI a lancé « MiniCPM-V-4.6 : un modèle de langage visuel multimodal et performant pour les applications Edge ». La configuration de l’environnement est terminée et le déploiement en ligne du modèle est aisé.

Exécutez en ligne :https://go.hyper.ai/GVDmw

Consultez les articles de recherche connexes :

https://hyper.ai/papers/2605.08985

Plus de tutoriels en ligne :

Bienvenue sur notre site web officiel pour plus d'informations :

Essai de démonstration

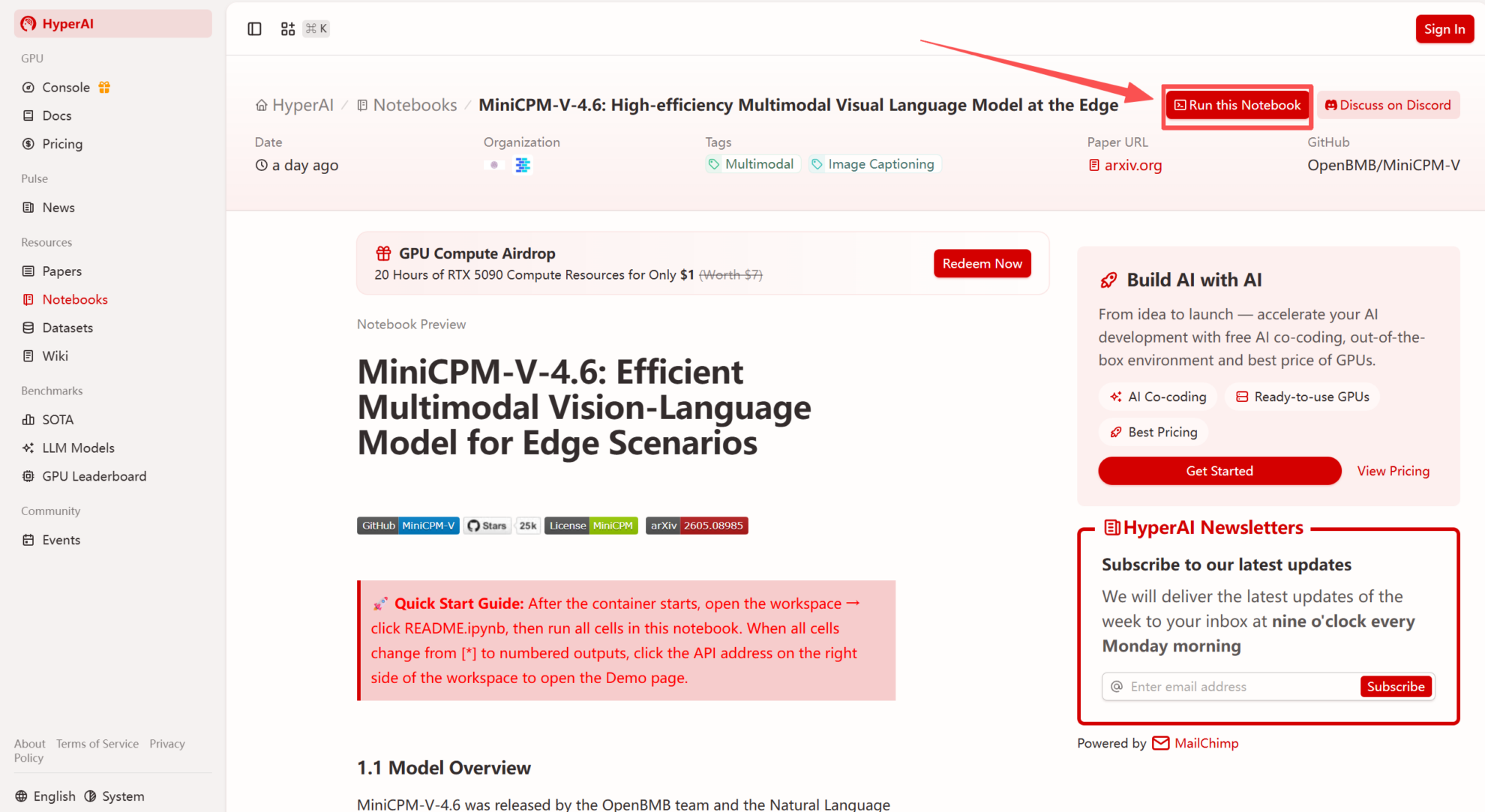

1. Après avoir accédé à la page d'accueil d'hyper.ai, sélectionnez la page « Tutoriels » ou cliquez sur « Voir plus de tutoriels », sélectionnez « MiniCPM-V-4.6 : Modèle de langage visuel multimodal efficace pour appareils », puis cliquez sur « Exécuter ce tutoriel ».

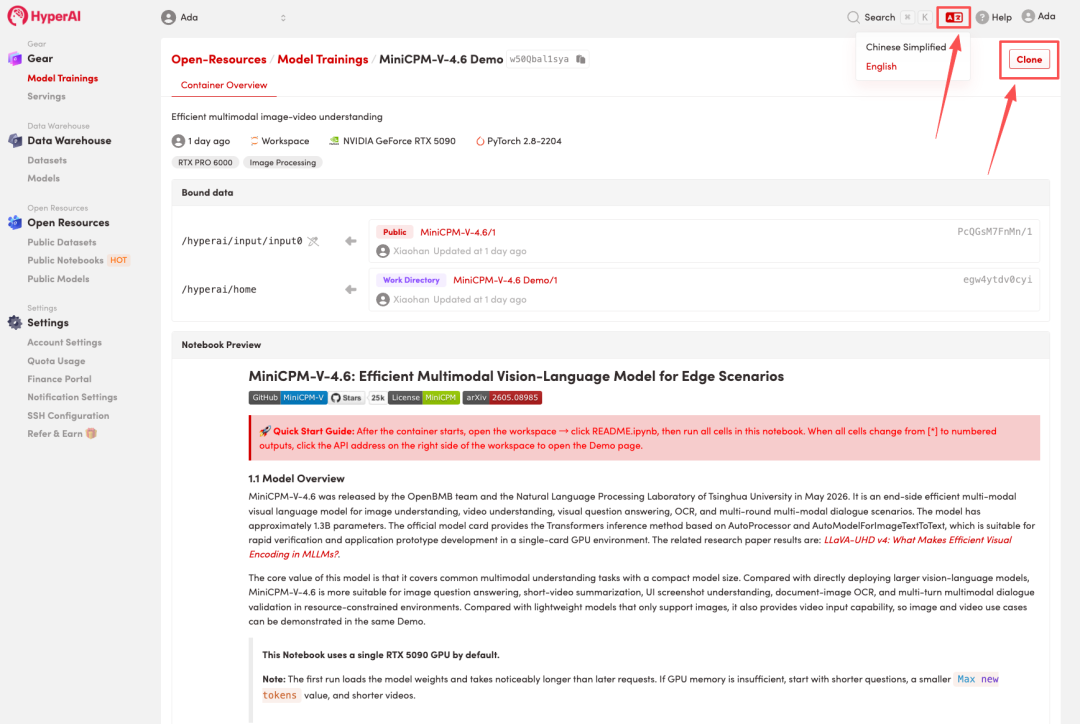

2. Une fois la page redirigée, cliquez sur « Cloner » en haut à droite pour cloner le tutoriel dans votre propre conteneur.

Remarque : Vous pouvez changer de langue en haut à droite de la page. Actuellement, le chinois et l’anglais sont disponibles. Ce tutoriel présente les étapes en anglais.

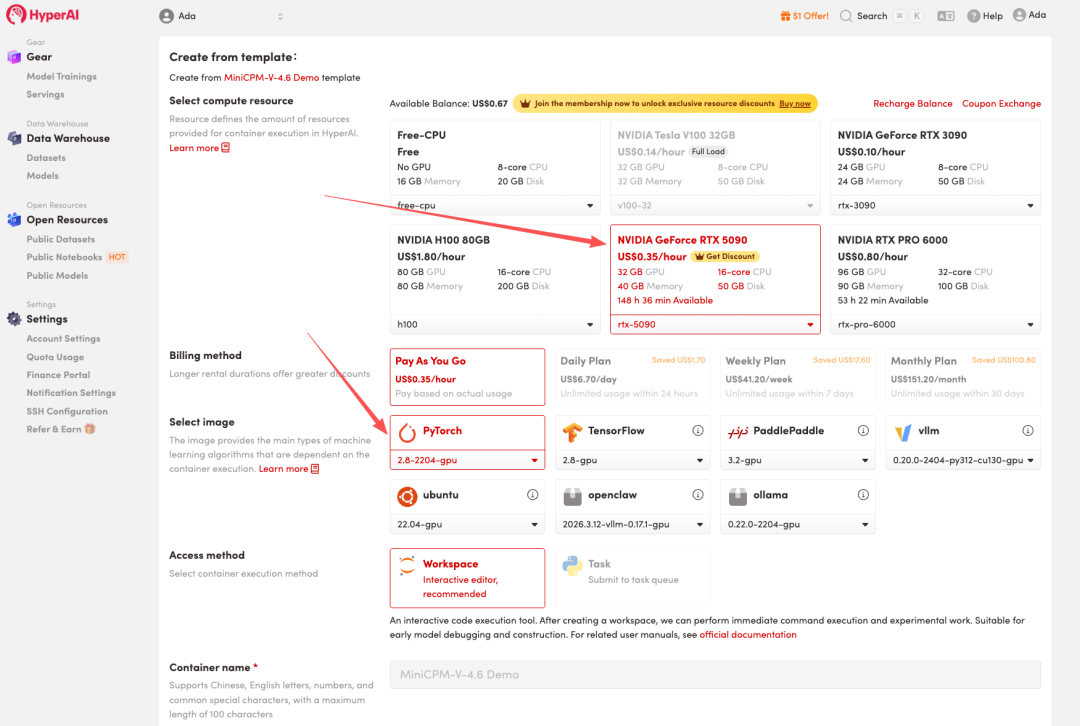

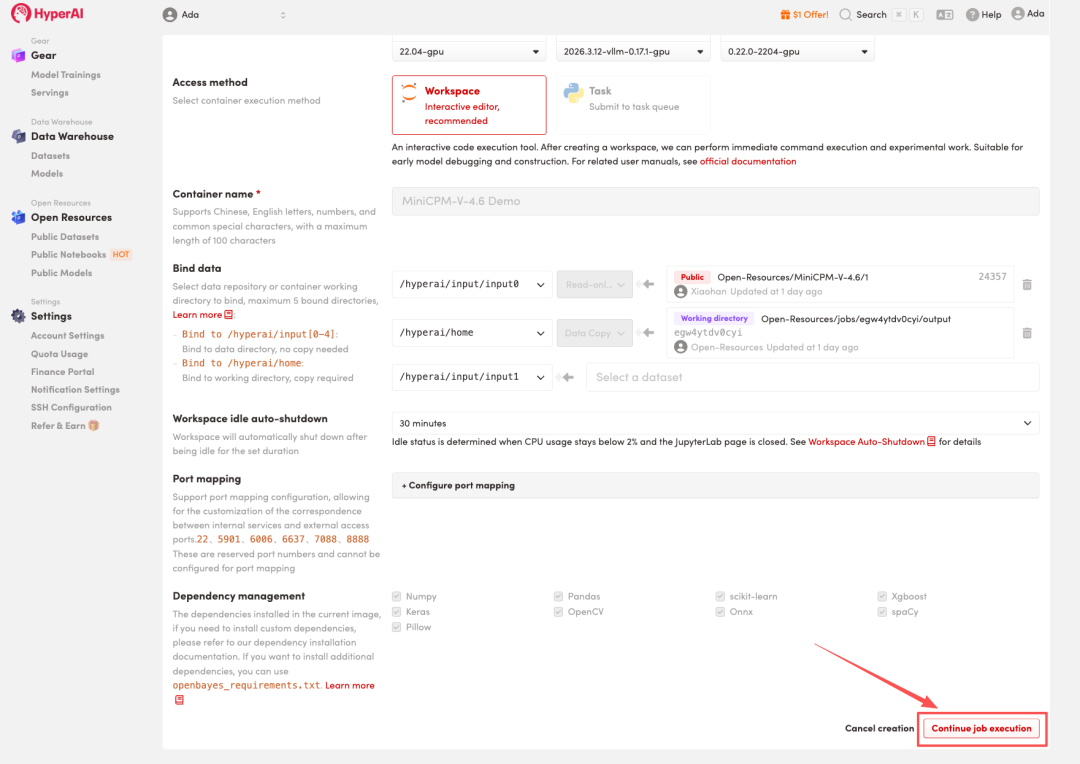

3. Sélectionnez les images « NVIDIA RTX 5090 » et « PyTorch », puis cliquez sur « Continuer l'exécution de la tâche ».

HyperAI propose un bonus d'inscription pour les nouveaux utilisateurs : pour seulement $1, vous pouvez obtenir 20 heures de puissance de calcul RTX 5090 (au lieu de $7), et les ressources sont valables indéfiniment.

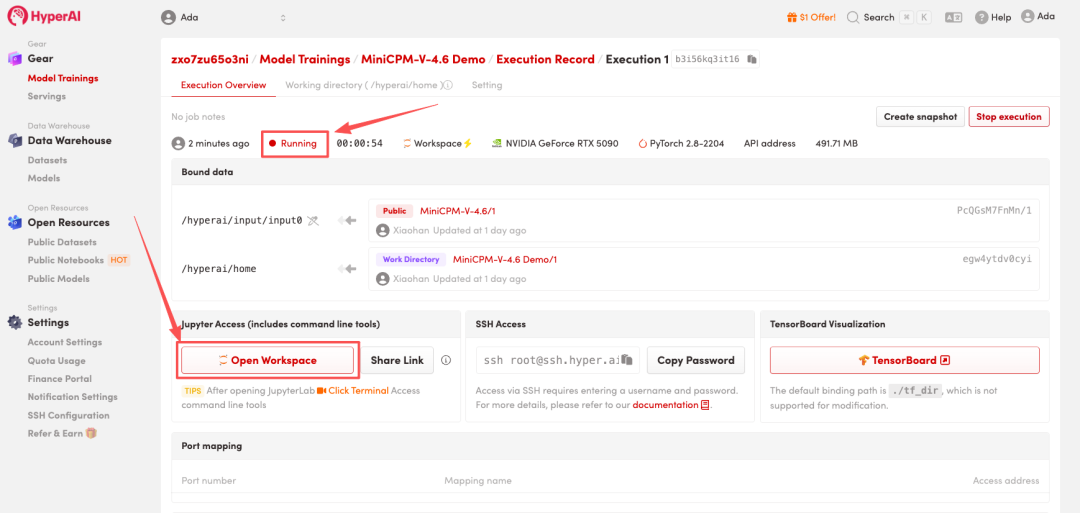

4. Attendez que les ressources soient allouées. Une fois que le statut passe à « En cours d'exécution », cliquez sur « Ouvrir l'espace de travail » pour accéder à l'espace de travail Jupyter.

Affichage des effets

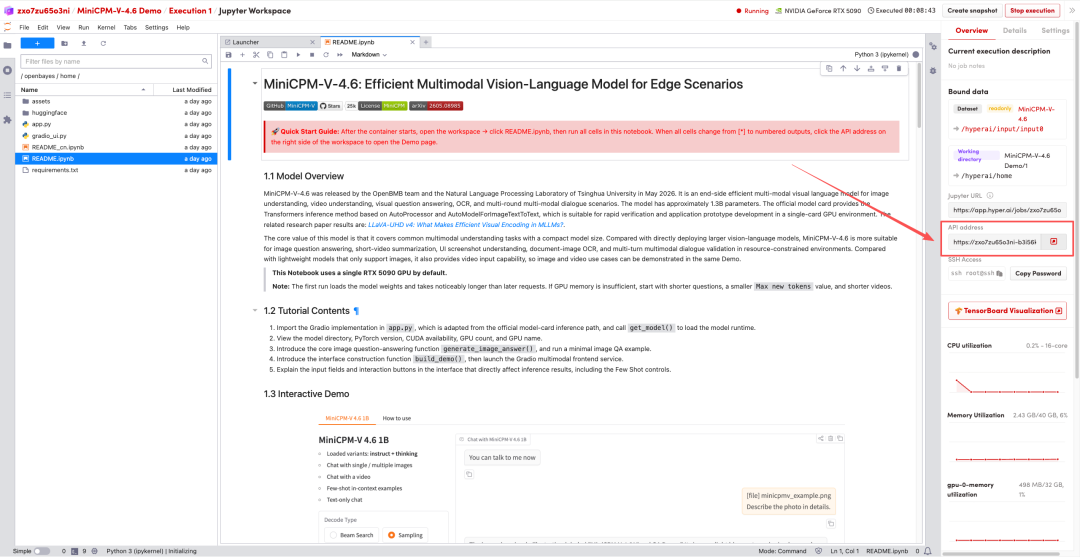

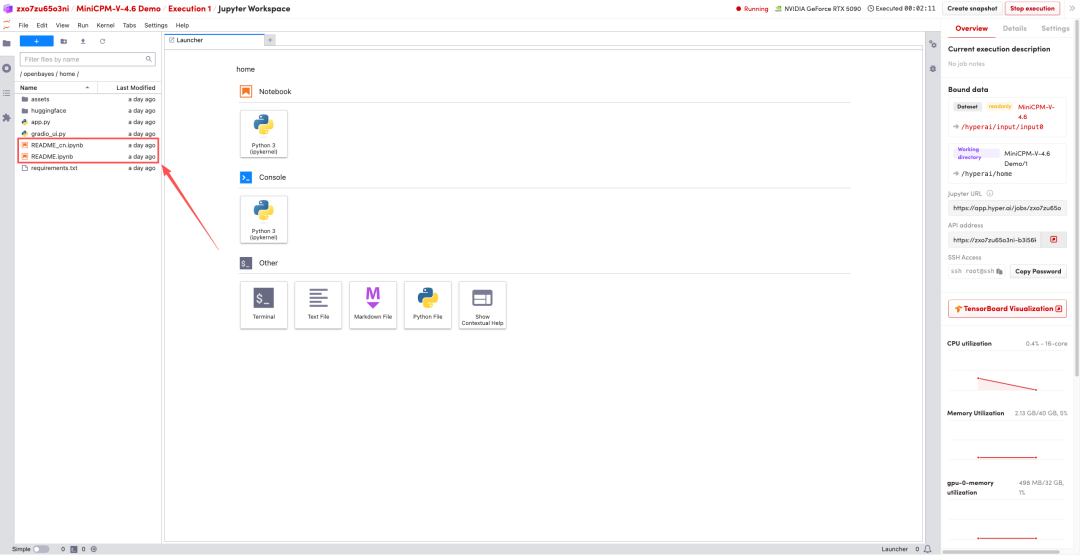

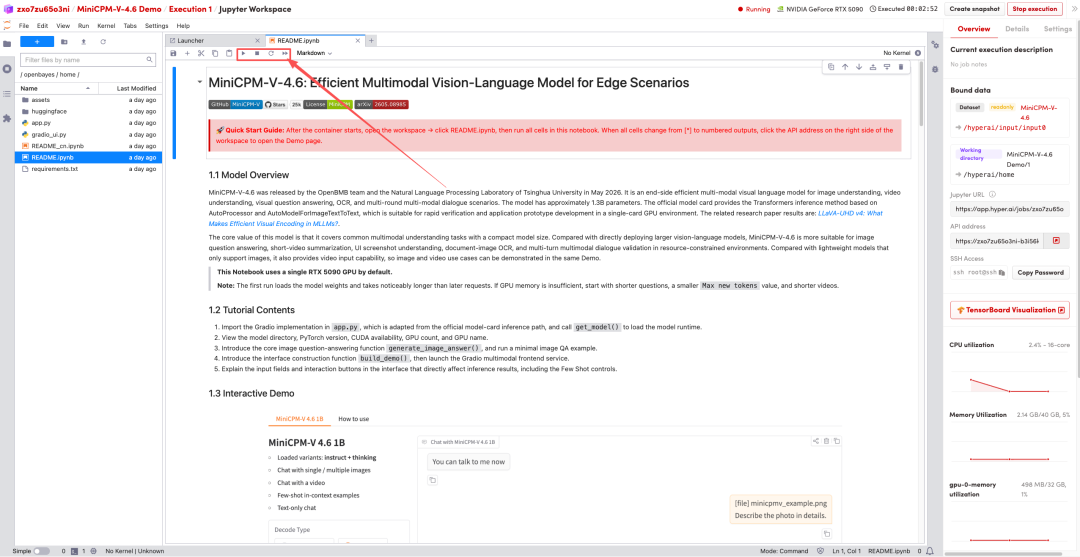

1. Une fois la page redirigée, cliquez sur le fichier README à gauche, puis sur « Exécuter » en haut.

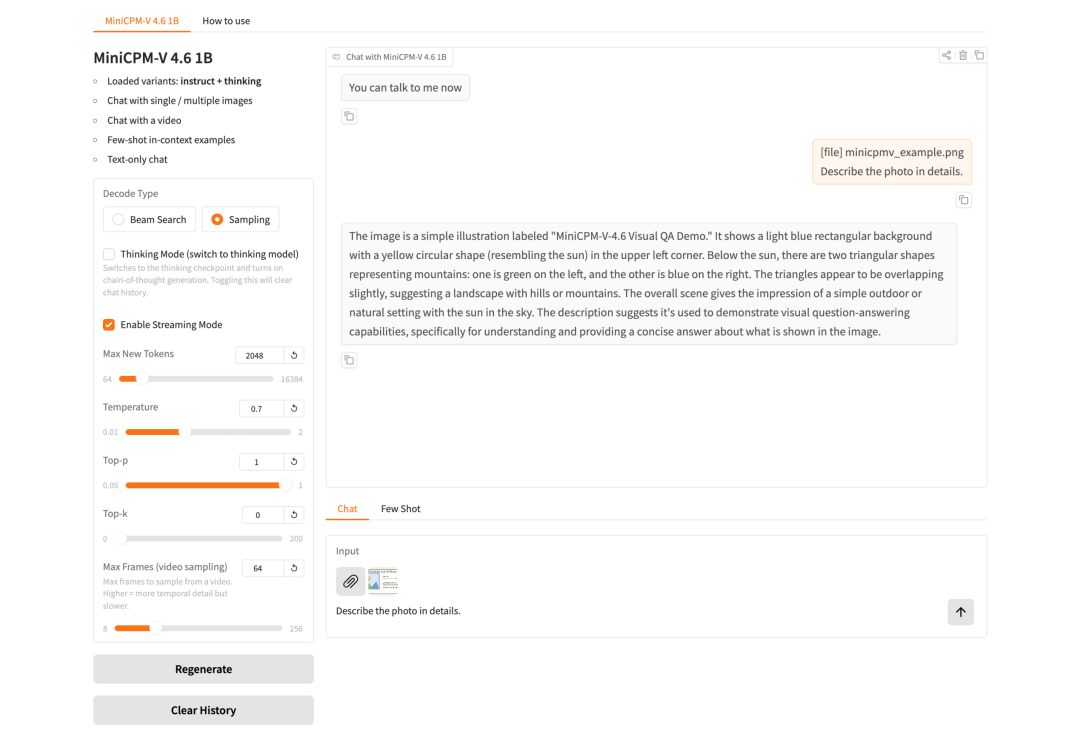

2. Une fois le processus terminé, cliquez sur l'adresse API à droite pour accéder à la page de démonstration.