Command Palette

Search for a command to run...

Tutoriel En Ligne | Le Modèle De Vision 3D Universel VGGT a Remporté Le Prix Du Meilleur Article Du CVPR 2025. Sa Vitesse d'inférence Peut Atteindre Quelques secondes.

Le 13 juin, CVPR 2025, l'une des trois plus importantes conférences mondiales sur la vision par ordinateur, a annoncé les prix des meilleurs articles. Selon les données officielles, CVPR 2025 a reçu 13 008 articles soumis par plus de 40 000 auteurs, soit une augmentation de 131 TP3T par rapport à l'année dernière.La conférence a finalement accepté 2 872 articles, avec un taux d'acceptation global d'environ 22,1%.

Parmi les près de 3 000 articles finalement sélectionnés, un seul a été retenu et a remporté le titre de « Meilleur Article ». Imaginez sa valeur.Cette réalisation est un modèle de vision 3D général VGGT basé sur une architecture Transformer à feedforward pure proposée conjointement par l'Université d'Oxford et Meta AI.Il résout le défi des modèles précédents limités à une seule tâche et peut déduire directement toutes les propriétés 3D clés de la scène à partir d'une, plusieurs ou des centaines de perspectives, y compris les paramètres de la caméra, les cartes de points, les cartes de profondeur et les pistes de points 3D.

* Titre de l'article :「VGGT : Transformateur de mise à la terre à géométrie visuelle"

* Lien vers l'article :https://go.hyper.ai/Nmgxd

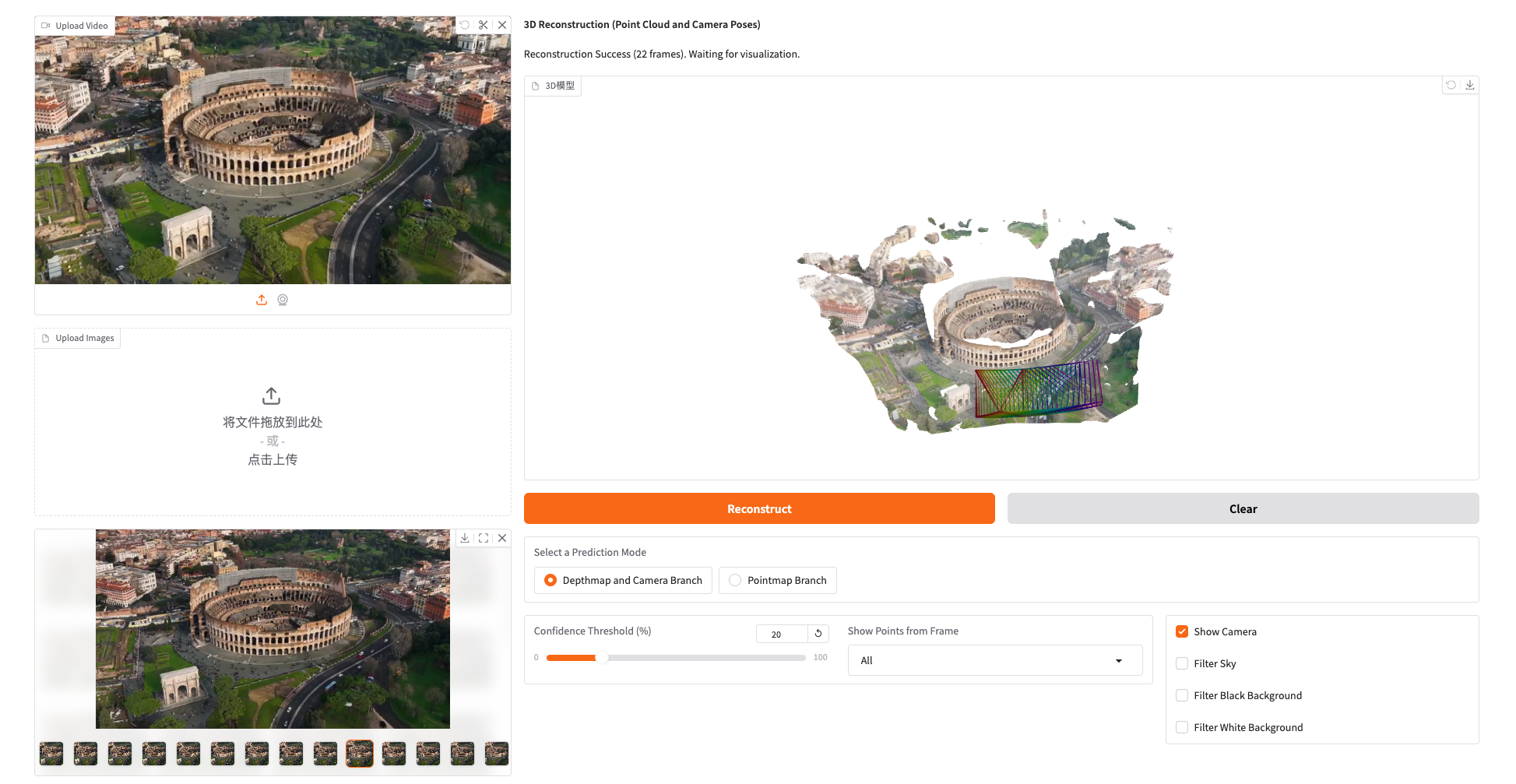

Plus important encore, cette méthode est simple et efficace.Capable de terminer la reconstruction d'image en moins d'une seconde.Les performances de VGGT dépassent celles des alternatives reposant sur des techniques de post-traitement d'optimisation de la géométrie visuelle. Les résultats expérimentaux montrent que VGGT atteint des performances de niveau SOTA dans de nombreuses tâches 3D, notamment l'estimation des paramètres de caméra, l'estimation de la profondeur multi-vues, la reconstruction de nuages de points denses et le suivi de points 3D.

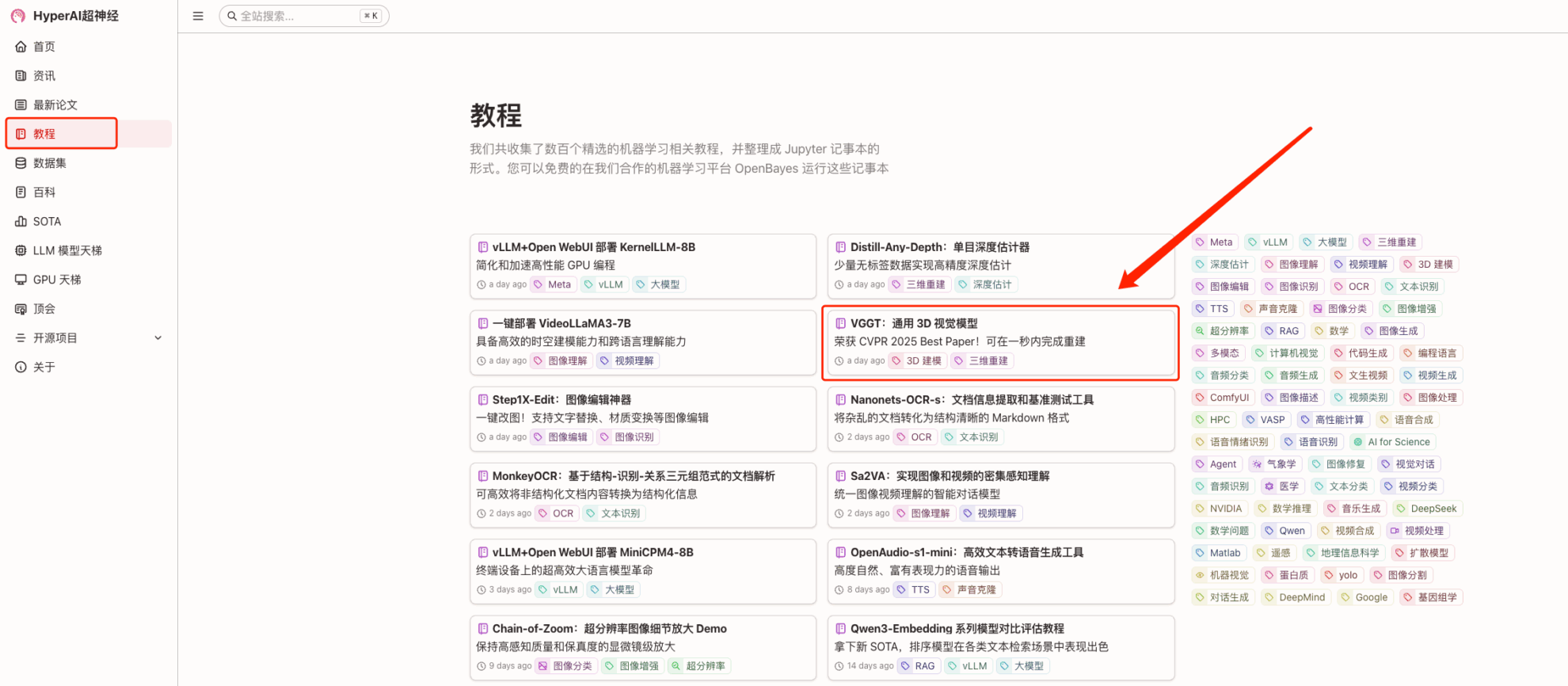

à l'heure actuelle,La section tutoriel de HyperAI Hyper.ai a lancé « VGGT : un modèle de vision 3D universel ».Soutenez l'effet d'expérience de déploiement en un clic, venez ressentir la force puissante de cette percée⬇️

* Lien du tutoriel :https://go.hyper.ai/GX3bC

Essai de démonstration

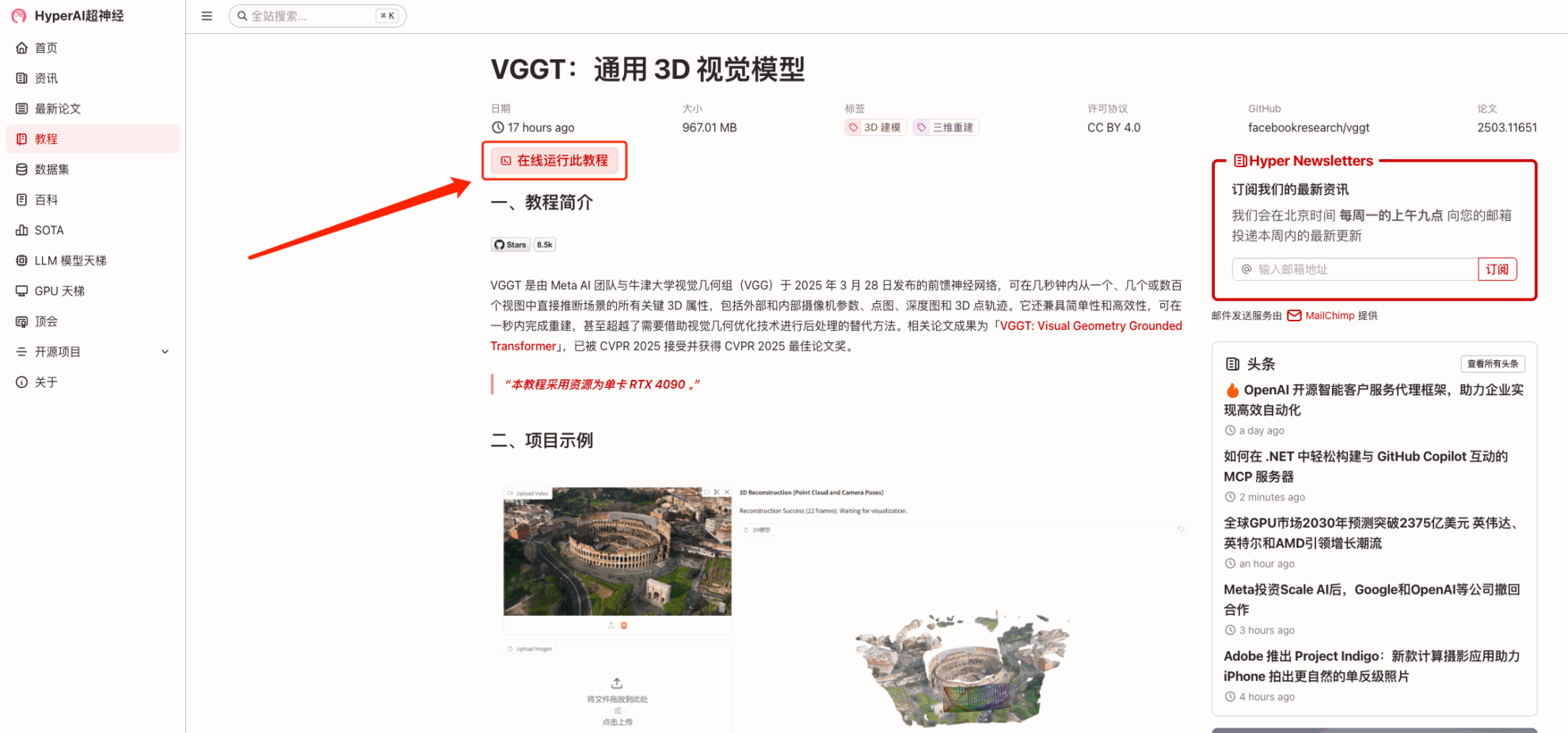

1. Après avoir accédé à la page d'accueil de hyper.ai, sélectionnez la page « Tutoriel », sélectionnez « VGGT : Modèle de vision 3D général » et cliquez sur « Exécuter ce tutoriel en ligne ».

2. Une fois la page affichée, cliquez sur « Cloner » dans le coin supérieur droit pour cloner le didacticiel dans votre propre conteneur.

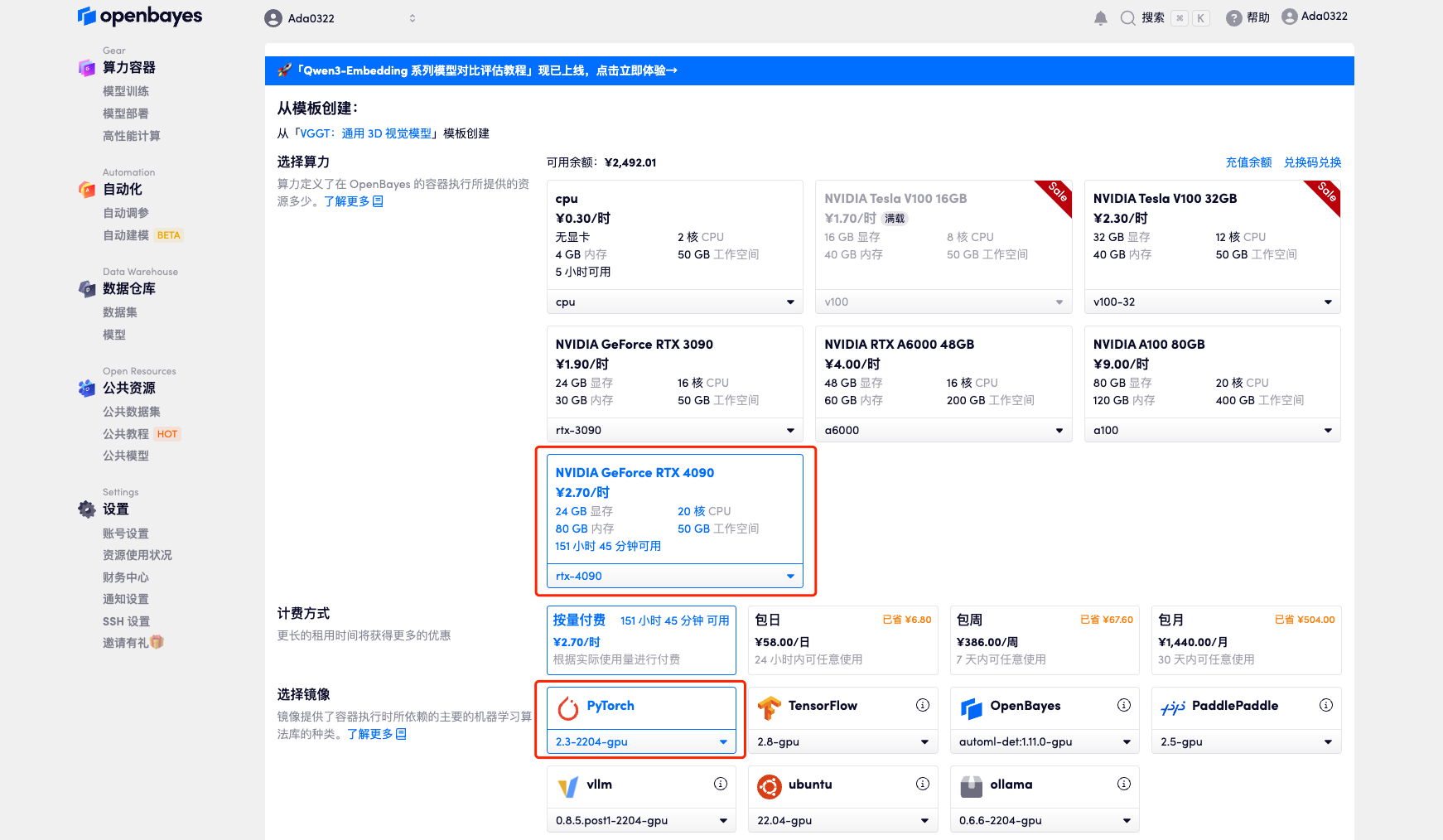

3. Sélectionnez les images « NVIDIA RTX 4090 » et « PyTorch ». La plateforme OpenBayes propose quatre modes de facturation. Vous pouvez choisir entre « Paiement à l'utilisation » ou « Paiement journalier/hebdomadaire/mensuel » selon vos besoins. Cliquez sur « Continuer ». Les nouveaux utilisateurs peuvent s'inscrire via le lien d'invitation ci-dessous pour obtenir 4 heures de RTX 4090 et 5 heures de temps processeur gratuit !

Lien d'invitation exclusif HyperAI (copier et ouvrir dans le navigateur) :

https://openbayes.com/console/signup?r=Ada0322_NR0n

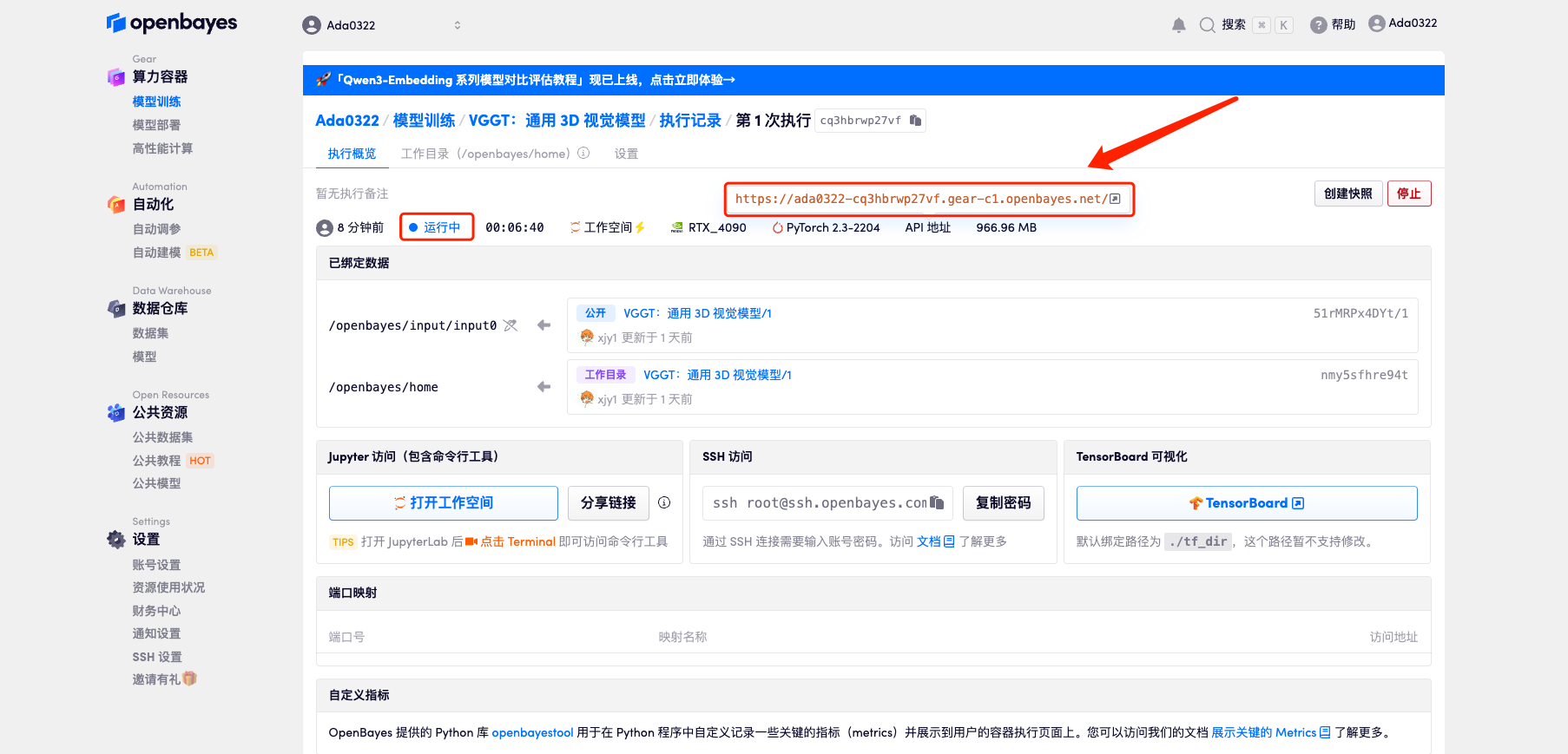

4. Attendez que les ressources soient allouées. Le premier processus de clonage prend environ 2 minutes. Lorsque le statut passe à « En cours d'exécution », cliquez sur la flèche de saut à côté de « Adresse API » pour accéder à la page de démonstration. Étant donné que le modèle est volumineux, il faut environ 3 minutes pour afficher l'interface WebUI, sinon « Bad Gateway » s'affichera. Veuillez noter que les utilisateurs doivent effectuer l'authentification par nom réel avant d'utiliser la fonction d'accès à l'adresse API.

Démonstration d'effet

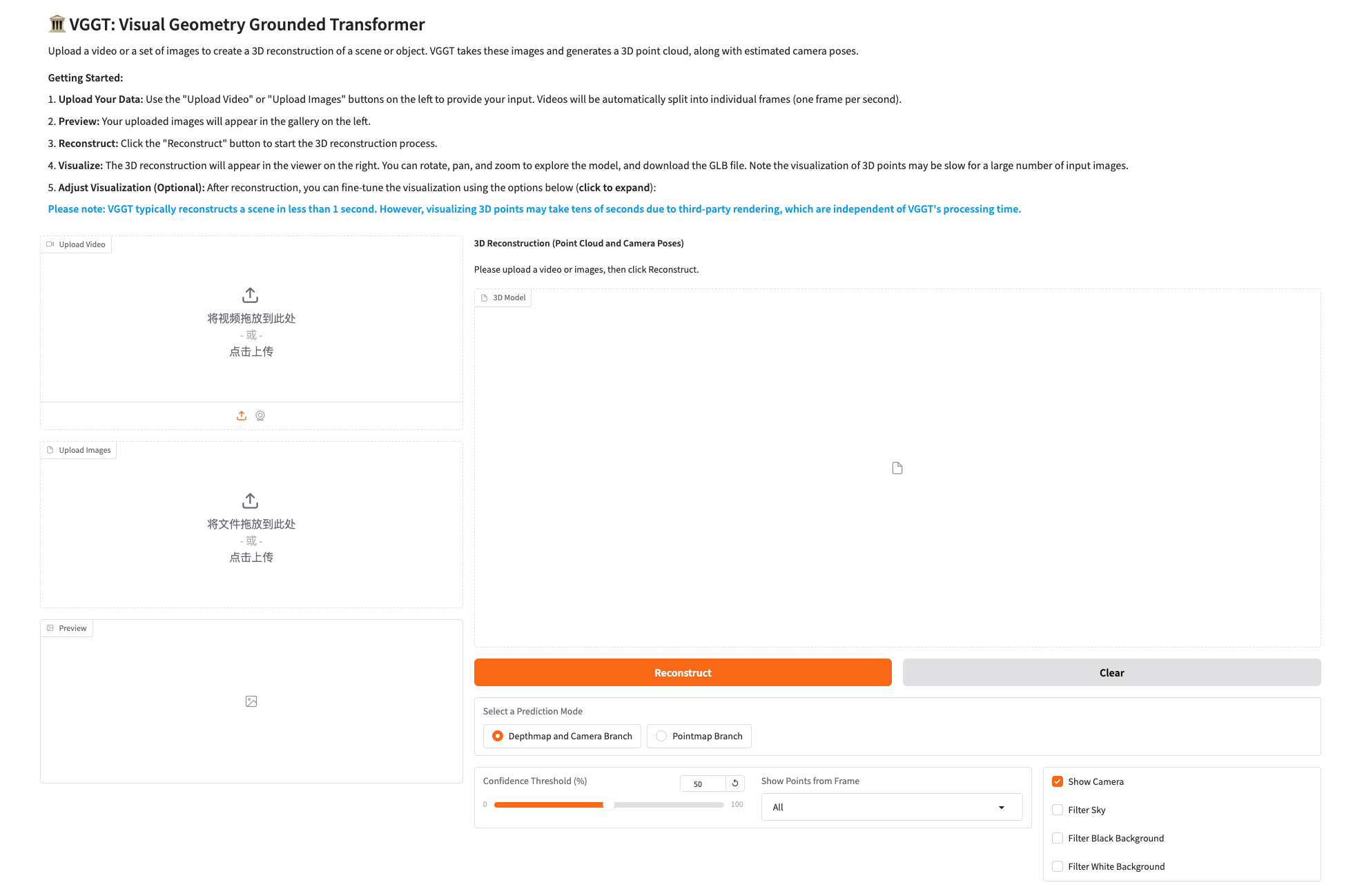

1. Cliquez sur l'adresse de l'API pour accéder à la page de démonstration et découvrir le modèle, comme indiqué ci-dessous :

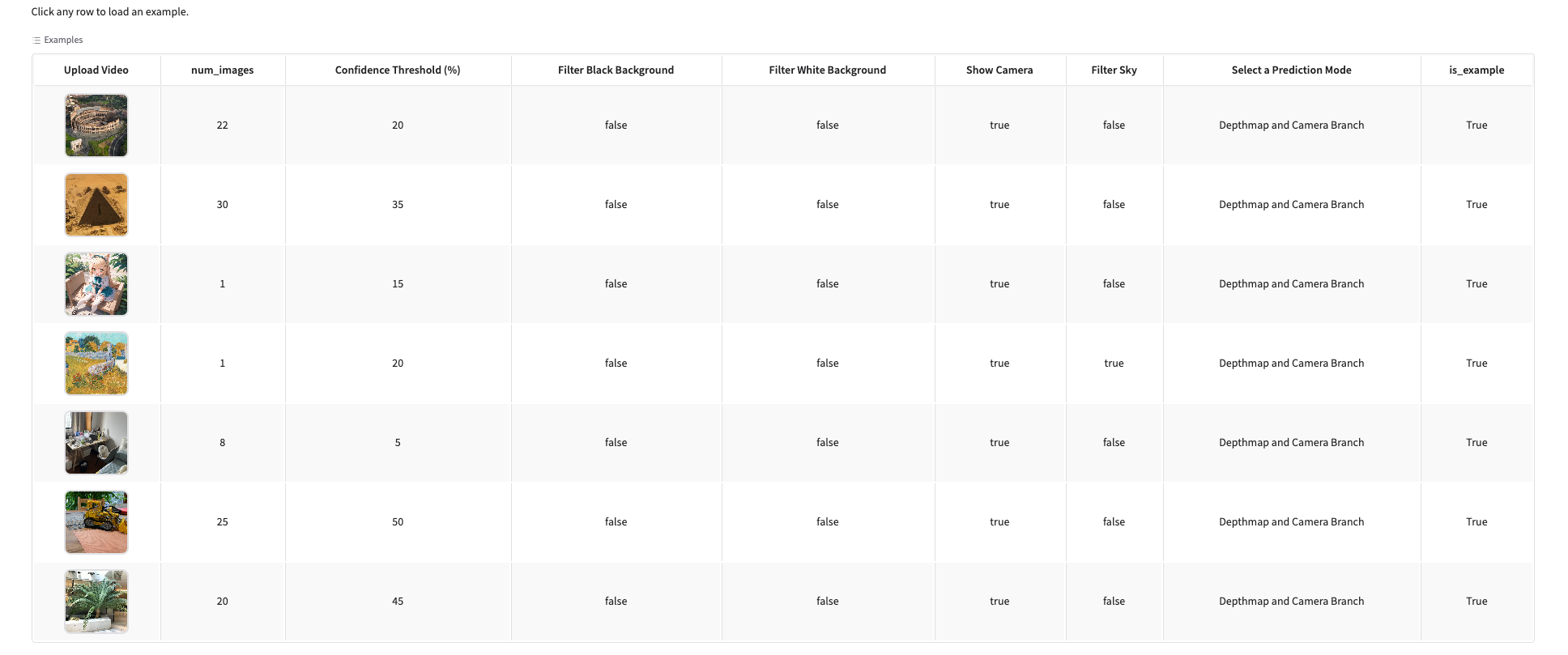

2. Nous avons préparé des exemples pour vous dans ce tutoriel. Vous pouvez directement expérimenter l'effet du modèle en cliquant dessus, comme illustré ci-dessous.

Voici le tutoriel recommandé pour ce problème. N'hésitez pas à l'essayer par vous-même ⬇️

* Lien du tutoriel :https://go.hyper.ai/GX3bC