Command Palette

Search for a command to run...

Online-Tutorial | Microsoft Stellt TRELLIS.2 Als Open Source Für Generative 3D-Modelle Bereit: Hochauflösende Assets Mit Vollständigen Texturen in 3 Sekunden Generieren

In den letzten Jahren wurde generative KI in großem Umfang auf 2D-Inhalte – Bilder, Videos und Texte – angewendet, aber die 3D-Generierung blieb eine scheinbar erreichbare, aber schwer fassbare Herausforderung, da sie mehr als nur eine Erhöhung der Dimensionalität beinhaltet.Es handelt sich dabei auch um einen umfassenden Test der Darstellungsmethode, der Lernziele und der technischen Anwendbarkeit.

Die zentrale Herausforderung für generative 3D-Modelle bestand nie einfach darin, „ob es möglich ist, ein Ergebnis zu erzeugen, das wie ein Objekt aussieht“.Es geht vielmehr darum, „wie man geometrische Konsistenz, semantische Stabilität und strukturelle Nutzbarkeit gleichzeitig in einem hochdimensionalen Raum aufrechterhalten kann“.Ein Modell mag aus einer bestimmten Perspektive plausibel erscheinen, aber bei einem Perspektivenwechsel schnell zusammenbrechen; es kann auch visuell sehr realistisch sein, aber keine bearbeitbaren und wiederverwendbaren Standard-3D-Assets exportieren. Diese Probleme schränken die Anwendung von 3D-Generierungstechnologien in realen Produktionsszenarien direkt ein.

In den letzten Jahren hat die Branche ständig mit verschiedenen technologischen Ansätzen experimentiert und zwischen ihnen hin und her gewechselt. Zum BeispielNeRF-basierte Methoden weisen eine hervorragende Leistung in der visuellen Kontinuität auf.Allerdings ist es naturgemäß eher auf Rendering als auf Modellierung ausgerichtet, was es schwierig macht, die nachgelagerten Anforderungen an Netz, Topologie und physikalische Eigenschaften zu erfüllen;Die auf Voxeln oder expliziten Netzen basierenden Generierungsmethoden weisen eine klare Struktur auf.Allerdings war die Auflösung, die Detaildarstellung und die Generalisierungsfähigkeit seit langem begrenzt;Bei den 3D-Generierungsverfahren mit Einzel- oder Mehransichten wurden bahnbrechende Effizienzgewinne erzielt.Allerdings stehen sie im Allgemeinen vor Problemen wie mangelnder Konsistenz über verschiedene Perspektiven hinweg und instabilen geometrischen Strukturen.

Die wiederholte Weiterentwicklung dieser Ansätze offenbart nicht die Unzulänglichkeit eines einzelnen Modells oder einer einzelnen Trainingsmethode, sondern vielmehr eine tiefer liegende Tatsache: Das Problem der 3D-Generierung ist im Wesentlichen eine systematische Diskrepanz zwischen Repräsentation, Generierungspfad und Trainingsziel.Wenn das Optimierungsziel eines Modells in erster Linie darin besteht, dass es „vernünftig erscheint“ und nicht „strukturell solide“ ist, wird es schwierig, mit den generierten Ergebnissen die Lücke zwischen Demonstration und Anwendung zu schließen.

In Anbetracht dessenMicrosoft Research Asia hat kürzlich TRELLIS.2 veröffentlicht, das nicht nur 3D-Objekte mit vielfältigen Materialien wie Metall, Kunststoff, Glas, Holz und Wasserwellen erzeugen kann, sondern auch die innere Geometrie der Objekte vollständig konstruieren kann.Im Gegensatz zu herkömmlichen feldbasierten 3D-Generierungsverfahren schlägt TRELLIS.2 eine innovative, feldfreie Repräsentation vor – die spärliche Voxelstruktur O-Voxel. Diese Repräsentationsmethode ermöglicht die Generierung hochauflösender 3D-Objekte mit beliebigen topologischen Strukturen und vielfältigen Materialeigenschaften und reduziert den Aufwand für Entwickler in der Vorverarbeitungsphase erheblich.

Gleichzeitig erreicht TRELLIS.2 auch eine 16-fache Speicherkomprimierung, wodurch große generative Modelle mit 4 Milliarden Parametern das Training und die Inferenz effizient durchführen können.Was die tatsächliche Leistung betrifft, so dauert das Generieren eines Assets mit vollständiger Textur in der Auflösung 512³ nur etwa 3 Sekunden.

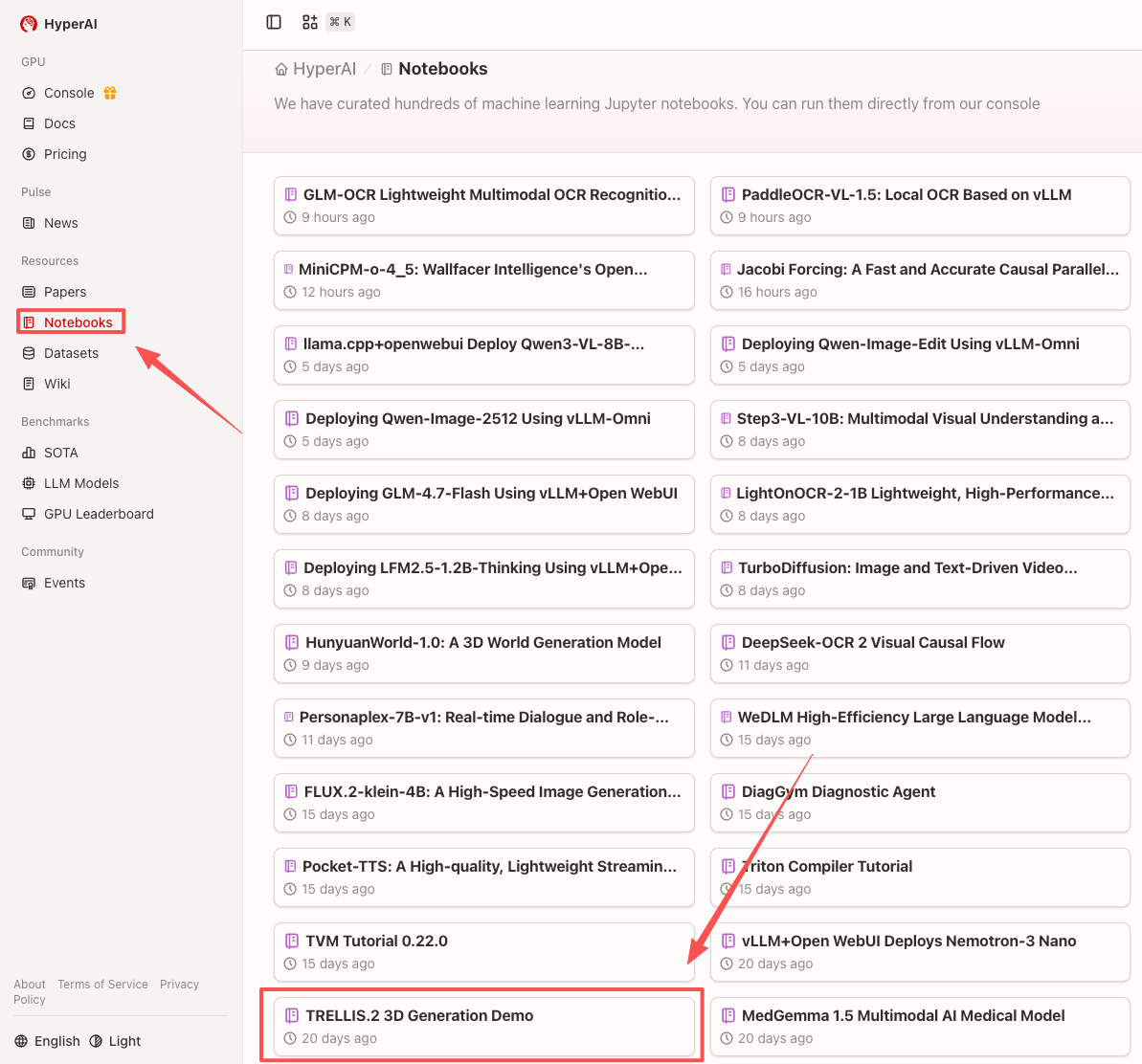

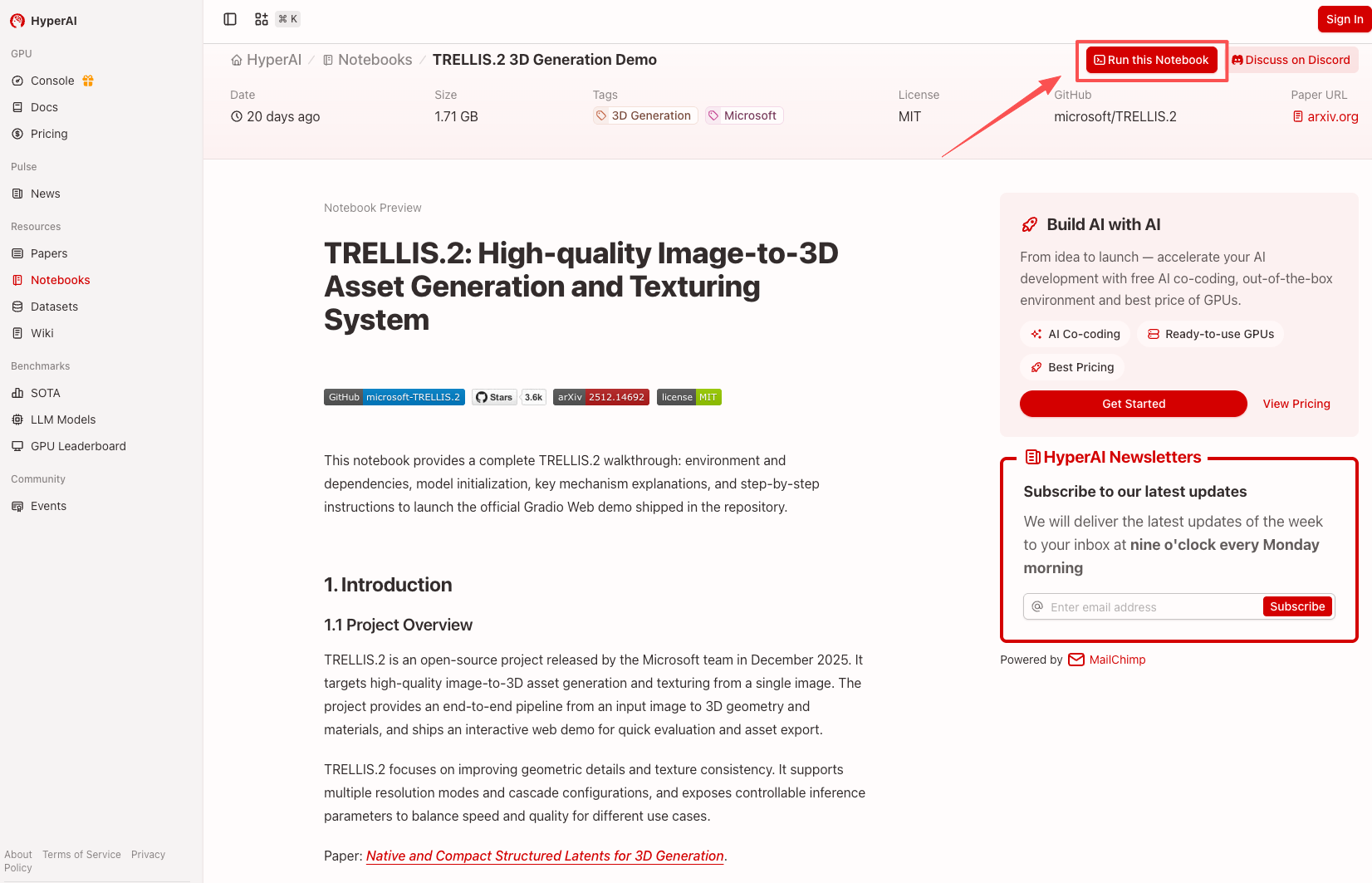

Die „TRELLIS.2 3D-Generierungsdemo“ ist jetzt auf der HyperAI-Website (hyper.ai) im Bereich „Tutorials“ verfügbar. Erleben Sie die effiziente Generierung von 3D-Modellen!

Online ausführen:https://go.hyper.ai/1nofM

Effektdemonstration:

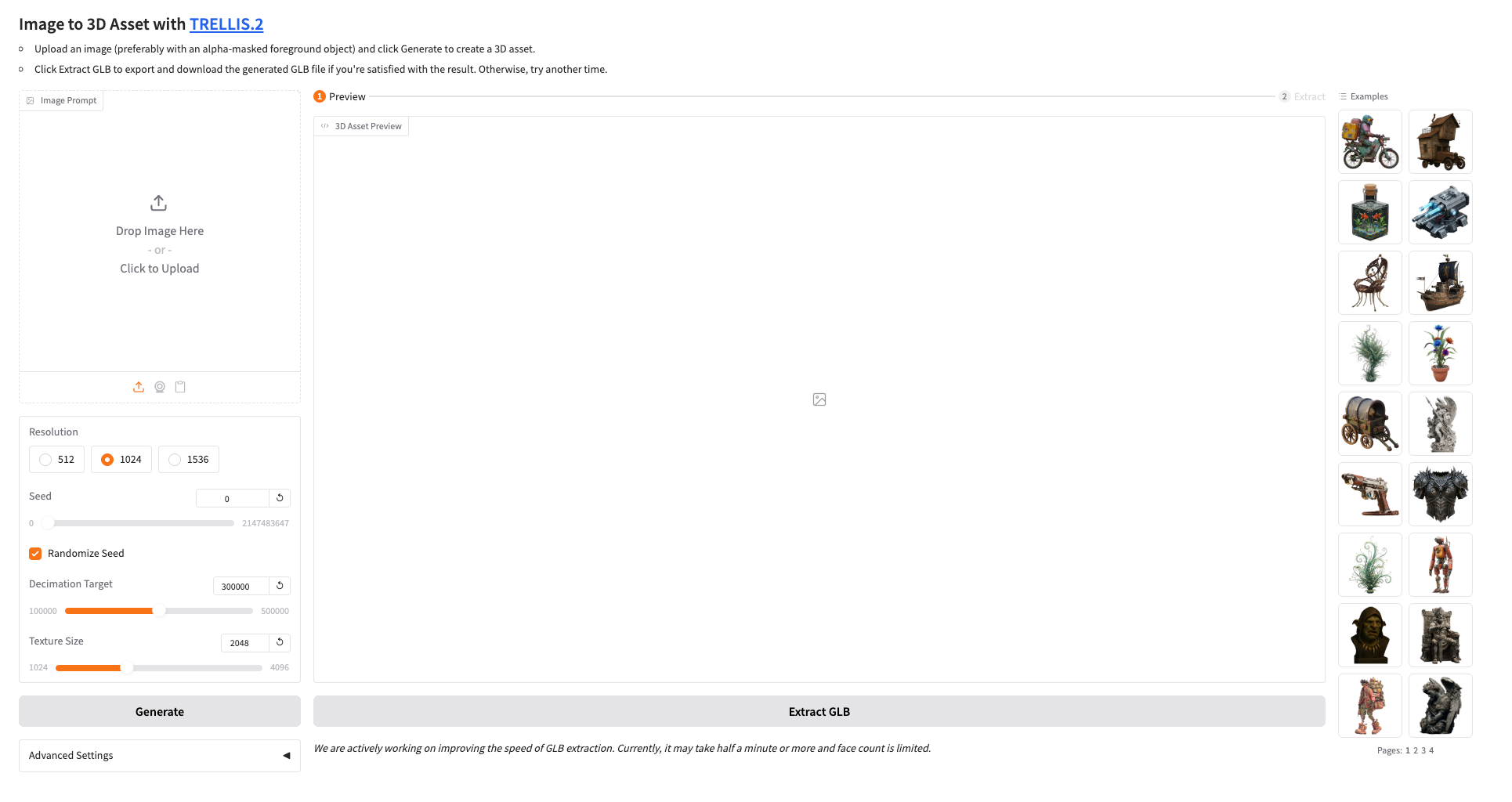

Demolauf

1. Nachdem Sie die Startseite von hyper.ai aufgerufen haben, wählen Sie „TRELLIS.2 3D Demo Generation“ oder gehen Sie zur Seite „Tutorials“, um es auszuwählen. Klicken Sie nach der Weiterleitung auf „Dieses Tutorial online ausführen“.

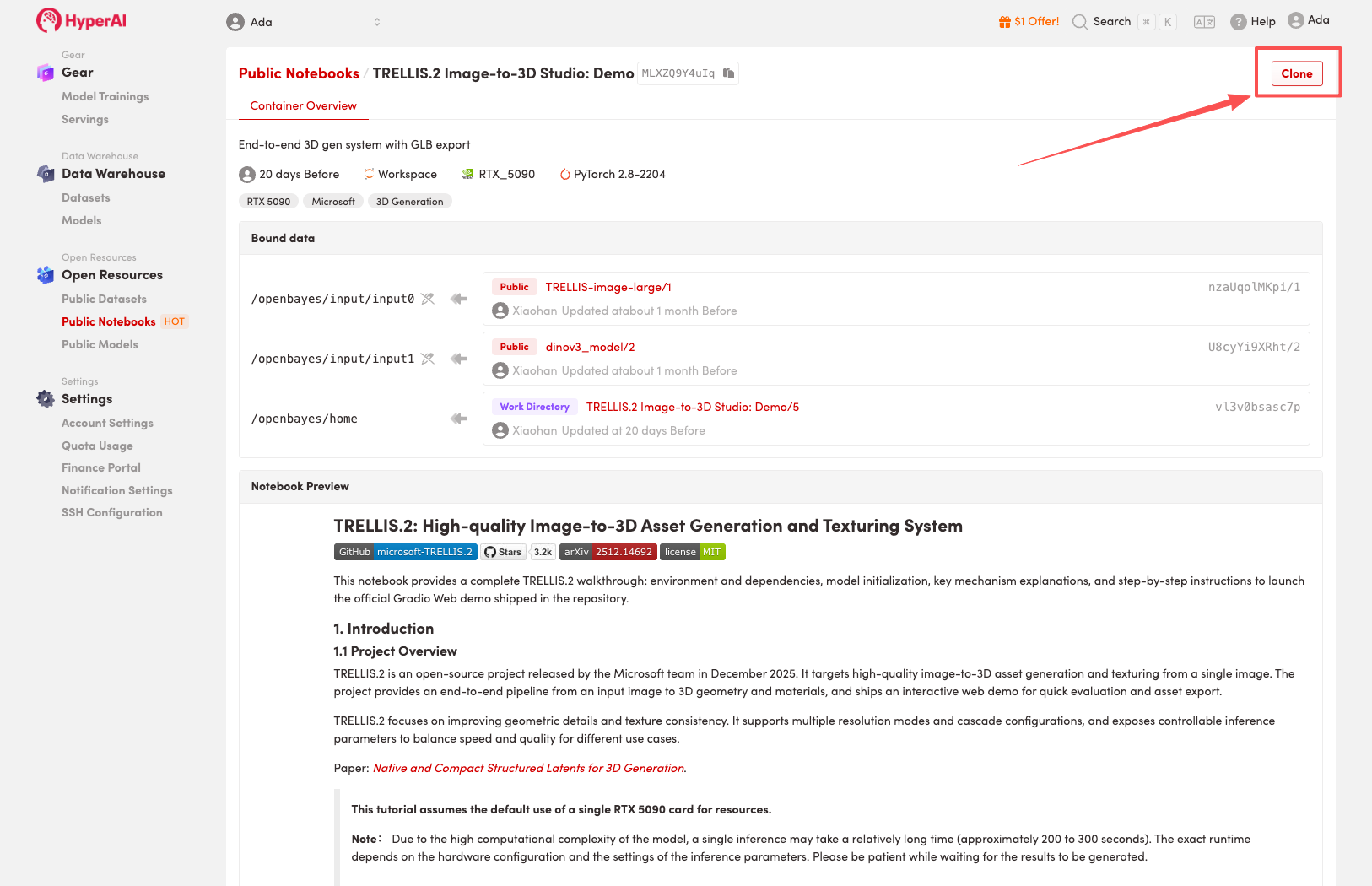

2. Klicken Sie nach dem Seitensprung oben rechts auf „Klonen“, um das Tutorial in Ihren eigenen Container zu klonen.

Hinweis: Sie können die Sprache oben rechts auf der Seite ändern. Derzeit sind Chinesisch und Englisch verfügbar. Dieses Tutorial zeigt die Schritte auf Englisch.

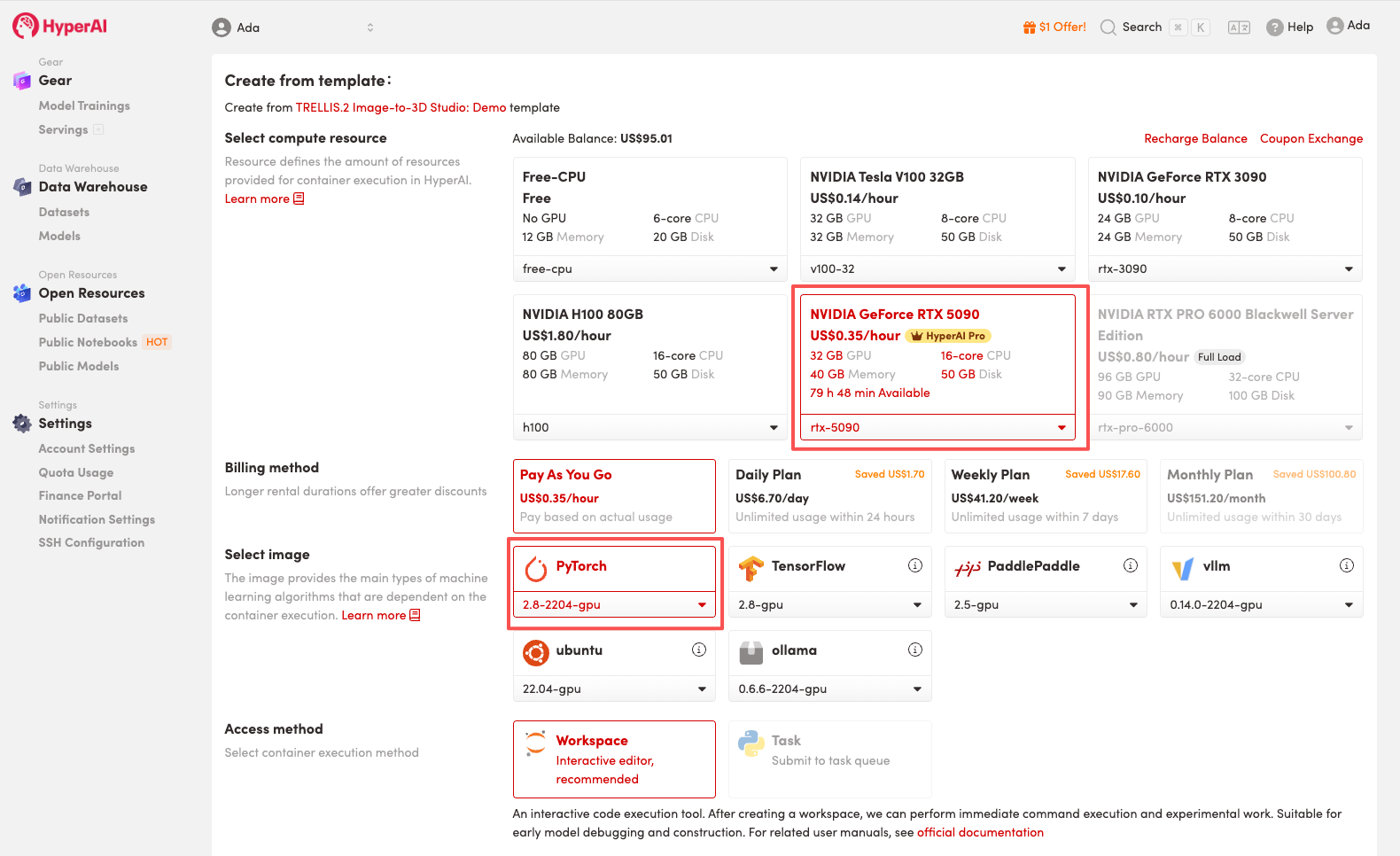

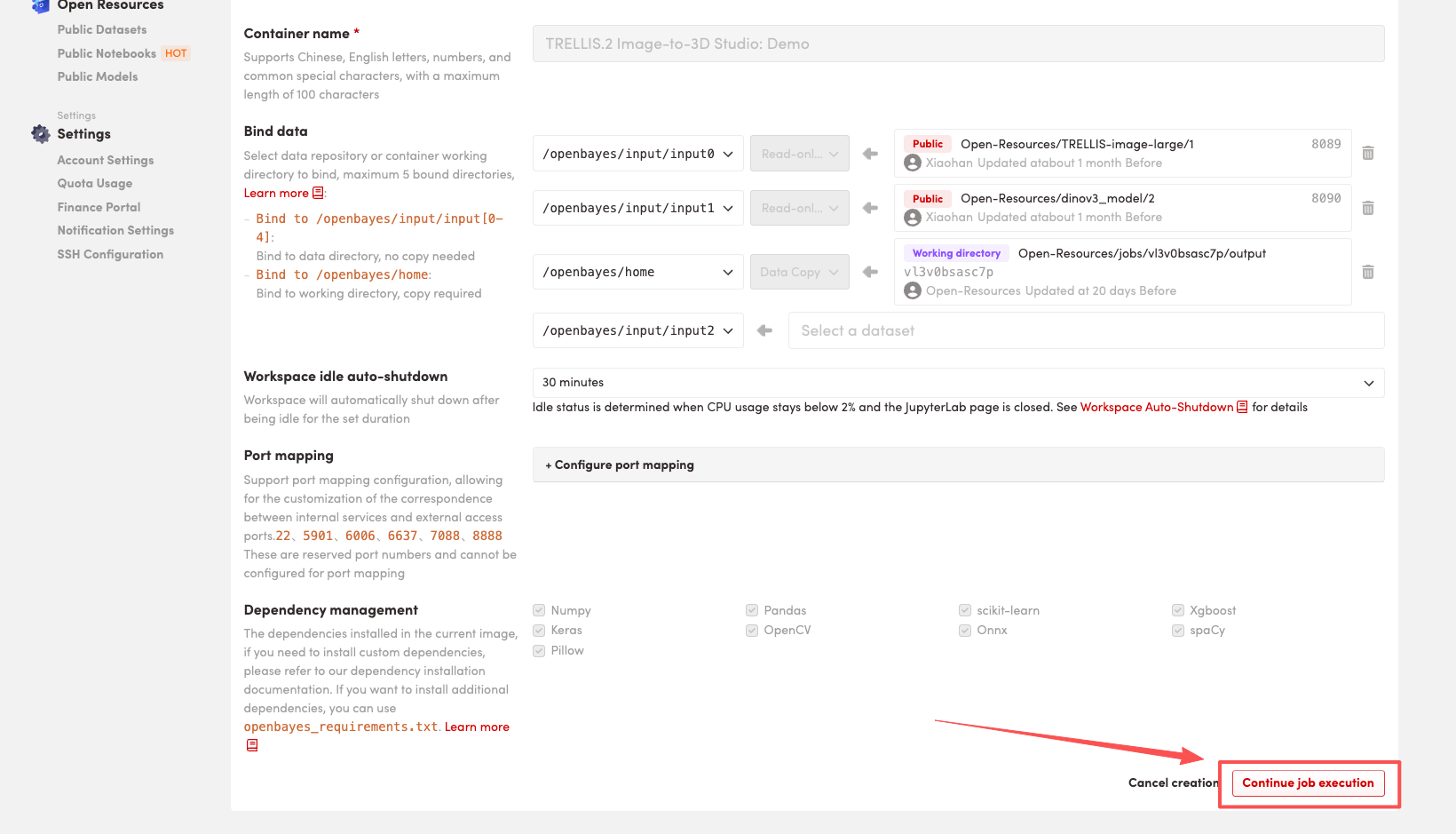

3. Wählen Sie die Images „NVIDIA RTX 5090“ und „PyTorch“ aus und wählen Sie je nach Bedarf „Pay As You Go“ oder „Tagesplan/Wochenplan/Monatsplan“. Klicken Sie anschließend auf „Auftragsausführung fortsetzen“.

HyperAI bietet Neukunden Registrierungsvorteile.Für nur $1 erhalten Sie 20 Stunden Rechenleistung einer RTX 5090 (ursprünglicher Preis $7).Die Ressource ist dauerhaft gültig.

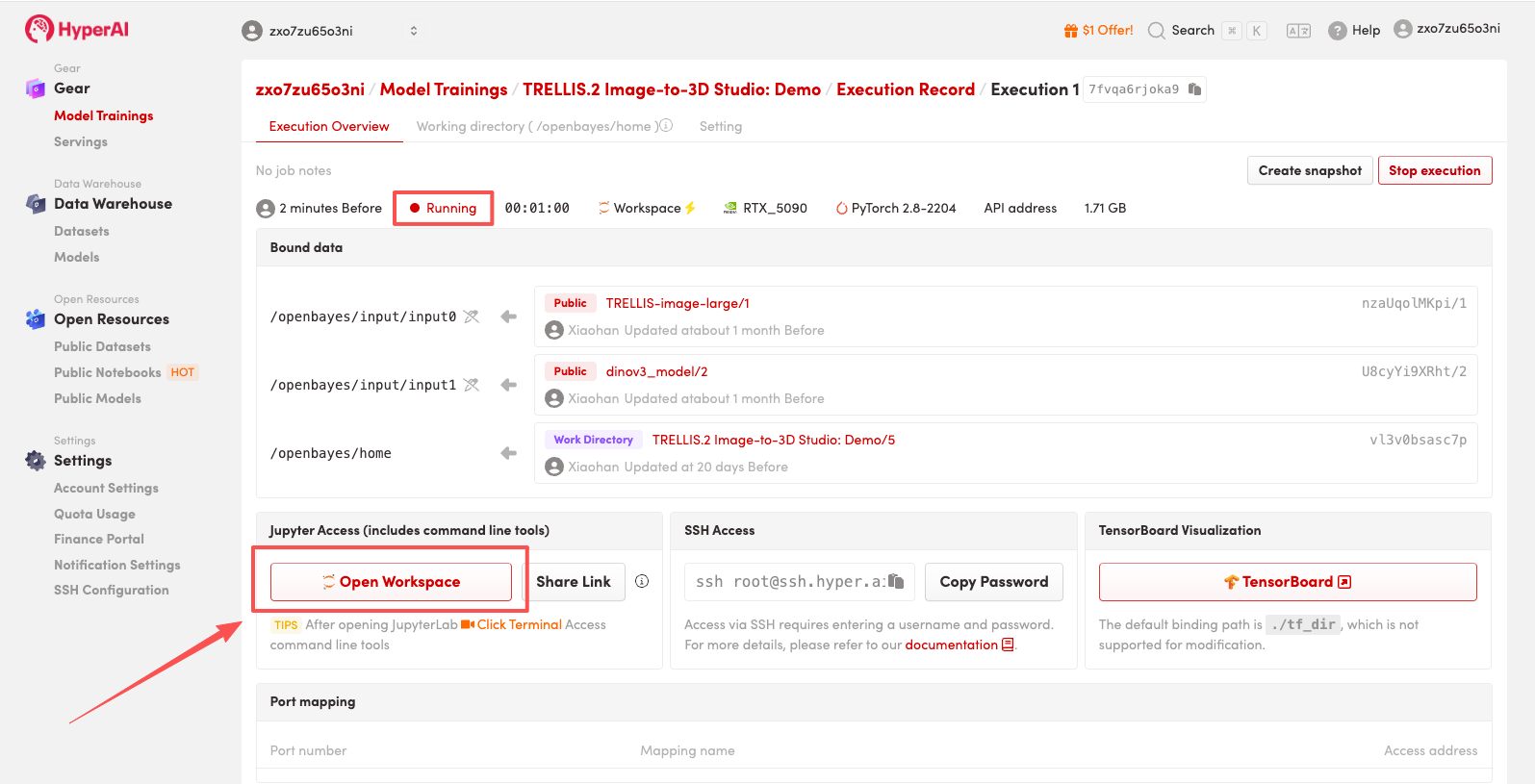

4. Warten Sie, bis die Ressourcen zugewiesen wurden. Sobald sich der Status auf „Wird ausgeführt“ ändert, klicken Sie auf „Arbeitsbereich öffnen“, um den Jupyter-Arbeitsbereich zu betreten.

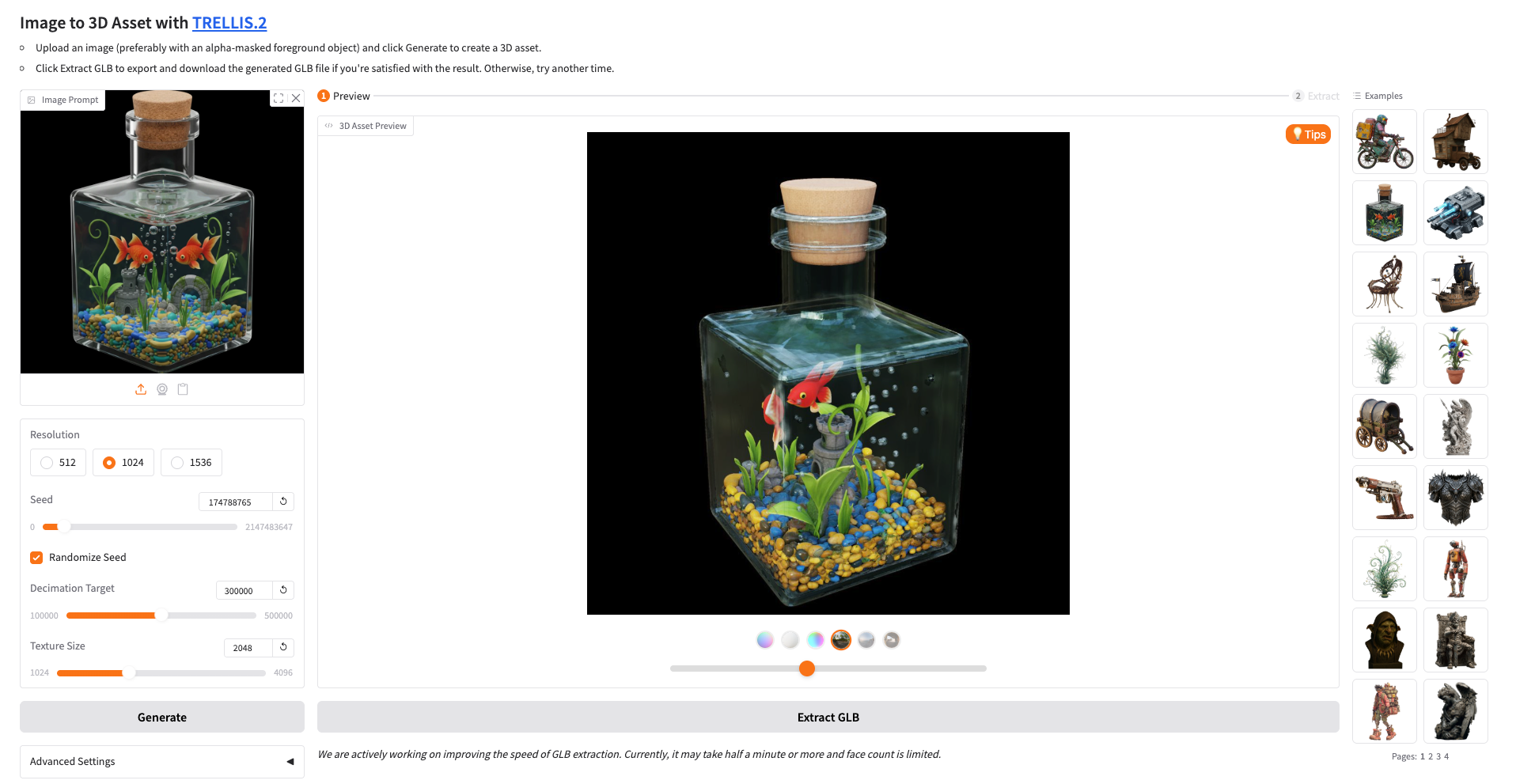

Effektdemonstration

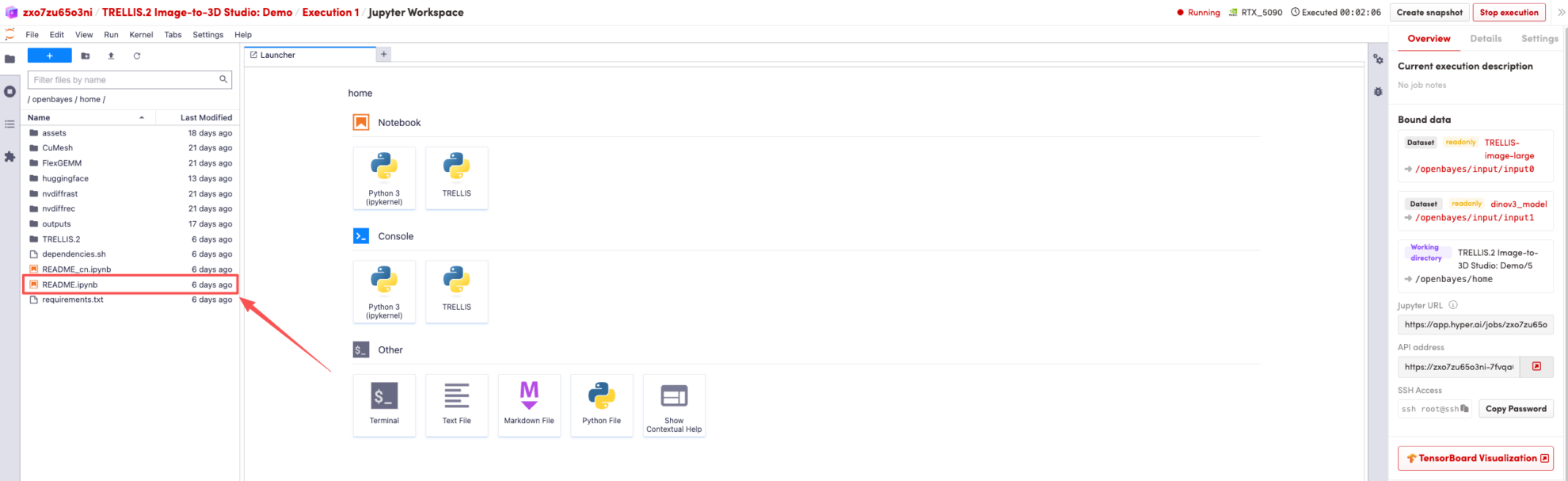

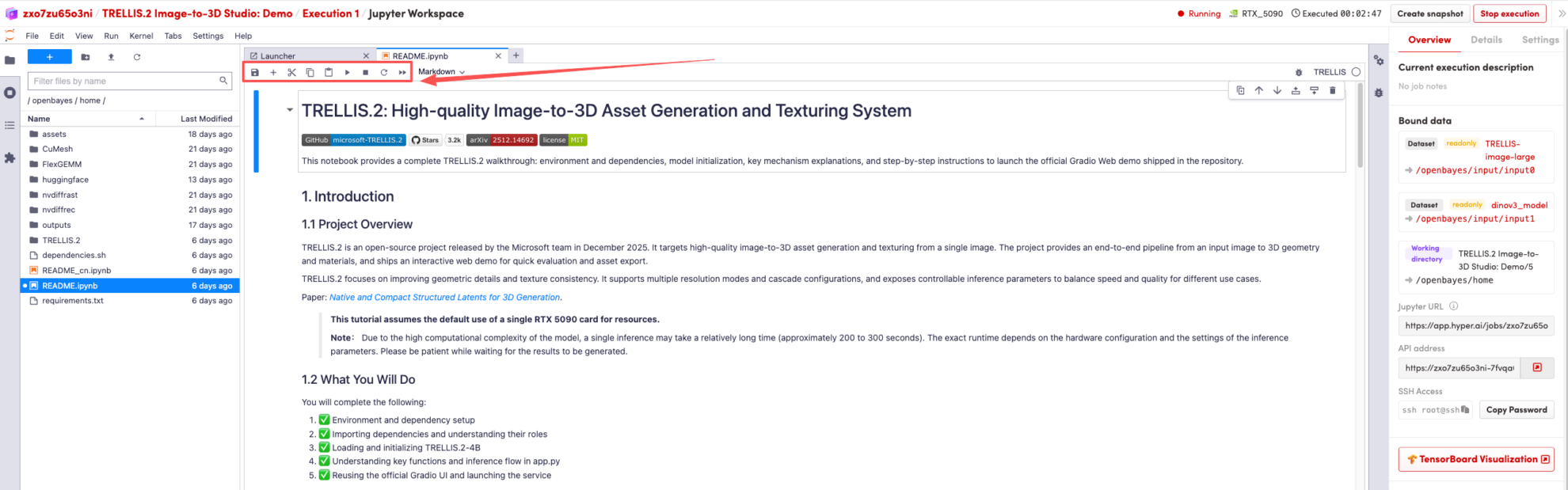

Nachdem die Seite weitergeleitet wurde, klicken Sie links auf die README-Seite und anschließend oben auf Ausführen.

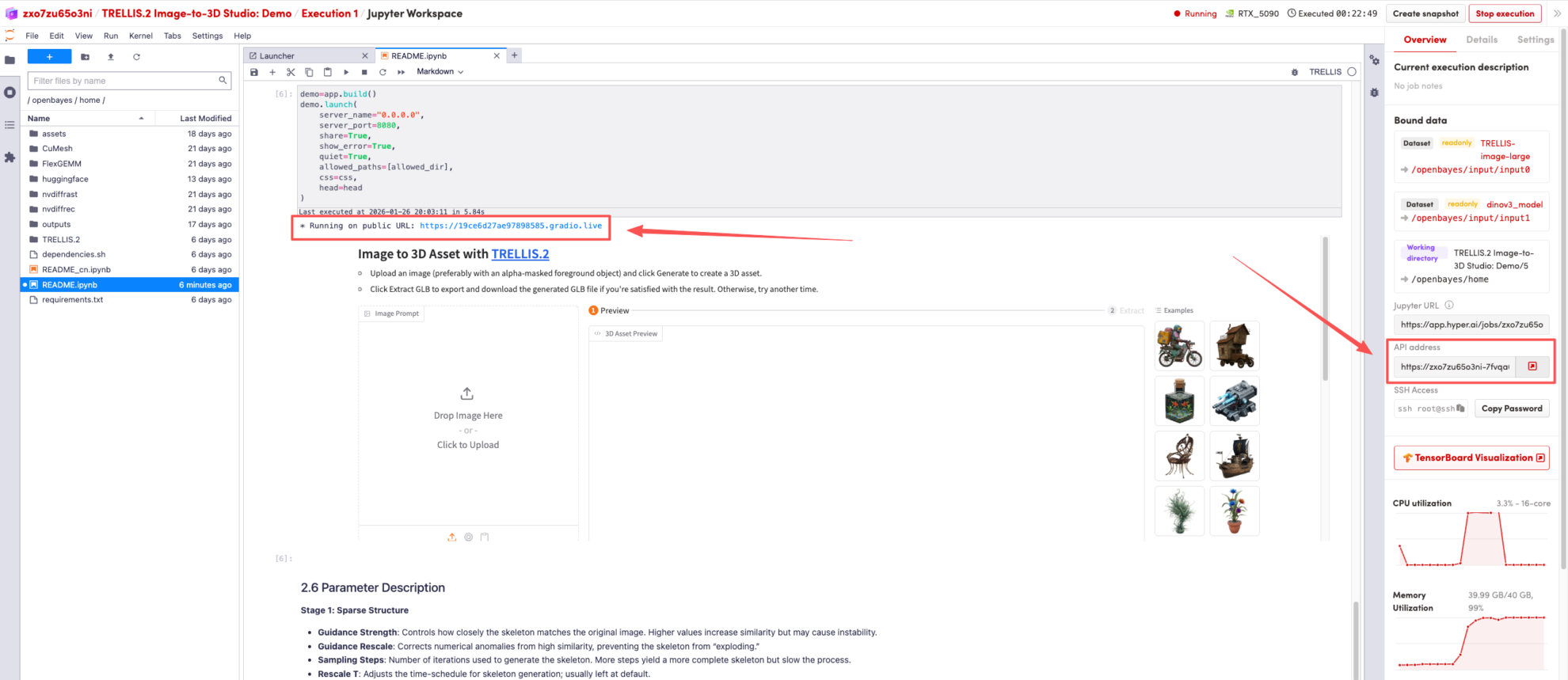

Sobald der Vorgang abgeschlossen ist, klicken Sie auf die API-Adresse rechts, um zur Demoseite zu gelangen.

Das Obige ist das diesmal von HyperAI empfohlene Tutorial. Jeder ist herzlich eingeladen, vorbeizukommen und es auszuprobieren!

Link zum Tutorial:https://go.hyper.ai/1nofM