Command Palette

Search for a command to run...

Die Taktile Revolution Der Verkörperten Intelligenz Der Zukunft! TactEdge-Sensoren Verleihen Robotern Eine Feine Taktile Wahrnehmung, Die Die Erkennung Von Stofffehlern Und Eine Geschickte Betriebssteuerung ermöglicht.

In unserer Vorstellung sollte ein perfekter Roboter über das gleiche Seh-, Tast-, Hör-, Geruchs- und Geschmacksvermögen wie der Mensch verfügen.

Das Wahrnehmen und Verstehen der physischen Welt durch die oben genannten „fünf Sinne“ und die Nutzung eines leistungsstarken KI-Gehirns, um präzise auf die Umgebung zu reagieren, ist der Kern des Baus intelligenter Roboter, und auch der Technologieriese Tesla stimmt dem zu.

Ihr humanoider Roboter der zweiten Generation, Optimus, verfügt beispielsweise über eine verbesserte taktile Wahrnehmung und kann geschickt ein Ei mit zwei Fingern greifen.Diese genaue Wahrnehmung von Objekten und die präzise Kraftkontrolle sind den taktilen Sensoren an den Spitzen seiner zehn Finger zu verdanken.

Menschen nutzen ihren Tastsinn, um beispielsweise die Größe und Form von Objekten einzuschätzen, und das tun Roboter auch. Mithilfe taktiler Sensoren können Roboter das Interaktionsverhalten von Objekten in der realen Welt besser verstehen und taktile Informationen wie Textur, Temperatur, Härte und Verformung der Zielobjekte erfassen, um eine genaue Positionierung der Objekte zu erreichen und verschiedene Aufgaben (wie etwa Greifen) auszuführen.Kurz gesagt: Die Bedienung ist untrennbar mit dem Tastsinn verbunden und die taktile Sensorik bietet ein großes Anwendungspotenzial im Bereich der Robotik.

Am 13. Dezember wurde das dritte Online-Sharing-Event „Newcomers on the Frontier“, das von der Embodied Haptic Community veranstaltet und von HyperAI mitorganisiert wurde, offiziell eröffnet.Zu der Veranstaltung wurde Zhang Shixin, ein Doktorand im vierten Jahr an der China University of Geosciences (Peking), eingeladen, einen Vortrag zum Thema „Design, Vorbereitung und Roboterwahrnehmung von TactEdge-Sensoren“ zu halten.Wir gaben eine detaillierte Einführung in den Iterationsverlauf, die Hardwareoptimierung, die visuelle und taktile Simulation und die Roboterwahrnehmungsvorgänge des visuellen und taktilen Sensors TactEdge.

HyperAI hat die ausführlichen Ausführungen von Dr. Zhang Shixin zusammengestellt und zusammengefasst, ohne die ursprüngliche Absicht zu verletzen.

Upgrade-Verlauf für den visuellen Tastsensor TactEdge

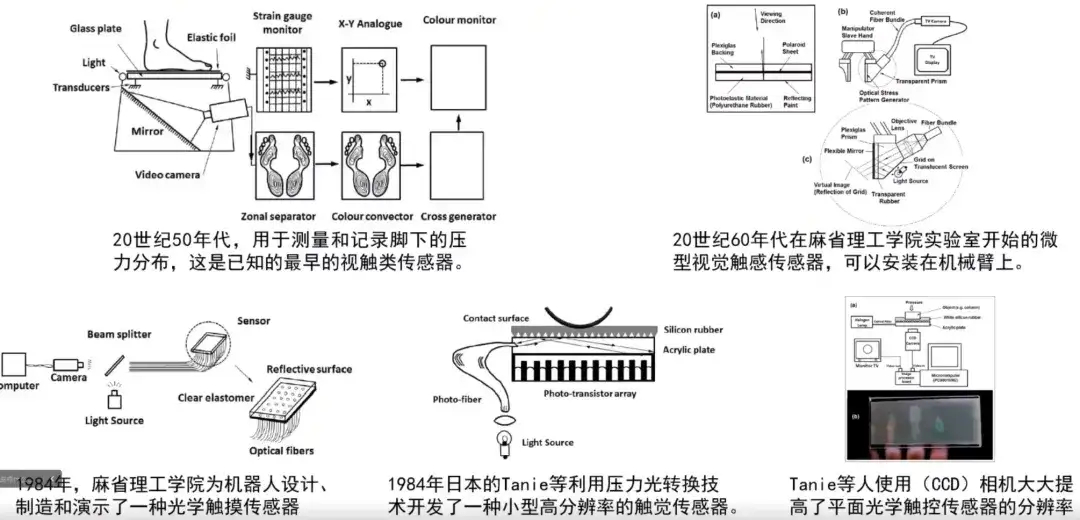

Früher wurden elektronische Tastsensoren zum Zählen taktiler Informationen verwendet. Allerdings sind die Sensoreinheiten dieser Art von Tastsensoren spärlich verteilt und die Auflösung beim Abbilden taktiler Informationen ist relativ niedrig. Um die Qualität der taktilen Informationen zu verbessern, führten die Forscher einen neuen Sensormechanismus ein:Taktile Sensoren, die auf visuellen Erkennungsprinzipien basieren (auch als visuelle taktile Sensoren bekannt), verwenden Bilder als Erfassungsmedium und verbessern die taktile Qualität, insbesondere im Hinblick auf die räumliche Auflösung, erheblich.Die Entwicklung visueller und taktiler Sensoren wird in der folgenden Abbildung dargestellt:

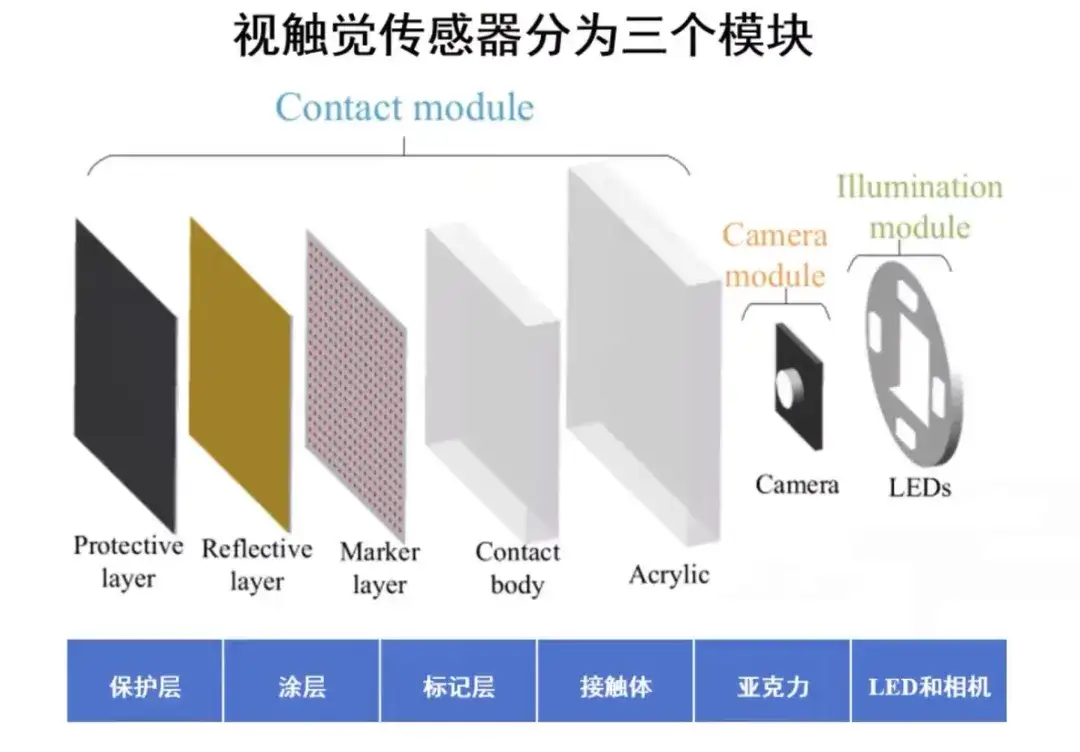

Nach dem 20. Jahrhundert schlugen Forscher eine neue visuell-taktile Erfassungsmethode vor. Ihre Arbeit lässt sich in drei Hauptmodule zusammenfassen: Kontaktmodul, Kameramodul und Beleuchtungsmodul, die zur Standardisierung des visuell-taktilen Sensormechanismus verwendet werden.Darunter umfasst das Kontaktmodul eine Markierungsschicht, eine Beschichtung und eine Funktionsschicht zur Übertragung taktiler Informationen (z. B. eine temperaturempfindliche Schicht). Anschließend werden die taktilen Informationen durch inverse Bildgebungstechnologie visualisiert.

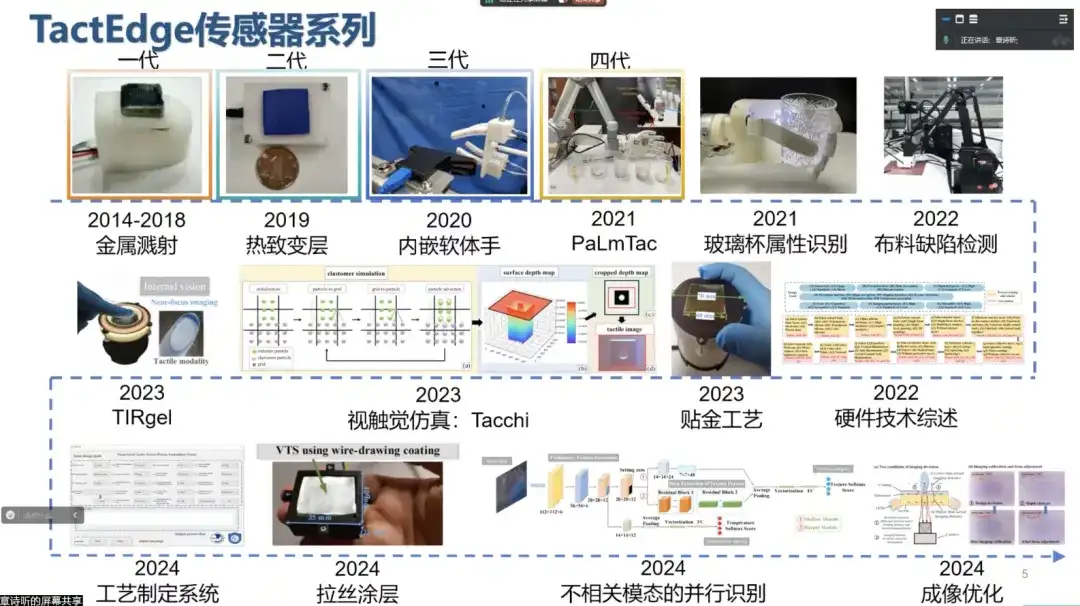

Unser Team begann 2014 mit der Erforschung visuell-taktiler Sensoren, mittlerweile sind es 10 Jahre. Während dieser ZeitWir haben mehrere Generationen von Sensortechnologie erforscht und entwickelt und nennen sie eine hochmoderne taktile Technologie: TactEdge.Wie in der folgenden Abbildung dargestellt:

* Die erste Generation von TactEdge verwendet ein Beschichtungsdesign.Durch Metallzerstäubungs- und Maskierungsprozesse wurden eine dünne Metallbeschichtung und ein Standardmarkierungsarray hergestellt, die über dualmodale taktile Sensorfunktionen verfügen.

* Die zweite Generation von TactEdge fügt dem Beschichtungs- oder Markierungsmaterial thermotrope Materialien hinzu.Da jedes Material eine andere Temperaturschwelle hat, können Sie bei steigender oder fallender Temperatur den Farbwechsel von hell nach dunkel erkennen und so eine lokale Temperaturwahrnehmung erlangen.

* Die dritte Generation TactEdge ist eine Softwarehand mit integrierten visuellen und taktilen Sensoren.Die Beugehaltung wird mithilfe von Embedded Vision verfolgt, um den Verformungszustand des inneren Hohlraums zu überwachen.

* TactEdge der vierten Generation:Die Beschichtungsschicht wird für die Texturabbildung verwendet, die Markierungsschicht implementiert die Kraftverfolgung und die thermosensitive Schicht ist für die Temperaturerfassung verantwortlich. Um eine multimodale Wahrnehmung zu erreichen, haben wir diese Funktionsebenen kombiniert. TactEdge der vierten Generation kombiniert die thermotrope Schicht mit der Beschichtung, um eine multimodale Wahrnehmung von Textur und Temperatur zu erreichen.

* Die fünfte Generation von TactEdge bietet große Verbesserungen bei der Optimierung der radialen Abmessungen des Sensors und der Robustheit der taktilen Bildgebung.Darüber hinaus wird die Markierungsschicht mit der Beschichtung kombiniert, um eine dualmodale Wahrnehmung von Kraft und Textur zu erreichen.

* Die sechste Generation TactEdge verwendet einen neuen visuellen taktilen Sensormechanismus TIRgel,Durch die Implementierung einer Totalreflexion im Inneren des Elastomers werden photometrische Informationen zur Darstellung der taktilen Informationen erstellt und eine fokussierbare Kamera wird eingeführt, um die interne und externe Sicht umzuwandeln.

Hardwareoptimierung

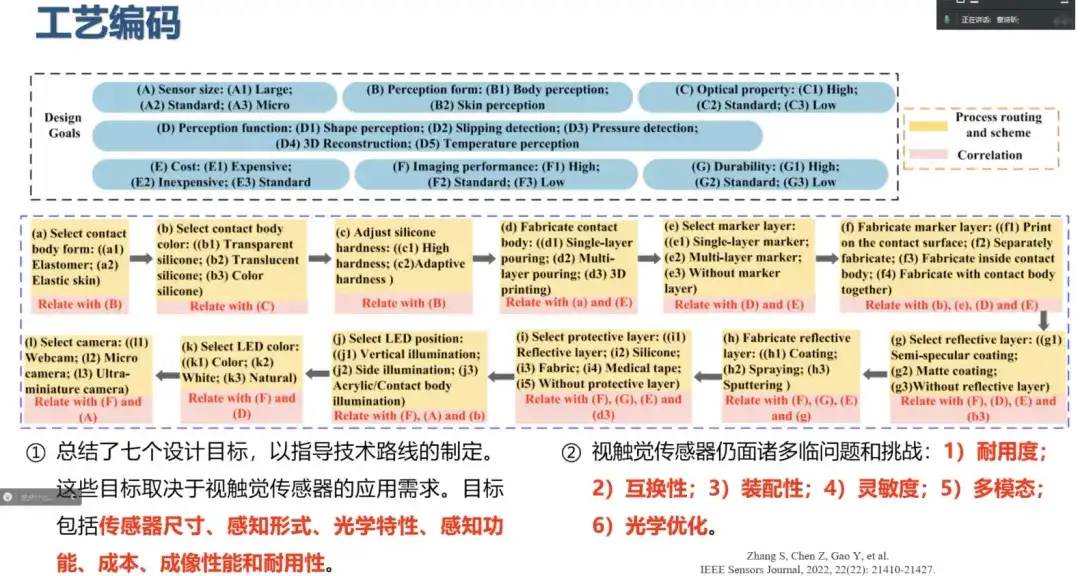

Im Sensorentwicklungsprozess der letzten Jahre haben wir uns auf die Hardwareoptimierung konzentriert.Beispielsweise haben wir im Jahr 2021 die aktuellen gängigen Sensorherstellungstechnologien (wie Elastomerherstellungsprozess, Markierungsschichtherstellungsprozess, Beschichtungsherstellungsprozess und Trägerstrukturform) zusammengefasst, auf dieser Grundlage eine Prozesscodierung durchgeführt und 7 Designziele zusammengefasst, wie in der folgenden Abbildung dargestellt. Diese Ziele hängen von den Anwendungsanforderungen visueller und taktiler Sensoren ab.

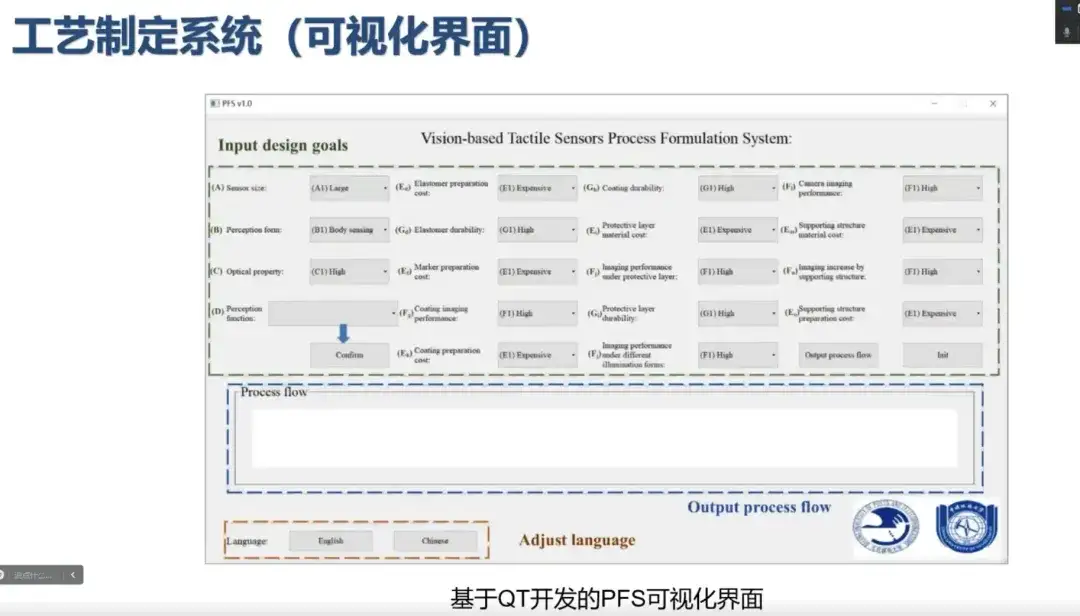

Basierend auf diesen Sensoranforderungen haben wir verschiedene Einschränkungen hinzugefügt und die intrinsische Beziehung und den logischen Rahmen zwischen den Prozess- und Designzielen erstellt. Darauf aufbauend haben wir das gesamte Prozessformulierungssystem aufgebaut und eine visuelle Schnittstelle für das Prozessformulierungssystem auf Basis von QT entwickelt. Wie in der folgenden Abbildung dargestellt, können Benutzer Designziele in das grüne Feld eingeben. Der Systemhintergrund wird mit einem angemessenen Vorbereitungsprozess auf Grundlage dieser Ziele übereinstimmen, um das Team bei der Entwicklung von Sensoren zu unterstützen. Hier werden jedoch nur empfohlene Hilfestellungen zum Vorbereitungsprozess gegeben. Einige Anforderungen in speziellen Szenarien erfordern noch eine spezifische lokale Optimierung des Prozesses.

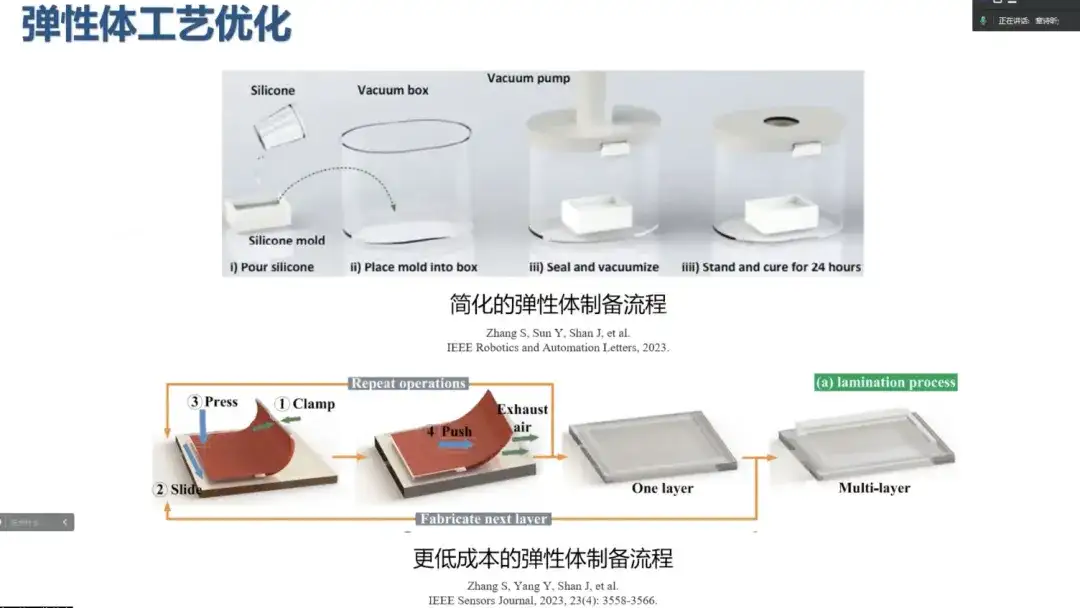

Elastomer-Prozessoptimierung: vereinfachter Herstellungsprozess + geringere Kosten

Beispielsweise umfasst der üblicherweise verwendete Herstellungsprozess von Elastomeren das Formen, Mischen von Silikon, Gießen, Vakuumieren, Erhitzen und Entformen, gefolgt von verschiedenen Beschichtungsprozessen. Dies ist ein gängiges Verfahren zur Elastomerherstellung. In der Massenproduktion kann aufgrund der langen Heizzeit ein selbsthärtendes Spezialsilikonmaterial verwendet werden, das nach dem Aushärten und Vakuumieren kein zusätzliches Erhitzen erfordert. Um die Kosten für die Herstellung von Sensorelastomeren zu senken, schlug unser Team außerdem ein Laminierungsverfahren vor.

Beschichtungsprozessoptimierung: Verschleißfestigkeit und Duktilität

Derzeit werden die Beschichtungsvorbereitungsverfahren für Sensoren hauptsächlich in Sprühverfahren und Metallsputtern unterteilt. Metallbeschichtungen lösen sich bei häufigem Berühren vollständig ab und nutzen sich ab. Sprühbeschichtungen sind etwas verschleißfester, werden aber bei Kontakt mit scharfen Gegenständen teilweise beschädigt. Daher dürfen die Qualität der Beschichtung und die Verschleißfestigkeit nicht außer Acht gelassen werden. In der Vergangenheit lag der Schwerpunkt bei der Beschichtungsvorbereitung eher auf der mechanischen Haftung. In den letzten Jahren haben einige Leute das Konzept der chemischen Haftung vorgeschlagen, d. h., Beschichtungsmaterialien auf der Oberfläche ungehärteter Elastomere anzubringen, um vor dem Aushärten chemische Bindungen zu bilden und so die Verschleißfestigkeit und Haftung zu verbessern.

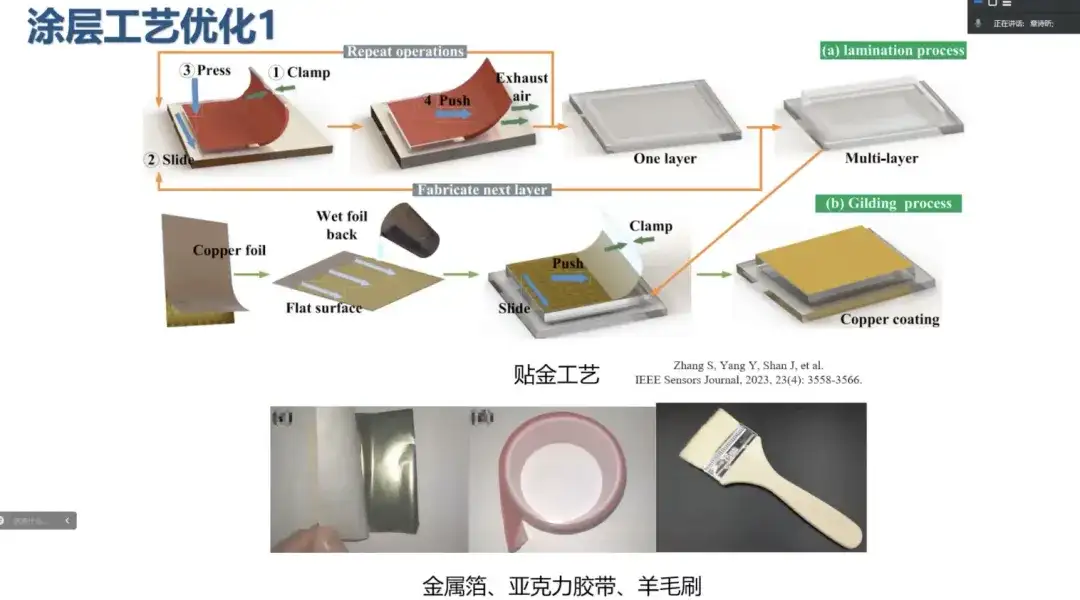

Vergoldungsprozess: Verbesserung der Verschleißfestigkeit

Als Reaktion darauf haben wir eine neue Lösung zur Beschichtungsoptimierung vorgeschlagen – ein Vergoldungsverfahren, um die Verschleißfestigkeit zu verbessern. Der Hauptprozess besteht darin, die Metallfolie auf dem Elastomer zu befestigen, um eine dünne Beschichtung zu bilden. Mit dieser Lösung wird eine doppelte Optimierung der Haftfestigkeit erreicht, d. h. das Peroxid auf der Oberfläche der Metallfolie und des Acrylbandes (Methylmethacrylat) lösen eine Kettenpolymerisationsreaktion aus, bei der eine chemische Bindung entsteht. Zudem bilden sich zwischen dem Elastomer und der Metallfolie Van-der-Waals-Kräfte aus.

Im Vergleich zu herkömmlichen Sprüh- und Metallsputternverfahren bietet die Vergoldung erhebliche Vorteile hinsichtlich der Hardwarekosten, der Vorbereitungskosten und des Zeitverlusts. Beispielsweise werden der Sprühvorgang und die aufwändige Reinigung der Spritzpistole erheblich vereinfacht, wodurch der Sensorvorbereitungszyklus verkürzt wird. Darüber hinaus verbessert das neue Verfahren nicht nur die Verschleißfestigkeit der Funktionsschicht, sondern kann bei fachgerechter Handhabung auch die Vorbereitungszeit des gesamten Kontaktmoduls auf 5-10 Minuten verkürzen. Ein weiterer wesentlicher Vorteil des Goldfolienverfahrens ist die einfache Pflege. Die Beschichtungsoberfläche wird üblicherweise mit einer Schutzschicht, beispielsweise aus Stoff oder medizinischem Klebeband, befestigt. Die Dicke dieser Schutzschichten beeinträchtigt die Tastempfindlichkeit und die Feinstrukturierung, das Goldfolienverfahren ermöglicht jedoch Nachbearbeitungen der beschädigten Beschichtung, was der Wartung förderlich ist.

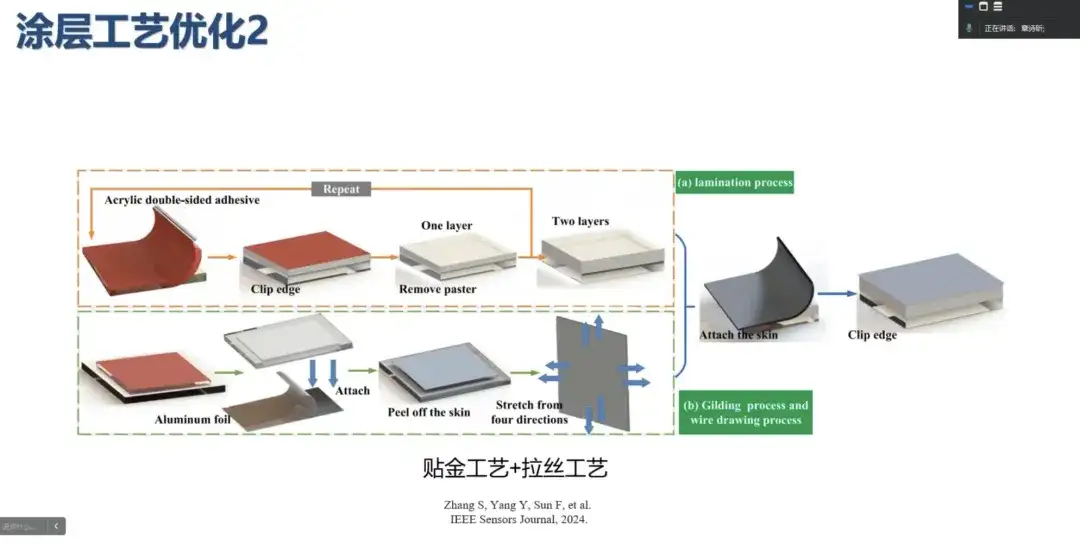

Drahtziehprozess: Verbesserung der Duktilität

Bei tatsächlichen Anwendungen stellten wir jedoch fest, dass während des Pressvorgangs leicht Risse entstehen, da die Metallfolie selbst eine durchgehende Beschichtung darstellt. Wir glauben, dass die kontinuierliche Ansammlung von Metallfolienpartikeln eine kontinuierliche Beschichtung im Makromaßstab bilden und dadurch die Duktilität der Beschichtung verbessern kann. Aus diesem Grund haben wir den Vergoldungsprozess verbessert und das Drahtziehverfahren vorgeschlagen.

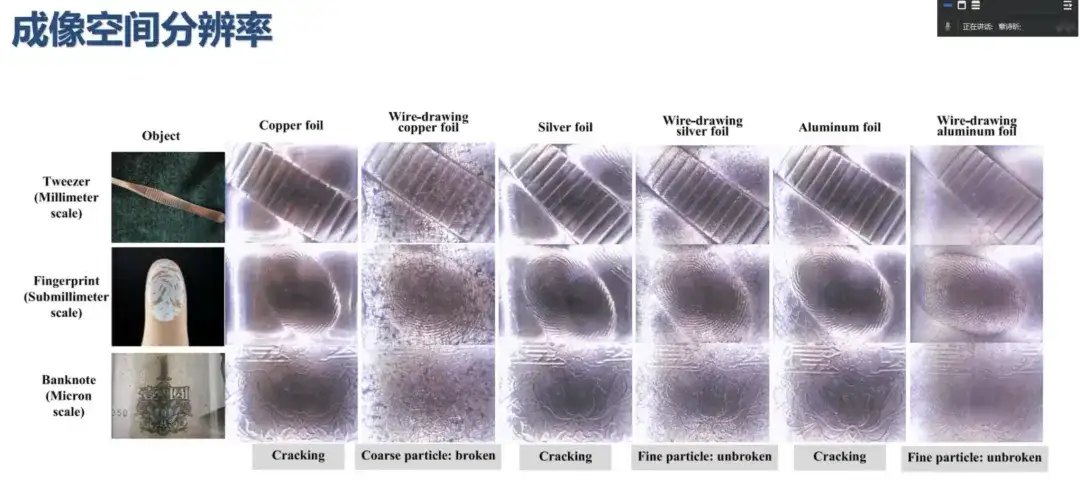

Wir spannen die Metallfolie. Da es über reichhaltige Gleitsysteme verfügt, können während des plastischen Verformungsprozesses feine Partikel entstehen. Je höher die Zugfestigkeit, desto feiner die Partikel. Verschiedene Metalle haben unterschiedliche Gleitsysteme und unterschiedliche Partikelgrößen, daher haben wir für unsere Experimente Kupferfolie, Aluminiumfolie und Silberfolie verwendet. Die Mikrostruktur unter dem Elektronenmikroskop zeigt:

* Kupferfolie: Da das Gleitsystem nicht so reichhaltig ist wie das von Aluminiumfolie und Silberfolie, sind die Partikel während des Dehnungsprozesses relativ grob, was die Kontinuität der taktilen Abbildung beeinträchtigt.

* Aluminiumfolie und Silberfolie: Die Partikel sind nach dem Strecken sehr fein und weisen eine Partikelverteilung im Nanomaßstab auf, was die räumliche Auflösung der taktilen Bildgebung erheblich verbessert.

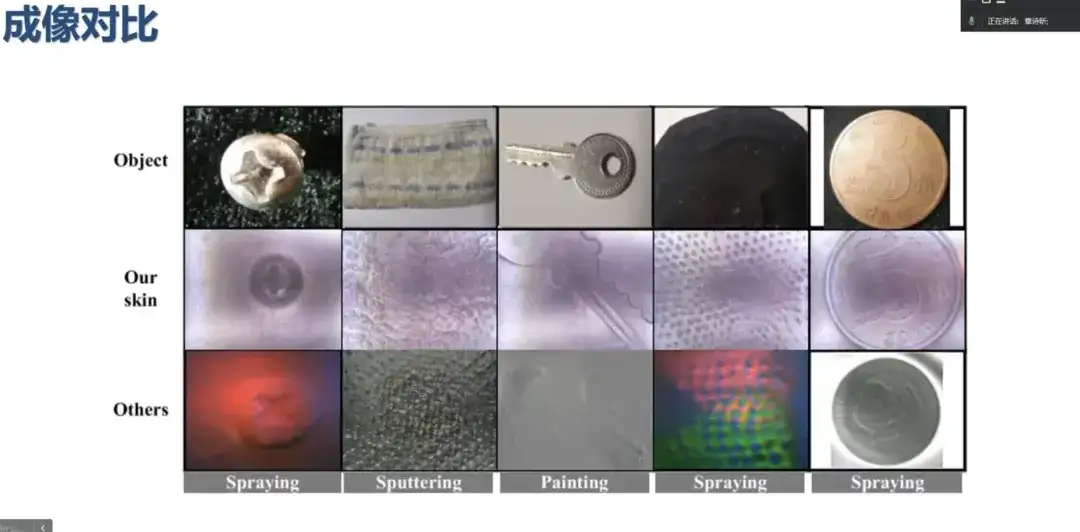

Wir haben die Streichbeschichtung mit dem derzeit gängigen Sprühverfahren und dem Metallsputtern verglichen. Wie in der folgenden Abbildung gezeigt, ist unser Verfahren hinsichtlich des Texture-Mapping-Effekts das beste.

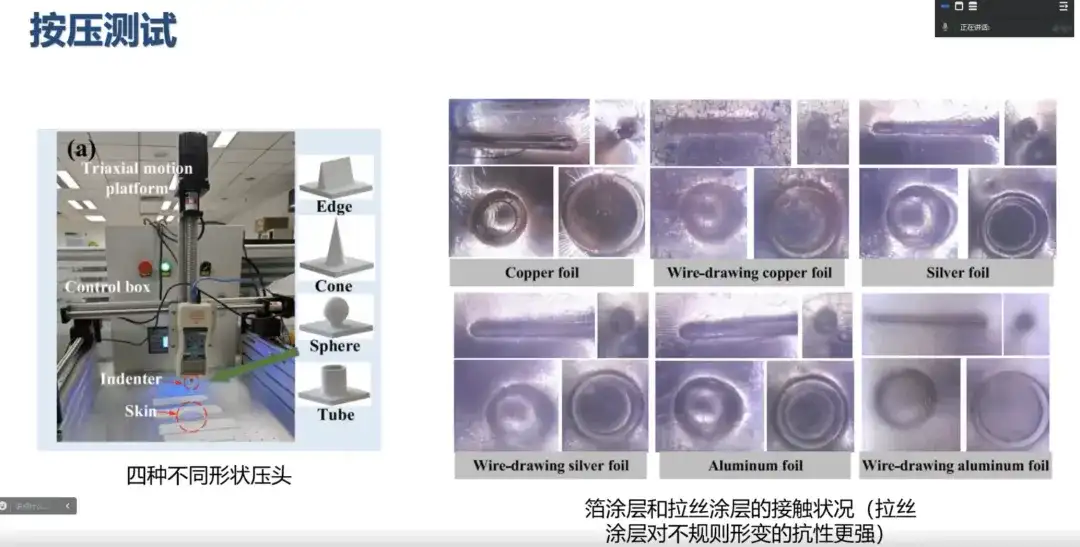

Wie in der Abbildung unten gezeigt, brechen dünne Beschichtungen beim Pressen leicht, und die Geschwindigkeit und das Ausmaß des Bruchs sind größer, wenn mit einem scharfen Gegenstand auf sie gedrückt wird. Die gekörnte, gebürstete Beschichtung zeigte jedoch eine stärkere Widerstandsfähigkeit gegenüber unregelmäßiger Verformung, was darauf hindeutet, dass der Körnungsprozess die Duktilität der dünnen Beschichtung verbessert.

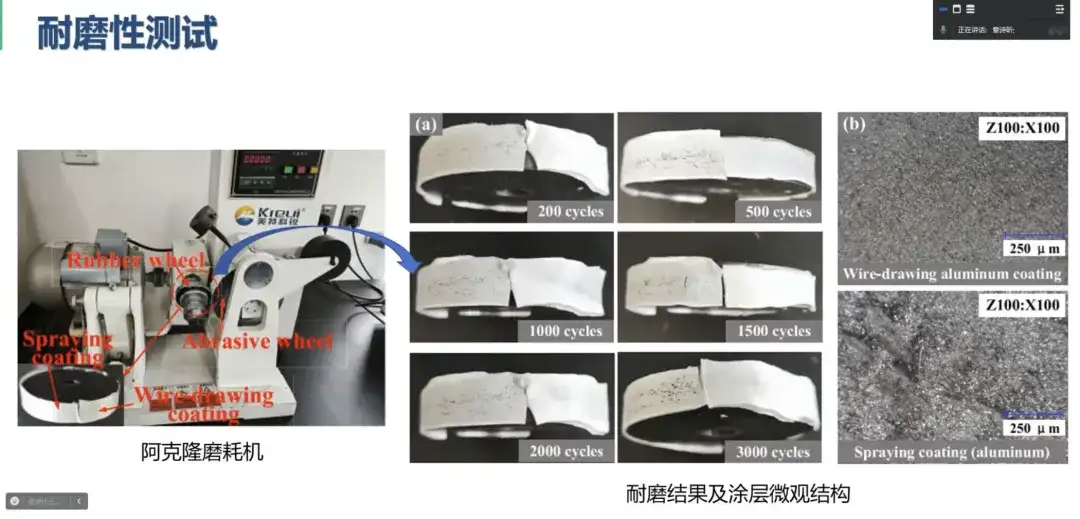

Um die Verschleißfestigkeit der Beschichtung nach der doppelten Haftverstärkung zu bewerten, wurden Verschleißfestigkeitstests durchgeführt und die Veränderungen der Beschichtungsmikrostruktur aufgezeichnet. Die Ergebnisse zeigen, dass die Partikel der gebürsteten Beschichtung während des Verschleißprozesses feiner werden und der Gesamtverschleiß gleichmäßig ist. Die aufgesprühte Beschichtung hingegen haftet schwächer und löst sich beim Verschleiß teilweise ab, sammelt sich in der Umgebung an und bildet Schlaglöcher.

Optimierung der visuell-taktilen Bildgebung: Verbesserung der Robustheit der visuell-taktilen Bildgebung

Darüber hinaus erhöht die verbesserte Beschichtung auch in gewissem Maße die Robustheit der visuell-taktilen Abbildung.

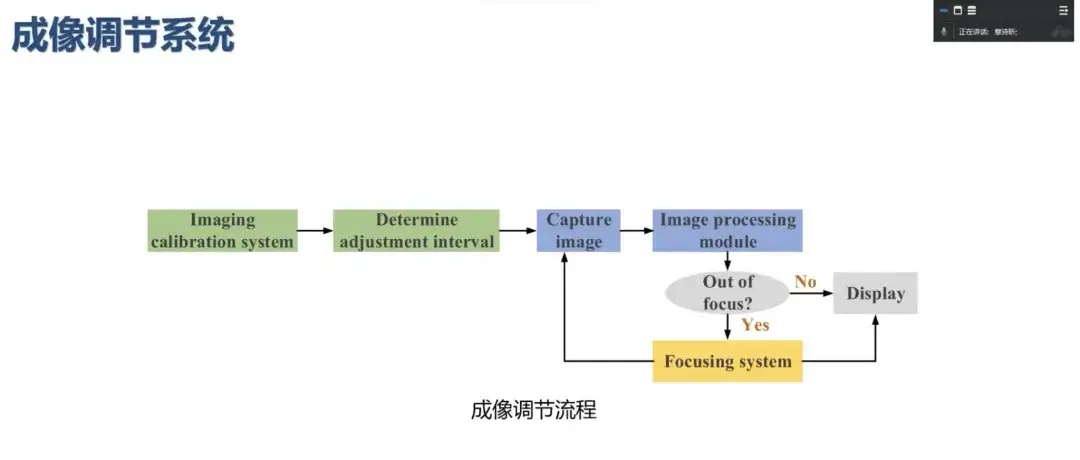

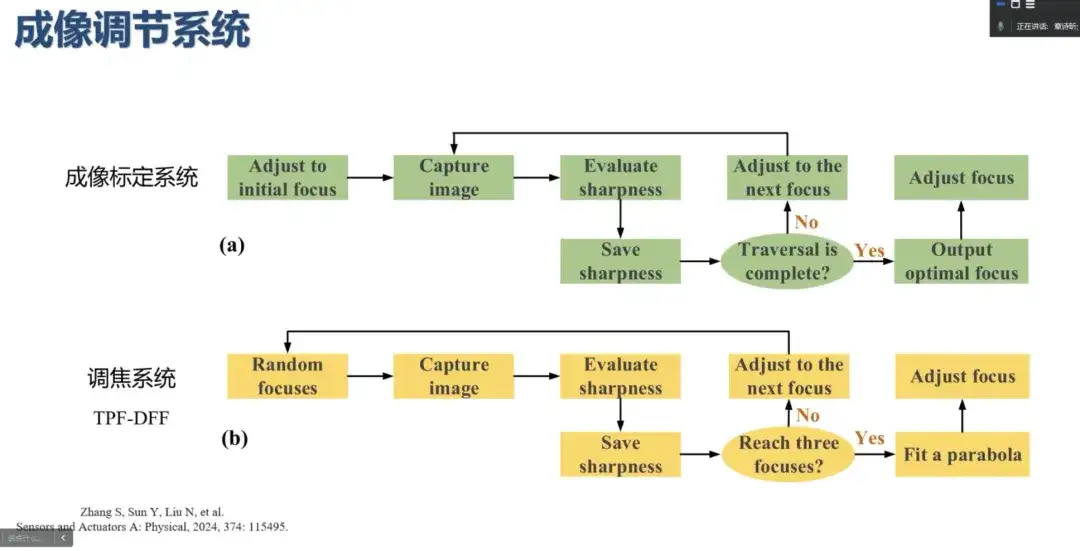

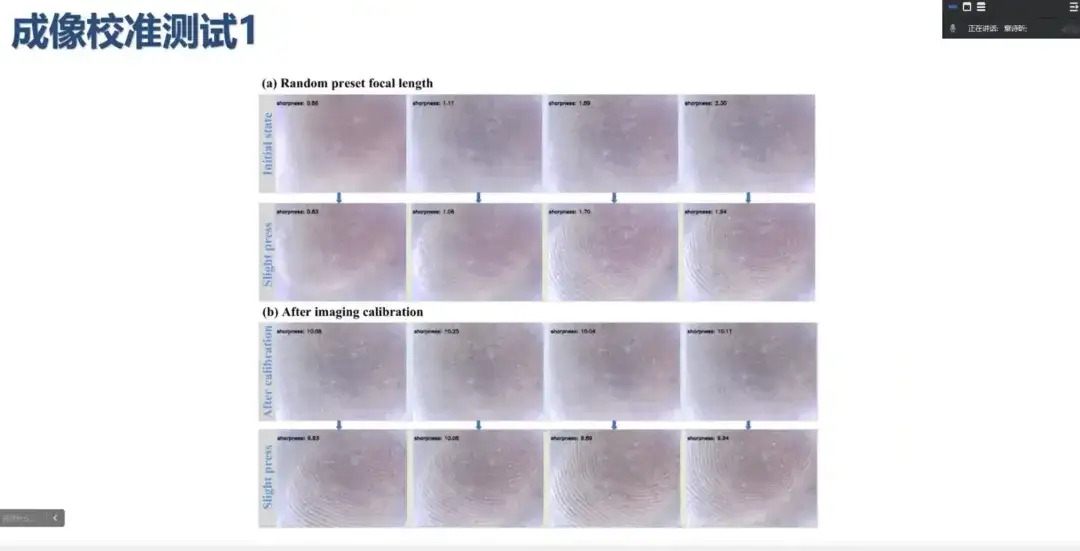

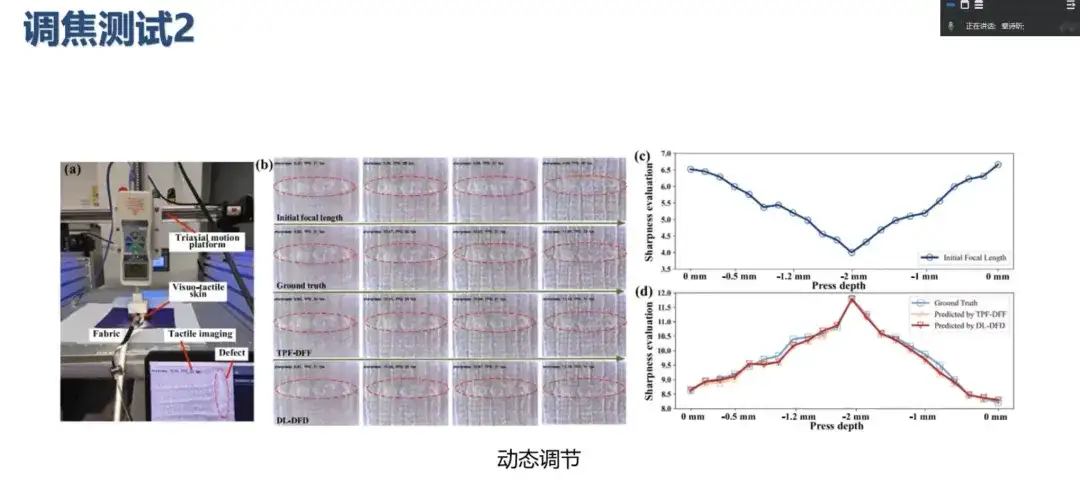

Bei der visuell-taktilen Erfassung ist die Abbildungsdistanz sehr gering und es handelt sich häufig um Makroabbildungen. In diesem Fall ändert sich mit jedem Drücken der Abbildungsabstand, was zu einer Abbildungsabweichung führt. Darüber hinaus kann es zu Abweichungen zwischen der bei der Entwicklung des Sensors voreingestellten Abbildungsdistanz und der tatsächlichen Abbildungsdistanz kommen, was zu einer unzureichenden Bildschärfe führt. Um diese Probleme zu lösen, haben wir ein Bildanpassungssystem entwickelt, das ein Kalibrierungsmodul und ein Fokussierungsmodul umfasst.

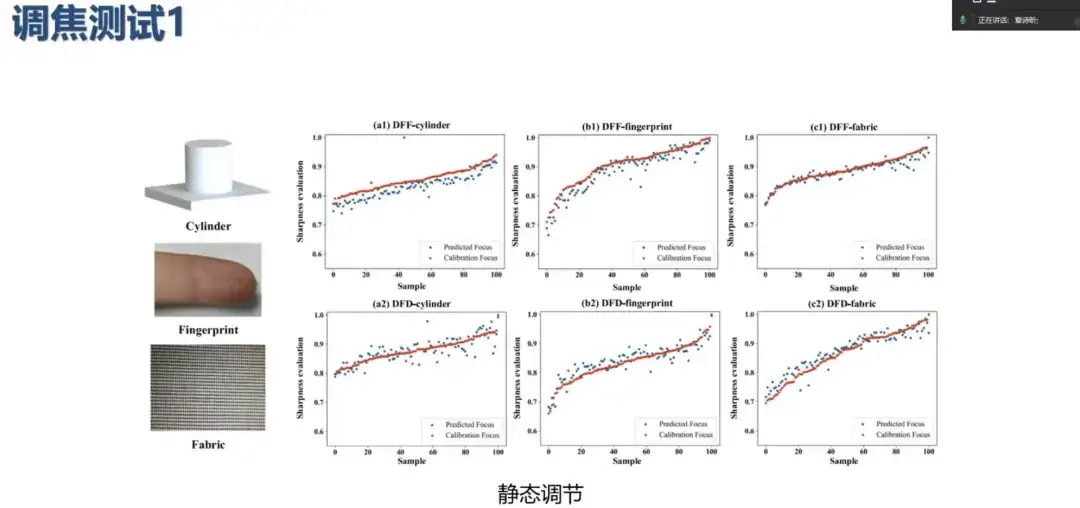

Im Bildanpassungssystem verwendet das Bildkalibrierungsmodul eine globale Suchstrategie, um das Anpassungsintervall zu verlängern und die Fokussierentfernung zu verkürzen, während gleichzeitig sinnvolle Anpassungswerte als Beschriftungen ermittelt werden. Das Fokussierungsmodul verwendet zwei Methoden: die Fokustiefenmethode basierend auf Dreipunktanpassung und die Defokustiefenmethode basierend auf Deep Learning. Ersteres weist eine hohe Genauigkeit, aber eine geringe Geschwindigkeit auf, während Letzteres schneller ist, aber eine etwas geringere Genauigkeit aufweist. Es handelt sich um eine End-to-End-Anpassungsmethode.

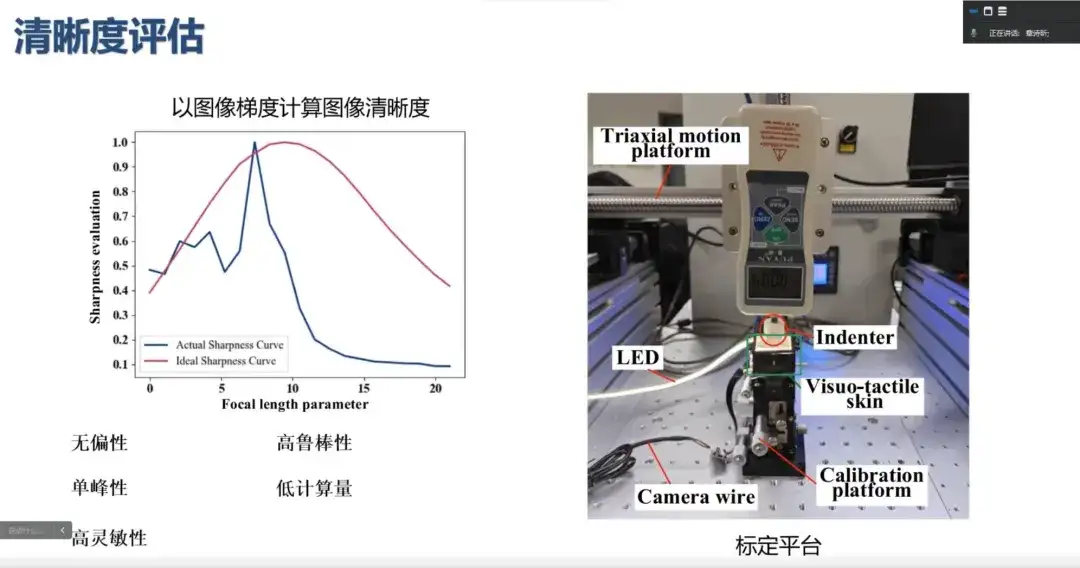

Da die visuell-taktile Wahrnehmung auf Bildmechanismen beruht, verwenden wir hauptsächlich die Bildschärfe als Kriterium für die Fokussierung. Wie in der Abbildung unten gezeigt, sollte die ideale Bewertungskurve für die Bildschärfe unvoreingenommen und unimodal sein (rote Kurve). In tatsächlichen Fokussierungsumgebungen ist das Licht jedoch häufig ungleichmäßig (blaue Kurve) und weist einen lokalen Fokussierungspeak auf.

Durch die Verwendung visuell-taktiler Sensoren in einer geschlossenen Umgebung können externe Störfaktoren reduziert und die Bildgebungskurve näher an den Idealzustand gebracht werden. Zu diesem Zweck haben wir eine Kalibrierungsplattform gebaut und die Abbildungskurve der visuell-taktilen Erfassung getestet, um die für diesen Sensor geeignete Methode zur Berechnung des Bildgradienten zu ermitteln. Die Ergebnisse zeigen, dass die Tenengrad-Gradientenberechnungsmethode für den Sensor besser geeignet ist und die Anpassungskurve die fünf vorgeschlagenen Schlüsseleigenschaften aufweist, insbesondere die Unvoreingenommenheit und Unimodalität, die für die Bewertung der nachfolgenden Fokussierung entscheidend sind.

Im Allgemeinen legen wir zufällig einen anfänglichen Fokuswert fest und kalibrieren nach einem leichten Druck die Bildgebung, um ein klares Bild zu erhalten, und die Bildgebung liegt immer noch in einem akzeptablen Bereich.

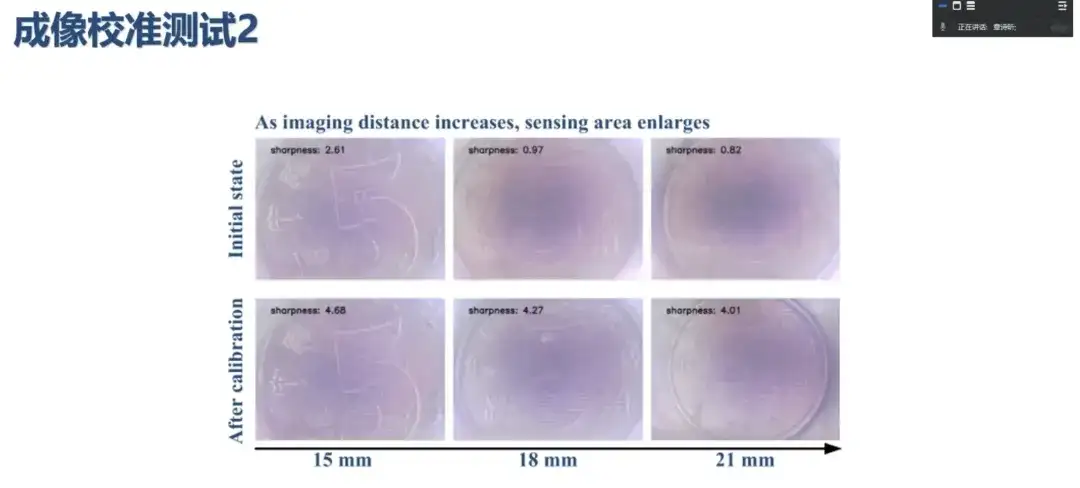

Darüber hinaus muss das sich dynamisch ändernde Sensorfeld während der Sensordesignphase berücksichtigt werden, sodass die Abbildungsdistanz je nach Szenario erweitert oder verringert werden kann. Mit zunehmender Abbildungsdistanz erweitert sich auch das Erfassungsfeld. Durch die Verwendung einer dynamischen Bildfokussierung wird das Gesamtdesign vereinfacht. Wie in der folgenden Abbildung dargestellt:

Um die Fokussierungsgenauigkeit zu testen, haben wir Experimente mit drei Objekten mit unterschiedlich dichter Textur durchgeführt. Die Ergebnisse zeigten, dass beide Kalibrierungsmethoden nahe an den erwarteten Ergebnissen lagen, mit einer Bildanpassungsgenauigkeit von mehr als 99,5% und Echtzeitfokussierung bei dynamischen Erkennungsaufgaben.

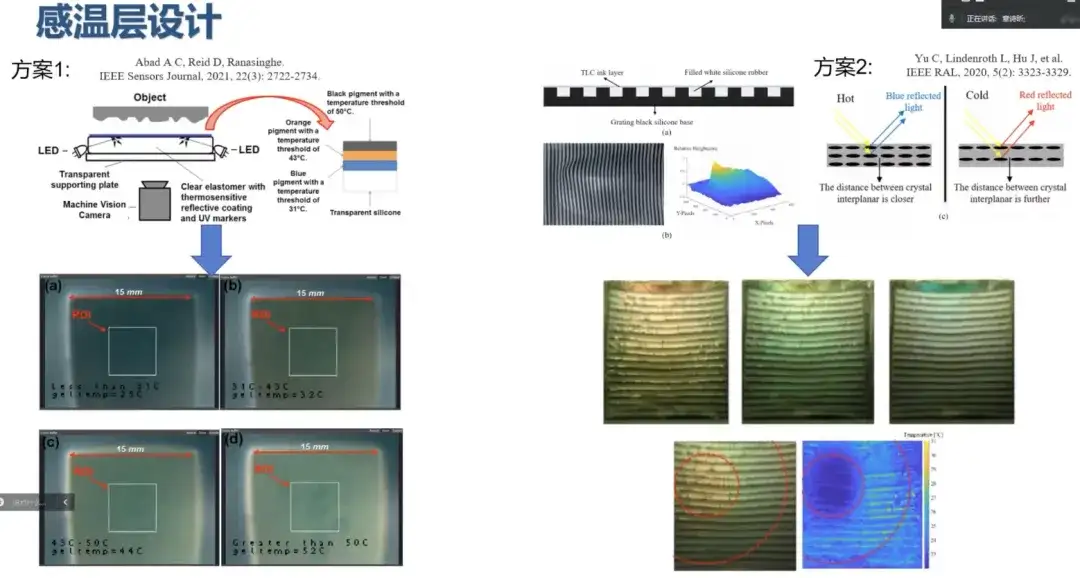

Optimierung der Temperatursensorschicht: Verteiltes modales Design

Was die optimale Gestaltung der Temperatursensorschicht betrifft, gibt es derzeit relativ wenig Forschung. Die gängige Methode besteht darin, der Funktionsschicht des Sensors temperaturempfindliche Materialien hinzuzufügen, beispielsweise thermotropes Pulver und thermotropes Öl. Den vorläufigen Bildergebnissen zufolge werden die Farbinformationen dieser Methode mit den Texturinformationen verschmolzen. Es besteht jedoch kein direkter Zusammenhang zwischen Temperatur und Textur. Es ist nicht sinnvoll, diese nicht zusammenhängenden Merkmale im Bild ohne ordnungsgemäße Merkmalsextraktion oder -trennung zu verschmelzen und sie dann zur Erkennung in das Modell einzugeben.

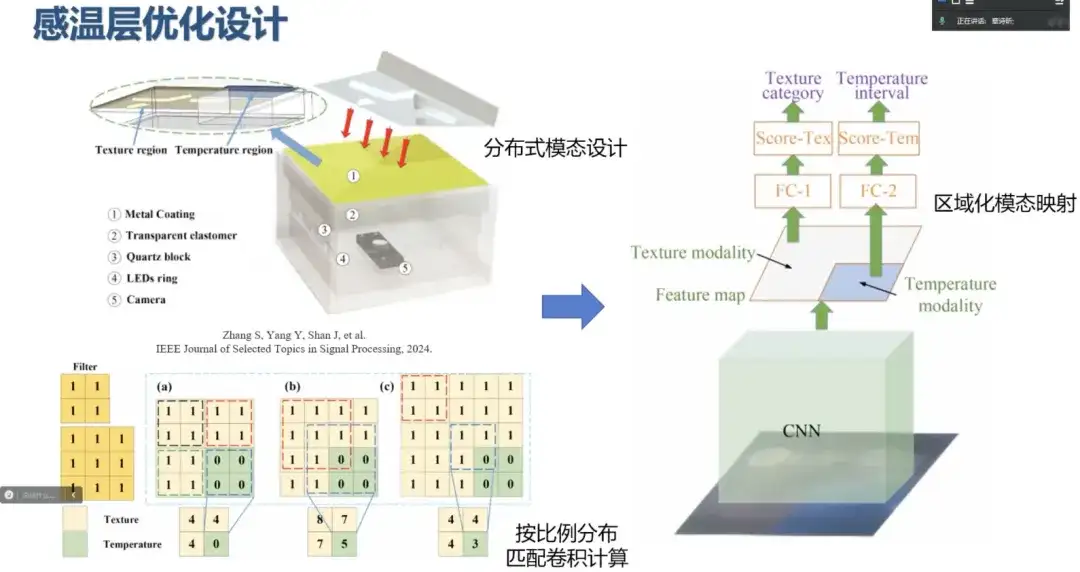

Um dieses Problem zu lösen, haben wir ein verteiltes modales Design für die thermosensitive Schicht und die Beschichtung durchgeführt, bei dem die Größen der beiden Bereiche dem Merkmalsextraktionsmechanismus entsprechen. Wir werden dies später im Detail erklären.

Optimierung der inneren Struktur: Miniaturisierung verbessert die Sensorintegration

Angesichts der Notwendigkeit einer Miniaturisierung visuell-taktiler Sensoren hoffen wir, ihre Größe reduzieren zu können, um die Integration der Sensoren zu verbessern. Dank der Entwicklung der mikroskopischen Bildgebungstechnologie haben wir die Bildgröße effektiv reduziert und die interne Struktur des Sensors modularisiert. Durch die Integration selten verbauter Komponenten können wir die Montage und Demontage erleichtern und eine maximale Raumausnutzung erreichen. In Kombination mit verschiedenen Steckverbindern kann der optisch-taktile Miniatursensor in verschiedene Manipulatoren integriert werden, um eine hohe Integration und Kompatibilität zu erreichen.

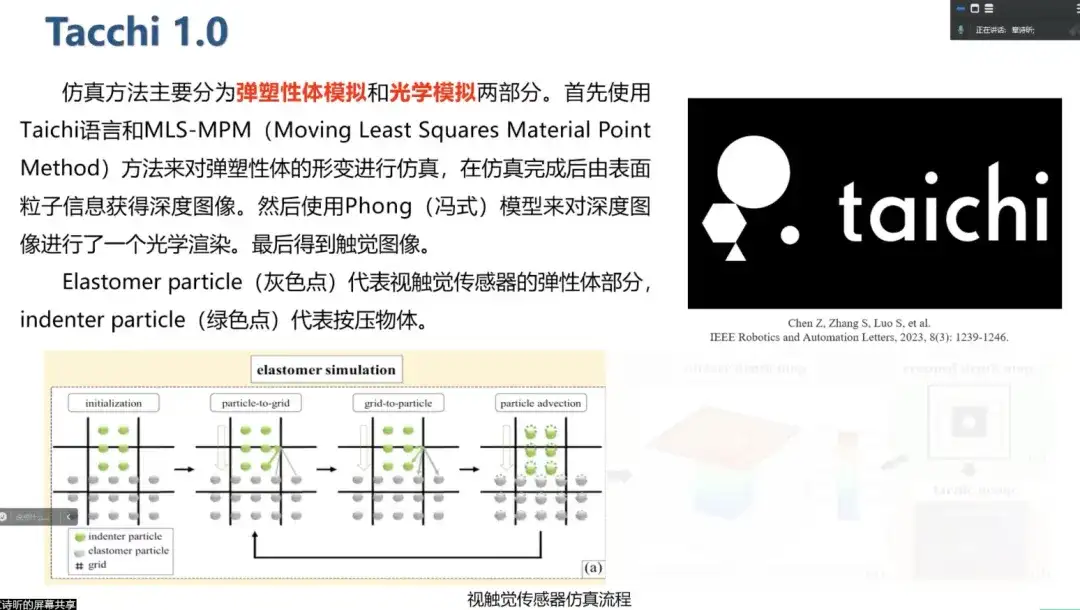

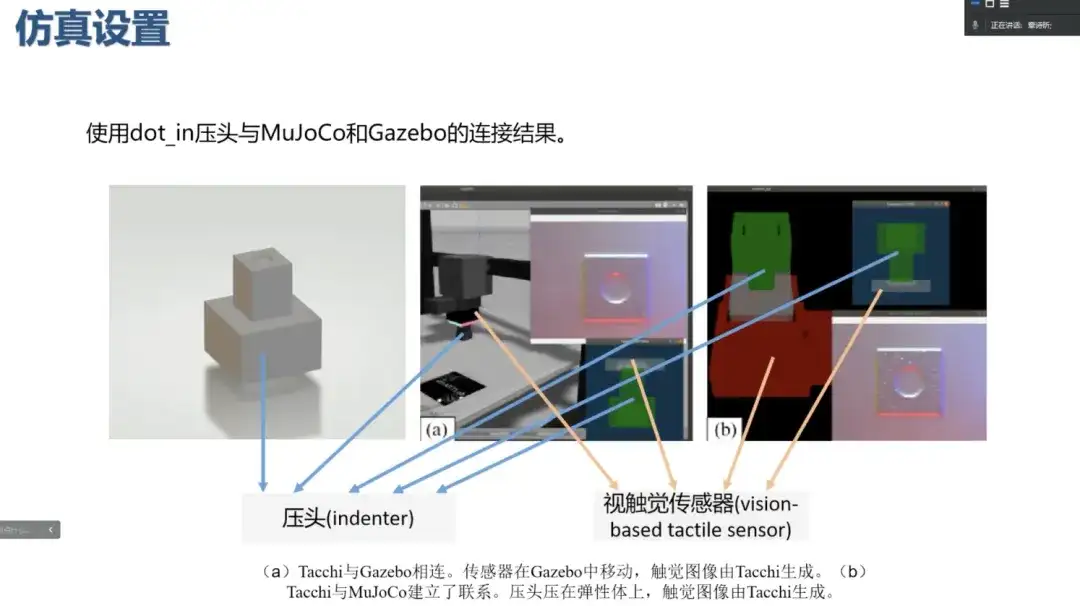

Visuelle und taktile Simulation

Obwohl unsere Methode die Verschleißfestigkeit der Beschichtung des visuellen Tastsensors verbessert, kommt es auch nach Tausenden von Anwendungen zu Verschleiß. In diesem Fall müssen wir eine umfangreiche Datenerfassung durchführen und es ist nicht realistisch, sich ausschließlich auf manuelle Arbeit zu verlassen. Aus diesem Grund haben wir Untersuchungen zur visuell-taktilen Simulation durchgeführt, die hauptsächlich auf der Taichi-Sprache und der MLS-MPM-Methode basieren, um die Verformung elastischer Körper zu simulieren.

Bei der elastischen Simulation werden hauptsächlich körnige Partikel verwendet, um den elastischen Körper und den Eindringkörper darzustellen, und die physikalischen Eigenschaften der Partikel (wie Impuls und Masse) werden während jedes Simulationsschritts auf das Gitter übertragen. Der Zustand der Partikel wird dann unter Verwendung des vorherigen Zustands der Gitterknoten und Partikel aktualisiert. Nach Abschluss der Simulation können die Tiefeninformationen abgerufen werden. Tacchi kann zur gemeinsamen Simulation auch mit anderen Robotern verbunden werden. Während des Pressvorgangs verändern sich die Partikel Bild für Bild und schließlich wird eine Partikeltiefenkarte erstellt und gerendert. Darüber hinaus haben wir in Touch 2.0 einen Mechanismus zur gegenseitigen Informationsübertragung zwischen Partikeln und Netzen hinzugefügt, die Simulation gleitender Objekte verbessert und Raytracing verwendet, um den Realismus des Renderings zu erhöhen, wodurch die neue Version detaillierter ist als Touch 1.0.

Roboterwahrnehmungsbetrieb

Basierend auf Hardware und Simulation dringen visuelle und taktile Sensoren in verschiedene Wahrnehmungsfelder vor. Unsere TactEdge-Maschine wird zur Lösung von Erkennungsproblemen in verschiedenen Bereichen eingesetzt. Wir machen auch einige interessante Versuche im Bereich Roboteroperationen.

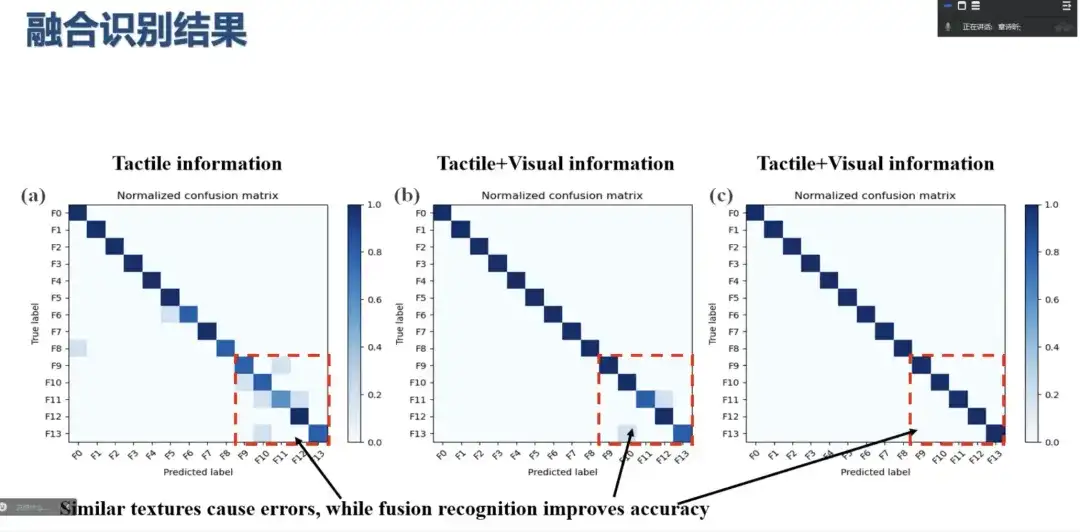

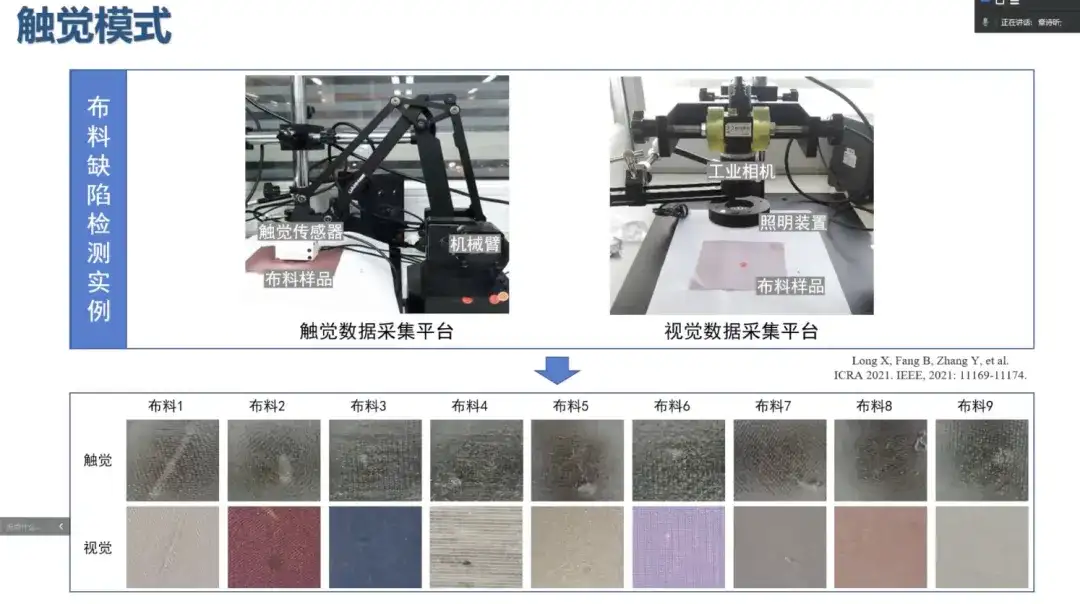

Stofferkennung: Kann zur Erkennung von Stofffehlern verwendet werden

Da Stoffe eine feine Textur und ausgeprägte geometrische Merkmale aufweisen, wurden sie früher verwendet, um den Texturabbildungseffekt visuell-taktiler Sensoren zu überprüfen. Der beschichtete optische Tastsensor filtert jedoch beim Drücken des Stoffes die Farbinformationen heraus. Obwohl die geometrischen Informationen indirekt extrahiert werden, ist die Farbe für den Stoff ebenso wichtig. Zu diesem Zweck verglichen wir die Leistung beschichteter Sensoren und visuell-taktiler Sensoren der sechsten Generation an Proben mit derselben Textur, aber unterschiedlichen Farben. Wie in der Abbildung unten gezeigt, wird die Genauigkeit des Beschichtungssensors durch die Integration von Sehen und Berühren erheblich verbessert und er kann sowohl visuelle als auch taktile Informationen erfassen.

Die Erkennung von Stofffehlern ist von entscheidender Bedeutung, da Fehler zu einer Wertminderung von 45% bis 65% führen können. Das Färbemuster des Stoffes hat erhebliche Auswirkungen auf die Vielseitigkeit und Komplexität des Algorithmus. Der Tastsinn ist eine der wichtigsten Wahrnehmungsfähigkeiten des Menschen und wird nicht durch die Oberflächenfarbe von Objekten beeinflusst. Er kann das Sehvermögen unterstützen und uns dabei helfen, Objekte wahrzunehmen. Daher integrieren wir Berührungen in die Erkennung von Stofffehlern und verwenden 9 Stoffproben zur Kreuzvalidierung. Die Ergebnisse zeigen, dass die Erkennungsgenauigkeit im taktilen Modus höher ist als im visuellen Modus, insbesondere bei der Erkennung bestimmter spezieller Texturen.

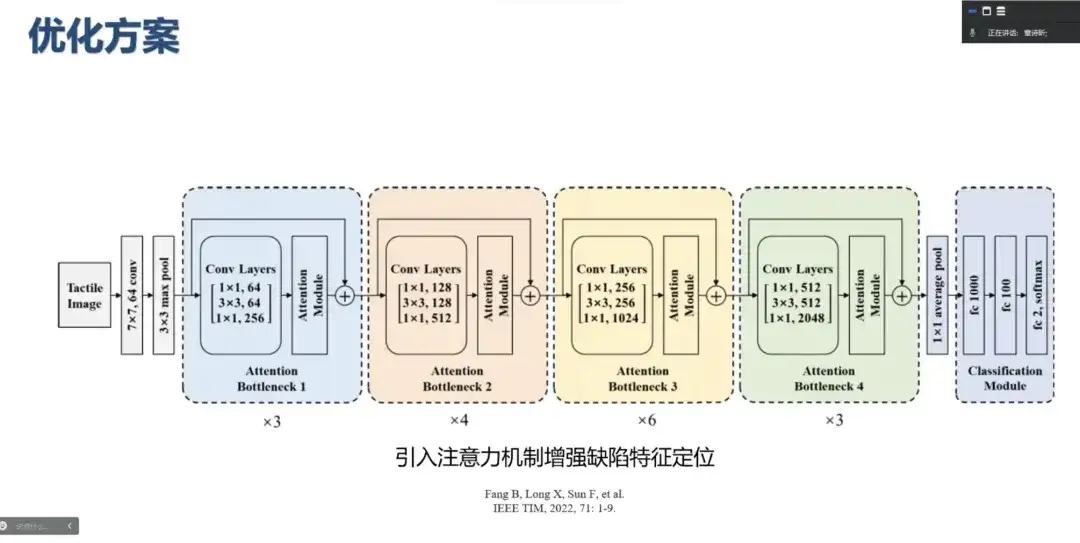

Da die Texturinformationen des Gewebes dominant sind und die Bestimmung defekter Teile beeinflussen, haben wir einen Aufmerksamkeitsmechanismus eingeführt, um den Fokus auf die wichtigsten defekten Bereiche zu legen und die Erkennungsgenauigkeit defekter Teile zu verbessern.

Transparente Objekterkennung: Die Glaserkennungsgenauigkeit erreicht 99% oder mehr

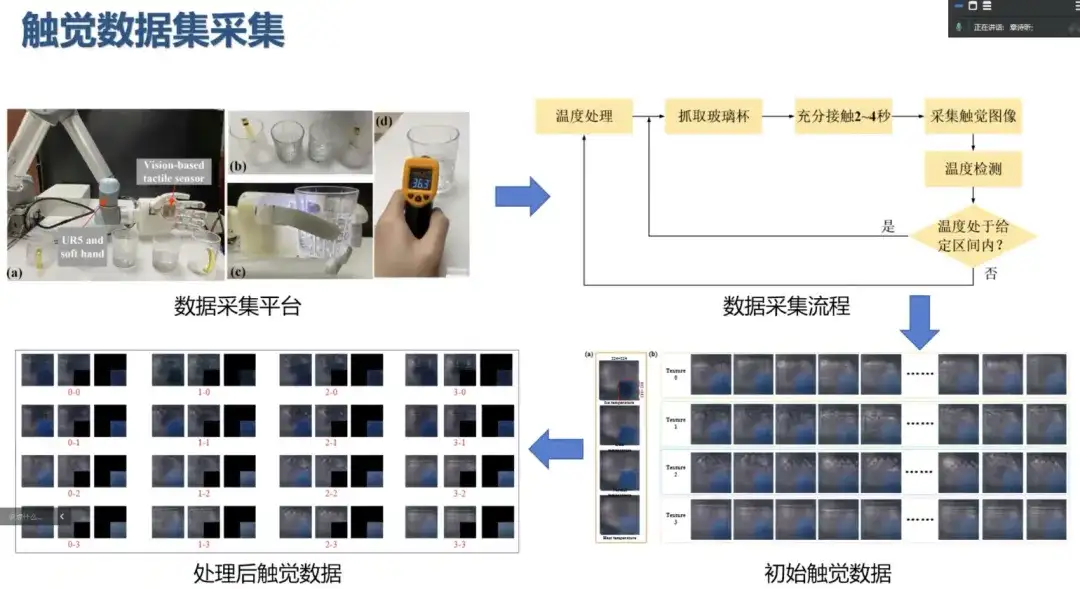

Neben Stoffen ist die Texturerkennung transparenter Objekte recht schwierig. Aufgrund ihrer transparenten Eigenschaften und des Einflusses von reflektiertem Licht kann es in visuellen Situationen zu Fehlerkennungen kommen. Daher führen wir einen taktilen Mechanismus ein, sammeln taktile Daten und erstellen eine taktile Plattform. In den gesammelten Glasbechern regulieren wir unter Berücksichtigung des Einflusses ihrer eigenen Temperatureigenschaften die Temperatur durch Zugabe von heißem Wasser oder Eiswürfeln, sammeln taktile Bilder und verarbeiten sie in die gewünschte taktile Form.

Wie bereits erwähnt, enthält die taktile Erkennung normalerweise Temperatur- und Texturinformationen. Eine gängige Erkennungsmethode besteht darin, die beiden separat zu identifizieren und unterschiedliche Einzelmodelle zu verschmelzen, um die Extraktion und Trennung der beiden Merkmale zu verbessern. Dies kann jedoch zu einer unregelmäßigen Verschmelzung führen.

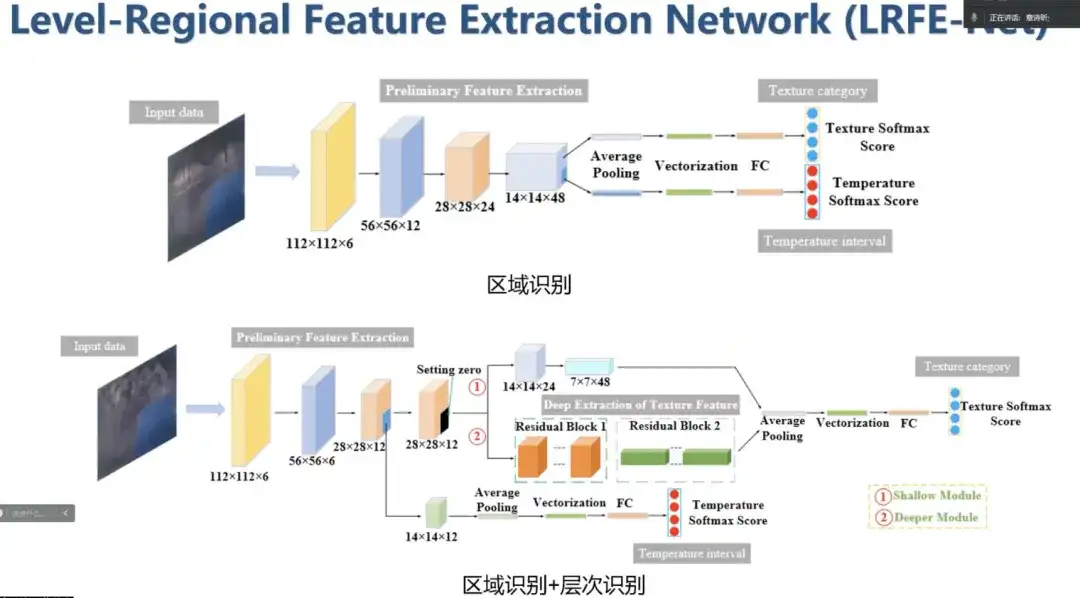

Aus diesem Grund haben wir einen Mechanismus zur Extraktion hierarchischer Regionsmerkmale vorgeschlagen. Dieser Mechanismus stellt sicher, dass die regionale Verteilung der thermosensitiven Schicht und der Temperaturschicht entsprechend einer bestimmten Größe verteilt wird, diese bestimmte Größe mit der Faltungsgröße übereinstimmt und während des Faltungsgleitprozesses in jedem Bereich eine unabhängige Merkmalsextraktion realisiert, wodurch eine gemischte Fusionsextraktion vermieden werden kann. Während die regionalen Merkmale extrahiert werden, bildet außerdem jede modale Region in der nachfolgenden Merkmalskarte eine modale Abbildung mit der ursprünglichen Region. In Kombination mit der Vektorisierungsverarbeitung kann eine verteilte parallele Verarbeitung nicht verwandter modaler Merkmale erreicht werden.

Unter Berücksichtigung der unterschiedlichen Lernschwierigkeiten von Texturmerkmalen und Temperaturmerkmalen haben wir auch einen hierarchischen Erkennungsmechanismus integriert, um verschiedene tiefe Netzwerkmodule zuzuweisen und so die Informationsverarbeitung zu vertiefen. Dieser hierarchische Mechanismus kann komplexe Merkmale effektiv erlernen.

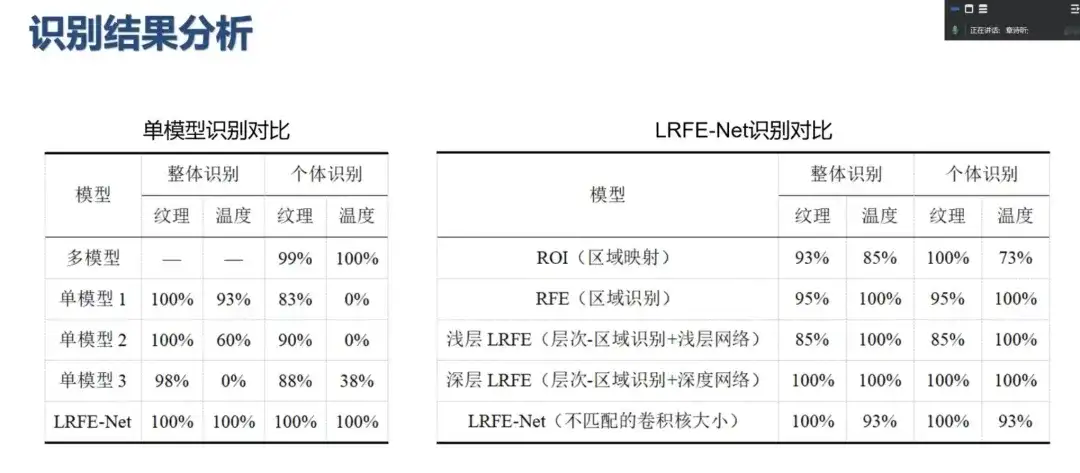

Wie in der folgenden Abbildung gezeigt, ist das herkömmliche Einzelmodell nicht in der Lage, Textur- und Temperaturinformationen effektiv zu verarbeiten. Daher ist die Genauigkeit der Temperaturerkennung bei der Einzelerkennung gering. Da bei der Gesamterkennung die Texturerkennung des Bildes dominiert, koppelt und ordnet das Modell irrelevante Merkmale zwangsweise zu, was die Temperaturerkennung verbessert. Unser Mechanismus (LRFE-Net) gewährleistet jedoch eine gleichbleibende Genauigkeit sowohl bei der Gesamt- als auch bei der Einzelerkennung. Darüber hinaus verbessert unsere Methode auch die Zeiteffizienz im Vergleich zur Multimodellerkennung.

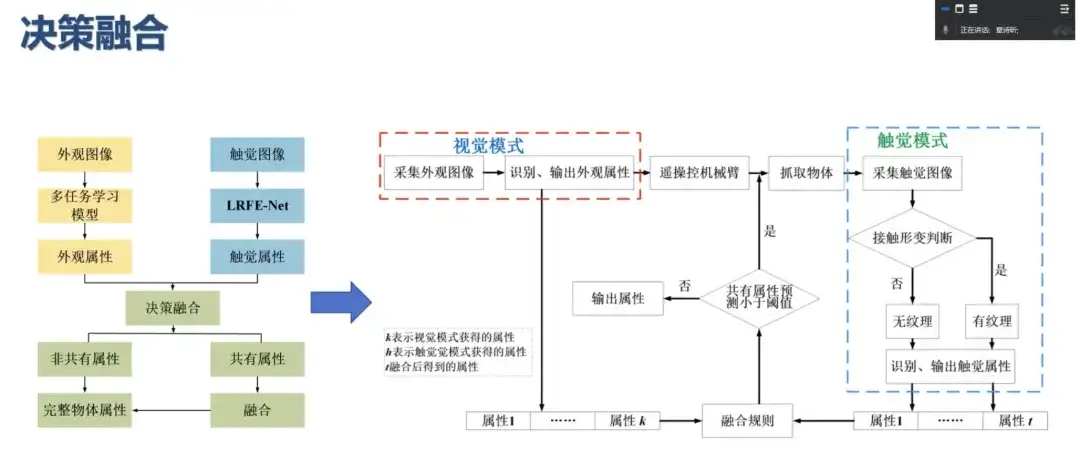

Zusammenfassend erhalten wir die Erscheinungsattribute transparenter Objekte im visuellen Modus und ihre Textur- oder Temperaturattribute im taktilen Modus. Als Nächstes können wir die aus diesen beiden Modi erhaltenen Attribute mithilfe der Entscheidungsfusion verschmelzen und gemeinsam an der transparenten Objekterkennung arbeiten. Beispielsweise hat unsere Methode bei Glasbechern eine visuelle und taktile Erkennungsgenauigkeit von über 99% erreicht.

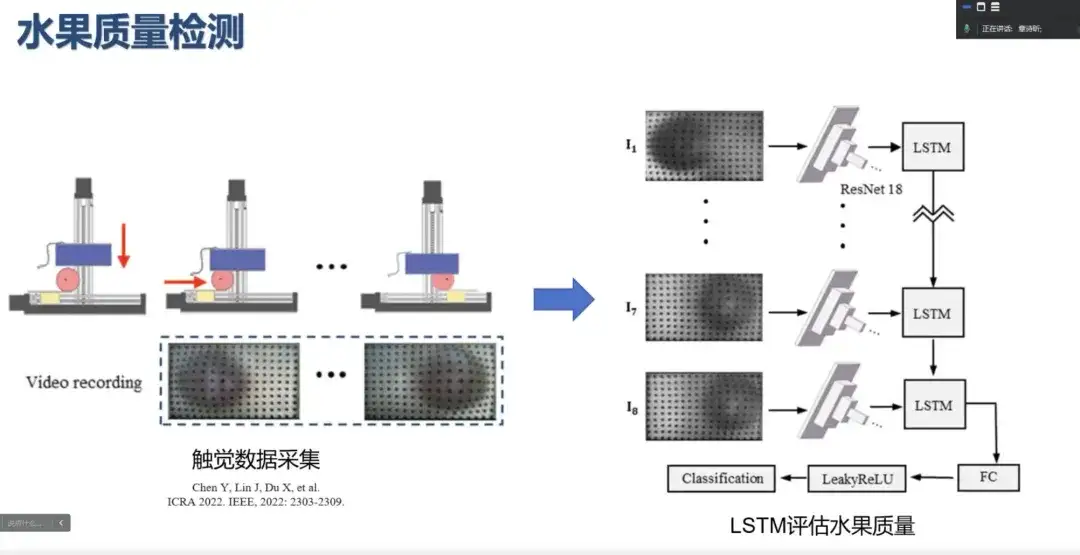

Landwirtschaftliche Anwendungen: Prüfung der Fruchtqualität

Im landwirtschaftlichen Bereich haben wir die visuell-taktile Sensorik auch auf die Qualitätsprüfung von Früchten ausgeweitet und nutzen dabei Deformationsunterschiede, um die Weichheit und Härte der Früchte sowie den Grad des lokalen Verfalls zu beurteilen.

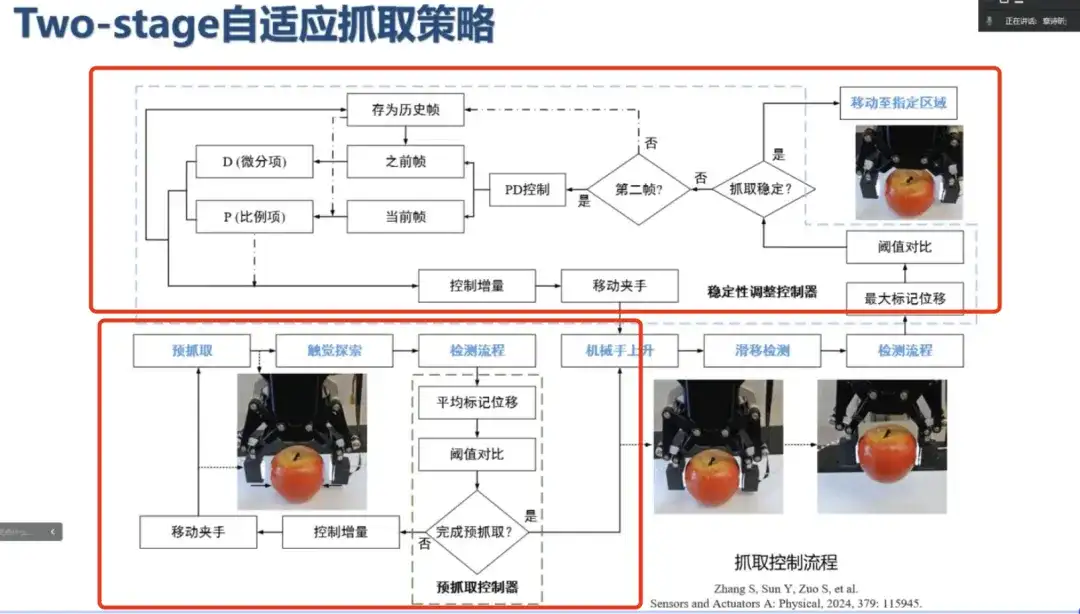

So wie sich Gegenstände unterschiedlicher Härte bei Druckeinwirkung unterschiedlich verformen, besteht auch zwischen Markierung und Kraft ein Zusammenhang. Um die Kontaktmechanismen dieses Tastsinns vollständig darzustellen, wären wahrscheinlich sehr große Datensätze und komplexe Modelle erforderlich. Bei tatsächlichen Betriebsaufgaben ist es jedoch nicht erforderlich, den Kraftwert genau zu messen. Um bestimmte Aufgaben zu erfüllen, reicht es aus, den Verformungstrend des Kontaktpunkts zu verstehen. Daher haben wir eine zweistufige adaptive Crawling-Strategie vorgeschlagen, wie in der folgenden Abbildung dargestellt. Die Strategie gliedert sich im Wesentlichen in zwei Phasen:

* Phase vor dem Begreifen: Durch taktile Erkundung wird ein stabiler Mikrokontaktzustand zwischen dem visuellen Tastsensor und dem Objekt hergestellt, der ein vorläufiges Verständnis der Eigenschaften des Objekts ermöglicht.

* Stabilitätsanpassungsphase: In dieser Phase wird die Greifstabilität basierend auf der dynamischen Erkennung von Mikroverformungen bestimmt, sodass der visuelle Tastsensor und das Objekt einen dynamischen relativen Stabilitätszustand erreichen können, der die Wahrnehmung der Objekteigenschaften stärken kann.

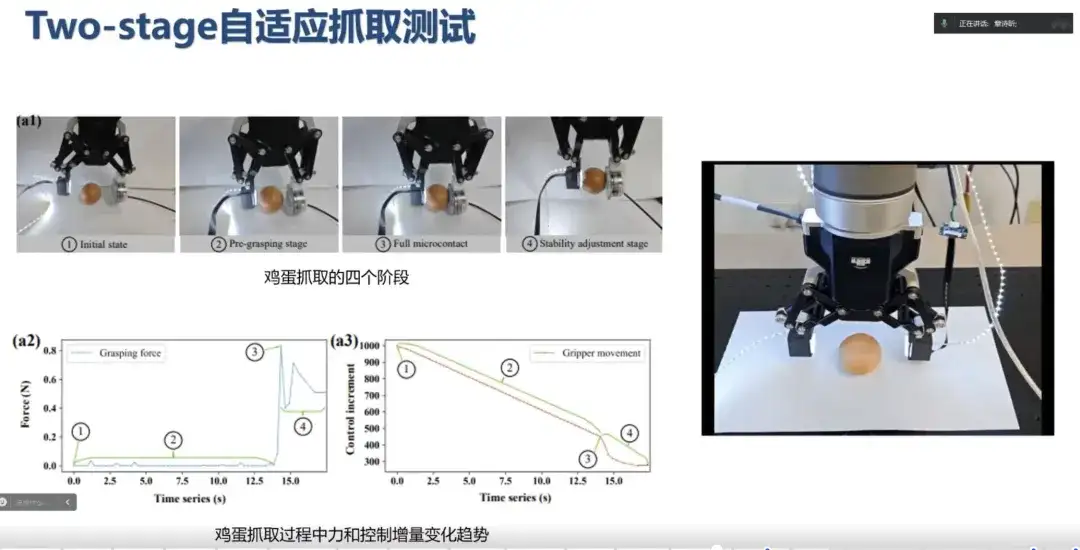

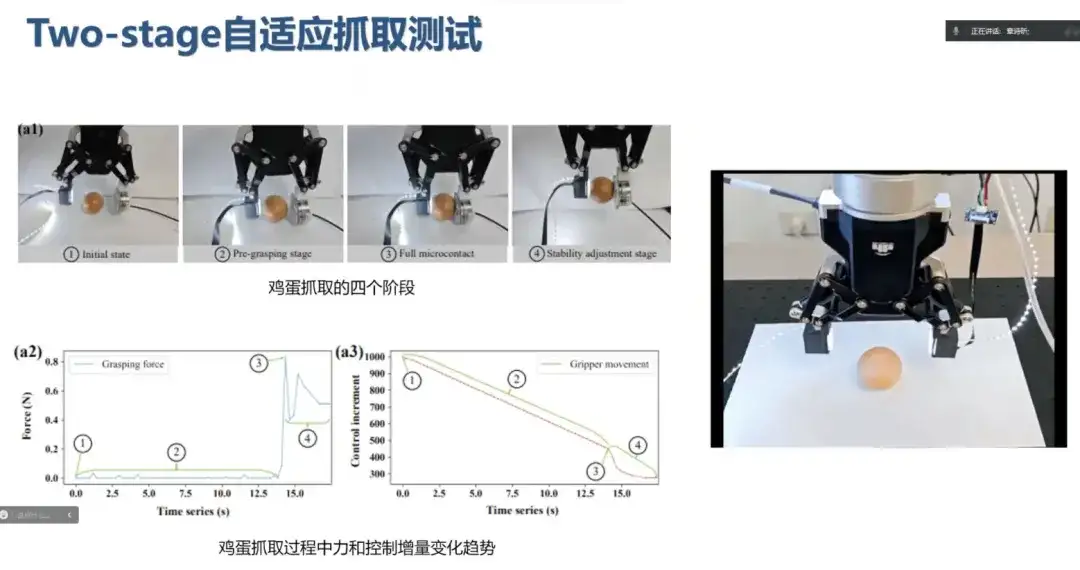

Diese Strategie kann an unterschiedliche Greifbedürfnisse angepasst werden, beispielsweise an das Greifen von Äpfeln, Eiern, Schwämmen, Dosen usw. Wie in der Abbildung unten gezeigt, bewegt sich der Roboter in der Phase vor dem Greifen des Eis langsam, um eine vorläufige Erkennung der Eigenschaften des Objekts vorzunehmen. Während der Stabilitätsanpassungsphase sind aufgrund des geringen Gewichts des Eis nur geringfügige Anpassungen des Systems erforderlich, um den Greifvorgang ohne große Eingriffe abzuschließen.

Bei Materialien wie Schwämmen kann bereits in der Vorgreifphase ein relativ stabiler Kontaktzustand hergestellt werden, so dass keine weitere Anpassung des Systems erforderlich ist. Im Gegensatz dazu erreichen Dosen als schwere Objekte beim ersten Greifen keinen völlig stabilen Zustand. Während der Stabilitätseinstellung neigen die Dosen zum Verrutschen. Der PD-Regler führt eine Feinabstimmung durch, bis die Stabilitätsanforderungen erfüllt sind und der gesamte Anpassungsprozess abgeschlossen ist.

Wie in der folgenden Abbildung dargestellt, zeigen die Greiftests verschiedener Objekte, dass unsere vorgeschlagene zweistufige adaptive Greifstrategie äußerst robust ist und stabile und zuverlässige Greifvorgänge an verschiedenen Objekten mit mehreren Attributen erreichen kann.

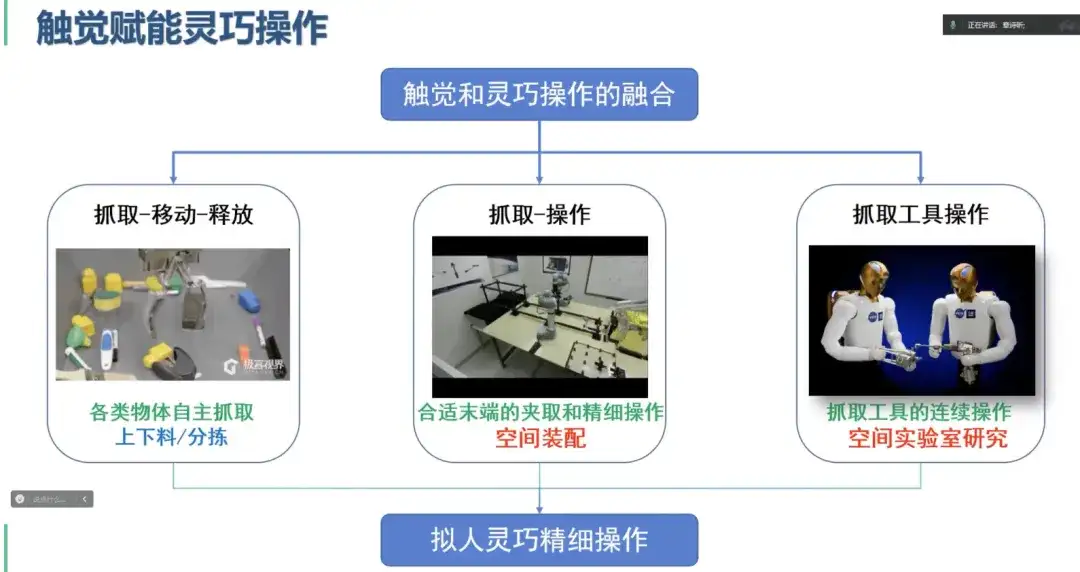

In Zukunft werden wir weiterhin die Integration von Berührung und geschickter Manipulation erforschen und eine anthropomorphe und präzise Manipulation von Robotern anstreben.

Auch in Zukunft wird HyperAI die Embodied-Touch-Community dabei unterstützen, weiterhin Online-Sharing-Aktivitäten durchzuführen und Experten und Wissenschaftler aus dem In- und Ausland einzuladen, um hochmoderne Ergebnisse und Erkenntnisse auszutauschen. Bleiben Sie dran!