Command Palette

Search for a command to run...

マルチモーダル コンピューティングが普及し始めると、わずか 9 バイトの MiniCPM-o-4.5 がリアルタイムの画像理解とテキスト生成をカバーし、vLLM Omni はテキスト モデルとマルチモーダル モデルの両方に対して高スループットの展開とサービス指向アーキテクチャを同時にサポートします。

マルチモーダルな大規模モデルが「使える」から「使いやすい」へと移行しつつあるこの重要な局面において、パラメータサイズ、推論コスト、そして導入障壁は、モデルの機能と同様に重要になりつつあります。OpenBMBの最新リリースであるMiniCPM-o-4.5は、Omni のフルモーダル機能は、9B のパラメータのみを使用して構築されており、軽量と高性能の間のより優れたソリューションを見つけます。

MiniCPM-o-4.5は、テキストや画像などのマルチモーダル入力からモデル化と出力生成を共同で行う統合アーキテクチャを採用しており、クロスモーダルアライメント機能と推論効率の相乗的な最適化を重視しています。9バイトのモデルサイズは、主流のコンシューマー向けGPUへの推論実装を可能にし、大規模なクローズドソースモデルと比較して、メモリ使用量と応答レイテンシの点でエンジニアリングフレンドリーです。

現在のところ、HyperAI の公式ウェブサイトが公開されました。「MiniCPM-o-4_5: Wallfacer Intelligence オープンソース フルデュプレックス フルモーダルモデル」ぜひお試しください〜

オンラインでの使用:https://go.hyper.ai/iOGzO

2月24日から2月27日までのhyper.ai公式ウェブサイトの更新の概要は次のとおりです。

* 高品質の公開データセット: 3

* 高品質のチュートリアル: 14

* 人気のある百科事典のエントリ: 5

公式ウェブサイトにアクセスしてください:ハイパーアイ

公開データセットの選択

1. THINGS-EEG EEGデータセット

THINGS-EEGは、米国国立衛生研究所(NIH)の国立精神衛生研究所、ドイツのマックス・プランク人間認知・脳科学研究所、ギーセン大学医学部などによって公開されている、物体認知研究のための脳波(EEG)データセットです。50人の被験者が物体の画像を見ている際のEEG活動を記録し、物体処理の時間的ダイナミクスと認知表現を分析するために使用されています。

直接使用します:https://go.hyper.ai/kqejl

2. THINGS-MEG磁気脳波データセット

THINGS-MEGは、米国国立衛生研究所(NIH)の国立精神衛生研究所、ドイツのマックス・プランク人間認知・脳科学研究所、ギーセン大学医学部などによって公開されている、物体認知研究のための脳磁図(MEG)データセットです。被験者が物体の画像を見た際の脳の電磁活動をミリ秒レベルで記録し、物体処理の時間的ダイナミクスを分析するために用いられます。

直接使用します:https://go.hyper.ai/eBKWI

3. THINGS-fMRI機能的磁気共鳴画像データセット

THINGS-fMRIは、米国国立衛生研究所(NIH)の国立精神衛生研究所、ドイツのマックス・プランク人間認知・脳科学研究所、ギーセン大学医学部などによって共同で公開されている、物体認知研究のための高密度機能的磁気共鳴画像データセットです。このデータセットは、人間の脳が現実世界の物体をどのように視覚的および意味的に表現するかを体系的に特徴付けることを目的としています。

直接使用します:https://go.hyper.ai/CRbiA

選択された公開チュートリアル

今週は、3種類の高品質な公開チュートリアルをまとめました。

* OCRチュートリアル: 4

* マルチモーダルチュートリアル: 6

* 大規模言語モデルチュートリアル:4部構成

OCRチュートリアル

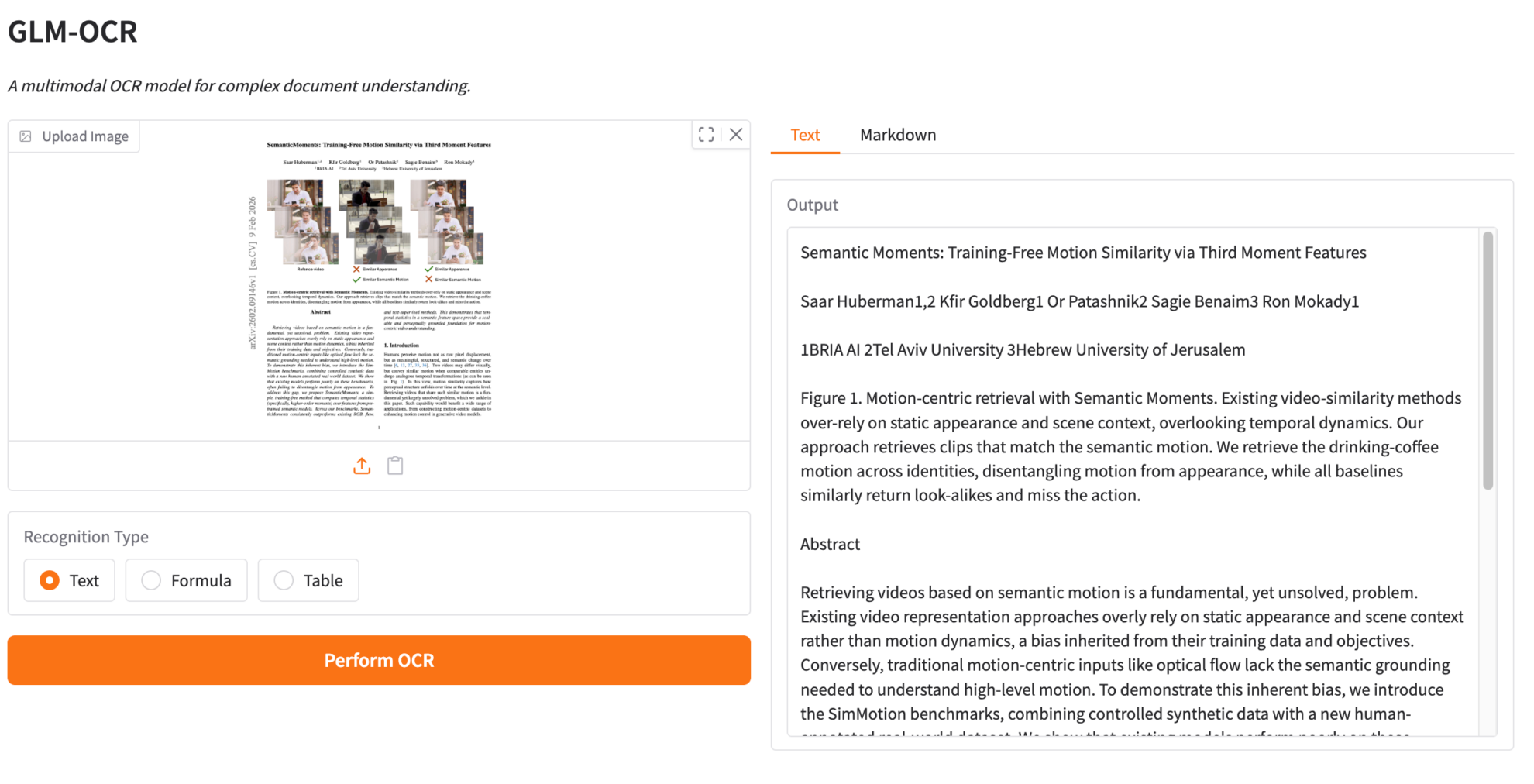

1. GLM-OCR 軽量マルチモーダルOCR認識システム

GLM-OCRは、Zhipu AIが2026年2月にオープンソース化した軽量マルチモーダルOCRモデル(0.9B)で、複雑な文書シナリオにおける高精度なテキスト認識と構造化解析に重点を置いています。その主な利点は「小型、高精度、容易な導入」です。GLM-Vエンコーダー・デコーダー・マルチモーダルアーキテクチャをベースとし、自社開発のCogViTビジュアルエンコーダーとRLHF最適化を統合しています。OmniDocBench V1.5ベンチマークにおいて、94.62という最高スコアを獲得し、最先端(SOTA)ベンチマークでトップとなり、Gemini-3-Proに迫る性能を実現しました。オフィス文書の解析、教育・科学技術関連の数式認識、政府・金融文書の検証、コードスニペット抽出など、様々なシナリオに適しています。

オンラインで実行:https://go.hyper.ai/kgb3n

2. PaddleOCR-VL-1.5: vLLMに基づくローカルOCR

PaddleOCR-VL-1.5は、PaddlePaddleチームがリリースしたPaddleOCRシリーズのマルチモーダルOCRモデルの一つです。複雑な文書シナリオ(請求書、契約書、書類、スキャン文書など)において、より強力なテキスト認識機能とレイアウト理解機能を提供します。本チュートリアルでは、OpenAI互換のvLLMインターフェースを使用してこのモデルに接続し、画像のアップロードと認識結果の完全な連携を実現しています。0.9Bのパラメータ数を備え、OmniDocBench v1.5で94.5%という新世代の精度を達成しました。

オンラインで実行:https://go.hyper.ai/cea6x

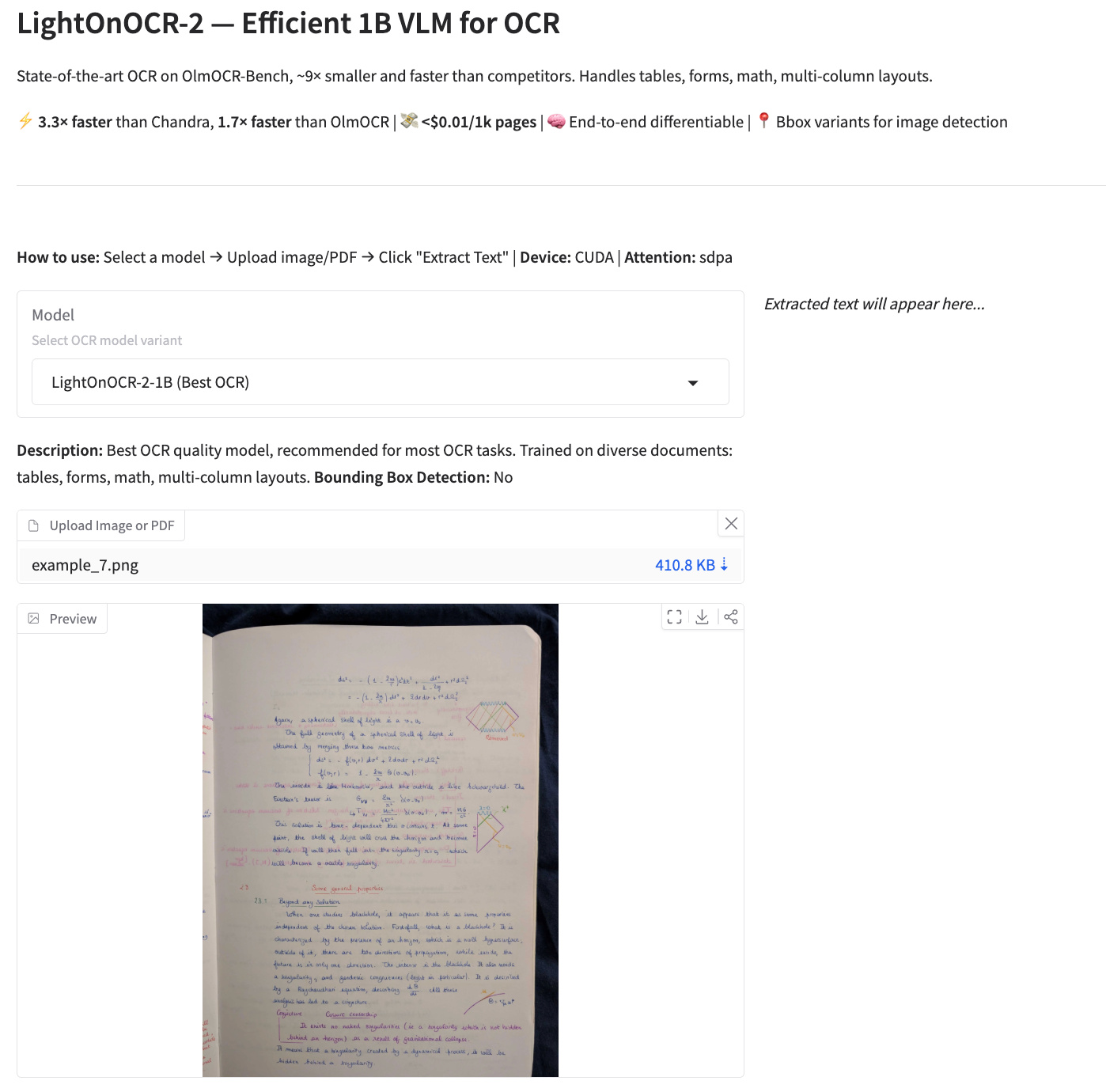

3.LightOnOCR-2-1B 軽量、高性能エンドツーエンドOCRモデル

LightOnOCR-2-1Bは、LightOn AIの最新世代エンドツーエンド視覚言語モデルです。LightOnOCRシリーズのフラッグシップモデルとして、コンパクトなアーキテクチャに文書理解とテキスト生成を統合し、10億個のパラメータを誇り、コンシューマーグレードのGPUで動作可能です。このモデルは、Vision-Language Transformerアーキテクチャを採用し、RLVR学習技術を組み込むことで、非常に高い認識精度と推論速度を実現しています。複雑な文書、手書きテキスト、LaTeX数式の処理を必要とするアプリケーション向けに特別に設計されています。

オンラインで実行:https://go.hyper.ai/cLSj5

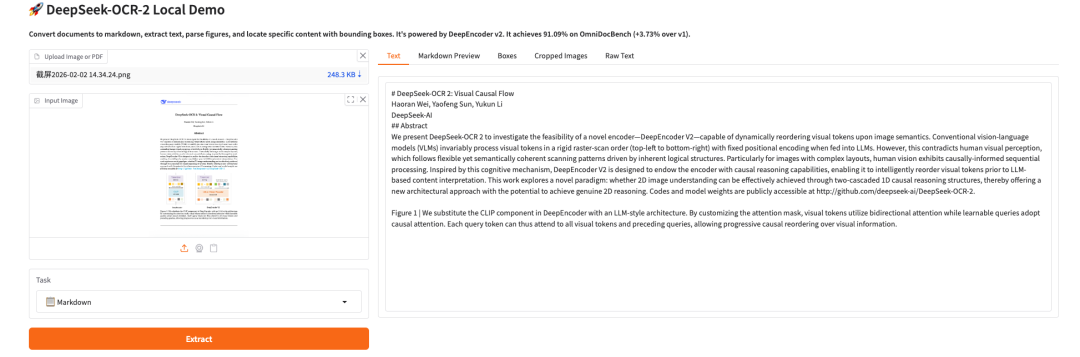

4. DeepSeek-OCR 2 ビジュアル因果フロー

DeepSeek-OCR 2は、DeepSeekチームが発表した第2世代OCRモデルです。DeepEncoder V2アーキテクチャを導入することで、固定スキャンからセマンティック推論へのパラダイムシフトを実現しています。このモデルは、因果ストリームクエリとデュアルストリームアテンションメカニズムを採用し、視覚トークンを動的に並べ替えることで、複雑な文書の自然な読み取りロジックをより正確に再現します。OmniDocBench v1.5ベンチマークでは、このモデルは総合スコア91.09%を達成し、前モデルから大幅に向上しました。また、OCR認識結果の繰り返し率も大幅に低減し、将来のフルモーダルエンコーダ構築への新たな道筋を示しています。

オンラインで実行:https://go.hyper.ai/iOGzO

マルチモーダルチュートリアル

1. MiniCPM-o-4.5: Wallfacer Intelligenceのオープンソースの全二重、フルモーダルモデル

MiniCPM-o-4.5は、Facewall Intelligenceと清華大学自然言語処理ラボが2026年2月にオープンソース化した90億パラメータのフルモーダルフラッグシップモデルです。siglip2、whisper、cosyvoice2、qwen3-8bを用いたエンドツーエンドアーキテクチャを採用しています。業界初の「リアルタイムフリーダイアログ」対応モデルとして、フルデュプレックスインタラクションを実現。ユーザーは、従来のターンベースの「トランシーバー」モードから脱却し、見る、聞く、話すという3つの要素を同時に行うことができます。このモデルは、優れた視覚理解機能、ハイパーヒューマノイド音声生成機能、音声クローニング機能を誇ります。プロアクティブインタラクションとリアルタイムストリーミングメディア処理をサポートし、エッジデバイス上で動作可能です。ascendやHygonなどの様々な国産チップと互換性があり、llama.cppやvLLMなどのフレームワークを用いて効率的に導入できます。

オンラインで実行:https://go.hyper.ai/iOGzO

2.vLLM-Omniを使用したQwen-Image-Editの導入

Qwen-Image-Editは、Alibabaがリリースした多機能な画像編集モデルです。セマンティック編集とビジュアル編集の両方の機能を備え、低レベルのビジュアルアピアランス編集(要素の追加、削除、変更など)と高レベルのビジュアルセマンティック編集(IPの作成、オブジェクトの回転、スタイルの転送など)の両方が可能です。このモデルは、中国語と英語のバイリンガルテキストの正確な編集をサポートし、画像内のテキストを元のフォント、サイズ、スタイルを維持しながら修正できます。

オンラインで実行:https://go.hyper.ai/4w6XA

3. ステップ3-VL-10B: マルチモーダル視覚理解とグラフィカル対話

Step3-VL-10Bは、StepFunチームがリリースしたオープンソースの視覚言語基盤モデルであり、マルチモーダル理解と複雑推論タスク向けに特別に設計されています。このモデルは、効率性、推論能力、視覚理解の質のバランスを再定義することを目指しており、パラメータサイズが限られたマルチモーダルモデルに適しています。パラメータサイズが小さいにもかかわらず、視覚知覚、複雑推論、そして人間の指示との整合において優れた性能を発揮します。複数のベンチマークにおいて、同規模のモデルを一貫して上回り、特定のタスクにおいてはパラメータ数が10~20倍のモデルに匹敵する性能を発揮します。

オンラインで実行:https://go.hyper.ai/RqTTW

4. vLLM-Omniを使用してQwen-Image-2512をデプロイする

Qwen-Image-2512は、Qwen-Imageシリーズの基盤となるテキスト画像変換モデルであり、主に高品質な画像生成と複雑なマルチモーダルコンテンツ表現を目的として設計されています。生成される画像の全体的なリアリティとユーザビリティの向上に重点を置いています。ポートレート生成では自然さが大幅に向上し、顔の構造、肌の質感、照明の関係が写真に近づきます。自然風景においては、より詳細な地形テクスチャ、植生の詳細、動物の毛皮などの高頻度情報を生成できます。テキスト生成とタイポグラフィ機能も向上し、読みやすいテキストと複雑なフォントスタイルをより安定して表示できるようになりました。

オンラインで実行:https://go.hyper.ai/JMmhs

5. TurboDiffusion: 画像とテキスト駆動型ビデオ生成システム

TurboDiffusionは、2025年12月に清華大学のチームによって開発された高効率のビデオ拡散生成システムです。高次蒸留用のWan2.1アーキテクチャに基づいて、このシステムは大規模なビデオモデルにおける推論速度の遅さと計算リソースの消費量の増加という問題点を解決し、最小限の手順で高品質のビデオを生成するという目標を達成することを目的としています。

オンラインで実行:https://go.hyper.ai/VvyVZ

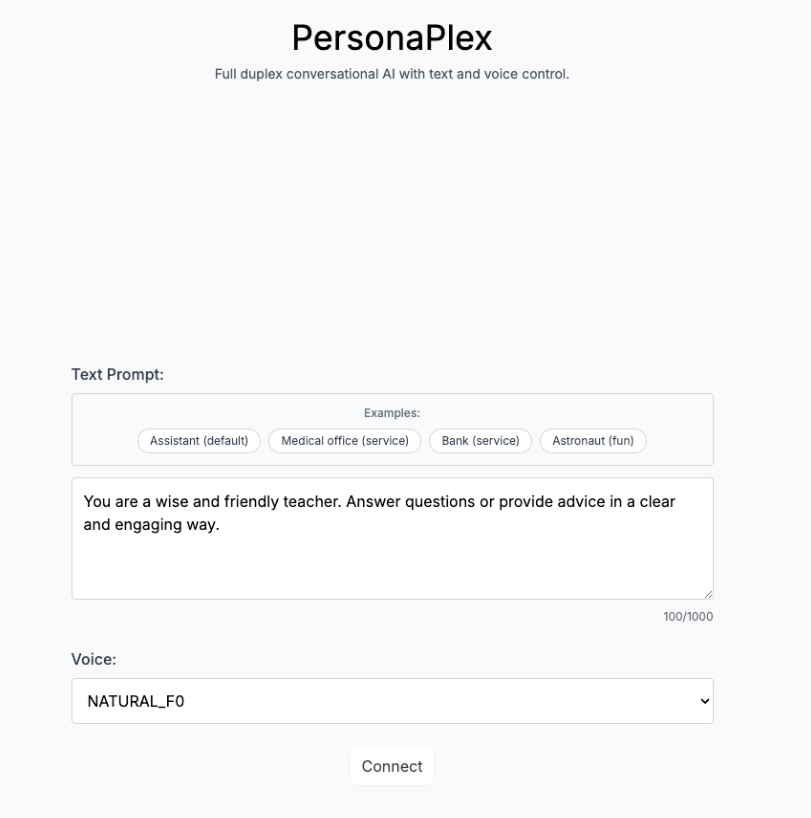

6. Personaplex-7B-v1: リアルタイム対話とキャラクターカスタマイズ音声インターフェース

PersonaPlex-7B-v1は、NVIDIAがリリースした70億パラメータのマルチモーダル・パーソナライズ対話モデルです。リアルタイムの音声/テキストインタラクション、長期的なペルソナ一貫性シミュレーション、マルチモーダル知覚タスク向けに設計されており、ミリ秒レベルの応答速度を備えた没入型ロールプレイングおよびマルチモーダルインタラクションのデモンストレーションシステムを提供することを目指しています。

オンラインで実行:https://go.hyper.ai/ndoj0

大規模言語モデルのチュートリアル

1.llama.cpp+WebUIを開いてQwen3-VL-8B-Instruct-GGUFをデプロイする

Qwen3-VL-8B-Instruct-GGUFは、高精度な言語モデルの多様なバリアントと専用のMMPROJビジュアルエンコーダを提供します。これらのモデルはllama.cppやOllamaなどのツールと互換性があり、CPU、NVIDIA GPU、Apple Silicon、Intel GPUなど、幅広いハードウェアに適しています。Qwen3-VL-8B-Instruct-GGUFは、GGUF形式において言語コンポーネントとビジュアルコンポーネントを明示的に区別します。これにより、開発者はハードウェア固有の量子化レベルを柔軟に選択でき、リソースが限られたCPU環境でも許容可能な応答時間を実現しながら、GPUを搭載したシステムではより高いパフォーマンスを引き出すことができます。

オンラインで実行:https://go.hyper.ai/EKryC

2. ヤコビ強制:高速かつ正確な因果並列デコード技術

Jacobi Forcingは、Hao AI Labsによって導入された、大規模言語モデル(LLM)をネイティブな因果並列デコーダーに変換する新しい学習手法です。モデルが自身のJacobi復号軌跡に沿ってノイズの多い未来ブロックを処理するように学習することで、この手法は因果自己回帰バックボーン構造の整合性を維持しながら、ARモデルから拡散モデルへのマッチング問題を解決します。

オンラインで実行:https://go.hyper.ai/fIad4

3.vLLM+GLM-4.7-Flash の Open WebUI 展開

GLM-4.7-Flashは、高性能と高スループットを両立した軽量マルチモーダル推論モデルであり、Chained Thinking(CoT)、ツール呼び出し、エージェント機能をネイティブにサポートしています。GLM-4.7-Flashはハイブリッドエキスパート(MoE)アーキテクチャを採用し、スパースアクティベーションメカニズムを活用することで、大規模モデルの表現力を維持しながら、各推論の計算コストを大幅に削減します。

オンラインで実行:https://go.hyper.ai/a2IN3

4.vLLM+Open WebUI LFM2.5-1.2B-Thinkingの展開

LFM2.5-1.2B-Thinkingは、エッジ最適化されたハイブリッドアーキテクチャモデルです。LFM2.5シリーズの中でも特に論理推論に最適化されたバージョンとして、コンパクトなアーキテクチャに長シーケンス処理と効率的な推論機能を統合しています。12億個のパラメータを誇り、コンシューマーグレードのGPUだけでなく、エッジデバイスでもスムーズに動作します。革新的なハイブリッドアーキテクチャ(線形動的システム+アテンション)を採用することで、極めて高いメモリ効率とスループットを実現し、インテリジェンスを犠牲にすることなくリアルタイムのオンデバイス推論を必要とするシナリオ向けに特別に設計されています。

オンラインで実行:https://go.hyper.ai/1XTsV

コミュニティ記事の解釈

1. ヨーロッパの研究チームは、わずか20秒で15日間の予報を提供できる高解像度の地域海洋予報モデル「SeaCast」を提案した。

陸と海の不規則な分布、複雑な横方向の境界条件、そして垂直に成層化した変数の詳細な特性評価の必要性により、既存の地球規模の海洋AIモデルを地域的なタスクに直接適用することは困難です。この問題に対処するため、ヘルシンキ大学(フィンランド)、地中海気候変動研究センター、サレント大学(イタリア)からなる共同研究チームは、地域海洋予測用に特別に設計されたグラフニューラルネットワークモデル「SeaCast」を開発しました。このモデルは、1/24°グリッド内の18の垂直レベルにわたる15日間の予測を、単一のGPUでわずか20秒で実行できます。

レポート全体を表示します。https://go.hyper.ai/kRXnE

2. コーネル大学は、高伝導性リチウムイオン電解質の化学メカニズムを解読するための革新的な AI フレームワークを提案し、% で 80% を超える予測成功率を達成しました。

塩溶媒化学は、ほとんどのリチウムイオン電池システムにおける電解質挙動の基盤となっていますが、その合理的な設計は、無数の組み合わせと非線形な構造-性能相関関係を含む広大な化学空間によって制約されています。この問題は、実験データがまばらで不均一に分布していることによってさらに悪化し、モデルの一般化能力を阻害しています。コーネル大学の研究チームは、塩溶媒化学のモデル化と解釈のための、堅牢で解釈可能かつデータ効率の高いフレームワークSCANを開発しました。このフレームワークは、ロングテールデータを効果的に処理し、塩溶媒配合の包括的なスペクトルを捉えます。

レポート全体を表示します。https://go.hyper.ai/OrHIt

3. ミシガン大学などが提案したバッテリー寿命を予測する新しい手法により、検証サイクルが 40 倍短縮され、「発見学習」を用いた 98% の評価時間が短縮されます。

次世代バッテリーの研究と大規模応用には、正確かつ効率的なバッテリーサイクル寿命予測が不可欠であり、その信頼性、安全性、そしてライフサイクル全体のコストを直接左右します。最近、ミシガン大学などの研究機関の専門家は、「Discovery Learning(DL)」と呼ばれる革新的な科学的機械学習手法を提案しました。これは、能動学習、物理的制約学習、ゼロショット学習を有機的に統合し、人間のような推論に基づく閉ループ学習フレームワークを構築するものです。控えめな仮定の下では、産業グレードのバッテリー寿命検証プロセスと比較して、Discovery Learningは評価時間を981 TP3T短縮し、エネルギー消費量を951 TP3T節約できるため、検証サイクルを約1,333日から33日に短縮できます。

レポート全体を表示します。https://go.hyper.ai/28W2g

4. 論文概要 | 科学におけるAI活用の主要成果100選:2025年までの技術革新の概観

過去1年間、AIと科学研究の関係は、深く静かな変革を遂げてきました。2025年までに、AI for Scienceは単なる散発的な技術応用ではなく、科学研究とイノベーションのための明確で体系的、かつ再利用可能な道筋へと進化するでしょう。AIはもはや単なるツールではなく、研究パラダイムの一部となりつつあります。HyperAIは、医療、材料化学、気象研究、天文学など、複数の分野からの論文を収集し、さまざまなバックグラウンドを持つ読者が迅速に検索・レビューできるようにしています。

レポート全体を表示します。https://go.hyper.ai/FLJGD

人気のある百科事典の項目を厳選

1. RRFと組み合わせた逆ソート

2. コルモゴロフ・アーノルド表現定理

3. 大規模マルチタスク言語理解MMLU

4. ブラックボックスオプティマイザー

5. クラス条件付き確率

ここには何百もの AI 関連の用語がまとめられており、ここで「人工知能」を理解することができます。

上記は、今週編集者が選択したすべてのコンテンツです。hyper.ai 公式 Web サイトに掲載したいリソースがある場合は、お気軽にメッセージを残すか、投稿してお知らせください。

また来週お会いしましょう!