Command Palette

Search for a command to run...

チュートリアル概要|オープンソースの小型モデルがGPT-5に匹敵する総合的な知能を実現。Qwen 3.5/Gemma 4などの人気モデルをワンストップで評価。

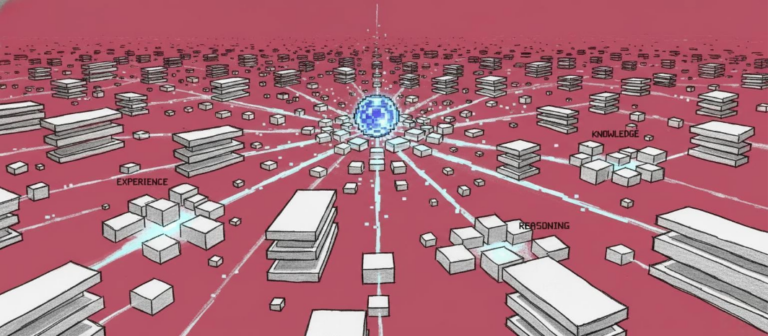

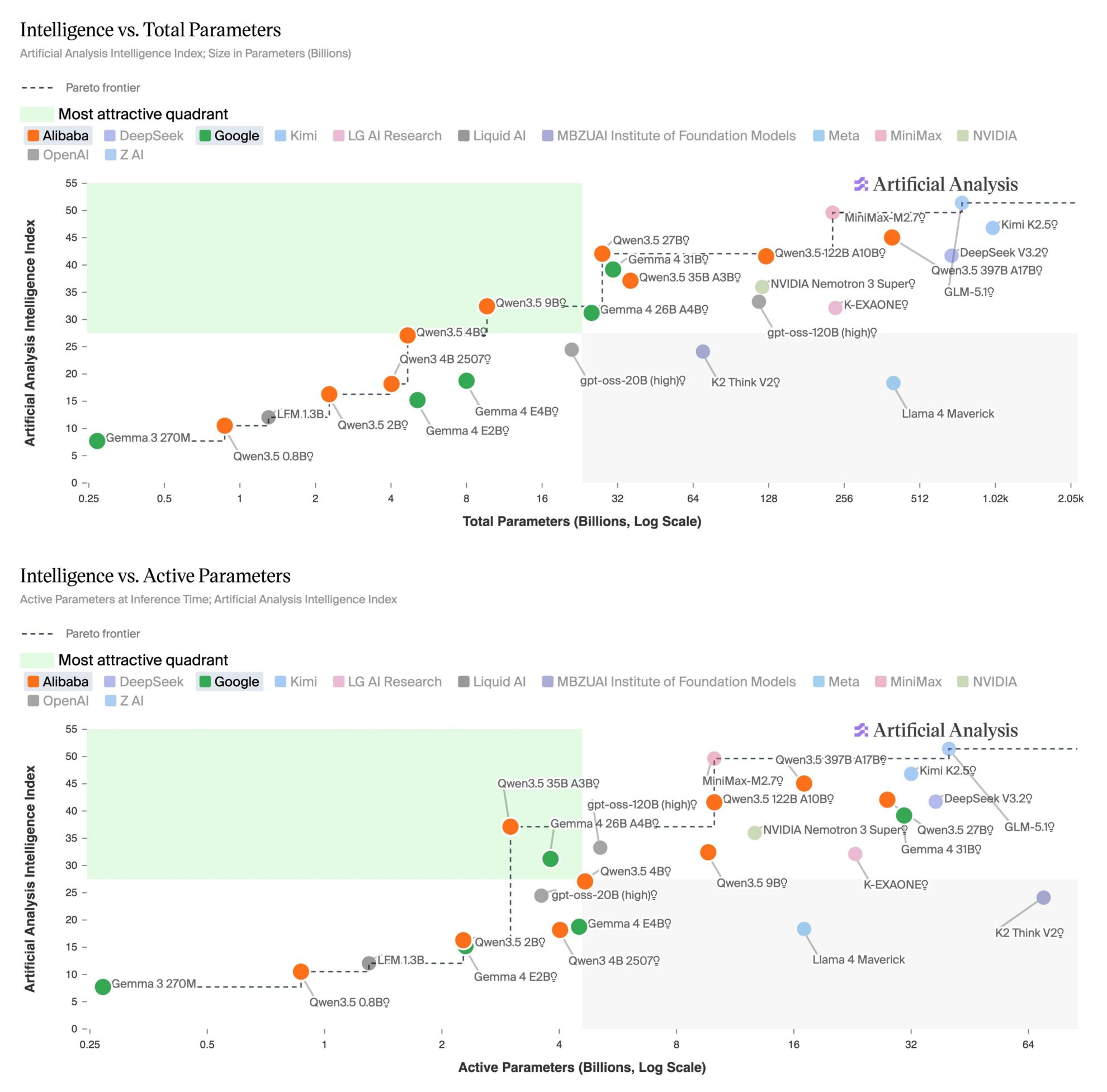

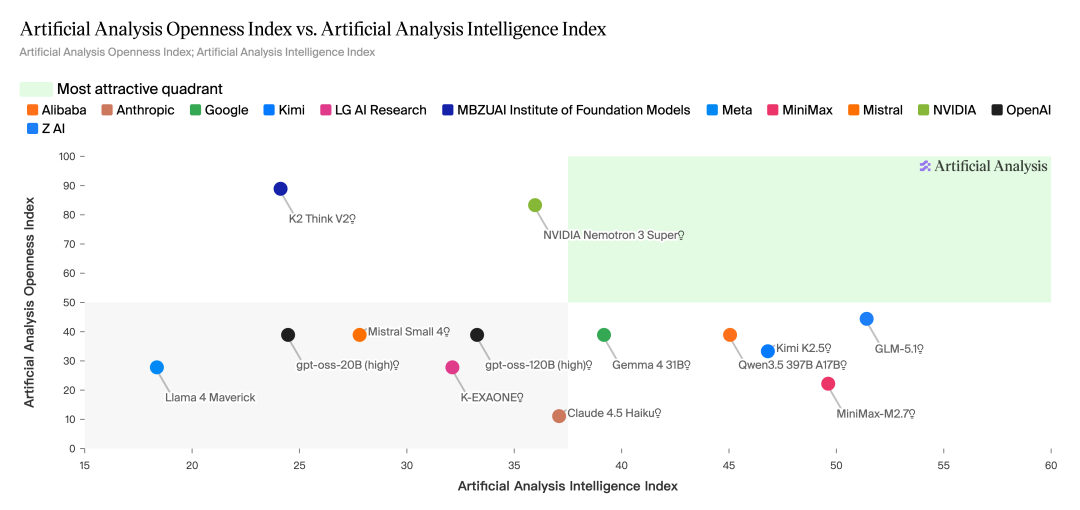

4月14日、第三者テスト機関であるArtificial Analysisは、32バイト未満のオープンソースモデルに関する比較レポートを発表し、以下のことを明らかにした。小型モデルのQwen3.5 27BとGemma 4 31Bは、総合的な知能の面で対応するGPT-5モデルに追いついた。その中で、Qwen3.5 27B(推論バージョン)は知能指数で42点を獲得し、GPT-5(中程度)に匹敵する。Gemma 4 31B(推論バージョン)は39点を獲得し、GPT-5(低程度)と同等の成績を収めた。

このレポートによると、この世代の32Bモデルは推論能力とエージェント性能において著しい改善を示している。Qwen3.5 27Bはエージェントインデックスで55点を獲得し、GPT-5(中級)の46点を上回った。Gemma 4 31BもTerminalBench HardやHLEなどの複雑なタスクにおいてGPT-5(低級)を上回る性能を発揮している。さらに、両モデルともマルチモーダル入力をネイティブにサポートしており、MMMU-Proなどの視覚理解タスクにおいて、同クラスのオープンソースモデルの中でトップクラスの性能を発揮する。

しかし、より小さなモデルは、知識の正確性と錯覚の制御という点で依然として大きく遅れをとっています。2つのモデルはAA-Omniscienceインデックスでそれぞれ-42と-45のスコアを獲得しましたが、GPT-5関連バージョンは-10のスコアを獲得しており、パラメータサイズが知識保持能力に及ぼす影響が依然として大きいことを示しています。

展開レベルでは、これらのモデルの実用性が大幅に向上しました。上記の2つのモデルはどちらも単一のNVIDIA H100で動作し、量子化によって個人用デバイスにローカルで展開できるため、導入のハードルが低くなっています。一方、オープンソースの重み付けコミュニティ全体も急速に最先端に追いついており、GLM-5.1のような大規模モデルは、その差を1桁台のスコアにまで縮めています。

ずっと、開発者が最新のオープンソースモデルを迅速に使い始め、検証できるように、HyperAIは公式ウェブサイトの「チュートリアル」セクションで、人気モデルのオンライン展開ノートブックを継続的に更新しています。この記事では、人工知能分析レポートで紹介されている高品質なオープンソースモデルと、それらをワンクリックで導入できるチュートリアルをまとめています。クローズドソースモデルに匹敵する高性能をぜひご体験ください!

その他のオンラインチュートリアル:

より詳しい情報については、弊社の公式ウェブサイトをご覧ください。

NVIDIA Nemotron-3 Super-120B

NVIDIA Nemotron 3 Super NVFP4は、NVIDIA Corporationによって2026年3月にリリースされました。このモデルは、合計120個のパラメータと12個のアクティベーションパラメータを持つ大規模な言語モデルであり、LatentMoEハイブリッドアーキテクチャを採用し、最大100万トークンのコンテキストをサポートしています。

このモデルは、長文コンテキスト推論、エージェントワークフロー、ツール呼び出し、RAG(応答アルゴリズム)、および高スループットの質問応答を含むシナリオ向けに設計されています。インタラクションに関しては、推論モードの有効化と無効化の両方をサポートしており、標準化されたチャットテンプレートパラメータを使用して、通常の質問応答モードと推論強化モードを切り替えることができます。

オンラインで実行:

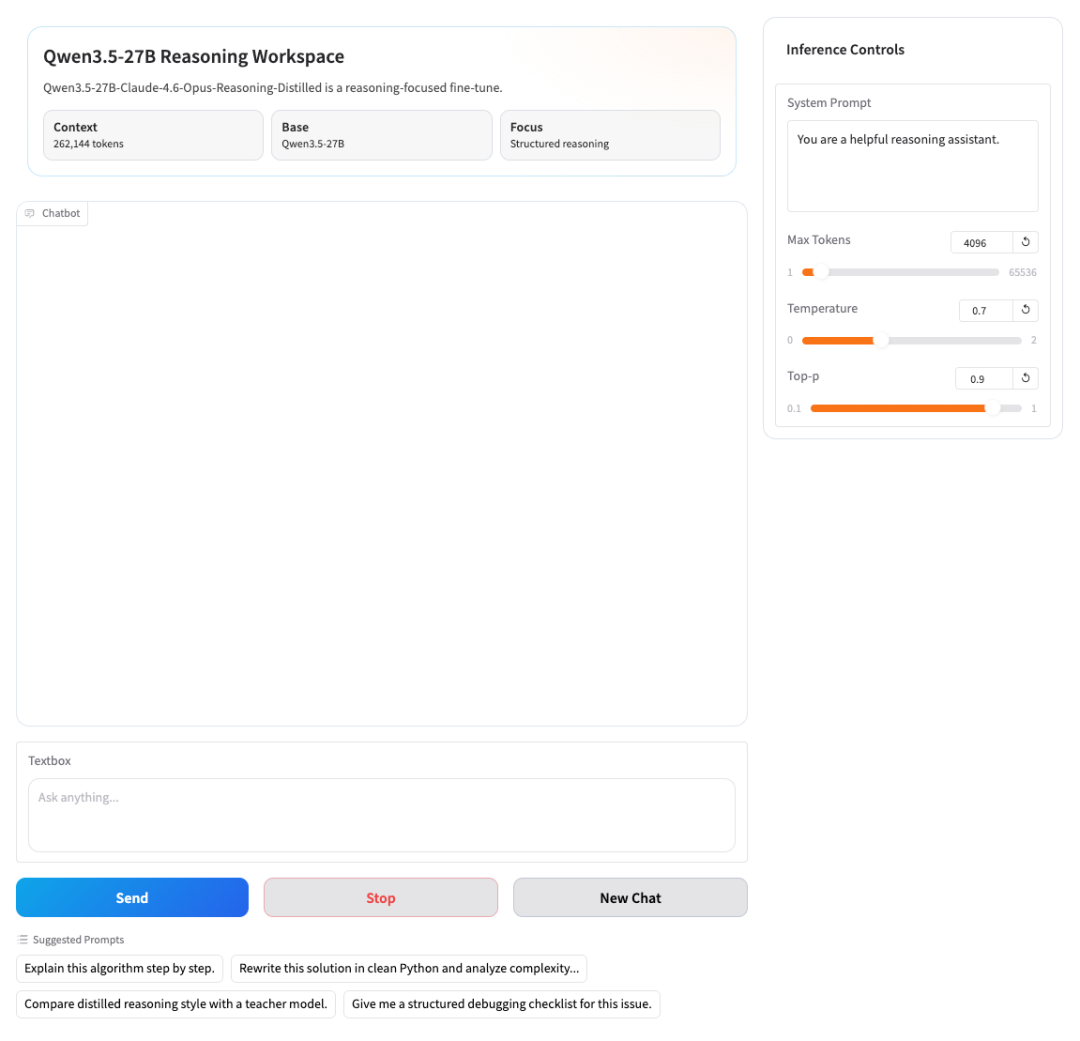

Qwen3.5-27B-Claude-4.6-Opus–推論のエッセンス

2026年3月、Jackrongは高性能推論モデル「Qwen3.5-27B-Claude-4.6-Opus-Reasoning-Distilled」をオープンソース化しました。これはQwen3.5-27Bアーキテクチャをベースに、Claude-4.6とOpusから抽出した高度な推論機能を統合したものです。元の強力な言語理解・表現能力を維持しつつ、複雑な問題解決や複数ターンにわたる対話の性能を大幅に向上させています。

本モデルは、コア機能レベルにおいて、高品質な思考連鎖抽出技術を導入することで推論能力を包括的に向上させ、数学的導出、論理分析、計画立案と意思決定、多段階タスク分解といったシナリオにおいて特に優れた性能を発揮します。従来のモデルと比較して、本システムは単に解答を生成するだけでなく、問題を段階的に構造的に分析し、複雑なタスクを明確かつ実行可能な論理的ステップに分解することで、推論の安定性と結果の信頼性を向上させます。

オンラインで実行:

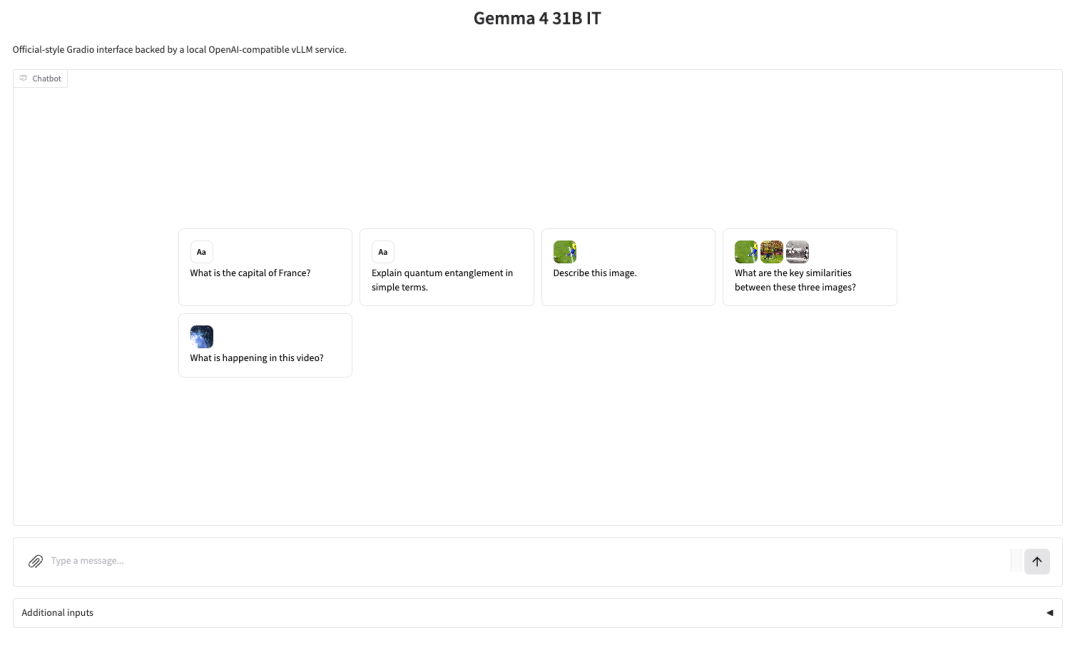

ジェマ-4-31B-it

Google DeepMindのオープンソースモデルであるGemma 4シリーズは、Gemini 3と同じ技術システムに基づいており、Arena AIのリーダーボードでトップ3にランクインしただけでなく、競合製品よりもはるかに小さいパラメータスケールで、より大型のモデルに匹敵、あるいはそれを上回る性能を達成した。

製品形態の観点から見ると、Gemma 4は単一モデルではなく、E2B、E4B、26B、A4Bから31Bまでを網羅するマルチサイズシステムであり、モバイルデバイス、ローカル展開、高性能コンピューティング環境など、さまざまなシナリオに対応しています。中でも、現行シリーズの性能上限である31Bバージョンは、Qwen 3.5 397Bに匹敵する性能レベルを誇ります。

アプリケーションシナリオに関して言えば、バージョン31Bは画像とテキストの入出力に対応し、最大256Kトークンのコンテキストウィンドウを備え、推論、関数呼び出し、システムプロンプトをネイティブにサポートしています。また、140以上の言語に対応しているため、高品質な質問応答、コード支援、エージェントサービスなどのシナリオで優れたパフォーマンスを発揮します。

オンラインで実行:

CPU展開 Qwen3.5-9B-GGUF

Qwen3.5は、アリババ傘下の同義千文チームがリリースした、新世代のマルチモーダル大規模言語モデルシリーズです。テキストと画像の入力をサポートし、テキストを出力します。対話、推論、プログラミング、視覚理解などのタスクを対象としています。中でもQwen3.5-9Bは、このシリーズの9Bパラメータバージョンであり、機能と導入コストのバランスが取れており、リソースが限られた環境におけるエッジ環境やローカル環境での推論に適しています。

このチュートリアルでは、コミュニティが提供するGGUF重み(Q4_K_M量子化バージョン)を使用し、ビジュアルエンコーダー(mmproj GGUFファイル)と組み合わせます。llama.cppを介してOpenAIインターフェースと互換性のあるバックエンドサービスを起動し、OpenWebUIに接続してブラウザベースのインタラクティブなインターフェースを提供します。

オンラインで実行:

その他の人気チュートリアルはこちら: