Command Palette

Search for a command to run...

オンラインチュートリアル | CVPR 2025のベストペーパーを受賞したユニバーサル3DビジョンモデルVGGT推論速度は数秒に達する

6月13日、世界三大コンピュータビジョンカンファレンスの一つであるCVPR 2025が最優秀論文賞を発表しました。公式データによると、CVPR 2025には4万人以上の著者から13,008件の論文が提出され、昨年比で13%増加しました。会議では最終的に 2,872 件の論文が採択され、全体の採択率は約 22.1% でした。

最終的に選ばれた約3,000本の論文の中から、わずか1本だけが「最優秀論文」の称号を獲得しました。その価値は想像に難くありません。この成果は、オックスフォード大学とMeta AIが共同で提案した純粋なフィードフォワードTransformerアーキテクチャに基づく汎用3DビジョンモデルVGGTです。このモデルは、単一のタスクに制限されていた以前のモデルの課題を打破し、カメラ パラメータ、ポイント マップ、深度マップ、3D ポイント トラックなど、1 つ、複数、または数百の視点からシーンのすべての主要な 3D プロパティを直接推測できます。

* 論文タイトル:「VGGT: ビジュアルジオメトリ接地変圧器」

* 論文リンク:https://go.hyper.ai/Nmgxd

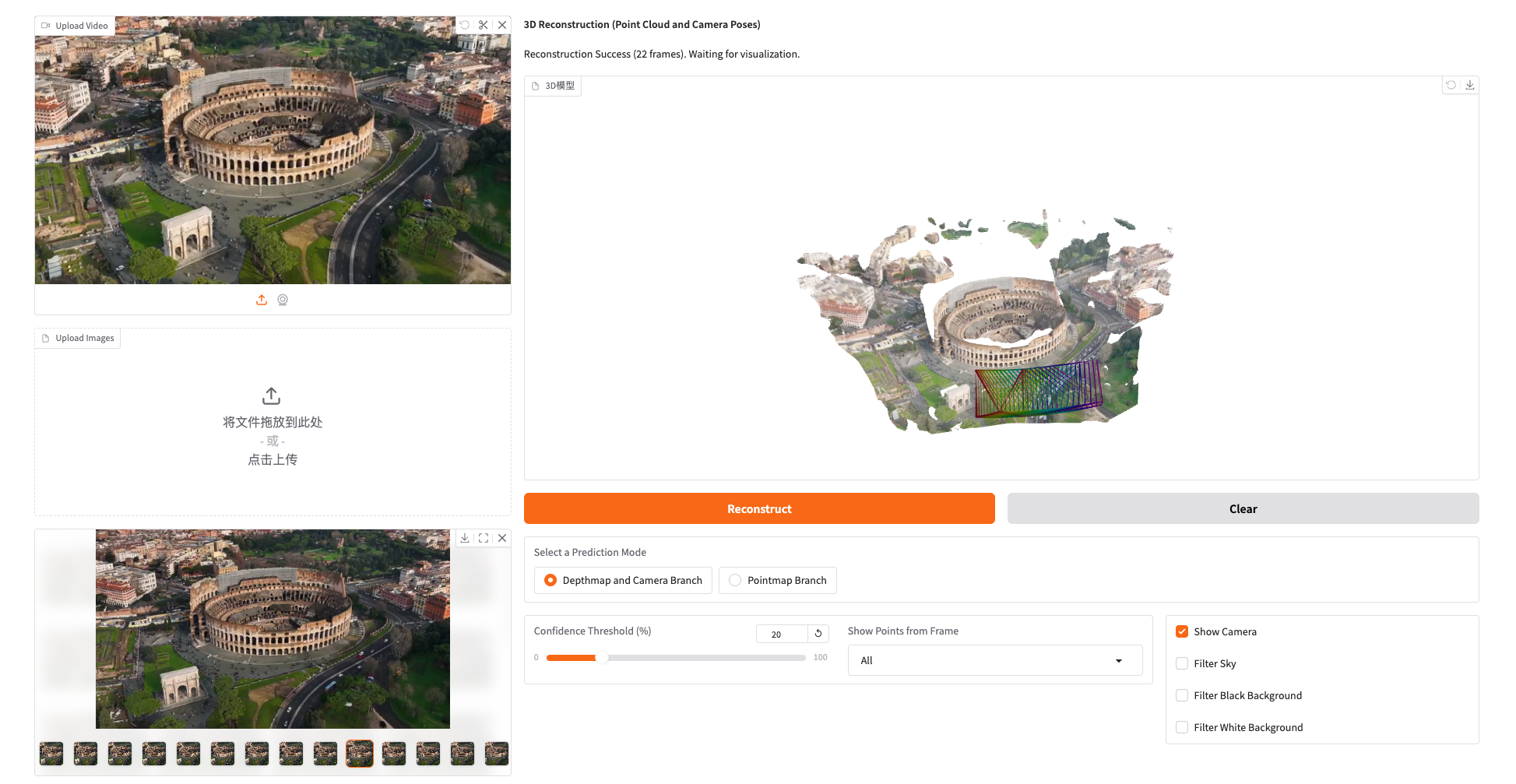

さらに重要なのは、この方法はシンプルで効率的であるということです。1秒以内に画像再構成を完了できます。VGGTの性能は、視覚的ジオメトリ最適化後処理技術に依存する他の手法を上回っています。実験結果によると、VGGTはカメラパラメータ推定、多視点深度推定、高密度点群再構成、3D点追跡など、複数の3DタスクにおいてSOTAレベルの性能を達成しています。

現在のところ、HyperAI Hyper.ai のチュートリアル セクションで、「VGGT: ユニバーサル 3D ビジョン モデル」がリリースされました。ワンクリック展開体験効果をサポートし、この画期的な製品の強力な威力をぜひ体感してください⬇️

* チュートリアルリンク:https://go.hyper.ai/GX3bC

デモの実行

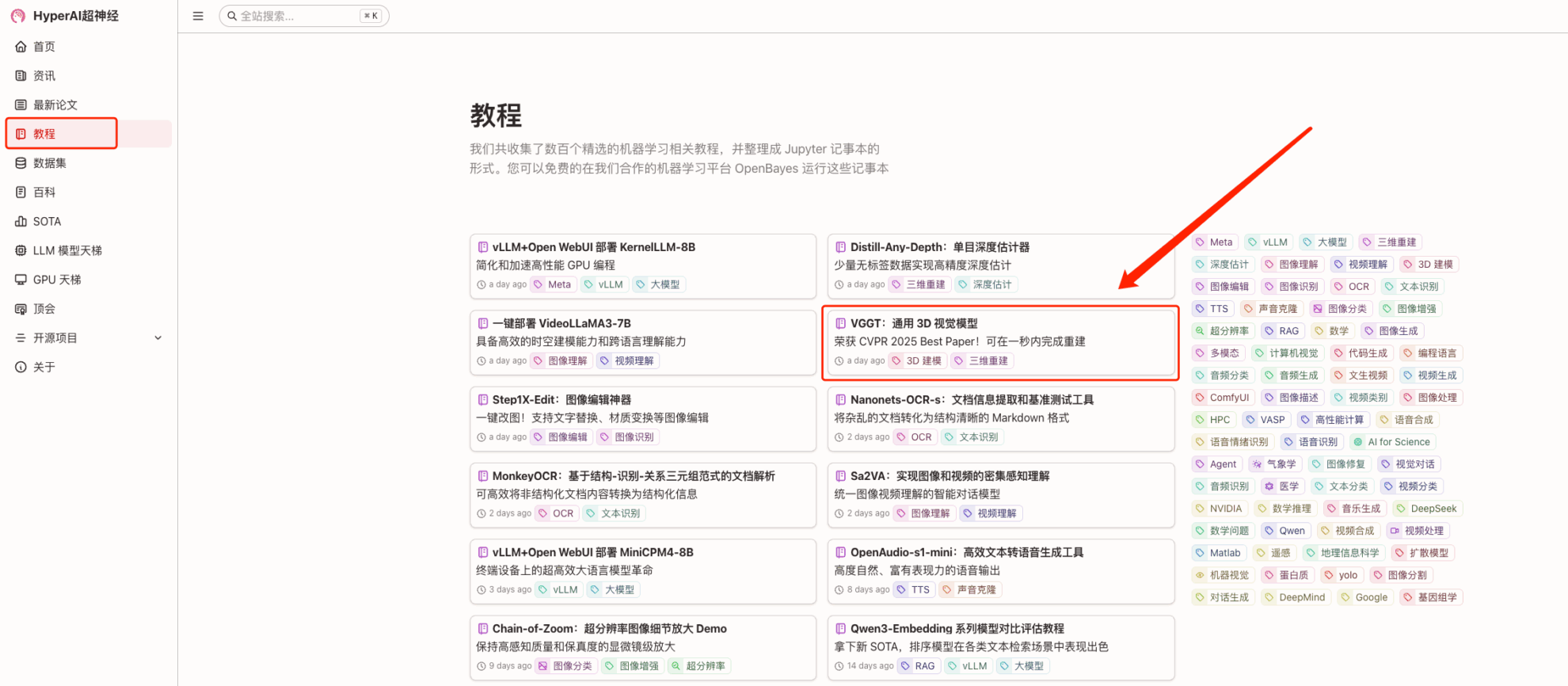

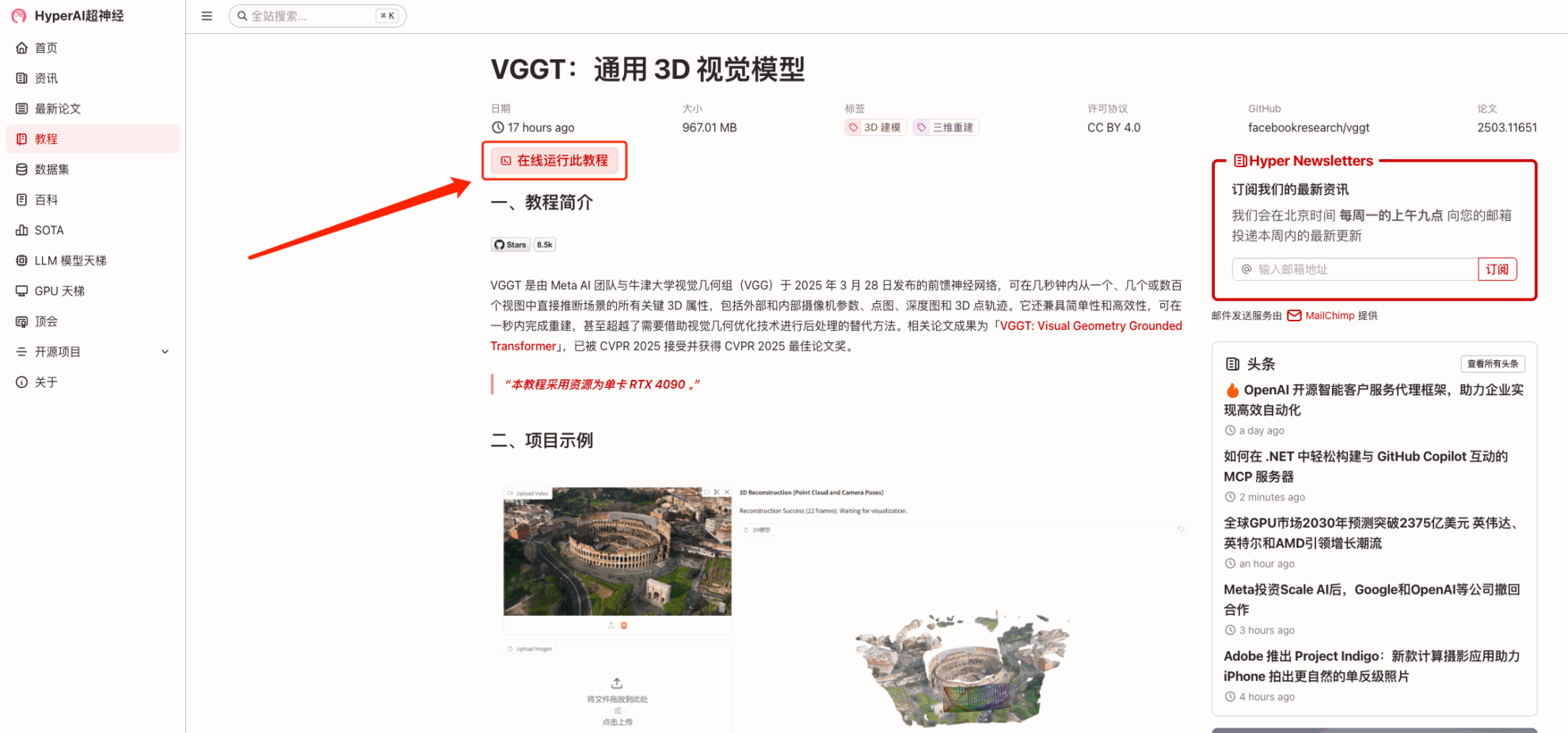

1. hyper.ai ホームページにアクセス後、「チュートリアル」ページを選択し、「VGGT: 一般的な 3D ビジョン モデル」を選択して、「このチュートリアルをオンラインで実行」をクリックします。

2. ページがジャンプしたら、右上隅の「クローン」をクリックしてチュートリアルを独自のコンテナにクローンします。

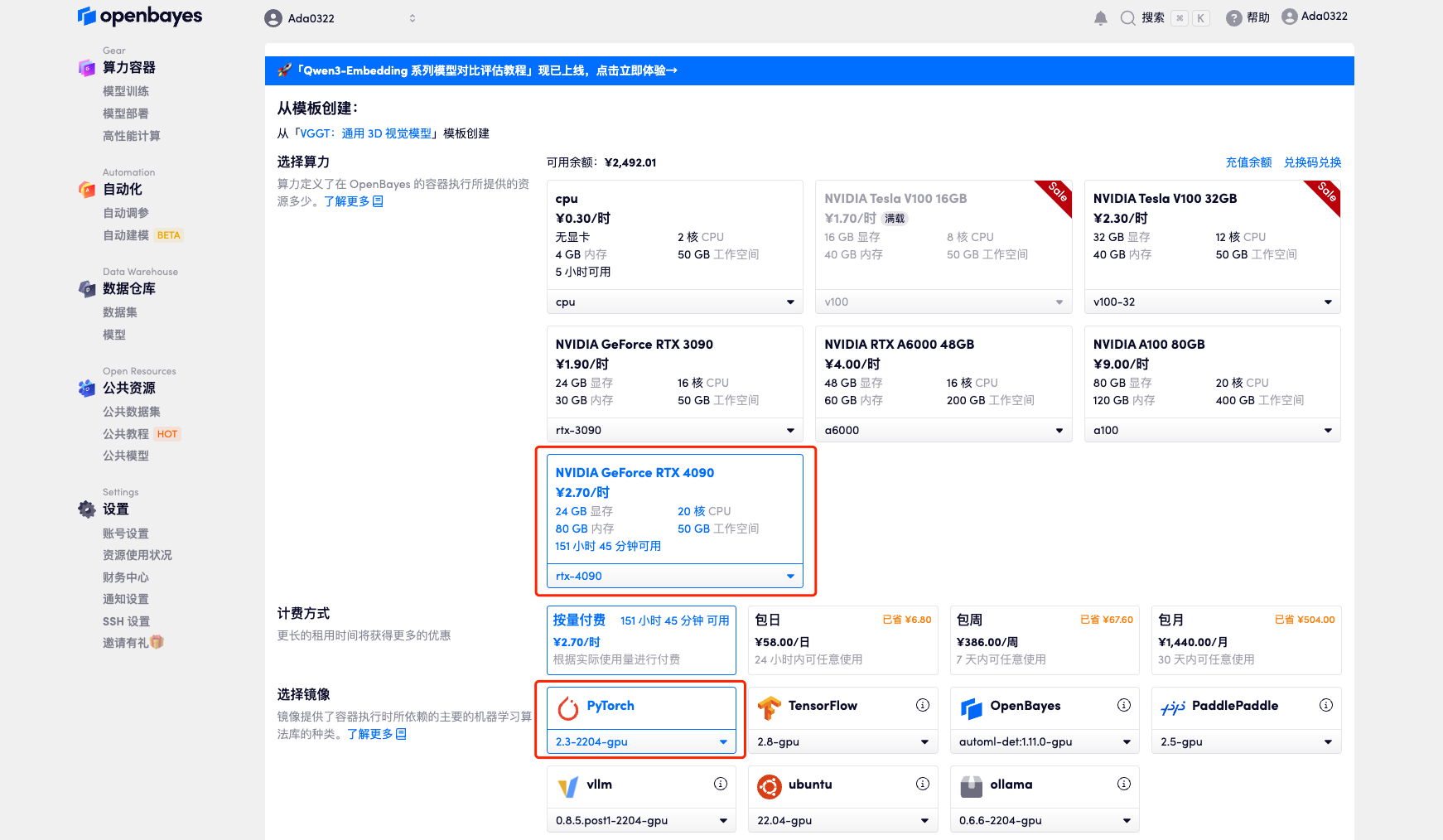

3. 「NVIDIA RTX 4090」と「PyTorch」のイメージを選択してください。OpenBayesプラットフォームでは4つの課金方法をご用意しています。ニーズに合わせて「従量課金制」または「日/週/月単位の課金」をお選びいただけます。「続行」をクリックしてください。新規ユーザーは、以下の招待リンクから登録すると、RTX 4090 4時間分とCPUフリータイム5時間分がプレゼントされます。

HyperAI ハイパーニューラルの専用招待リンク (ブラウザに直接コピーして開きます):

https://openbayes.com/console/signup?r=Ada0322_NR0n

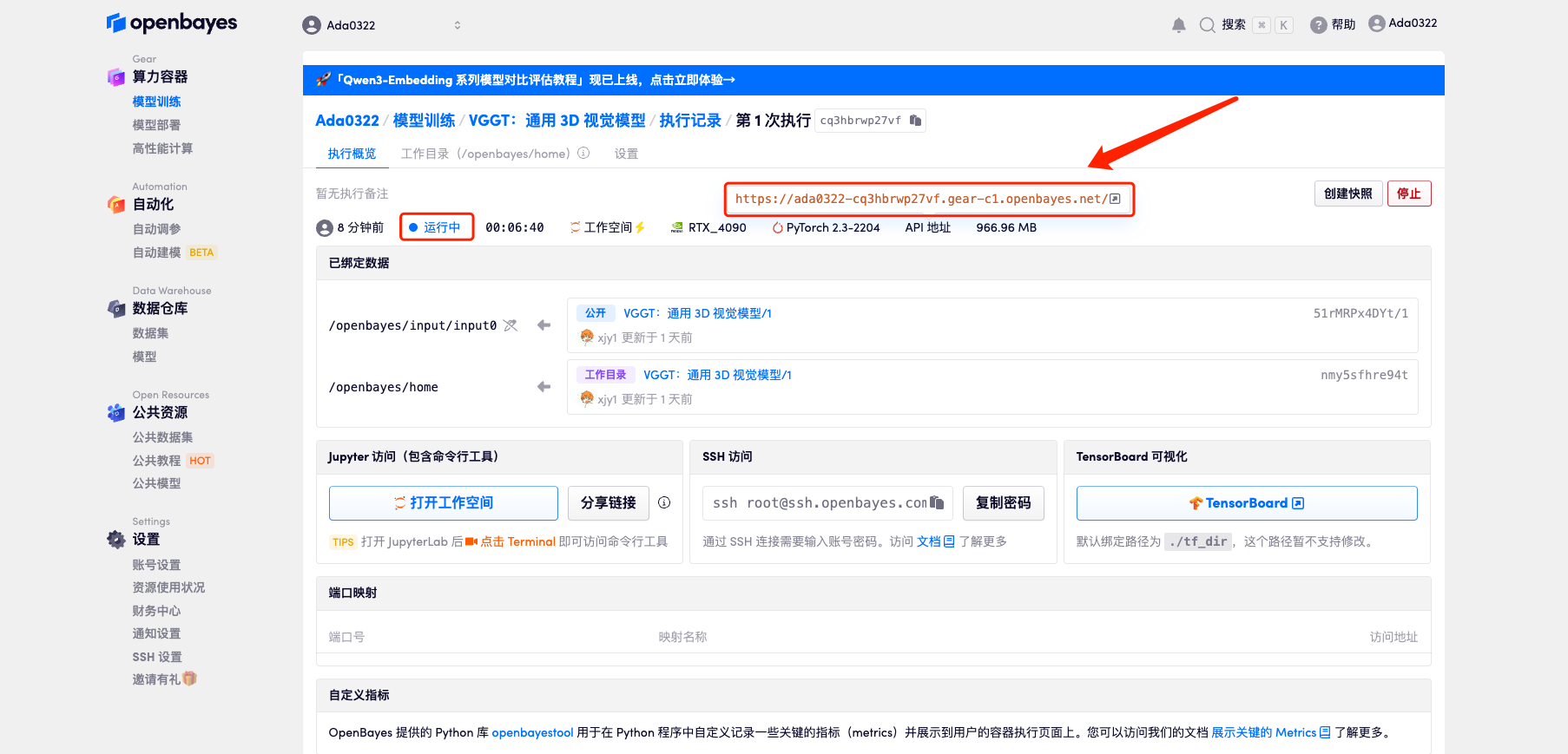

4. リソースが割り当てられるのを待ちます。最初のクローン作成プロセスには約 2 分かかります。ステータスが「実行中」に変わったら、「API アドレス」の横にあるジャンプ矢印をクリックしてデモ ページに移動します。モデルが大きいため、WebUI インターフェイスが表示されるまでに約 3 分かかります。そうでない場合は、「Bad Gateway」と表示されます。 APIアドレスアクセス機能を使用する前に、ユーザーは実名認証を完了する必要がありますのでご注意ください。

効果実証

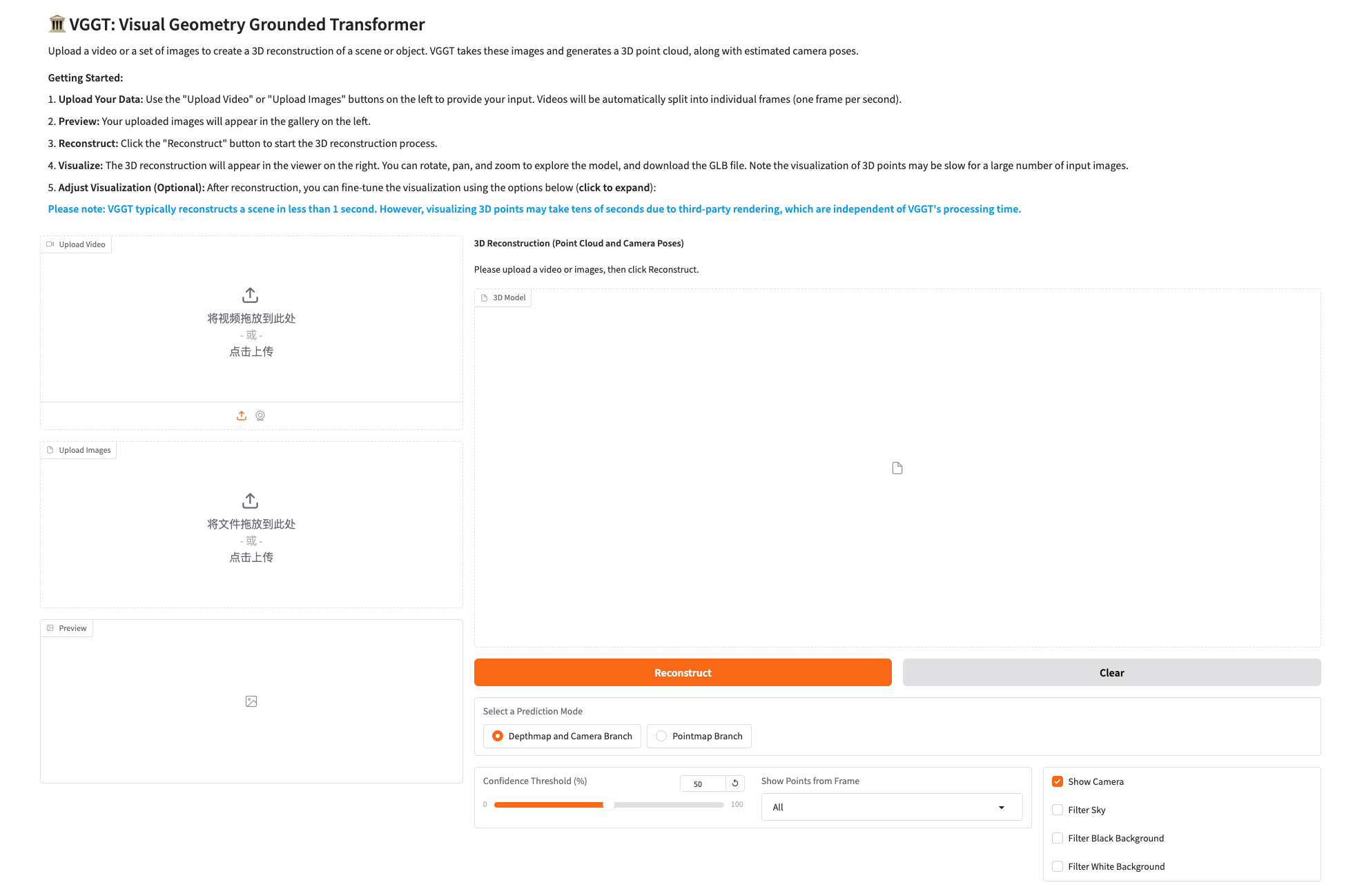

1. API アドレスをクリックしてデモ ページに入り、以下に示すようにモデルを体験します。

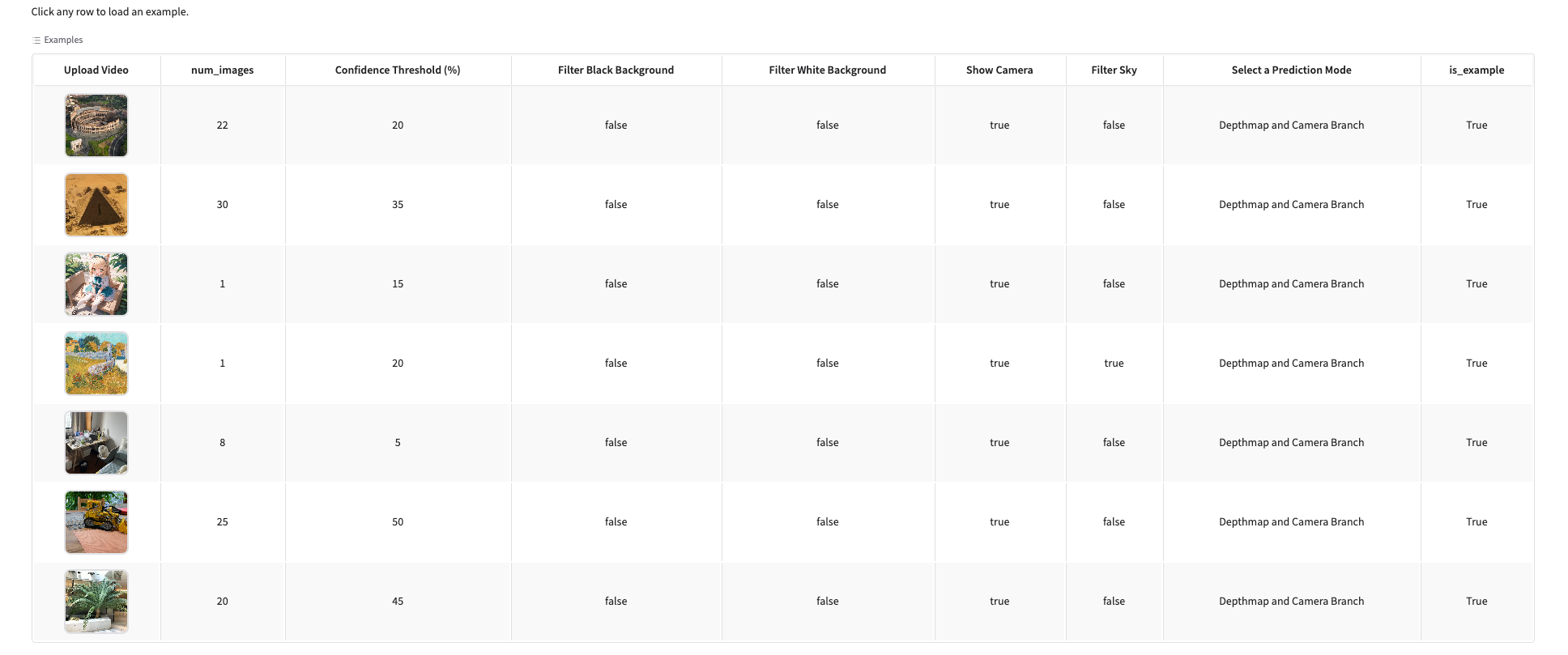

2. チュートリアルにはサンプルをご用意しています。以下に示すように、サンプルをクリックすると、モデルの効果を直接体験できます。

これは今回の号のおすすめチュートリアルです。ぜひ皆さんも試してみてください⬇️

* チュートリアルリンク:https://go.hyper.ai/GX3bC