Command Palette

Search for a command to run...

Tutoriel En Ligne | Basé Sur 5 Millions d'heures De Données Vocales, Qwen3-TTS Réalise Un Clonage Vocal Et Un Réglage Précis En 3 secondes.

Lorsque l'IA générative ne se limite plus à la simple « génération de texte » mais commence à véritablement « parler », la parole passe d'un canal d'information à un moyen d'expression programmable et malléable. De la création de contenu multilingue aux assistants vocaux en temps réel, des points d'ancrage virtuels aux systèmes interactifs immersifs, la synthèse vocale (TTS) devient un élément central du modèle multimodal.Cependant, pour que la machine parle de manière naturelle, stable et contrôlable, et qu'elle maintienne un temps de réponse de l'ordre de la milliseconde dans des scénarios de diffusion en continu, elle nécessite non seulement des capacités de modélisation acoustique, mais aussi une grande expertise en matière de conception architecturale et d'optimisation du système.

Tout au long de cette évolution technologique, la nouvelle génération de modèles a commencé à tenter de dépasser les limites de la synthèse vocale traditionnelle, en recherchant non seulement une fidélité plus élevée, mais aussi en mettant l'accent sur la capacité de généralisation multilingue et la capacité de contrôle précis.Qwen3-TTS, récemment mis en open source par l'équipe Qwen, est basé sur une architecture de modèle de langage (LM) à double voie, qui permet un contrôle précis de la parole de sortie tout en effectuant une synthèse vocale en temps réel.

Plus précisément, Qwen3-TTS prend en charge le clonage vocal de 3 secondes et la commande vocale basée sur la description. Il est entraîné sur plus de 5 millions d'heures de données vocales couvrant 10 langues et est équipé de deux analyseurs vocaux.

* Qwen-TTS-Tokenizer-25Hz :Utilisant un codec à livre de codes unique, il se concentre sur la représentation du contenu sémantique, peut être intégré de manière transparente avec Qwen-Audio et réalise la reconstruction de la forme d'onde en flux continu grâce à la technologie DiT par blocs.

* Qwen-TTS-Tokenizer-12Hz :Grâce à une compression de débit binaire extrême et une sortie de flux à latence ultra-faible, basée sur une conception multi-codebook à 16 couches de 12,5 Hz et un réseau convolutif causal léger (causal ConvNet), il peut atteindre une sortie instantanée du premier paquet en 97 millisecondes.

De nombreux résultats expérimentaux montrent que cette série de modèles a atteint des performances de pointe (SOTA) dans de multiples tests de référence objectifs et subjectifs, y compris l'ensemble de tests multilingues TTS et InstructTTSEval.

La démo « Qwen3-TTS : Synthèse vocale multilingue contrôlable de haute qualité » est désormais disponible dans la section « Tutoriels » du site web HyperAI. Venez découvrir la synthèse vocale en 3 secondes !

Tutoriels en ligne :

Voir le document :

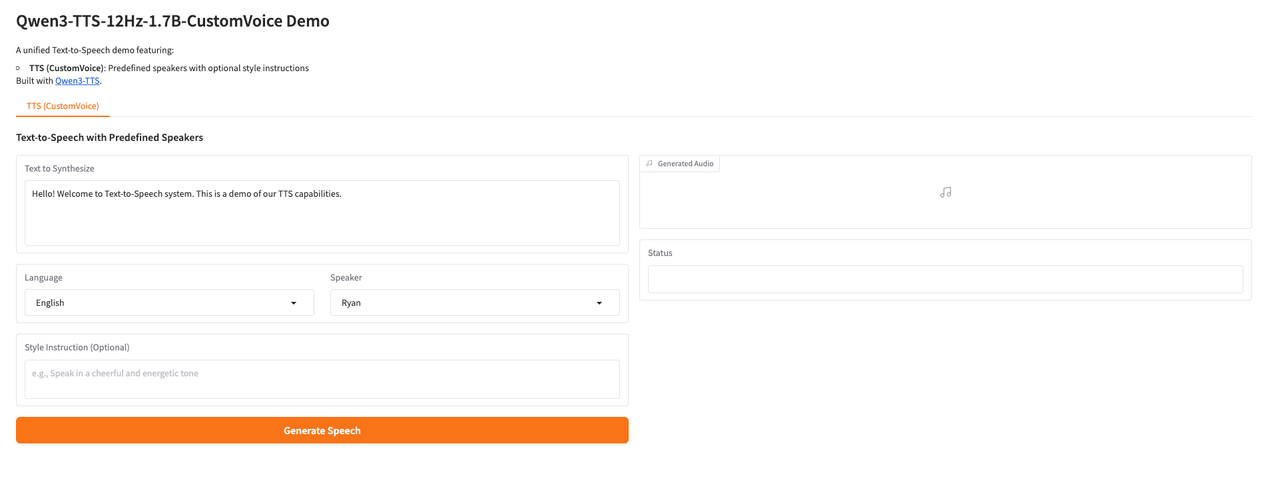

Essai de démonstration

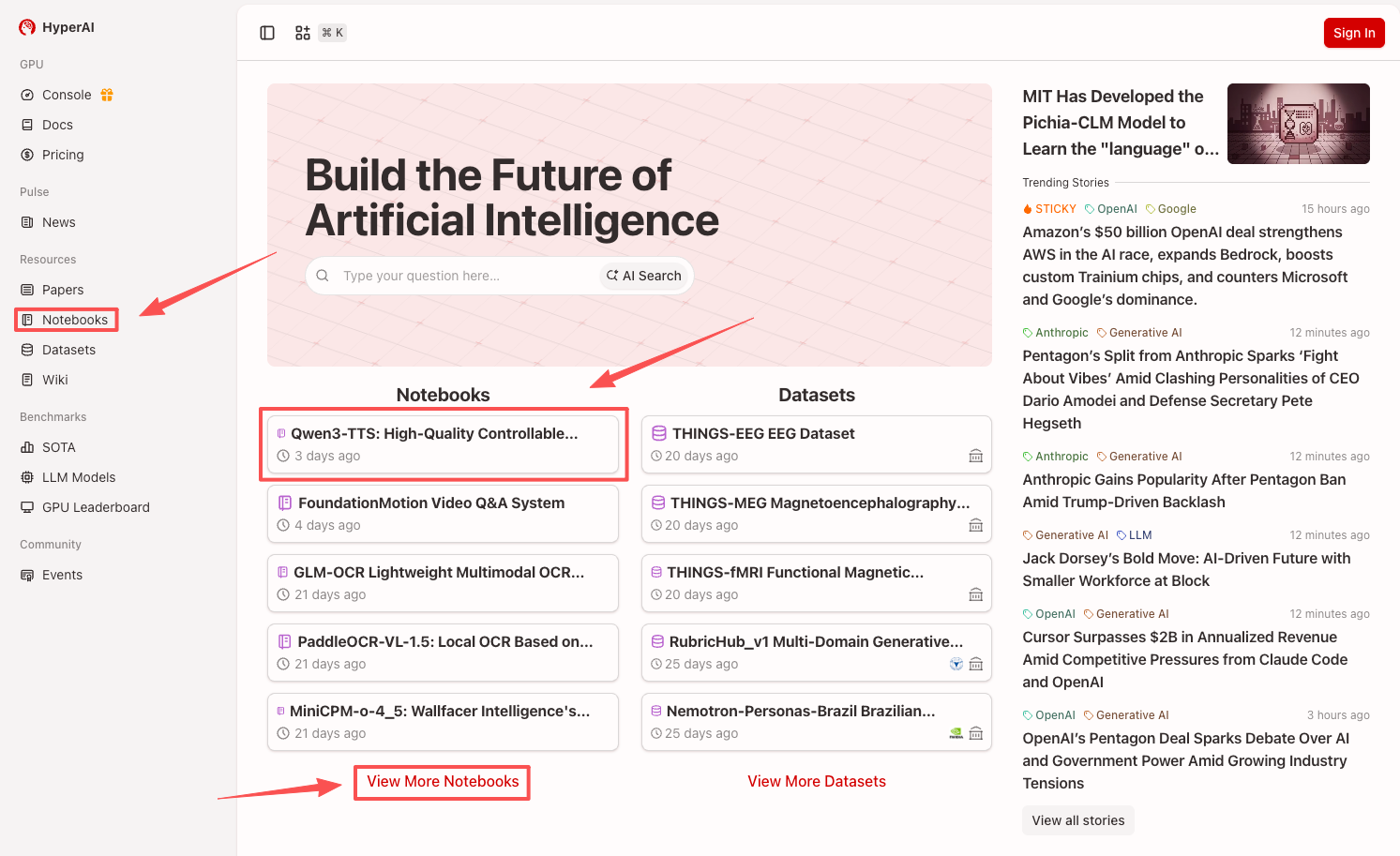

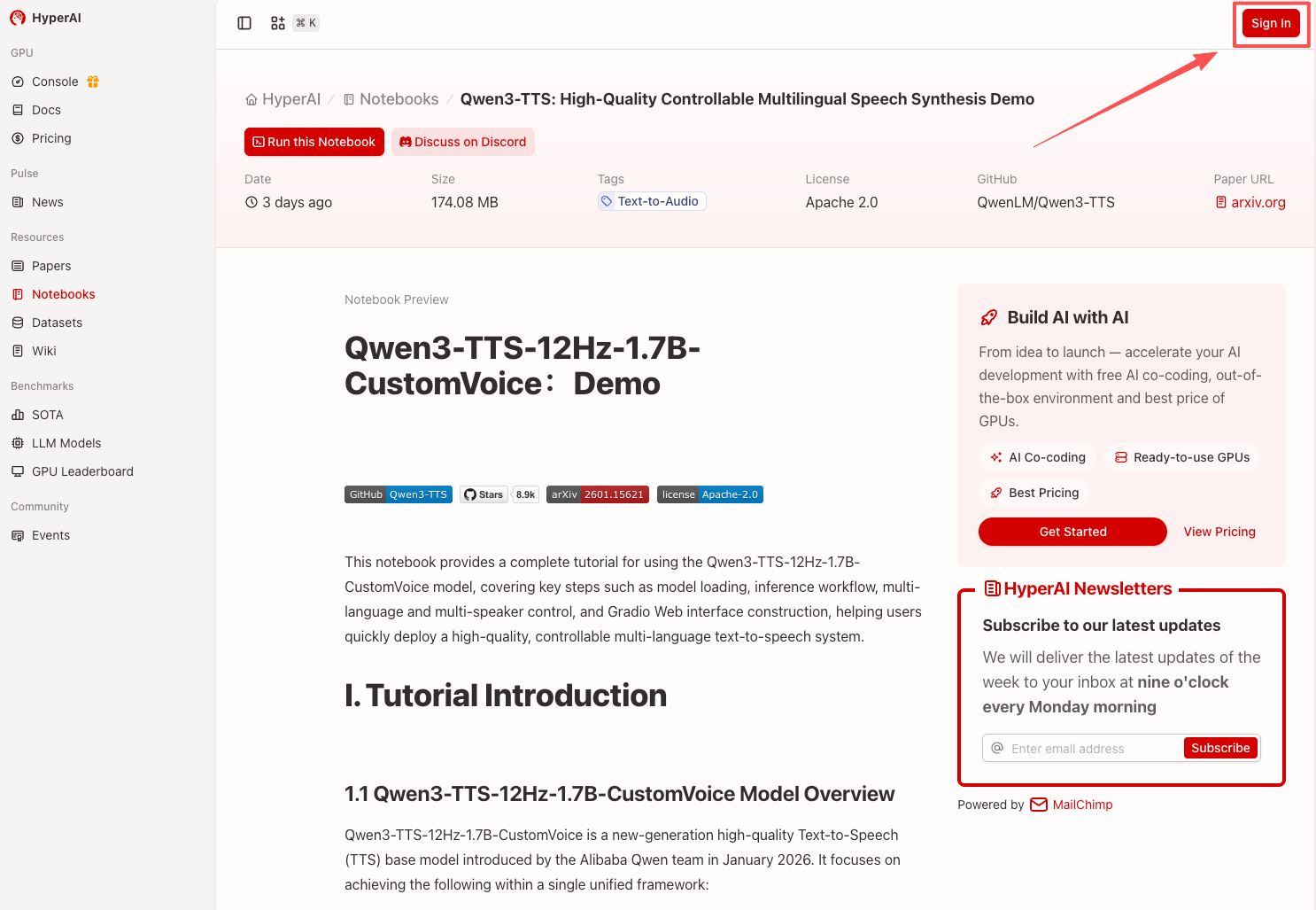

1. Après avoir accédé à la page d'accueil d'hyper.ai, sélectionnez la page « Tutoriels » ou cliquez sur « Voir plus de tutoriels », sélectionnez « Qwen3-TTS : Démo de synthèse vocale multilingue contrôlable de haute qualité » et cliquez sur « Exécuter ce tutoriel en ligne ».

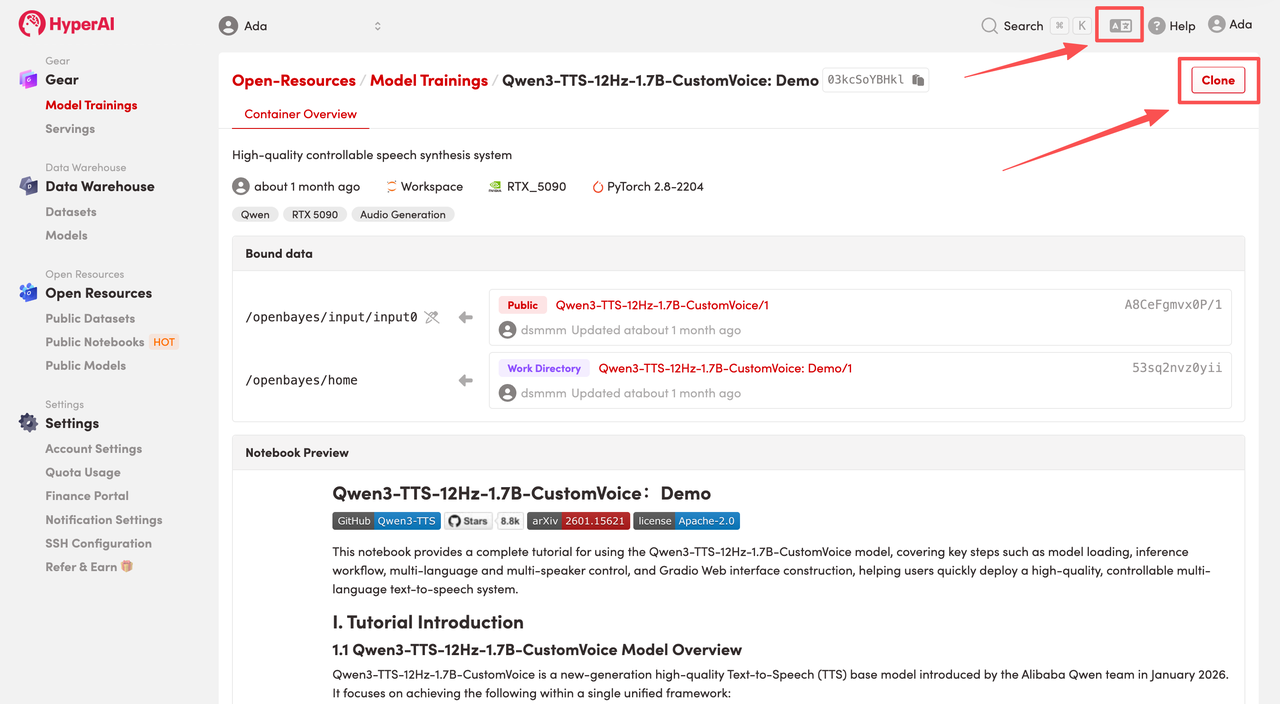

2. Une fois la page redirigée, cliquez sur « Cloner » en haut à droite pour cloner le tutoriel dans votre propre conteneur.

Remarque : Vous pouvez changer de langue en haut à droite de la page. Actuellement, le chinois et l’anglais sont disponibles. Ce tutoriel présente les étapes en anglais.

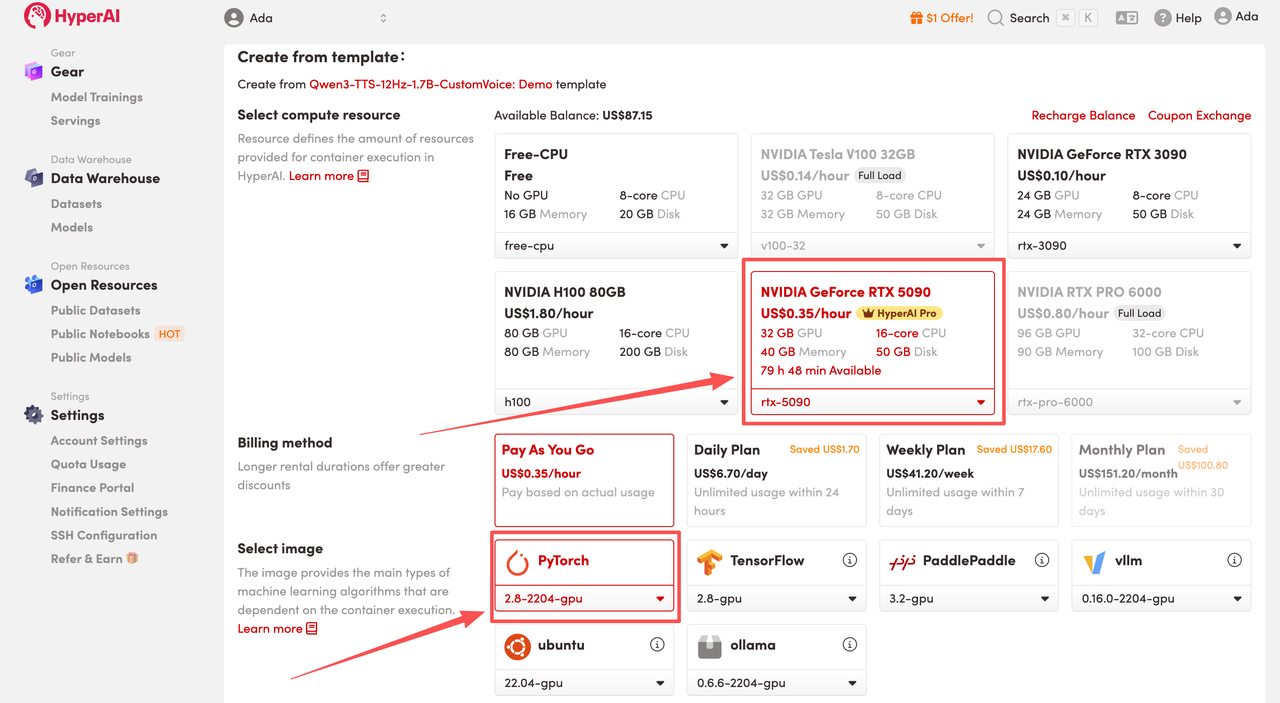

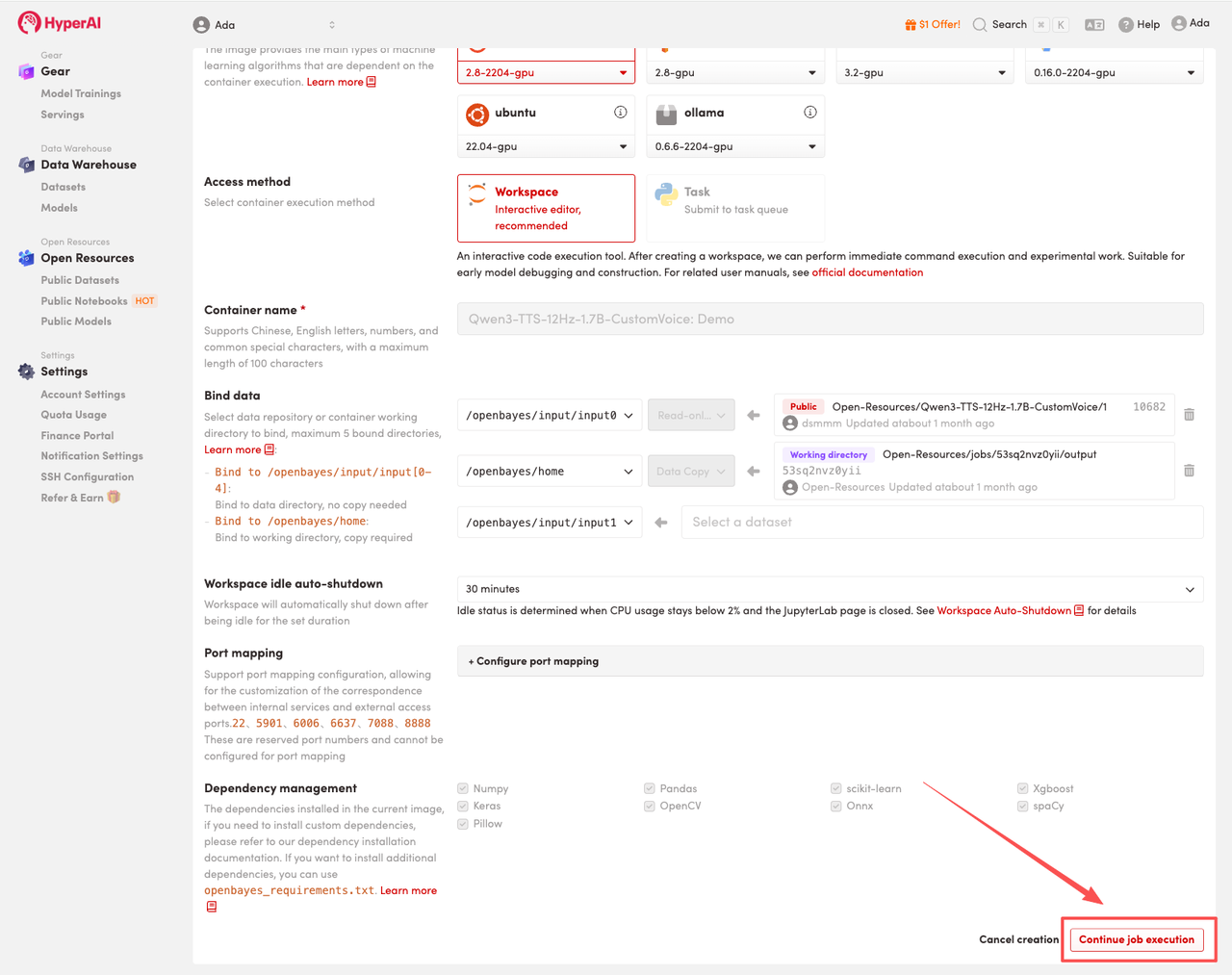

3. Sélectionnez les images « NVIDIA GeForce RTX 5090 » et « PyTorch », puis choisissez « Pay As You Go » ou « Daily Plan/Weekly Plan/Monthly Plan » selon vos besoins, puis cliquez sur « Continuer l’exécution de la tâche ».

HyperAI offre des avantages à l'inscription pour les nouveaux utilisateurs.Pour seulement $1, vous pouvez obtenir 20 heures de puissance de calcul RTX 5090 (prix d'origine $7).La ressource est valide en permanence.

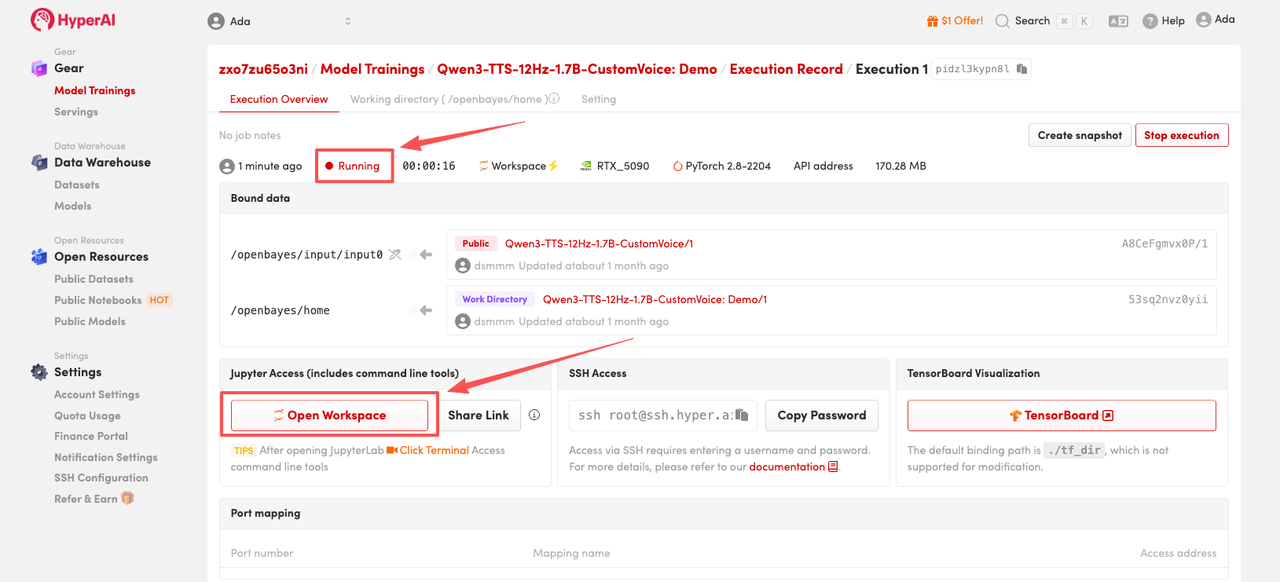

4. Attendez que les ressources soient allouées. Une fois que le statut passe à « En cours d'exécution », cliquez sur « Ouvrir l'espace de travail » pour accéder à l'espace de travail Jupyter.

Démonstration d'effet

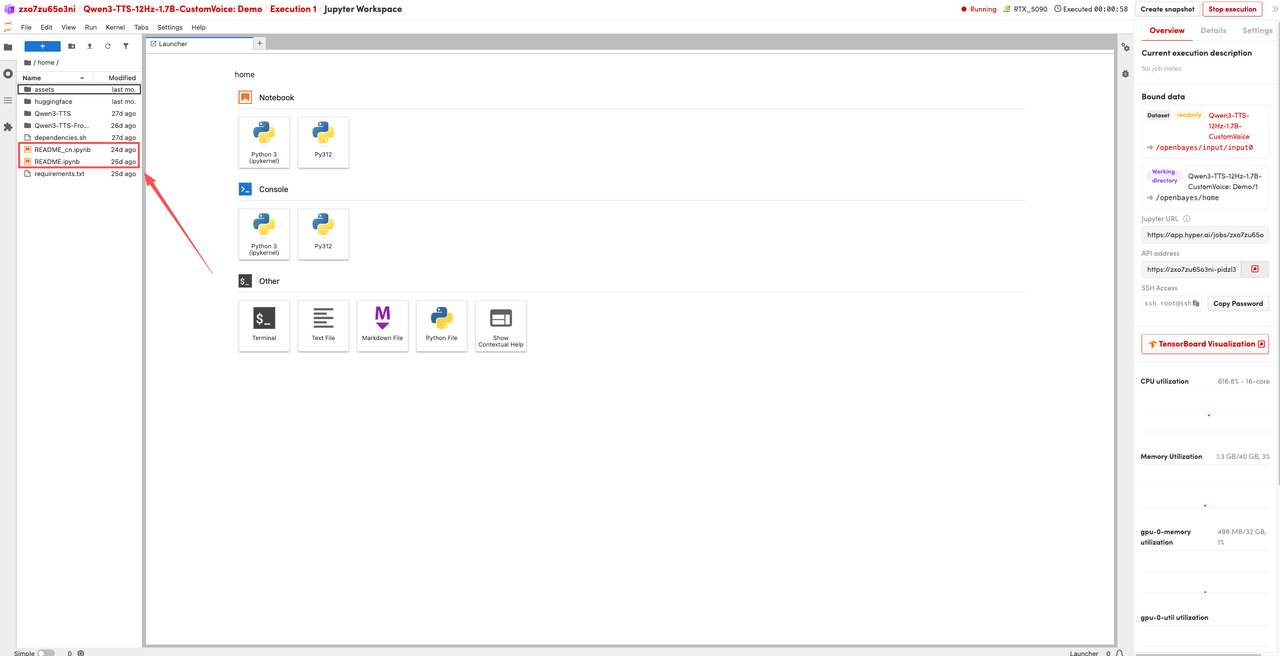

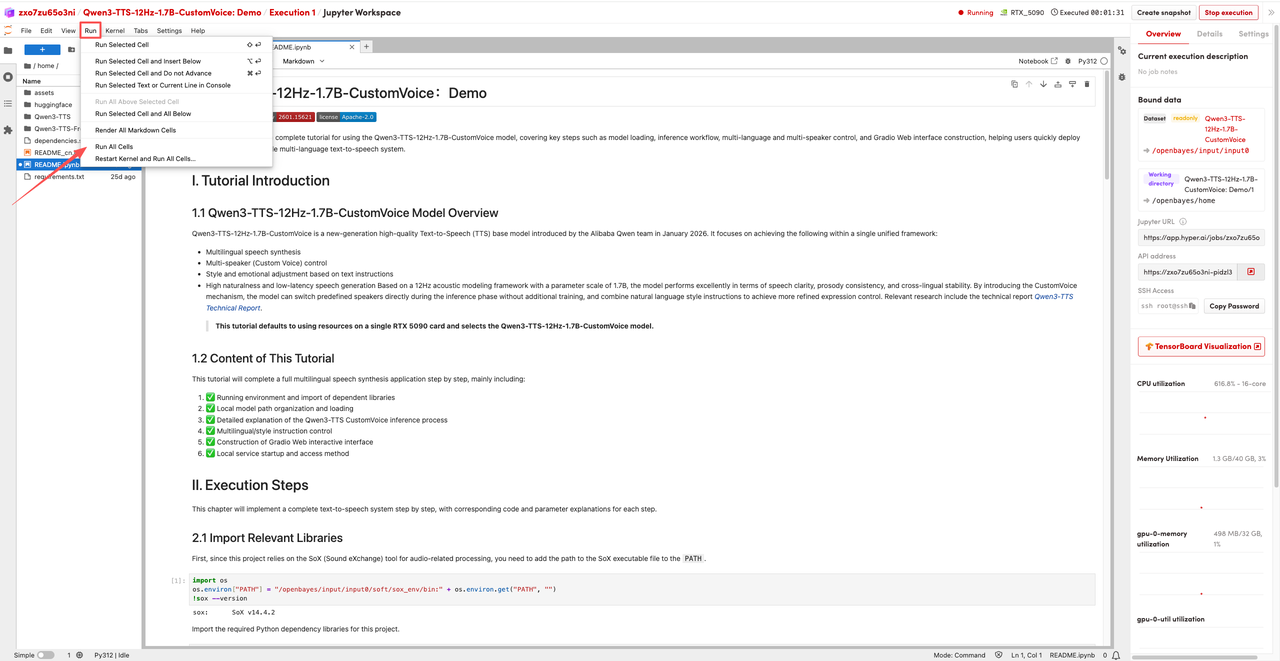

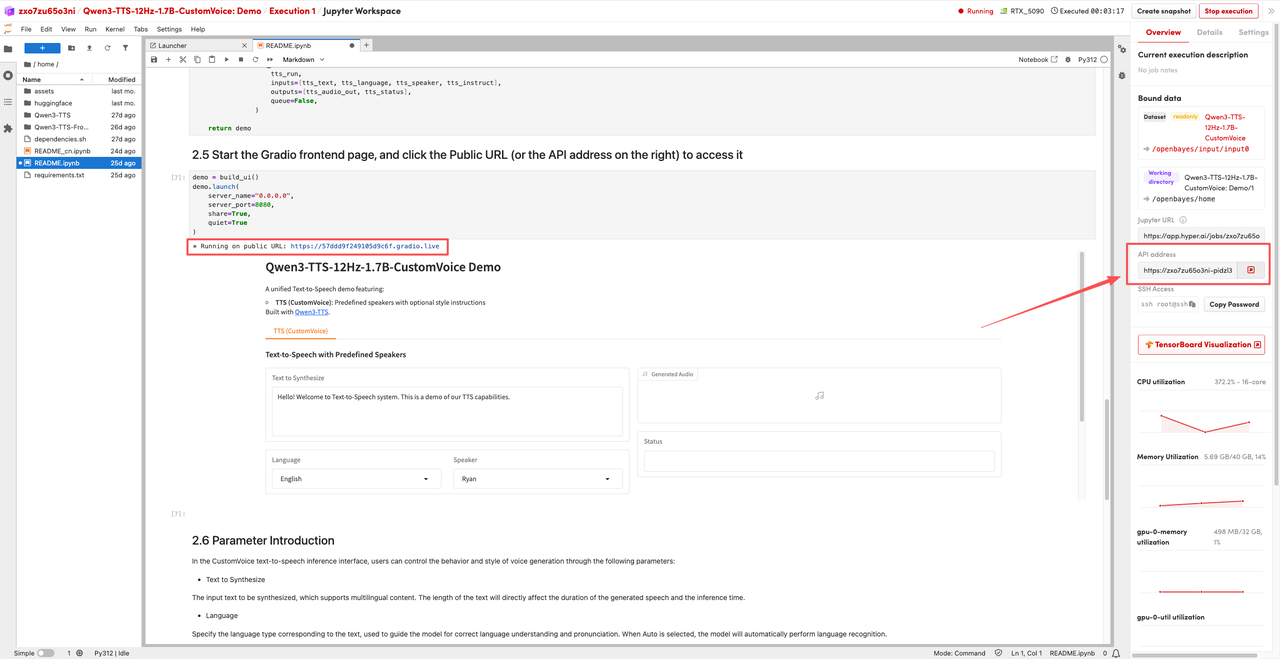

1. Une fois la page redirigée, cliquez sur le fichier README à gauche, puis sur « Exécuter » en haut.

2. Une fois le processus terminé, cliquez sur l'adresse API à droite pour accéder à la page de démonstration.

Le tutoriel ci-dessus est celui recommandé par HyperAI cette fois-ci. Bienvenue à tous pour le découvrir !

Lien du tutoriel :https://go.hyper.ai/1xEOr