Command Palette

Search for a command to run...

Google Publie Le Framework HEAL, 4 Étapes Pour Évaluer Si Les Outils d'IA Médicale Sont Équitables

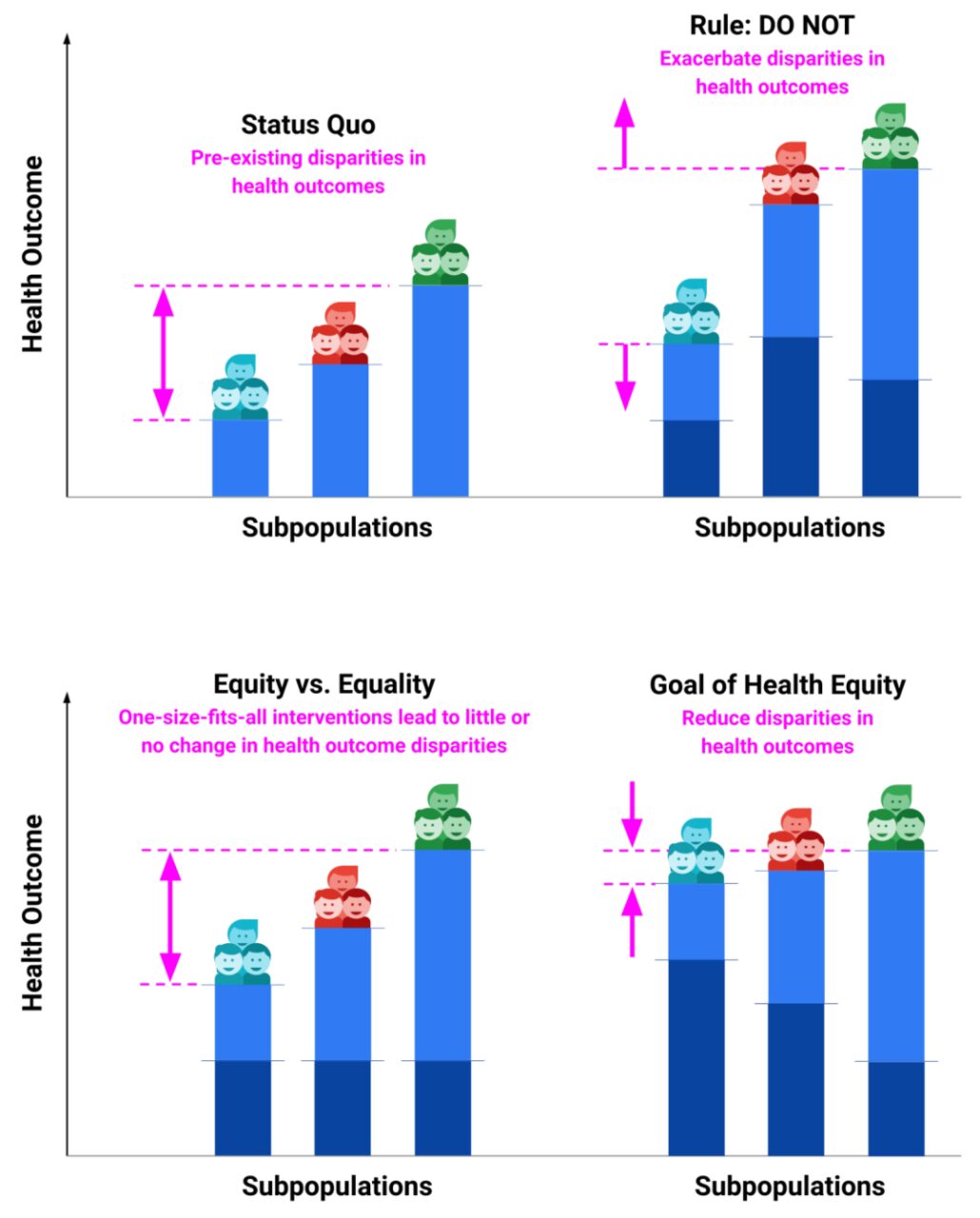

Si vous imaginez le maintien d’un état de santé comme une course, tout le monde ne peut pas partir de la même ligne de départ. Certaines personnes peuvent courir sans problème jusqu’au bout, et d’autres peuvent obtenir de l’aide immédiatement même si elles tombent. Cependant, certaines personnes peuvent être confrontées à davantage d’obstacles en raison de leurs conditions économiques, de leur lieu de résidence, de leur niveau d’éducation, de leur race ou d’autres facteurs.

« L’équité en santé » signifie que chacun devrait avoir un accès égal aux ressources de soins de santé afin de pouvoir terminer cette course plus sereinement et atteindre une santé optimale.Le traitement injuste de certains groupes (tels que les minorités, les personnes à faible statut socio-économique ou les personnes ayant un accès limité aux soins de santé) en matière de prévention, de diagnostic et de traitement des maladies peut grandement affecter leur qualité de vie et leurs chances de survie. Il ne fait aucun doute qu’une attention accrue à « l’équité en matière de santé » devrait devenir un consensus mondial afin de mieux s’attaquer aux causes profondes des inégalités.

De nos jours, bien que l’apprentissage automatique, l’apprentissage profond, etc. aient « réalisé quelques progrès » dans le domaine de la santé médicale, ils sont même sortis du laboratoire et sont passés à la ligne de front clinique. Lorsqu’on s’émerveille des puissantes capacités de l’IA, les gens devraient-ils prêter davantage attention à la question de savoir si l’application pratique de ce type de technologie émergente va exacerber l’inégalité des ressources en matière de santé ?

*Les barres bleu clair indiquent les problèmes de santé préexistants

* Les barres bleu foncé illustrent l’impact des interventions sur les résultats de santé préexistants

À cette fin, l’équipe de Google a développé le cadre HEAL (The health equity framework), qui permet d’évaluer quantitativement si les solutions de soins de santé basées sur l’apprentissage automatique sont « équitables ».Grâce à cette approche, l’équipe de recherche cherche à garantir que les technologies de santé émergentes réduisent efficacement les inégalités en matière de santé, plutôt que de les exacerber par inadvertance.

Cadre HEAL : 4 étapes pour évaluer l'équité des outils d'IA en dermatologie

Le cadre HEAL comprend 4 étapes :

- Identifier les facteurs associés aux inégalités en matière de santé et définir les indicateurs de performance des outils d'IA

- Identifier et quantifier les disparités de santé préexistantes

- Tests de performance des outils d'IA

- Mesurer le potentiel des outils d'IA pour prioriser les disparités en matière d'équité en santé

Étape 1 : Identifier les facteurs associés aux inégalités de santé en dermatologie et identifier les indicateurs permettant d'évaluer les performances des outils d'IA

Les chercheurs ont sélectionné les facteurs suivants - âge, sexe, race/origine ethnique et type de peau Fitzpatrick (FST) - en examinant la littérature et en tenant compte de la disponibilité des données.

Le FST est un système de classification de la peau humaine en fonction de sa réponse aux rayons ultraviolets (UV), en particulier aux coups de soleil et au bronzage. Allant du FST I au FST VI, chaque type représente un niveau différent de production de mélanine dans la peau, les yeux et les cheveux, ainsi qu'une sensibilité aux rayons UV.

De plus, les chercheurs ont choisi l'accord top-3 comme mesure pour évaluer les performances de l'outil d'IA, qui est défini comme la proportion de cas dans lesquels au moins une des trois principales conditions suggérées par l'IA correspondait au diagnostic de référence du panel d'experts en dermatologie.

Étape 2 : Identifier les « disparités de santé » existantes en dermatologie

Les indicateurs de disparité en matière de santé sont des mesures spécifiques utilisées pour quantifier et décrire l’inégalité de l’état de santé entre différents groupes. Ces groupes sont différenciés en fonction de la race, du statut économique, de la situation géographique, du sexe, de l’âge, du statut de handicap ou d’autres déterminants sociaux.

Voici quelques indicateurs courants de disparités en matière de santé :

Années de vie corrigées de l'incapacité (AVCI):Reflète le nombre d’années de vie en bonne santé perdues en raison d’une maladie, d’un handicap ou d’un décès prématuré. Le DALY est un indicateur composite, qui est la somme des années de vie potentielle perdues (YLL) et des années vécues avec incapacité (YLD).

Années de vie perdues (YLL):Nombre prévu d’années de bonne santé perdues en raison d’un décès prématuré.

Les chercheurs ont également mené une sous-analyse du cancer de la peau pour comprendre comment les performances de l’outil d’IA variaient dans des conditions à haut risque. Nous avons utilisé les catégories de la charge mondiale de morbidité (GBD) de « cancer de la peau non mélanocytaire » et de « mélanome cutané malin » pour estimer les résultats de santé pour tous les cancers, et la catégorie de « maladies de la peau et sous-cutanées » pour toutes les affections non cancéreuses.

Étape 3 : Mesurer les performances des outils d’IA

L'accord des trois premiers a été mesuré en comparant les pathologies classées prédites par l'IA avec les diagnostics de référence sur un ensemble de données d'évaluation (sous-populations stratifiées par âge, sexe, race/ethnicité et eFST).

Étape 4 : Tester les performances des outils d’IA dans la prise en compte des disparités en matière de santé

Pour quantifier la métrique HEAL de l'outil d'IA sur les maladies de la peau, la méthode spécifique est la suivante :

Pour chaque sous-population, deux entrées sont requises :Mesures quantitatives des disparités de santé préexistantes et des performances des outils d’IA.

Calculez la corrélation inverse R entre les résultats en matière de santé et les performances de l’IA dans tous les sous-groupes pour un facteur d’inégalité donné (par exemple, la race/l’origine ethnique). Plus la valeur positive de R est élevée, plus la prise en compte de l’équité en santé est complète.

La métrique HEAL de l'outil d'IA est définie comme : p(R > 0), qui estime la probabilité que l'IA donne la priorité aux disparités de santé préexistantes à travers la distribution R de 9 999 échantillons. Un indice HEAL supérieur à 50% signifie une probabilité plus élevée d’atteindre l’équité en santé, tandis qu’un indice HEAL inférieur à 50% signifie une probabilité plus faible d’atteindre une performance équitable.

Examen de l'outil d'IA dermatologique : certains sous-groupes doivent encore être améliorés

Race/ethnicité : L’indicateur HEAL est de 80,5%, ce qui indique une priorité élevée pour remédier aux disparités en matière de santé qui existent parmi ces sous-groupes.

Genre : L'indicateur HEAL est 92,1%, ce qui indique que le genre a une priorité élevée dans la prise en compte des différences de santé dans les performances des outils d'IA.

Âge : L’indicateur HEAL est de 0,0%, ce qui indique une faible probabilité de donner la priorité aux différences de santé entre les groupes d’âge. Pour la condition cancéreuse, l'indice HEAL est de 73,8%, tandis que l'indice HEAL pour la condition non cancéreuse est de 0,0%.

Les chercheurs ont effectué une analyse de régression logistique qui a montré que l'âge et certaines affections dermatologiques (telles que le carcinome basocellulaire et le carcinome épidermoïde) avaient un impact significatif sur les performances de l'IA, tandis que d'autres affections (telles que les kystes) étaient moins précises.

De plus, les chercheurs ont mené une analyse intersectionnelle, en utilisant des outils de mesure des résultats de santé GBD segmentés pour étendre l'analyse HEAL à l'âge, au sexe et à la race/l'origine ethnique, avec un indice HEAL global de 17,0%.En nous concentrant spécifiquement sur l’intersection entre les faibles classements en matière de résultats de santé et les performances de l’IA, nous avons identifié des sous-groupes nécessitant une amélioration des performances des outils d’IA, notamment les femmes hispaniques âgées de 50 ans et plus, les femmes noires âgées de 50 ans et plus, les femmes blanches âgées de 50 ans et plus, les hommes blancs âgés de 20 à 49 ans et les hommes américains d’origine asiatique et du Pacifique âgés de 50 ans et plus.

Cela dit, l’amélioration des performances des outils d’IA pour ces groupes est essentielle pour parvenir à l’équité en matière de santé.

Au-delà de l'équité en santé : une vision plus large de l'équité en matière d'IA

Il est évident que les inégalités en matière de santé existent de manière significative entre les différents groupes raciaux/ethniques, de genre et d’âge. En particulier avec le développement rapide des technologies médicales de pointe, le déséquilibre des ressources en matière de santé s’est encore aggravé. L’IA a encore un long chemin à parcourir pour résoudre les problèmes connexes. Il convient toutefois de noter que l’injustice engendrée par le progrès technologique est en réalité répandue dans tous les aspects de la vie des gens, comme l’inégalité d’accès à l’information, à l’éducation en ligne et aux services numériques causée par la fracture numérique.

Jeff Dean, directeur de Google AI et « dieu de la programmation », a déclaré un jour que Google attachait une grande importance à l'équité de l'IA et avait réalisé de nombreux travaux sur les données, les algorithmes, l'analyse de la communication, l'interprétabilité des modèles, la recherche sur les différences culturelles et la protection de la vie privée des grands modèles. Par exemple : * En 2019, le Comité d'examen des produits d'IA responsables de Google Cloud et le Comité d'examen des transactions d'IA responsables de Google Cloud ont suspendu le développement de produits d'IA liés au crédit pour éviter d'exacerber l'injustice ou le biais algorithmique. * En 2021, l’Advanced Technologies Review Board a examiné des recherches impliquant de grands modèles linguistiques et a conclu qu’elles pouvaient se poursuivre avec prudence, mais que le modèle ne pouvait pas être officiellement lancé tant qu’un examen complet des principes de l’IA n’était pas effectué. * L'équipe Google DeepMind a publié un jour un article explorant « comment intégrer les valeurs humaines dans les systèmes d'IA » et intégrant des idées philosophiques dans l'IA pour l'aider à établir l'équité sociale.

À l’avenir, afin de garantir l’équité de la technologie de l’IA, une intervention et une gouvernance seront nécessaires sous de multiples angles, tels que :

* Collecte et traitement équitables des données :Assurez-vous que vos données de formation incluent la diversité, y compris des personnes de sexes, d’âges, de races, de cultures et de milieux socio-économiques différents. Dans le même temps, il convient d’éviter toute sélection de données en raison de biais afin de garantir la représentativité et l’équilibre de l’ensemble de données.

* Éliminer les biais algorithmiques :Au cours de la phase de conception du modèle, identifiez et éliminez de manière proactive les biais algorithmiques susceptibles de conduire à des résultats injustes. Cela peut impliquer une sélection rigoureuse des caractéristiques d’entrée du modèle ou l’utilisation de techniques spécifiques pour réduire ou éliminer les biais.

* Évaluation de l’équité :Des évaluations d’équité doivent être effectuées avant et après le déploiement du modèle. Cela comprend l’utilisation de diverses mesures d’équité pour évaluer l’impact du modèle sur différents groupes et la réalisation des ajustements nécessaires en fonction des résultats de l’évaluation.

* Suivi continu et amélioration itérative :Une fois le système d’IA déployé, ses performances dans l’environnement réel doivent être surveillées en permanence pour identifier et résoudre rapidement tout problème d’injustice éventuel. Cela peut nécessiter une itération régulière des modèles pour s’adapter aux changements environnementaux et aux nouvelles normes sociales.

Avec le développement de la technologie de l’IA, les normes éthiques, les lois et les réglementations pertinentes seront encore améliorées, permettant à la technologie de l’IA de se développer dans un cadre plus juste. Dans le même temps, l’accent sera davantage mis sur la diversité et l’inclusion. Cela nécessite de prendre en compte les besoins et les caractéristiques des différents groupes dans tous les aspects, y compris la collecte de données, la conception d’algorithmes et le développement de produits.

À long terme, la véritable signification de l’IA qui change la vie devrait être de mieux servir les personnes de différents sexes, âges, races, cultures et milieux socio-économiques, et de réduire l’injustice causée par l’application de la technologie. Alors que la sensibilisation du public continue de s’améliorer, pouvons-nous impliquer davantage de personnes dans la planification du développement de l’IA et faire des suggestions sur le développement de la technologie de l’IA pour garantir que le développement de la technologie soit conforme aux intérêts généraux de la société ?

Le grand projet d’équité dans la technologie de l’IA nécessite des efforts conjoints de plusieurs domaines tels que la technologie, la société et le droit. Nous devons veiller à ce que la technologie de pointe ne devienne pas un moteur de « l’effet Matthew ».