Command Palette

Search for a command to run...

Online-Tutorial | Unterstützt Über 600 Sprachen, Xiaomi Open Source OmniVoice: Stimmenklonen Mit Nur 3–10 Sekunden Referenzaudio

Mit der rasanten Entwicklung der KI-Sprachtechnologie bewegen sich Text-to-Speech-Modelle (TTS) von der Fähigkeit, „sprechen zu können“, hin zur „natürlichen Kommunikation wie ein echter Mensch“. Bestehende Systeme stehen jedoch im Allgemeinen immer noch vor Problemen wie komplexen Generierungsverbindungen, hohen Trainingskosten und begrenzter sprachübergreifender Generalisierungsfähigkeit in Bezug auf mehrsprachige Abdeckung, Zero-Sample-Sprachklonierung und Unterstützung komplexer Akzente und Dialekte.

Vor diesem Hintergrund stellt die Veröffentlichung von OmniVoice einen neuen Durchbruch in der mehrsprachigen Sprachgenerierung dar. Das vom Next-Gen Kaldi-Team des Xiaomi AI Labs entwickelte Modell unterstützt über 600 Sprachen und bietet Funktionen wie Voice Clone, Voice Design und Auto Voice. Im Vergleich zum herkömmlichen zweistufigen Generierungsprozess „Text → Semantik → Akustik“, der üblicherweise bei TTS-Modellen verwendet wird, nutzt OmniVoice eine diskrete nicht-autoregressive (NAR) Architektur, ähnlich einem Diffusionssprachmodell. Dabei wird Text direkt auf akustische Token aus mehreren Codebüchern abgebildet, was den Sprachgenerierungsprozess deutlich vereinfacht.

Diese architektonische Änderung reduziert nicht nur den Leistungsengpass herkömmlicher diskreter NAR-Modelle in komplexen Prozessen, sondern ermöglicht OmniVoice auch eine höhere Sprachverständlichkeit, bessere Sprachwiedergabe und sprachübergreifende Konsistenz. Gleichzeitig verwendet das Modell eine Strategie für das Training mit zufälligen Masken auf Basis eines vollständigen Codebuchs und wird anhand eines vortrainierten großen Sprachmodells initialisiert. Dies verbessert die Trainingseffizienz und steigert die Qualität der Sprachgenerierung zusätzlich.

Wichtiger noch: OmniVoice ist nicht nur ein „mehrsprachiges“ TTS-Modell. Es deckt nicht nur gängige Sprachen wie Chinesisch, Englisch, Japanisch und Koreanisch ab, sondern auch chinesische Dialekte wie den Henan-, Sichuan- und nordostchinesischen Dialekt sowie verschiedene englische Varianten wie amerikanische, britische, australische und indische Akzente. Dank seiner Zero-Sample-Sprachklonierungsfunktion, die nur wenige Sekunden Referenzaudio benötigt, bietet es ein enormes Anwendungspotenzial in Bereichen wie KI-Voiceover, digitale Menschen, sprachübergreifende Inhaltserstellung und globale Sprachinteraktion.

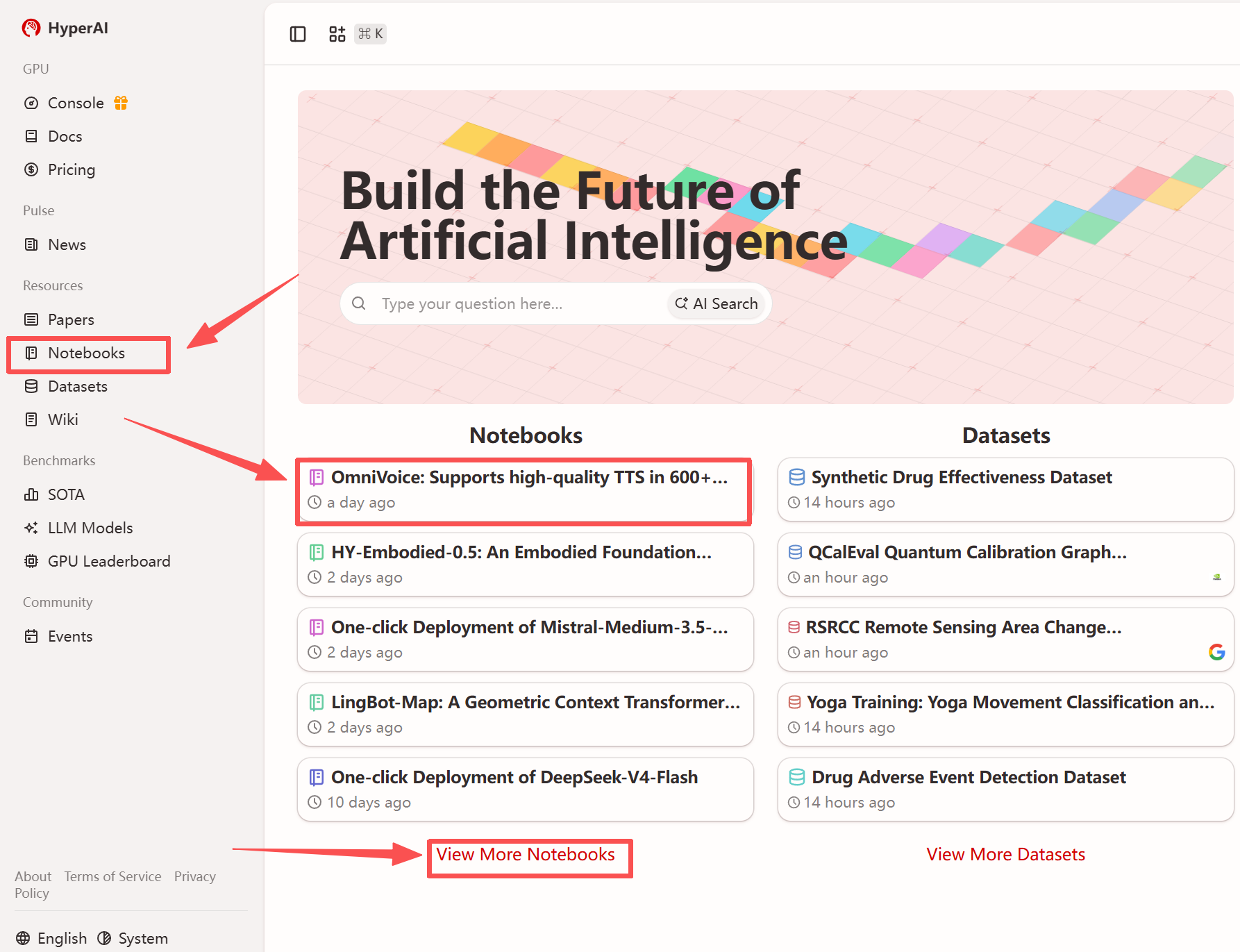

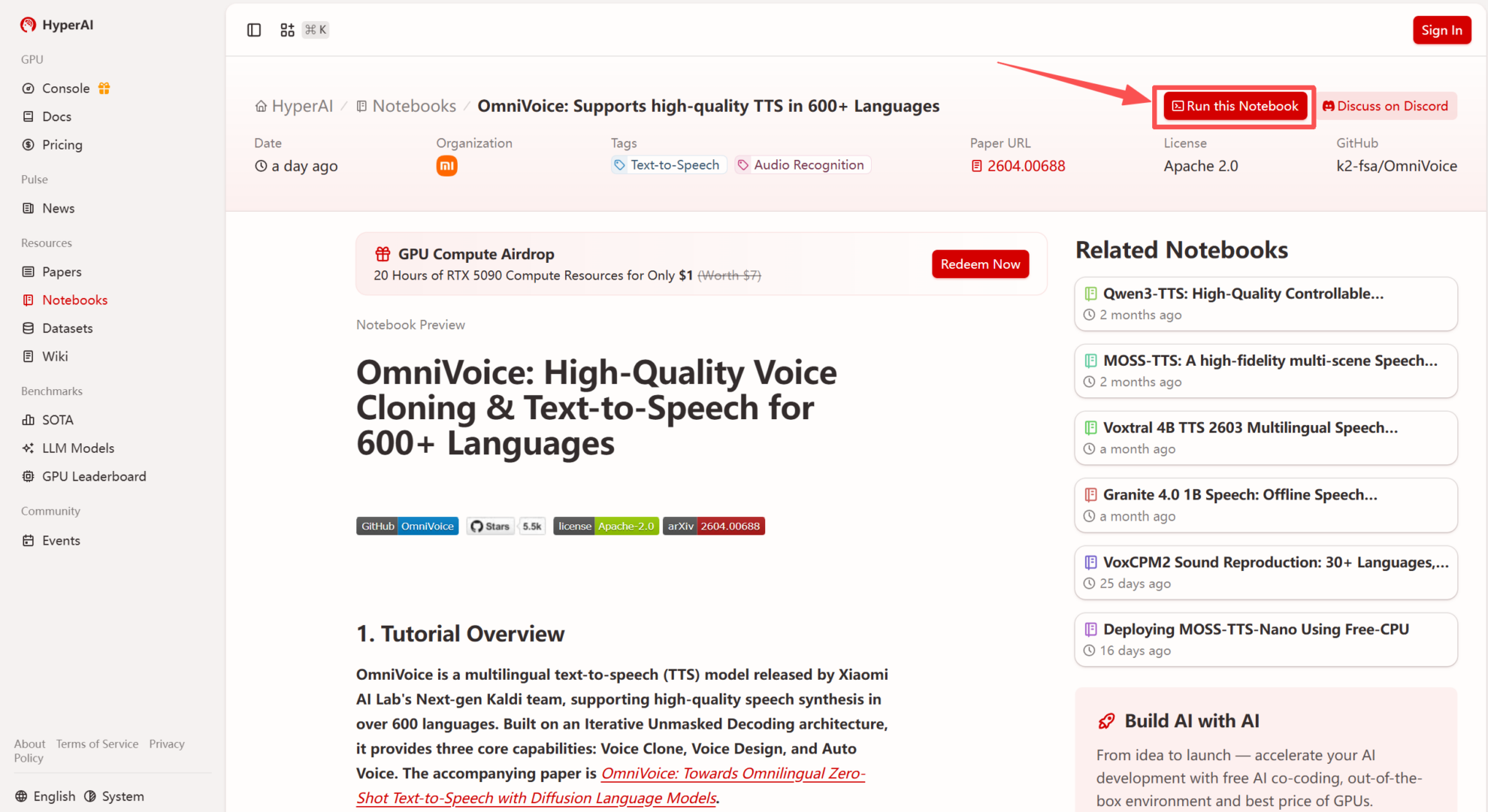

Aktuell ist im Tutorial-Bereich der offiziellen Website von HyperAI (hyper.ai) das Projekt „OmniVoice: Hochwertige TTS-Lösung für über 600 Sprachen“ verfügbar, das mit einem Klick gestartet und mit geringen Einstiegshürden eingesetzt werden kann.

Online ausführen:

Weitere Online-Tutorials:

Besuchen Sie unsere offizielle Website für weitere Informationen:

Demolauf

1. Nachdem Sie die Startseite von hyper.ai aufgerufen haben, wählen Sie die Seite „Tutorials“ aus oder klicken Sie auf „Weitere Tutorials anzeigen“, wählen Sie „OmniVoice: Hochwertige TTS-Lösung für über 600 Sprachen“ aus und klicken Sie auf „Dieses Tutorial ausführen“.

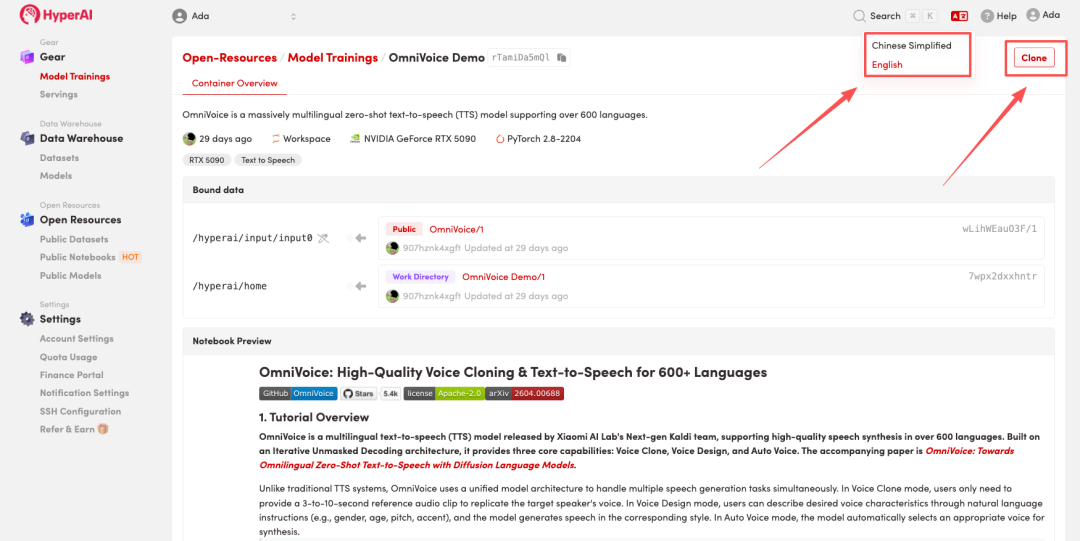

2. Nachdem die Seite weitergeleitet wurde, klicken Sie oben rechts auf „Klonen“, um das Tutorial in Ihren eigenen Container zu klonen.

Hinweis: Sie können die Sprache oben rechts auf der Seite ändern. Derzeit sind Chinesisch und Englisch verfügbar. Dieses Tutorial zeigt die Schritte auf Englisch.

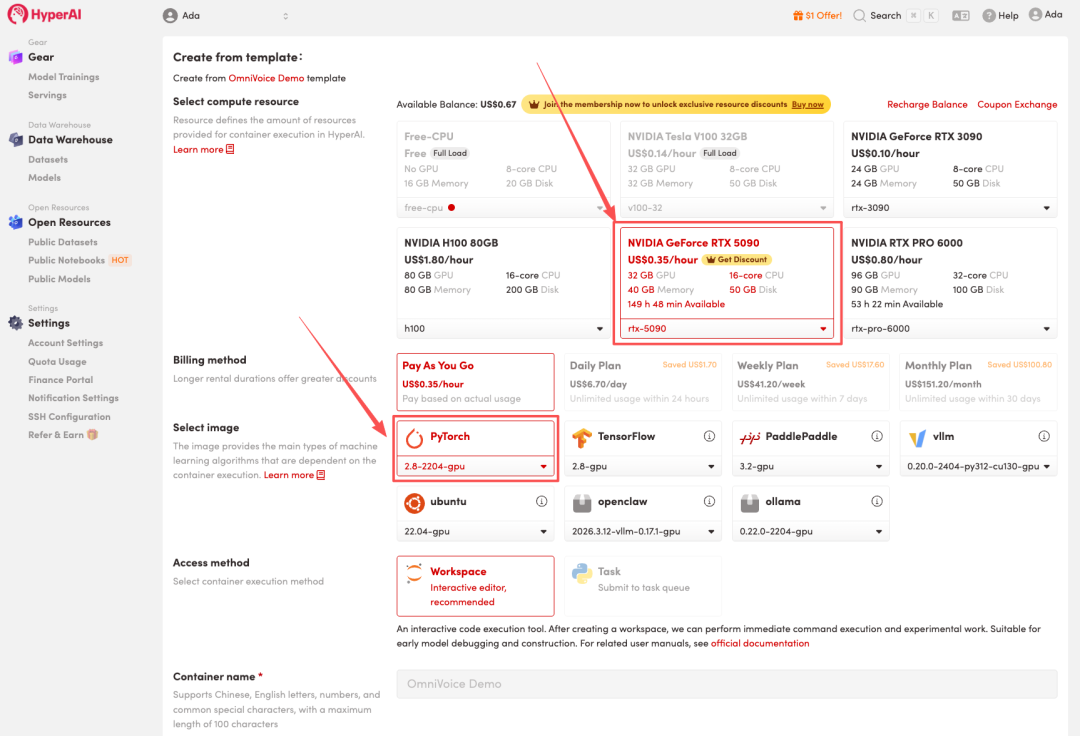

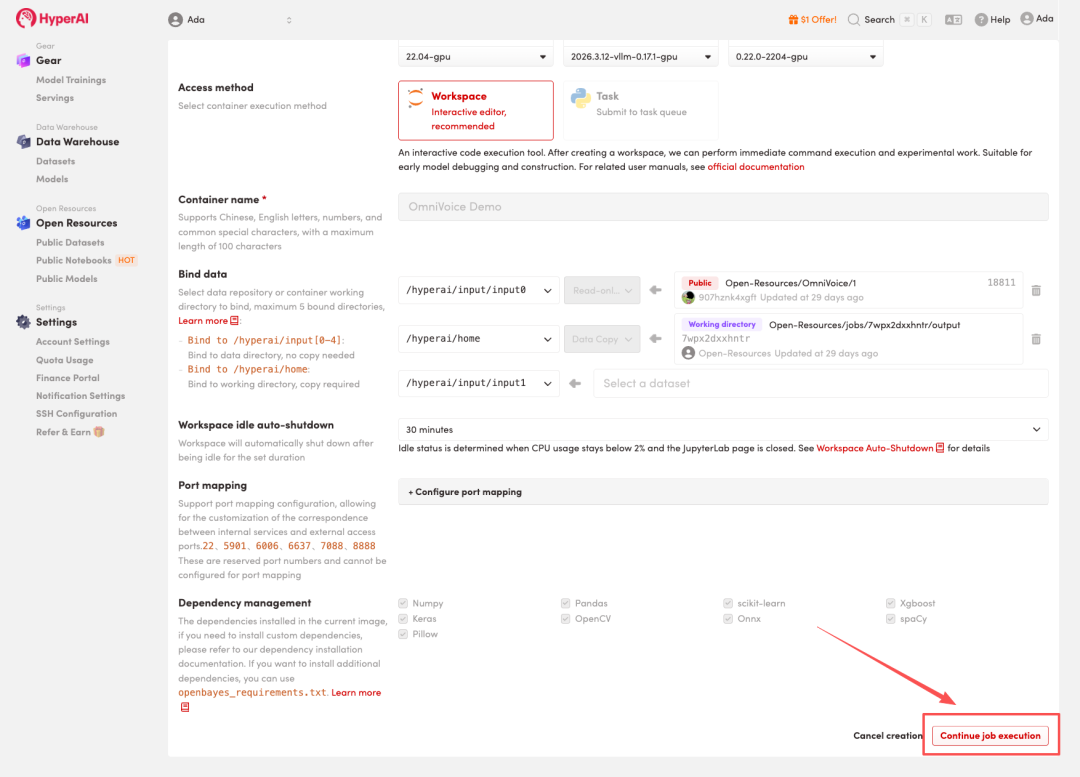

3. Wählen Sie die Images „NVIDIA RTX 5090“ und „PyTorch“ aus und klicken Sie auf „Auftragsausführung fortsetzen“.

HyperAI bietet Neukunden einen Registrierungsbonus: Für nur $1 erhalten Sie 20 Stunden RTX 5090 Rechenleistung (ursprünglich $7), und die Ressourcen sind unbegrenzt gültig.

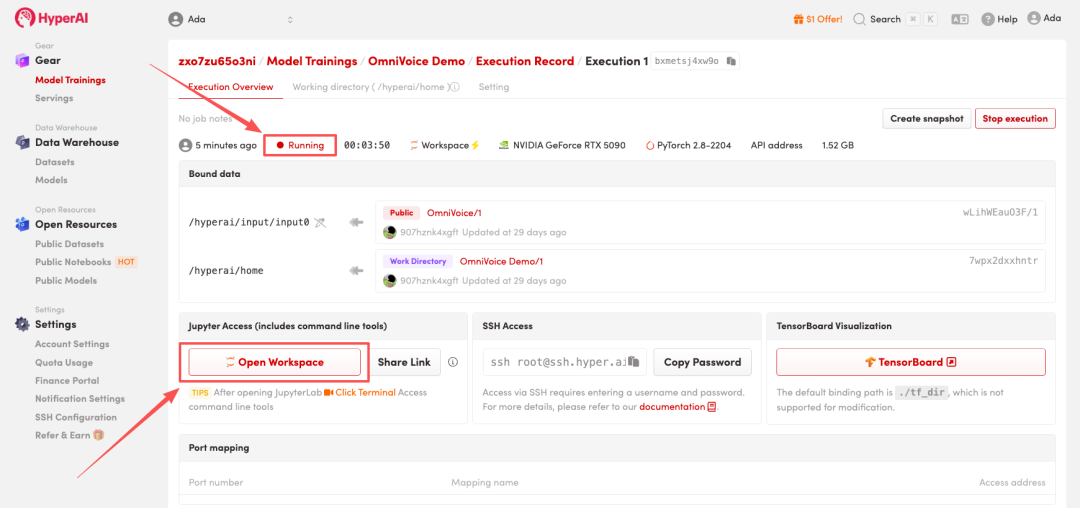

4. Warten Sie, bis die Ressourcen zugewiesen wurden. Sobald sich der Status auf „Wird ausgeführt“ ändert, klicken Sie auf „Arbeitsbereich öffnen“, um den Jupyter-Arbeitsbereich zu betreten.

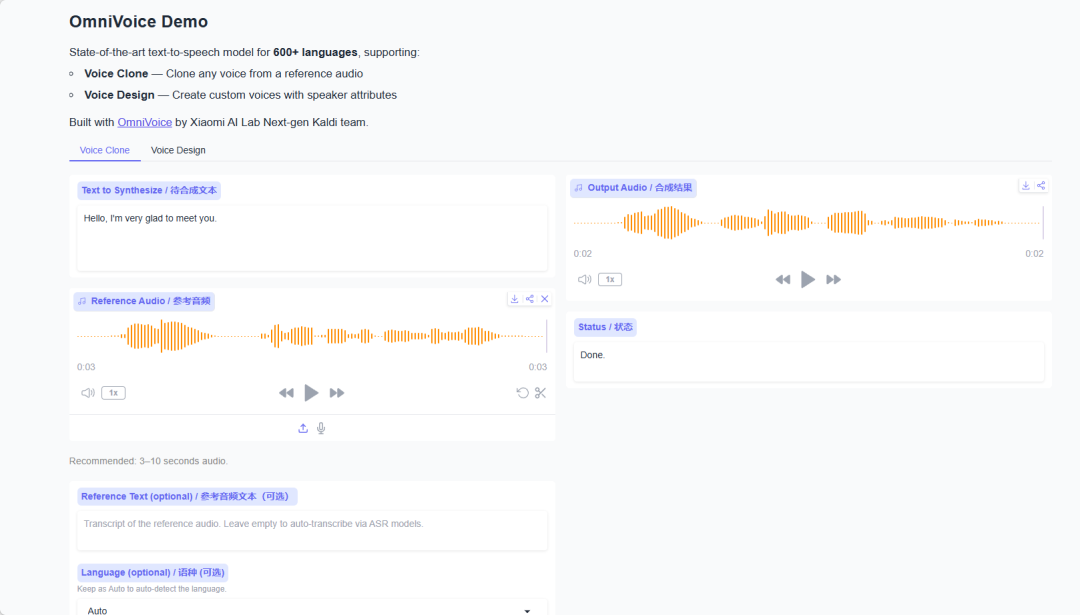

Effektanzeige

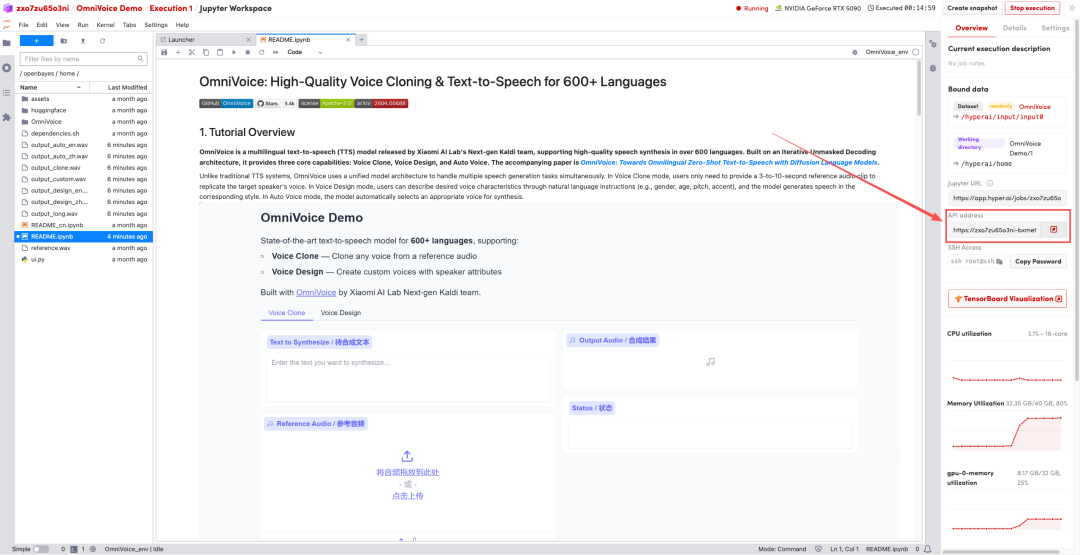

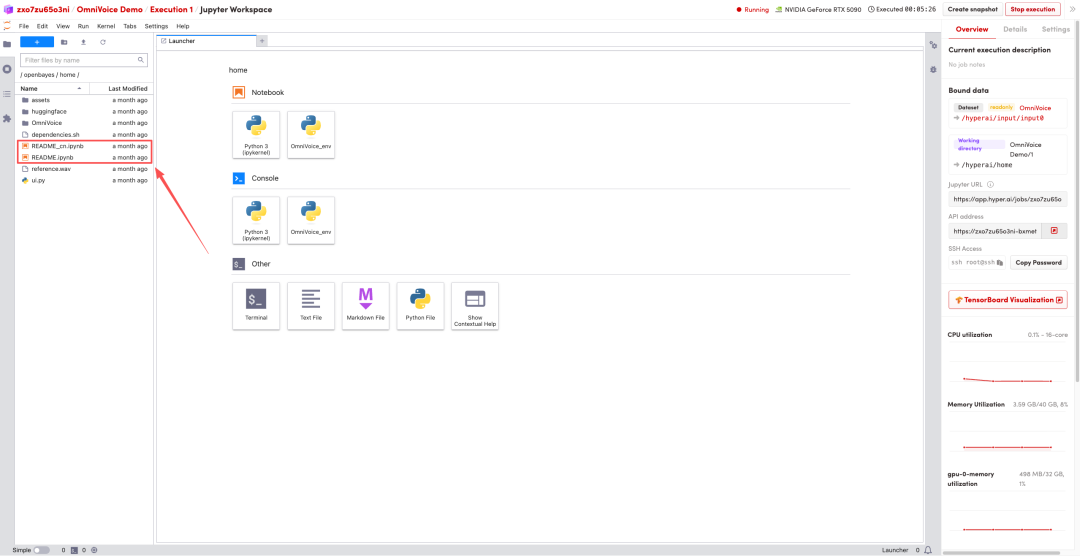

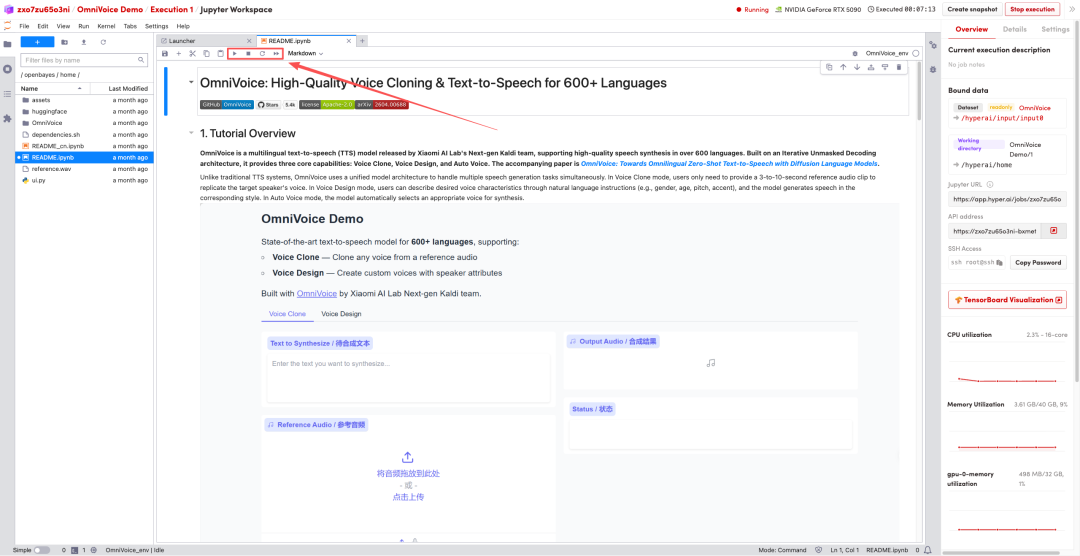

1. Nachdem die Seite weitergeleitet wurde, klicken Sie auf die README-Datei auf der linken Seite und anschließend oben auf Ausführen.

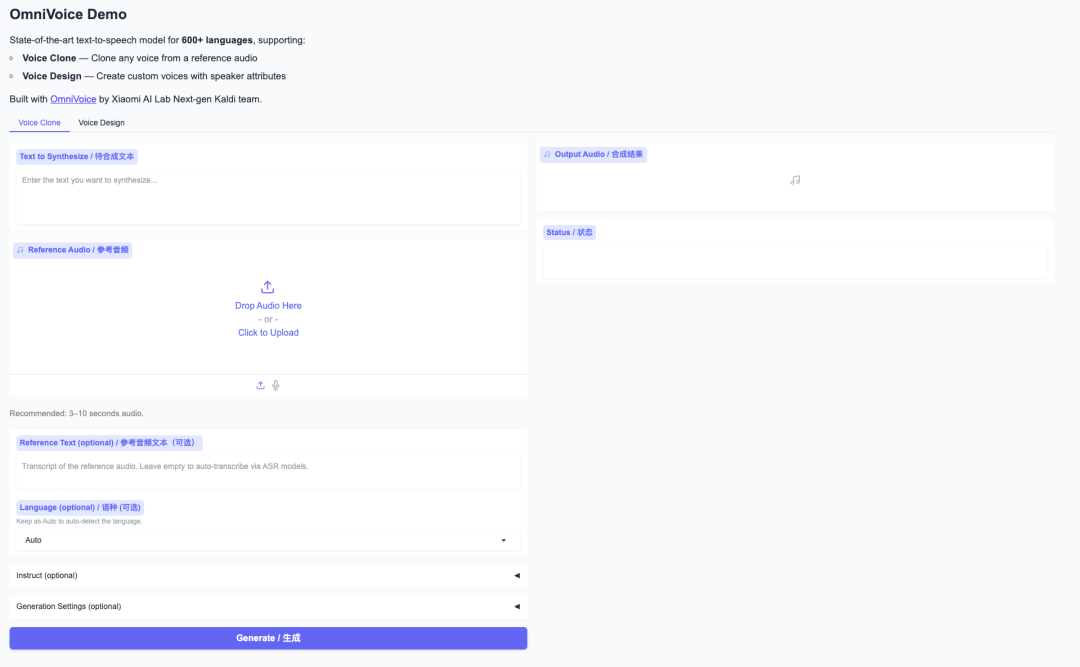

2. Sobald der Vorgang abgeschlossen ist, klicken Sie auf die API-Adresse rechts, um zur Demoseite zu gelangen.