Command Palette

Search for a command to run...

EnergAIzer, Ein Von MIT Und Anderen Entwickeltes Framework Zur GPU-Leistungsschätzung, Führt Vorhersagen Im Durchschnitt in 1,8 Sekunden Mit Einem Fehler Von Ungefähr 81 TP3T durch.

Schätzungen des Lawrence Berkeley National Laboratory zufolge ist dies auf das explosive Wachstum der künstlichen Intelligenz zurückzuführen.Bis 2028 werden Rechenzentren 121 TP3T des gesamten Stromverbrauchs der Vereinigten Staaten ausmachen.Als primärer Beschleuniger für KI-Workloads haben sich Grafikprozessoren (GPUs) zu einer Hauptquelle des Stromverbrauchs entwickelt, wobei die thermische Verlustleistung (TDP) bei den neuesten NVIDIA H100 und GB200 700 W bzw. 1200 W erreicht. Angesichts der zunehmend gravierenderen Energieherausforderungen,Die schnelle Abschätzung des GPU-Leistungs- und Energieverbrauchs für KI-Workloads ist von entscheidender Bedeutung geworden.

Stromverbrauchsmodelle benötigen typischerweise Informationen zur Hardwareauslastung, um die Nutzungsintensität verschiedener GPU-Module (wie DRAM und Tensor-Kerne) zu charakterisieren, da der dynamische Stromverbrauch direkt proportional zur Modulaktivität ist. Bestehende Methoden gewinnen diese Informationen hauptsächlich über zwei Ansätze: Zum einen werden Befehlsebenensimulatoren verwendet, um die Modulauslastung durch die Simulation der GPU-Ausführung zyklusweise zu ermitteln.Allerdings können selbst bei mittleren Arbeitslasten derart detaillierte Simulationen mehrere Stunden dauern.Die zweite Methode ist die Laufzeitleistungsanalyse (Profiling).Dies führt jedoch nicht nur zu einem höheren Analyseaufwand, sondern hängt auch von den verfügbaren Hardware-Ressourcen ab.

Vor diesem HintergrundForscher des MIT und des MIT-IBM Watson AI Lab haben EnergAIzer entwickelt, ein schnelles Framework zur GPU-Leistungsschätzung für KI-Workloads.Informationen zur Hardwareauslastung können direkt in die Stromverbrauchsmodelle eingespeist werden, ohne dass teure Simulationen oder Leistungsanalysen erforderlich sind.Dieses neue Framework kann die gesamte Stromverbrauchsabschätzung in durchschnittlich nur 1,8 Sekunden durchführen.Auf NVIDIA Ampere GPUs erreichte EnergAIzer einen Stromverbrauchsfehler von ungefähr 81 TP3T, was mit traditionellen Modellen konkurrenzfähig ist, die auf komplexen zyklischen Simulationen oder Hardware-Leistungsanalysen beruhen.

Die Forscher demonstrierten außerdem die Fähigkeiten von EnergAIzer in den Bereichen Frequenzskalierung und Architekturkonfigurationserkundung.Unter Einbeziehung der Vorhersage des Stromverbrauchs der NVIDIA H100 beträgt der Fehler lediglich 7%.Insgesamt bietet EnergAIzer schnelle und präzise Prognosemöglichkeiten für den Stromverbrauch von KI-Workloads. Rechenzentrumsbetreiber können diese Schätzungen nutzen, um begrenzte Ressourcen effizient auf mehrere KI-Modelle und Prozessoren zu verteilen und so die Energieeffizienz zu verbessern.

Die zugehörigen Forschungsergebnisse mit dem Titel „EnergAIzer: Fast and Accurate GPU Power Estimation Framework for AI Workloads“ wurden als Preprint auf arXiv veröffentlicht.

Forschungshighlights:

* Das neue Framework generiert zuverlässige Schätzungen des Stromverbrauchs in Sekundenschnelle, während herkömmliche Modellierungstechniken Stunden oder sogar Tage benötigen, um Ergebnisse zu liefern.

* Das neue Prognosetool kann auf eine breite Palette von Hardwarekonfigurationen angewendet werden, einschließlich neuerer Designs, die noch nicht im Einsatz sind.

Dieses Tool hilft Algorithmenentwicklern und Modellanbietern, den potenziellen Energieverbrauch neuer Modelle vor deren Einsatz zu bewerten.

Papieradresse:

https://arxiv.org/abs/2604.20105

Folgen Sie unserem offiziellen WeChat-Konto und antworten Sie im Hintergrund mit „Stromverbrauchsprognose“, um das vollständige PDF zu erhalten.

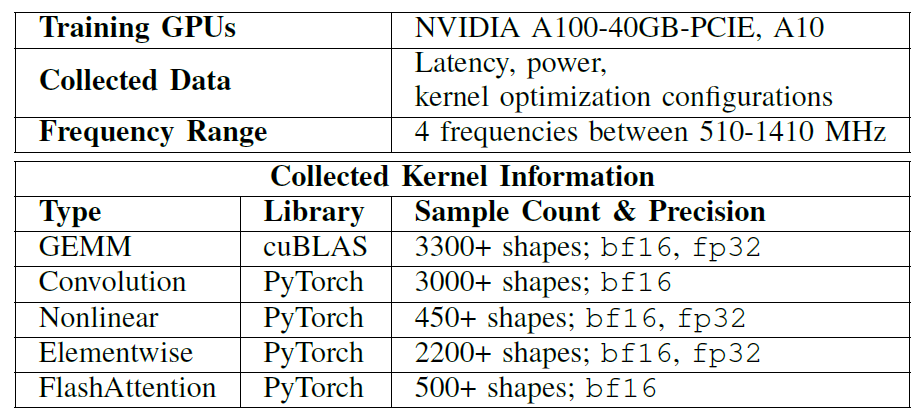

Datensatz: Umfasst verschiedene gängige Operatortypen und Tensorformen

In allen ExperimentenForscher erstellten Offline-Kerneldatenbanken auf Basis der NVIDIA A100-40GB-PCIE- und A10-GPU.Die Tabelle unten enthält Details zu verschiedenen gängigen Operatortypen und Tensorformen für das Training von EnergAIzer:

enthalten:

* Matrixberechnungen vom GEMM-Typ

* Faltung

* Nichtlinear

* Elementweise

* Blitzaufmerksamkeit

Die Forscher stellten experimentelle Ressourcen für EnergAIzer zur Verfügung.Dies umfasst den Quellcode für das Schätzframework, eine zuvor erstellte Datenbank für empirische Anpassungen sowie reale Messdaten zur Validierung der Vorhersagen.Zu den Ressourcen gehören Skripte zur Reproduktion von Experimenten, zur Generierung von Leistungs- und Latenzabschätzungen auf Einzelkernel-Ebene sowie End-to-End-Abschätzungen für KI-Workloads.

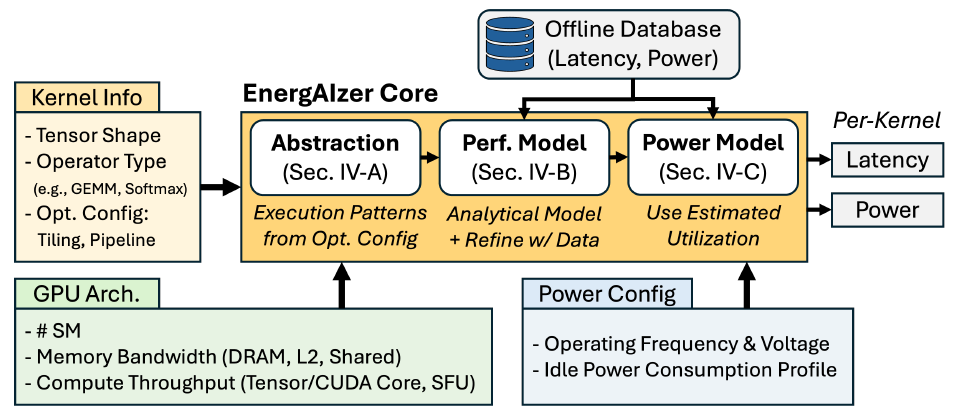

Drei Schritte zum Aufbau des EnergAIzer-Vorhersagemodells auf Kernel-Ebene

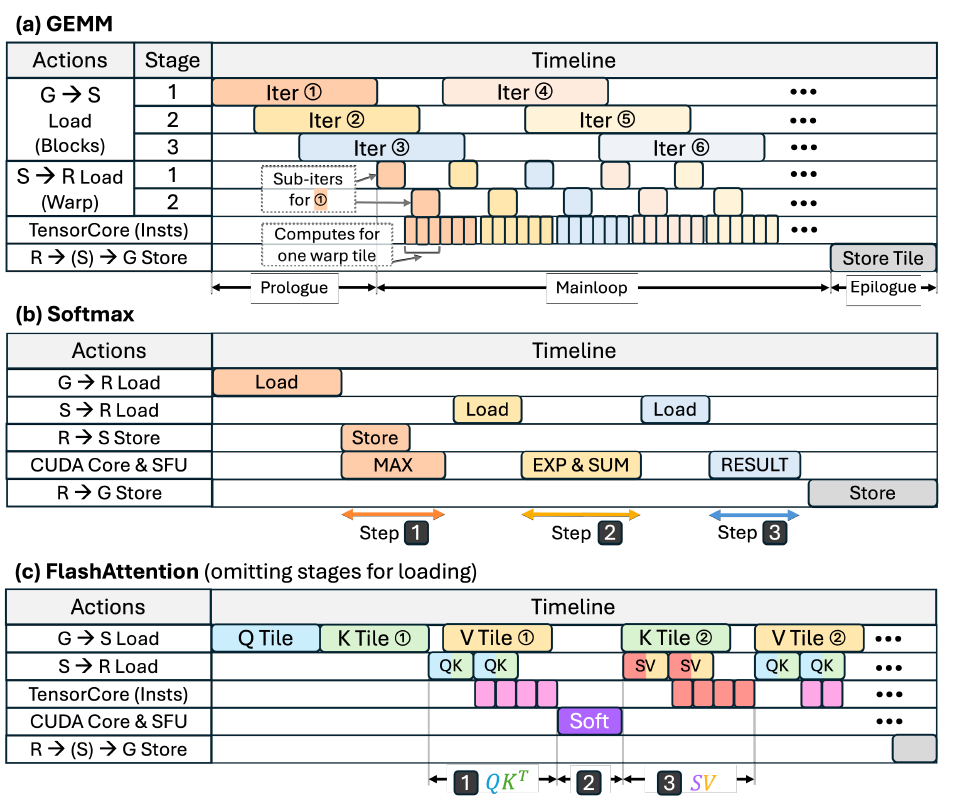

Kernstück von ENERGAIZER ist ein Vorhersagemodell auf Kernel-Ebene, das die Forscher in drei Schritten entwickeln.Erste,Durch die Etablierung von Workload-Repräsentationen, wie etwa Software-Optimierungsstrategien wie Tiling, Thread-Block-Scheduling und Pipelining, werden strukturierte Ausführungsmuster geschaffen, die die Grundlage für Leistungsmodelle bilden.Zweitens,Erstellen Sie Leistungsmodelle und passen Sie empirische Daten an, indem Sie diese Muster als Gerüst verwenden;endlich,Das Stromverbrauchsmodell verwendet die prognostizierte Auslastungsrate, um den dynamischen Stromverbrauch zu schätzen.

Arbeitslaststruktur-Modellierungsschicht

Optimierungsstrategie

Tensoren werden hierarchisch in Datenkacheln auf verschiedenen Ebenen der GPU-Ausführung unterteilt. Durch Thread-Block-Swizzling werden Thread-Blöcke, die auf dieselbe Eingabekachel zugreifen, benachbarten Tensoren zugeordnet, wodurch die Wiederverwendung des L2-Caches verbessert wird. Software-Pipelining überlappt Datentransfer und Berechnung in Zeititerationen. Die Pipelining-Struktur bestimmt die Latenz, die ein Schlüsselfaktor für die Leistungsmodellierung ist.

Über GEMM hinaus

Darauf aufbauend weiteten die Forscher die Analyse systematisch auf alle wichtigen Kerneltypen in der KI aus (einschließlich nichtlinearer, elementweiser und Fusionskernel), mit dem Ziel, die Auslastung auf Modulebene für die Modellierung der Energieeffizienz abzuleiten.

verifizieren

Mithilfe analytischer Methoden ermittelten die Forscher die gesamte Speicherauslastung für gemeinsam genutzten Speicher, L2-Cache und DRAM und verglichen diese mit Hardware-Zählerdaten, die durch eine NCU-Leistungsanalyse auf einer NVIDIA A100-40GB-PCIE-GPU gewonnen wurden. Nahezu perfekte Korrelationen wurden über mehr als 790 GEMM-Kerne, 70 Softmax-Kerne und über 380 FlashAttention-Kerne hinweg beobachtet. Dies bestätigt, dass Blockparameter und die optimale Thread-Block-Neuanordnung den Speicherverkehr bestimmen.

Leistungsmodellschicht

Zeitleistenkonstruktion

Das Leistungsmodell erstellt eine Ausführungszeitleiste aus grobkörnigen Operationen. Die Neigung bestimmt die Granularität der Operationen (z. B. Datenladen/Speichern, Anzahl der Rechenanweisungen), während die Pipeline-Verarbeitung festlegt, wie sich diese Operationen basierend auf Abhängigkeiten überlappen. Diese Zeitleiste bildet das analytische Gerüst und dient zur Ermittlung der Modulauslastung, wie in der folgenden Abbildung dargestellt:

Verzögerte Vorhersage

Nach Festlegung der Zeitleistenstruktur wird die Methode zur Berechnung der Latenz jeder Operation beschrieben; anschließend werden die Latenzen dieser einzelnen Operationen zur Gesamtausführungszeit addiert, wodurch die Auswirkungen der Pipeline berücksichtigt werden.

Nutzungsableitung

Anhand des Build-Zeitplans wurden die Auslastungsraten von sechs Schlüsselmodulen ermittelt: DRAM, L2-Cache, gemeinsam genutzter Speicher, Tensor-Kerne, CUDA-Kerne (für reguläre Gleitkommaoperationen) und Spezialfunktionseinheiten (für Exponential- und andere nichtlineare Funktionen). Die Auslastungsrate jedes Moduls wurde als Anteil seiner aktiven Zeit an der gesamten Kernel-Ausführungszeit definiert.

Schicht des Stromverbrauchsmodells

Basierend auf der Modulauslastung, die aus dem Leistungsmodell ermittelt wurde, schätzten die Forscher diese mithilfe einer Standardformel für den dynamischen Stromverbrauch. Diese Methode ist formal konsistent mit der traditionellen Stromverbrauchsmodellierung, der entscheidende Unterschied liegt jedoch in der Bestimmung der Auslastung α. Da die Offline-Datenbank Stromverbrauchsmessungen bei mehreren Betriebsfrequenzen umfasst, wird der Koeffizient C so angepasst, dass der Fehler über den gesamten Frequenzbereich minimiert wird. Dies ermöglicht die Stromverbrauchsschätzung bei jeder Frequenz ohne zusätzliche Messungen während der Inferenzphase.

Im Durchschnitt dauert die gemeinsame Schätzung von Latenz und Stromverbrauch pro Arbeitslast nur 1,8 Sekunden.

Forscher evaluierten experimentell die Vorhersagekraft von EnergAIzer und seine Anwendung bei der Untersuchung verschiedener Designoptionen:

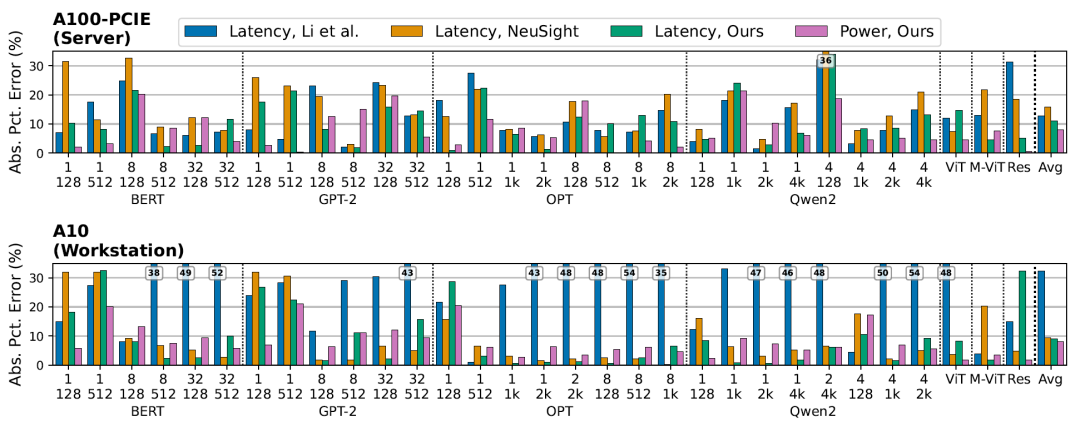

Genauigkeit der Latenz- und Leistungsaufnahmeschätzung für KI-Workloads

Die folgende Abbildung zeigt die Ergebnisse der End-to-End-Latenz- und Leistungsaufnahmeschätzung für verschiedene Sprachmodelle (BERT-Large, GPT-2, OPT-1.3B, Qwen2-1.5B) und visuelle Modelle (ResNet101, ViT, MobileViT):

EnergAIzer erreichte auf einer Server-GPU (A100-40GB-PCIE) einen durchschnittlichen Latenzfehler von 11,01 TP3T und einen Stromverbrauchsfehler von 8,01 TP3T.Auf einer Workstation-GPU (A10) betragen sie 8,8% bzw. 8,2%.Diese Ergebnisse sind über alle Arbeitslasten gemittelt. Hinsichtlich der Latenzvorhersage ist EnergAIzer mit modernsten ressourcenschonenden Leistungsmodellen (Li et al., NeuSight) vergleichbar und bietet darüber hinaus Leistungsabschätzungsfunktionen, die diese Modelle nicht bieten können.

EnergAIzer benötigt im Durchschnitt nur 1,8 Sekunden pro Arbeitslast, um eine gemeinsame Schätzung von Latenz und Stromverbrauch durchzuführen.Bei Sprachmodellen dauert eine einzelne Vorhersage zwischen 1,1 und 2,8 Sekunden. Im Gegensatz dazu benötigt die Hardware-Zählererfassung mit der NCU 452 bis 8192 Sekunden, wodurch eine Beschleunigung um das 317- bis 3856-Fache erreicht wird.

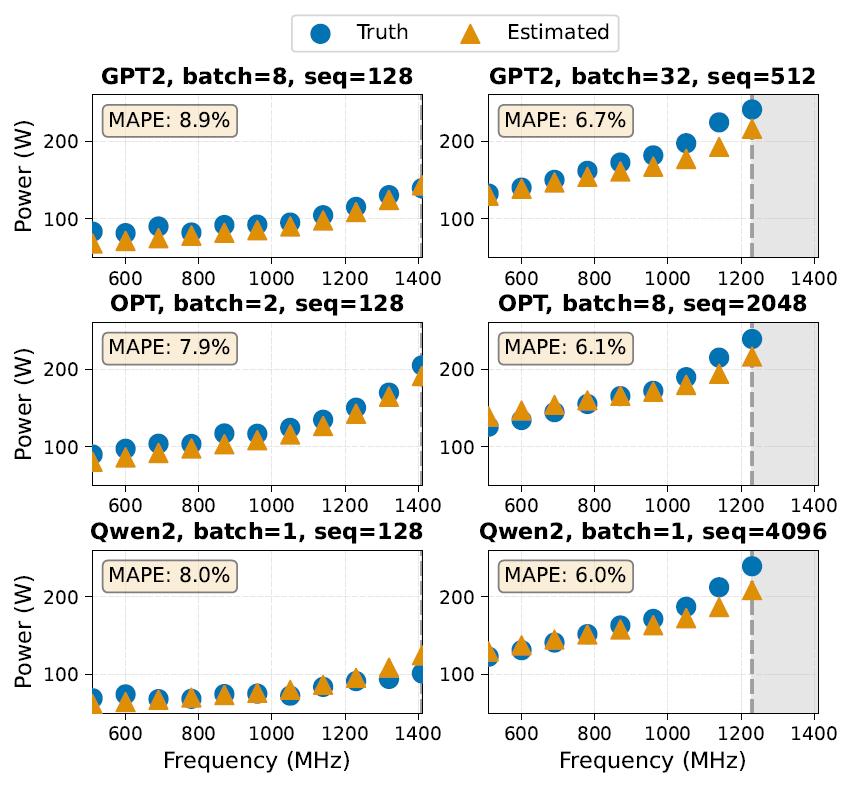

Spannungs-Frequenz-Regelung untersuchen

Die Spannungs-Frequenz-Regelung ist eine gängige Energiemanagementtechnik, die von einer präzisen Stromverbrauchsprognose über verschiedene Betriebspunkte hinweg profitiert. Forscher untersuchten die Fähigkeit von EnergAIzer, den Stromverbrauch bei unterschiedlichen Frequenzen (510–1410 MHz) auf einer A100-40GB-PCIe-Karte zu schätzen. In den Experimenten wurden ausschließlich die Eingangsparameter der Leistungskonfiguration von EnergAIzer angepasst, darunter die Zielfrequenz, die Spannung und der Stromverbrauch im Leerlauf bei dieser Frequenz. Die folgende Abbildung zeigt den Vergleich zwischen den tatsächlich gemessenen und den prognostizierten Stromverbrauchswerten:

Das EnergAIzer-Framework kann typische Skalierungsverhalten für verschiedene Workload-Typen erfassen: Workloads mit geringer Auslastung (kleine Batches/Sequenzen, linke Abbildung) und Workloads mit begrenzter Energieauslastung (große Batches/Sequenzen, rechte Abbildung).Der mittlere absolute prozentuale Fehler (MAPE) bei verschiedenen Frequenzen beträgt 6%–9%.

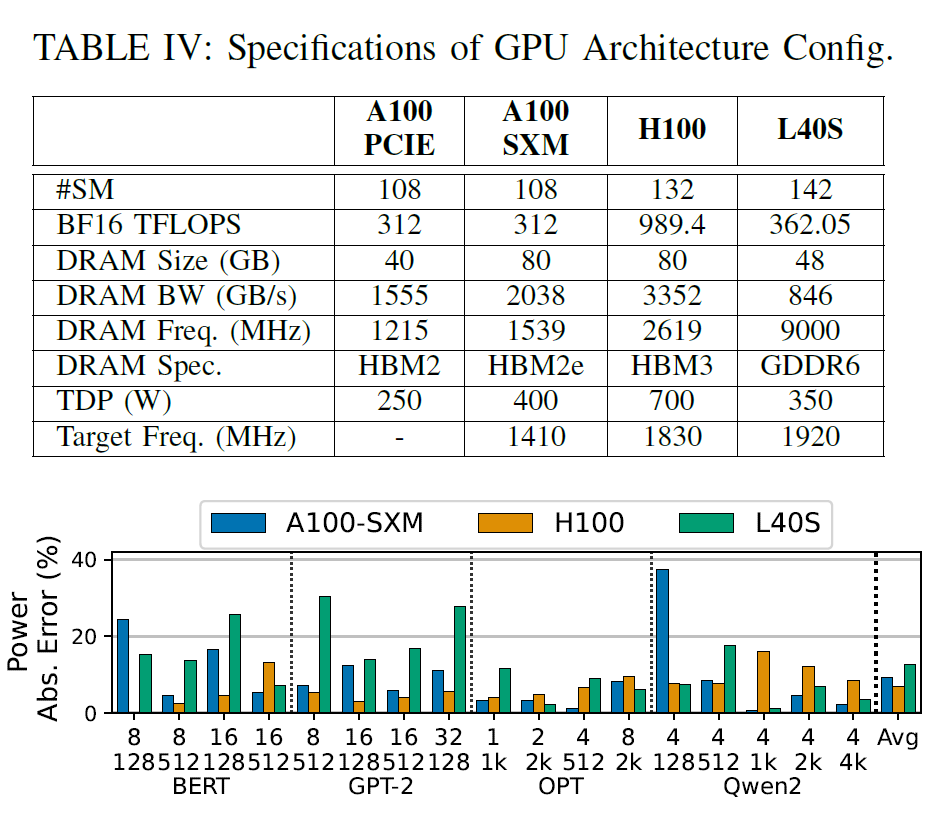

Erkundung der GPU-Architekturkonfiguration

Dieses Framework unterstützt auch die Erkundung verschiedener GPU-Architekturkonfigurationen durch die Anpassung von GPU-Architekturparametern (wie der Anzahl der SMs, der Speicherbandbreite und des Rechendurchsatzes) als Eingabe.Dies ermöglicht die Vorhersage des Stromverbrauchs der neuen Architektur, ohne dass Daten zur Zielhardware erfasst werden müssen. Die Forscher evaluierten zwei Szenarien: die Untersuchung innerhalb derselben GPU-Architekturgeneration und die Untersuchung über verschiedene Architekturgenerationen hinweg. Die Ziel-GPU-Konfigurationen sind in der folgenden Tabelle zusammengefasst:

Zunächst nutzten Forscher innerhalb der Ampere-Architektur ausschließlich eine Datenbank, die auf Basis der A100-40GB-PCIE-Architektur erstellt wurde, um den Stromverbrauch der A100-80GB-SXM vorherzusagen. Der durchschnittliche Fehler betrug dabei 9,11 TP3T. In generationsübergreifenden Szenarien ergab die Verwendung der Ampere-Architekturdatenbank zur Vorhersage des Stromverbrauchs der Hopper- (H100) und Lovelace-Architektur (L40S) Fehler von 6,71 TP3T bzw. 12,71 TP3T.

Insgesamt bietet EnergAIzer eine schnelle und genaue Vorhersage des Stromverbrauchs für KI-Workloads.

Abschluss

Für Rechenzentrumsbetreiber ermöglicht EnergAIzer die schnelle Bewertung des Energieverbrauchs verschiedener GPU-Konfigurationen, Frequenzstrategien und Ressourcenplanungsschemata und unterstützt so eine präzisere Ressourcenorchestrierung und Energieeffizienzoptimierung. KI-Modellentwicklern bietet dieses Framework ein neues, hardwarebasiertes Werkzeug. Bereits in der Entwurfsphase des Modells lassen sich die Leistungs- und Stromverbrauchsabwägungen, die sich aus unterschiedlichen Genauigkeiten und Betreiberimplementierungen ergeben, bewerten. Dadurch werden Probleme mit dem Energieverbrauch nicht erst bei der Implementierung deutlich.

Natürlich weist das aktuelle Framework noch gewisse Einschränkungen auf, beispielsweise den Bedarf an verbesserten Modellierungsfähigkeiten für kollaboratives Multi-GPU-Computing, den Kommunikationsaufwand und unregelmäßiges Sparse Computing. Methodisch betrachtet hat EnergAIzer jedoch einen klaren Trend aufgezeigt: Die Modellierung des GPU-Stromverbrauchs entwickelt sich von einem Offline-Analysewerkzeug, das stark auf Messungen basiert, zu einer ressourcenschonenden, einbettbaren Online-Entscheidungsfindungsmöglichkeit. Angesichts der kontinuierlich wachsenden Rechenleistung von KI und der zunehmend knappen Energieressourcen gewinnt diese Technologie rasant an Bedeutung. Zukünftig, mit steigender Modellkomplexität und Hardwareheterogenität, dürften Frameworks wie EnergAIzer mehr als nur Forschungswerkzeuge sein; sie könnten zu einem unverzichtbaren Bestandteil der KI-Infrastruktur werden.

Referenzen

https://news.mit.edu/2026/faster-way-to-estimate-ai-power-consumption-0427

https://arxiv.org/pdf/2604.20105