Command Palette

Search for a command to run...

Online-Tutorials | Einfache Bereitstellung Der Neuesten Physikalischen KI-Modelle Von NVIDIA, Einschließlich Humanoider Roboter/Generierung Menschlicher Bewegungen/Feinabstimmung Von Diffusionsmodellen usw.

Auf der kürzlich abgeschlossenen GTC 2026 legte NVIDIA neben den mit Spannung erwarteten neuen GPUs auch einen bedeutenden Fokus auf eine konkretere und praxisorientiertere Richtung:Physikalische KI.

Dieses von Jensen Huang wiederholt erwähnte Konzept führt zu einer zentralen Schlussfolgerung: Künstliche Intelligenz (KI) wird erst dann zur treibenden Kraft des industriellen Wandels, wenn sie nicht mehr nur auf einem Bildschirm existiert, sondern die physische Umgebung wahrnehmen, Aufgaben verstehen und Aktionen ausführen kann. Dieses Konzept überschneidet sich stark mit „Embodied AI“ und betont die enge Verknüpfung von KI mit der realen Welt – nicht nur deren „Bewegung“, sondern ihr zuverlässiges Handeln in komplexen Umgebungen.

Auf der GTC 2026, einer führenden Technologiekonferenz, konnten wir daher sehen, dass alles von grundlegenden humanoiden Robotermodellen bis hin zur hochpräzisen Bewegungserzeugung und einem einheitlichen System zur Modellierung des menschlichen Körpers diskutiert wurde.Die von NVIDIA herausgebrachten Modellreihen konzentrieren sich nicht mehr nur auf die Fähigkeiten des Modells, sondern drehen sich um „Aktion“ und „Ausführung“.

In,Die drei Open-Source-Projekte sind NVIDIA Isaac GR00T, Kimodo und SOMA-X.Sie gehen das gleiche Problem auf drei Ebenen an: Entscheidungsfindung, Generierung und Repräsentation – wie man Maschinen in die Lage versetzt, komplexe Aktionen natürlicher und effizienter auszuführen.

Eine Funktion ist dafür zuständig, Aufgaben zu verstehen und in ausführbare Verhaltensweisen zu übersetzen; eine andere konzentriert sich auf die Generierung detaillierter und realistischer Bewegungsabläufe; und die dritte versucht, das seit Langem bestehende Problem fragmentierter menschlicher Modelle zu lösen und so eine reibungslosere Zusammenarbeit zwischen verschiedenen Systemen zu ermöglichen. Jede dieser Fähigkeiten hat ihren eigenen Wert, aber vor allem zielen sie alle auf ein praktischeres Ziel ab: Roboter von „aktiven“ zu „benutzerfreundlichen“ Systemen zu entwickeln.

außerdem,NVIDIA veröffentlichte außerdem FDFO, eine Trainingsmethode für Diffusionsmodelle, die die oben genannten Fähigkeiten aus der Perspektive der generativen Modelloptimierung unterstützt.

Um Entwicklern weltweit einen schnellen Zugang zu den Open-Source-Errungenschaften der GTC 2026 in einer zugänglicheren und stabileren Umgebung zu ermöglichen, hat die HyperAI-Website (hyper.ai) die folgenden Online-Tutorials in ihrem Tutorial-Bereich veröffentlicht:

NVIDIA Isaac GR00T: Ein Basismodell für universell einsetzbare humanoide Roboter

Online ausführen:https://go.hyper.ai/2Cjvr

SOMA-X: Ein einheitliches parametrisches Framework für menschliche Körpermodelle

Online ausführen:https://go.hyper.ai/UcEI7

Kimodo: Modelle zur Generierung menschlicher und robotischer Bewegungen

Online ausführen:https://go.hyper.ai/p99vI

FDFO: Finite Differential Flow Optimization

Online ausführen:https://go.hyper.ai/ikihN

HyperAI bietet Neukunden Registrierungsvorteile.Für nur $1 erhalten Sie 20 Stunden Rechenleistung einer RTX 5090 (ursprünglicher Preis $7).Die Ressource ist dauerhaft gültig.

NVIDIA Isaac GR00T

Allgemeines humanoides Roboter-Basismodell

Der NVIDIA Isaac GR00T N1.6 ist ein Open-Source-Vision-Language-Action-Modell (VLA), das im März 2026 veröffentlicht wurde und speziell für das Erlernen von Fähigkeiten in humanoiden Allzweckrobotern entwickelt wurde. Dieses Modell verwendet ein Cross-Embodiment-Design, das es ihm ermöglicht, multimodale Eingaben, einschließlich Sprache und Bilder, zu empfangen und manipulative Aufgaben in verschiedenen Umgebungen auszuführen.

Die neuronale Netzwerkarchitektur von GR00T N1.6 kombiniert ein visuelles Sprachmodell mit einem Diffusionstransformator zur kontinuierlichen Bewegungsrauschunterdrückung. Dieses Modell wurde mit vielfältigen Roboterdaten trainiert, darunter Daten von Zweiarmrobotern, semi-humanoiden Robotern und großen humanoiden Robotern, und kann nachträglich an unterschiedliche Roboterformen, Aufgaben und Umgebungen angepasst werden.

Online ausführen:https://go.hyper.ai/2Cjvr

SOMA-X: Ein einheitliches parametrisches Framework für menschliche Körpermodelle

Parametrische menschliche Körpermodelle, darunter Skinned Multi-Person Linear (SMPL), SMPL-X, Multi-Task Human Representation (MHR), Anny und GarmentMeasurements, werden in Bereichen wie der Rekonstruktion des menschlichen Körpers, der Animation und der Simulation häufig eingesetzt.

Diese Modelle weisen jedoch grundlegende Inkompatibilitäten auf: Jedes Modell definiert seine eigene Netztopologie, Gelenkhierarchie und Parametrisierungsmethode, was eine nahtlose Integration unmöglich macht. Um die Vorteile verschiedener Modelle zu kombinieren (z. B. die Alterssteuerungsfunktionen eines Modells mit Bewegungsdaten eines anderen), ist daher häufig die Entwicklung eines separaten Adapters für jedes Modellpaar erforderlich. Dies erhöht nicht nur die Entwicklungskosten, sondern schränkt auch die Interoperabilität und die praktischen Anwendungsmöglichkeiten des Systems erheblich ein.

Vor diesem Hintergrund veröffentlichte NVIDIA Labs SOMA-X, um Kompatibilitätsprobleme zwischen parametrischen menschlichen Modellen zu beheben. Es bietet eine standardisierte menschliche Topologie und ein Skelett-Rigging-System als zentrale Plattform für alle unterstützten parametrischen menschlichen Modelle. Anstatt bestehende Modelle zu ersetzen, erreicht es Vereinheitlichung, indem es die statischen Formen jedes Modells auf eine gemeinsame Repräsentation abbildet. Dieser Ansatz ermöglicht es, jedes unterstützte Identitätsmodell in einer einheitlichen Animationspipeline zu verwenden, ohne dass benutzerdefinierte Adapter oder modellspezifische Umleitungen erforderlich sind. Dadurch werden die Vielseitigkeit und Skalierbarkeit des Systems deutlich verbessert.

Online ausführen:https://go.hyper.ai/UcEI7

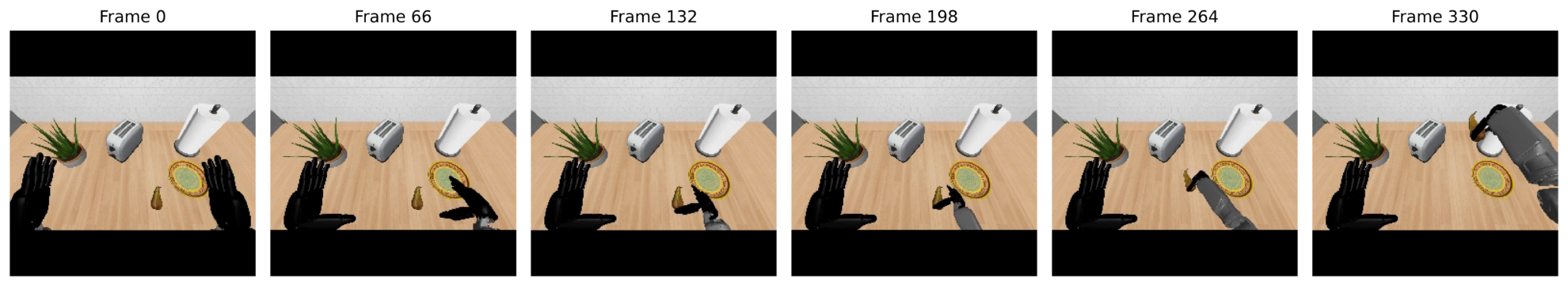

Kimodo: Modelle zur Generierung menschlicher und robotischer Bewegungen

Kimodo ist ein kinematisches Bewegungsdiffusionsmodell, das von NVIDIA Research im März 2026 veröffentlicht wurde. Das Modell wurde anhand eines umfangreichen (700 Stunden), kommerziell erhältlichen Datensatzes zur optischen Bewegungserfassung trainiert und generiert qualitativ hochwertige Bewegungen von Menschen und humanoiden Robotern. Es kann über Texteingaben und umfangreiche kinematische Beschränkungen wie Ganzkörper-Pose-Keyframes, Endeffektorposition/Rotation, 2D-Pfade und 2D-Wegpunkte gesteuert werden.

Kimodo unterstützt verschiedene Knochentypen, darunter:

* SOMA: Menschliches Skelett, 30 Gelenke

* Unitree G1: Humanoides Roboterskelett mit 34 Gelenken

* SMPL-X: Ein parametrisches menschliches Körpermodell mit 22 Gelenken.

Dieses Modell verwendet eine Diffusionsarchitektur, die einen Text-Encoder mit einem Bewegungsbeschränkungsmechanismus kombiniert und es ermöglicht, flüssige und natürliche Bewegungssequenzen auf der Grundlage von natürlichsprachlichen Beschreibungen und Keyframe-Beschränkungen zu generieren.

Online ausführen:https://go.hyper.ai/p99vI

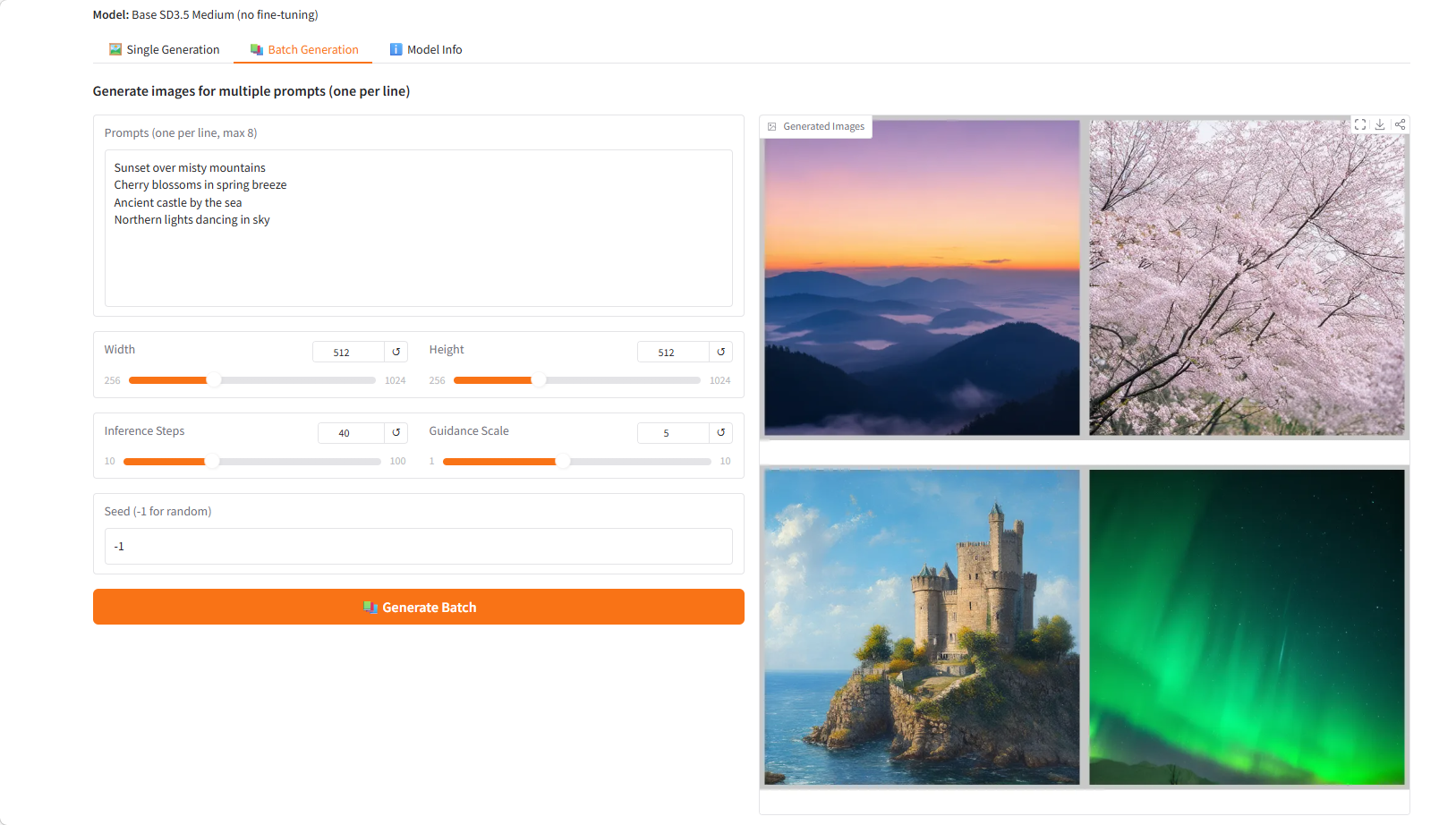

FDFO: Finite Differential Flow Optimization

FDFO (Finite Difference Flow Optimization) ist eine von NVIDIA im März 2026 veröffentlichte Methode zur Feinabstimmung von Streaming-Diffusionsmodellen, die auf der Gradientenschätzung mittels finiter Differenzen basiert. Diese Methode optimiert die generative Qualität des Modells, indem sie es auf Stable Diffusion 3.5 Medium trainiert und dabei Belohnungssignale aus Visual Language Model (VLM)-Scores und/oder PickScores nach dem Reinforcement Learning verwendet.

FDFO löst das Problem der Gradientenschätzung bei der Feinabstimmung traditioneller Diffusionsmodelle durch eine effiziente und stabile Gradientenberechnung mittels der Finite-Differenzen-Methode. Unter Beibehaltung der ursprünglichen Modellfunktionen verbessert diese Methode die Übereinstimmung, die ästhetische Qualität und den Realismus zwischen dem generierten Bild und dem Textvorschlag deutlich.

Online ausführen:https://go.hyper.ai/ikihN