Command Palette

Search for a command to run...

AI Paper Weekly Report | Neuentwicklung Von Proteinen / Erste Open-Source-Agentenlösung / HunyuanOCR / Olmo 3-Sprachmodell... Übersicht Mit Einem Klick

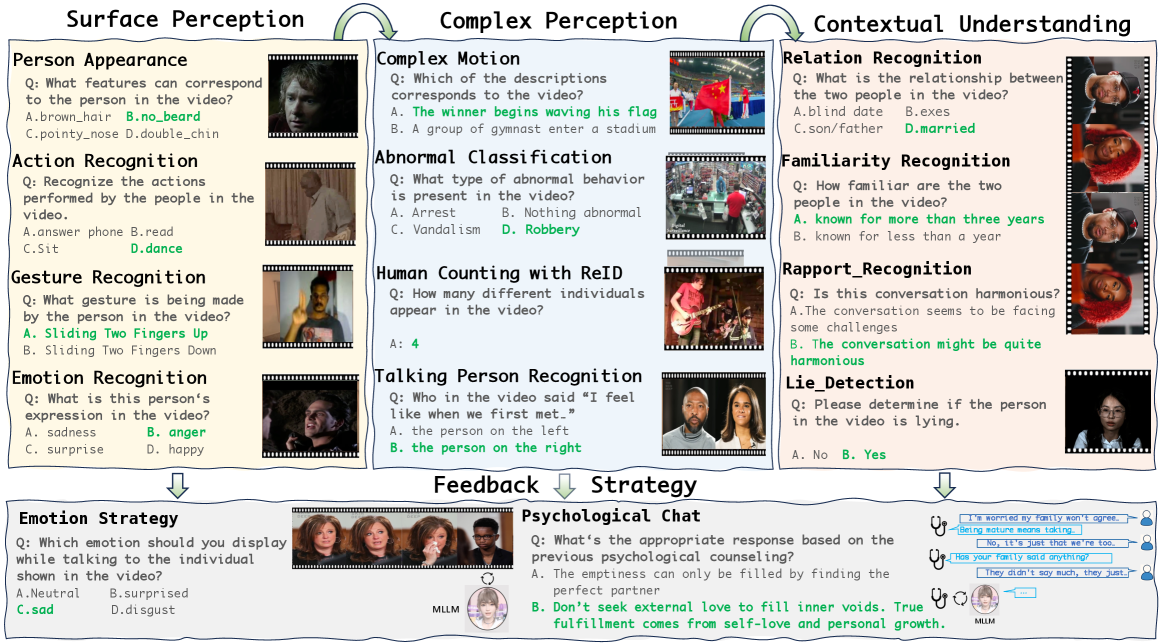

Multimodale große Sprachmodelle (MLLMs) haben ein großes Potenzial für die Erzielung menschenähnlicher Interaktion, doch ihre Entwicklung steht vor einer zentralen Herausforderung: dem Fehlen eines fein abgestuften Bewertungsrahmens für menschenzentrierte Szenarien, der gleichzeitig die Fähigkeit des Modells messen kann, komplexe menschliche Absichten zu verstehen und empathisches, kontextsensitives Feedback zu geben.

Aufbauend darauf entwickelte ein Forschungsteam der Xi’an Jiaotong Universität in Zusammenarbeit mit der Ant Group HumanSense, einen umfassenden Benchmark zur Bewertung der nutzerzentrierten Wahrnehmungs- und Interaktionsfähigkeiten von MLLMs. Der Fokus liegt dabei insbesondere auf dem tiefen Verständnis erweiterter multimodaler Kontexte und der Formulierung angemessener Reaktionen. Die Ergebnisse zeigen, dass MLLMs in nutzerzentrierten Szenarien, insbesondere bei Aufgaben mit komplexen Interaktionen, erhebliches Verbesserungspotenzial aufweisen. Die Forscher entwickelten zudem eine mehrstufige, modalitätsprogressive Reinforcement-Learning-Methode namens HumanSense-Omni-Reasoning, die die Leistung bei komplexen Verständnis- und Interaktionsaufgaben deutlich verbessert.

Link zum Artikel:https://go.hyper.ai/xYM02

Neueste KI-Artikel:https://go.hyper.ai/hzChC

Um mehr Benutzer über die neuesten Entwicklungen im Bereich der künstlichen Intelligenz in der Wissenschaft zu informieren, wurde auf der offiziellen Website von HyperAI (hyper.ai) jetzt der Bereich „Neueste Artikel“ eingerichtet, in dem täglich hochmoderne KI-Forschungsartikel aktualisiert werden.Hier sind 5 beliebte KI-Artikel, die wir empfehlen, werfen wir einen kurzen Blick auf die bahnbrechenden KI-Errungenschaften dieser Woche ⬇️

Die Zeitungsempfehlung dieser Woche

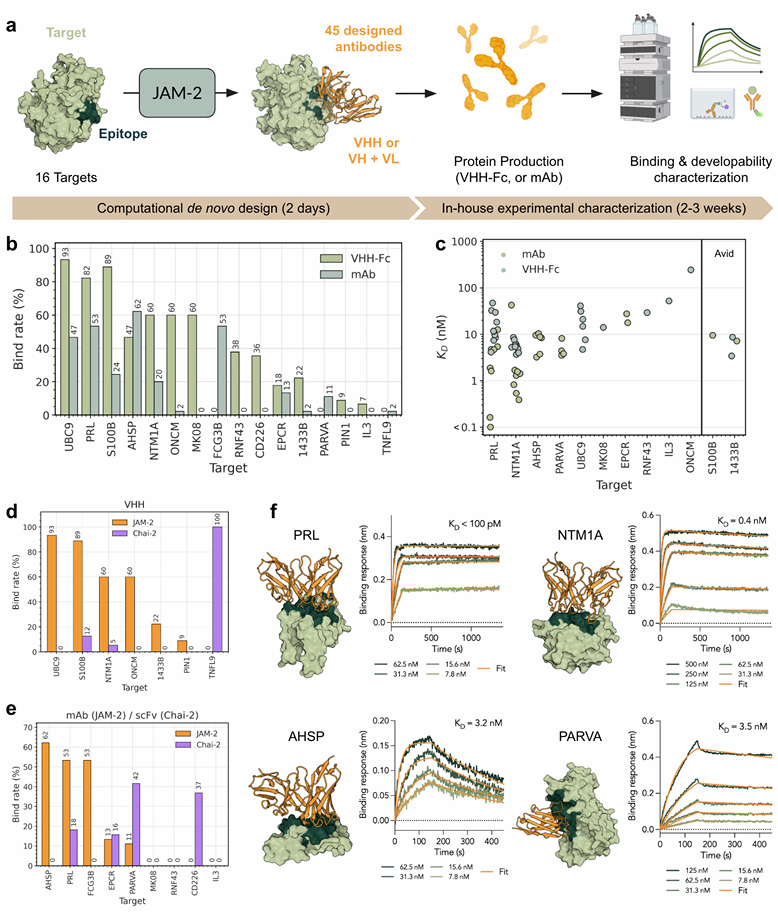

1.JAM-2

Titel: JAM-2: Vollständig computergestütztes Design von arzneimittelähnlichen Antikörpern mit hohen Erfolgsraten

Diese Arbeit stellt JAM-2 vor, ein universelles System für das De-novo-Proteindesign, das erstmals die hocheffiziente Entwicklung von VHH-Fc-Antikörpern und monoklonalen Antikörpern (mAbs) in voller Länge mit arzneimittelähnlicher Affinität und Entwicklungsfähigkeit ermöglicht und dabei zweistellige Erfolgsraten mit einer beispiellosen Bandbreite an Zielstrukturen und Epitopen erzielt. Von 16 unbekannten Zielstrukturen konnte JAM-2 für alle erfolgreich Bindungsmoleküle generieren, mit durchschnittlichen Erfolgsraten von 391 TP3T (VHH-Fc) und 181 TP3T (mAb).

Link zum Artikel:https://go.hyper.ai/3Mfna

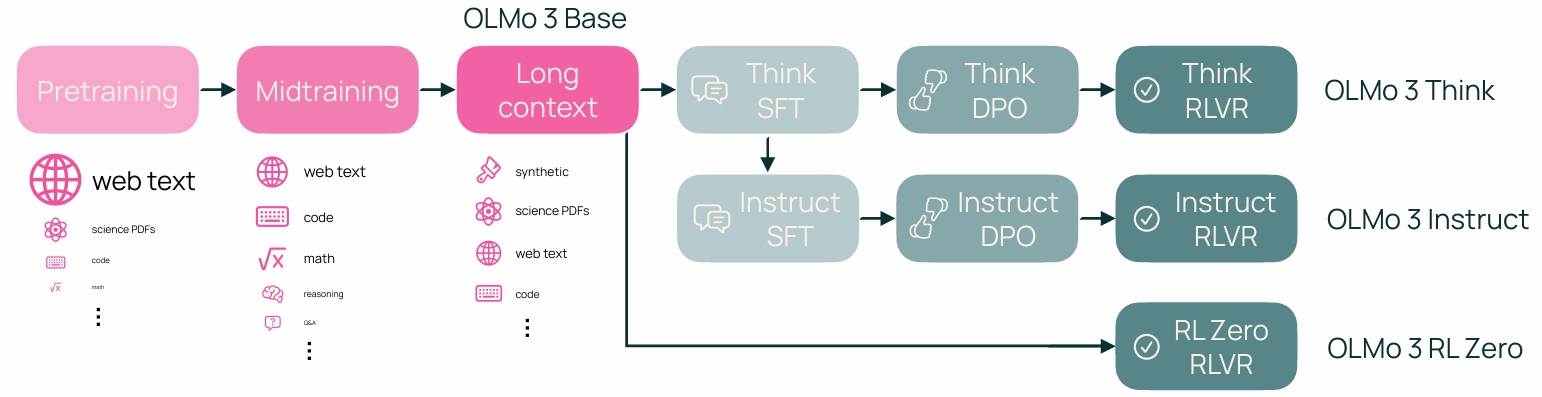

2.Olmo 3

Dieser Artikel stellt Olmo 3 vor, eine branchenführende Familie vollständig quelloffener Sprachmodelle mit Parameterskalen von 7 Milliarden und 32 Milliarden. Olmo-3-Modelle ermöglichen kontextbezogenes Schließen, Funktionsaufrufe, Programmierung, Befehlsverarbeitung, allgemeine Dialoge und Wissensabfrage. Diese Version enthält einen vollständigen Modellablauf, der den gesamten Lebenszyklus der Modellfamilie von der Erstellung bis zur Bereitstellung abdeckt und alle Trainingsphasen, Prüfpunkte, Datenpunkte und Abhängigkeiten umfasst.

Link zum Artikel:https://go.hyper.ai/HgvWV

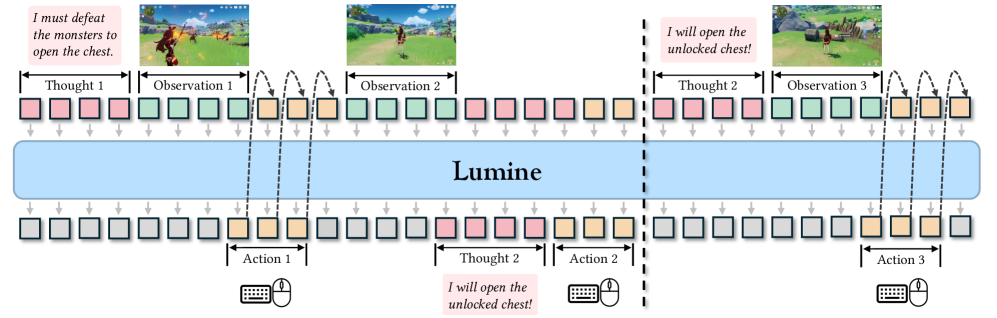

3.Lumine

Titel: Lumine: Ein offenes Rezept zum Erstellen von Generalistenagenten in offenen 3D-Welten

Diese Arbeit stellt Lumine vor, das erste Open-Source-System zur Entwicklung intelligenter Agenten für allgemeine Anwendungen, das komplexe Aufgaben stundenlang in Echtzeit in komplexen 3D-Umgebungen ausführen kann. Das Modell nutzt ein menschenähnliches Interaktionsparadigma und vereint Wahrnehmung, Schlussfolgerung und Handlung durch ein Bildverarbeitungs-Sprachmodell. Es verarbeitet Rohpixel-Eingaben mit 5 Bildern pro Sekunde, generiert präzise Tastatur- und Mausaktionen mit 30 Bildern pro Sekunde und ruft das Inferenzmodul nur bei Bedarf dynamisch auf.

Link zum Artikel:https://go.hyper.ai/6qg4A

4.HumanSense

Titel: HumanSense: Von multimodaler Wahrnehmung zu empathischen, kontextsensitiven Reaktionen durch logisches MLLMs

Diese Arbeit stellt HumanSense vor, ein umfassendes Benchmarking-Framework zur Bewertung der Fähigkeiten von MLLMs in der nutzerzentrierten Wahrnehmung und Interaktion. Der Fokus liegt dabei insbesondere auf dem tiefen Verständnis langfristiger multimodaler Kontexte und der Generierung sinnvoller Reaktionen. Unsere Ergebnisse zeigen, dass führende MLLMs in komplexen Interaktionsaufgaben noch erhebliches Verbesserungspotenzial aufweisen. Darüber hinaus wird in dieser Arbeit ein mehrstufiger, modalitätsprogressiver Reinforcement-Learning-Ansatz zur Konstruktion des HumanSense-Omni-Reasoning-Modells entwickelt, der die Leistung des Modells in komplexen Verständnis- und Interaktionsaufgaben signifikant verbessert.

Link zum Artikel:https://go.hyper.ai/xYM02

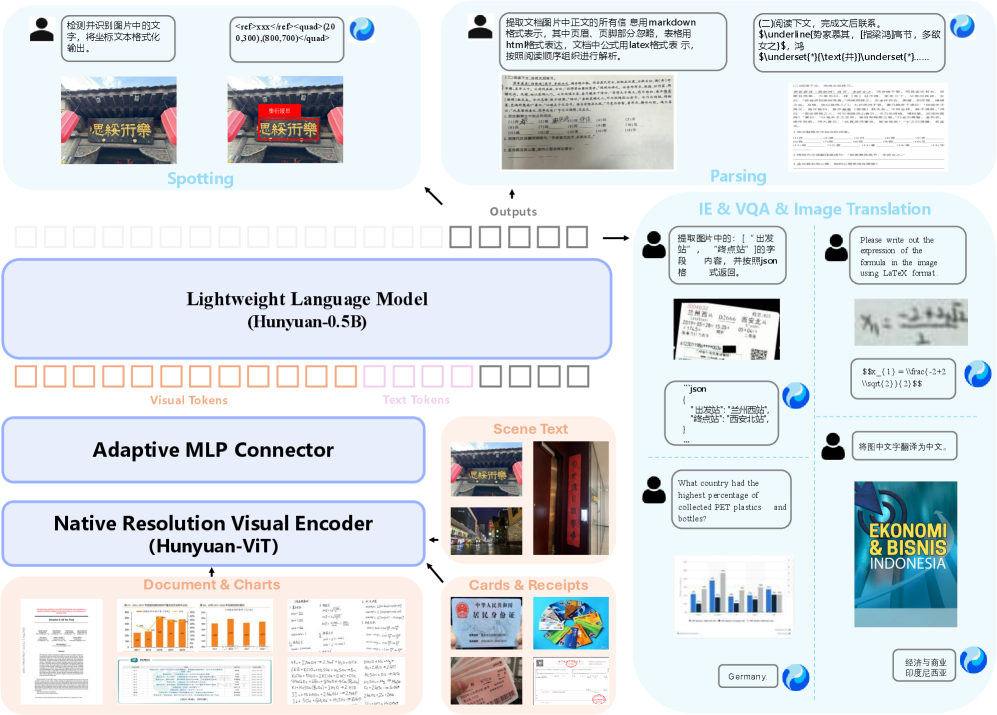

5.Technischer Bericht zu HunyuanOCR

Diese Arbeit stellt HunyuanOCR vor, ein kommerzielles, quelloffenes und ressourcenschonendes (1 Milliarde Parameter) visuelles Sprachmodell (VLM) für OCR-Aufgaben. Die Modellarchitektur besteht aus einem nativen visuellen Transformer (ViT) und einem ressourcenschonenden großen Sprachmodell (LLM), die über einen MLP-Adapter verbunden sind. HunyuanOCR zeigt überlegene Leistung und übertrifft bestehende kommerzielle APIs, traditionelle Verarbeitungsabläufe und Modelle mit einer höheren Parameteranzahl (wie z. B. Qwen3-VL-4B).

Link zum Artikel:https://go.hyper.ai/KxstF

Dies ist der gesamte Inhalt der Papierempfehlung dieser Woche. Weitere aktuelle KI-Forschungsarbeiten finden Sie im Bereich „Neueste Arbeiten“ auf der offiziellen Website von hyper.ai.

Wir freuen uns auch über die Einreichung hochwertiger Ergebnisse und Veröffentlichungen durch Forschungsteams. Interessierte können sich im NeuroStar WeChat anmelden (WeChat-ID: Hyperai01).

Bis nächste Woche!