Command Palette

Search for a command to run...

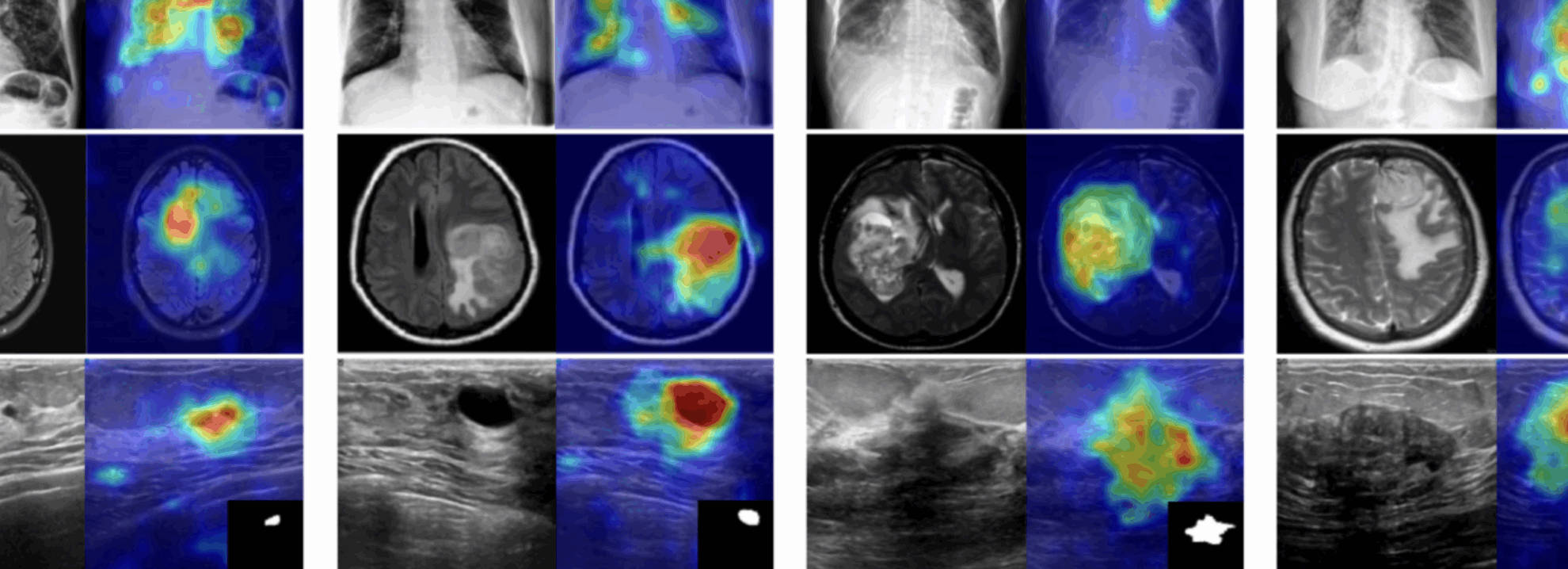

MediCLIP は、最小限の医療画像データを使用して、異常の検出と位置特定において最先端の結果を実現します。

臨床診断と治療において、医療画像技術(X線、CTスキャン、超音波など)は医師の診断に不可欠です。患者が画像検査を受けた後、通常は放射線科医または超音波専門医が画像を読影します。この専門的な読影によって異常が特定され、病変の位置が特定され、診断報告書が作成され、臨床上の意思決定に重要なサポートを提供します。

人工知能技術の発展により、医用画像解析は新たな変化を迎えています。現在、機械学習は、医用画像における異常の検出、つまり、病変のある異常画像と正常画像を区別し、これらの病変領域の位置を特定するというタスクを実行できます。この種の技術は、医療上の意思決定を支援する上で重要な役割を果たします。高度な検出モデルの中には、特定のタスクにおいて専門の臨床医と同等の性能を発揮するものもあり、意思決定のリスクを軽減すると同時に、医療スタッフの作業効率を向上させます。

しかし、既存の医用画像異常検出手法は、一般的に大規模なデータセットを用いた学習に依存しています。これにより、より高い性能を実現できる一方で、開発コストも大幅に増加します。

汎用CLIPモデルはゼロショット転送において優れた性能を発揮しますが、医療画像の異常検出への直接適用は、ドメインの違いやアノテーションの不足により制限されます。2022年、イリノイ大学アーバナ・シャンペーン校の研究チームはMedCLIP法を提案しました。CLIPのような画像とテキストの対照学習モデルに着想を得たこのアプローチは、画像とテキストの対照学習を分離し、医学的知識を取り入れることで偽陰性を排除することで、このパラダイムを医療画像分類とクロスモーダル検索に拡張します。この手法は、データ量を大幅に削減した場合でも優れた性能を発揮します。

MedCLIPはデータ依存の軽減において大きな成果を上げていますが、分類・検索タスク向けに設計されており、異常検出、特に病変部位の特定には適していません。一方、最近の研究ではCLIPをゼロショット/スモールショット異常検出に適用し、優れた成果を上げています。しかし、これらの手法では、モデル学習のために実際の異常画像とピクセルレベルのアノテーション付き補助データセットが必要になることが多く、医療現場ではこれらを入手するのは困難です。

これらの問題に対処するため、北京大学の研究チームは、MediCLIP と呼ばれる効率的な少数サンプルの医療画像異常検出ソリューションを提案しました。この方法では、少量の通常の医療画像のみで、異常検出および位置特定タスクにおいて優れたパフォーマンスを実現します。さまざまな医療画像タイプでさまざまな病気を効果的に検出し、驚異的なゼロサンプル一般化機能を発揮します。

「MediCLIP: CLIPを用いた少量サンプルの医用画像における異常検出」HyperAI の公式 Web サイト (hyper.ai) のチュートリアル セクションで、非常に効果的なインテリジェント医療画像診断方法を体験してください。

チュートリアルのリンク:

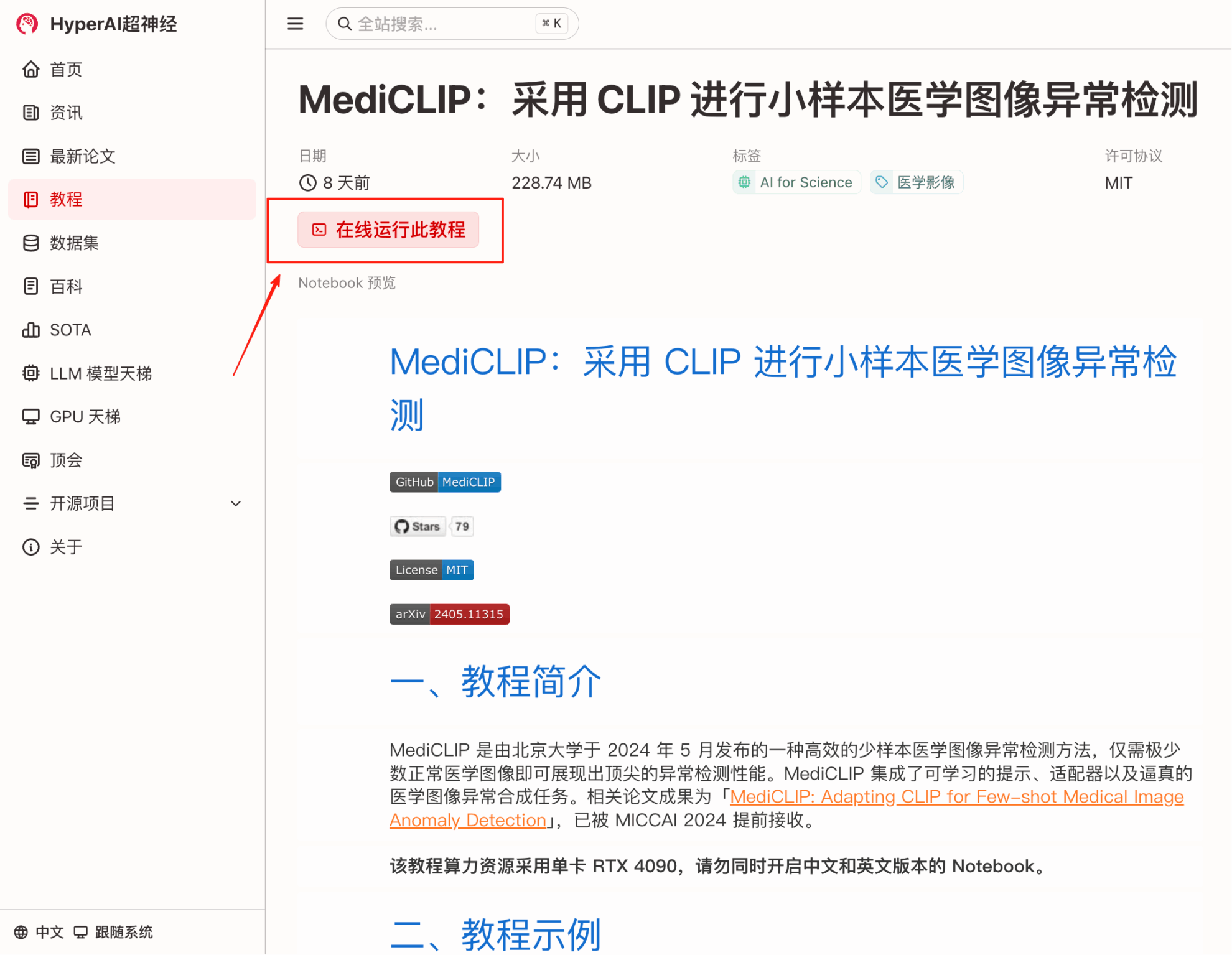

デモの実行

1. hyper.ai ホームページで「チュートリアル」ページを選択し、「MediCLIP: CLIP を使用した小規模医療画像の異常検出」を選択して、「このチュートリアルをオンラインで実行」をクリックします。

2. ページがジャンプしたら、右上隅の「クローン」をクリックしてチュートリアルを独自のコンテナにクローンします。

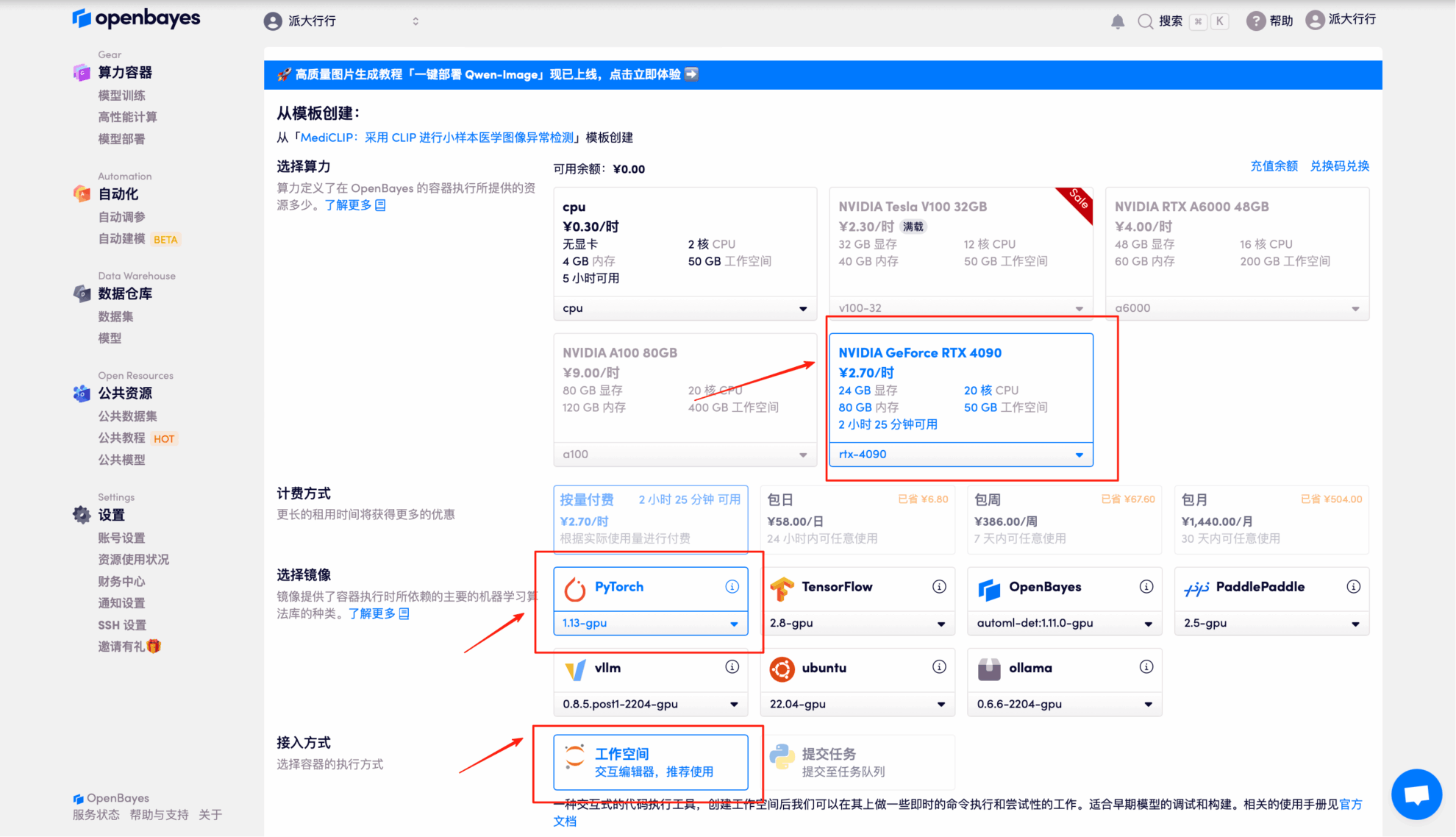

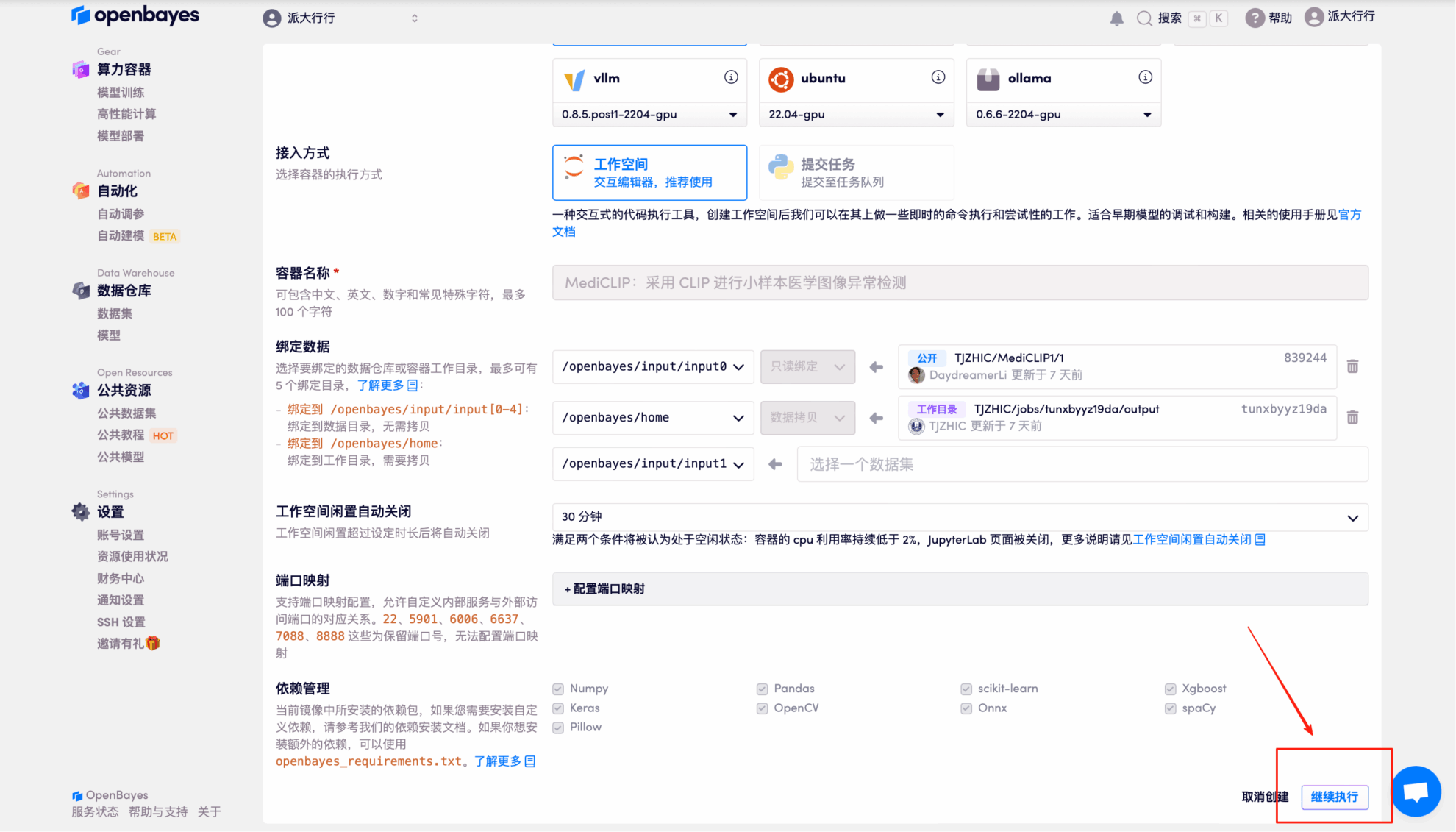

3. NVIDIA GeForce RTX 4090 と PyTorch イメージを選択し、「続行」をクリックします。 OpenBayes プラットフォームは 4 つの課金方法を提供します。ニーズに応じて、「従量課金制」または「日次/週次/月次」を選択できます。新規ユーザーは、以下の招待リンクを使用して登録すると、4 時間の RTX 4090 + 5 時間の CPU フリー時間を獲得できます。

HyperAI ハイパーニューラルの専用招待リンク (ブラウザに直接コピーして開きます):

https://openbayes.com/console/signup?r=Ada0322_NR0n

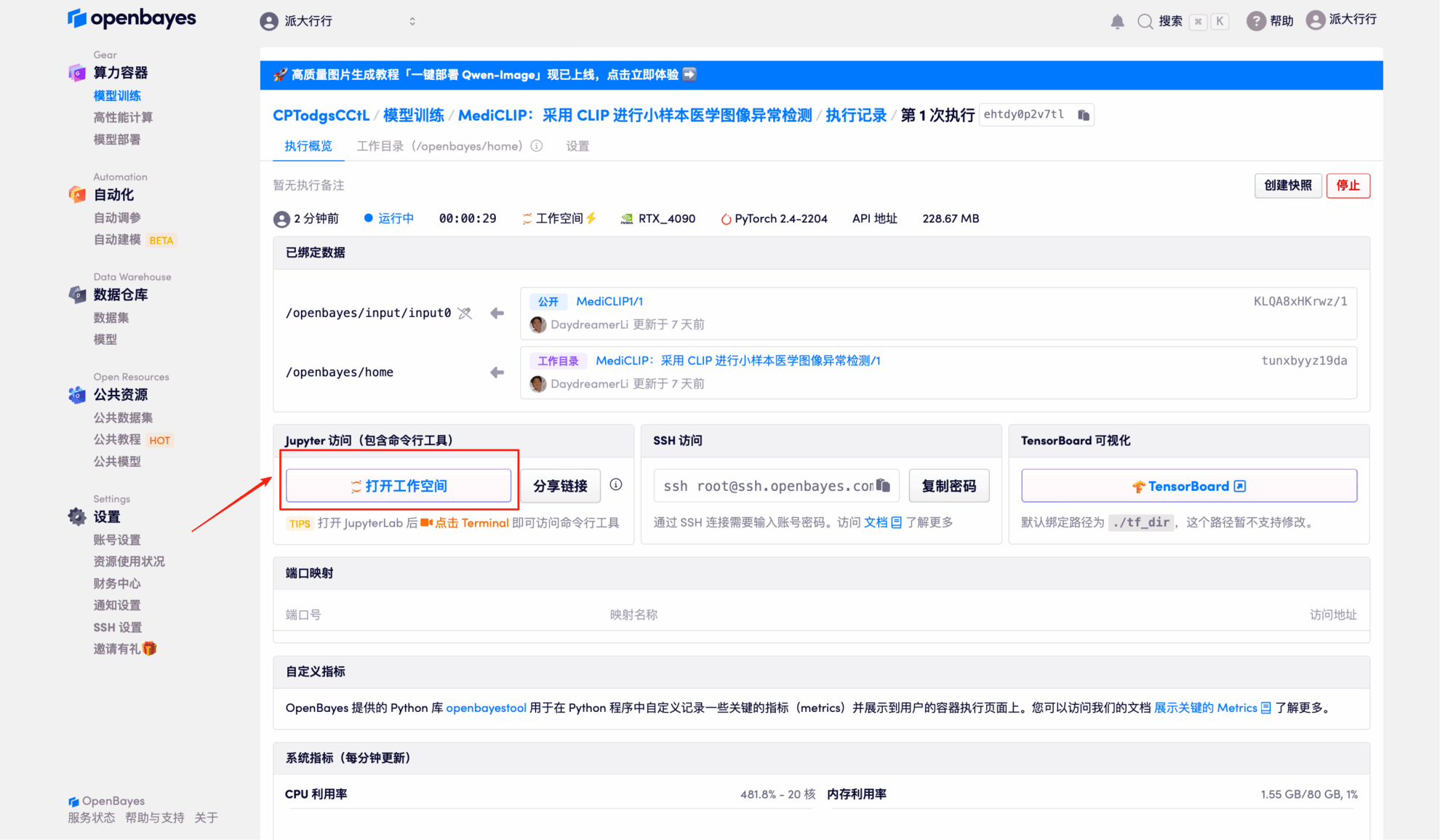

4. リソースが割り当てられるのを待ちます。最初のクローン作成には約2分かかります。ステータスが「実行中」に変わったら、「ワークスペースを開く」をクリックします。

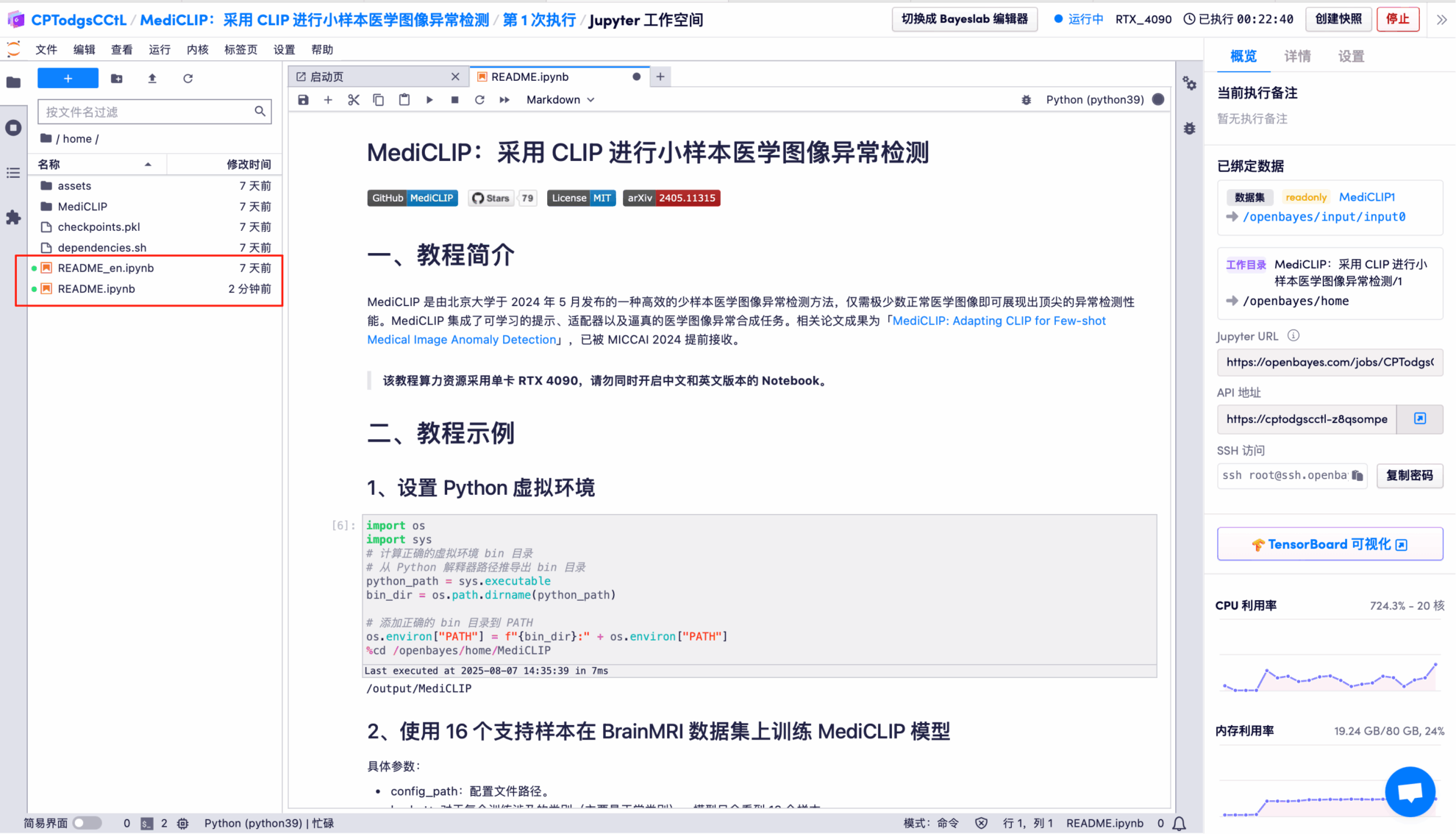

5. 左側のディレクトリにあるプロジェクト名をダブルクリックして使用を開始します。注:このチュートリアルでは、RTX 4090 GPUを1つ使用します。ノートブックの中国語版と英語版を同時に開かず、どちらか一方だけを開いてください。README.ipynbの使用をお勧めします(中国語版の方が読みやすいです)。

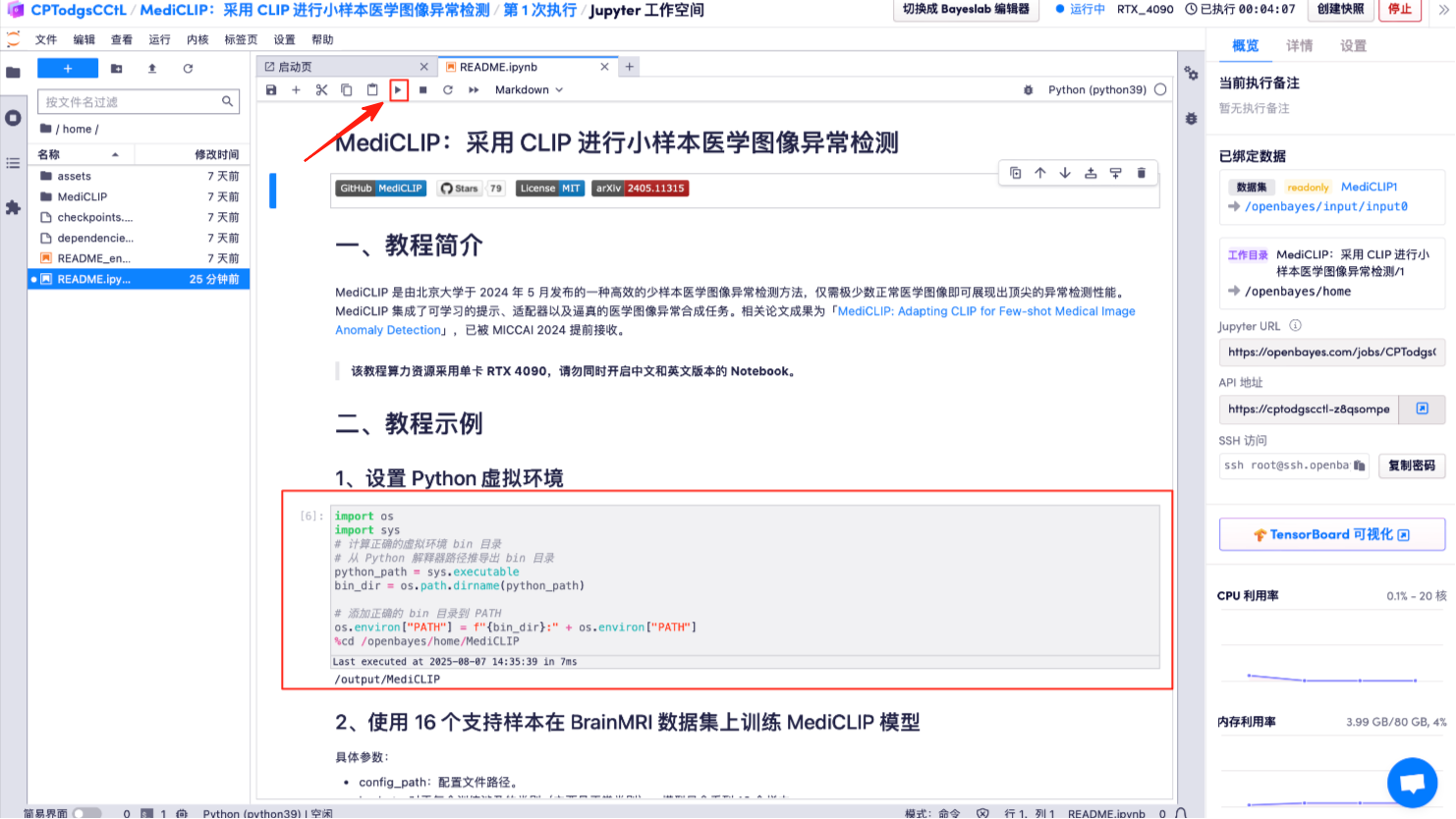

6. 上の「実行ボタン」をクリックして、Python 仮想環境を設定します。

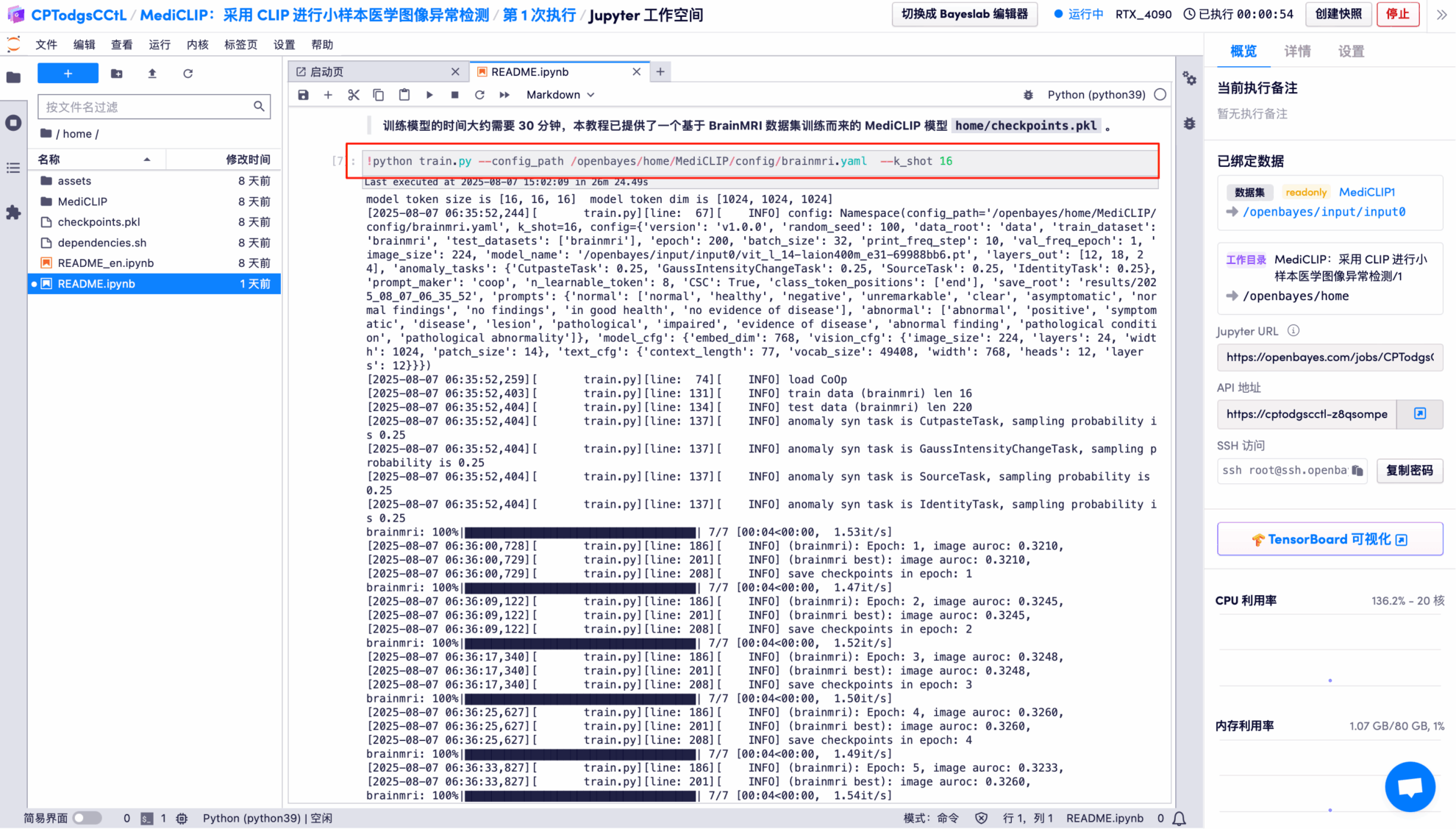

7. 16 個のサポート サンプルを使用して BrainMRI データセットでトレーニングされた MediCLIP モデル。

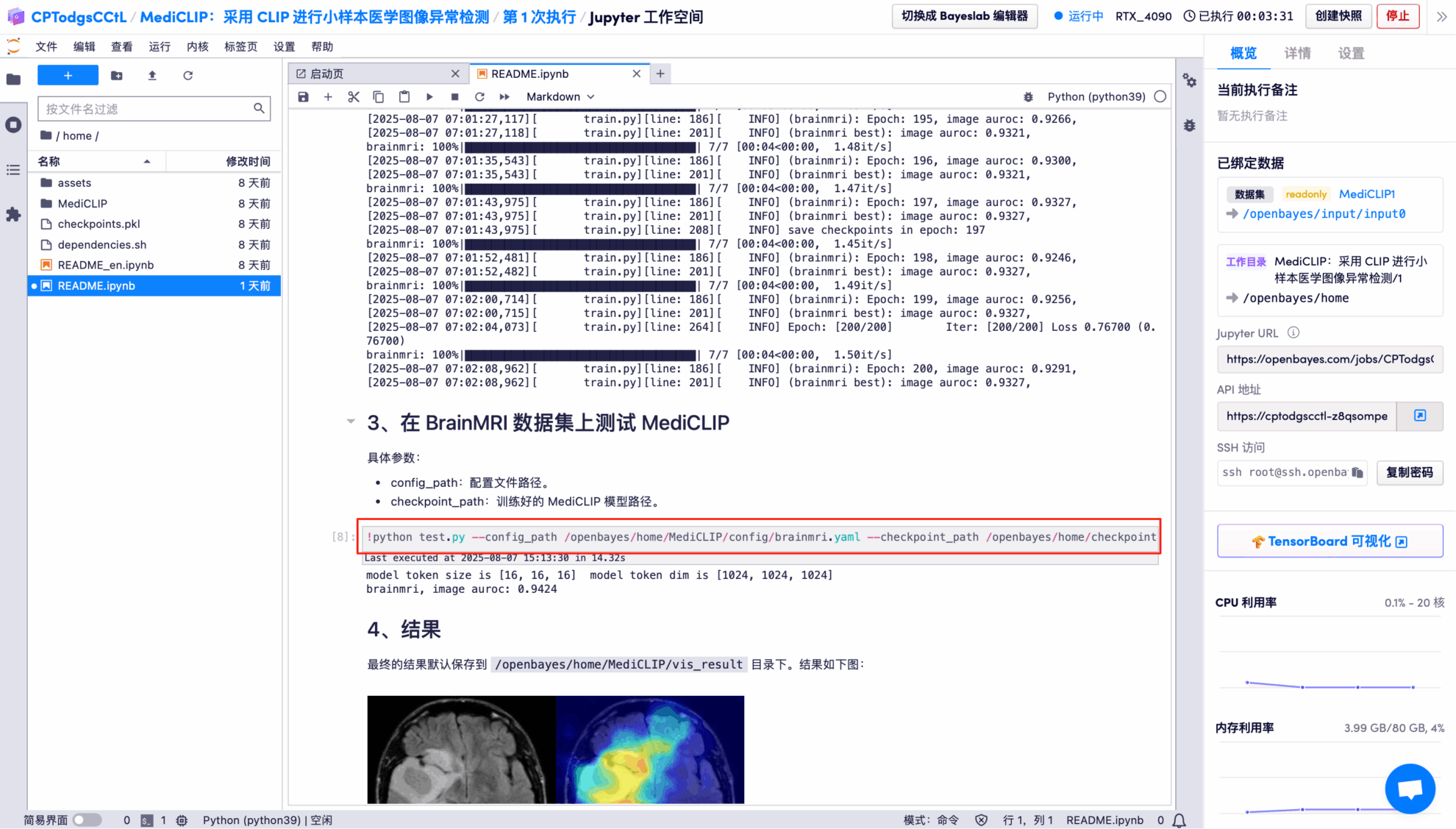

8. トレーニング済みのモデルを使用して BrainMRI データセットをテストします。

効果実証

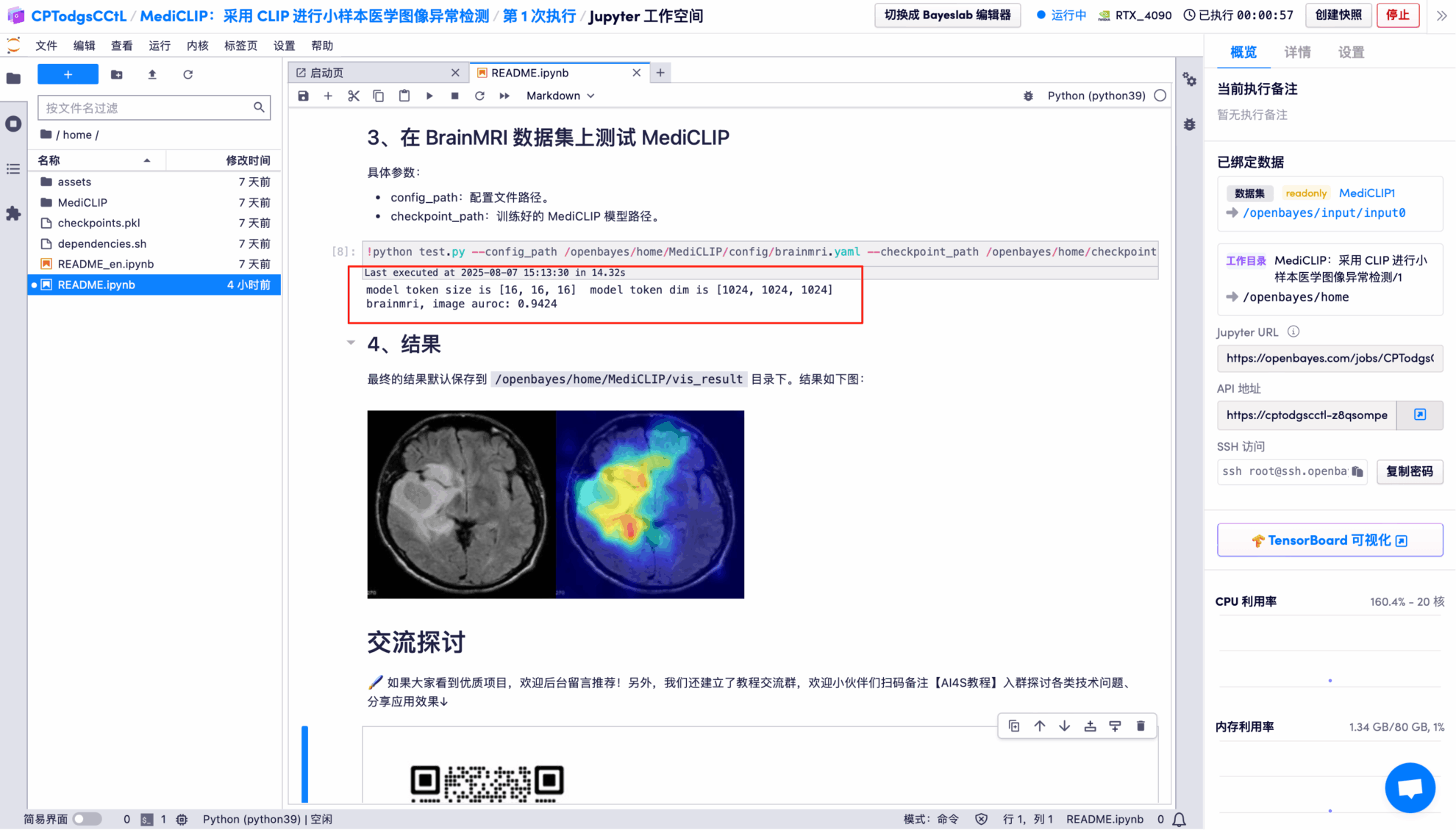

出力結果を見ると、このモデルは BrainMRI テスト セット上の画像のバイナリ分類において、AUROC が 0.9424 (満点の 1 に近い) と非常に優れたパフォーマンスを示していることがわかります。

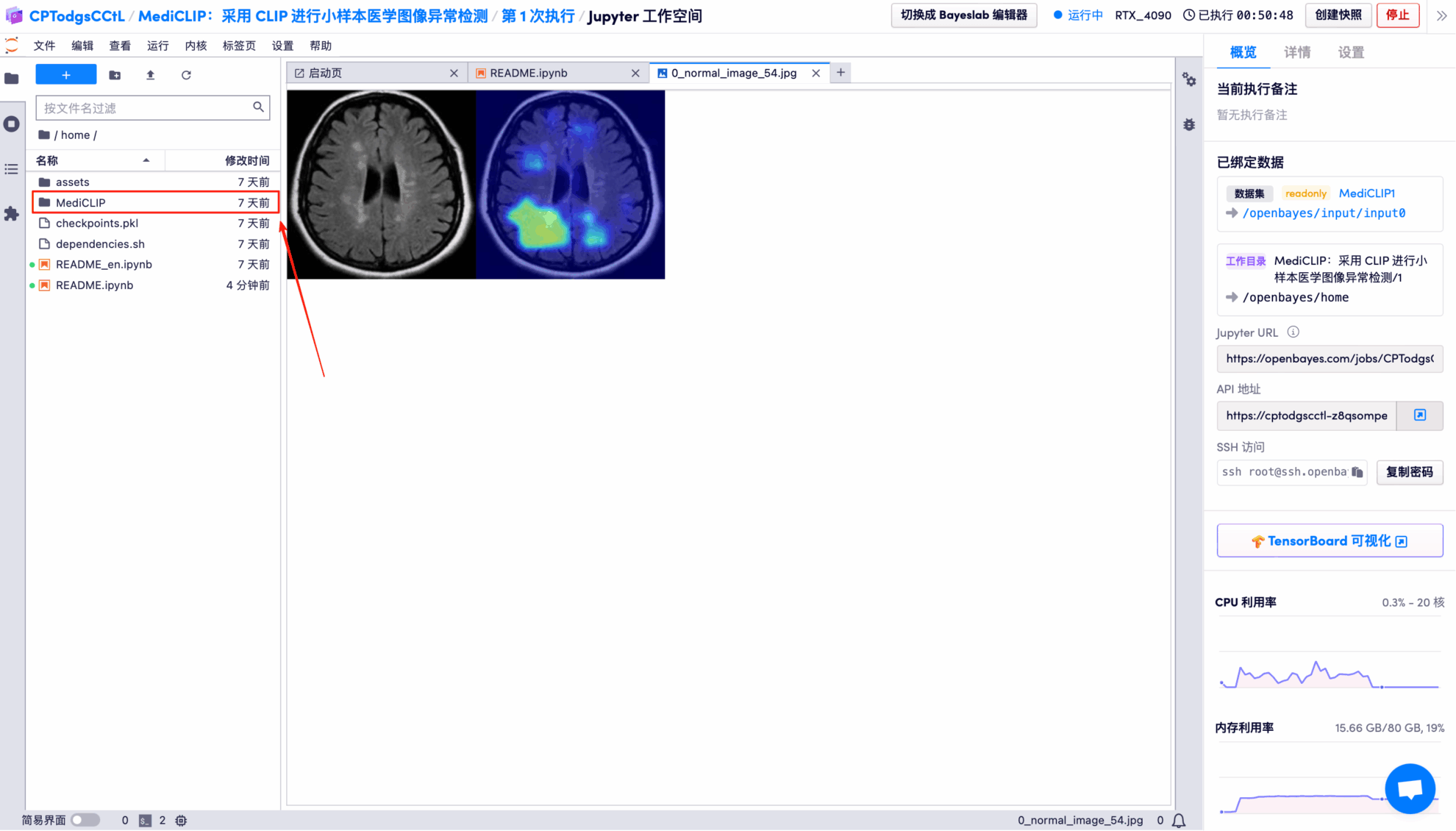

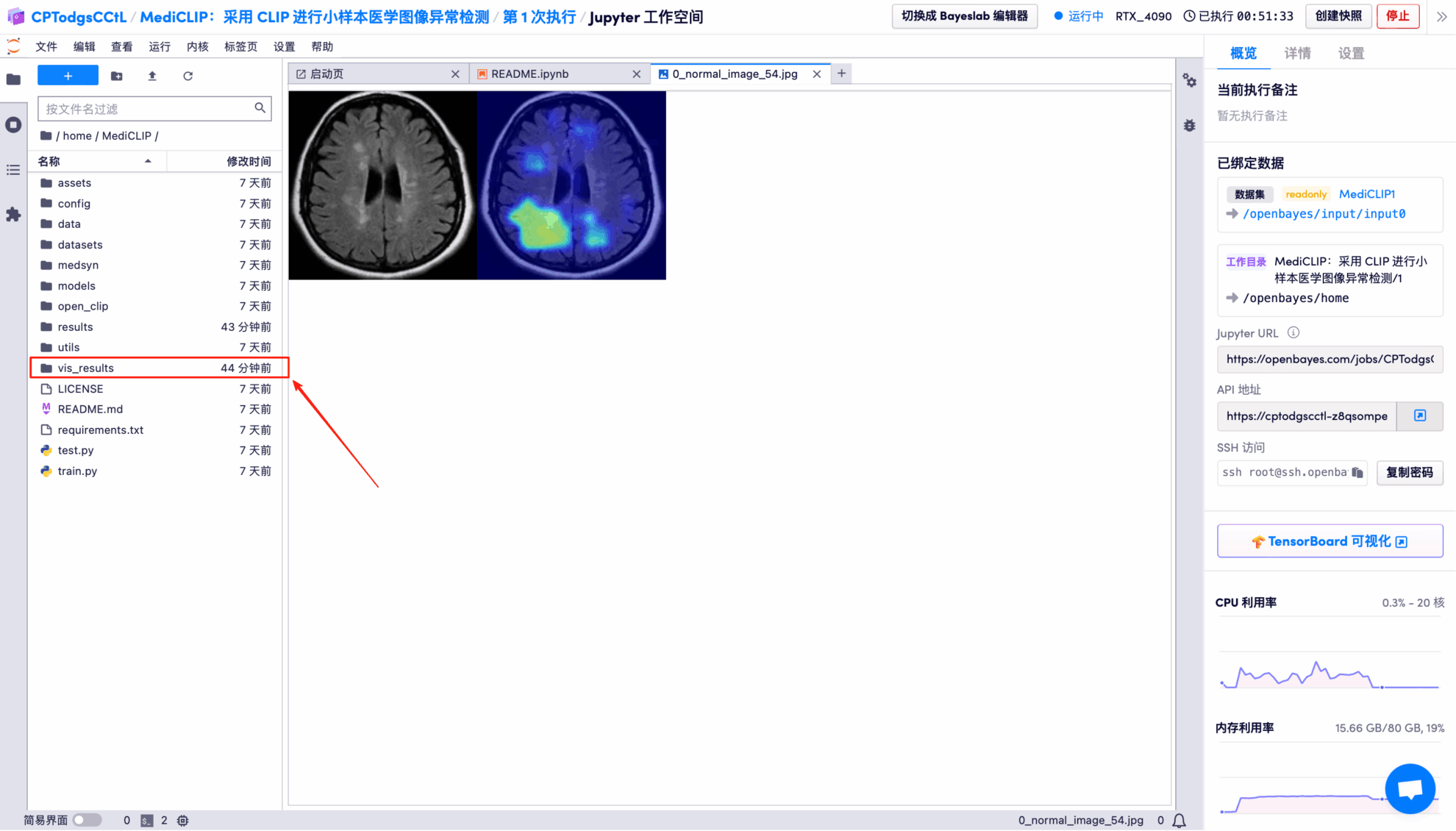

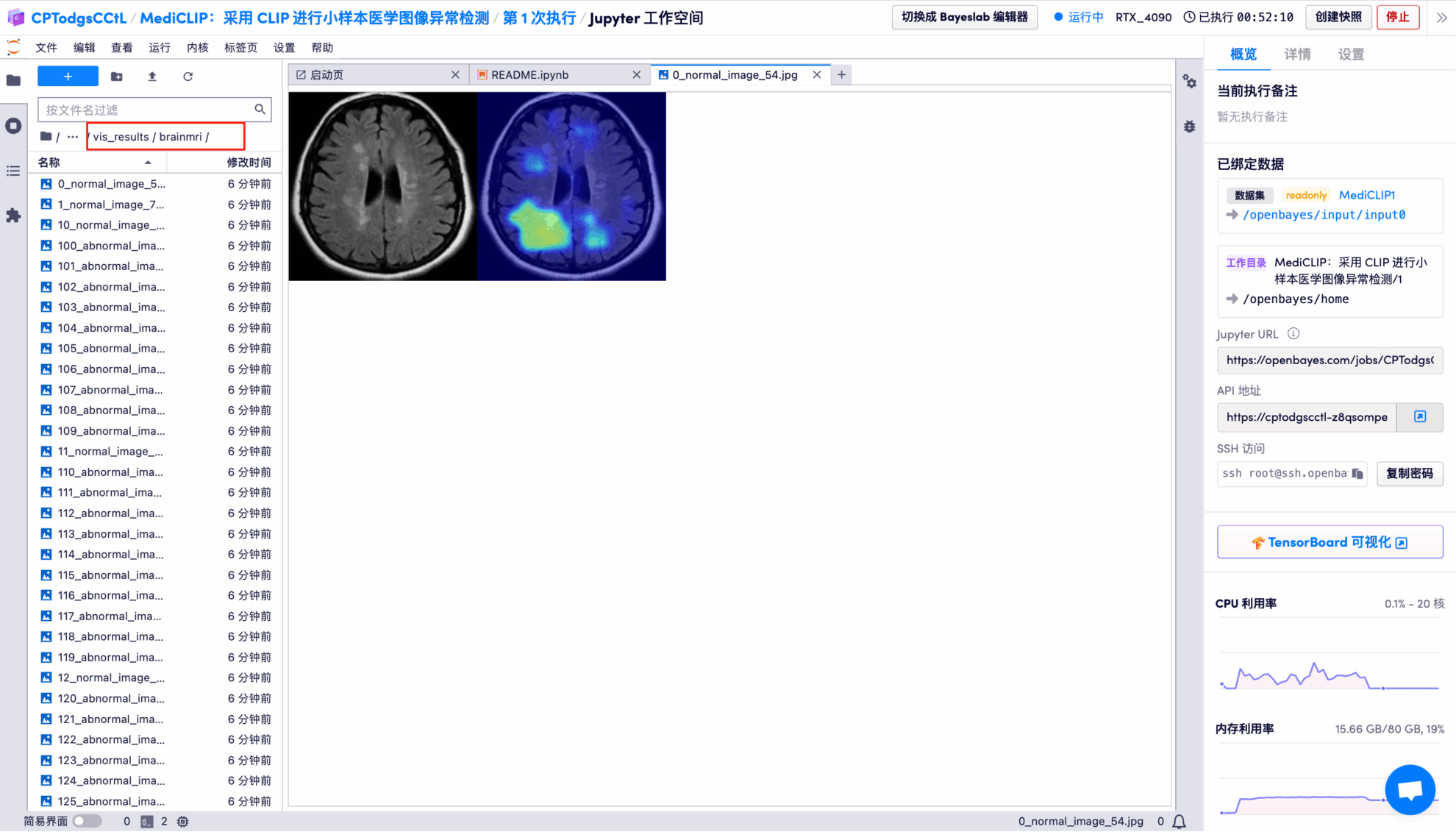

各テスト画像に対するモデルの視覚検出結果は、デフォルトで openbayes//home/MediCLIP/vis_result ディレクトリに保存されます。具体的な保存場所は下図のとおりです。

明確かつ直感的に表示されるテスト結果画像をランダムに開きます。

* 左:元の脳画像

* 右: 強調表示された「異常領域」

以上が今回HyperAIがおすすめするチュートリアルです。ぜひ皆さんも体験してみてください!

チュートリアルのリンク: