Command Palette

Search for a command to run...

4200 Fois Plus Rapide Que Les Méthodes Traditionnelles ! L'ETH Zurich Propose NOBLE, Le Premier Cadre De Modélisation Neuronale Validé Avec Des Données Corticales humaines.

La manière dont le cerveau humain façonne les fonctions cognitives grâce à des circuits complexes composés de centaines de neurones demeure un mystère profond et non résolu en sciences de la vie. Au cours de la dernière décennie, grâce à l'accumulation de données multimodales en électrophysiologie, morphologie et transcriptomique, les scientifiques ont progressivement mis en évidence l'hétérogénéité significative des neurones humains en termes d'expression génique, de structure morphologique et de propriétés électrophysiologiques. Cependant, la façon dont ces différences affectent le traitement de l'information par le cerveau – par exemple, le lien intrinsèque entre l'expression de gènes spécifiques et les maladies neurologiques – reste une question ouverte.

Traditionnellement, les chercheurs utilisent des modèles basés sur des équations aux dérivées partielles (EDP) multicompartimentales tridimensionnelles pour simuler l'activité neuronale. Bien que ces modèles puissent reproduire relativement bien le réalisme biologique,Cependant, elle présente un défaut fatal : son coût de calcul est extrêmement élevé.L'optimisation d'un modèle de neurone unique peut consommer environ 600 000 heures de calcul, et même de légères modifications des paramètres peuvent facilement entraîner des écarts importants entre les résultats de simulation et les données expérimentales. Plus important encore, ces modèles déterministes peinent à reproduire la variabilité intrinsèque observée lors des expériences ; même avec une même entrée, un même neurone peut produire des réponses électrophysiologiques différentes. De plus, l'introduction artificielle d'aléatoire induit souvent des interférences non mécaniques, ce qui affaiblit encore la fiabilité des prédictions du modèle.

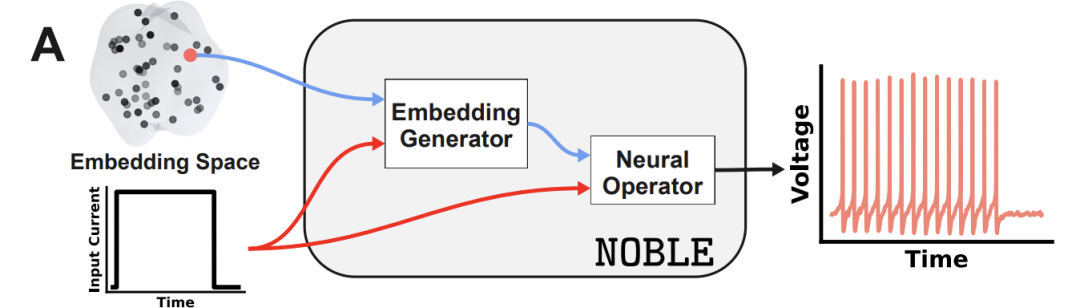

Pour relever ces défis, une équipe conjointe d'institutions telles que l'ETH Zurich, Caltech et l'Université de l'Alberta...Un cadre d'apprentissage profond appelé NOBLE (Neural Operator with Biologically-informed Latent Embeddings) est proposé.

L'innovation de ce cadre réside dans,Il s'agit du premier cadre d'apprentissage profond à grande échelle à valider ses performances à l'aide de données expérimentales provenant du cortex cérébral humain, et du premier à réaliser l'apprentissage direct de la dynamique non linéaire des neurones à partir de données expérimentales.Son innovation majeure réside dans la construction d'un « opérateur neuronal » unifié.Il est possible de mapper l'espace latent continu des caractéristiques neuronales à un ensemble de réponses de tension sans avoir à entraîner un système alternatif distinct pour chaque modèle. Lors de tests sur l'ensemble de données de neurones positifs à la pvalbumine (PVALB), NOBLE a non seulement reproduit avec précision la dynamique sous-seuil et de décharge de 50 modèles connus et de 10 modèles inédits, mais sa vitesse de simulation était également 4 200 fois supérieure à celle des solveurs numériques traditionnels.

Les résultats de recherche associés, intitulés « NOBLE – Opérateur neuronal avec des plongements latents informés biologiquement pour capturer la variabilité expérimentale dans les modèles de neurones biologiques », ont été acceptés pour NeurIPS 2025.

Adresse du document :

Suivez notre compte WeChat officiel et répondez « NOBLE » en arrière-plan pour obtenir le PDF complet.

Autres articles sur les frontières de l'IA :

https://hyper.ai/papers

Ensemble de données : Couvre 60 modèles HoF, 250 générations d’optimisation évolutive et 16 indicateurs physiologiques.

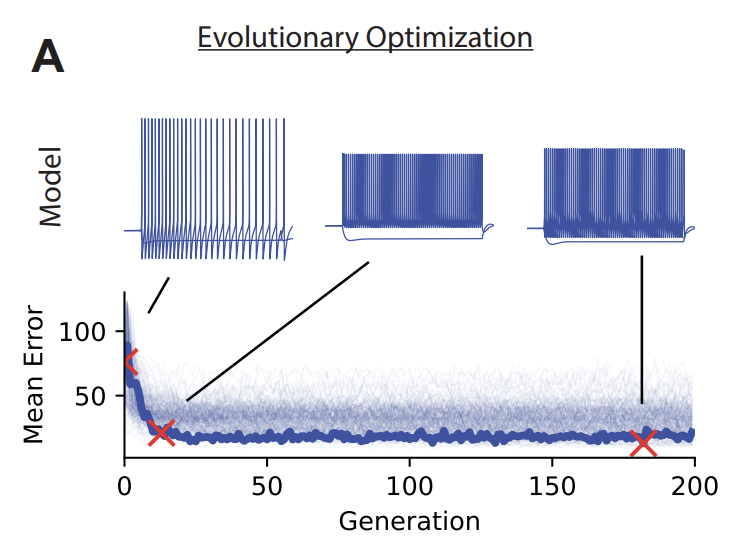

Pour valider l'efficacité du cadre NOBLE, l'équipe de recherche a construit un ensemble de données dédié contenant des neurones positifs à l'albumine (PVALB), dérivé des résultats de simulations de modèles bioréalistes de neurones corticaux humains.Ces modèles sont construits sur l'environnement de simulation NEURON et utilisent une configuration de canaux ioniques « entièrement actifs ».Le système a été généré à l'aide d'un cadre d'optimisation évolutionnaire multi-objectif, visant à reproduire les caractéristiques électrophysiologiques enregistrées lors des expériences.

Plus précisément, l'ensemble de données contient 60 modèles HoF, dont 50 sont utilisés pour l'entraînement (modèles de distribution) et 10 sont utilisés comme modèles non vus pour les tests (modèles hors distribution).Comme illustré ci-dessous, chaque modèle subit 250 générations d'optimisation évolutionnaire, en collectant les réponses en tension de chaque génération. Les équations du câble sont ensuite transformées en un système d'équations différentielles ordinaires couplées par discrétisation spatiale. Enfin, la combinaison de paramètres minimisant l'erreur moyenne du score z entre les caractéristiques simulées et expérimentales est sélectionnée.

Le processus de génération de données utilise une stratégie d'optimisation en deux étapes : il ajuste d'abord la réponse passive en régime sous-seuil, puis il capture la dynamique active et les courbes fréquence-courant complètes au-dessus du seuil de crête. Les données de séries temporelles sont échantillonnées pendant 515 ms avec un pas de temps de 0,02 ms. Après un sous-échantillonnage temporel trois fois supérieur, 8 583 points temporels sont conservés, ce qui évite les effets de repliement de spectre et réduit la charge de calcul.

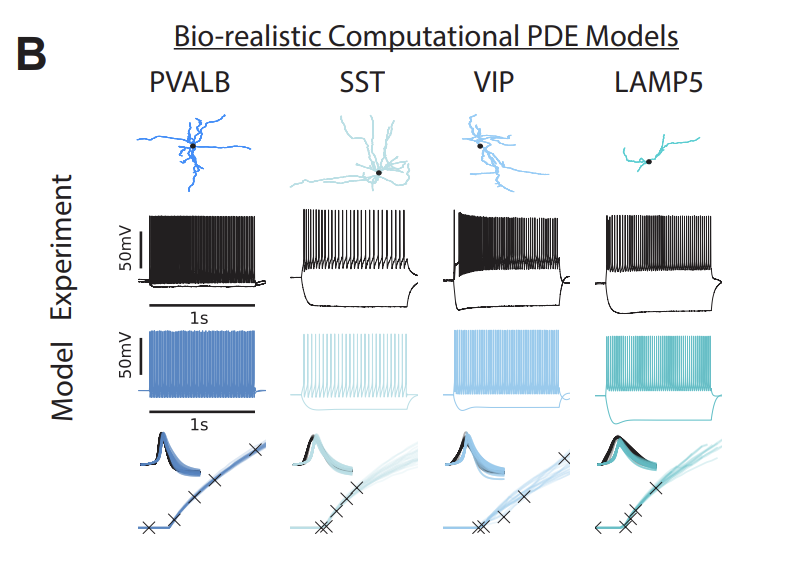

Comme le montre la figure ci-dessous, outre la courbe de variation de tension,L'ensemble de données comprend également des annotations pour 16 « indicateurs physiologiques » clés.L'ensemble de données comprend des motifs d'affichage (première ligne), des tracés de tension expérimentaux (deuxième ligne), des tracés de tension simulés (troisième ligne), des formes d'onde de potentiels d'action (quatrième ligne) et des courbes fréquence-courant (cinquième ligne), offrant ainsi un standard complet pour l'évaluation des modèles d'IA. Cette conception permet à la fois d'entraîner l'IA à prédire les réponses neuronales et d'évaluer la qualité de ces prédictions, aboutissant à une approche intégrée d'« enseignement, d'entraînement et de test ».

NOBLE : Un cadre d'opérateurs neuronaux piloté par FNO et intégré dans des entrées doubles.

L'innovation fondamentale du framework NOBLE réside dans son intégration profonde des opérateurs neuronaux avec des techniques d'intégration potentielles en bioinformatique.Un système de cartographie de bout en bout, reliant les caractéristiques neuronales aux réponses de tension, a été conçu. Ce système peut être assimilé à un « traducteur de signaux neuronaux ». Son architecture sous-jacente repose sur les opérateurs neuronaux de Fourier (ONF), et son principal atout réside dans sa capacité à traiter efficacement les données spatio-temporelles de l'électrophysiologie neuronale. Les ONF empruntent des concepts au traitement du signal audio, analysant des signaux électrophysiologiques échantillonnés à intervalles réguliers dans le domaine fréquentiel grâce à la transformée de Fourier rapide (FFT). Ils constituent ainsi un outil de calcul spécifiquement adapté à la recherche sur la dynamique neuronale.

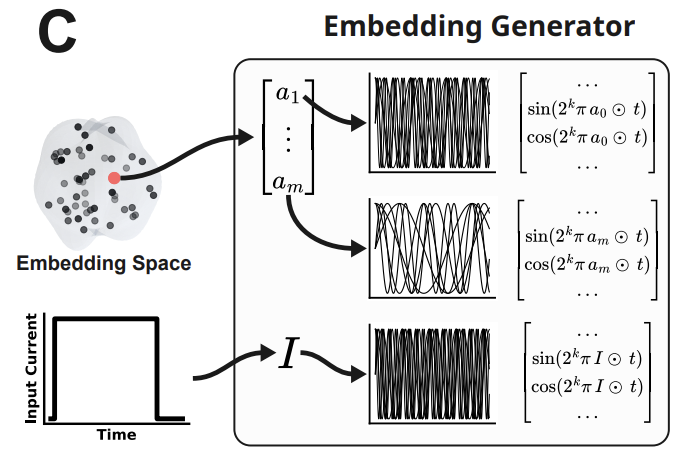

La capacité de « traduction » du modèle découle de deux conceptions clés d'intégration des entrées : l'intégration des caractéristiques neuronales et l'intégration de l'injection de courant.

La première méthode sélectionne deux indicateurs biologiquement interprétables, le courant seuil (Ithr) et la pente locale (sthr), comme caractéristiques principales. Celles-ci sont d'abord normalisées sur l'intervalle [0,5 ; 3,5]², puis converties en une série temporelle à l'aide d'un codage par fonction trigonométrique de type NeRF. Ceci fournit au modèle un véritable « manuel des paramètres matériels » pour les neurones, définissant clairement leurs principales propriétés électrophysiologiques. La seconde méthode emploie une stratégie de codage multifréquence à K = 9, correspondant aux paramètres d'excitation du courant d'entrée. Comme illustré dans la figure ci-dessous, les deux ensembles de canaux d'entrée empilés alignent efficacement les caractéristiques de faible dimension avec la méthode de traitement fréquentiel de FNO, améliorant considérablement la capacité du modèle à capturer la dynamique haute fréquence des signaux neuronaux.

En termes de structure de réseau, NOBLE contient 12 couches cachées.Chaque couche possède 24 canaux et utilise 256 modes de Fourier, ce qui représente environ 1,8 million de paramètres de modèle, équivalent à la construction d'une connexion neuronale simulée de même échelle. Le processus d'entraînement adopte une stratégie d'apprentissage personnalisé : grâce à l'optimiseur Adam avec un taux d'apprentissage initial de 0,004, associé à la stratégie d'ordonnancement ReduceLROnPlateau et à l'utilisation de l'erreur L4 relative comme fonction de perte, le modèle assimile rapidement les principes fondamentaux et ajuste automatiquement son rythme d'apprentissage en cas de goulots d'étranglement. Contrairement aux méthodes traditionnelles, NOBLE ne nécessite pas l'entraînement d'un modèle de substitution distinct pour chaque neurone ; il réalise plutôt une cartographie continue de l'espace du modèle neuronal entier grâce à un unique opérateur neuronal. Ceci lui permet de générer des réponses neuronales inédites d'un réalisme biologique grâce à l'interpolation dans l'espace latent.

De plus, NOBLE offre une grande flexibilité d'adaptation pour un « raffinement spécifique », permettant un réglage fin basé sur des informations physiques pour des caractéristiques électrophysiologiques spécifiques. Grâce à l'introduction d'une fonction de perte composite pondérée L(λ), les caractéristiques cibles (telles que l'amplitude de l'affaissement) peuvent se voir attribuer des pondérations plus élevées, améliorant ainsi la précision de la modélisation des indicateurs clés sans affecter les performances globales de prédiction.

NOBLE capture avec précision diverses dynamiques neuronales et est 4200 fois plus rapide que les solveurs traditionnels.

Évaluer systématiquement la performance globale du cadre NOBLEL'équipe de recherche a conçu des expériences multidimensionnelles autour de cinq axes principaux, notamment la précision de base, la capacité de généralisation, l'efficacité de calcul, la capacité de génération d'innovations et la vérification de l'efficacité des modules de base.L'expérience a utilisé 50 modèles HoF de neurones positifs à l'albumine (PVALB) comme principales données d'entraînement, et la précision de la prédiction du modèle a été quantifiée par l'erreur L2 relative et plusieurs indicateurs électrophysiologiques clés.

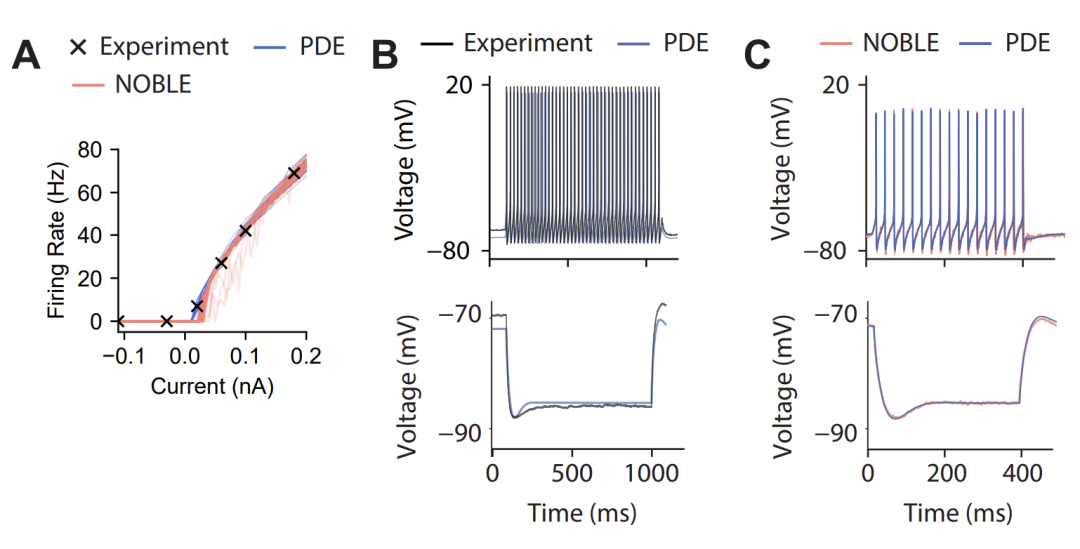

En ce qui concerne la précision de base (tests en cours de distribution),NOBLE présente toujours une excellente capacité de prédiction pour les signaux d'injection de courant non utilisés pour l'entraînement, avec une erreur L2 relative aussi faible que 2,18%. De plus, comme illustré dans la figure ci-dessous, les chercheurs ont comparé les trajectoires de tension entre les données expérimentales, les simulations PDE et les prédictions de NOBLE pour des injections de courant de 0,1 nA et -0,11 nA. Les résultats montrent une forte concordance entre les simulations PDE et les données expérimentales, tandis que l'écart entre les prédictions de NOBLE et les simulations PDE est minime. Ceci indique que NOBLE reproduit la précision du solveur numérique et capture fidèlement les dynamiques physiologiques clés.

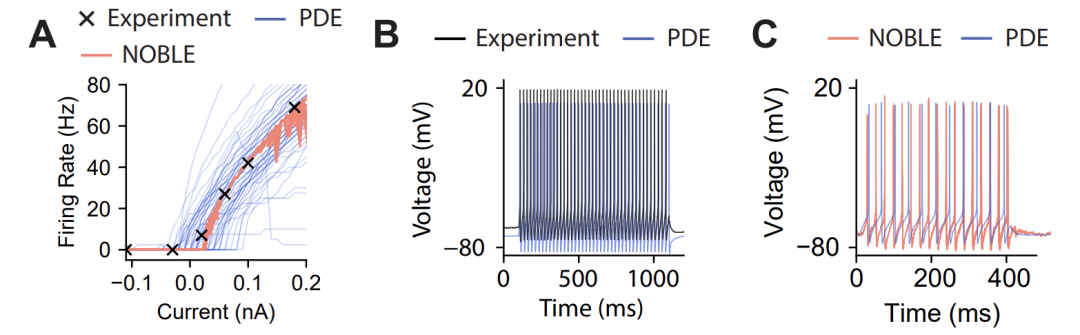

Dans l'évaluation de la capacité de généralisation (test hors distribution),NOBLE a conservé une précision de prédiction élevée même face à 10 modèles HoF inédits. L'équipe de recherche l'a ensuite appliqué à des données d'interneurones du peptide intestinal vasoactif (VIP), obtenant des résultats tout aussi stables. Ceci indique que NOBLE ne se contente pas de mémoriser les caractéristiques de l'ensemble d'entraînement, mais qu'il appréhende véritablement les lois électrophysiologiques propres à chaque type cellulaire.

En termes d'efficacité de calcul,NOBLE démontre un avantage de vitesse révolutionnaire. Les résultats des tests montrent qu'il peut prédire la trajectoire d'une tension en seulement 0,5 milliseconde, tandis que les solveurs numériques traditionnels mettent 2,1 secondes pour effectuer la même simulation, soit une amélioration de vitesse d'environ 4 200 fois. Ce gain d'efficacité ouvre la voie à de futures simulations en temps réel de réseaux comportant des millions de neurones, rendant possible la modélisation informatique à l'échelle du cerveau entier.

En termes de capacités de génération d'innovation,L'équipe de recherche s'est attachée à valider la capacité de NOBLE à « interpoler et créer » de nouveaux modèles neuronaux à partir de caractéristiques neuronales connues. En interpolant aléatoirement 50 points dans un espace latent composé de (Ithr, sthr), NOBLE a généré avec succès la trajectoire de réponse en tension correspondante, avec des résultats très cohérents avec les données expérimentales réelles, démontrant ainsi un réalisme biologique. À l'inverse, les méthodes traditionnelles qui interpolent directement les paramètres d'équations aux dérivées partielles produisent d'importants artefacts non physiologiques, créant des « modèles neuronaux aberrants ». Cette comparaison souligne que NOBLE a appris les lois biophysiques sous-jacentes des neurones, au lieu de simplement ajuster les données. Une validation supplémentaire, par le biais d'expériences de prédiction d'ensemble, a montré que la distribution de tension générée par inférence parallèle basée sur 50 modèles entraînés était très cohérente avec les résultats de la simulation numérique, et que même lorsque le nombre de points d'échantillonnage a été porté à 200, le modèle généré conservait sa plausibilité biologique.

Des expériences avec des variables contrôlées ont montré qu'après la suppression de l'encodage des caractéristiques neuronales, l'erreur de prédiction est passée de 2% à 12%, prouvant que cet intégration bioinformatique est le « moteur principal » du cadre.

Lien GitHub : github.com/neuraloperator/noble

Les avancées académiques et les applications industrielles des opérateurs neuronaux se font écho.

L'intégration croisée des opérateurs neuronaux et de la modélisation des neurones suscite un profond écho dans le monde universitaire et industriel, propulsant la recherche en neurosciences de l'exploration théorique à l'application industrielle.

À la pointe de la recherche académique, le cadre de transformation d'opérateurs sensibles à la géométrie (GAOT), proposé conjointement par l'ETH Zurich et l'Université Carnegie Mellon, utilise des mécanismes d'attention multi-échelles et des techniques d'intégration géométrique.Elle permet de surmonter les difficultés liées à la modélisation de domaines géométriques complexes.Ce cadre permet, pour la première fois, un entraînement en pleine résolution sur 9 millions de nœuds de données industrielles et obtient d'excellents résultats aux tests de référence portant sur 28 équations aux dérivées partielles. Parallèlement, il améliore le débit d'entraînement de 501 TPP3T et réduit la latence d'inférence de 151 à 301 TPP3T, ouvrant la voie à une simulation précise des circuits neuronaux irréguliers.

Titre de l'article : Transformateur d'opérateurs prenant en compte la géométrie comme substitut neuronal efficace et précis pour les EDP sur des domaines arbitraires

Lien vers l'article :https://arxiv.org/abs/2505.18781

Parallèlement, le modèle « miBrain » du MIT a réalisé des progrès significatifs dans la construction d'entités neuronales.Cette plateforme tridimensionnelle intègre les six principaux types de cellules du cerveau humain.La fonction de l'unité neurovasculaire a été reproduite avec succès à l'aide d'hydrogels biomimétiques, et le rôle synergique des cellules gliales dans la maladie d'Alzheimer a été révélé grâce à l'édition génique, offrant ainsi un environnement de vérification plus réaliste sur le plan physiologique pour les opérateurs neuronaux.

Titre de l'article : Modèle miBrain humain 3D immuno-glial-neurovasculaire bio-ingénieré

Lien vers l'article :https://doi.org/10.1073/pnas.2511596122

L'industrie, quant à elle, s'engage à exploiter et à appliquer les découvertes académiques. Les frameworks open source Modulus et PhysicsNeMo de NVIDIA en sont un exemple.Elle établit les bases essentielles de l'application pratique des opérateurs neuronaux, prenant en charge des applications dans de multiples domaines, des sciences de la vie à la simulation en ingénierie.Il permet un entraînement à grande échelle grâce à une grille de 50 millions de nœuds et a été utilisé par de nombreuses entreprises industrielles pour construire des jumeaux numériques.

Dans le secteur des applications médicales, des entreprises innovantes intègrent de plus en plus la technologie des opérateurs neuronaux aux besoins cliniques. Le système de rééducation par exosquelette du membre supérieur, développé conjointement par Boling Brain-Computer Interface et l'Université du Zhejiang, a amélioré la précision de la génération des commandes motrices grâce à l'optimisation des algorithmes d'analyse des signaux neuronaux. Il a déjà permis à des patients hémiplégiques victimes d'un AVC de recouvrer leur autonomie dans les essais cliniques multicentriques.

Cette innovation collaborative entre le monde universitaire et l'industrie a accéléré la mise en place d'un cycle complet « recherche fondamentale – transformation technologique – application industrielle ». Son importance fondamentale réside dans l'association harmonieuse de la théorie des opérateurs abstraits et d'un modèle neuronal concret, ce qui améliore non seulement l'efficacité de calcul et le réalisme physiologique de la simulation neuronale, mais élargit également le champ des applications d'ingénierie.

Liens de référence :

1.https://mp.weixin.qq.com/s/HWi9wNK3idpUSXCVN_nIZQ

2.https://mp.weixin.qq.com/s/YbqtmO0eU8Fn2Y-oRdBdWQ

3.https://mp.weixin.qq.com/s/UIi30fX81Xeh5dqBPxzMPQ