Command Palette

Search for a command to run...

MiniCPM-V 4.5: Das Leistungsstärkste Edge-to-Edge-Multimodalmodell

1. Einführung in das Tutorial

MiniCPM-V 4.5 ist ein äußerst effizientes Edge-KI-Modell, das im August 2025 vom Natural Language Processing Lab der Tsinghua-Universität in Zusammenarbeit mit Wallfacer AI als Open Source veröffentlicht wurde. MiniCPM-V 4.5 benötigt nur 8 Byte an Parametern. Das Modell zeichnet sich durch seine Leistungsfähigkeit in verschiedenen Bereichen wie Bild-, Video- und OCR-Verarbeitung aus und erzielt insbesondere bei der Verarbeitung von Videos mit hoher Bildwiederholrate bahnbrechende Ergebnisse. Es ist in der Lage, Videos mit hoher Bildwiederholrate zu verarbeiten und Inhalte präzise zu erkennen. Das Modell unterstützt einen hybriden Inferenzmodus, der Leistung und Reaktionsgeschwindigkeit optimal ausbalanciert. MiniCPM-V 4.5 ist für den Einsatz auf Edge-Systemen geeignet, benötigt wenig Speicher und zeichnet sich durch eine hohe Inferenzgeschwindigkeit aus. Dadurch eignet es sich für Anwendungen in Automobilsystemen, Robotern und anderen Geräten und setzt neue Maßstäbe für die Entwicklung von Edge-KI. Zugehörige Forschungsarbeiten sind verfügbar. MiniCPM-V: Ein MLLM auf GPT-4V-Ebene auf Ihrem Telefon .

Die in diesem Tutorial verwendeten Rechenressourcen sind eine einzelne RTX 4090-Karte.

2. Effektanzeige

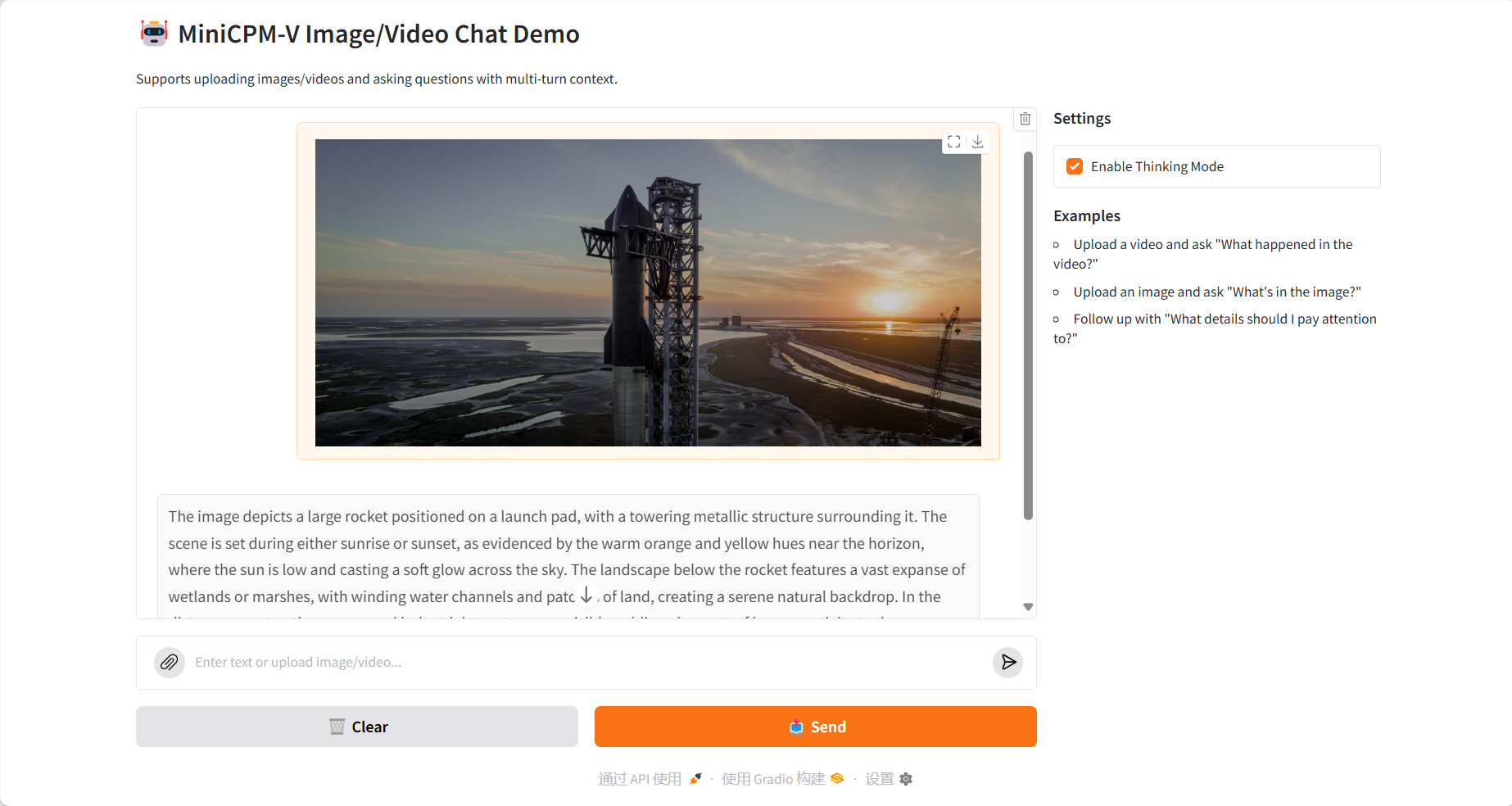

Bildverständnis

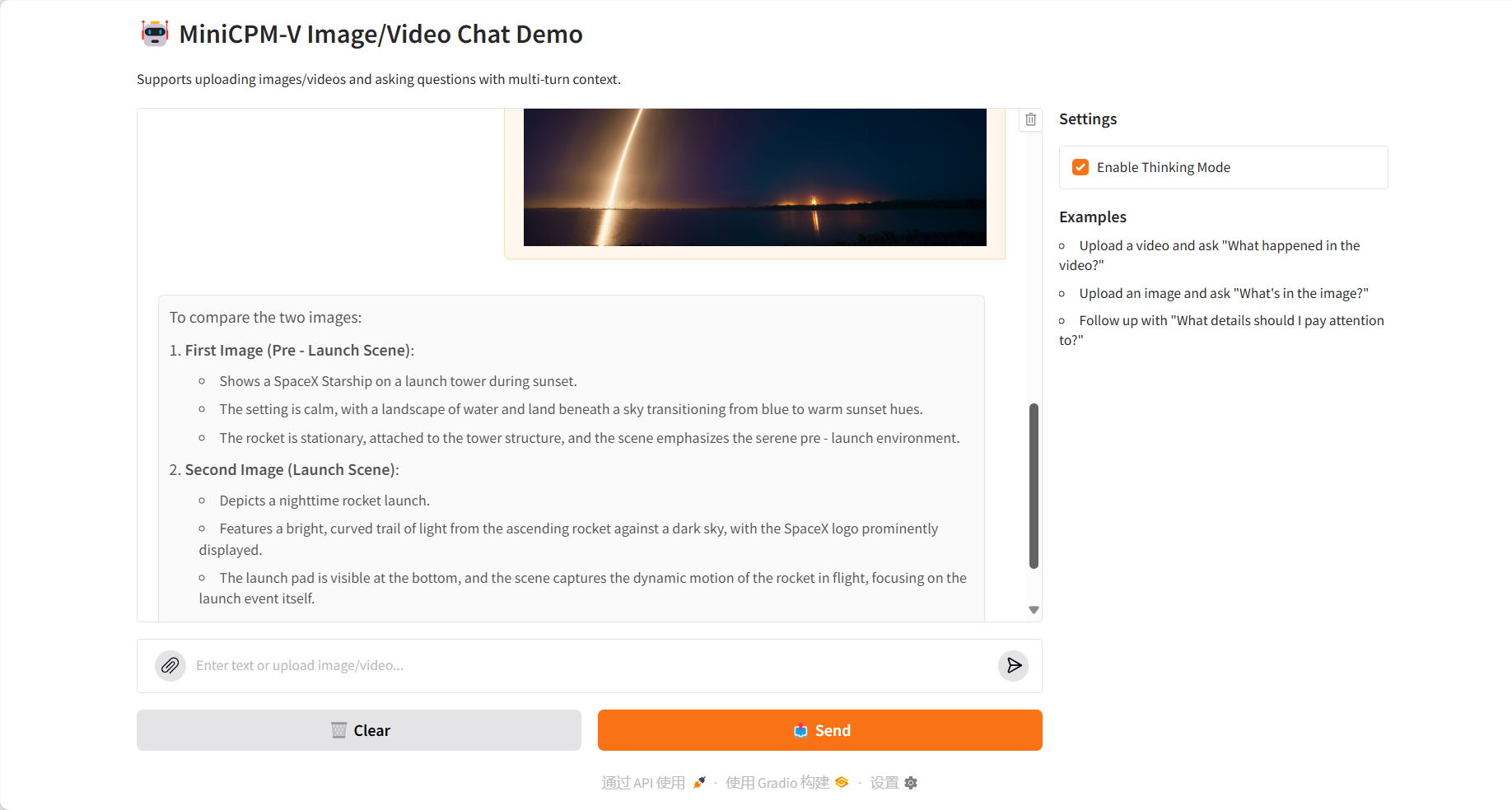

Mehrbildvergleich

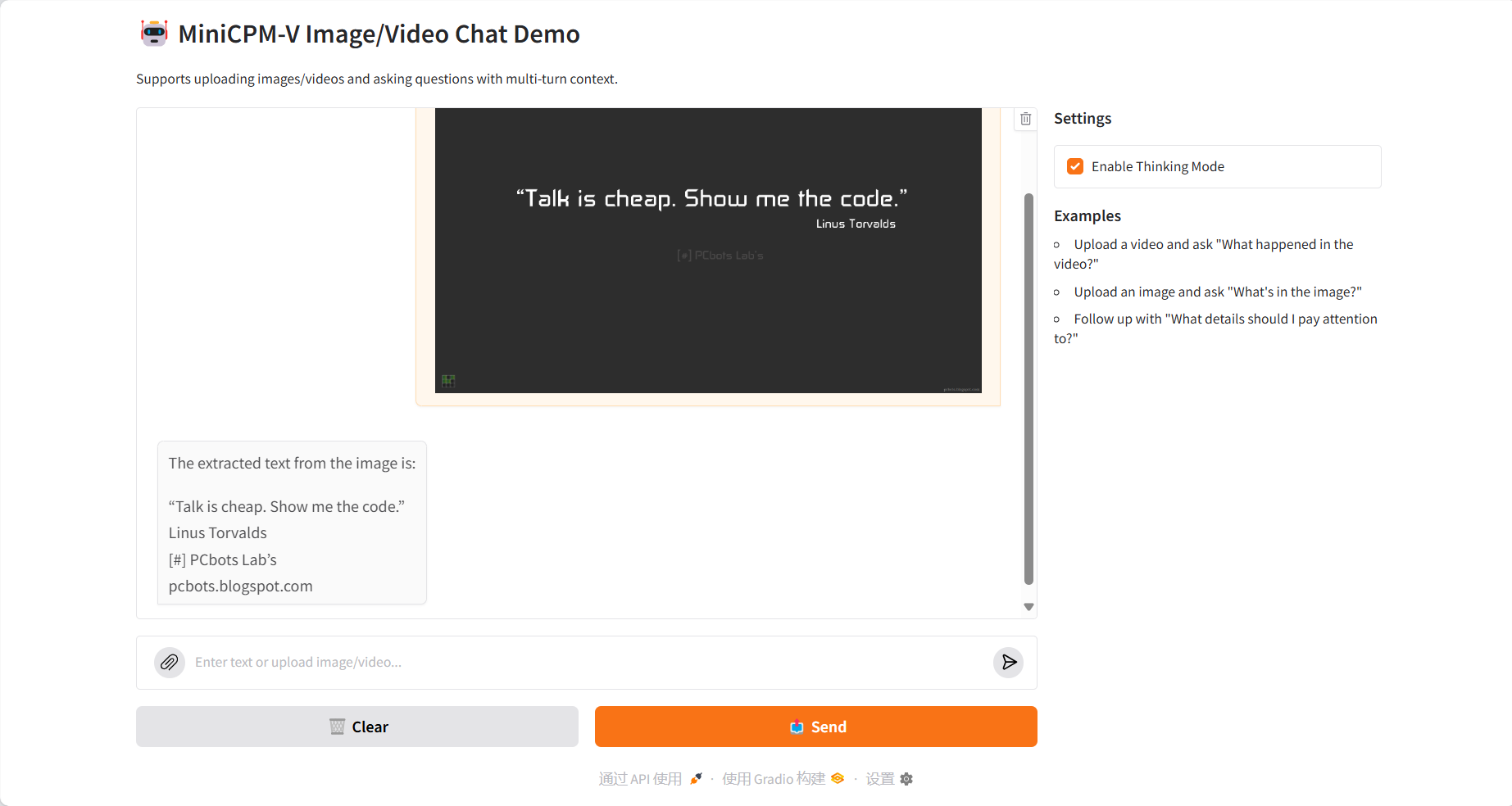

OCR-Textextraktion

Videoverständnis

3. Bedienungsschritte

1. Starten Sie den Container

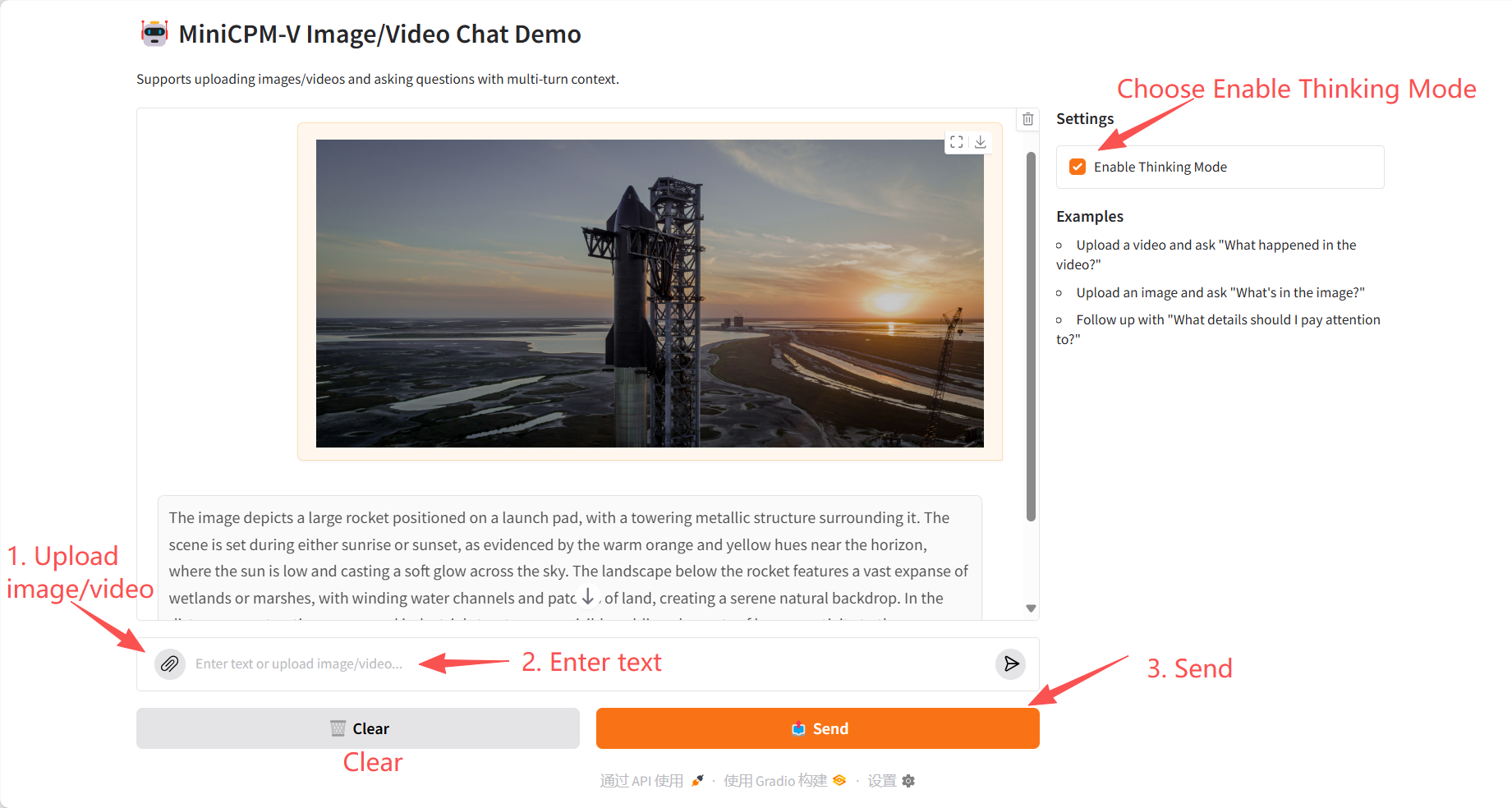

2. Anwendungsschritte

Wenn „Bad Gateway“ angezeigt wird, bedeutet dies, dass das Modell initialisiert wird. Da das Modell groß ist, warten Sie bitte etwa 2–3 Minuten und aktualisieren Sie die Seite.

4. Diskussion

🖌️ Wenn Sie ein hochwertiges Projekt sehen, hinterlassen Sie bitte im Hintergrund eine Nachricht, um es weiterzuempfehlen! Darüber hinaus haben wir auch eine Tutorien-Austauschgruppe ins Leben gerufen. Willkommen, Freunde, scannen Sie den QR-Code und kommentieren Sie [SD-Tutorial], um der Gruppe beizutreten, verschiedene technische Probleme zu besprechen und Anwendungsergebnisse auszutauschen ↓

Zitationsinformationen

Die Zitationsinformationen für dieses Projekt lauten wie folgt:

@article{yao2024minicpm,

title={MiniCPM-V: A GPT-4V Level MLLM on Your Phone},

author={Yao, Yuan and Yu, Tianyu and Zhang, Ao and Wang, Chongyi and Cui, Junbo and Zhu, Hongji and Cai, Tianchi and Li, Haoyu and Zhao, Weilin and He, Zhihui and others},

journal={arXiv preprint arXiv:2408.01800},

year={2024}

}KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.