Command Palette

Search for a command to run...

VideoLLaMA3-7Bのワンクリック展開

1. チュートリアルの概要

このチュートリアルでは、単一のRTX 4090コンピューティングリソースを使用し、モデルVideoLLaMA3-7B-Imageをデプロイし、ビデオ理解と画像理解の2つの例を示します。さらに、「単一画像理解」「複数画像理解」「視覚参照表現と配置」「ビデオ理解」の4つのノートブックスクリプトチュートリアルも提供します。

VideoLLaMA3は、2025年2月にアリババDAMOアカデミー自然言語処理チーム(DAMO-NLP-SG)によってオープンソース化されたマルチモーダル基盤モデルであり、画像と動画の理解タスクに重点を置いています。ビジョン中心のアーキテクチャと高品質なデータエンジニアリングにより、動画理解の精度と効率を大幅に向上させます。軽量版(2B)はエッジ展開のニーズに対応し、7Bモデルは研究用途向けに最高レベルのパフォーマンスを提供します。7Bモデルは、一般的な動画理解、時間的推論、長時間動画分析という3つの主要タスクにおいて、最先端(SOTA)レベルのパフォーマンスを達成しています。関連する研究論文もご覧いただけます。 VideoLLaMA 3: 画像とビデオの理解のための最先端のマルチモーダル基盤モデル 。

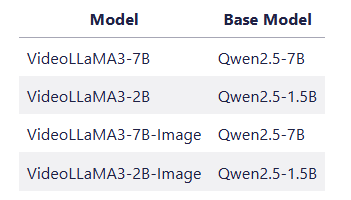

👉 このプロジェクトでは 4 つのモデルが提供されます:

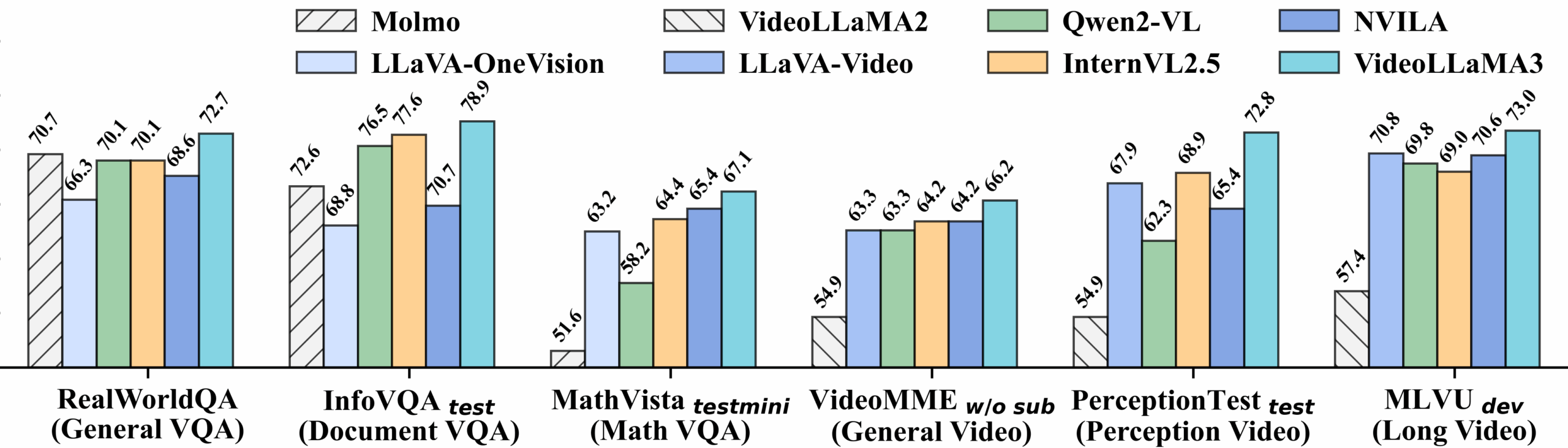

ビデオベンチマークの詳細なパフォーマンス:

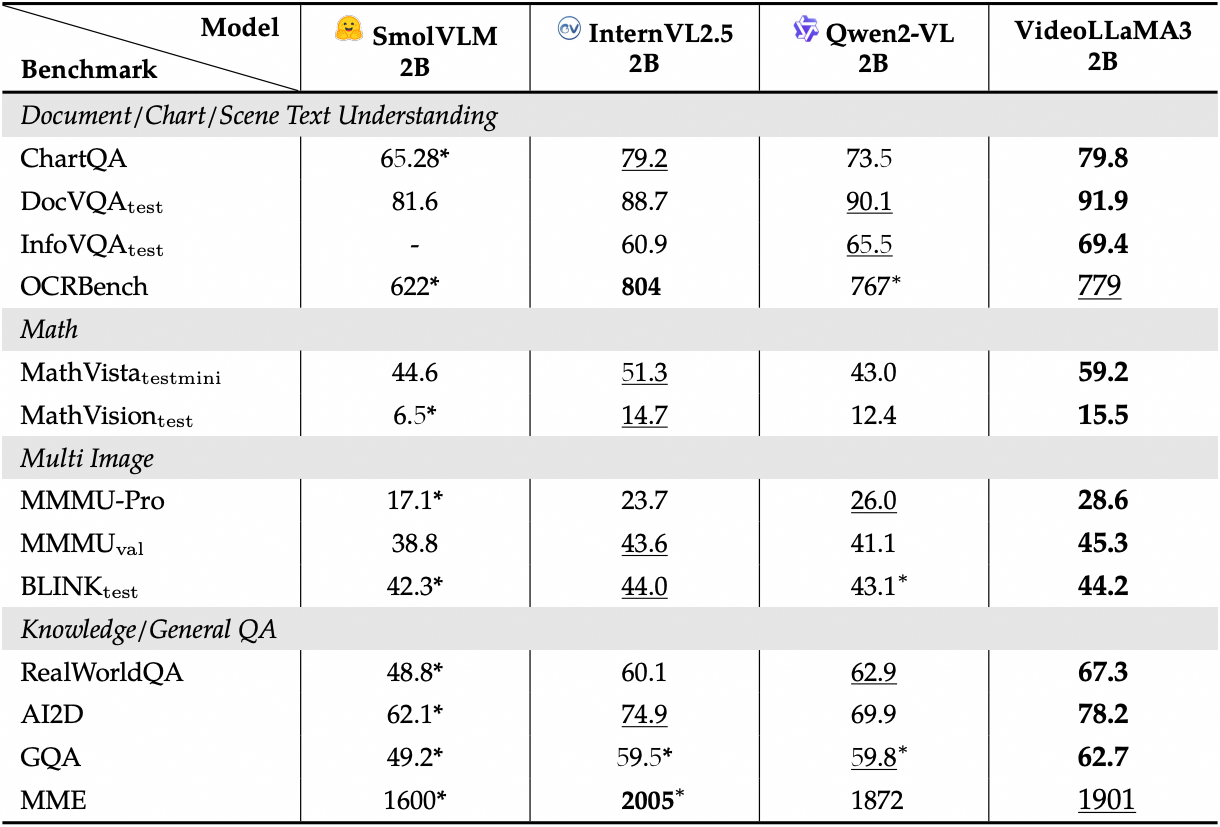

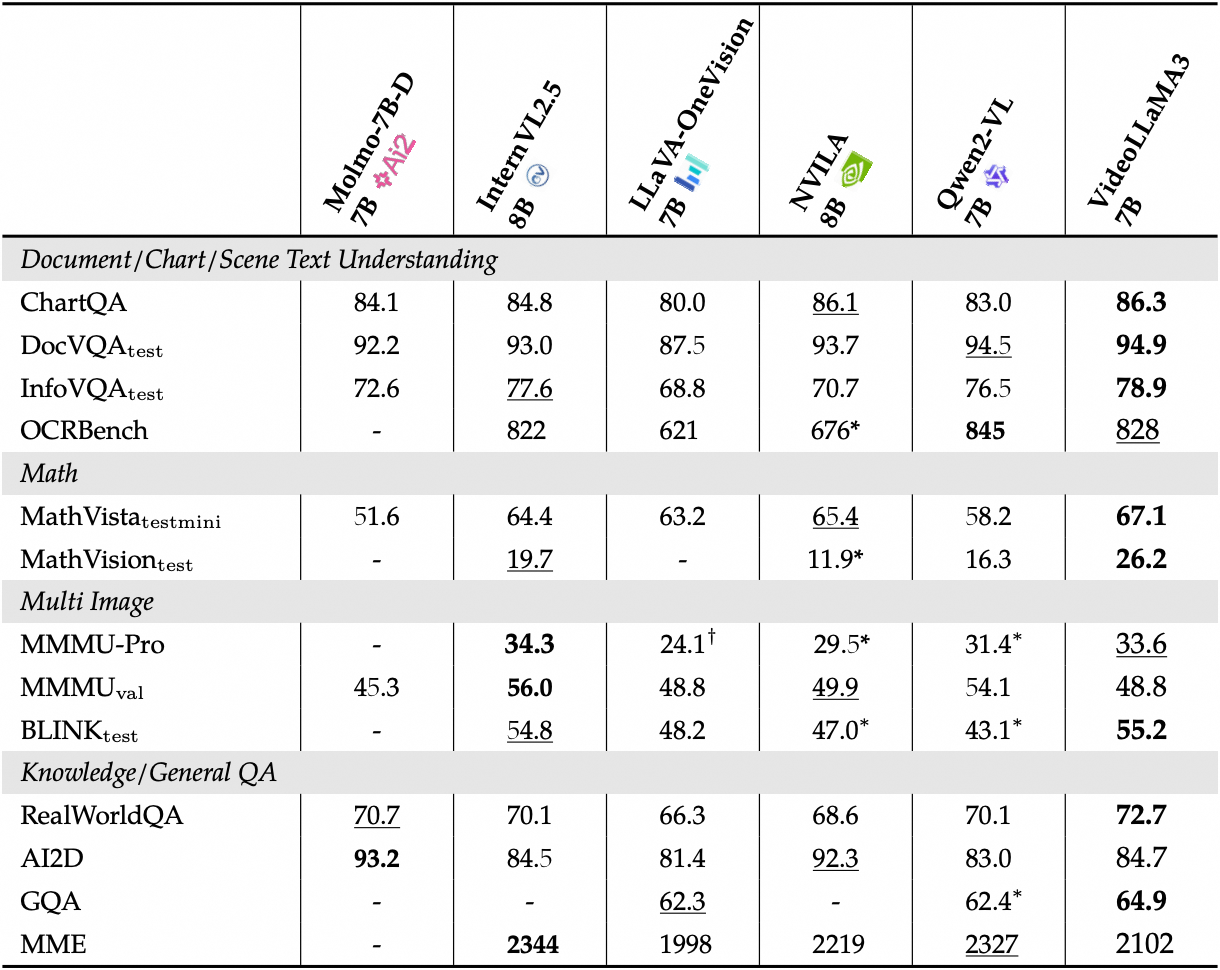

画像ベンチマークの詳細なパフォーマンスを表示します。

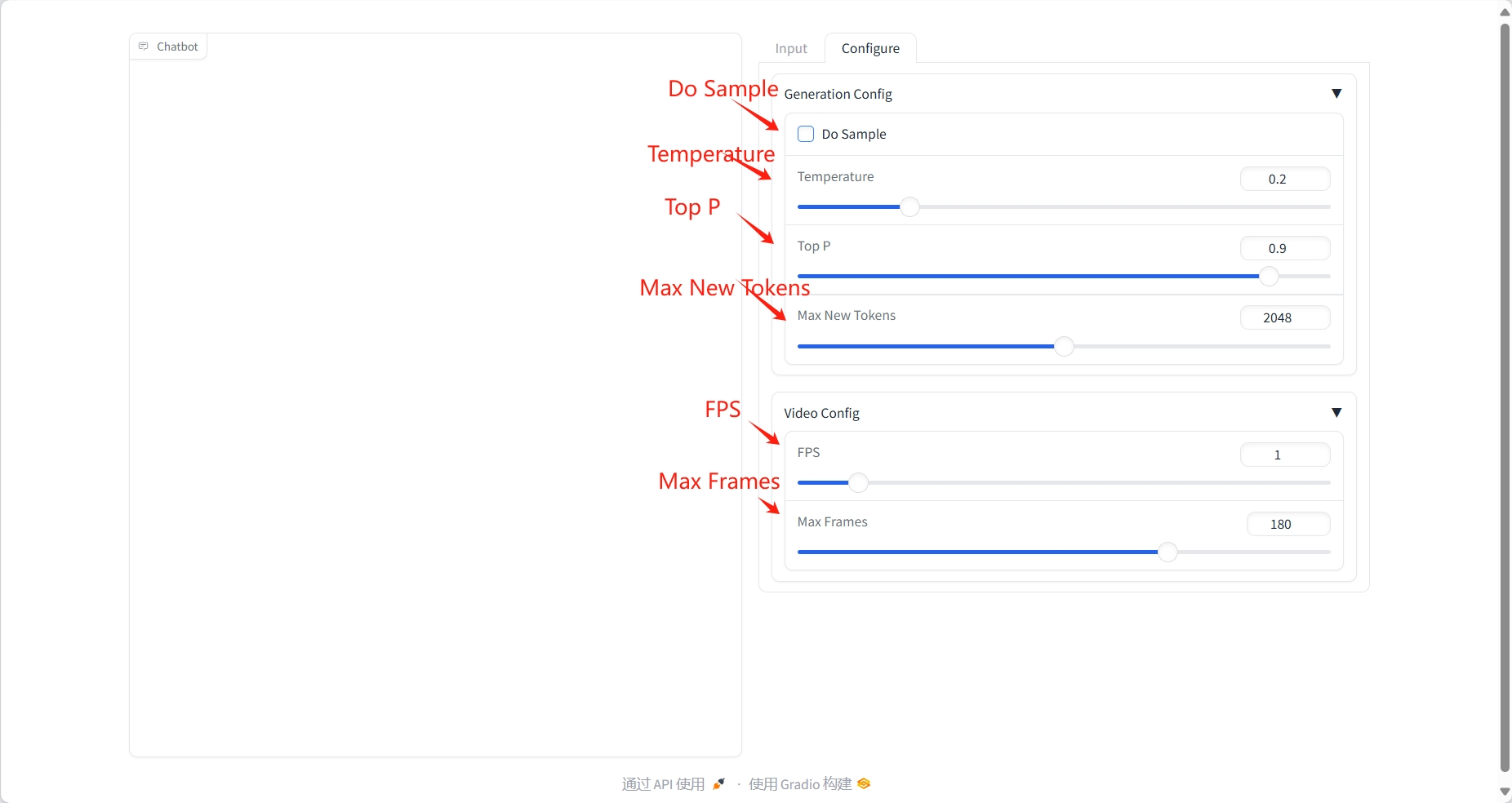

2. 操作手順

1. コンテナを起動します

「Bad Gateway」と表示される場合、モデルが初期化中であることを意味します。モデルが大きいため、2〜3分ほど待ってページを更新してください。

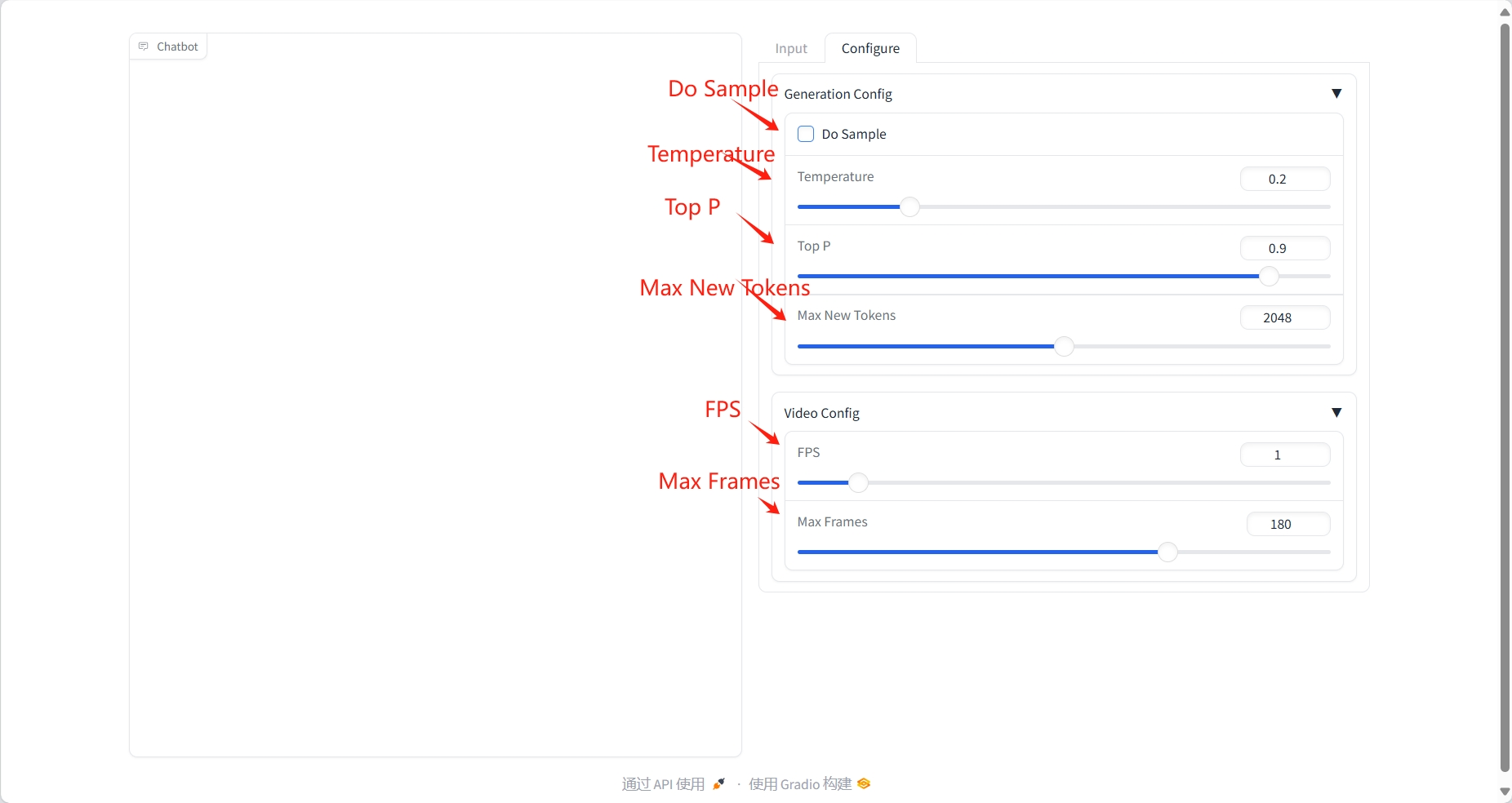

2. 使用手順

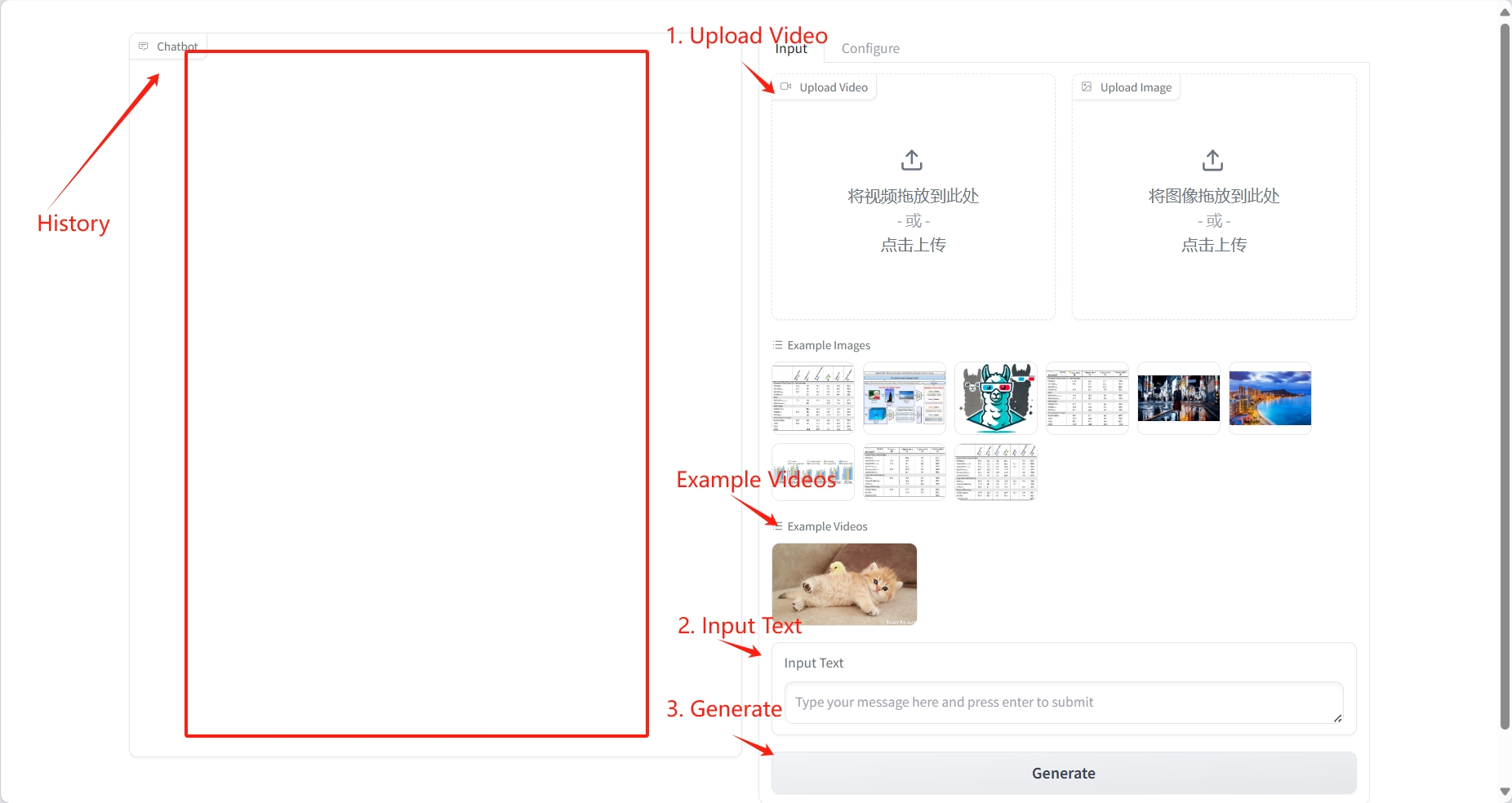

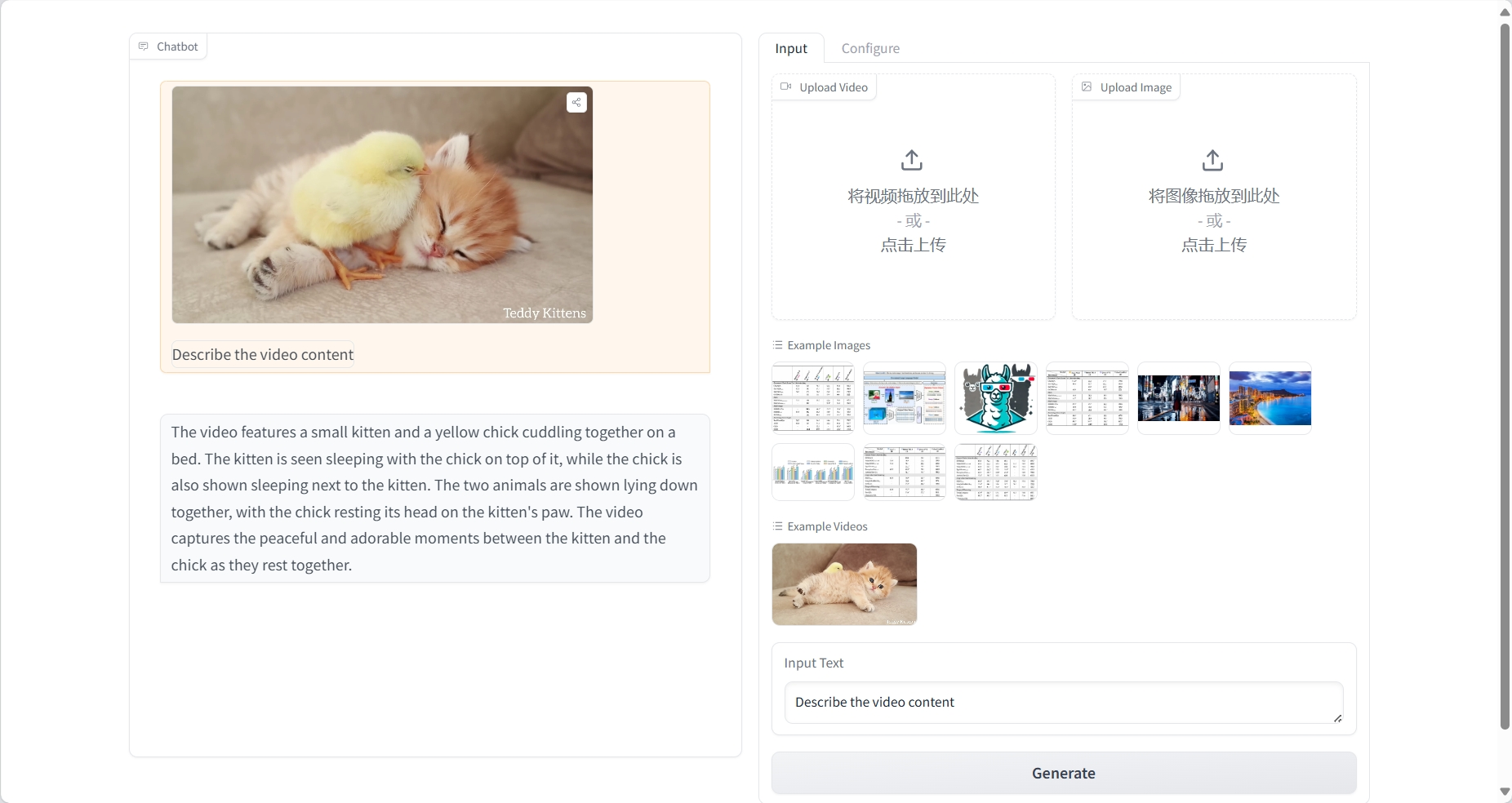

ビデオの理解

結果

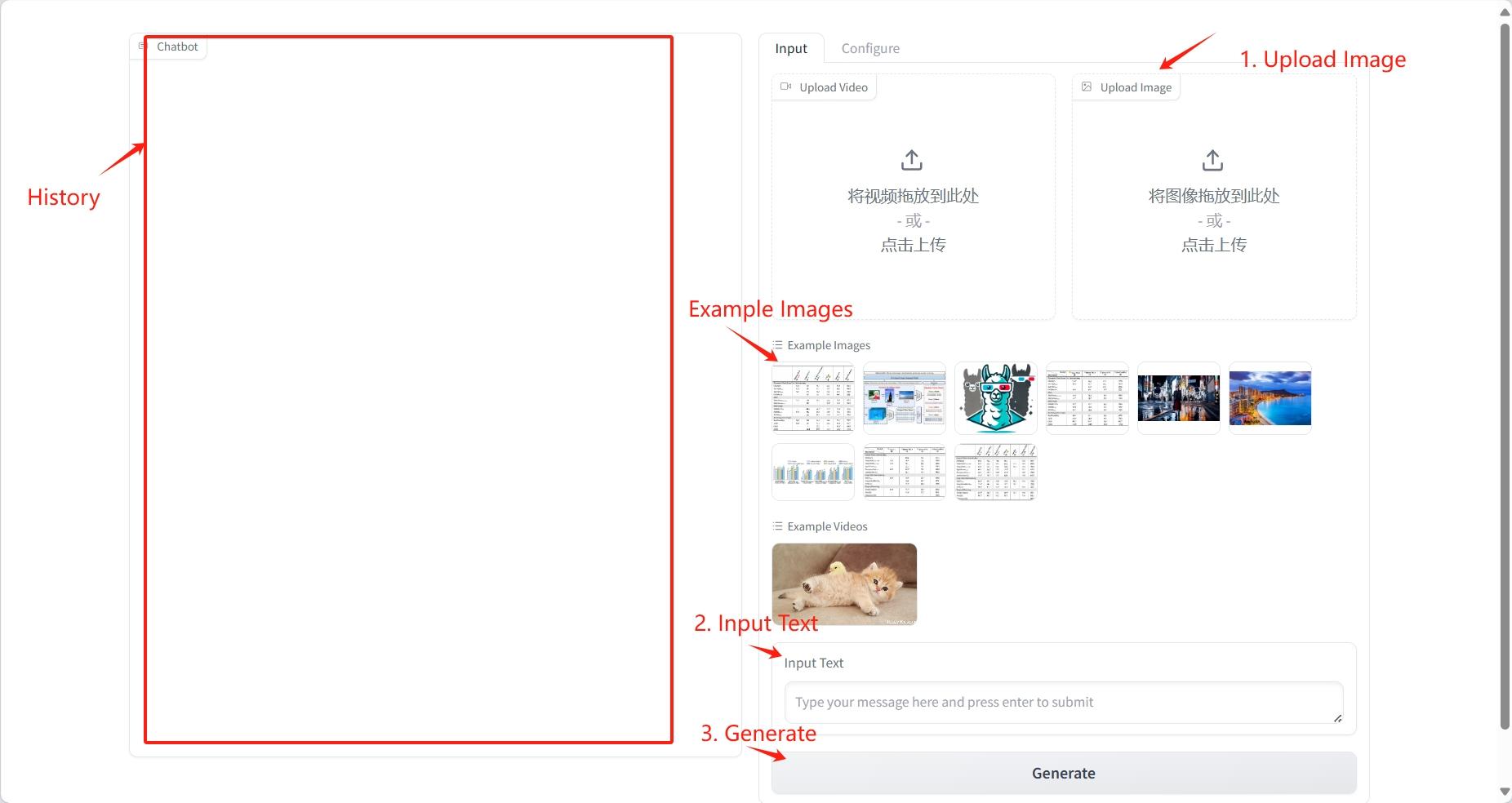

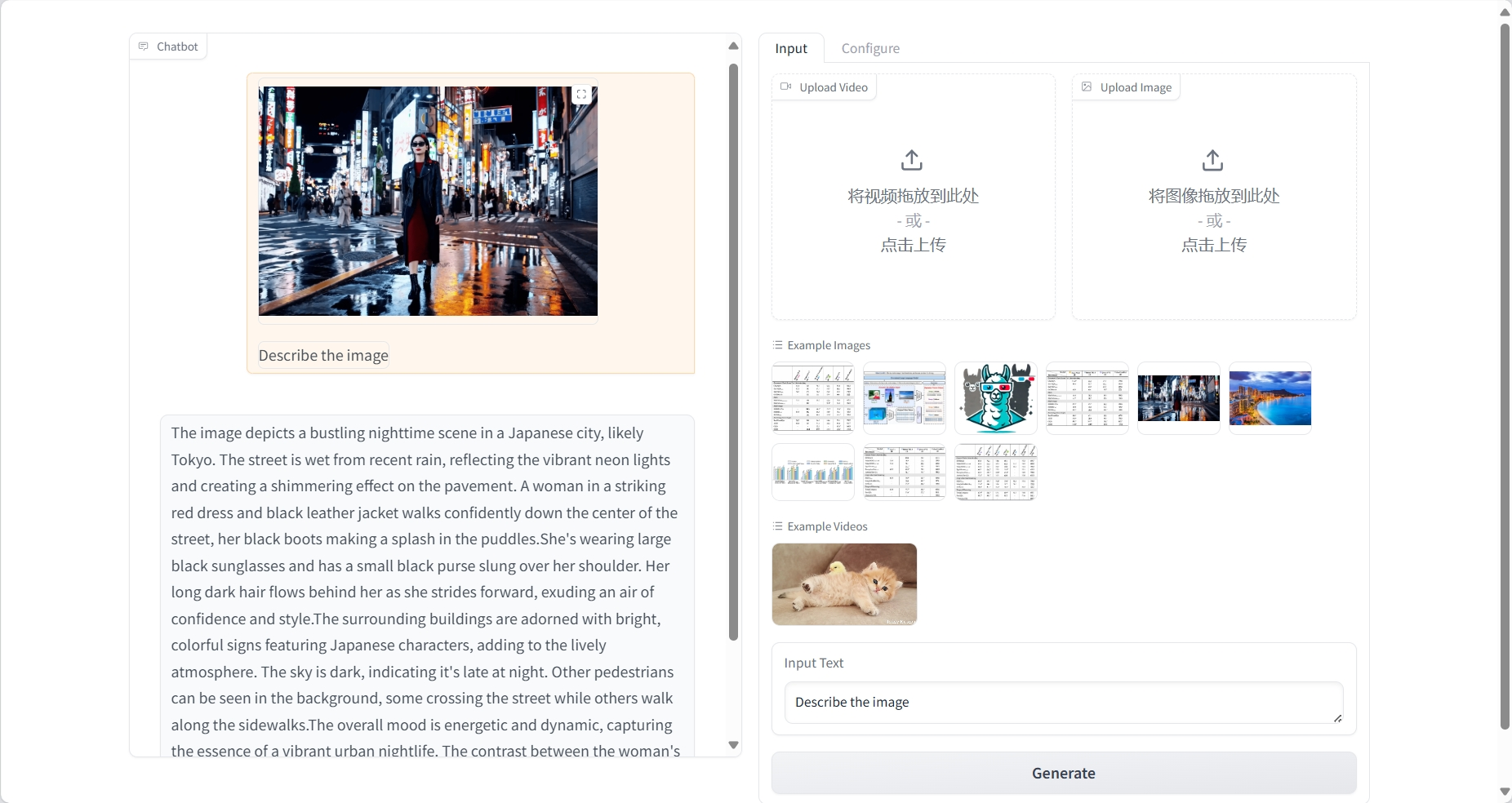

画像理解

結果

3. 議論

🖌️ 高品質のプロジェクトを見つけたら、メッセージを残してバックグラウンドで推奨してください。さらに、チュートリアル交換グループも設立しました。お友達はコードをスキャンして [SD チュートリアル] に参加し、さまざまな技術的な問題について話し合ったり、アプリケーションの効果を共有したりできます。

引用情報

このプロジェクトの引用情報は次のとおりです。

@article{damonlpsg2025videollama3,

title={VideoLLaMA 3: Frontier Multimodal Foundation Models for Image and Video Understanding},

author={Boqiang Zhang, Kehan Li, Zesen Cheng, Zhiqiang Hu, Yuqian Yuan, Guanzheng Chen, Sicong Leng, Yuming Jiang, Hang Zhang, Xin Li, Peng Jin, Wenqi Zhang, Fan Wang, Lidong Bing, Deli Zhao},

journal={arXiv preprint arXiv:2501.13106},

year={2025},

url = {https://arxiv.org/abs/2501.13106}

}

@article{damonlpsg2024videollama2,

title={VideoLLaMA 2: Advancing Spatial-Temporal Modeling and Audio Understanding in Video-LLMs},

author={Cheng, Zesen and Leng, Sicong and Zhang, Hang and Xin, Yifei and Li, Xin and Chen, Guanzheng and Zhu, Yongxin and Zhang, Wenqi and Luo, Ziyang and Zhao, Deli and Bing, Lidong},

journal={arXiv preprint arXiv:2406.07476},

year={2024},

url = {https://arxiv.org/abs/2406.07476}

}

@article{damonlpsg2023videollama,

title = {Video-LLaMA: An Instruction-tuned Audio-Visual Language Model for Video Understanding},

author = {Zhang, Hang and Li, Xin and Bing, Lidong},

journal = {arXiv preprint arXiv:2306.02858},

year = {2023},

url = {https://arxiv.org/abs/2306.02858}

}