Command Palette

Search for a command to run...

MUVR マルチモーダル非クロップ動画検索ベンチマーク

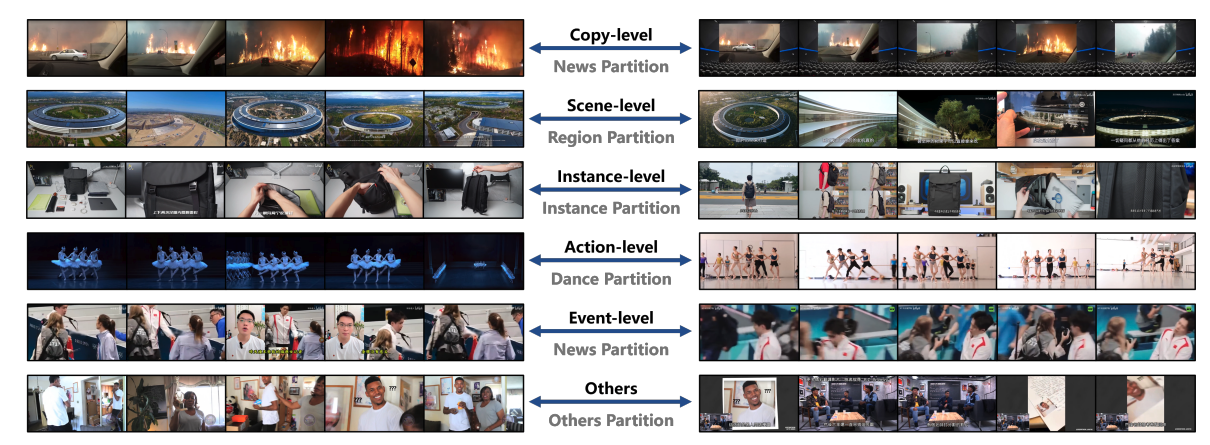

MUVRは、南京航空航天大学が南京大学および香港理工大学と共同で2025年に公開した、マルチモーダル非クロップ動画検索タスクのベンチマークデータセットです。関連論文には以下が含まれます。 MUVR: マルチレベル視覚対応を備えたマルチモーダル非トリミングビデオ検索ベンチマークこれは、長時間のビデオ プラットフォーム シナリオでのビデオ検索に関する研究を促進することを目的として、NeurIPS 2025 データセットとベンチマークに選ばれました。 このデータセットには、ビリビリが提供する約53,000本の未編集動画、1,050件のマルチモーダルクエリ、そして84,000件のクエリと動画のマッチング関係が含まれており、ニュース、旅行、ダンスなど、様々な一般的な動画タイプを網羅しています。マッチング関係のレベルを明確に区別するために、データセットでは6つの視覚的対応レベル(コピー、イベント、シーン、インスタンス、アクションなど)を定義し、1対多の検索設定を採用しています。これにより、各クエリは関連コンテンツを含む複数の完全な動画に対応できます。クエリ形式には、長いテキストの説明、動画タグのヒント、マスクのヒントなどがあり、きめ細かな検索ニーズに対応できます。