Command Palette

Search for a command to run...

Rapport Hebdomadaire Sur l'IA | Conception De Protéines De Novo / Première Solution d'agent Open Source / HunyuanOCR / Modèle De Langage Olmo 3… Aperçu En Un Clic

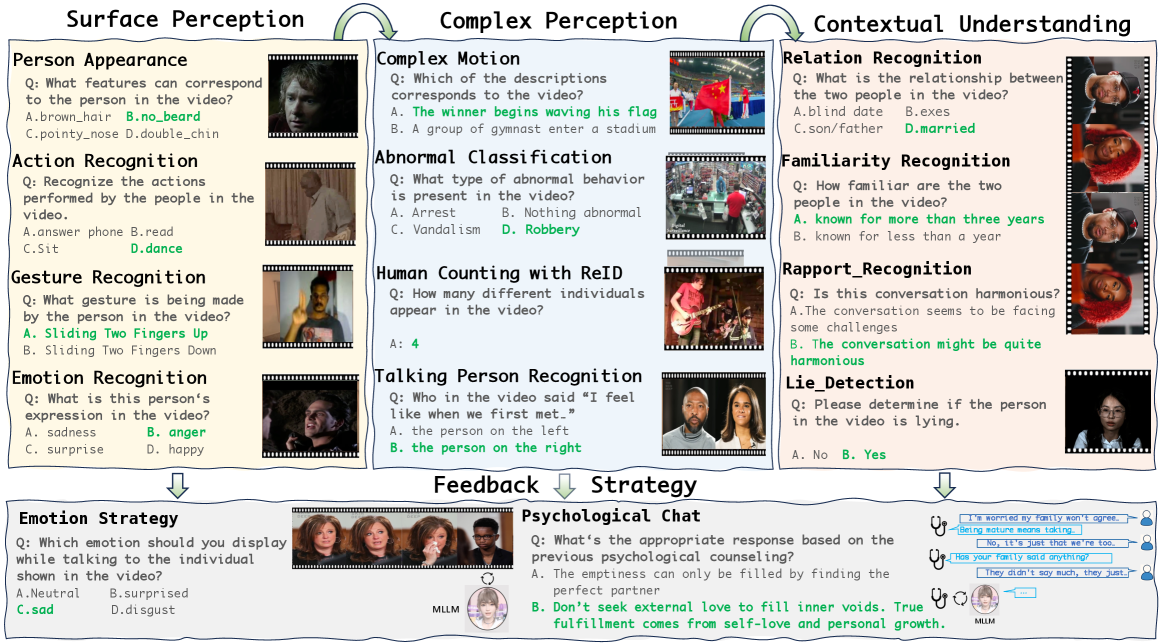

Les grands modèles de langage multimodaux (MLLM) ont un grand potentiel pour parvenir à une interaction semblable à celle de l'homme, mais leur développement est confronté à un défi majeur : le manque d'un cadre d'évaluation précis pour les scénarios centrés sur l'humain qui puisse simultanément mesurer la capacité du modèle à comprendre les intentions humaines complexes et à fournir une rétroaction empathique et contextuelle.

Partant de ce constat, une équipe de recherche de l'Université Jiaotong de Xi'an, en collaboration avec Ant Group, a proposé HumanSense, un banc d'essai complet conçu pour évaluer les capacités de perception et d'interaction centrées sur l'humain des modèles multimodaux de langage (MLLM), en mettant l'accent sur la compréhension approfondie des contextes multimodaux étendus et la formulation de réponses pertinentes. Les résultats montrent que les MLLM présentent un potentiel d'amélioration important dans les scénarios centrés sur l'humain, notamment pour les tâches impliquant des interactions de haut niveau. Les chercheurs ont également conçu une méthode d'apprentissage par renforcement multimodale progressive, HumanSense-Omni-Reasoning, qui améliore significativement les performances pour les tâches de compréhension et d'interaction de haut niveau.

Lien vers le document:https://go.hyper.ai/xYM02

Derniers articles sur l'IA:https://go.hyper.ai/hzChC

Afin de permettre à davantage d'utilisateurs de connaître les derniers développements dans le domaine de l'intelligence artificielle dans le milieu universitaire, le site Web officiel d'HyperAI (hyper.ai) a désormais lancé une section « Derniers articles », qui met à jour quotidiennement les articles de recherche de pointe sur l'IA.Voici 5 articles populaires sur l'IA que nous recommandons, jetons un coup d’œil rapide aux réalisations de pointe en matière d’IA de cette semaine⬇️

Recommandation de papier de cette semaine

1.JAM-2

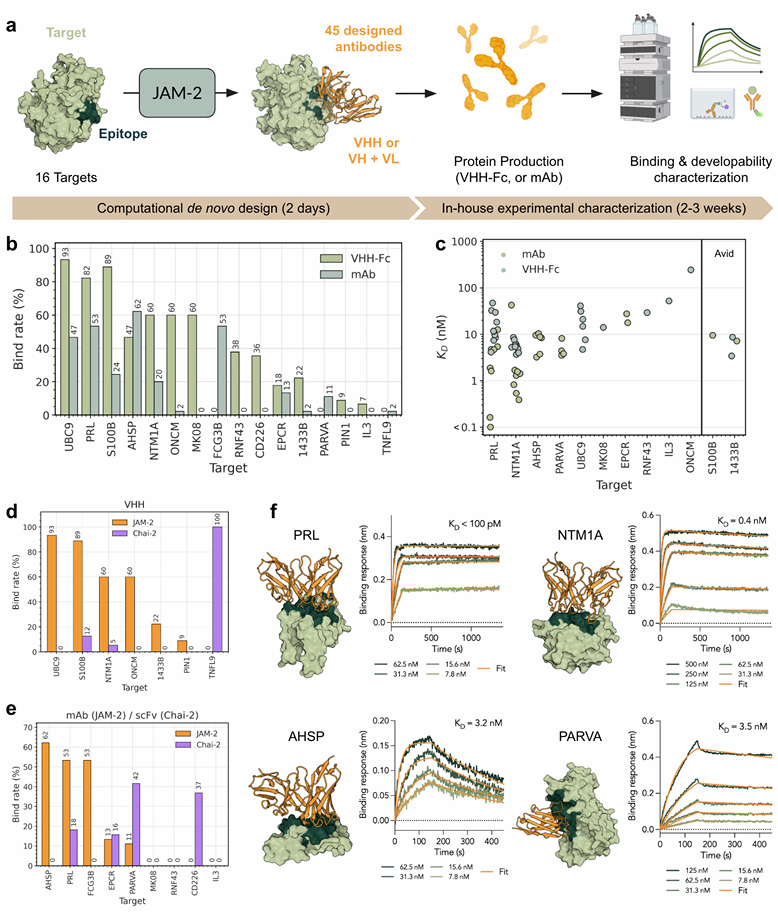

Titre : JAM-2 : Conception entièrement informatique d'anticorps à visée thérapeutique avec des taux de réussite élevés

Cet article présente JAM-2, un système universel de conception de protéines de novo qui, pour la première fois, permet la conception très efficace d'anticorps VHH-Fc et d'anticorps monoclonaux (AcM) de pleine longueur présentant une affinité et une facilité de développement comparables à celles des médicaments, tout en atteignant des taux de réussite à deux chiffres pour une gamme de cibles et d'épitopes sans précédent. Parmi 16 cibles inédites, JAM-2 a permis d'obtenir avec succès des molécules de liaison pour chacune d'elles, avec des taux de réussite moyens de 39% (VHH-Fc) et 18% (AcM).

Lien vers l'article :https://go.hyper.ai/3Mfna

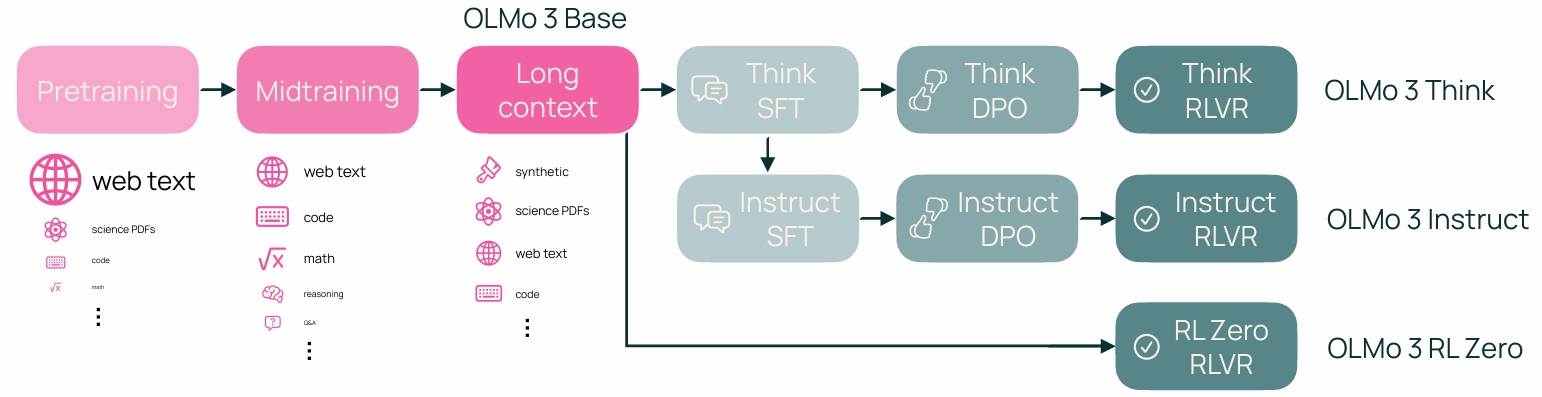

2.Olmo 3

Cet article présente Olmo 3, une famille de modèles de langage open source de pointe, disponible en versions 7 et 32 milliards de paramètres. Les modèles Olmo 3 sont conçus pour le raisonnement sur des contextes longs, les appels de fonctions, la programmation, le suivi d'instructions, le dialogue général et la recherche de connaissances. Cette version inclut un flux de développement complet, couvrant l'intégralité du cycle de vie de la famille de modèles, de la compilation au déploiement, et incluant toutes les phases d'entraînement, les points de contrôle, les données et les dépendances.

Lien vers l'article :https://go.hyper.ai/HgvWV

3.Lumine

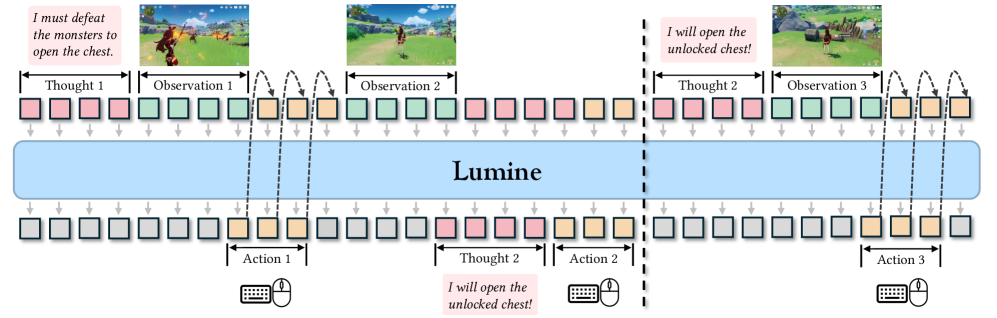

Titre : Lumine : une recette ouverte pour la création d’agents généralistes dans des mondes ouverts en 3D

Cet article propose Lumine, le premier système de développement d'agents intelligents open source et généraliste capable d'exécuter des tâches complexes pendant des heures en temps réel dans des environnements 3D complexes en monde ouvert. Le modèle utilise un paradigme d'interaction similaire à celui de l'humain, unifiant perception, raisonnement et action de bout en bout grâce à un modèle vision-langage. Il traite les entrées de pixels bruts à une fréquence de 5 images par seconde, génère des actions précises au clavier et à la souris à 30 images par seconde et invoque dynamiquement le module d'inférence uniquement lorsque cela est nécessaire.

Lien vers l'article :https://go.hyper.ai/6qg4A

4.Sens humain

Titre : HumanSense : De la perception multimodale aux réponses empathiques et contextuelles grâce aux modèles linéaires multimodaux de raisonnement

Cet article propose HumanSense, un cadre d'évaluation complet conçu pour analyser les capacités des modèles multimodaux d'apprentissage (MLLM) en matière de perception et d'interaction centrées sur l'humain, en particulier leur capacité à appréhender en profondeur les contextes multimodaux à long terme et à générer des réponses pertinentes. Nos résultats d'évaluation montrent que les MLLM les plus performants présentent encore une marge de progression importante pour les tâches d'interaction complexes. De plus, cet article propose une approche d'apprentissage par renforcement multimodale et progressive pour construire le modèle HumanSense-Omni-Reasoning, améliorant ainsi significativement ses performances pour les tâches de compréhension et d'interaction complexes.

Lien vers l'article :https://go.hyper.ai/xYM02

5.Rapport technique HunyuanOCR

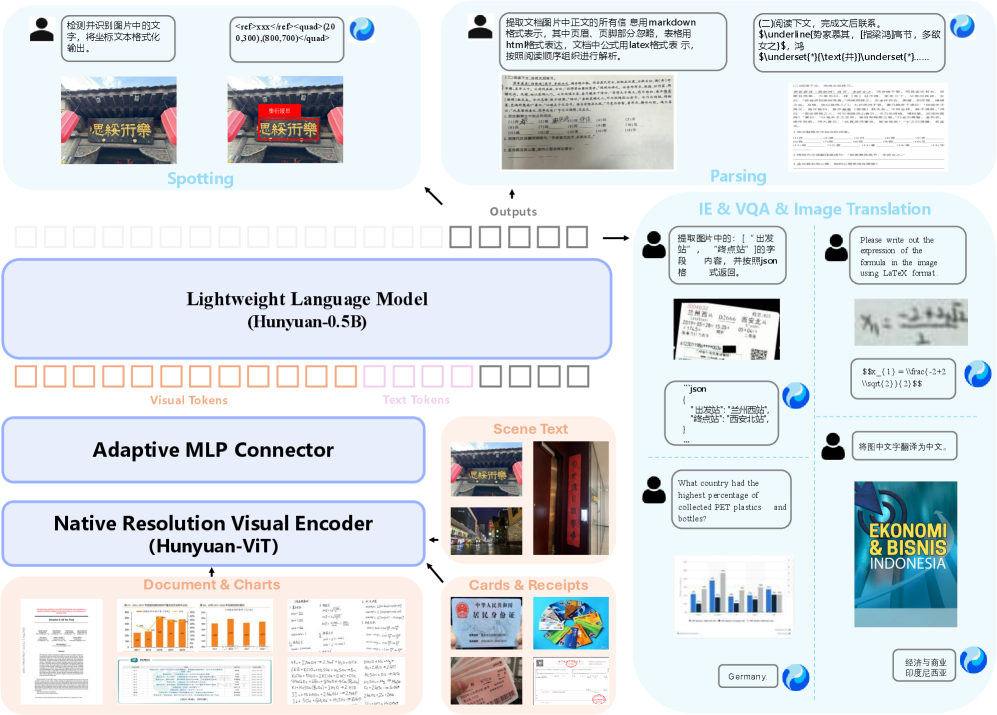

Cet article propose HunyuanOCR, un modèle visuel-langage (VLM) commercial, open source et léger (1 milliard de paramètres) pour les tâches de reconnaissance optique de caractères (OCR). Son architecture se compose d'un transformateur visuel natif (ViT) et d'un modèle de langage léger et étendu (LLM) connectés par un adaptateur MLP. HunyuanOCR offre des performances supérieures, surpassant les API commerciales existantes, les flux de traitement traditionnels et les modèles comportant un plus grand nombre de paramètres (tels que Qwen3-VL-4B).

Lien vers l'article :https://go.hyper.ai/KxstF

Voici l'intégralité du contenu de la recommandation d'article de cette semaine. Pour découvrir d'autres articles de recherche de pointe en IA, veuillez consulter la section « Derniers articles » du site officiel d'hyper.ai.

Nous invitons également les équipes de recherche à nous soumettre des résultats et des articles de haute qualité. Les personnes intéressées peuvent ajouter leur compte WeChat NeuroStar (identifiant WeChat : Hyperai01).

À la semaine prochaine !