Command Palette

Search for a command to run...

LongCat-Video: Meituans Open-Source-KI-Videogenerierungsmodell

Datum

Größe

10.51 MB

Tags

Lizenz

MIT

Paper-URL

1. Einführung in das Tutorial

LongCat-Video ist ein Open-Source-KI-Videogenerierungsmodell mit 13,6 Milliarden Parametern, entwickelt vom LongCat-Team von Meituan. Es eignet sich hervorragend für Aufgaben wie Text-zu-Video, Bild-zu-Video und Videofortsetzung, insbesondere für die effiziente Generierung hochwertiger langer Videos. Das Modell nutzt Multi-Reward Reinforcement Learning Optimization (GRPO) und erzielt in internen und öffentlichen Benchmarks eine mit führenden Open-Source-Videogenerierungsmodellen und modernsten kommerziellen Lösungen vergleichbare Leistung. Zugehörige Forschungsarbeiten sind verfügbar. Technischer Bericht zu LongCat-Video .

Dieses Tutorial nutzt eine einzelne RTX PRO 6000 GPU für die Rechenleistung. Es werden vier Beispiele zum Testen bereitgestellt: Bild-zu-Video, Text-zu-Video, langes Video und Videofortsetzung.

2. Effektanzeige

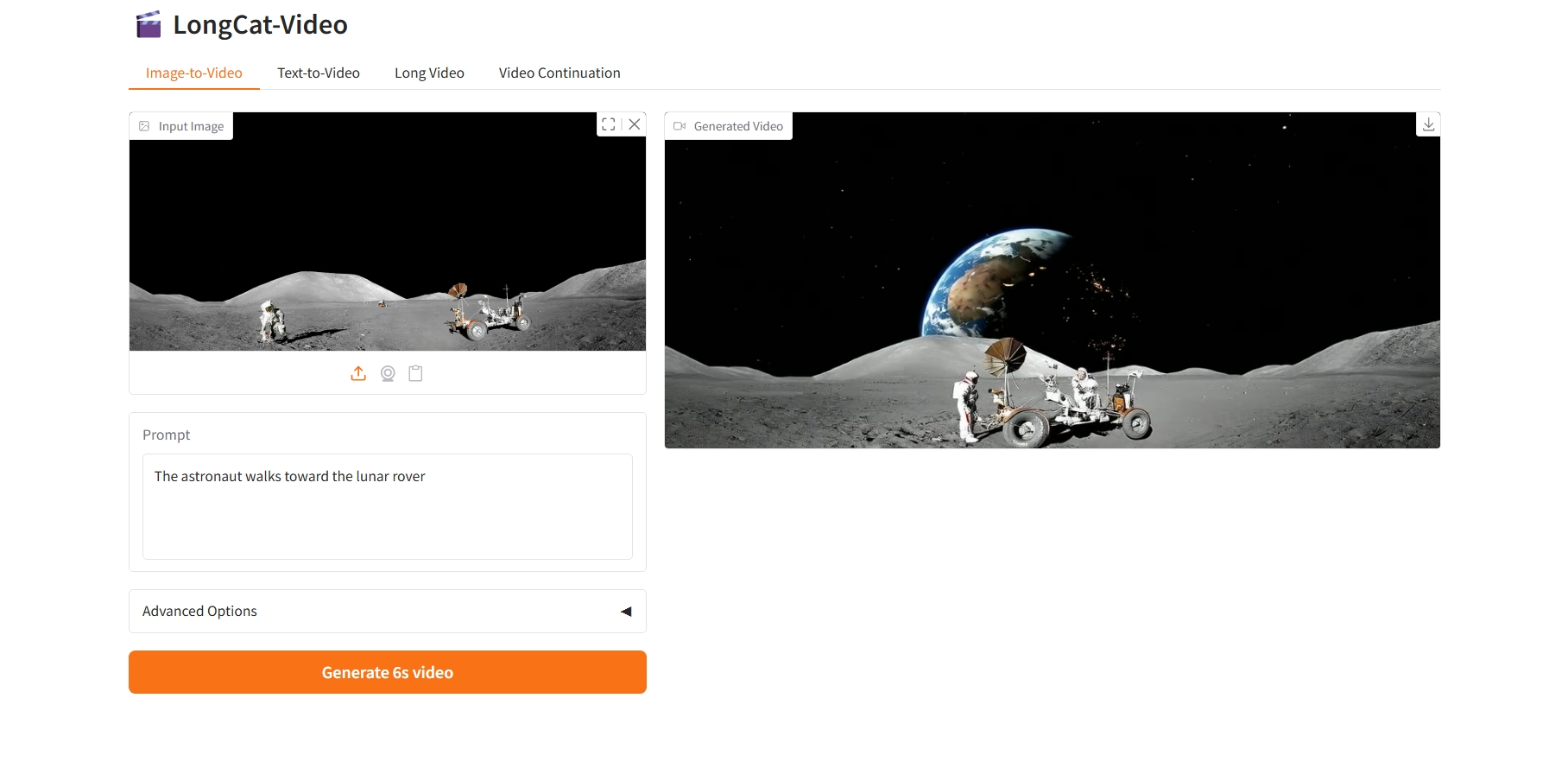

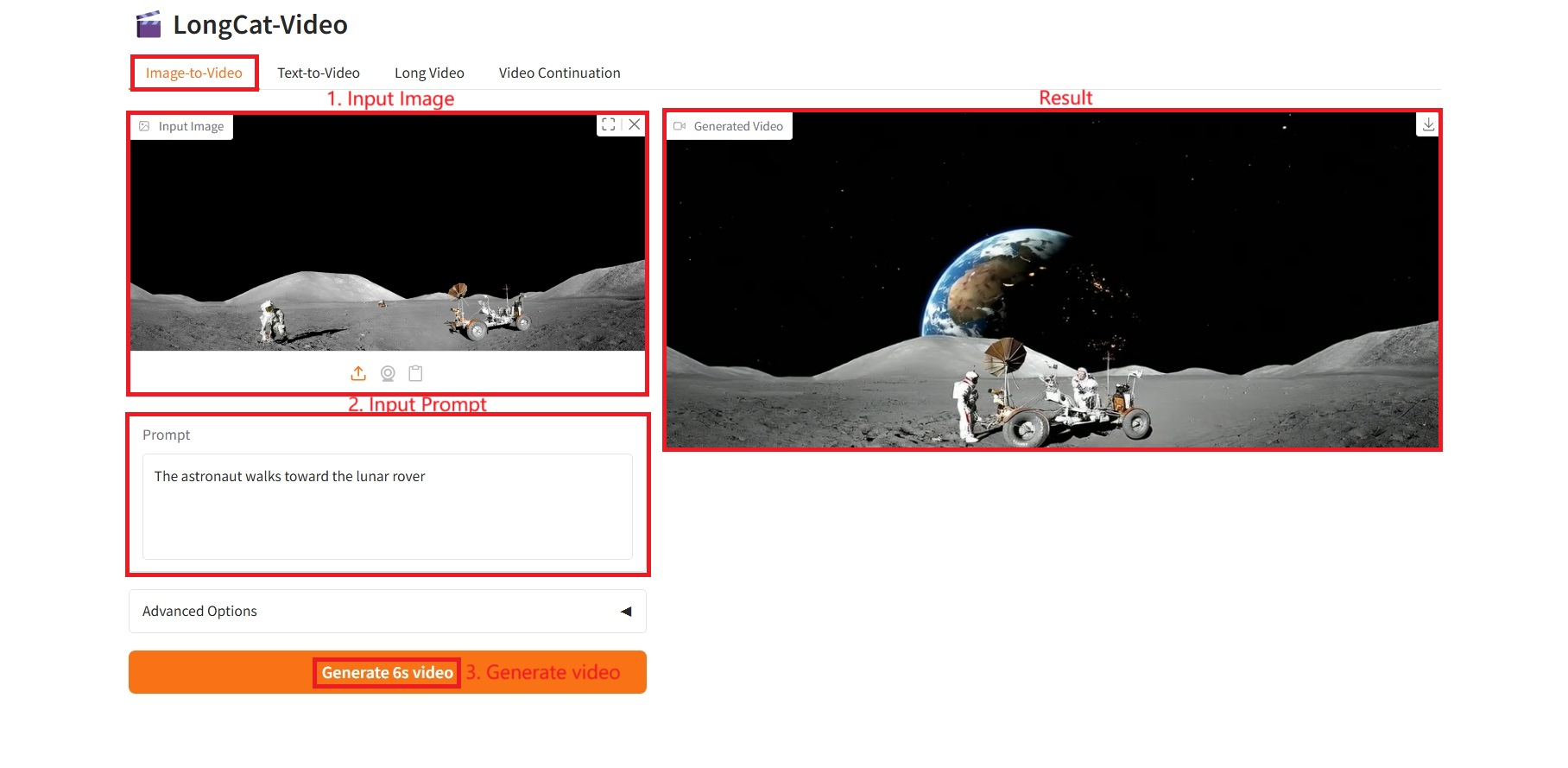

1. Bild-zu-Video

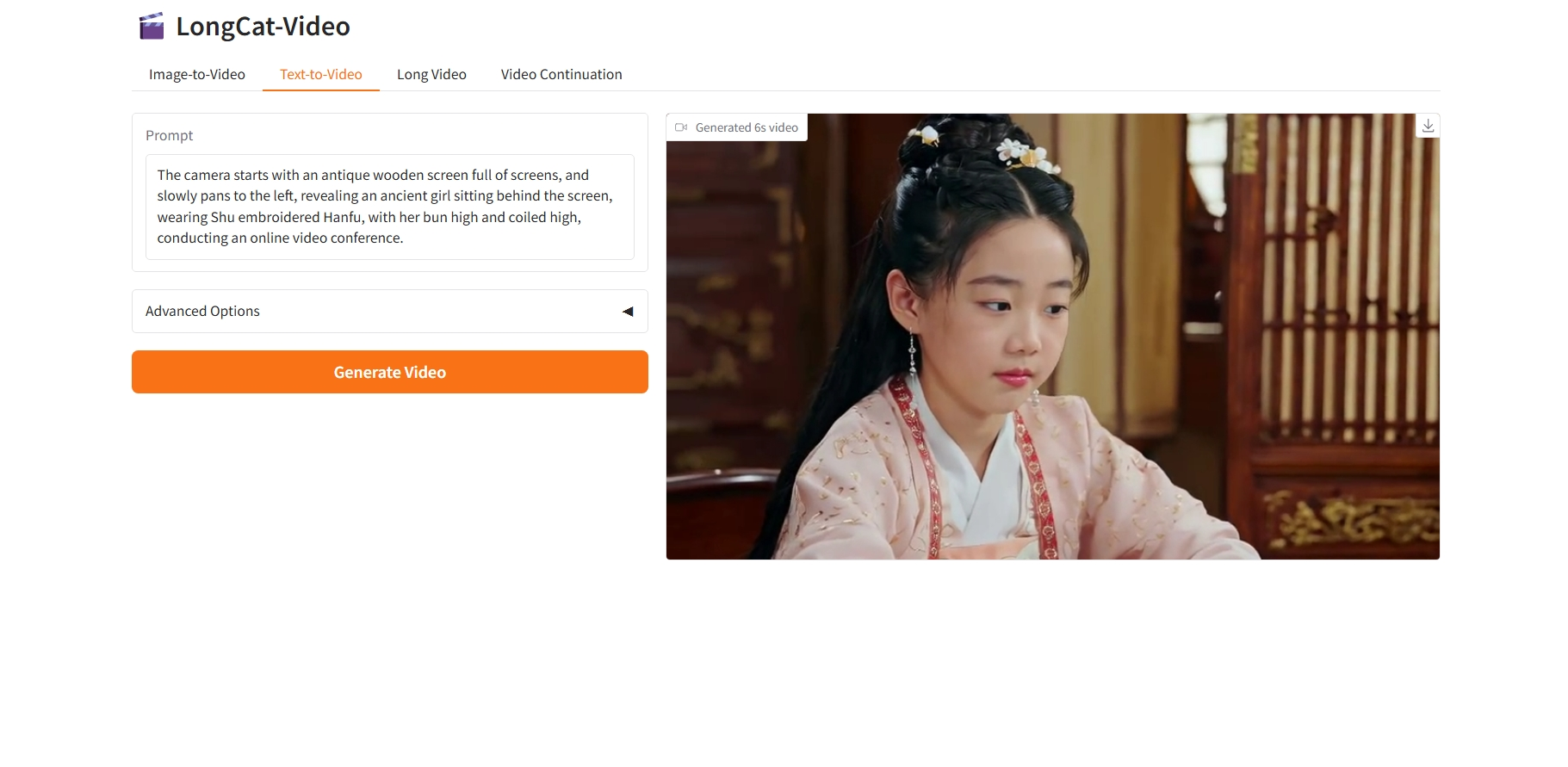

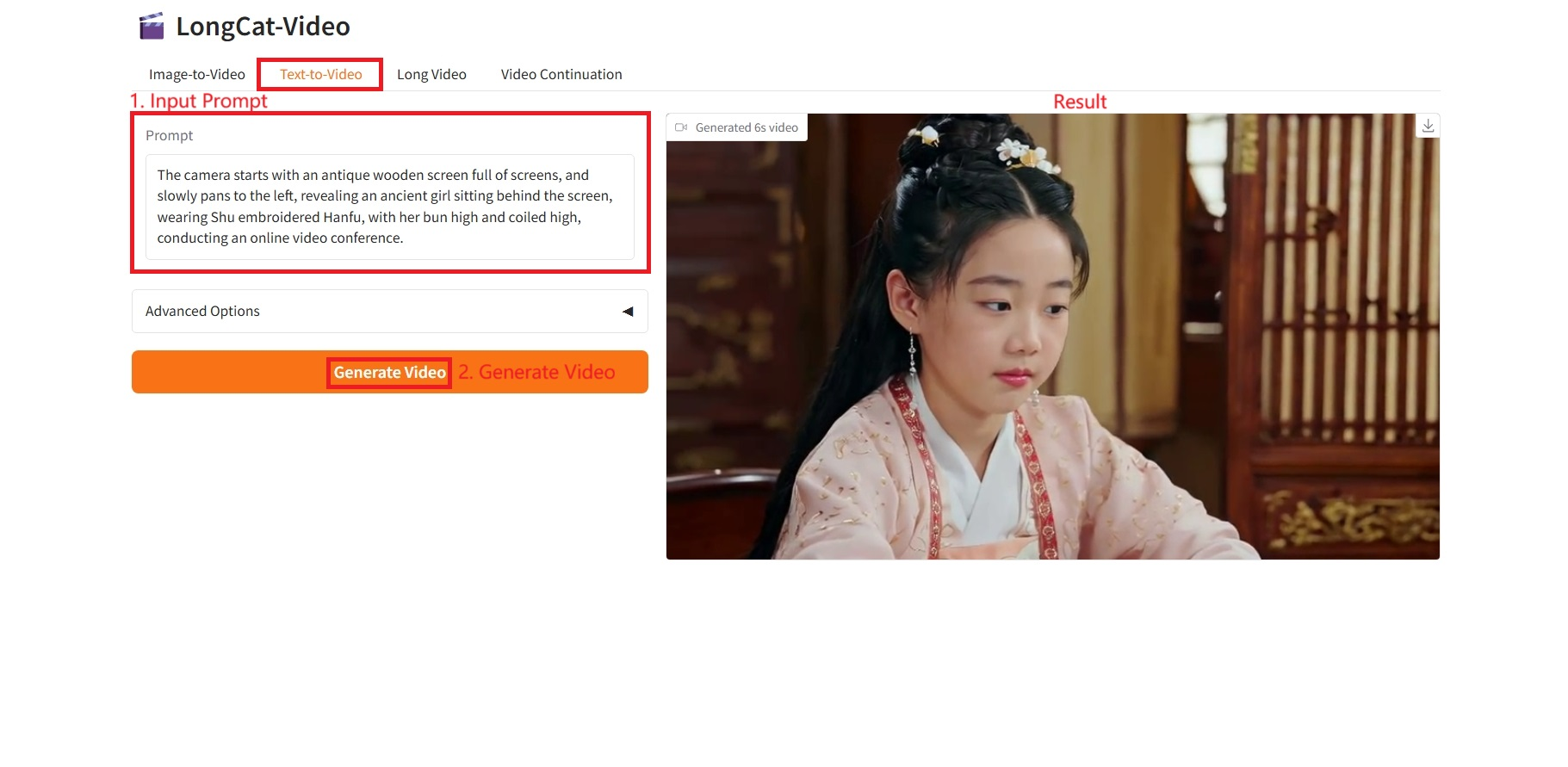

2. Text-zu-Video

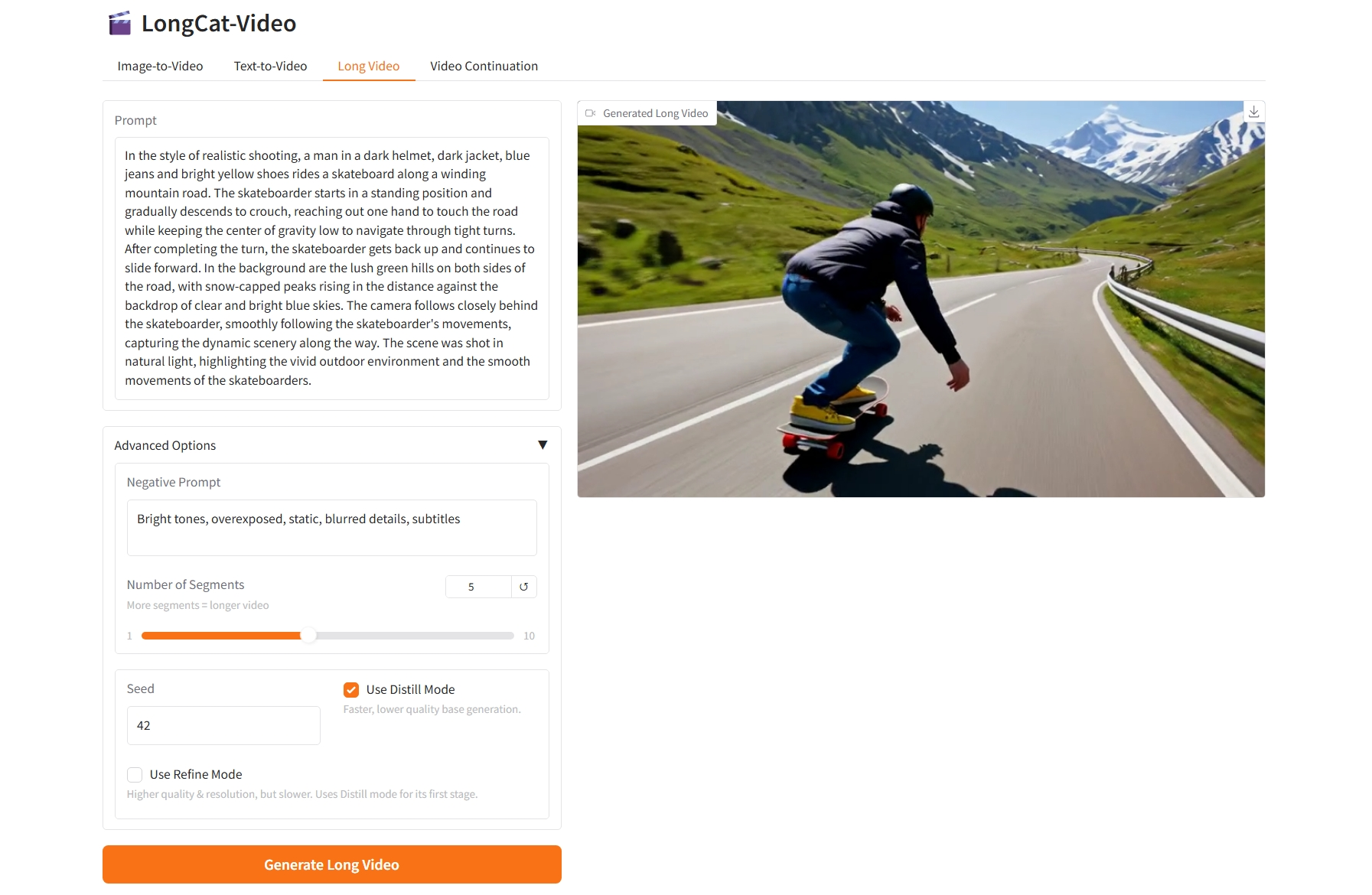

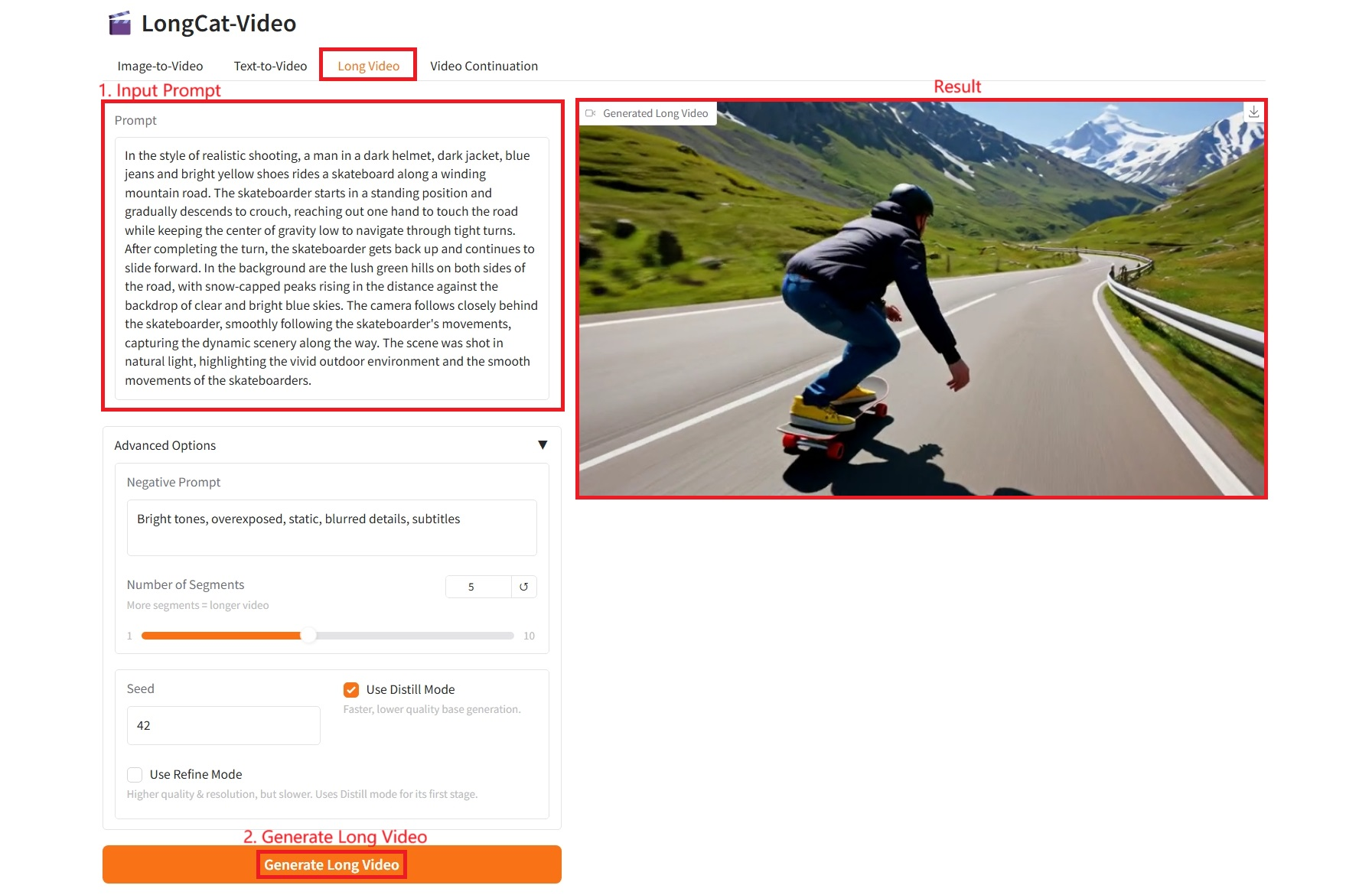

3. Generation Langvideos

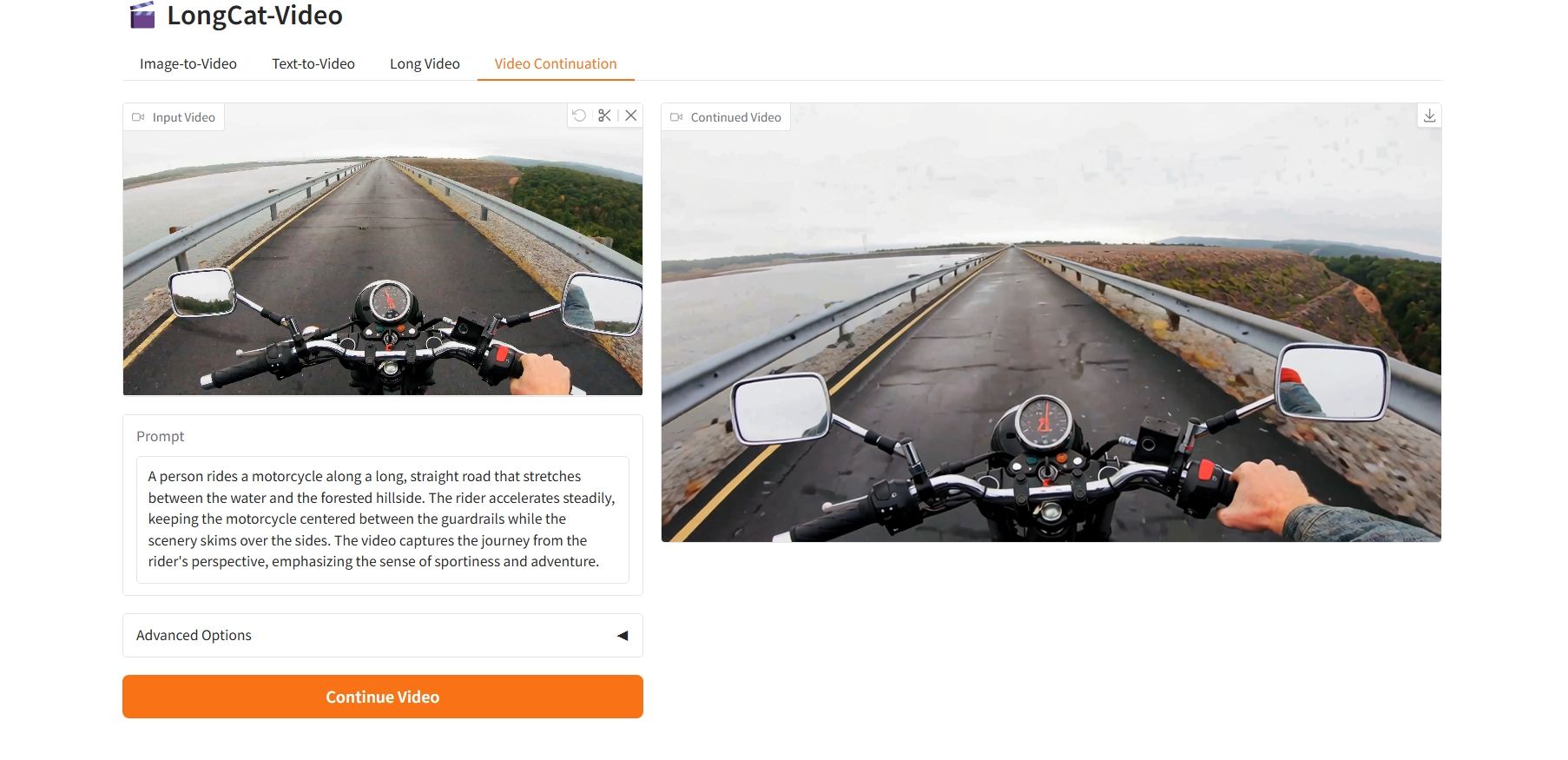

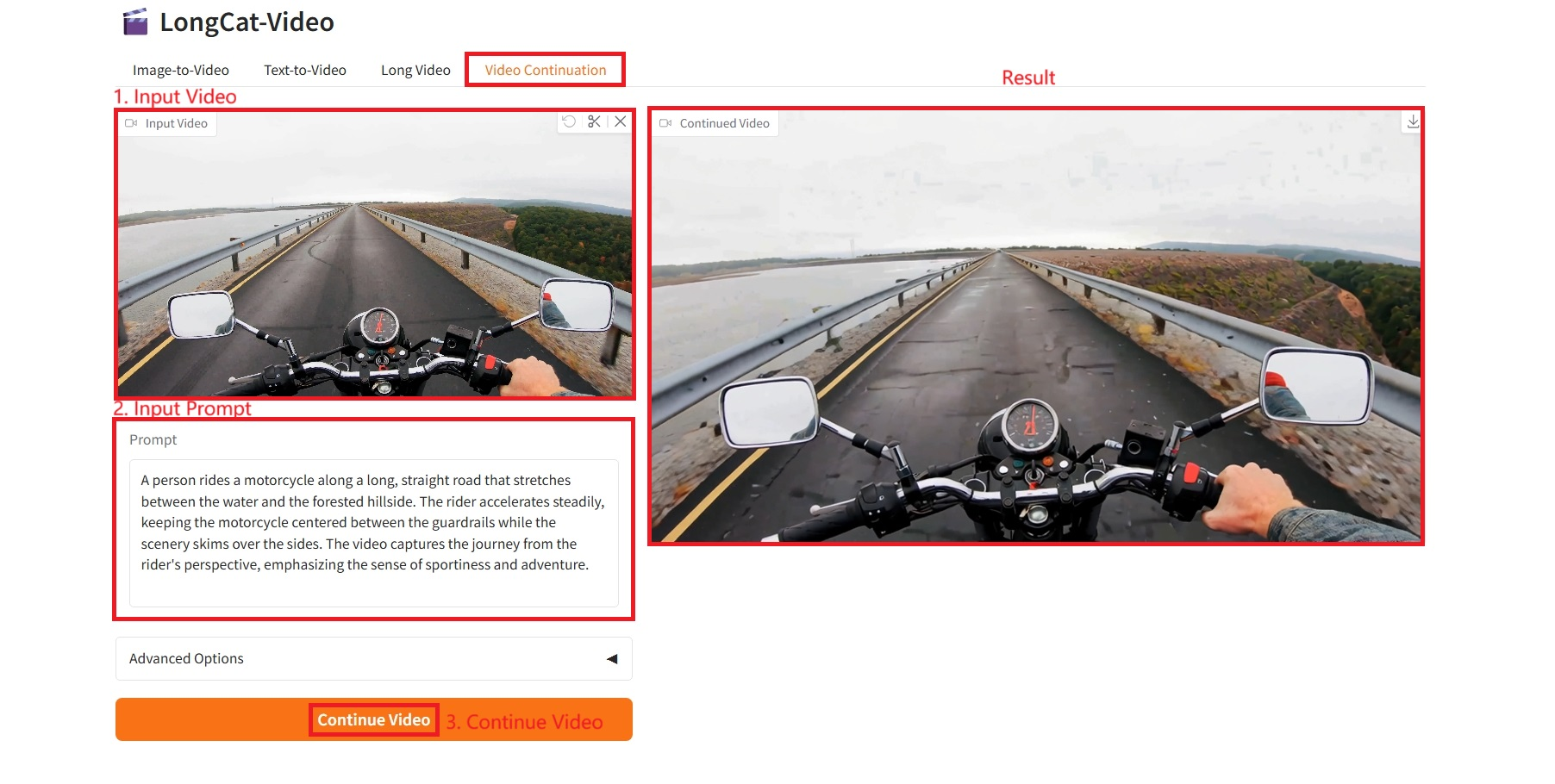

4. Video-Fortsetzung

3. Bedienungsschritte

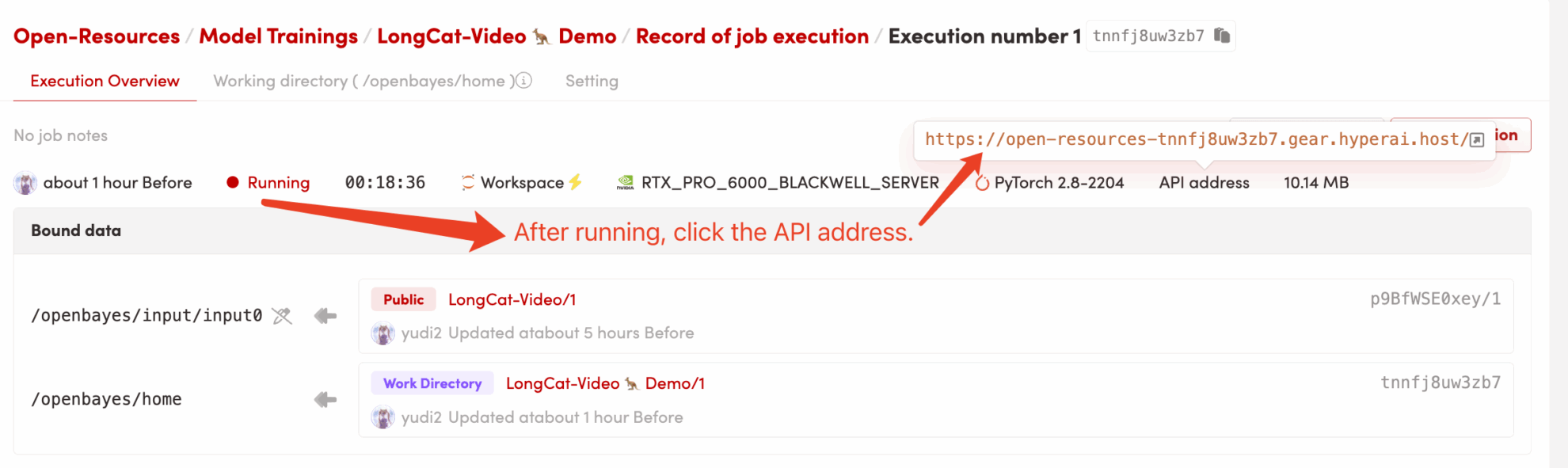

1. Starten Sie den Container

2. Anwendungsschritte

Wird „Bad Gateway“ angezeigt, bedeutet dies, dass das Modell initialisiert wird. Da das Modell umfangreich ist, warten Sie bitte etwa 5–6 Minuten und aktualisieren Sie dann die Seite.

1. Bild-zu-Video

Parameterbeschreibung:

- Negative Eingabeaufforderung: Durch die Eingabe unerwünschter Elemente wird das Modell angewiesen, diese Merkmale zu vermeiden, wodurch die Qualität des generierten Inhalts verbessert wird.

- Auflösung: Gibt die Pixelabmessungen (Breite × Höhe) des generierten Bildes an.

- Seed: Legt den Startpunkt für die Zufälligkeit im Generierungsprozess fest. Ein fester Seed-Wert gewährleistet reproduzierbare Ergebnisse.

2. Text-zu-Video

Parameterbeschreibung:

- Negative Eingabeaufforderung: Durch die Eingabe unerwünschter Elemente wird das Modell angewiesen, diese Merkmale zu vermeiden, wodurch die Qualität des generierten Inhalts verbessert wird.

- Höhe: Gibt die Höhe des generierten Bildes an.

- Breite: Gibt die Breite des generierten Bildes an.

- Seed: Legt den Startpunkt für die Zufälligkeit im Generierungsprozess fest. Ein fester Seed-Wert gewährleistet reproduzierbare Ergebnisse.

3. Generation Langvideos

Die Erstellung des Langvideos dauert ungefähr 20 Minuten.

Parameterbeschreibung:

- Negative Eingabeaufforderung: Durch die Eingabe unerwünschter Elemente wird das Modell angewiesen, diese Merkmale zu vermeiden, wodurch die Qualität des generierten Inhalts verbessert wird.

- Anzahl der Segmente: Je mehr Segmente, desto länger das Video.

- Seed: Legt den Startpunkt für die Zufälligkeit im Generierungsprozess fest. Ein fester Seed-Wert gewährleistet reproduzierbare Ergebnisse.

4. Video-Fortsetzung

Die Videofortsetzung dauert ungefähr 20 Minuten.

Parameterbeschreibung:

- Negative Eingabeaufforderung: Durch die Eingabe unerwünschter Elemente wird das Modell angewiesen, diese Merkmale zu vermeiden, wodurch die Qualität des generierten Inhalts verbessert wird.

- Auflösung: Gibt die Pixelabmessungen (Breite × Höhe) des generierten Bildes an.

- Seed: Legt den Startpunkt für die Zufälligkeit im Generierungsprozess fest. Ein fester Seed-Wert gewährleistet reproduzierbare Ergebnisse.

Zitationsinformationen

Die Zitationsinformationen für dieses Projekt lauten wie folgt:

@misc{meituanlongcatteam2025longcatvideotechnicalreport,

title={LongCat-Video Technical Report},

author={Meituan LongCat Team and Xunliang Cai and Qilong Huang and Zhuoliang Kang and Hongyu Li and Shijun Liang and Liya Ma and Siyu Ren and Xiaoming Wei and Rixu Xie and Tong Zhang},

year={2025},

eprint={2510.22200},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2510.22200},

}KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.