Command Palette

Search for a command to run...

UniDepthV2:通用单目度量深度估计

项目概述

UniDepthV2 由 Luigi Piccinelli 等人在 2025 年 2 月发布。 UniDepthV2,能够跨域仅从单张图像重建度量三维场景。与现有的 MMDE 范式不同,UniDepthV2 在推理时直接从输入图像预测度量三维点,无需任何额外信息,力求实现通用且灵活的 MMDE 解决方案。相关论文成果为 UniDepthV2: Universal Monocular Metric Depth Estimation Made Simpler 。

本教程采用资源为单卡 RTX 4090 。

项目示例

运行步骤

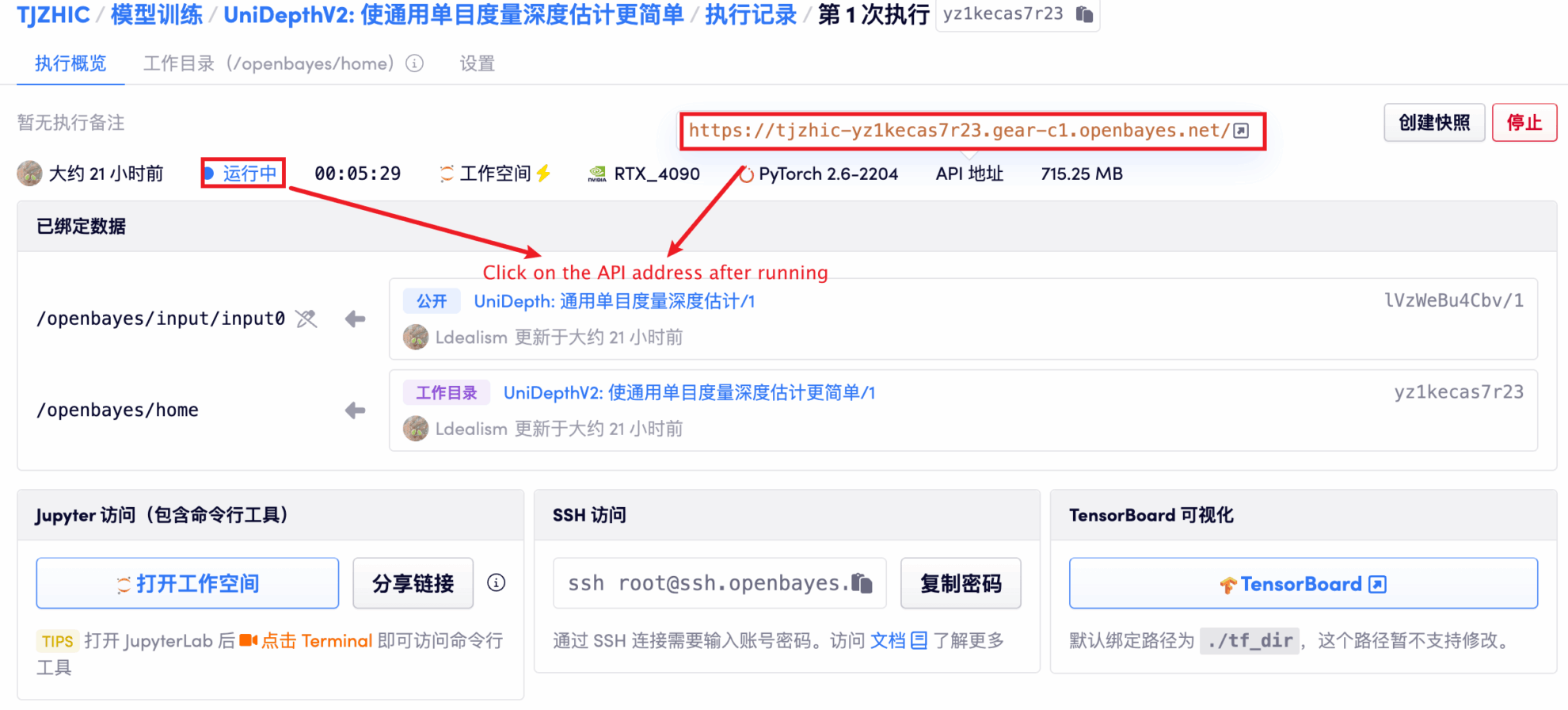

1. 启动容器后点击 API 地址即可进入 Web 界面

若显示「Bad Gateway」,这表示模型正在初始化,由于模型较大,请等待约 1-2 分钟后刷新页面。

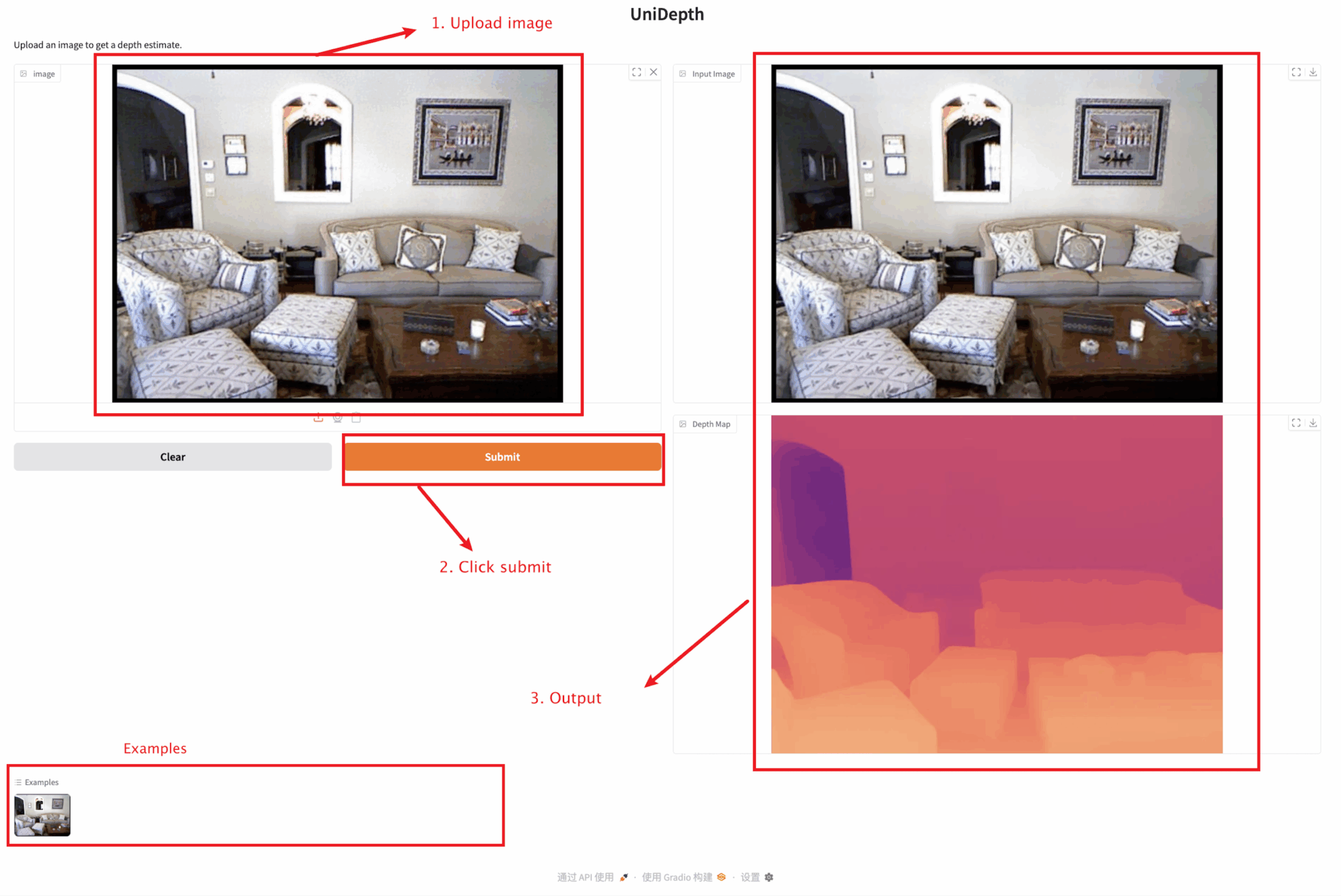

2. 进入网页后,即可与模型进行交互

交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓

引用信息

本项目引用信息如下:

@inproceedings{piccinelli2024unidepth,

title = { {U}ni{D}epth: Universal Monocular Metric Depth Estimation},

author = {Piccinelli, Luigi and Yang, Yung-Hsu and Sakaridis, Christos and Segu, Mattia and Li, Siyuan and Van Gool, Luc and Yu, Fisher},

booktitle = {Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)},

year = {2024}

}

@misc{piccinelli2025unidepthv2,

title={ {U}ni{D}epth{V2}: Universal Monocular Metric Depth Estimation Made Simpler},

author={Luigi Piccinelli and Christos Sakaridis and Yung-Hsu Yang and Mattia Segu and Siyuan Li and Wim Abbeloos and Luc Van Gool},

year={2025},

eprint={2502.20110},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2502.20110},

}