Command Palette

Search for a command to run...

オンラインチュートリアル | 1枚のSIMカードによる大規模な改造:MiniCPM-V-4.6、1.3Bオープンソースモデルは、画像理解/ビデオ理解/OCR/マルチターンマルチモーダル対話(Wallfacerおよびその他のオープンソースライブラリを使用)をサポートします。

ここ数年、AI業界全体はほぼ完全にスケーリング法則という物語に包まれてきた。パラメータが大きく、学習データが多いほど、モデルは「汎用人工知能」に近づくように見える。数百億から数兆ものパラメータを持つ大規模モデルは、推論能力や世界知識に対する人々の想像力を絶えず刺激し、同時に「計算能力の蓄積とスケールアップ」を業界のデフォルトの発展経路とした。

しかし、AIが本格的に産業界で活用され始めると、徐々に深刻な問題が浮上してくる。すべてのシナリオにおいて、クラウドデータセンターにスーパーモデルを導入する必要があるわけではない。推論コストの高さ、制御不能なネットワーク遅延、そしてますます深刻化するデータプライバシーリスクは、「大規模かつ包括的な」モデルアプローチにおけるボトルネックとなっている。性能、適時性、コストという「両立不可能な三角形」は、AIの民主化において解決すべき課題となっている。

こうして、一見すると直感に反するような傾向が現れ始めた。すなわち、パラメータの小さいモデルが、特にエッジデバイスや高並行性の産業環境において、ますます多くの実世界のシナリオで、より高い効率性と費用対効果を発揮するようになったのである。軽量モデルは、OCR、画像による質問応答、意図認識といった基本的なタスクを担うようになっている。これらはモバイルデバイス上でオフラインでもミリ秒単位の速度で動作し、RAGシステム内でのルーティングやコスト削減も処理できるため、AIアプリケーションの真の実現にとって不可欠なインフラストラクチャとなる。

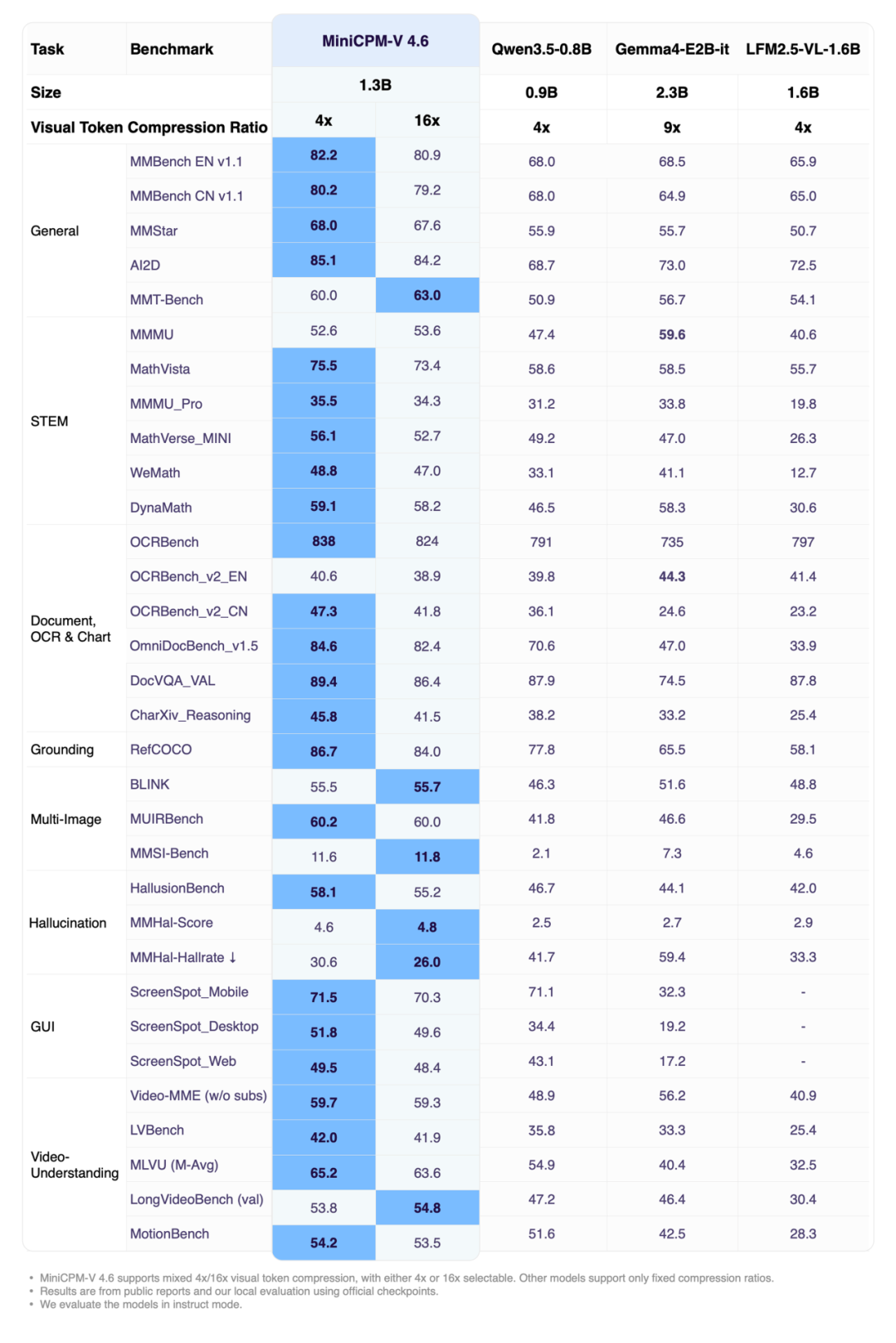

最近、Facewall Intelligence、清華大学、およびOpenBMBは共同で、次世代エッジマルチモーダルモデルMiniCPM-V 4.6をオープンソース化しました。このモデルはパラメータ数が約13億個と少ないものの、画像認識、動画認識、OCR、および複数ターンのマルチモーダル対話機能をサポートしており、複数の評価において同レベルの他のモデルを凌駕しています。

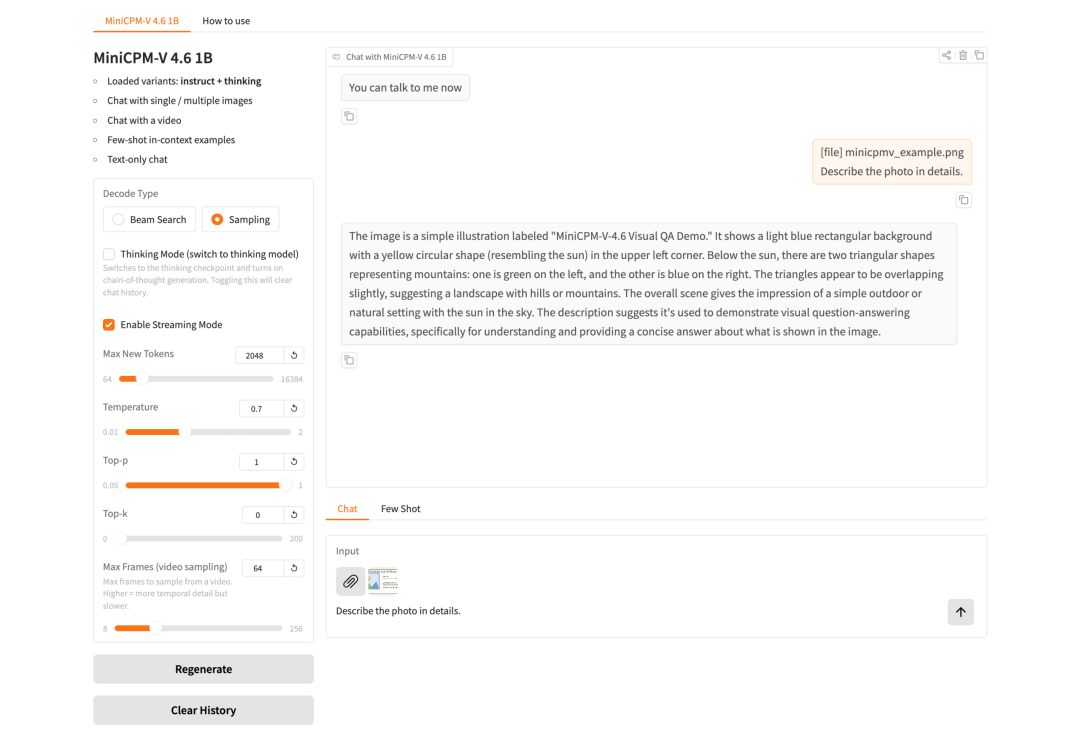

注目すべきは、公式のモデルカードには、Transformer に基づく AutoProcessor および AutoModelForImageTextToText 推論ソリューションが搭載されており、単一 GPU 環境での迅速な検証やアプリケーションのプロトタイピングに適している点である。

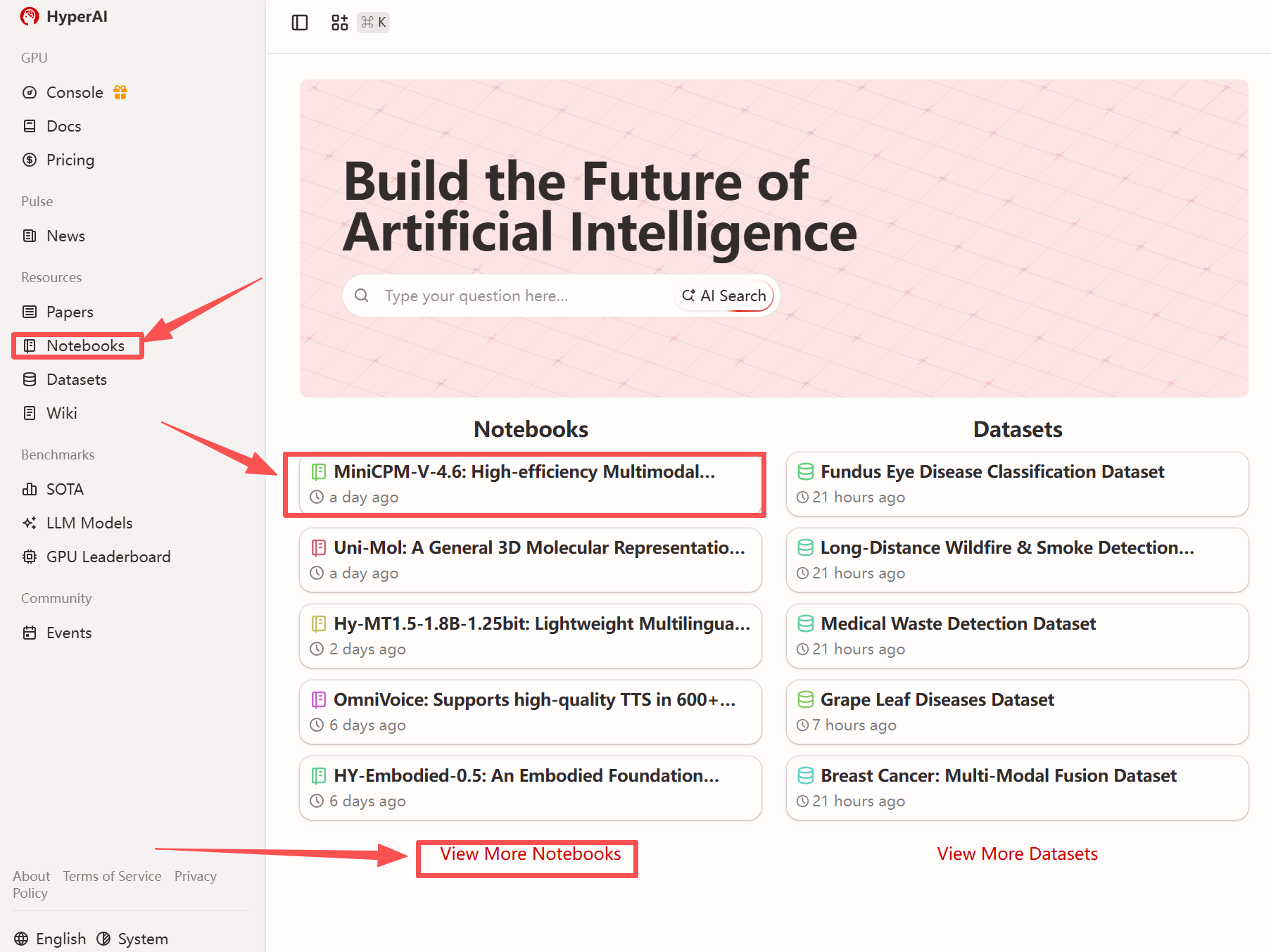

世界中の開発者がこの軽量モデルを迅速に体験できるよう、HyperAIは「MiniCPM-V-4.6:エッジアプリケーション向け高効率マルチモーダルビジュアル言語モデル」をリリースしました。環境設定は完了しており、モデルのオンライン展開も容易に行えます。

オンラインで実行:https://go.hyper.ai/GVDmw

関連する研究論文を見る:

https://hyper.ai/papers/2605.08985

その他のオンラインチュートリアル:

より詳しい情報については、弊社の公式ウェブサイトをご覧ください。

デモの実行

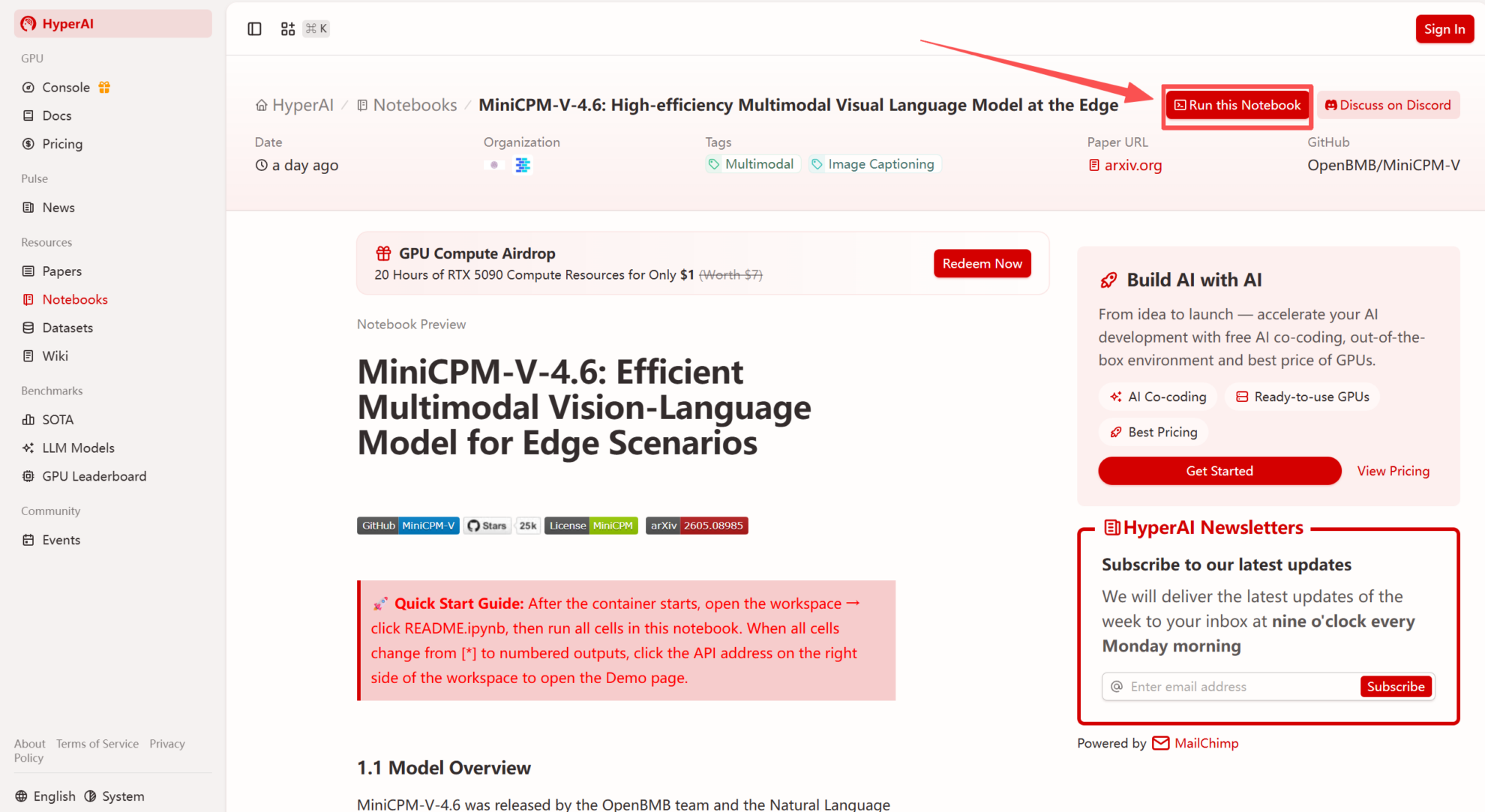

1. hyper.ai のホームページにアクセスしたら、「チュートリアル」ページを選択するか、「その他のチュートリアルを表示」をクリックし、「MiniCPM-V-4.6: デバイス向け効率的なマルチモーダル視覚言語モデル」を選択して、「このチュートリアルを実行」をクリックします。

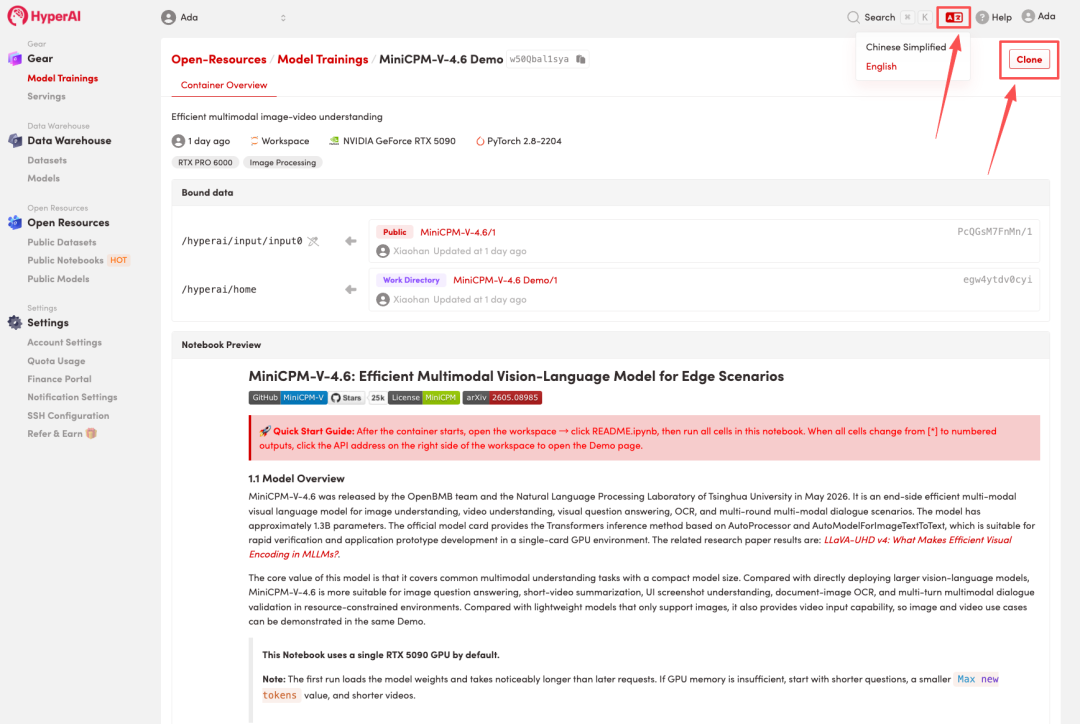

2. ページがリダイレクトされたら、右上隅の「複製」をクリックして、チュートリアルを独自のコンテナーに複製します。

注:ページの右上で言語を切り替えることができます。現在、中国語と英語が利用可能です。このチュートリアルでは英語で手順を説明します。

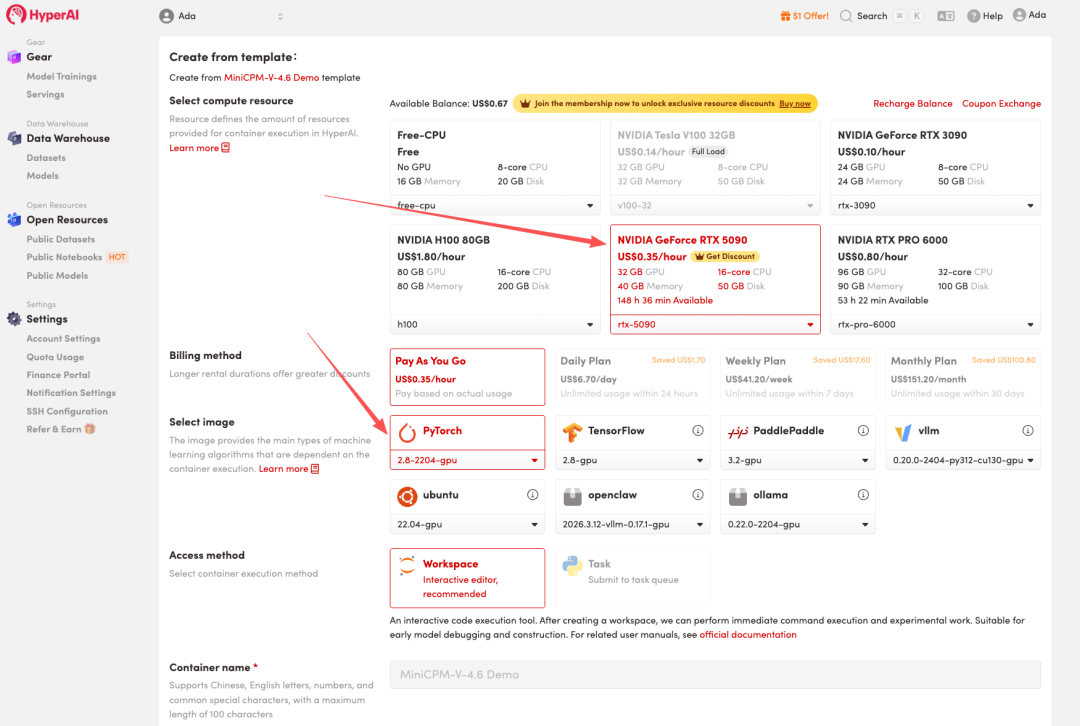

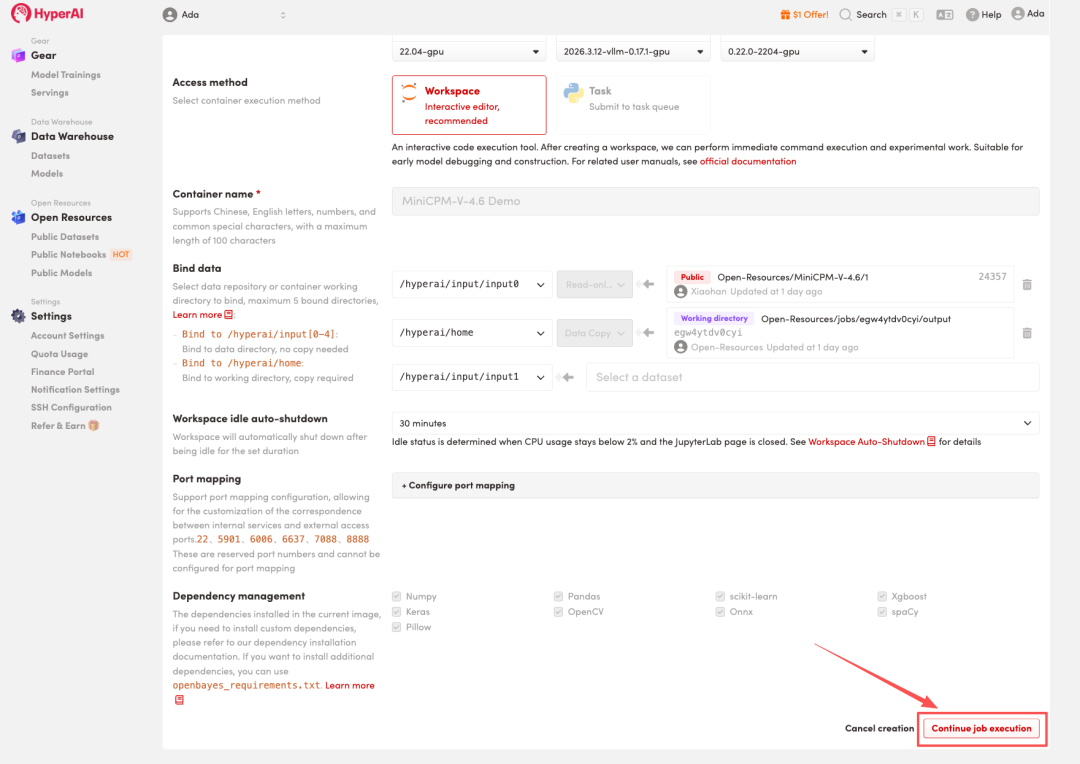

3. 「NVIDIA RTX 5090」と「PyTorch」の画像を選択し、「ジョブの実行を続行」をクリックします。

HyperAI は新規ユーザー向けに登録ボーナスを提供しています。わずか $1 で、RTX 5090 のコンピューティング パワー (元の価格は $7) を 20 時間利用でき、リソースは無期限に有効です。

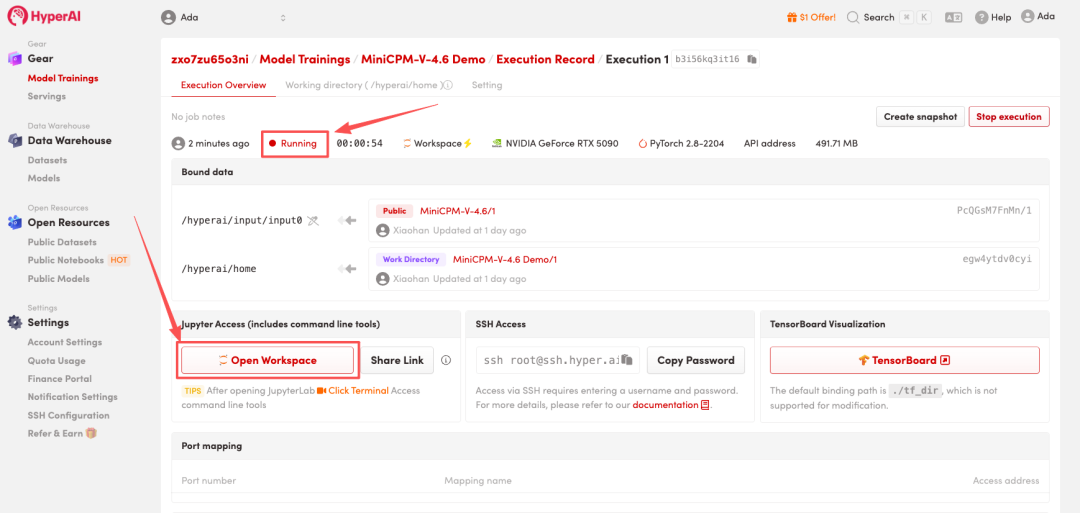

4. リソースが割り当てられるのを待ちます。ステータスが「実行中」に変わったら、「ワークスペースを開く」をクリックしてJupyterワークスペースに入ります。

エフェクト表示

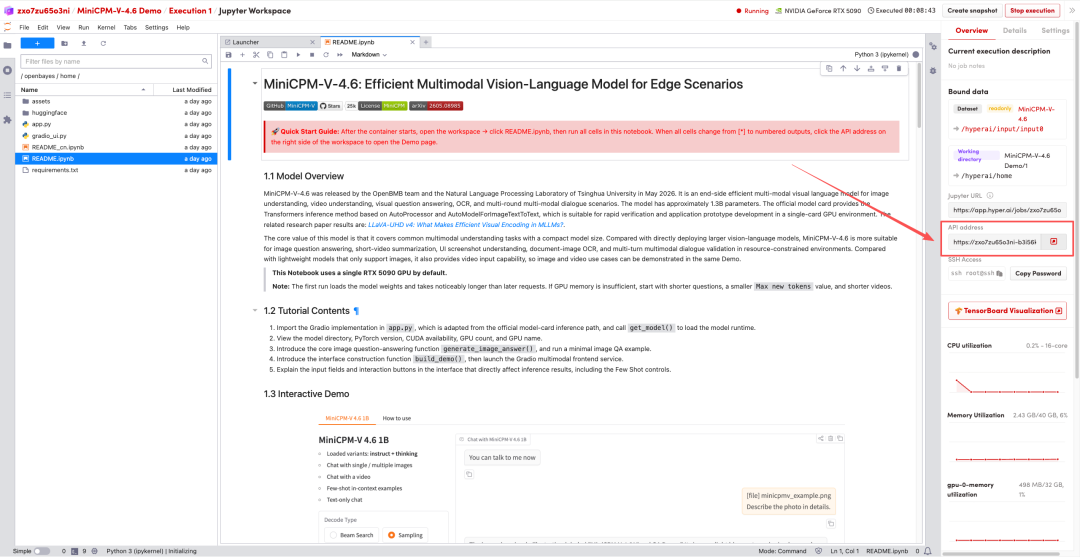

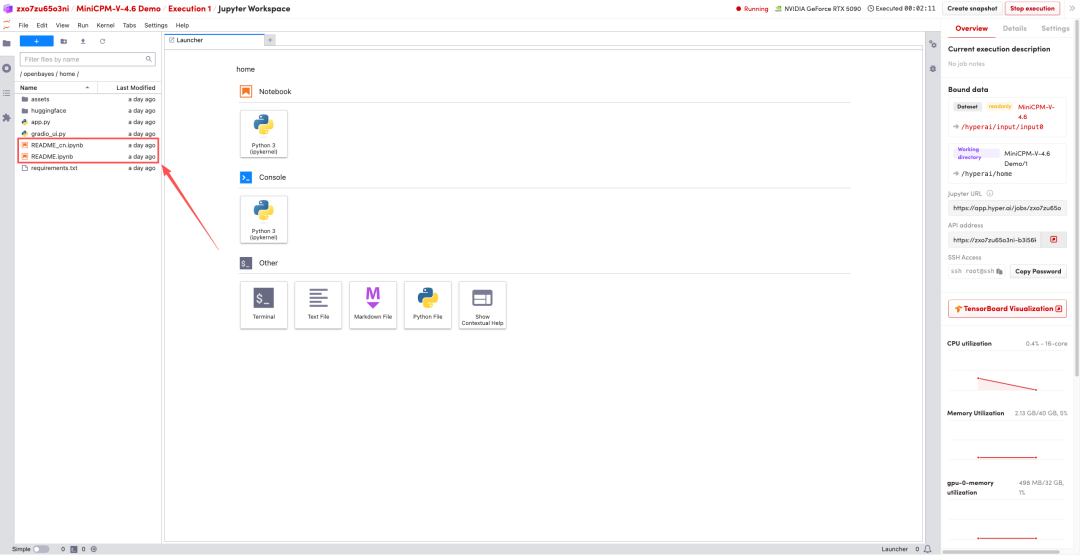

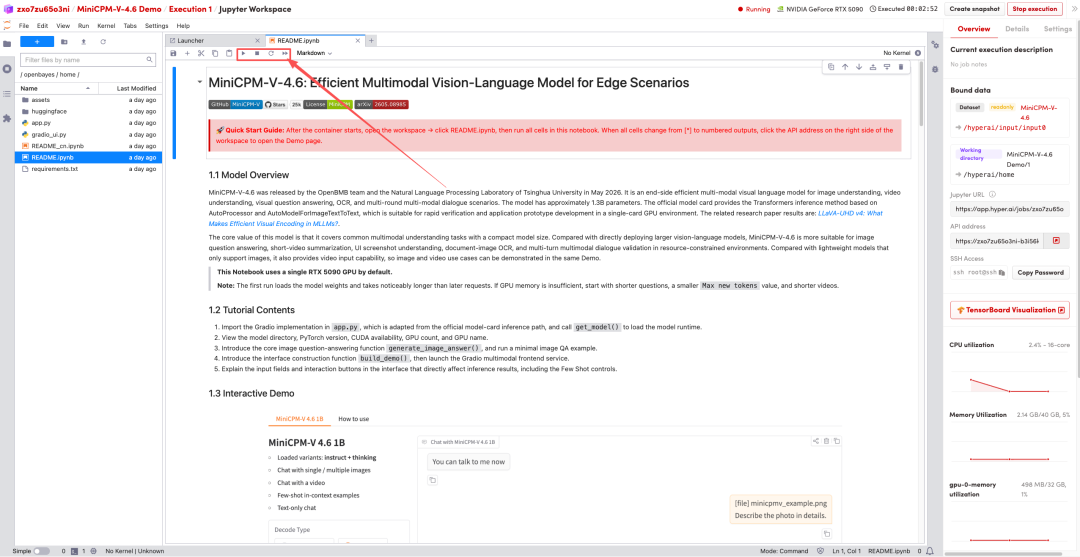

1. ページがリダイレクトされたら、左側のREADMEファイルをクリックし、上部の「実行」をクリックします。

2. 処理が完了したら、右側のAPIアドレスをクリックしてデモページに移動します。