Command Palette

Search for a command to run...

MiniCPM-V 4.5 : Le Modèle Multimodal De Bout En Bout Le Plus Puissant

Date

Taille

343.55 MB

Balises

Licence

Apache 2.0

GitHub

URL du document

1. Introduction au tutoriel

MiniCPM-V 4.5 est un modèle d'IA embarquée extrêmement performant, open source depuis août 2025, développé par le Laboratoire de traitement automatique du langage naturel de l'Université Tsinghua en collaboration avec Wallfacer AI. Ce modèle utilise 8 octets de paramètres. Il excelle dans de nombreux domaines, notamment le traitement d'images, de vidéos et la reconnaissance optique de caractères (OCR), et réalise des avancées majeures, en particulier dans la compréhension de vidéos à fréquence de rafraîchissement élevée. Il est capable de traiter ces vidéos et d'en reconnaître le contenu avec précision. Le modèle prend en charge un mode d'inférence hybride, offrant un équilibre optimal entre performance et rapidité de réponse. MiniCPM-V 4.5 est facilement déployable en périphérie de réseau, avec une faible consommation de mémoire et une vitesse d'inférence élevée, ce qui le rend idéal pour les applications embarquées dans les véhicules, les robots et autres appareils, établissant ainsi une nouvelle référence pour le développement de l'IA embarquée. Des articles de recherche associés sont disponibles. MiniCPM-V : un MLLM de niveau GPT-4V sur votre téléphone .

Les ressources informatiques utilisées dans ce tutoriel sont une seule carte RTX 4090.

2. Affichage des effets

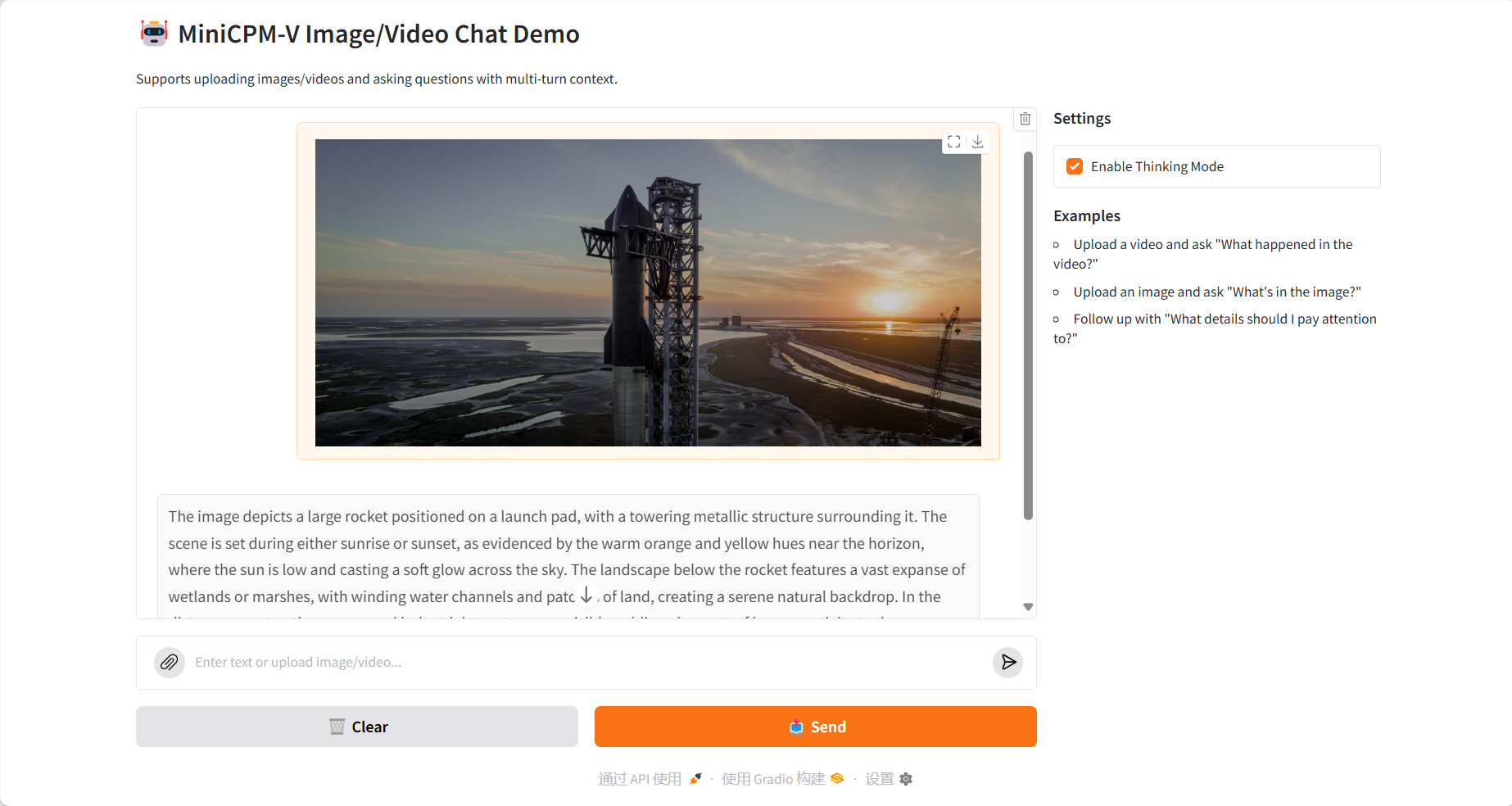

Compréhension de l'image

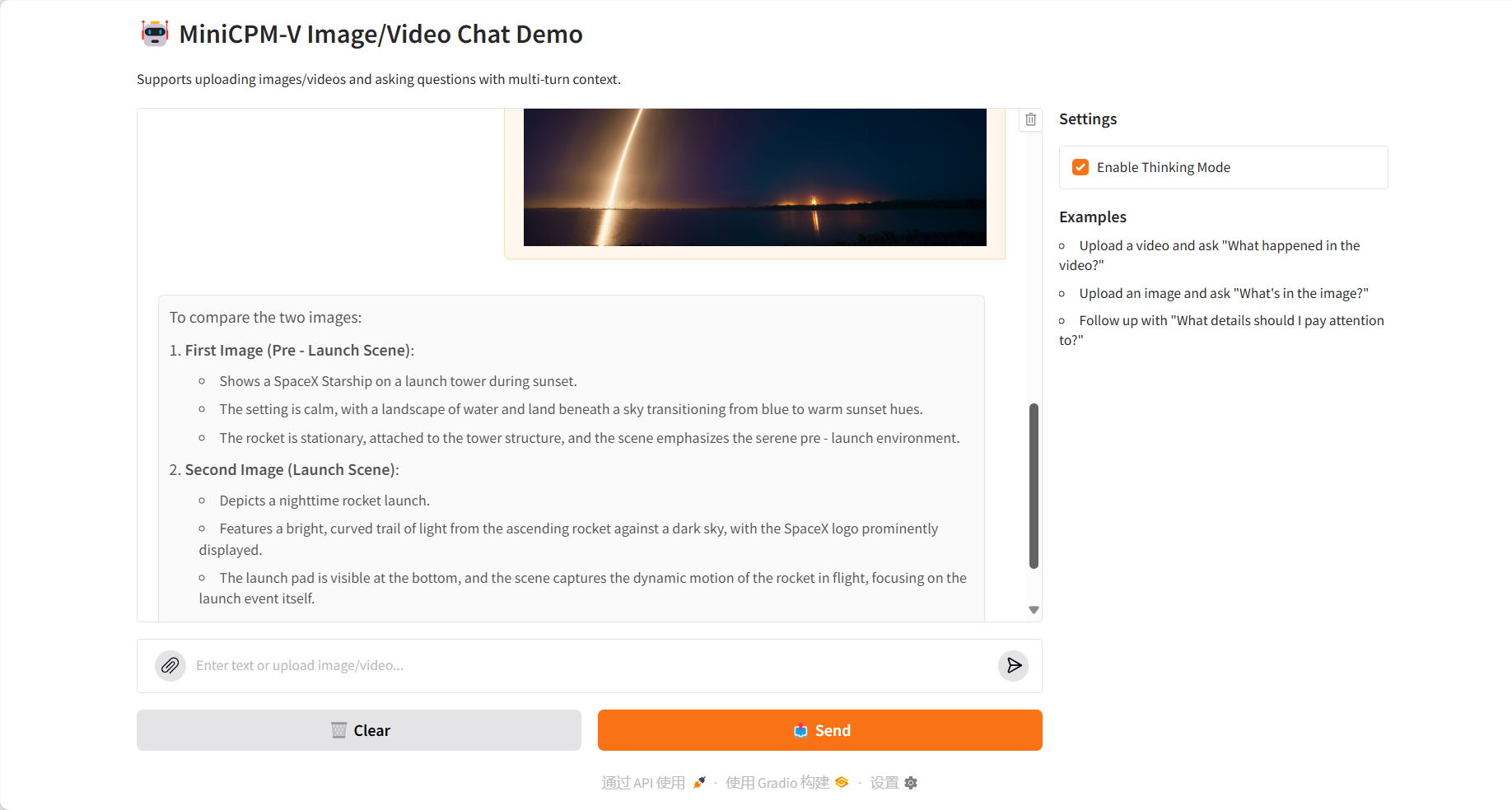

Comparaison multi-images

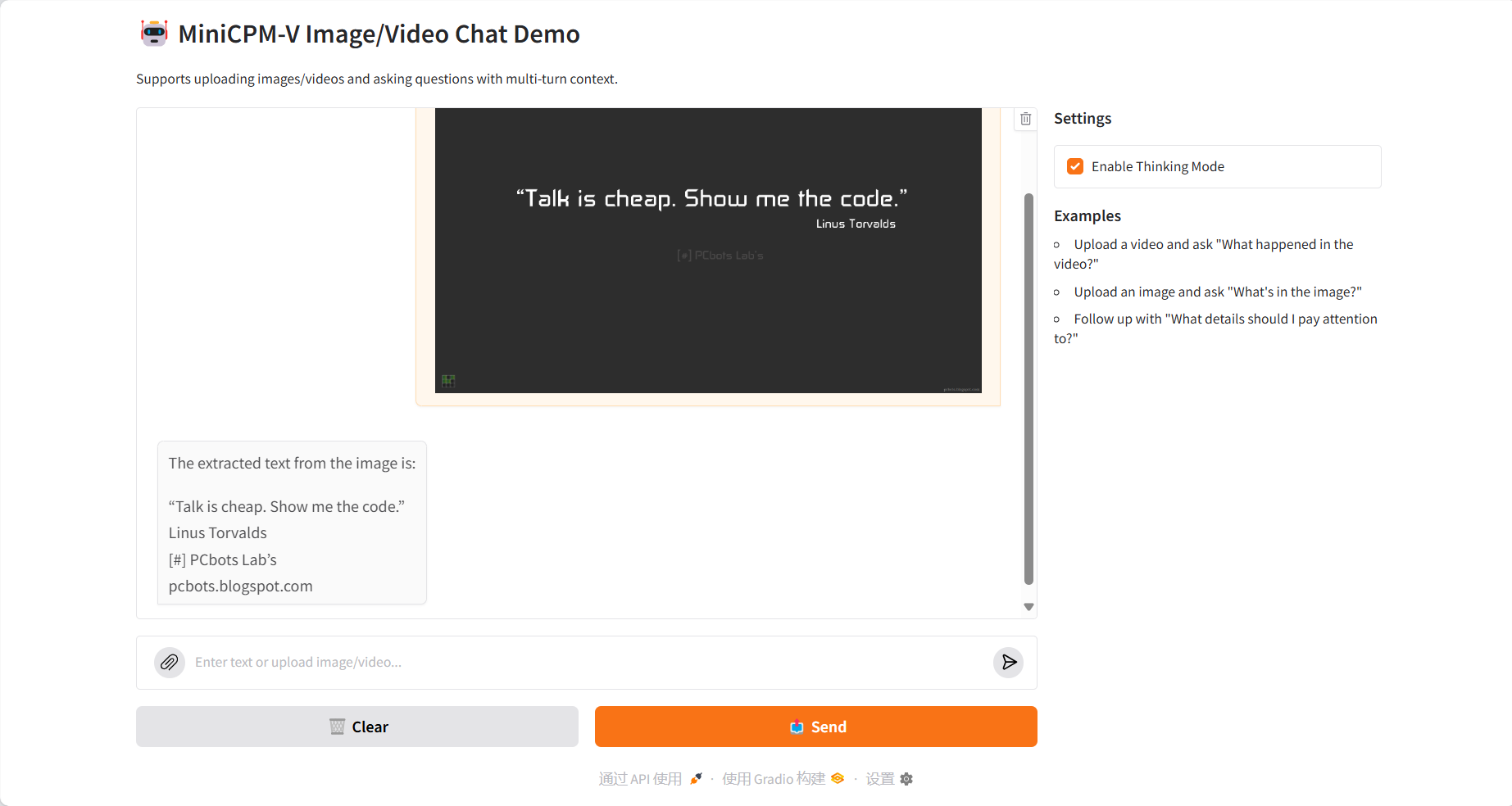

Extraction de texte OCR

Compréhension de la vidéo

3. Étapes de l'opération

1. Démarrez le conteneur

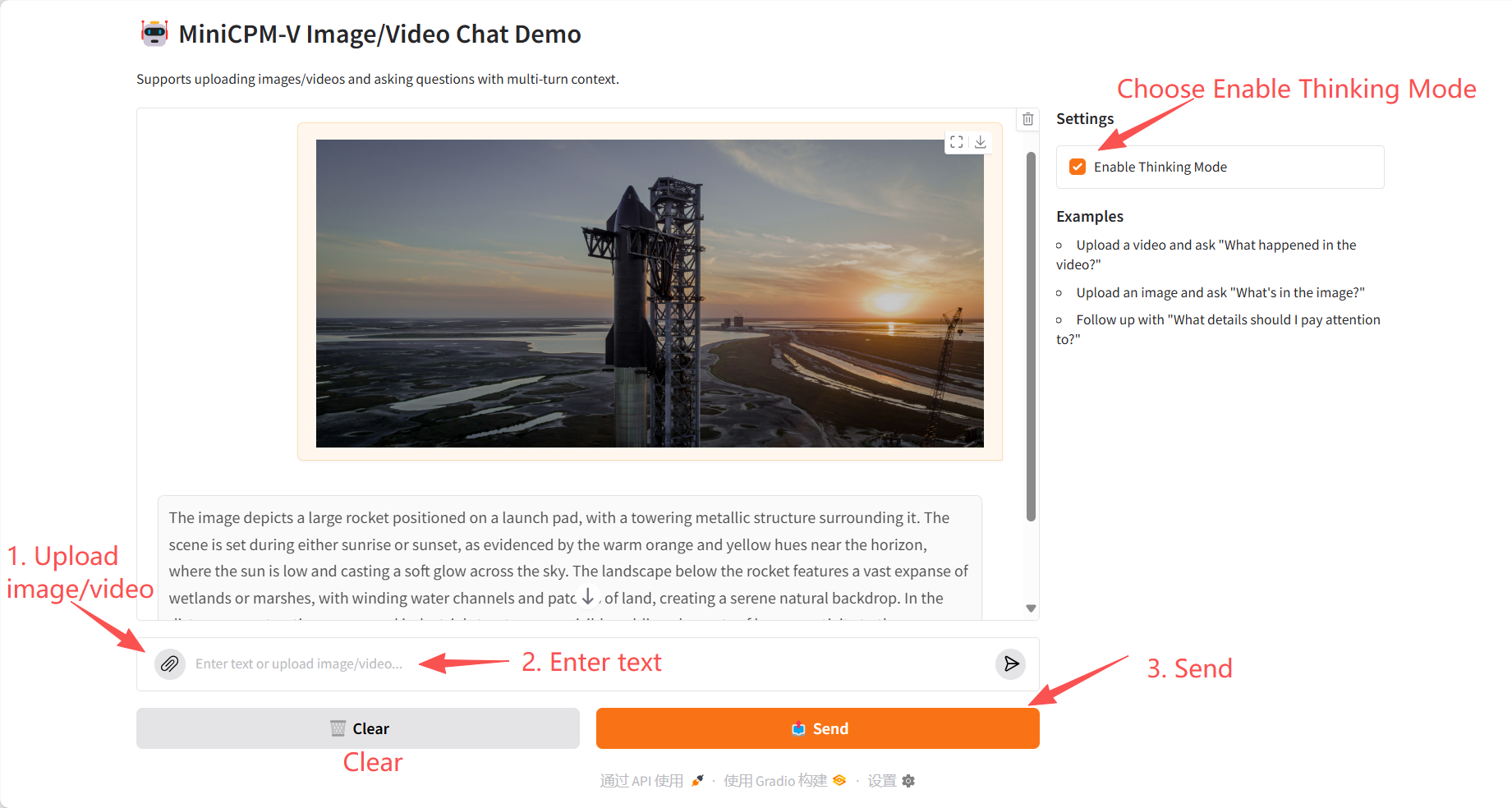

2. Étapes d'utilisation

Si « Bad Gateway » s'affiche, cela signifie que le modèle est en cours d'initialisation. Étant donné que le modèle est grand, veuillez patienter environ 2 à 3 minutes et actualiser la page.

4. Discussion

🖌️ Si vous voyez un projet de haute qualité, veuillez laisser un message en arrière-plan pour le recommander ! De plus, nous avons également créé un groupe d’échange de tutoriels. Bienvenue aux amis pour scanner le code QR et commenter [Tutoriel SD] pour rejoindre le groupe pour discuter de divers problèmes techniques et partager les résultats de l'application↓

Informations sur la citation

Les informations de citation pour ce projet sont les suivantes :

@article{yao2024minicpm,

title={MiniCPM-V: A GPT-4V Level MLLM on Your Phone},

author={Yao, Yuan and Yu, Tianyu and Zhang, Ao and Wang, Chongyi and Cui, Junbo and Zhu, Hongji and Cai, Tianchi and Li, Haoyu and Zhao, Weilin and He, Zhihui and others},

journal={arXiv preprint arXiv:2408.01800},

year={2024}

}Créer de l'IA avec l'IA

De l'idée au lancement — accélérez votre développement IA avec le co-codage IA gratuit, un environnement prêt à l'emploi et le meilleur prix pour les GPU.