Command Palette

Search for a command to run...

Step1X-Edit : Outil d'édition d'images

Date

Taille

655.06 MB

Balises

Licence

Apache 2.0

GitHub

URL du document

Aperçu du projet

Ce tutoriel utilise une seule carte RTX A6000 comme ressource.

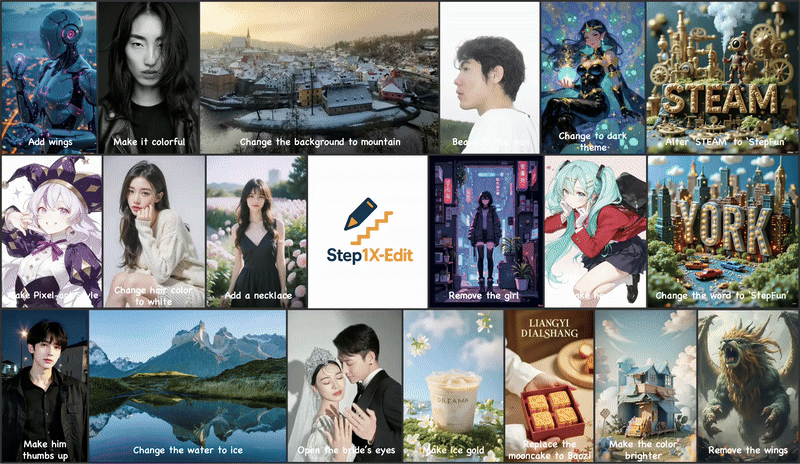

Step1X-Edit est un modèle d'édition d'images de pointe, publié par l'équipe StepFun le 25 avril 2025. Il vise à offrir des performances comparables à celles des modèles propriétaires tels que GPT-4o et Gemini2 Flash. Plus précisément, Step1X-Edit utilise le LLM multimodal pour traiter les images de référence et les instructions d'édition utilisateur, extraire les inclusions latentes et les intégrer au décodeur d'images diffuses afin d'obtenir l'image cible. Le modèle, doté d'un volume de paramètres total de 19 B (7 B MLLM + 12 B DiT), offre trois fonctionnalités clés : une analyse sémantique précise, le maintien de la cohérence des identités et un contrôle de niveau régional de haute précision. Il prend en charge 11 types de tâches d'édition d'images à haute fréquence, telles que le remplacement de texte, le transfert de style, la transformation de matériaux, la retouche de caractères, etc.

Step1X-Edit est la première plateforme open source à intégrer pleinement MLLM et DiT, améliorant considérablement la précision d'édition et la fidélité des images. Dans le nouveau benchmark d'édition d'images GEdit-Bench, Step1X-Edit surpasse largement les modèles open source existants en termes de cohérence sémantique, de qualité d'image et de score global, rivalisant avec GPT-4o et Gemini 2.0 Flash. Des articles de recherche associés sont disponibles. Step1X-Edit : un cadre pratique pour l'édition d'images en général .

Step1X-Edit dispose des fonctionnalités de base suivantes pour les tâches d'édition d'images en langage naturel :

- Analyse de précision sémantique : prend en charge les instructions de combinaison complexes décrites en langage naturel. Ces instructions ne nécessitent pas de modèles et peuvent s'adapter avec souplesse aux besoins d'édition multi-tours et multi-tâches. Elles prennent également en charge la reconnaissance, le remplacement et la reconstruction de texte dans les images.

- Préservation de la cohérence de l'identité : après l'édition, le visage, la posture et les caractéristiques d'identité peuvent être conservés de manière stable, ce qui convient aux scénarios à haute cohérence tels que les personnes virtuelles, les modèles de commerce électronique et les images sociales ;

- Contrôle de zone de haute précision : prend en charge l'édition directionnelle du texte, des matériaux, des couleurs, etc. dans les zones désignées, en conservant un style d'image unifié et en offrant des capacités de contrôle plus raffinées.

Exemples de projets

Étapes de course

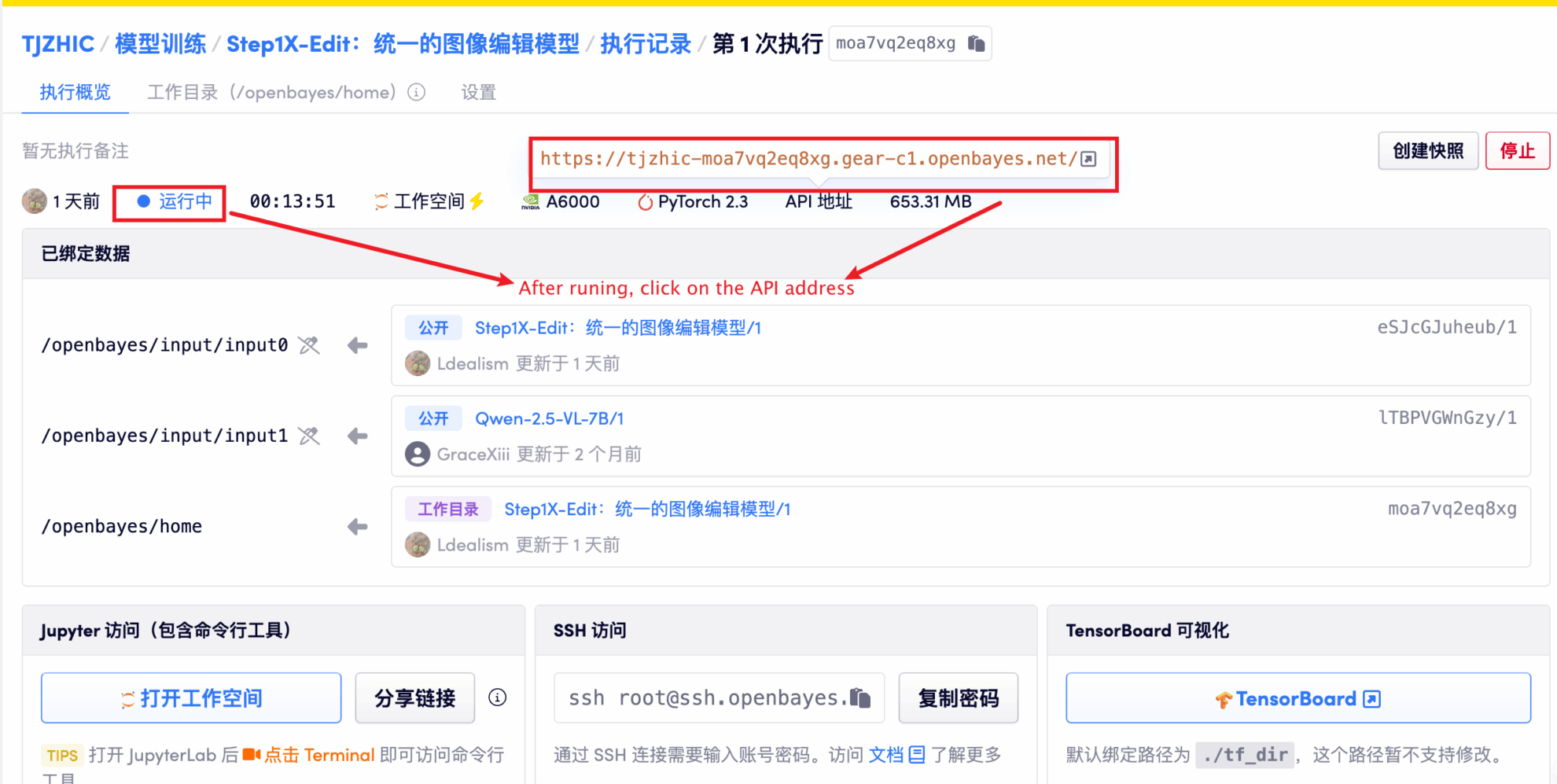

1. Après avoir démarré le conteneur, cliquez sur l'adresse API pour accéder à l'interface Web

Si « Bad Gateway » s'affiche, cela signifie que le modèle est en cours d'initialisation. Étant donné que le modèle est grand, veuillez patienter environ 1 à 2 minutes et actualiser la page.

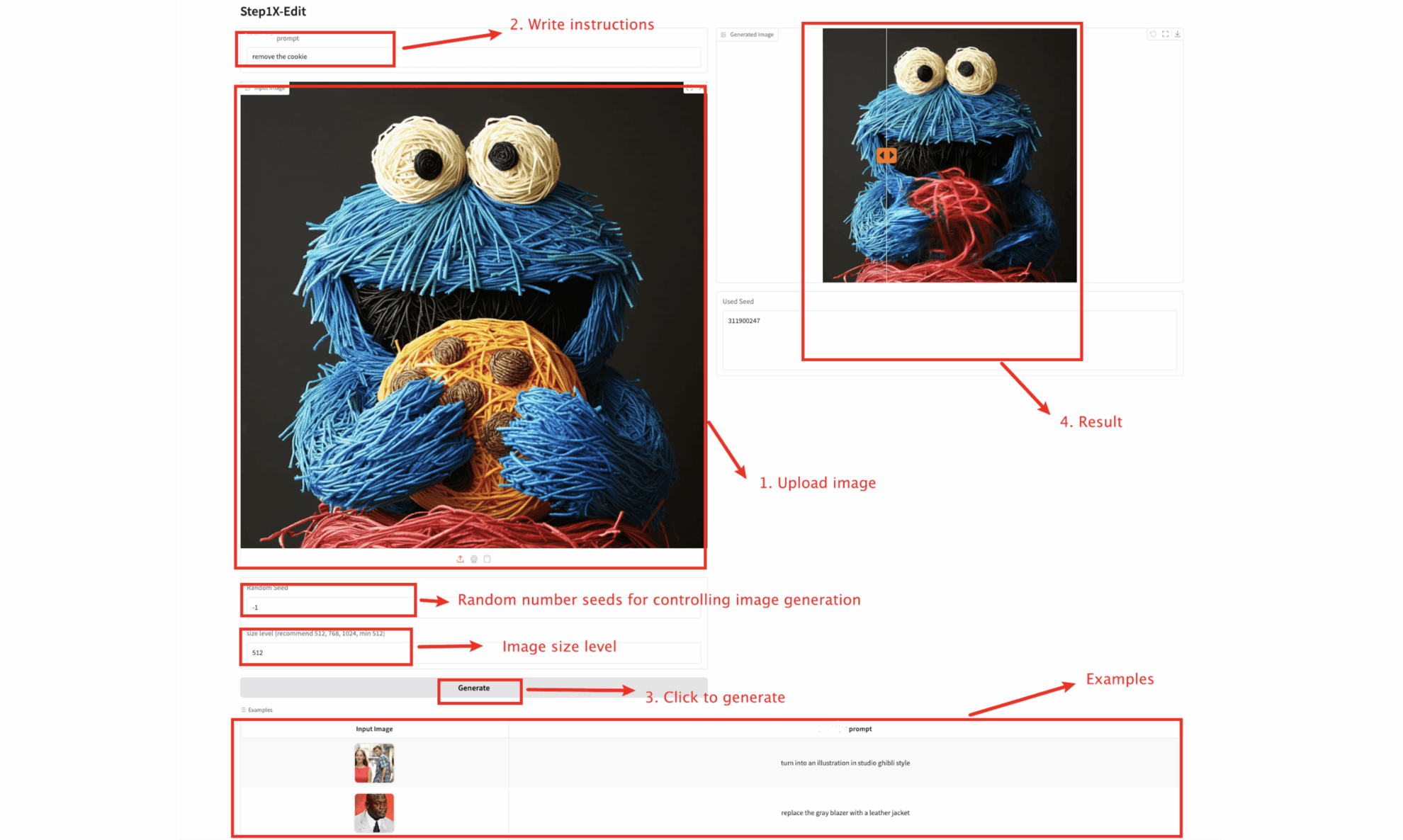

2. Une fois que vous entrez sur la page Web, vous pouvez interagir avec le modèle

Échange et discussion

🖌️ Si vous voyez un projet de haute qualité, veuillez laisser un message en arrière-plan pour le recommander ! De plus, nous avons également créé un groupe d’échange de tutoriels. Bienvenue aux amis pour scanner le code QR et commenter [Tutoriel SD] pour rejoindre le groupe pour discuter de divers problèmes techniques et partager les résultats de l'application↓

Informations sur la citation

Merci à l'utilisateur Github zhangjunchang Pour le déploiement de ce tutoriel, les informations de référence du projet sont les suivantes :

@article{liu2025step1x-edit,

title={Step1X-Edit: A Practical Framework for General Image Editing},

author={Shiyu Liu and Yucheng Han and Peng Xing and Fukun Yin and Rui Wang and Wei Cheng and Jiaqi Liao and Yingming Wang and Honghao Fu and Chunrui Han and Guopeng Li and Yuang Peng and Quan Sun and Jingwei Wu and Yan Cai and Zheng Ge and Ranchen Ming and Lei Xia and Xianfang Zeng and Yibo Zhu and Binxing Jiao and Xiangyu Zhang and Gang Yu and Daxin Jiang},

journal={arXiv preprint arXiv:2504.17761},

year={2025}

}Créer de l'IA avec l'IA

De l'idée au lancement — accélérez votre développement IA avec le co-codage IA gratuit, un environnement prêt à l'emploi et le meilleur prix pour les GPU.