Command Palette

Search for a command to run...

Tutoriel En Ligne | Guide Approfondi Sur Le Suivi d'instructions/l'inférence/la Programmation : Mistral Medium 3.5 Déploie Des Agents De Programmation Dans Le Cloud

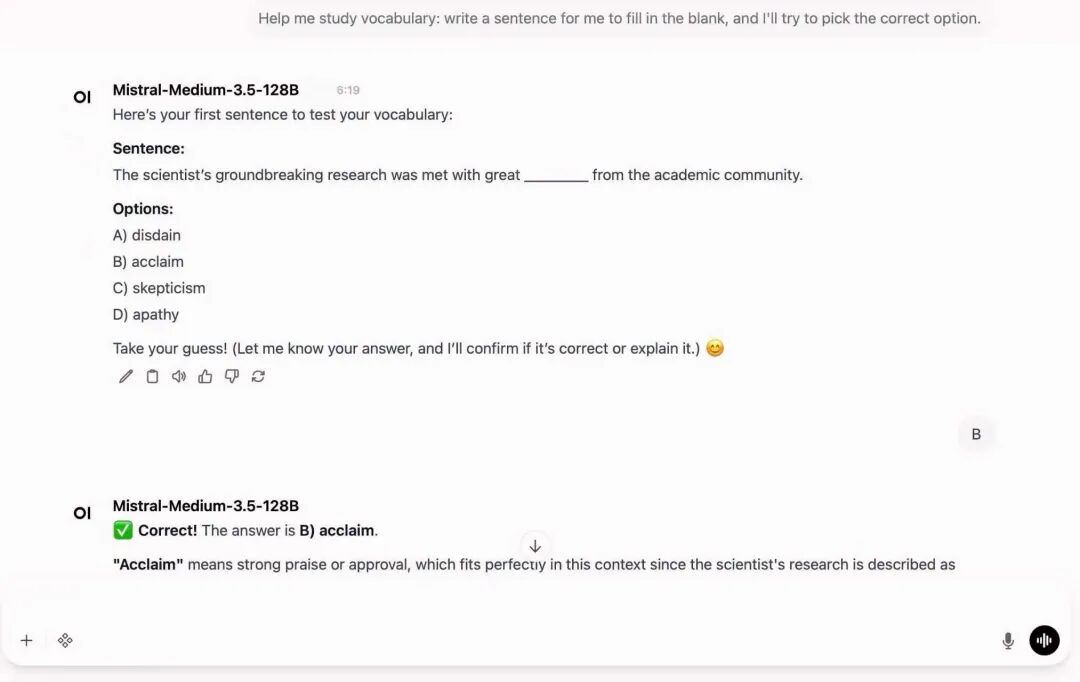

À mesure que les capacités des agents d'IA évoluent, les modèles à grande échelle se transforment progressivement d'« assistants conversationnels » en systèmes véritablement intelligents capables d'exécuter des tâches. Récemment, Mistral Medium 3.5 de Mistral AI a propulsé les agents de programmation IA vers de nouveaux sommets. Contrairement aux assistants de programmation traditionnels qui se contentent d'effectuer des saisies de code simples, il peut désormais fonctionner de manière autonome dans le cloud, traiter des tâches en parallèle et mener à bien en continu des processus de développement logiciel complexes, tels que la génération de code, le débogage, l'installation des dépendances, l'exécution des tests et même la soumission de demandes de fusion.

Dernier modèle phare de Mistral, le Mistral Medium 3.5 adopte une architecture dense de 128 octets, dispose de 256 000 fenêtres de contexte et intègre pour la première fois les capacités de suivi d'instructions, de raisonnement et de codage dans un seul modèle.

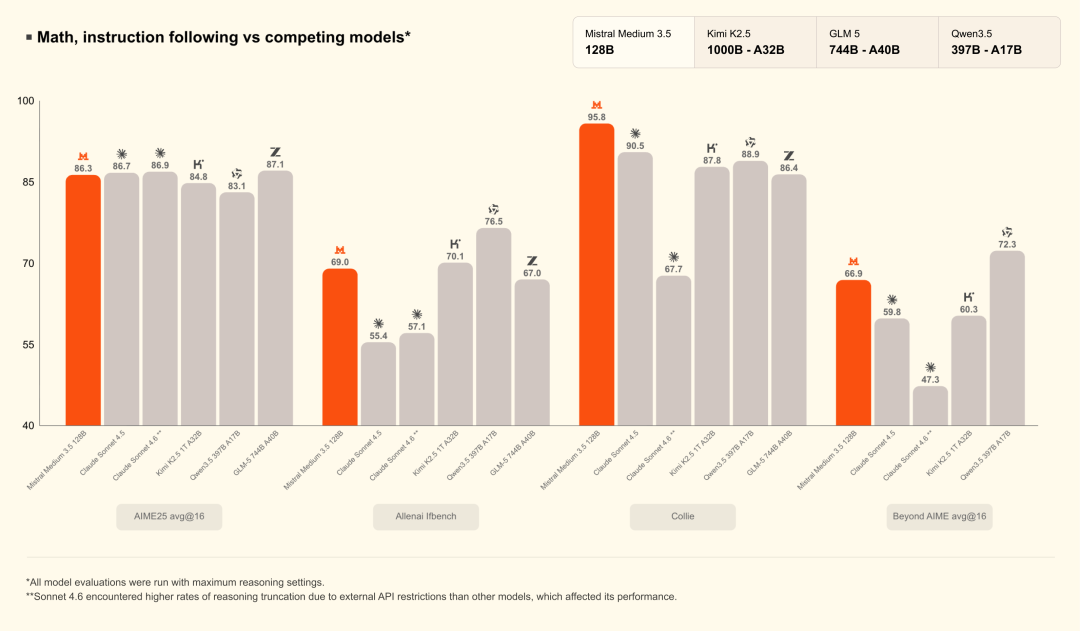

Contrairement aux grands modèles actuels qui reposent fortement sur l'architecture MoE, Mistral a choisi de renforcer son approche de modèle dense, améliorant ainsi ses capacités de traitement des tâches de longue durée tout en préservant la stabilité de l'inférence. Les données officielles montrent que Mistral Medium 3.5 a obtenu un score de 77,61 TP3T sur le SWE-Bench Verified, surpassant des modèles tels que Devstral 2 et Qwen3.5 397B A17B, et démontrant également d'excellentes performances lors de tests de capacités d'agents comme τ³-Telecom.

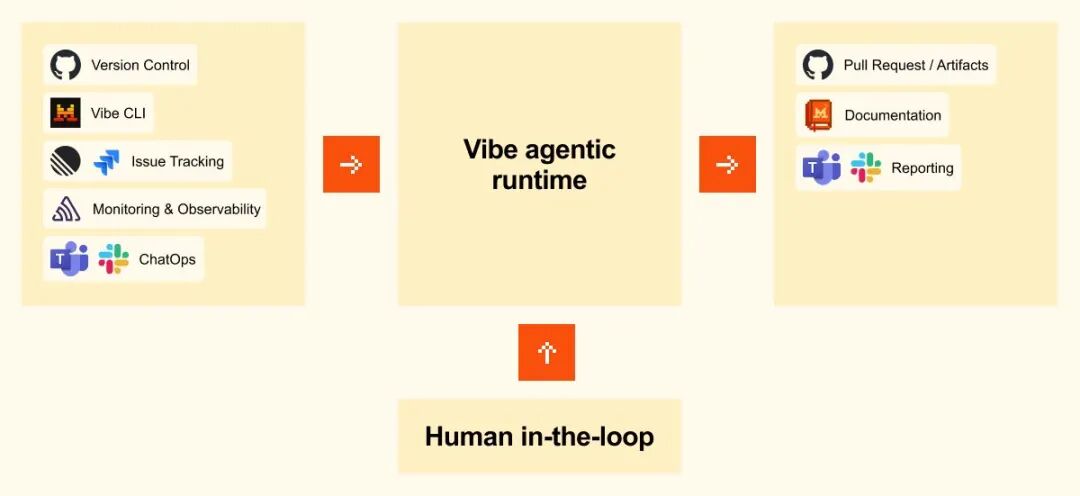

Au-delà du modèle lui-même, l'aspect le plus remarquable de cette mise à jour est la restructuration complète du flux de travail des agents IA par Mistral. Grâce aux agents distants Vibe, les développeurs peuvent exécuter des sessions de codage asynchrones directement dans le cloud, éliminant ainsi la nécessité d'une connexion permanente sur un ordinateur local. Les utilisateurs peuvent lancer des tâches via l'interface de ligne de commande (CLI) ou démarrer des agents cloud directement depuis Le Chat, permettant au modèle d'exécuter en continu des tâches de codage en plusieurs étapes, telles que la refactorisation de modules, la génération de tests, le dépannage de l'intégration continue et la correction de bogues. Parallèlement, le nouveau mode de travail prend en charge la collaboration inter-outils, permettant l'accès à des systèmes externes comme la messagerie, les calendriers, les documents et les plateformes collaboratives, évoluant progressivement vers un véritable assistant IA orienté exécution.

Dans une certaine mesure, Mistral Medium 3.5 représente bien plus qu'une simple mise à jour du modèle ; il marque un tournant majeur dans la programmation de l'IA, passant du rôle de « copilote » à celui d'« agent autonome ». Auparavant, l'IA servait principalement de générateur de code auxiliaire ; désormais, les modèles acquièrent la capacité d'exécuter des tâches pendant de longues périodes, d'invoquer des outils, de gérer des processus et de fournir des résultats. Grâce aux améliorations continues apportées à la longueur du contexte, à la stabilité des inférences et au cadre des agents, les processus de développement logiciel futurs pourraient également connaître des transformations importantes.

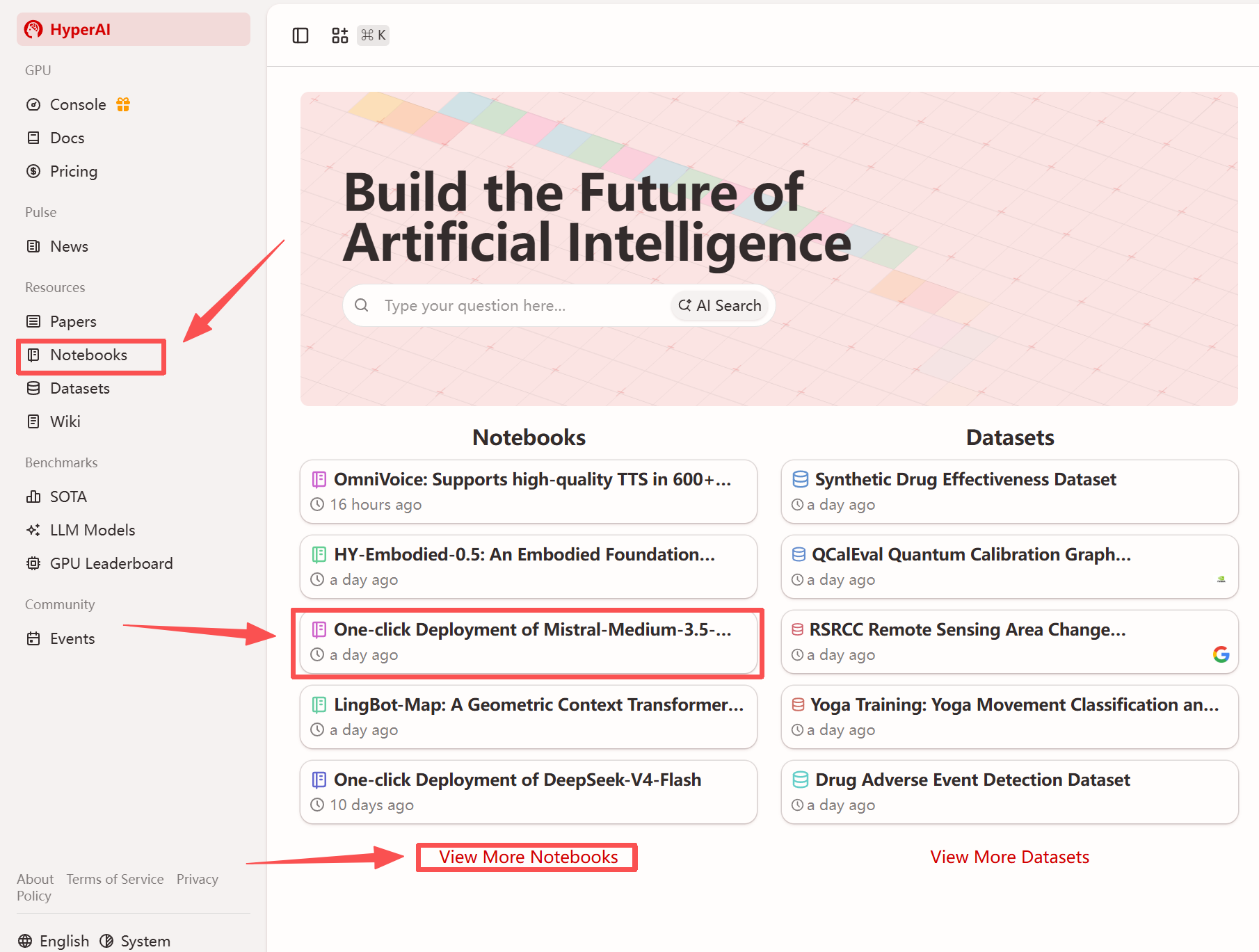

Actuellement, la section tutoriels du site officiel d'HyperAI (hyper.ai) a lancé le « déploiement en un clic de Mistral-Medium-3.5-128B » pour compléter la configuration de l'environnement et réduire encore le seuil d'utilisation du modèle.

Exécutez en ligne :

Plus de tutoriels en ligne :

Bienvenue sur notre site web officiel pour plus d'informations :

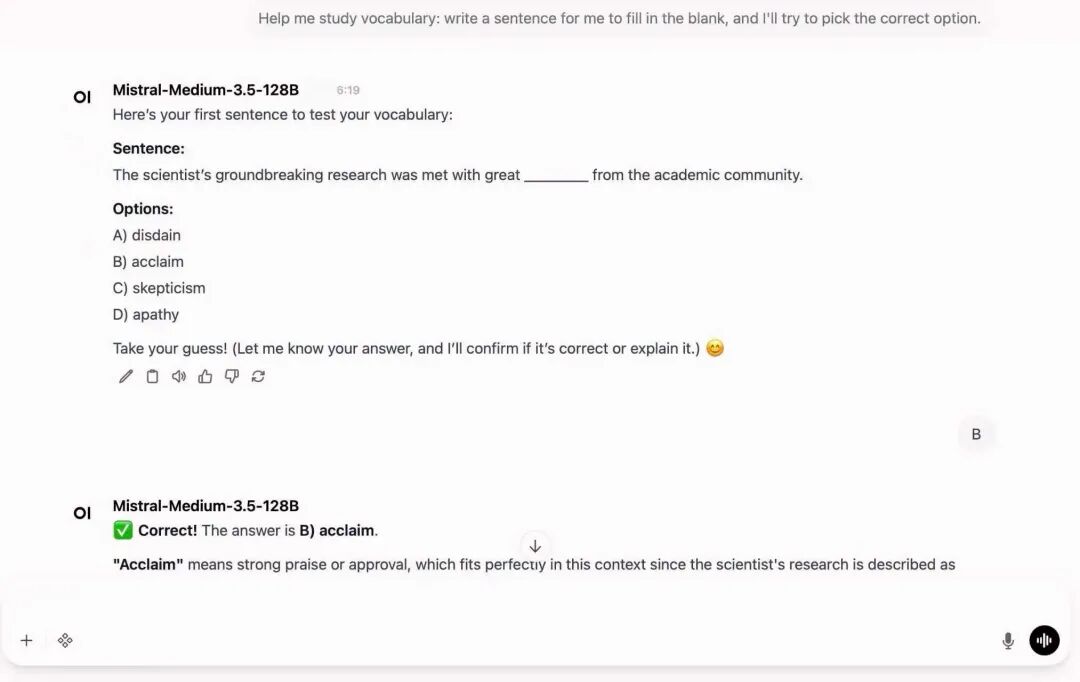

Essai de démonstration

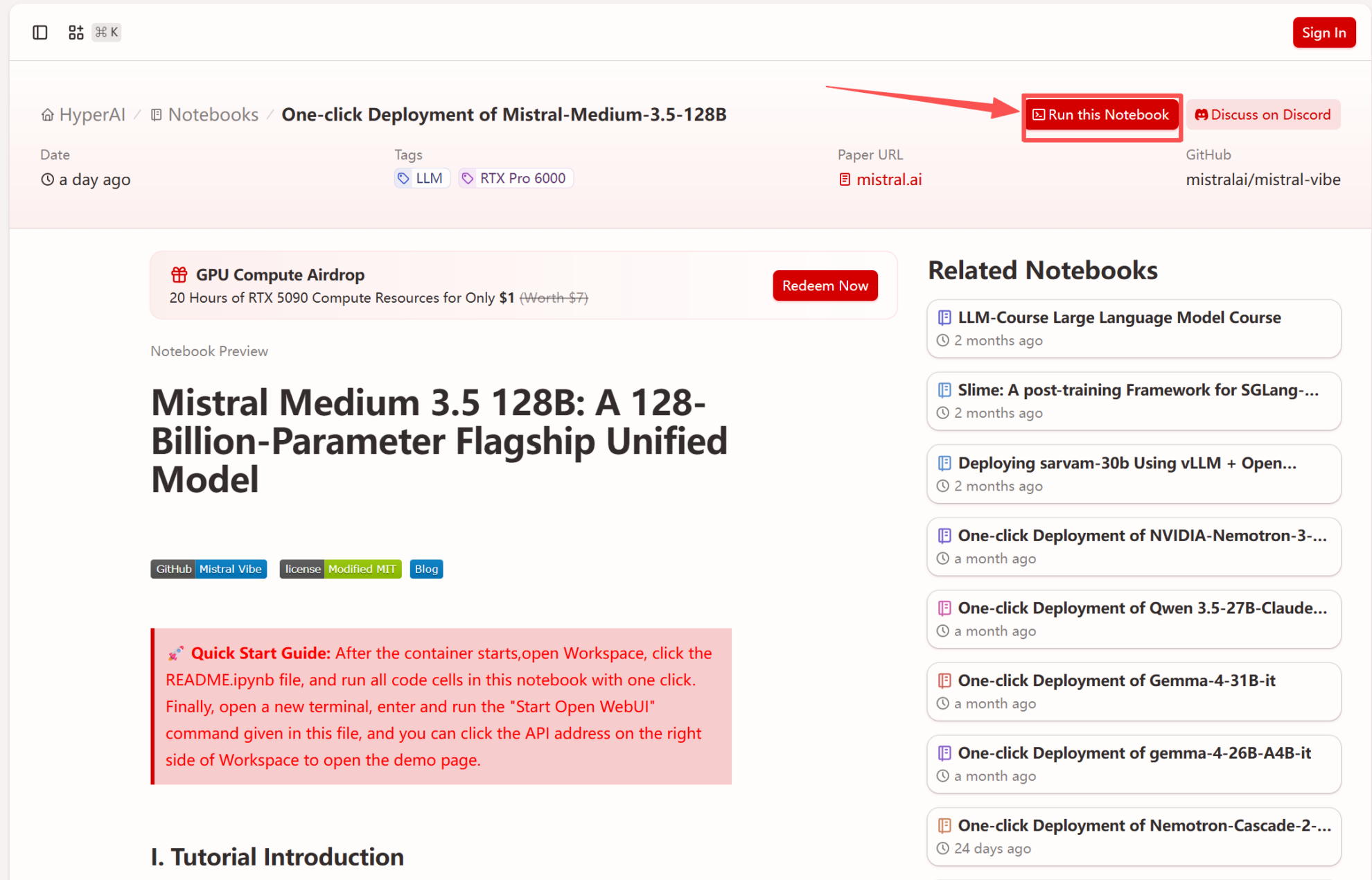

1. Après avoir accédé à la page d'accueil hyper.ai, sélectionnez la page « Tutoriels », ou cliquez sur « Voir plus de tutoriels », sélectionnez « Déploiement en un clic de Mistral-Medium-3.5-128B », et cliquez sur « Exécuter ce tutoriel ».

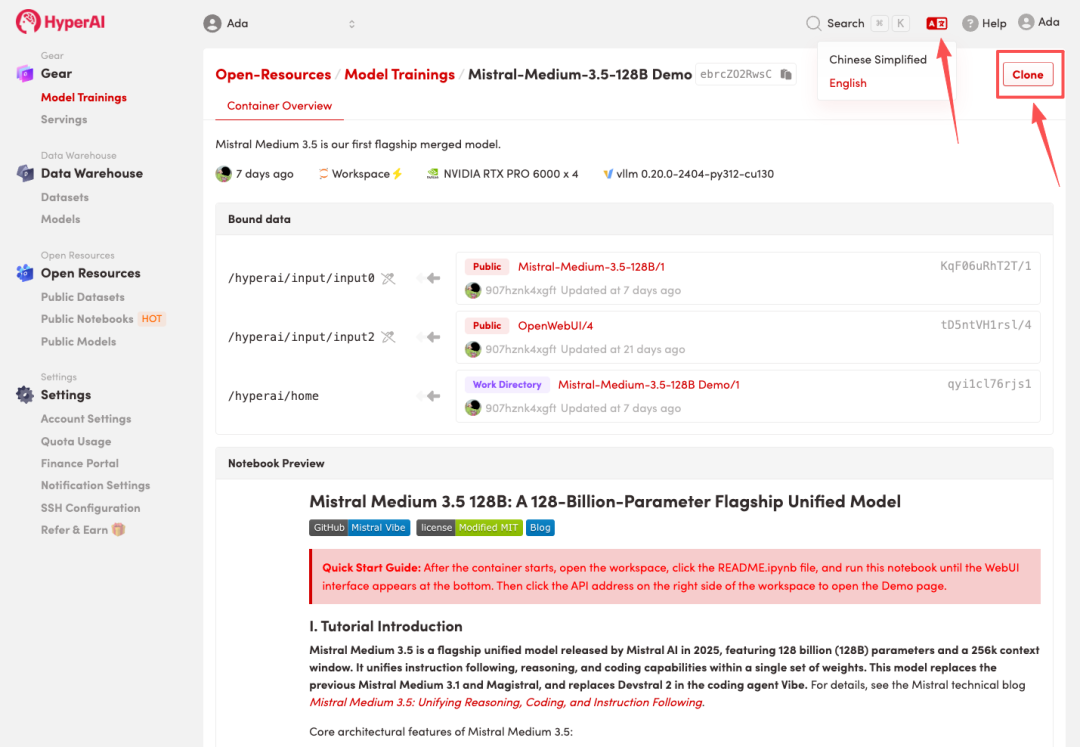

2. Une fois la page redirigée, cliquez sur « Cloner » en haut à droite pour cloner le tutoriel dans votre propre conteneur.

Remarque : Vous pouvez changer de langue en haut à droite de la page. Actuellement, le chinois et l’anglais sont disponibles. Ce tutoriel présente les étapes en anglais.

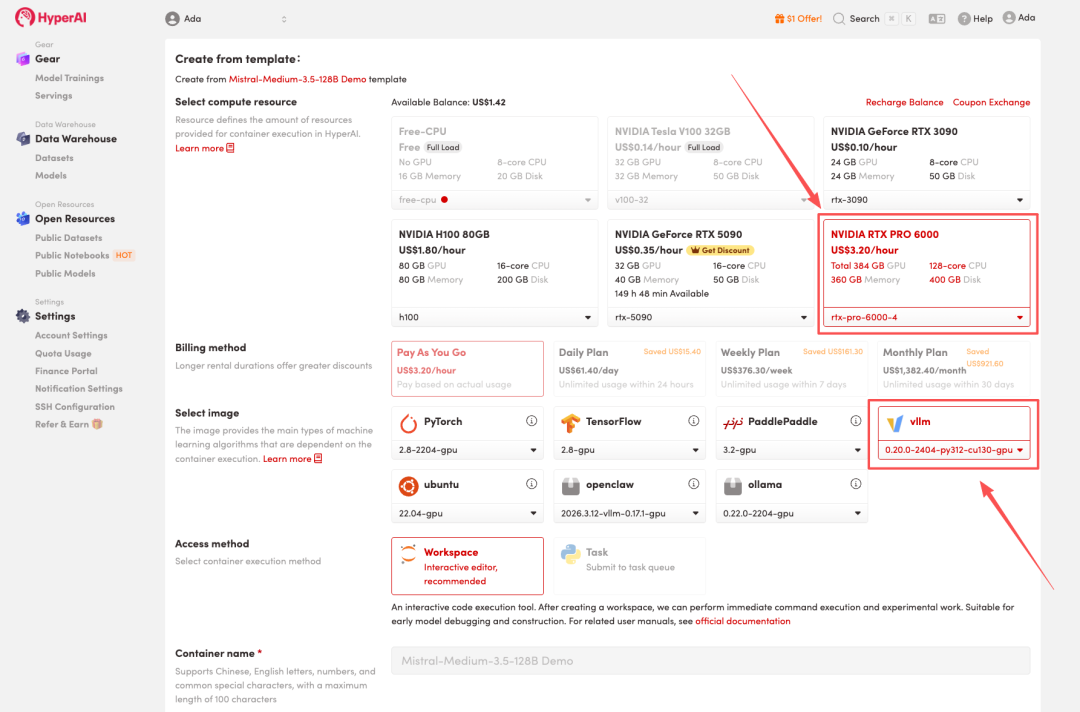

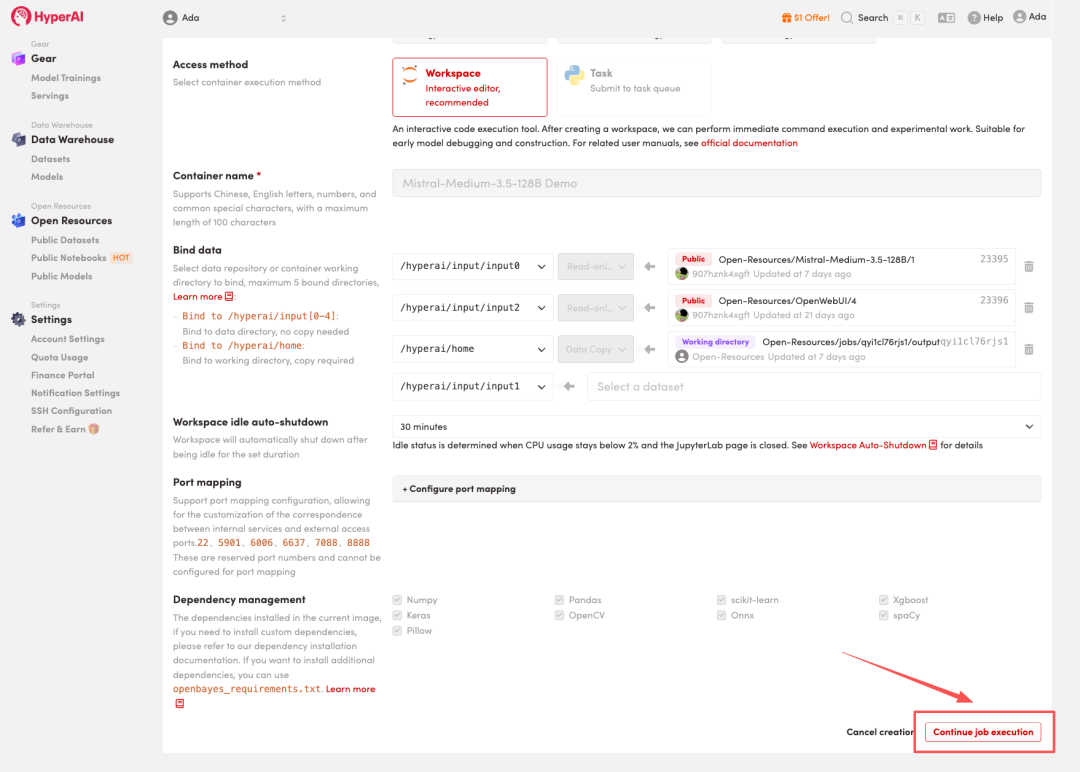

3. Sélectionnez les images « NVIDIA RTX PRO 6000 -4 » et « vLLM », puis cliquez sur « Continuer l'exécution de la tâche ».

HyperAI propose un bonus d'inscription pour les nouveaux utilisateurs : pour seulement $1, vous pouvez obtenir 20 heures de puissance de calcul RTX 5090 (au lieu de $7), et les ressources sont valables indéfiniment.

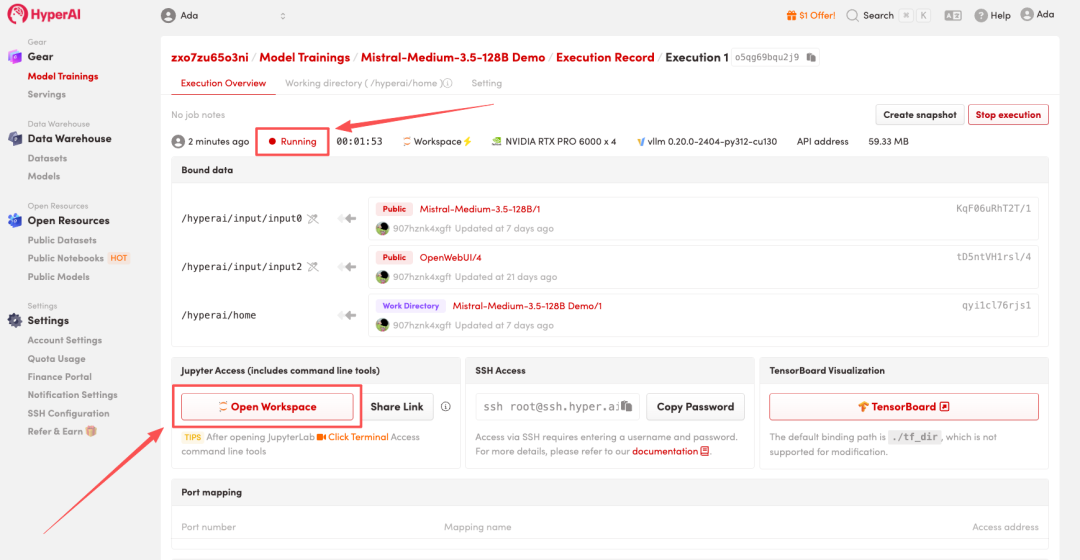

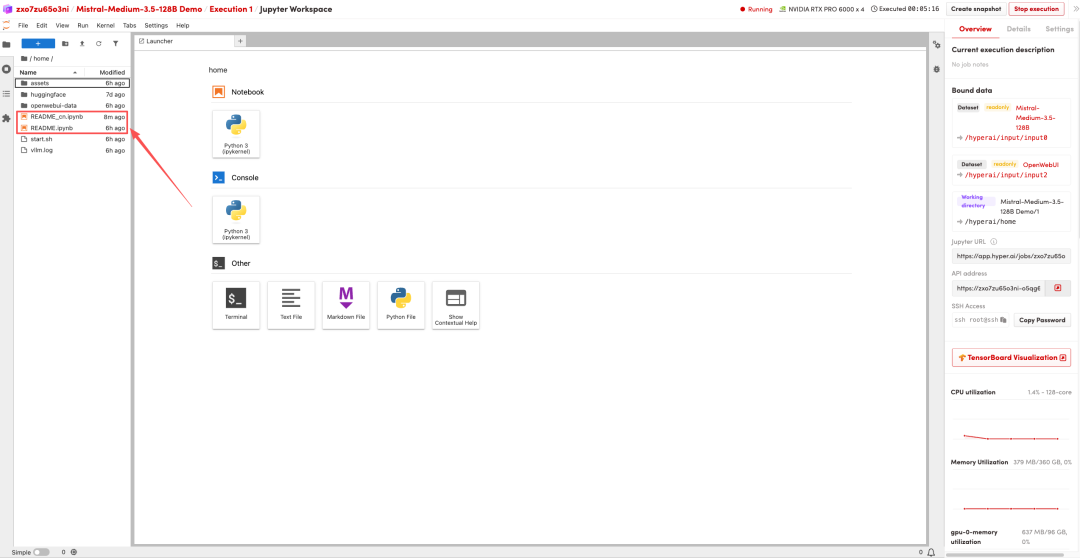

4. Attendez que les ressources soient allouées. Une fois que le statut passe à « En cours d'exécution », cliquez sur « Ouvrir l'espace de travail » pour accéder à l'espace de travail Jupyter.

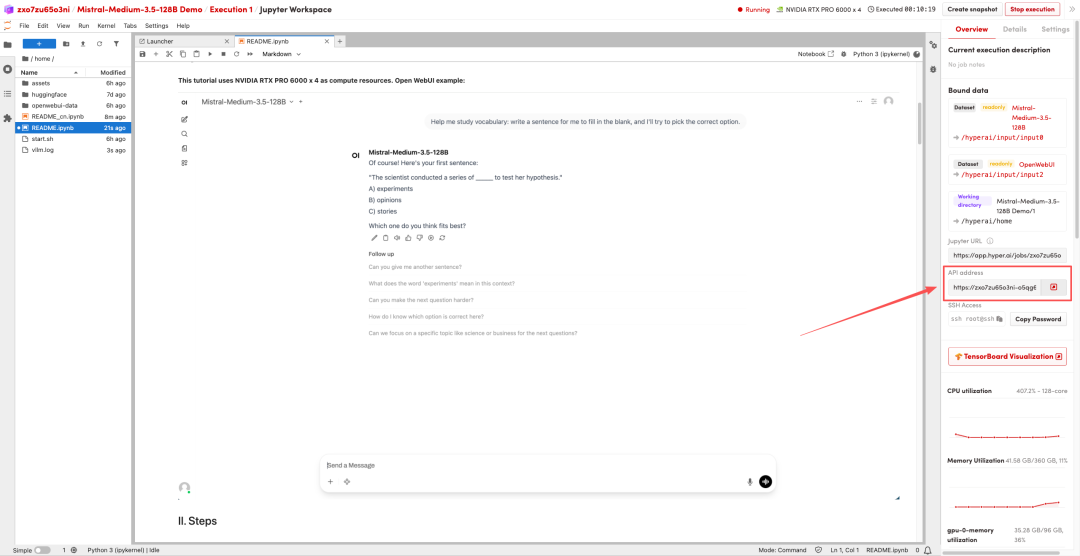

Affichage des effets

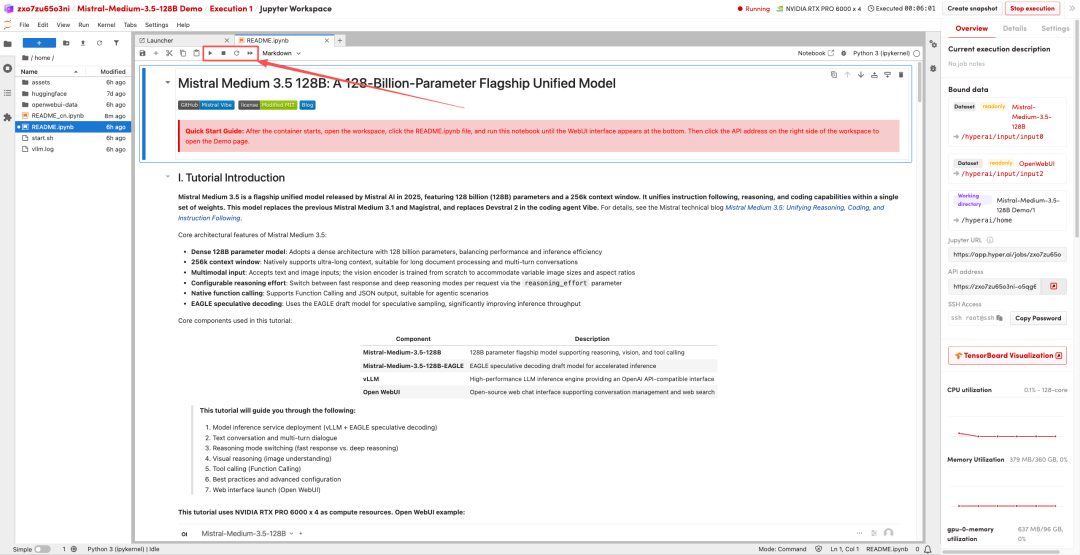

1. Une fois la page redirigée, cliquez sur le fichier README à gauche, puis sur « Exécuter » en haut.

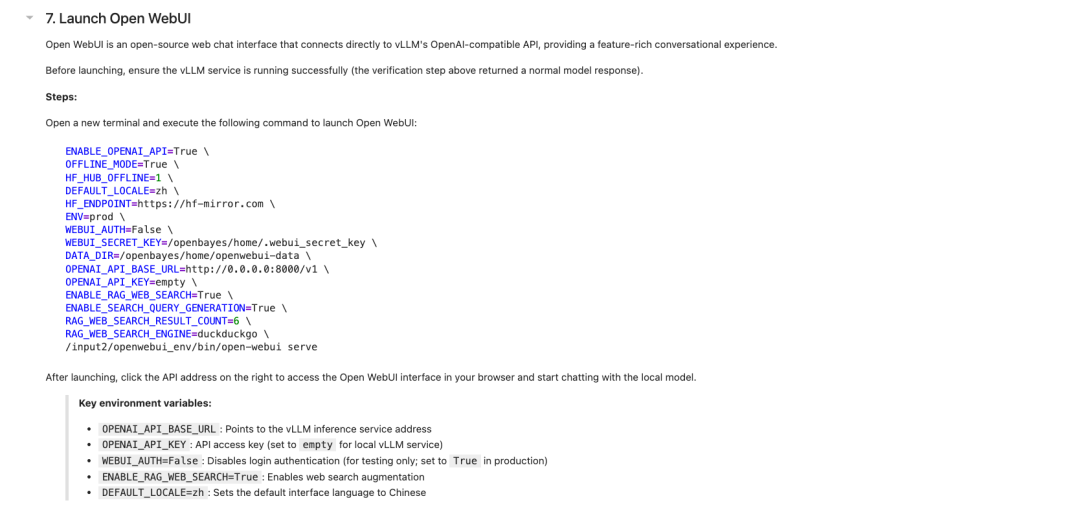

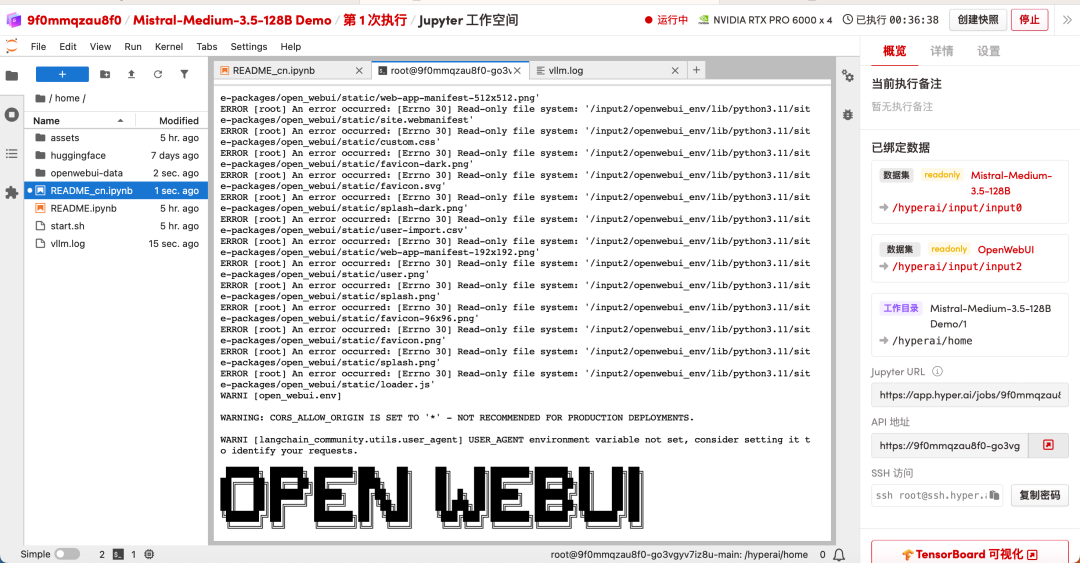

2. Une fois le processus terminé, lancez Open WebUI en suivant les instructions du fichier README. Le démarrage est terminé lorsque vous voyez les caractères ASCII « OPENWEBUI » en forme de carré. Vous pouvez ensuite cliquer sur l'adresse de l'API à droite pour accéder à la page de démonstration.