Command Palette

Search for a command to run...

Rapport Hebdomadaire AI Paper | Tests De Modèles De Langage Par l'équipe Rouge / Méthodes De Suivi De Points 3D multi-vues / Cadre d'apprentissage De La Représentation Des Protéines / Nouveau Cadre De Détection Des Vulnérabilités cryptographiques...

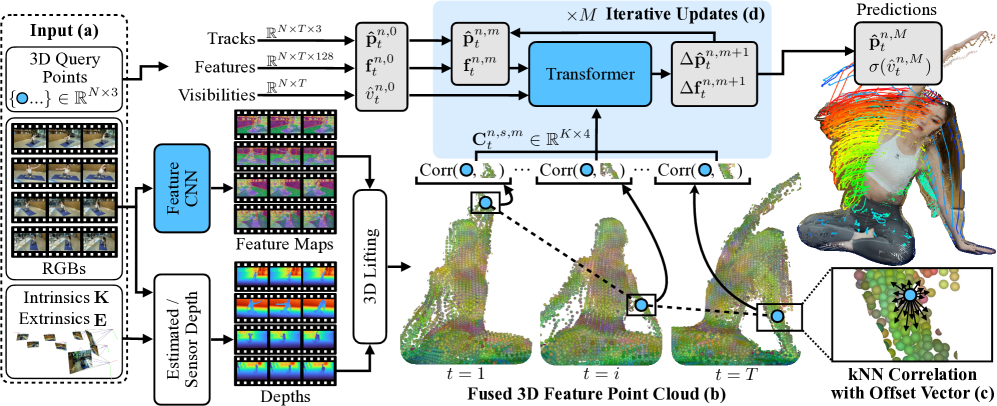

Ces dernières années, plusieurs méthodes ont tenté de réaliser un suivi de points 3D à partir de vidéos monoculaires. Cependant, en raison de la difficulté d'estimer précisément les informations 3D dans des scénarios complexes tels que l'occlusion et les mouvements complexes, les performances de ces méthodes ne répondent toujours pas aux exigences de haute précision et de robustesse des applications pratiques.

Sur cette base, l'ETH Zurich et l'Université Carnegie Mellon ont proposé conjointement la première méthode de suivi de points 3D multi-vues pilotée par les données, qui vise à suivre des points arbitraires dans des scènes dynamiques en utilisant plusieurs perspectives de caméra. Le modèle de prédiction de cette méthode prédit directement les points 3D correspondants en utilisant seulement un petit nombre de caméras, permettant un suivi en ligne robuste et précis.

Lien vers le document:https://go.hyper.ai/2BSGR

Derniers articles sur l'IA:https://go.hyper.ai/hzChC

Afin de permettre à davantage d'utilisateurs de connaître les derniers développements dans le domaine de l'intelligence artificielle dans le milieu universitaire, le site Web officiel d'HyperAI (hyper.ai) a désormais lancé une section « Derniers articles », qui met à jour quotidiennement les articles de recherche de pointe sur l'IA.Voici 5 articles populaires sur l'IA que nous recommandonsNous avons également résumé la carte mentale de la structure du document pour tous. Jetons un coup d'œil rapide aux avancées de pointe en IA de la semaine.

Recommandation de papier de cette semaine

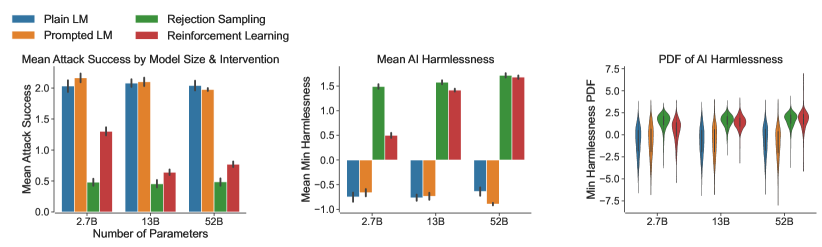

1. Modèles linguistiques de Red Teaming pour réduire les risques : méthodes, adaptation des comportements et enseignements tirés

Cet article décrit les premiers travaux explorant les tests en équipe rouge des modèles de langage, visant à identifier, mesurer et atténuer simultanément les résultats potentiellement dangereux des modèles. L'étude a révélé que la difficulté des tests en équipe rouge pour les modèles RLHF augmente significativement avec l'échelle, tandis que les autres types de modèles ne présentent aucune tendance significative à l'échelle. L'article publie également un ensemble de données de 38 961 échantillons d'attaques en équipe rouge et décrit la conception des instructions, le processus d'exécution, les méthodes statistiques et les facteurs d'incertitude associés utilisés dans les tests en équipe rouge.

Lien vers le document:https://go.hyper.ai/j2U2u

2. Suivi de points 3D multi-vues

Cet article propose la première méthode de suivi de points 3D multi-vues pilotée par les données, conçue pour suivre des points arbitraires dans des scènes dynamiques à l'aide de plusieurs vues de caméra. Cette méthode présente une bonne généralisation à un large éventail de scénarios vidéo, de 1 à 8 vues, sous différents angles d'observation et avec des longueurs d'image allant de 24 à 150.

Lien vers le document:https://go.hyper.ai/2BSGR

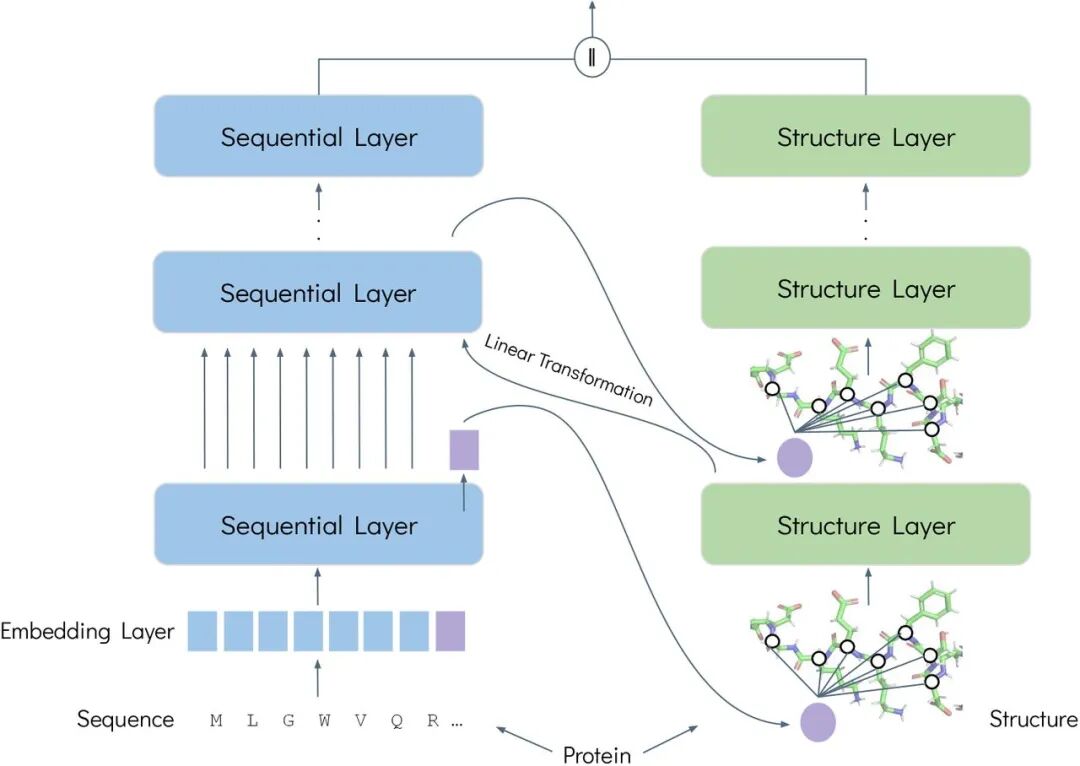

3. FusionProt : fusion des informations de séquence et de structure pour l'apprentissage unifié de la représentation des protéines

Cet article propose un nouveau cadre d'apprentissage de la représentation des protéines, FusionProt, qui vise à apprendre simultanément une représentation unifiée de la séquence unidimensionnelle et de la structure tridimensionnelle d'une protéine. FusionProt introduit une balise de fusion innovante et apprenable comme passerelle adaptative, permettant un échange d'informations itératif entre les modèles de langage protéique et les graphes de structure tridimensionnelle des protéines.

Lien vers l'article :https://go.hyper.ai/rjbaU

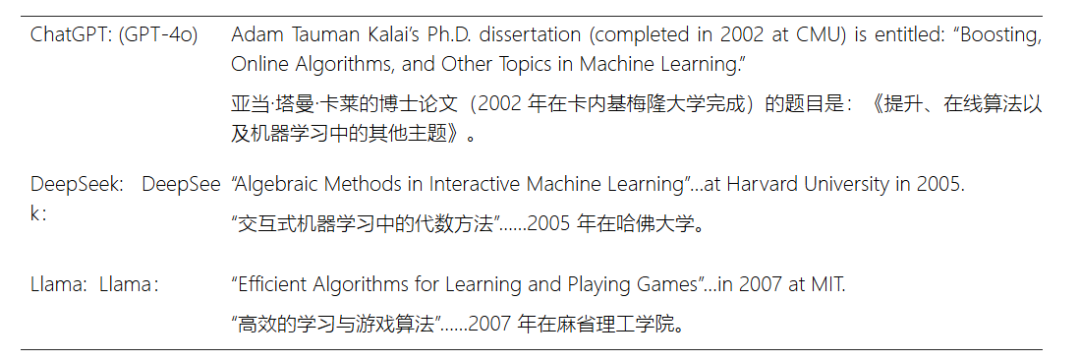

4. Pourquoi les modèles de langage hallucinent

Cet article suggère que la raison fondamentale pour laquelle les modèles linguistiques présentent des hallucinations est que leurs mécanismes d'entraînement et d'évaluation tendent à récompenser les devinettes plutôt qu'à reconnaître l'incertitude. Il analyse également les racines statistiques des hallucinations dans les processus d'entraînement modernes. Les hallucinations persistent car, dans la plupart des méthodes d'évaluation, les modèles linguistiques sont optimisés pour être d'excellents candidats, et deviner dans l'incertitude améliore en réalité les performances aux tests. Cette pénalité systématique pour les réponses incertaines suggère que les méthodes de notation actuelles, biaisées, des référentiels traditionnels devraient être révisées, plutôt que d'introduire des indicateurs supplémentaires pour évaluer les hallucinations.

Lien vers le document:https://go.hyper.ai/7TIjt

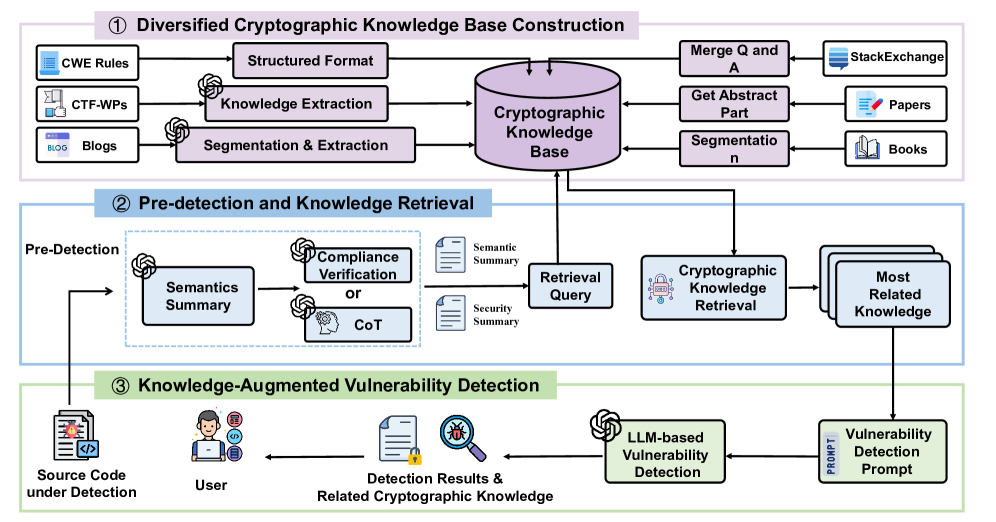

5. CryptoScope : utilisation de grands modèles de langage pour la détection automatisée des vulnérabilités de la logique cryptographique

Cet article propose un nouveau cadre de détection automatisée des vulnérabilités cryptographiques basé sur LLM, CryptoScope, qui combine la technique d'indication de la chaîne de pensée (CoT) avec la génération augmentée de récupération (RAG) et s'appuie sur une base de connaissances cryptographiques soigneusement organisée contenant plus de 12 000 entrées.

Lien vers le document:https://go.hyper.ai/qkboy

Voici l'intégralité du contenu de la recommandation d'article de cette semaine. Pour découvrir d'autres articles de recherche de pointe en IA, veuillez consulter la section « Derniers articles » du site officiel d'hyper.ai.

Nous invitons également les équipes de recherche à nous soumettre des résultats et des articles de haute qualité. Les personnes intéressées peuvent ajouter leur compte WeChat NeuroStar (identifiant WeChat : Hyperai01).

À la semaine prochaine !