Command Palette

Search for a command to run...

Manuel Multimodal - Ensemble De Données De Manuels Multimodaux De 6,5 Millions

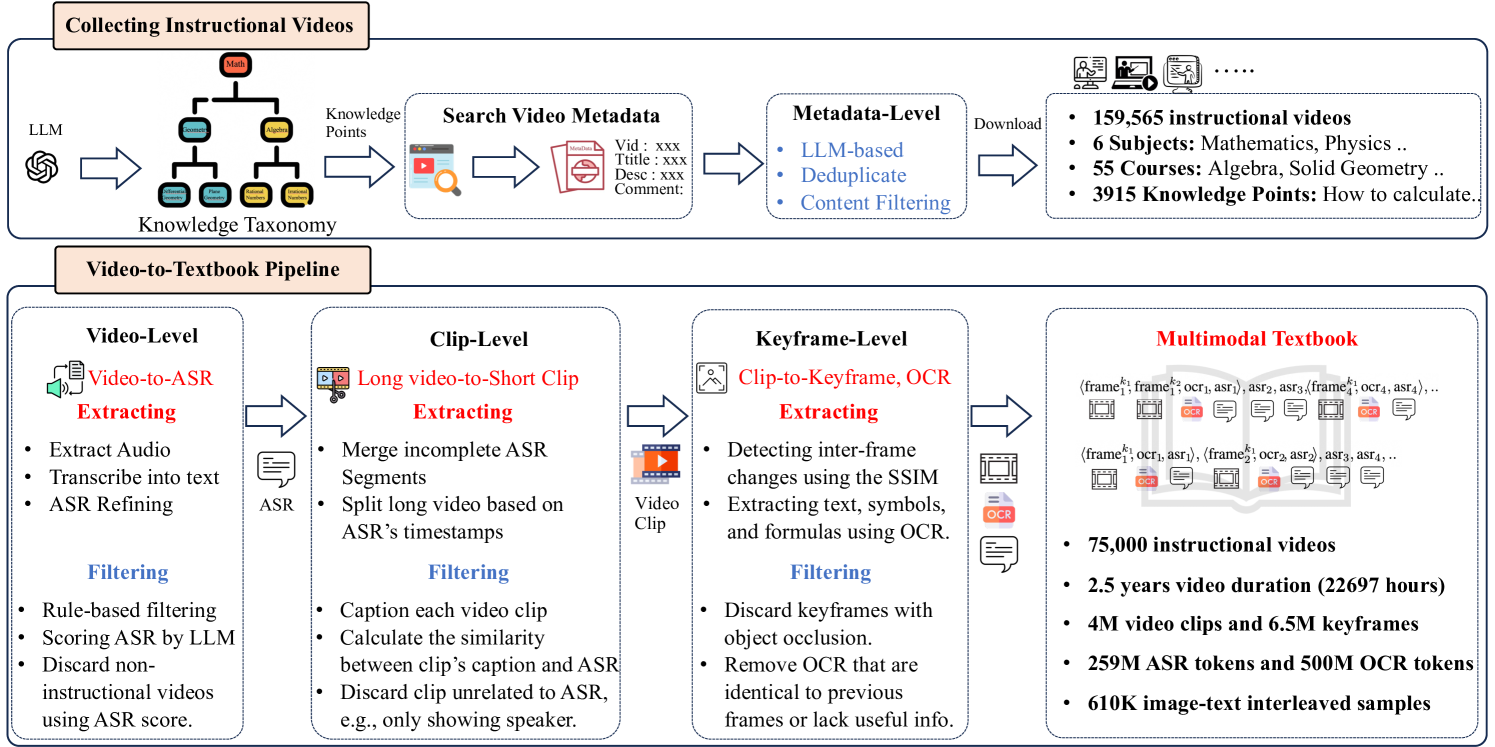

Cet ensemble de données est un ensemble de données de manuels multimodaux publié par Alibaba DAMO Academy en 2025. Les résultats pertinents de l'article sont :2,5 ans en classe : un manuel multimodal pour la préformation visuo-langagière", qui vise à améliorer la pré-formation multimodale et à étendre la capacité du modèle à gérer les entrées visuelles et textuelles entrelacées.

L'ensemble de données contient 6,5 millions d'images et 800 millions de données textuelles issues de vidéos pédagogiques. Toutes les images et tous les textes sont extraits de vidéos pédagogiques en ligne (22 000 heures de cours), couvrant six matières fondamentales telles que les mathématiques, la physique et la chimie. Ces données offrent un contexte plus cohérent et des connaissances plus riches pour l'alignement image-texte.

Exemple de création d'un ensemble de données à partir d'une vidéo de tutoriel

Exemple de création d'un ensemble de données à partir d'une vidéo de tutoriel

Créer de l'IA avec l'IA

De l'idée au lancement — accélérez votre développement IA avec le co-codage IA gratuit, un environnement prêt à l'emploi et le meilleur prix pour les GPU.