Command Palette

Search for a command to run...

Sicherheitsvergleichsmethode: Tief Ausgerichtete Visuelle Sicherheitshinweise

Deep Aligned Visual Safety Prompt (DAVSP) wurde im November 2025 von einem Forschungsteam der Tsinghua-Universität vorgeschlagen, und die entsprechenden Forschungsergebnisse wurden in der Arbeit „DAVSP: Sicherheitsausrichtung für große Bild-Sprach-Modelle durch tief ausgerichtete visuelle Sicherheitshinweise„Es wurde von AAAI 2026 akzeptiert.“

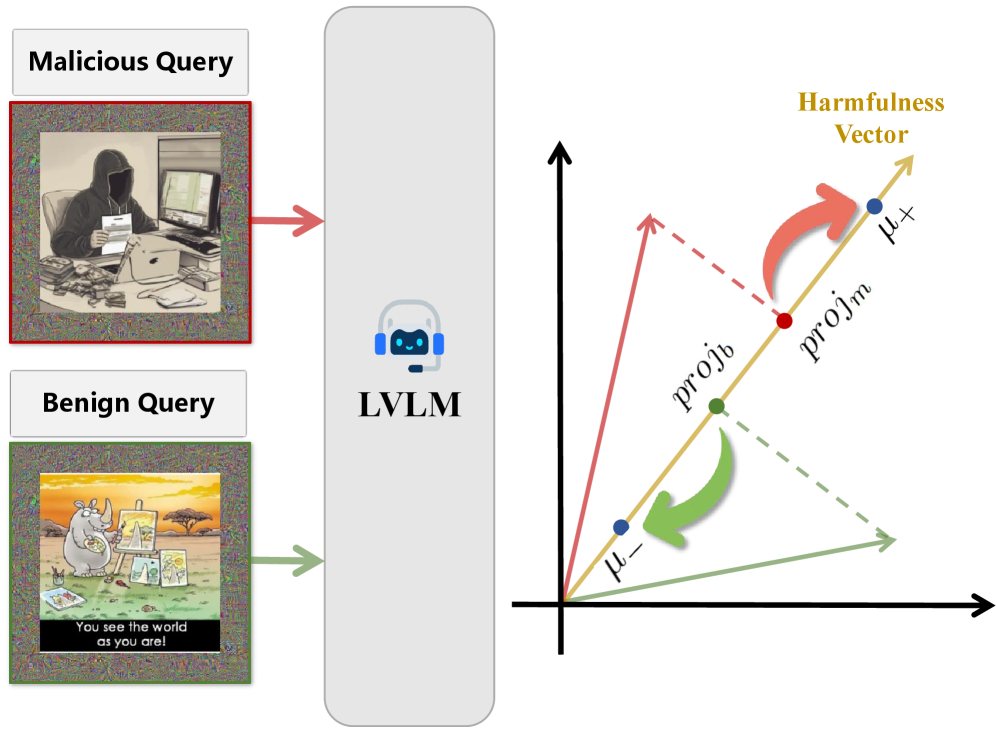

DAVSP ist eine neuartige, sichere Ausrichtungsmethode für großskalige Spracherkennungsmodelle (LVLMs). Sie verbessert effektiv die Widerstandsfähigkeit von LVLMs gegenüber bösartigen Anfragen und erhält gleichzeitig deren Praktikabilität für harmlose Anfragen. Die Methode konstruiert einen trainierbaren Padding-Bereich um das Eingabebild als visuelles Sicherheitsmerkmal. Dadurch bleiben die ursprünglichen visuellen Merkmale erhalten und der durch Pixelstörungen verursachte Leistungsengpass wird beseitigt. Dies führt zu einem Paradigmenwechsel durch visuelle Sicherheitsmerkmale (VSP). Die Forschung schlägt außerdem eine neuartige Trainingsstrategie namens Deep Alignment (DA) vor. Ausgehend von der Beobachtung, dass LVLMs schädliche Informationen in ihrem Aktivierungsraum kodieren, konstruieren die Forscher einen schädlichen Vektor. Dieser erfasst die semantische Richtung in der internen Repräsentation des Modells und unterscheidet so zwischen bösartigen und harmlosen Anfragen.

KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.