Command Palette

Search for a command to run...

安全比对方法 Deep Aligned Visual Safety Prompt

Deep Aligned Visual Safety Prompt(DAVSP)是由清华大学研究团队于 2025 年 11 月提出的,相关研究成果发表于论文「DAVSP: Safety Alignment for Large Vision-Language Models via Deep Aligned Visual Safety Prompt」,已被 AAAI 2026 录用。

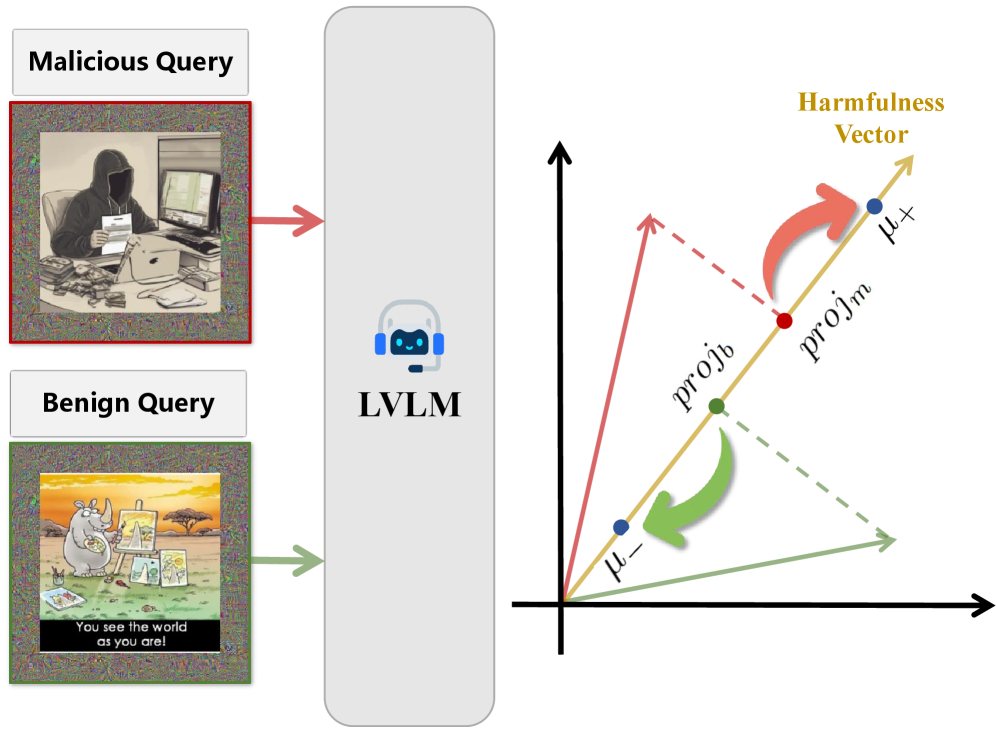

DAVSP 是一种针对大型语言视觉模型(LVLM)的新型安全比对方法,有效提升了 LVLM 抵抗恶意查询的能力,并保留了模型在无害查询上的实用性。该方法在输入图像周围构建了一个可训练的填充区域,作为视觉安全提示,这保留了原始的视觉特征,并消除了像素扰动带来的表现瓶颈,通过视觉安全提示(VSP)实现了范式转变。研究还提出一种名为深度对齐(Deep Alignment,DA)的新训练策略。基于观察到 LVLMs 在其激活空间中固有编码有害信息,研究人员构建了一个有害向量,捕捉模型内部表征中区分恶意查询与良性查询的语义方向。