Command Palette

Search for a command to run...

Wan2.2-Animate-14B:开放式高级大规模视频生成模型

一、教程简介

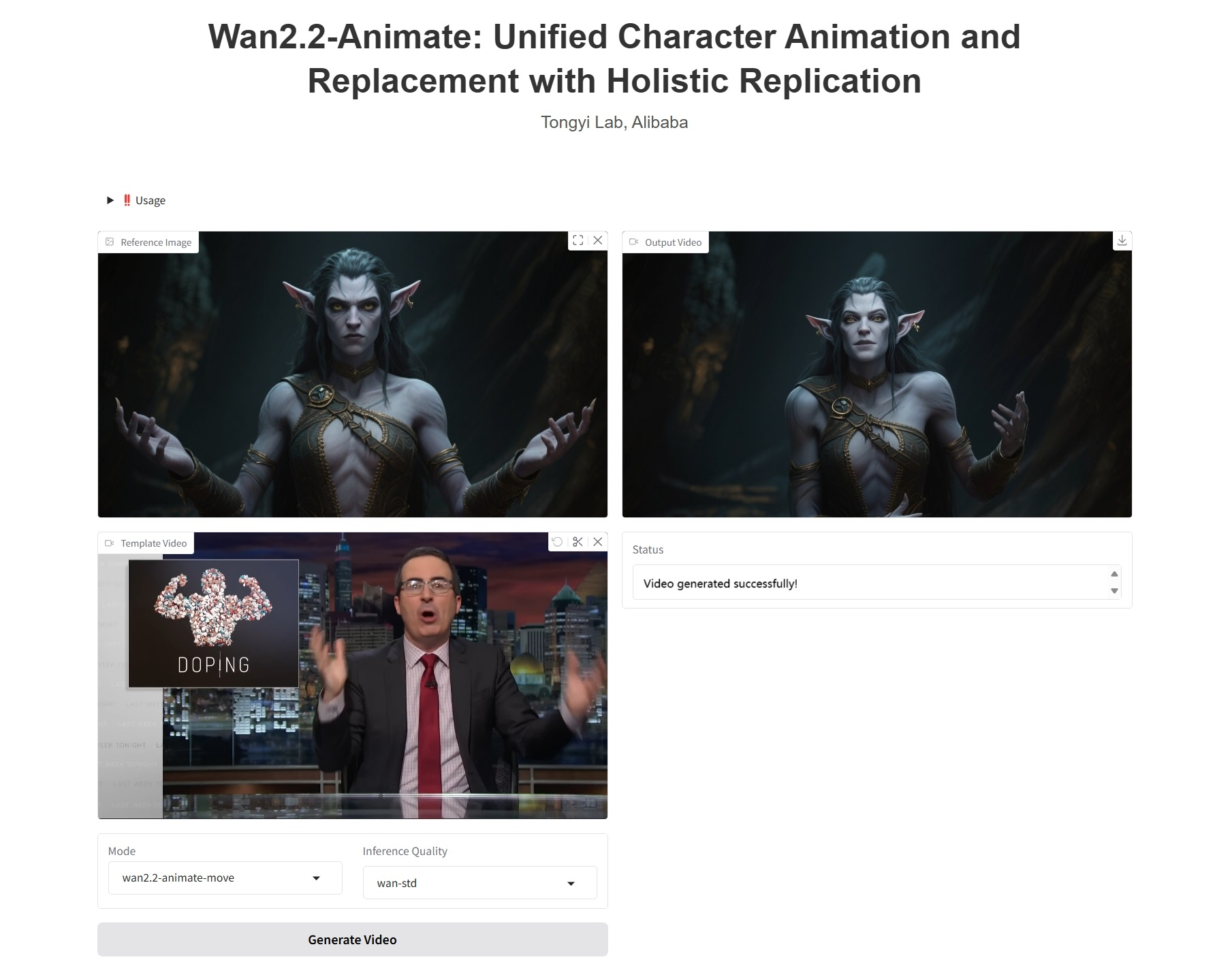

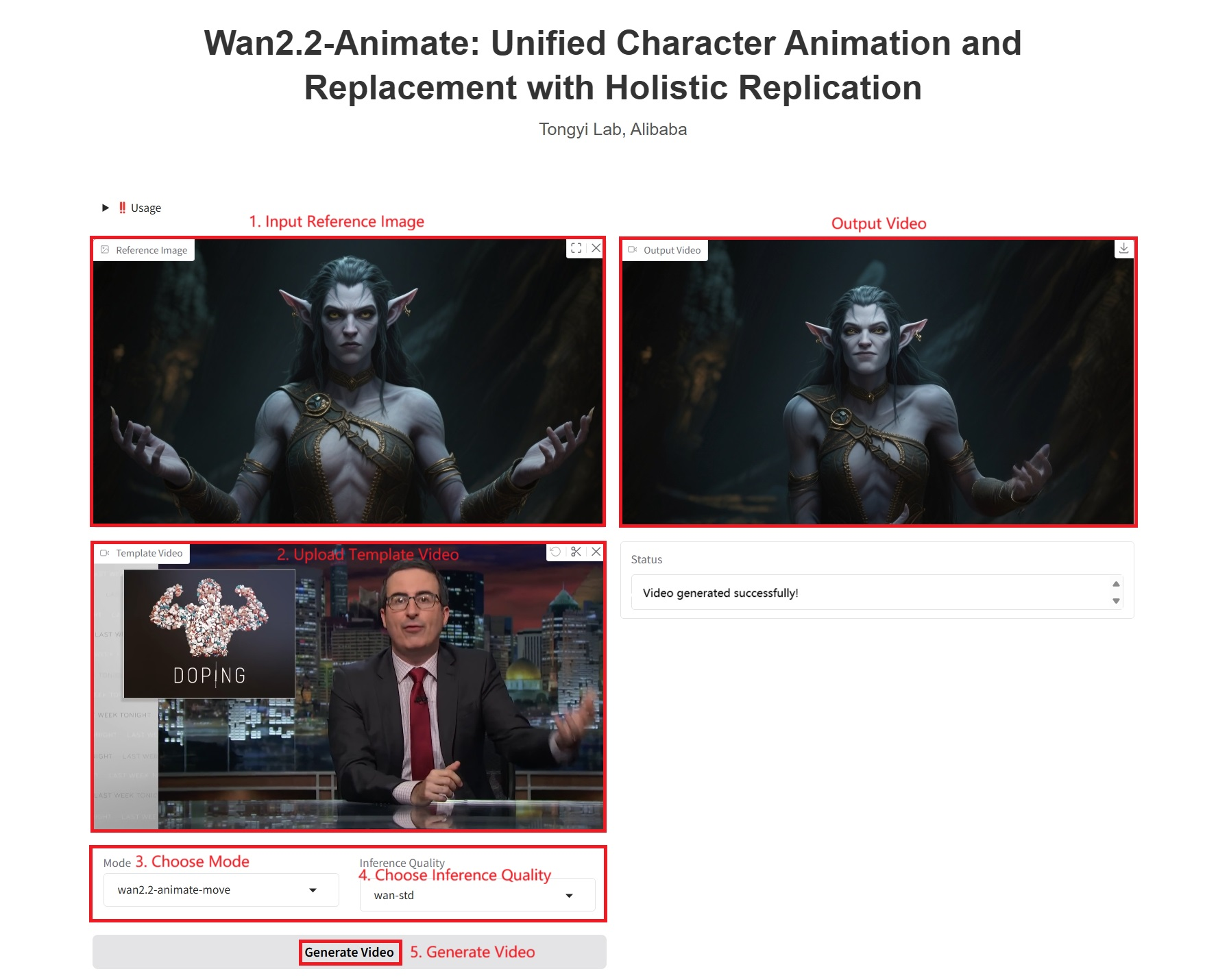

Wan2.2-Animate-14B 是由阿里巴巴通义万相团队于 2025 年 9 月开源的一款动作生成模型,模型同时支持动作模仿和角色扮演两种模式,能基于表演者的视频,精确复制面部表情和动作,生成高度逼真的角色动画视频。模型能将动画角色无缝替换进原视频,完美匹配场景的光照和色调。模型基于 Wan 模型构建,通过空间对齐的骨骼信号控制肢体动作,用从源图像中提取的隐式面部特征重现表情,实现高度可控和富有表现力的角色视频生成。相关论文成果为 Wan-Animate: Unified Character Animation and Replacement with Holistic Replication 。

该教程算力资源采用单卡 RTX PRO 6000 。

二、效果展示

三、运行步骤

1. 启动容器

2. 使用步骤

若显示「Bad Gateway」,这表示模型正在初始化,由于模型较大,请等待约 1-2 分钟后刷新页面。

注意:Inference Quality 选择 wan-pro 生成的视频质量越好同时消耗的时长也越长, 示例一大约耗时 1200 秒。

具体参数:

- Mode:

- wan2.2-animate-move:动作模仿,输入一张角色图片和一段参考视频,模型将参考视频中角色的动作和表情迁移到输入的图片角色中,使静态图片角色具有动态表现力。

- wan2.2-animate-mix:角色替换,在保留原始视频的动作、表情及环境的基础上,将视频中的角色替换为输入的图片中的角色,实现无缝融合。

- Inference Quality:

- wan-pro:高质量生成。

- wan-std:标准版,平衡性能与效率。

四、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓

引用信息

本项目引用信息如下:

@article{wan2025,

title={Wan: Open and Advanced Large-Scale Video Generative Models},

author={Team Wan and Ang Wang and Baole Ai and Bin Wen and Chaojie Mao and Chen-Wei Xie and Di Chen and Feiwu Yu and Haiming Zhao and Jianxiao Yang and Jianyuan Zeng and Jiayu Wang and Jingfeng Zhang and Jingren Zhou and Jinkai Wang and Jixuan Chen and Kai Zhu and Kang Zhao and Keyu Yan and Lianghua Huang and Mengyang Feng and Ningyi Zhang and Pandeng Li and Pingyu Wu and Ruihang Chu and Ruili Feng and Shiwei Zhang and Siyang Sun and Tao Fang and Tianxing Wang and Tianyi Gui and Tingyu Weng and Tong Shen and Wei Lin and Wei Wang and Wei Wang and Wenmeng Zhou and Wente Wang and Wenting Shen and Wenyuan Yu and Xianzhong Shi and Xiaoming Huang and Xin Xu and Yan Kou and Yangyu Lv and Yifei Li and Yijing Liu and Yiming Wang and Yingya Zhang and Yitong Huang and Yong Li and You Wu and Yu Liu and Yulin Pan and Yun Zheng and Yuntao Hong and Yupeng Shi and Yutong Feng and Zeyinzi Jiang and Zhen Han and Zhi-Fan Wu and Ziyu Liu},

journal = {arXiv preprint arXiv:2503.20314},

year={2025}

}