Command Palette

Search for a command to run...

GTC 2026 丨从 Vera Rubin 到 NemoClaw:英伟达的未来不止 GPU?

在一年一度的 NVIDIA GTC 上,公司 CEO 黄仁勋的主题演讲历来被视为全球 AI 产业的重要风向标。从新一代 GPU 架构到软件生态布局,这场 keynote 往往昭示着未来几年 AI 计算基础设施的热门技术与发展方向。

当地时间 3 月 16 日,GTC 2026 的主题演讲如约而至,63 岁的黄仁勋身着标志性皮衣出场,在加利福尼亚州圣何塞体育场内激情澎湃地带来了一系列重磅新品。

不止 GPU

作为 NVIDIA AI 芯片线路图中的「当家花旦」,Vera Rubin 平台也在本届 GTC 大会上吊足了观众的胃口——由 7 款突破性芯片、 5 组机架、 1 台超级计算机组成,黄仁勋称其标志着一代技术的飞跃。其中尤为值得关注的便是 Rubin GPU 、 NVIDIA Groq 3 LPX 以及 NVIDIA Vera CPU 。

首先是 Rubin GPU,这一专为 Agentic AI 打造的全新架构已经在今年 1 月正式亮相,其搭载了配备硬件加速自适应压缩功能的第三代 Transformer Engine,可为 AI 推理提供 50 petaflops 的 NVFP4 计算性能,支持 NVLink 72 全互联。

其次是 Groq 技术在 NVIDIA 的落地。自从 2025 年年末,黄仁勋斥资 200 亿美元获得 Groq 技术许可后,外界便有猜测此举是要「弃 GPU 换 LPU」,如今终于尘埃落定,二者形成了良好的协同互补。

大规模部署时,LPU 集群如同一个巨大的单一处理器,用于快速、确定性的推理加速。与 Vera Rubin NVL72 配合部署时,Rubin GPU 和 LPU 通过为每个输出 token 联合计算 AI 模型的每一层,共同提升解码性能。基于此,NVIDIA 推出了采用 256 个 LPU 处理器的 LPX 机架,专为满足智能体系统对低延迟和大上下文的需求而设计,与 Vera Rubin 相结合,可为万亿参数模型提供高达每兆瓦 35 倍的推理吞吐量。

最后是全球首款为 Agentic AI 与强化学习时代打造的处理器 NVIDIA Vera CPU,其运行效率是传统机架级 CPU 的 2 倍,运行速度快 50%,可为大规模 AI 服务(如编程助手、消费级和企业级智能体)提供更高的 AI 吞吐量、响应速度和效率。黄仁勋表示,「CPU 不再仅仅是支持模型,而是在驱动模型。凭借突破性的性能和能效,Vera 解锁了思考更快、扩展能力更强的 AI 系统。」

基于此,NVIDIA 还发布了一款全新的 Vera CPU 机架,集成了 256 个液冷 Vera CPU,可支持超过 22,500 个并发 CPU 环境,每个环境都能独立全速运行。

可以说,Vera Rubin 的亮相标志着 NVIDIA 在 Agentic AI 时代的再一次竞争力升格,从 Vera CPU 的算力基座,到 Rubin GPU 的推理巅峰,再到 BlueField-4 DPU 的存储革命,NVIDIA 正通过极致协同设计,将 AI 工厂的每一个环节都推向新高度。

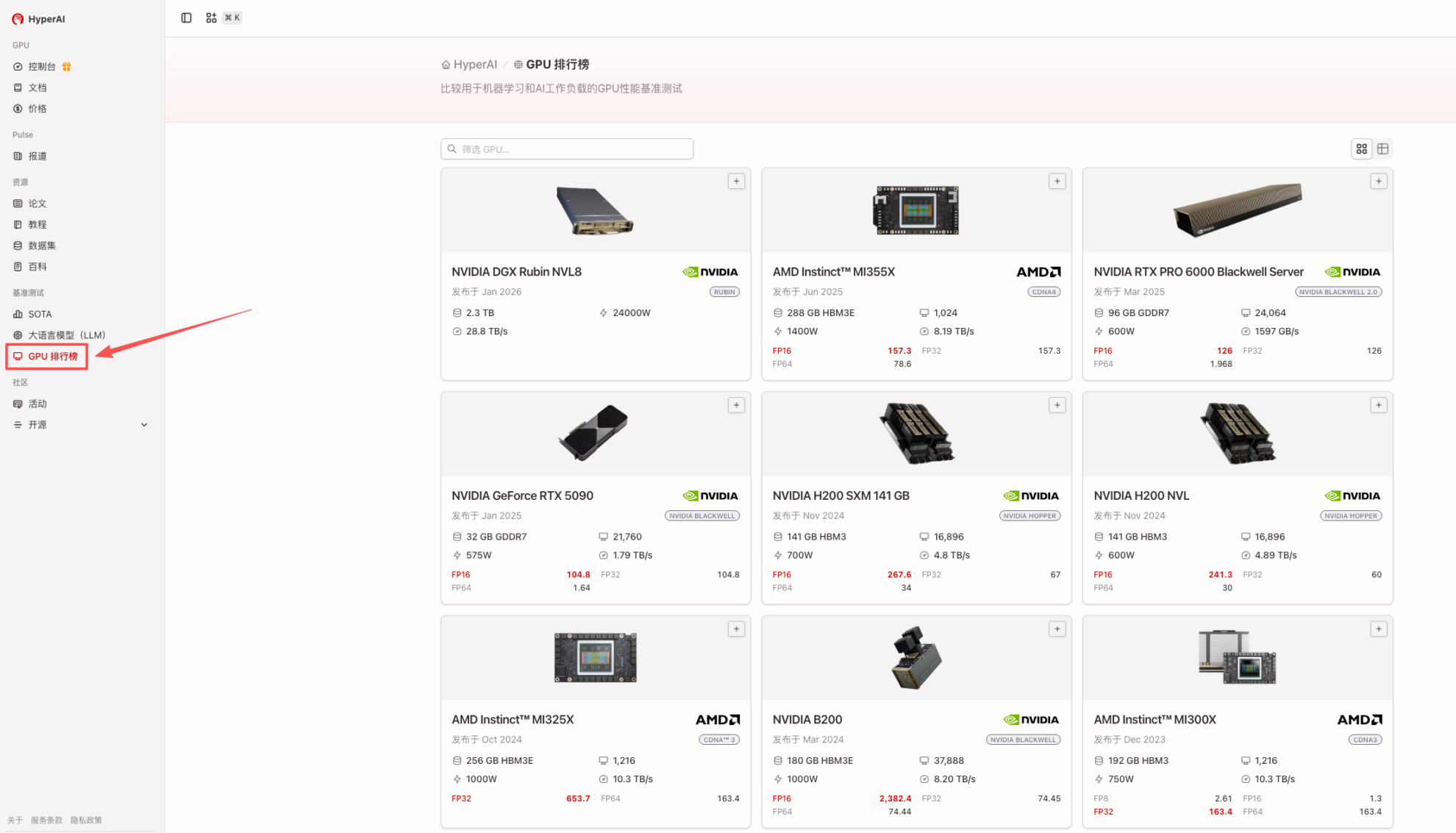

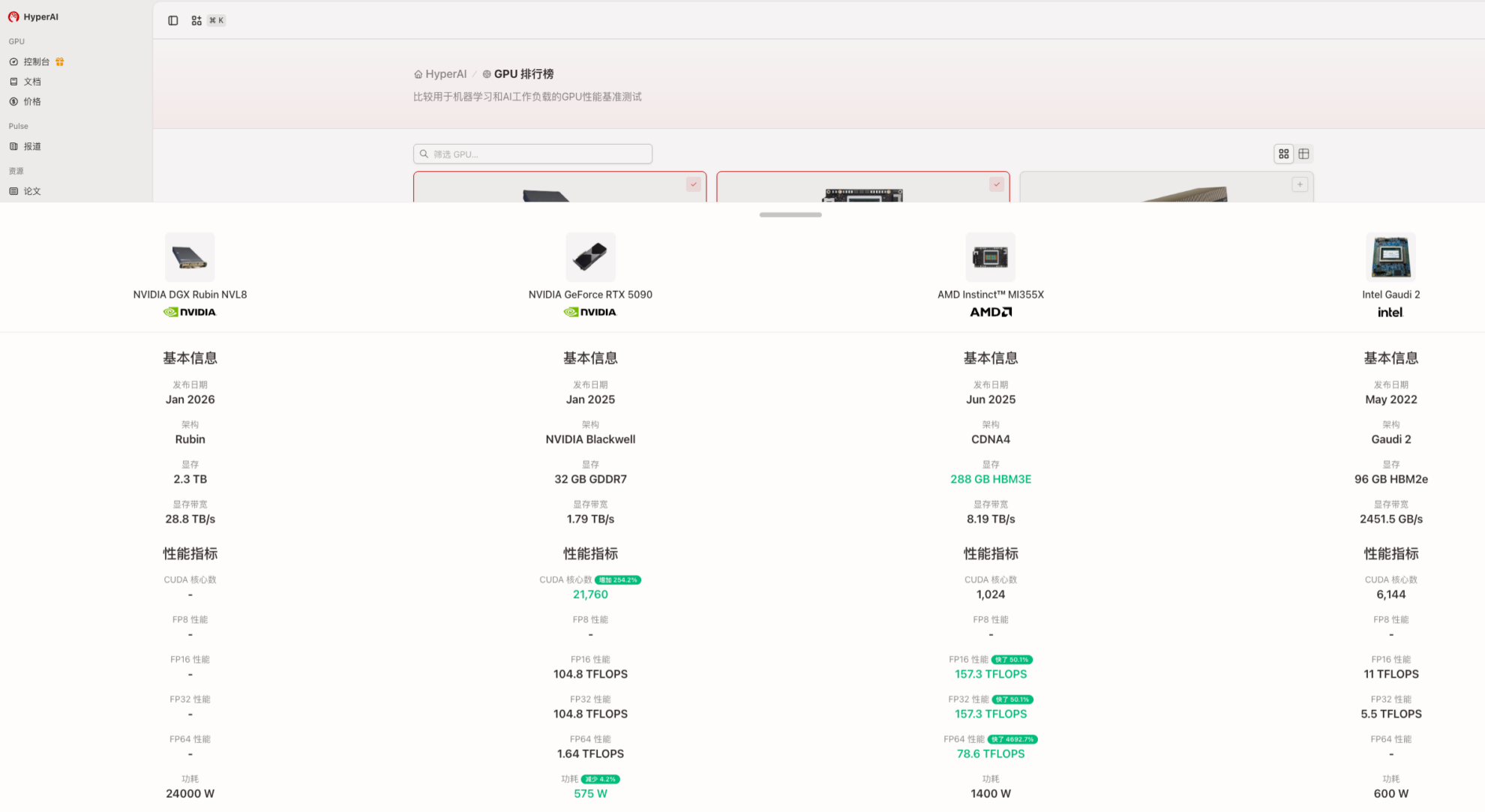

而对于开发者与企业而言,面对如此庞大且性能持续攀升的芯片矩阵,在享受技术红利的同时,也面临着一个更现实的难题:在 GPU 型号愈发繁杂、算力指标层出不穷的今天,如何才能跳出厂商参数,客观对比不同硬件的真实性能?换言之,如何在海量选择中精准锁定最适合自身业务的那一款?

针对于此,HyperAI 推出了「GPU 排行榜」,构建 AI / 大模型 / HPC 场景的 GPU 选型与决策参考平台,支持跨厂商、跨架构对比,通过统一的对比规则,帮助用户在复杂的 GPU / AI 加速器市场中做出正确、理性的技术决策。 HyperAI 将及时追踪最新产品更新,以期为开发者提供以 AI 实际工作负载为中心的实用工具。

最新发布的 Rubin GPU 性能对比已上线,立即查看 GPU 排行榜:

https://hyper.ai/gpu-leaderboard

NemoClaw:单条命令即可对 OpenClaw 进行优化

在发布新一代芯片路线图之后,NVIDIA 也在软件层面同步给出了其对「AI 下一阶段形态」的答案:NemoClaw 。

「OpenClaw 将 AI 的下一个前沿带给了所有人,并成为历史上增长最快的开源项目」,黄仁勋对这一开源项目给予了高度评价,「Mac 和 Windows 是个人计算机的操作系统,而 OpenClaw 则是个人 AI 的操作系统。这正是整个行业期待已久的时刻——软件新文艺复兴的开端。」

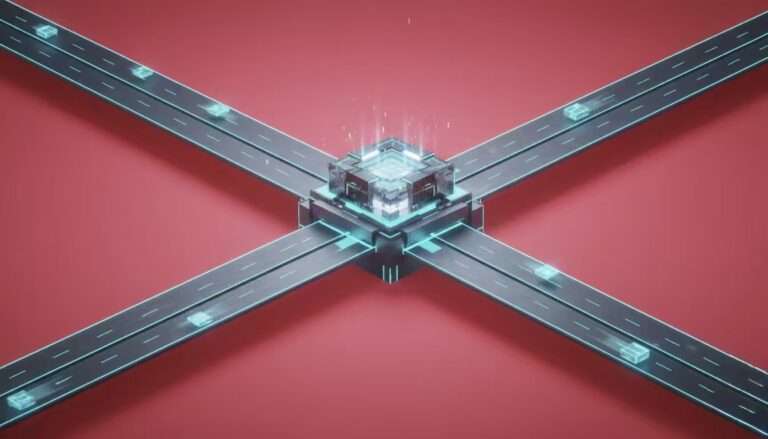

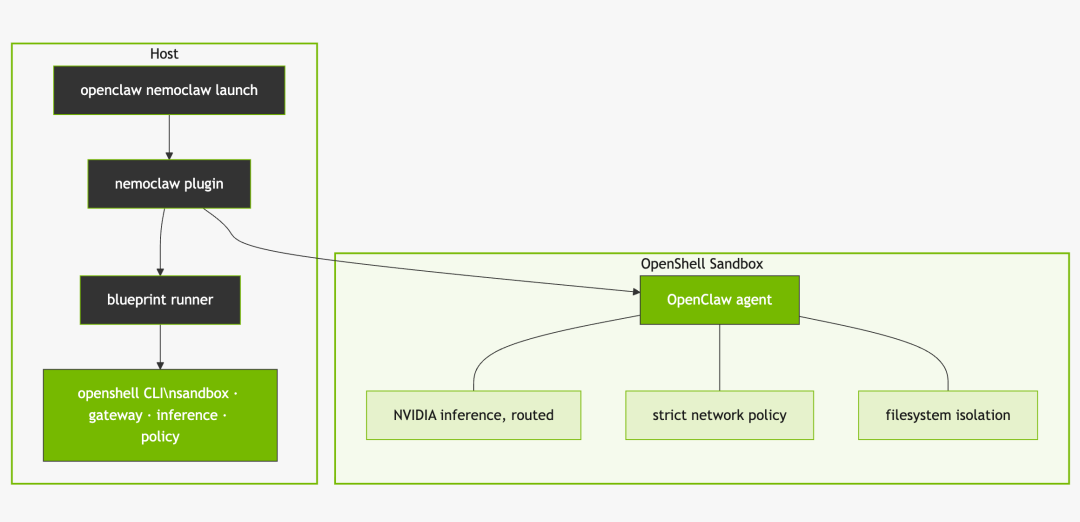

NemoClaw 利用 NVIDIA Agent Toolkit 软件,通过单条命令即可对 OpenClaw 进行优化,将其直接纳入到英伟达生态之中。 NemoClaw 安装 OpenShell,提供开源模型以及一个隔离的沙盒环境,为自主 agent 增强数据隐私与安全性。这一方案为 claws 提供了此前缺失的底层基础设施层,使其在获得执行任务所需访问能力的同时,也能通过基于策略的安全、网络与隐私护栏进行约束。如下图所示:

NemoClaw 支持使用任意编程型 agent 。在开放 agent 架构下,它可以调用在用户专属本地系统运行的开源模型(包括 NVIDIA Nemotron)。同时,通过隐私路由器(privacy router),agent 也可以访问运行在云端的前沿模型。本地模型 + 云端模型的组合,为 agent 在既定隐私与安全约束下学习新技能、完成复杂任务提供了基础。

在这一框架下,黄仁勋所强调的「个人 AI 操作系统」开始具备更清晰的落地路径:agent 不再只是调用模型的接口,而是能够长期运行、持续学习的数字执行体。如果说最新发布的 GPU 与系统架构为这一愿景提供了算力底座,那么 NemoClaw 则是在软件层面定义了 agent 的运行方式与安全边界——两者共同构成了 NVIDIA 对「AI 工厂」与「AI 劳动力」的完整叙事。

从某种程度上来看,NemoClaw 进一步降低了 OpenClaw 的开发门槛。但对于开发者而言,快速验证使用场景同样重要,基于此,HyperAI 为全球开发者提供了开箱即用的运行环境与在线 Notebook,无需复杂配置,即可直接上手构建属于自己的 AI agent 。

在线运行链接:

OpenClaw:使用 Free-CPU 调用 API 运行

https://hyper.ai/notebooks/49888

OpenClaw 的 GPU 运行教程

https://hyper.ai/notebooks/49890

毫无疑问,一年一度的 GTC 大会早已成为「AI 春晚」,不仅是 NVIDIA 秀肌肉的舞台,更是技术风向标。众多媒体围绕本次科技盛宴的报道纷至沓来,各类产品、模型更新涌入大众视野,接下来一段时间,HyperAI 还将持续为大家深度分享本次发布的优质开源模型、数据集,并提供在线体验,敬请期待。