Command Palette

Search for a command to run...

00 后清华学霸用 AI 打败大气层「魔法攻击」,还原宇宙真面貌

大气层的存在,对于地球生命至关重要,但对于天文观测而言,大气层会导致蒙气差、视宁度、大气消光等现象的出现,即使是用世界上最好的地面天文望远镜,获得的天文图像也很模糊。这种模糊有时会造成错误的物理测量,影响天文学家的科研进展。

为了应对这一挑战,近日,来自清华大学的李天骜和来自美国西北大学的艾玛·亚历山大 (Emma Alexander) 等科研人员,利用模拟数据训练了一种计算机视觉算法,对天文图像进行锐化「还原」,同时,这一算法还与薇拉·C·鲁宾天文台的成像参数进行了匹配,明年天文台开放时,该工具可以直接与之兼容。

目前,这项名为 Galaxy image deconvolution for weak gravitational lensing with unrolled plug-and-play ADMM 的研究成果,已发表在《皇家天文学会月刊》上。

本研究成果发表在《皇家天文学会月刊》

论文地址:

https://academic.oup.com/mnrasl/article/522/1/L31/7075894

试验详解:用 AI 算法为天文图像「祛魅」

本论文中,研究小组针对实际模拟数据对经典和现代的去除模糊的方法进行了基准测试,包括椭圆度误差 (ellipticity errors) 、计算时间和对 PSF 误差的灵敏度等方面,结果表明,unrolled- ADMM 与传统消除模糊的经典方法相比,误差减少了 38.6%;与现代方法相比,误差减少了 7.4% 。

现代方法 GitHub 地址:

https://github. com/lukeli0425/galaxy-deconv

图像处理

要想对经典方法创建 Benchmark 并训练神经网络,清洁的 ground truth image 必须与真实的 PSF 和噪声模糊图像进行配对。为此,研究人员借助 Galsim (modular galaxy image simulation toolkit) 及 COSMOS (COSMOS real galaxy dataset) 模拟基于地面的观测,创建了试验数据集。

Galsim:

https://github.com/GalSim-developers/GalSim

COSMOS real galaxy dataset:

https://doi.org/10.5281/zenodo.3242143

原始图像被随机剪切和旋转以模拟弱引力透镜效应 (weak lensing effects),然后使用随机的大气和光学 PSF 对这些图像进行卷积,并在添加高斯噪声前按比例缩放亮度。最后,将所有图像下采样到 LSST 的像素尺度。

目前该数据集已上线 HyperAI 超神经官网:

https://hyper.ai/datasets/23544

神经网络训练

研究人员使用 Adam 优化器在 NVIDIA GeForce RTX 2080 Ti GPU 上对 40,000 个样本进行训练,其中用多尺度 L1 损失函数对 ground truth 图像及重建图像训练了 50 个 epoch 。每个迭代数 (N=2,4,8) 都训练了一个单独的网络,ResUNet 作为降噪插件 (17,007,744 个参数),在神经网络中引入 skip connection,从而避免因迭代次数增加、神经网络加深而引起的梯度消失或爆炸。同时,训练 CNN (80,236 参数) 来学习步长超参数。

神经网络训练过程中,研究人员使用的是 PyTorch,同步提供了数据集生成和基准测试工具。

GitHub 地址:

https://github.com/Lukeli0425/Galaxy-Deconv

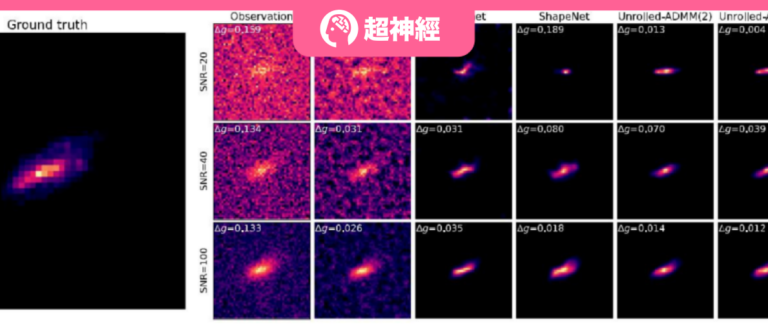

不同 SNR 水平下的性能表现

研究人员在不同的 SNR 水平下对提出的方法进行了测试,并将其性能与其他算法进行了比较(如下图所示)。可以发现,低信噪比时,Richardson-Lucy 算法会产生噪声更大的重建结果,其中,galaxy 会逐渐淹没在背景的噪声模式 (noisy pattern) 中。

现代方法虽然可以抑制背景噪声,但会扭曲 galaxy 形状,特别是在低信噪比时格外明显。研究人员使用 FPFS 套件进行椭圆度评估 (ellipticity estimation),结合已知的 PSF 进行逆向滤波 (inverse filtering),或使用单点 PSF 作为无需逆向滤波的 stable estimator,这被应用于本篇论文中所有涉及的反卷积方法的 output 。

随着 SNR 的降低,除本论文提出的 unrolled-ADMM 外,所有方法逐渐失效。

如上图所示,随着 SNR 的降低,论文中提出来的 8 次迭代 unrolled-ADMM 神经网络,在不同 SNR 中性能最佳。

时间-性能权衡

如下图所示,3 张图对应的 galaxy image 信噪比分别为 20 、 40 及 100 。误差棒显示了 5 倍的标准误差,括号中的数字表示迭代次数。

论文中提出的 8 次迭代 unrolled-ADMM 方法,在不同 SNR 水平下显示出比其他方法更优的性能和更低的方差 (variance),但代价是更长的计算时间。

PSF 中系统误差的稳健性

在实际观测中,星系中心的 PSF 是通过恒星测量的 PSF 插值计算得到的,然而视场中 PSF 的空间方差往往很难建模,因此,插值不能精确地重建星系间的有效 PSF,这要求反卷积算法对 PSF 中的系统误差具有稳健性。

如下图所示,左侧图对应假设 PSF 中的剪切误差 (shear error),右侧图对应 PSF 中的尺寸误差 (FWHM) 。横轴下方的 cartoon bar 可以直观地显示 PSF 的系统误差。

研究人员提出的 unrolled-ADMM 和经典方法,对 model mismatch 的敏感度更高。当 PSF 误差很大时,unrolled-ADMM 与现代方法表现相当甚至要更好。

消融研究

通过改变网络结构并重新训练,研究人员分离出个别设计选择对 unrolled-ADMM 的影响。如下图所示,将损失函数从提议的多尺度损失改为 Shape Loss(如青色虚线)或 MSE(如青色实线),会略微降低性能;删除超参数 SubNet(紫色虚线)或后续迭代层,会降低高 SNR 下的性能;训练降噪器但不训练反卷积 (ADMMNet-style training),会显著降低性能。

通过试验,本次研究获得了以上成果,但研究人员提出未来在以下方面仍能进行相关改进:

* 考虑和解决 PSF 中更高阶的误差,以获得更好的性能;

* 模拟数据可通过更准确的 LSST PSF 光学模型和更真实的生成模型进行改进;

* PSF 插值可以包含在 Pipeline 中,并与低秩反卷积 (low-rank deconvolution) 相结合。

目前,该研究重新生成模拟数据的代码以及数据集链接已经开源。

清华学霸将兴趣与科研完美结合

值得关注的是,本论文的一作李天骜,本科就读于清华大学电子工程系。据其个人网站信息显示,他曾担任清华大学视觉智能与计算成像实验室担任研究助理,目前在美国西北大学生物启发式视觉实验室担任研究实习生,师从艾玛·亚历山大(该论文二作)。

据介绍,他主要关注计算成像、计算机视觉、信号处理、优化和机器学习的交叉领域,尤其关注成像中的反问题求解、物理学引导的机器学习以及天文成像方面的研究。

如今,Science AI 在各行各业兴起,在天文学领域也不例外。算力的提升、大数据时代的来临给本来需要巨大算力的天文学领域带来了更多的可能性。

日本科学家们正在使用智能 AI 驱动望远镜对太空中的物体进行分类,从而帮助物理学家编写和检验假设。印度天文学家创造了一种新的 AI 算法,从已知的 5,000 颗行星中,找出了大约 60 颗可能适合人类居住的行星。一批天文学家首次在一项星系合并研究中使用 AI,确认星系合并导致了恒星爆发。腾讯与国家天文台启动「探星计划」,用来提高探星效率……

越来越多的天文学家正将 AI 作为一种强大的探索工具,正如中国科学院国家天文台研究员、 FAST 首席科学家李菂所说,如果问天文学使不使用机器学习、深度学习等技术,就好像问「20 年前天文学用不用电脑」一样。