Command Palette

Search for a command to run...

Ensemble De Données De Référence Multimodales d'auto-apprentissage Multimodal

Date

Taille

URL de publication

URL du document

Licence

CC BY-SA 4.0

Balises

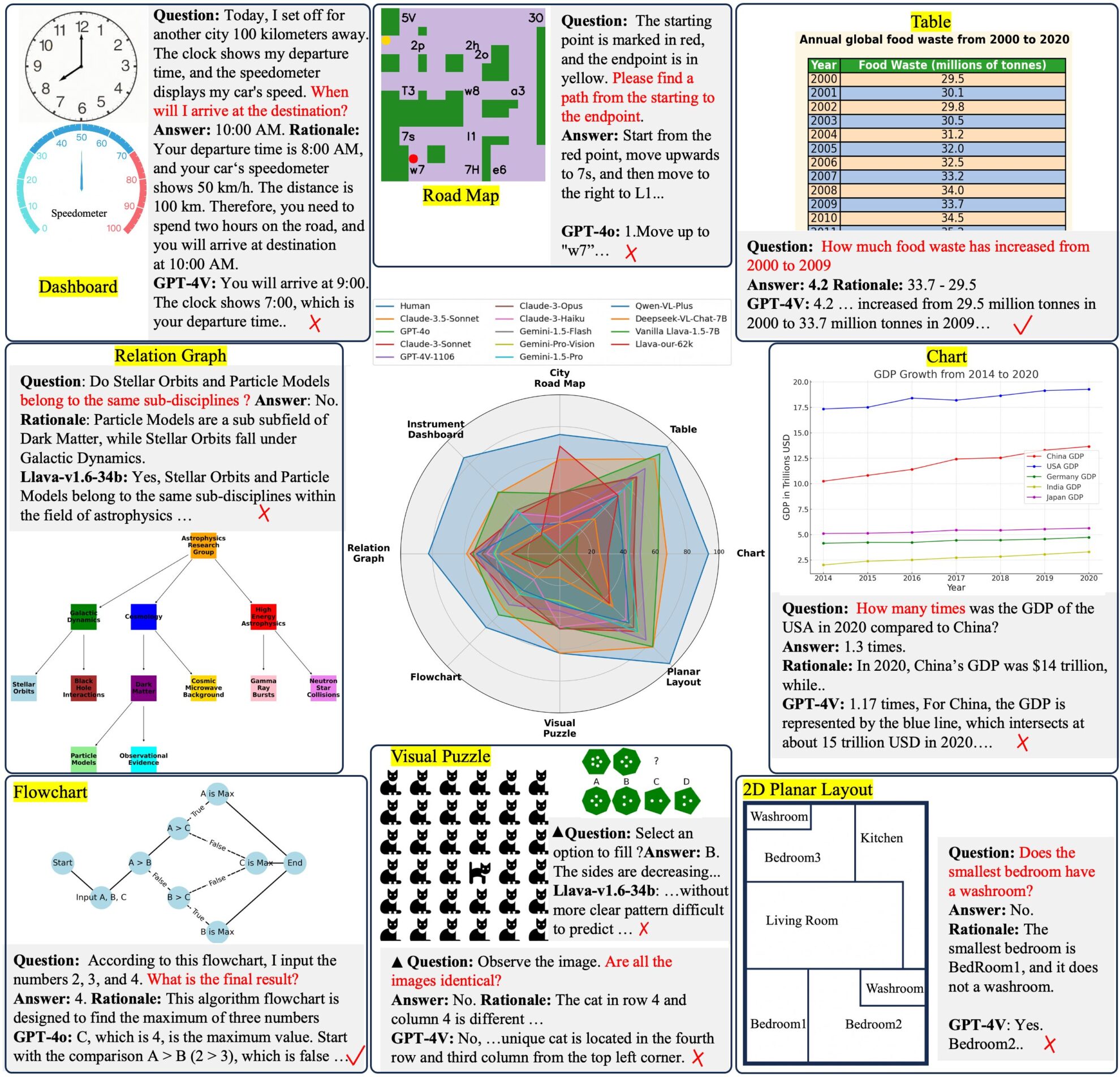

Cet ensemble de données a été lancé conjointement par l'Université du Zhejiang, l'Institut des logiciels de l'Académie chinoise des sciences, l'Université ShanghaiTech et d'autres institutions en 2024. Les résultats pertinents de l'article sont "Auto-apprentissage multimodal : enseignement par images synthétiques abstraites et raisonnement visuel à l'aide d'un modèle de langage". L'ensemble de données contient un total de 11 193 images abstraites avec des questions pertinentes, couvrant 8 catégories principales, notamment des tableaux de bord, des feuilles de route, des graphiques, des tableaux, des organigrammes, des diagrammes de relations, des énigmes visuelles et des plans d'étage 2D, en plus de 62 476 données supplémentaires pour affiner le modèle.

Créer de l'IA avec l'IA

De l'idée au lancement — accélérez votre développement IA avec le co-codage IA gratuit, un environnement prêt à l'emploi et le meilleur prix pour les GPU.