Command Palette

Search for a command to run...

ACE-Step: Basismodell Zur Musikgenerierung

1. Einführung in das Tutorial

ACE-Step-v1-3.5B wurde gemeinsam vom KI-Unternehmen StepFun und der digitalen Musikplattform ACE Studio entwickelt und am 7. Mai 2025 als Open Source veröffentlicht. Das Modell kann auf einer A100-GPU in nur 20 Sekunden bis zu 4 Minuten Musik synthetisieren, 15-mal schneller als eine LLM-basierte Baseline, und erreicht dabei eine überlegene musikalische Kohärenz und lyrische Ausrichtung in Bezug auf melodische, harmonische und rhythmische Metriken. Darüber hinaus bewahrt das Modell feine akustische Details und ermöglicht erweiterte Steuerungsmechanismen wie Stimmenklonen, Songtextbearbeitung, Remixen und Trackgenerierung.

2. Kernfunktionen

Verschiedene Stile und Genres

- Unterstützt alle gängigen Musikstile und kann in verschiedenen Formen eingegeben werden, z. B. als kurze Tags/Beschreibungstext/Verwendungsszenarien

- Kann Instrumentenkombinationen und Stilmerkmale automatisch an verschiedene Typen anpassen (z. B. Jazz-Standard-Saxophon und Swing-Rhythmus)

Mehrsprachige Unterstützung

- Unterstützt die Eingabe in 19 Sprachen, zu den Top 10 Sprachen gehören: 🇺🇸 Englisch, 🇨🇳 Chinesisch, 🇷🇺 Russisch, 🇪🇸 Spanisch, 🇯🇵 Japanisch, 🇩🇪 Deutsch, 🇫🇷 Französisch, 🇵🇹 Portugiesisch, 🇮🇹 Italienisch, 🇰🇷 Koreanisch

Instrumentaler Ausdruck

- Unterstützt die genreübergreifende Instrumentalgenerierung und kann die Klangfarbeneigenschaften von Musikinstrumenten (wie Klavierpedalresonanz und Gitarrenrutschgeräusche) präzise wiederherstellen.

- Erstellen Sie mehrspurige Musik mit komplexen Arrangements und bewahren Sie dabei die Harmonie und rhythmische Einheit zwischen den Teilen.

- Automatische Anpassung an die Spieltechniken der Instrumente (z. B. Streichervibrato, Blechbläserzunge)

Stimmliche Ausdruckskraft

- Unterstützt mehrere Gesangsstile (Populärgesang, Belcanto, Operngesang usw.)

- Fähigkeit, die Intensität des emotionalen Ausdrucks zu kontrollieren (z. B. unterdrückter tiefer Gesang vs. explosive hohe Töne)

3. Bedienungsschritte

1. Starten Sie den Container

Wenn „Bad Gateway“ angezeigt wird, bedeutet dies, dass das Modell initialisiert wird. Da das Modell groß ist, warten Sie bitte etwa 1–2 Minuten und aktualisieren Sie die Seite.

2. Anwendungsbeispiele

Nutzungsrichtlinien

Bei Verwendung des Safari-Browsers wird der Ton möglicherweise nicht direkt abgespielt und muss vor der Wiedergabe heruntergeladen werden.

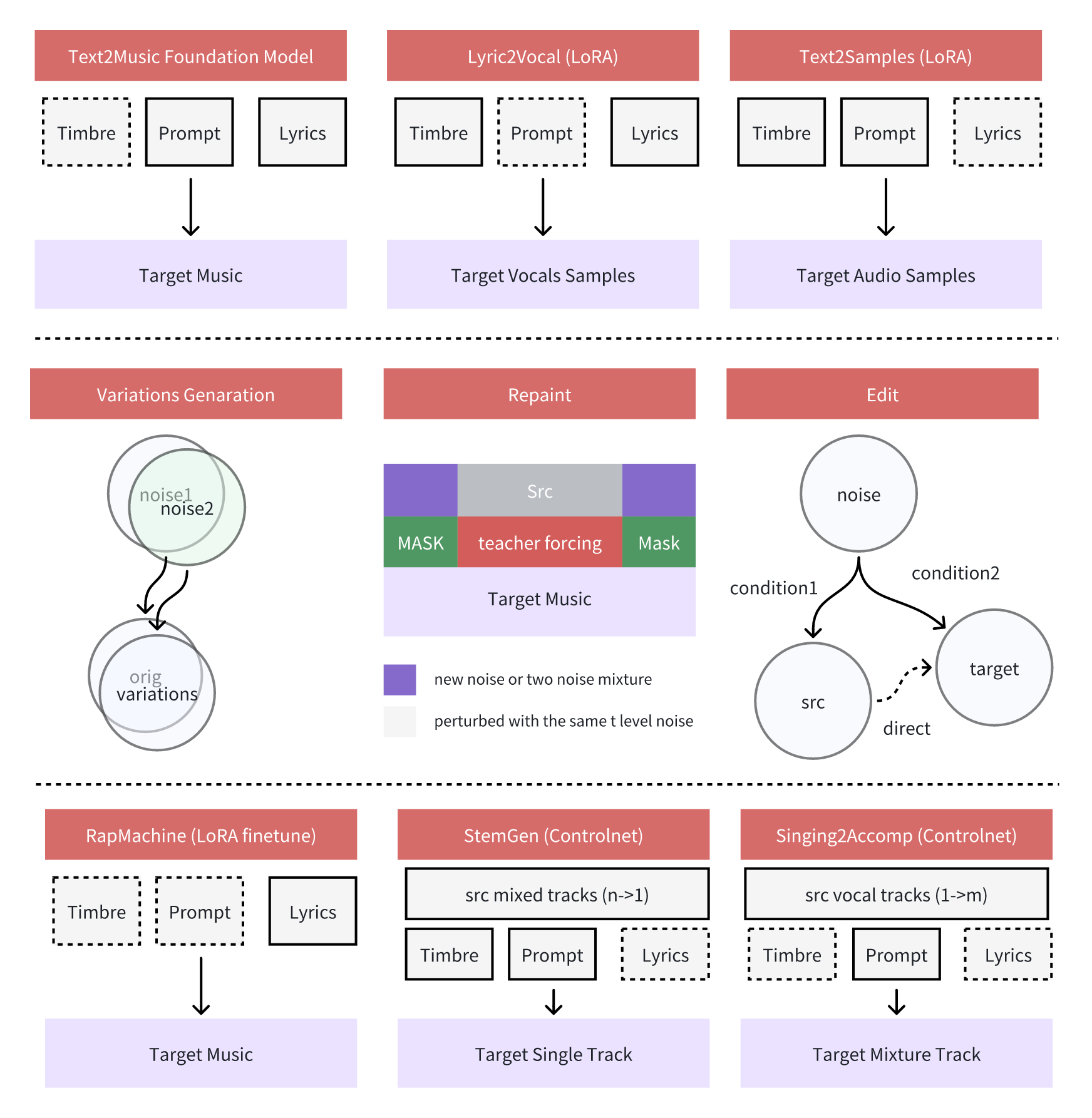

Das Projekt bietet Multitasking-Erstellungsfelder: Registerkarte „Text2Music“, Registerkarte „Retake“, Registerkarte „Repainting“, Registerkarte „Edit“ und Registerkarte „Extend“.

Die Funktionen der einzelnen Module sind wie folgt:

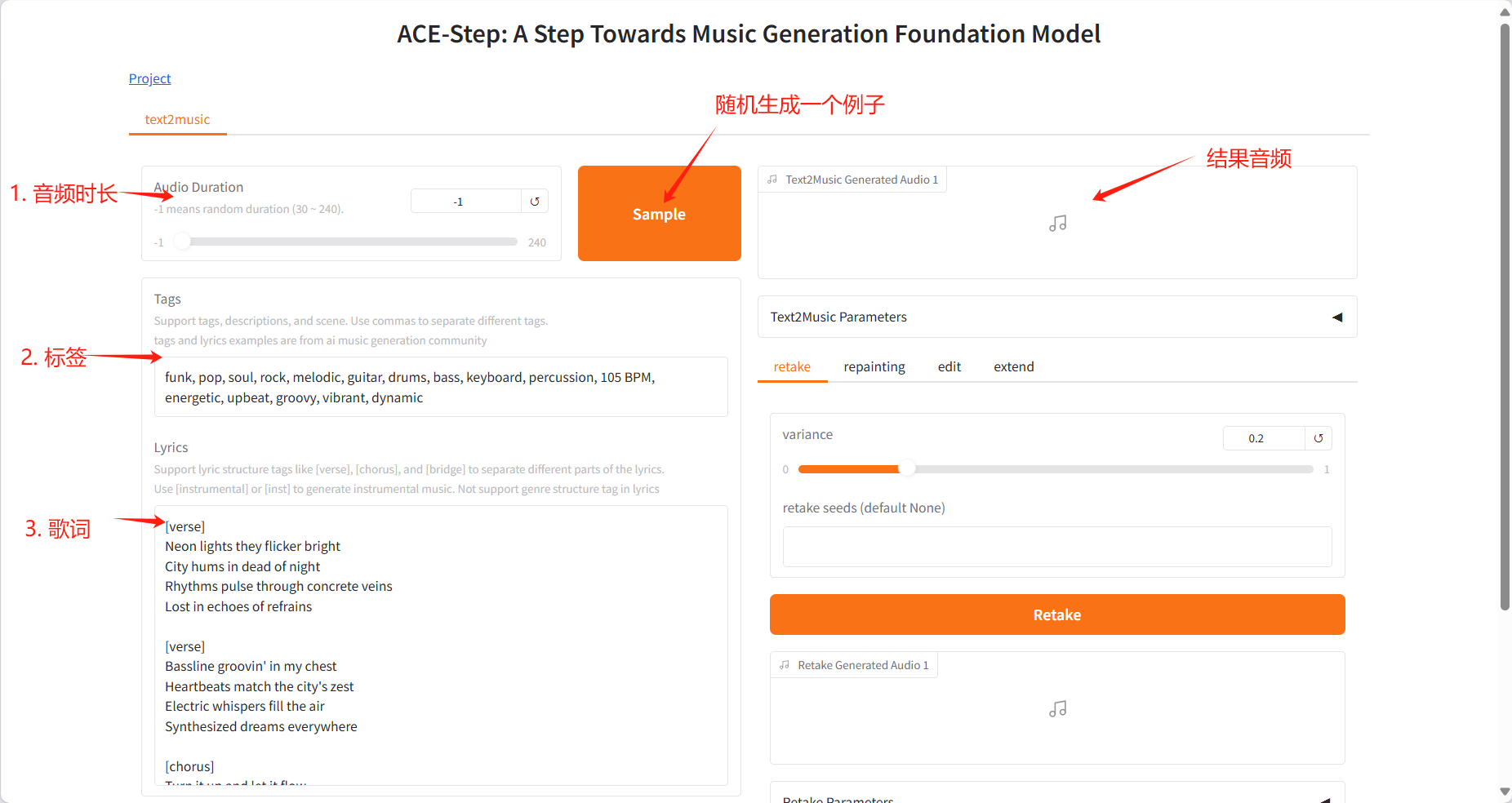

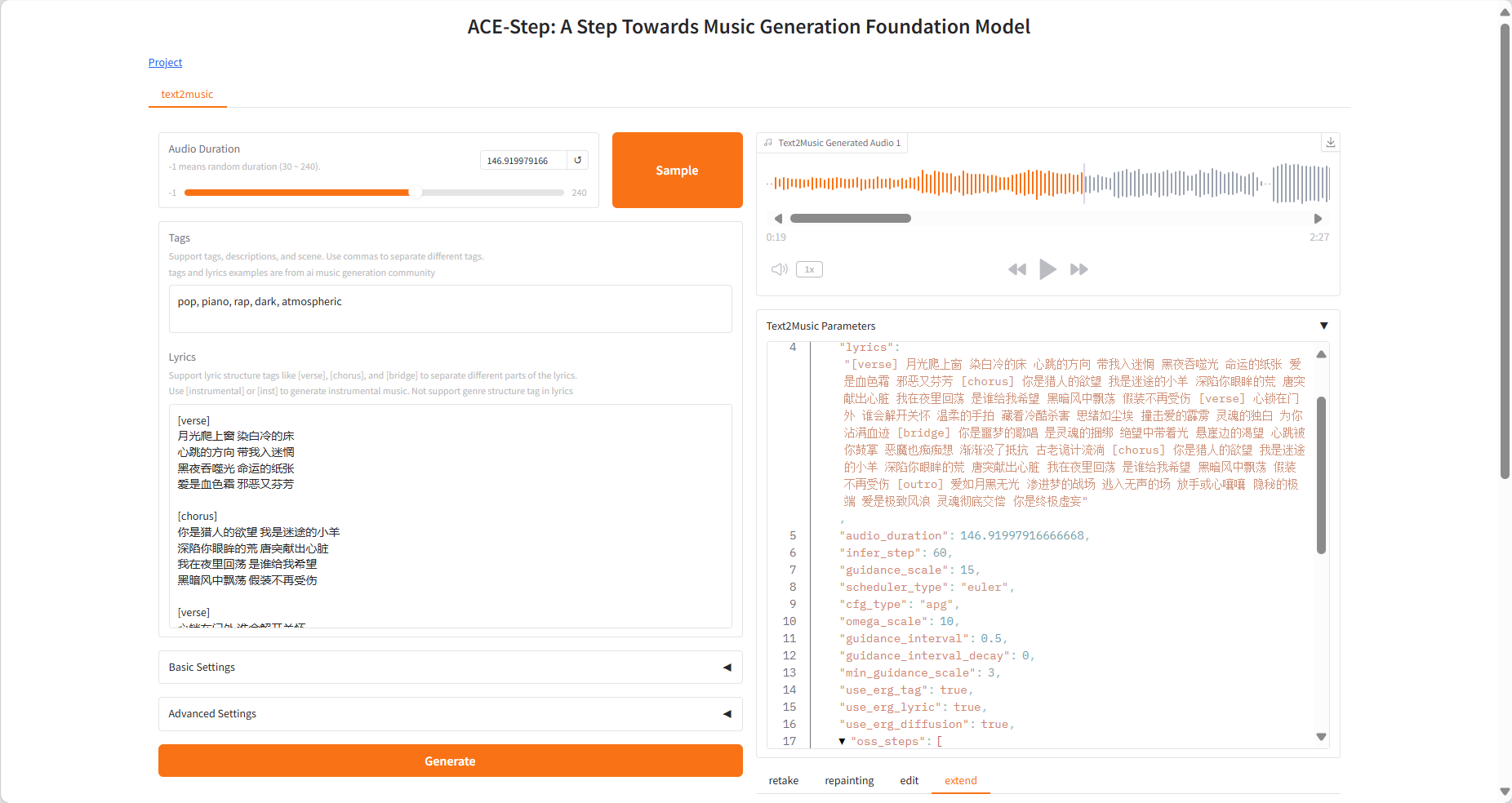

Registerkarte „Text2Music“

- Eingabefelder

- Tags: Geben Sie beschreibende Tags, Musikgenres oder Szenenbeschreibungen ein, getrennt durch Kommas

- Liedtext: Geben Sie Liedtexte mit Struktur-Tags ein, wie etwa [Vers], [Refrain], [Bridge].

- Audiodauer: Legen Sie die Dauer des generierten Audios fest (-1 bedeutet zufällige Generierung).

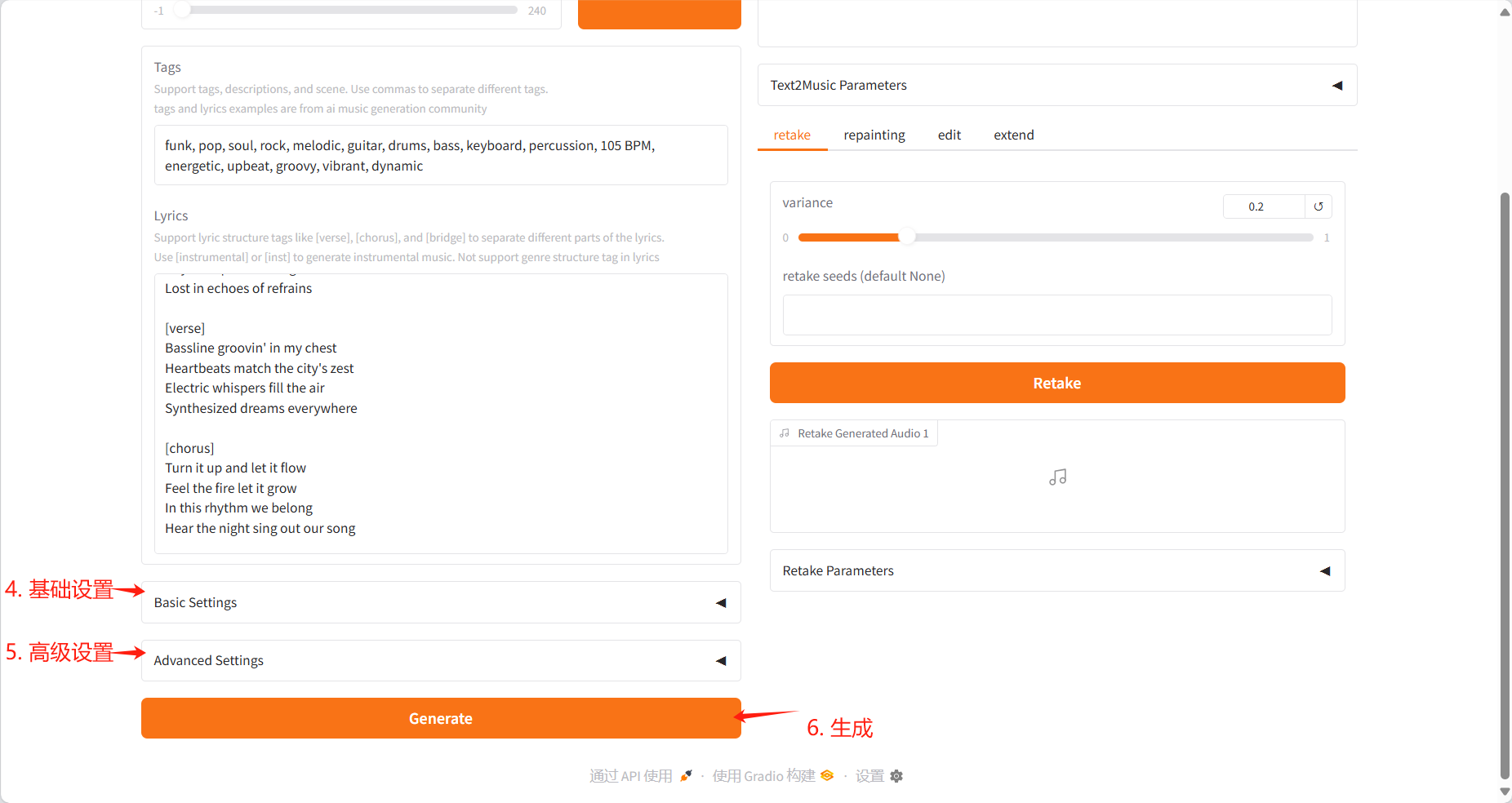

- Einstellungen

- Grundeinstellungen: Passen Sie die Anzahl der Inferenzschritte, das Führungsverhältnis und den Startwert an

- Erweiterte Einstellungen: Feinabstimmung des Scheduler-Typs, des CFG-Typs, der ERG-Einstellungen und anderer Parameter

- Generation

- Klicken Sie auf die Schaltfläche "Generieren", um Musik basierend auf dem Eingabeinhalt zu erstellen

Ergebnisse generieren

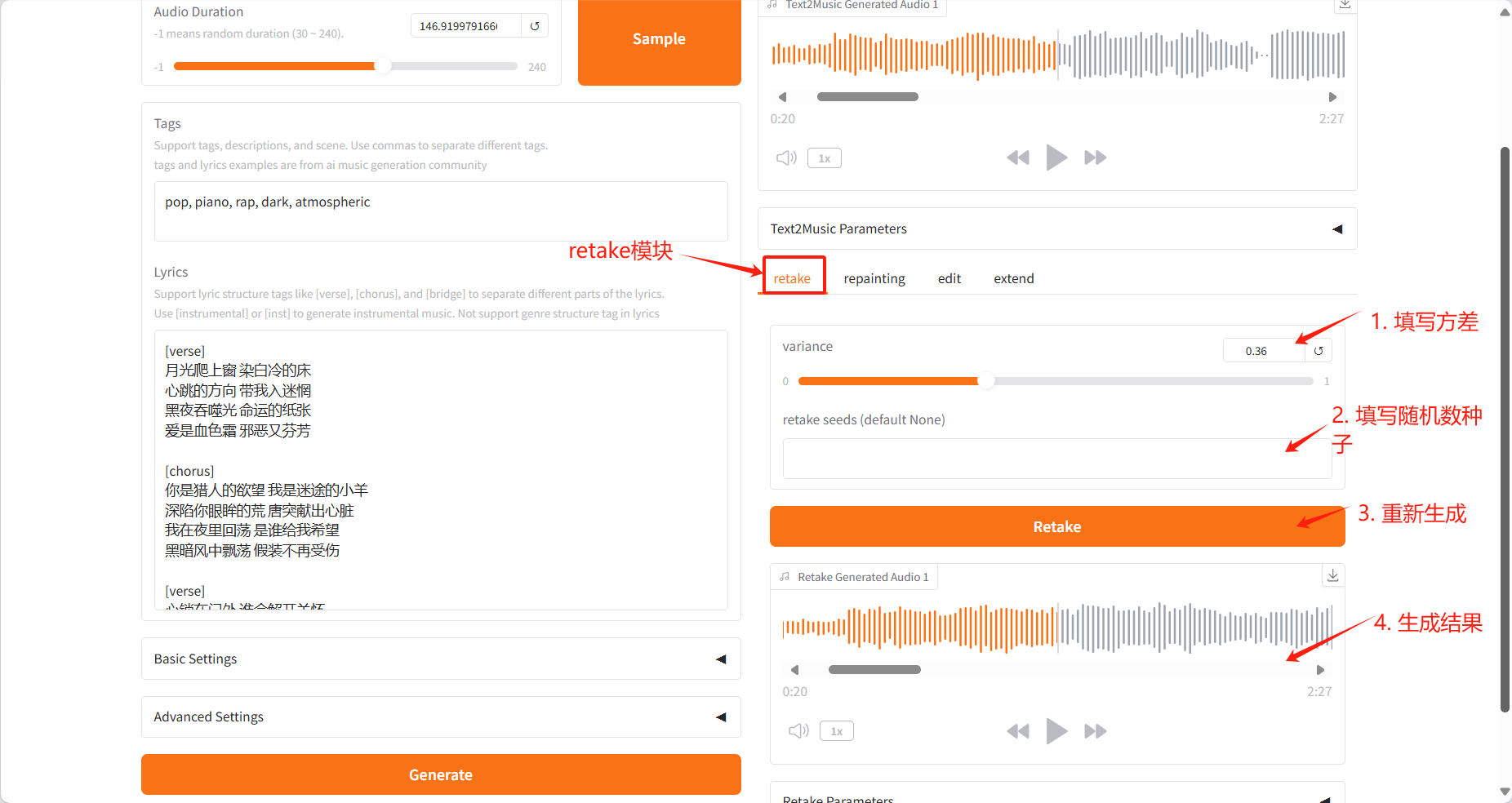

Registerkarte „Wiederholen“

- Regenerieren Sie die Musik mit unterschiedlichen Seed-Werten und erzeugen Sie leichte Variationen

- Passen Sie die Variationsparameter an, um zu steuern, wie stark sich die neue Version vom Original unterscheidet

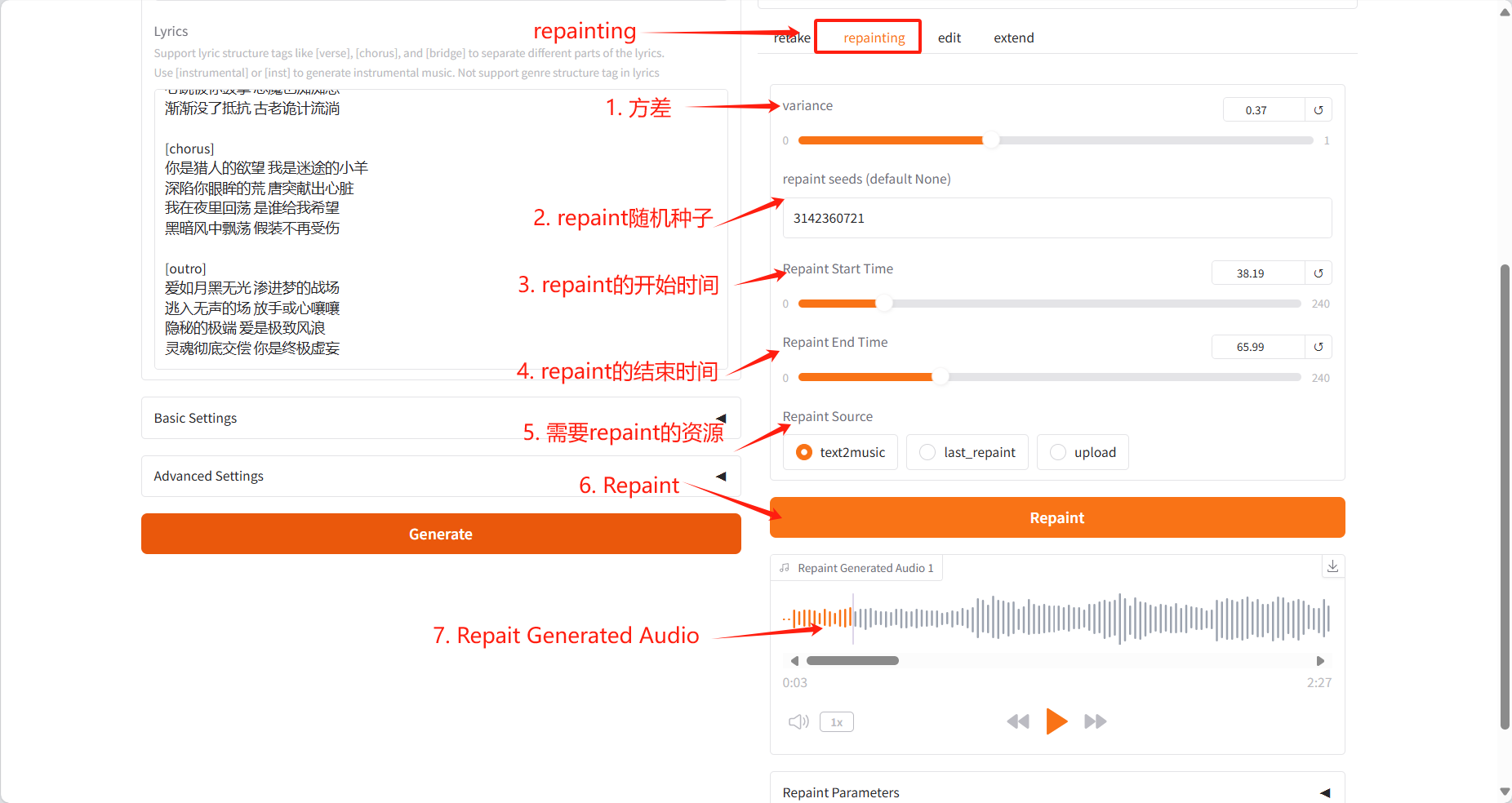

Registerkarte „Neulackierung“

- Selektives Regenerieren bestimmter Musikpassagen

- Geben Sie die Start- und Endzeit des zu regenerierenden Segments an

- Wählen Sie das Quellaudio (text2music, last_repaint oder upload)

Registerkarte „Bearbeiten“

- Passen Sie vorhandene Musik an, indem Sie das Label oder den Text ändern

- Sie können zwischen dem Modus „only_lyrics“ (die Originalmelodie beibehalten) oder dem Modus „remix“ (die Melodie ändern) wählen.

- Kontrollieren Sie den Grad der Erhaltung des Originalsongs durch Anpassen der Bearbeitungsparameter

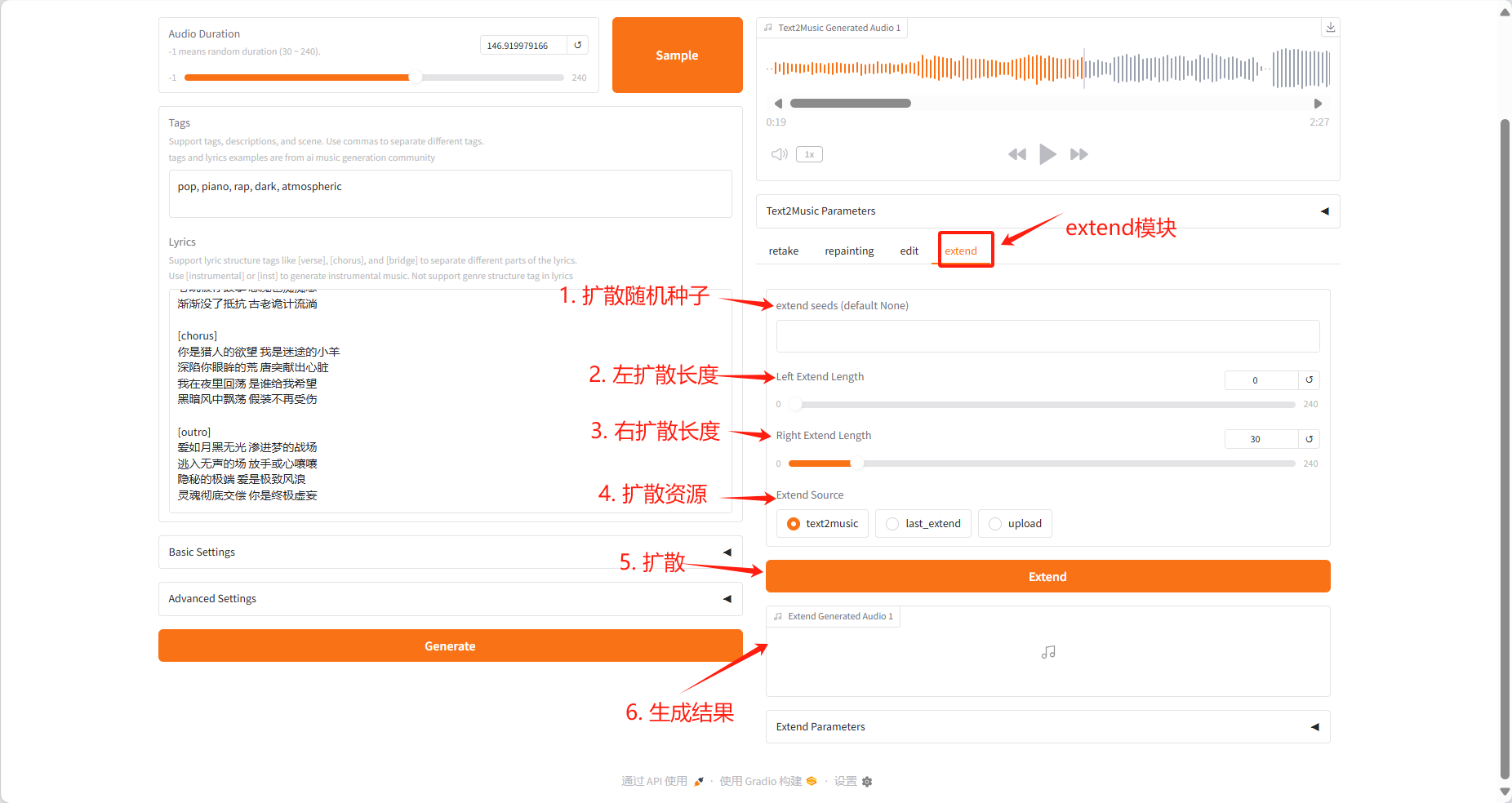

Registerkarte „Erweitern“

- Fügen Sie am Anfang oder Ende der vorhandenen Musik ein Musikstück hinzu

- Geben Sie die Verlängerungsdauer auf der linken und rechten Seite an

- Wählen Sie das Quellaudio aus, das erweitert werden muss

4. Diskussion

🖌️ Wenn Sie ein hochwertiges Projekt sehen, hinterlassen Sie bitte im Hintergrund eine Nachricht, um es weiterzuempfehlen! Darüber hinaus haben wir auch eine Tutorien-Austauschgruppe ins Leben gerufen. Willkommen, Freunde, scannen Sie den QR-Code und kommentieren Sie [SD-Tutorial], um der Gruppe beizutreten, verschiedene technische Probleme zu besprechen und Anwendungsergebnisse auszutauschen ↓

Zitationsinformationen

Dank an den Github-Benutzer SuperYang Bereitstellung dieses Tutorials. Die Zitationsinformationen für dieses Projekt lauten wie folgt:

@misc{gong2025acestep,

title={ACE-Step: A Step Towards Music Generation Foundation Model},

author={Junmin Gong, Wenxiao Zhao, Sen Wang, Shengyuan Xu, Jing Guo},

howpublished={\url{https://github.com/ace-step/ACE-Step}},

year={2025},

note={GitHub repository}

}KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.