Command Palette

Search for a command to run...

3EED-Datensatz Zur Sprachgesteuerten 3D-Verständnisentwicklung

Datum

Größe

Paper-URL

Lizenz

Apache 2.0

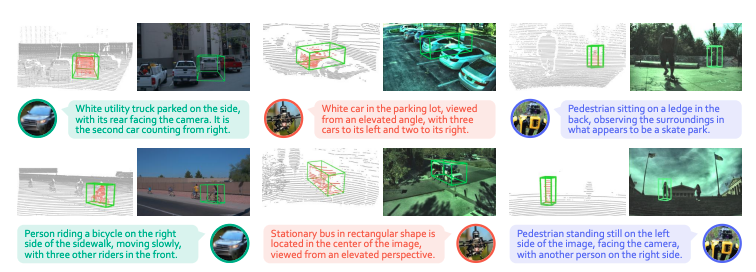

3EED ist ein plattformübergreifender, multimodaler 3D-Datensatz zur visuellen Orientierung, der 2025 von der Hong Kong University of Science and Technology (Guangzhou) in Zusammenarbeit mit der Nanyang Technological University und anderen Institutionen veröffentlicht wurde. Die zugehörige Forschungsarbeit trägt den Titel „3EED: Alles und überall in 3D verankernDie vorgeschlagene Methode wurde von NeurIPS 2025 akzeptiert und zielt darauf ab, Modelle bei der Durchführung sprachgesteuerter 3D-Objektlokalisierungsaufgaben in realen Außenszenarien zu unterstützen und die plattformübergreifende Robustheit und die räumlichen Verständnisfähigkeiten des Modells umfassend zu bewerten. Dieser Datensatz umfasst 20.367 zeitlich ausgerichtete multimodale Bilder von drei Plattformen: Fahrzeugen, Drohnen und Vierbeinern. Er enthält 128.735 3D-Begrenzungsrahmen und 22.439 manuell verifizierte sprachliche Referenzausdrücke – fast zehnmal so viel wie vergleichbare bestehende Datensätze. Darüber hinaus erstreckt sich der Datenraum über bis zu 280 m × 240 m × über 80 m und ist damit um eine Größenordnung größer als bestehende 3D-Referenzdatensätze für den Außenbereich. Dies bietet einzigartige Voraussetzungen für die Untersuchung des 3D-Verständnisses aus großer Entfernung, in verschiedenen Maßstäben und aus verschiedenen Perspektiven.

KI mit KI entwickeln

Von der Idee bis zum Launch – beschleunigen Sie Ihre KI-Entwicklung mit kostenlosem KI-Co-Coding, sofort einsatzbereiter Umgebung und bestem GPU-Preis.