Command Palette

Search for a command to run...

LiveCC:实时视频解说大模型

项目概述

LiveCC 由新加坡国立大学 Show Lab 与字节跳动公司于 2025 年 4 月 25 日首次发布,LiveCC 是一个专注于大规模流式语音转录的视频大语言模型项目,该项目旨在通过创新的视频 – 自动语音识别(ASR)流式方法训练出首个具备实时评论能力的视频大语言模型,在流式和离线基准测试中均达到了当前最优(SOTA)水平。相关论文成果为 LiveCC: Learning Video LLM with Streaming Speech Transcription at Scale,已被 CVPR 2025 收录。

本教程采用资源为单卡 RTX A6000 。

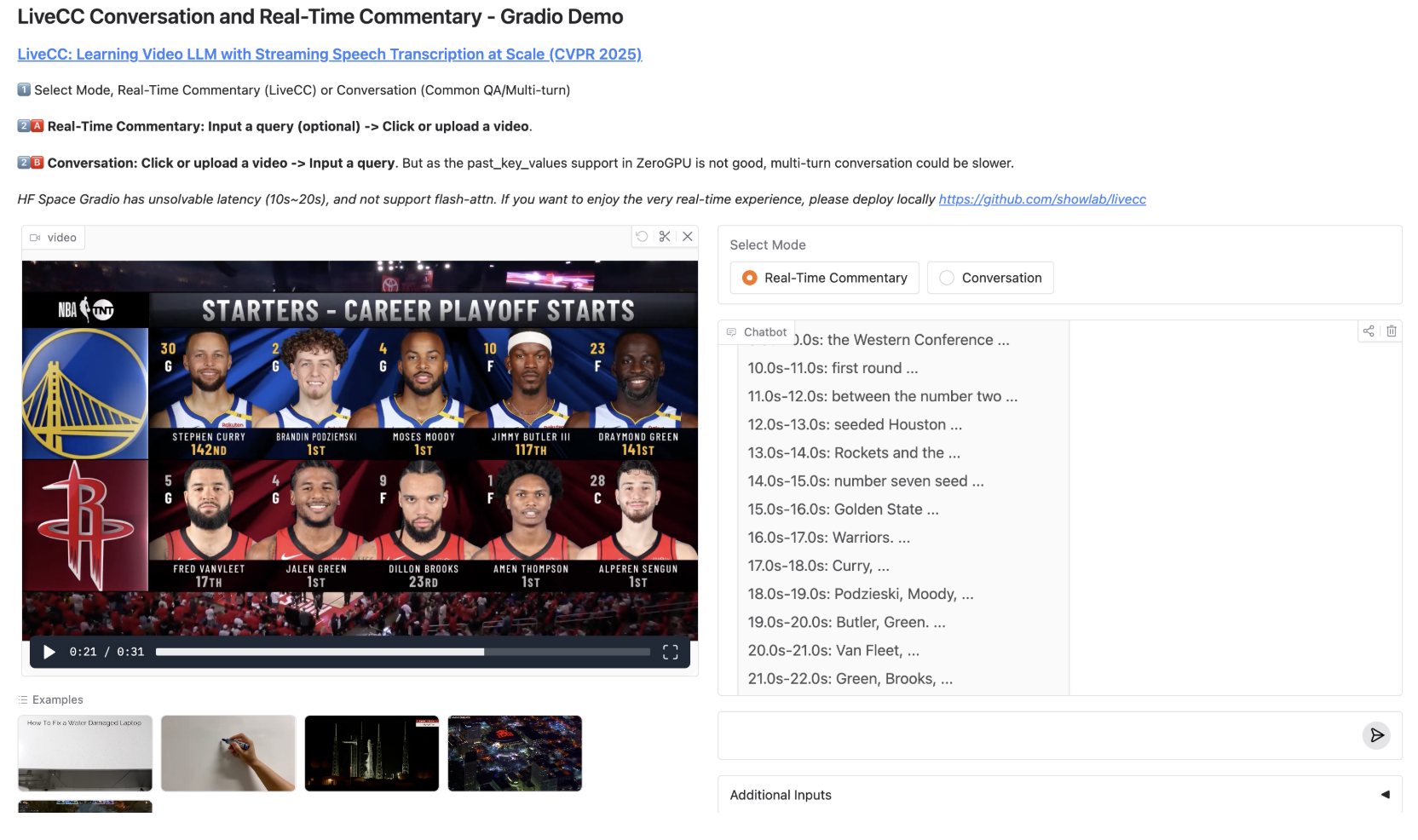

项目示例

运行步骤

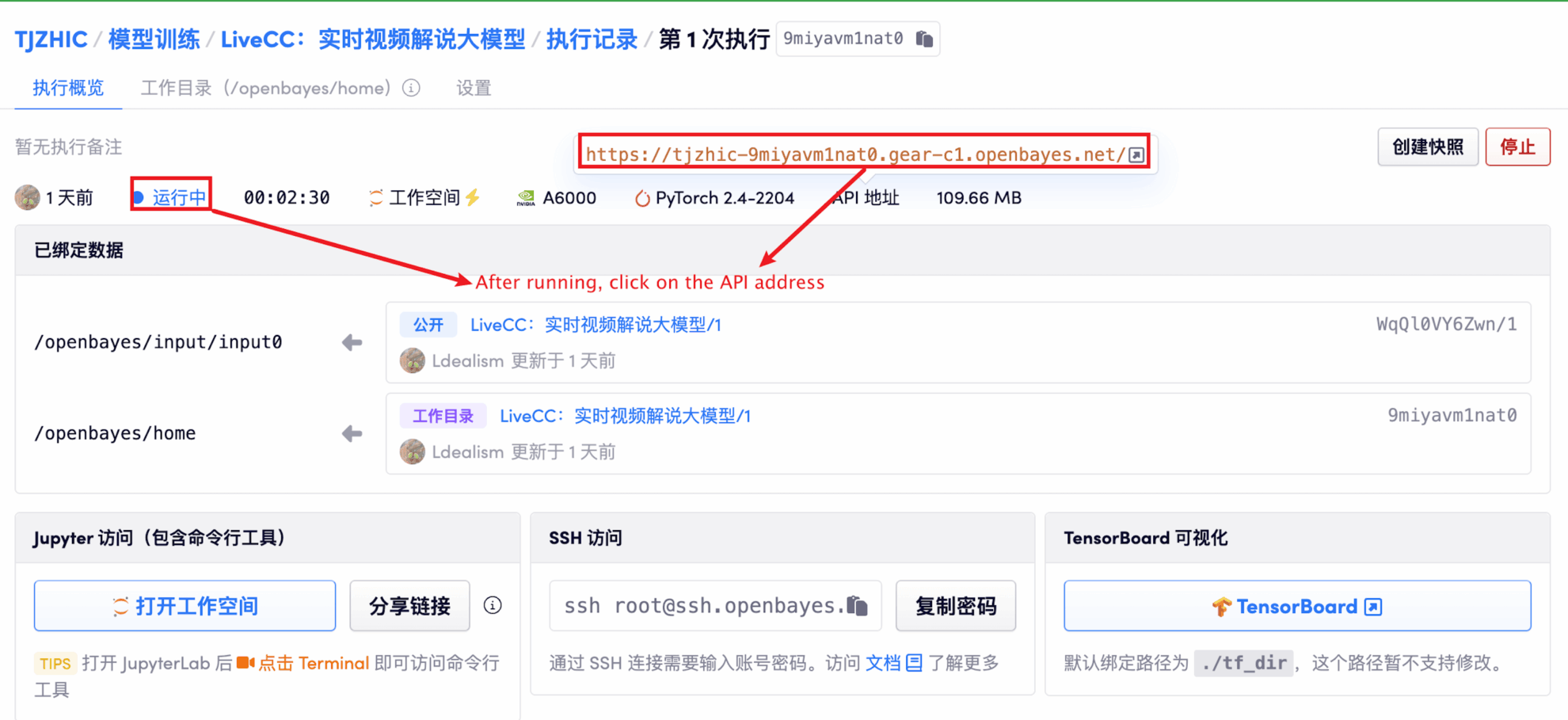

1. 启动容器后点击 API 地址即可进入 Web 界面

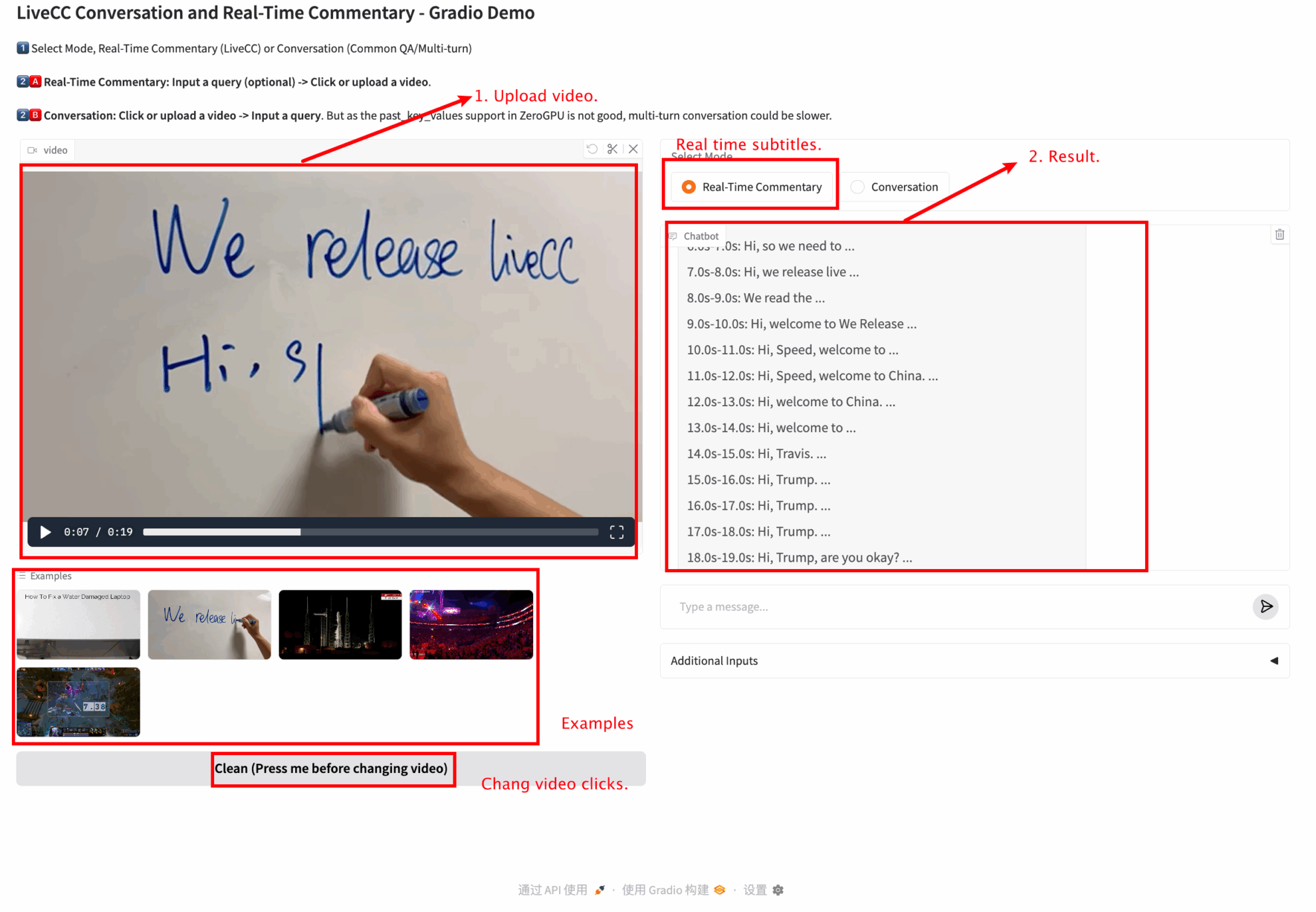

2. 进入网页后,即可与模型进行交互

若显示「Bad Gateway」,这表示模型正在初始化,由于模型较大,请等待约 1-2 分钟后刷新页面。

本教程提供两种模块测试: Real-Time Commentary 和 Conversation 模块。

请勿频繁切换模型,以免造成资源堵塞。

各模块功能如下:

Real-Time Commentary

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓

引用信息

本项目引用信息如下:

@inproceedings{livecc,

author = {Joya Chen and Ziyun Zeng and Yiqi Lin and Wei Li and Zejun Ma and Mike Zheng Shou},

title = {LiveCC: Learning Video LLM with Streaming Speech Transcription at Scale},

booktitle = {CVPR},

year = {2025},

}