Command Palette

Search for a command to run...

MiniCPM-V4.0:极致高效的端侧大模型

一、教程简介

MiniCPM-V 4.0 是由清华大学自然语言处理实验室联合面壁智能于 2025 年 8 月开源的极致高效的端侧大模型。 MiniCPM-V 4.0 基于 SigLIP2-400M 和 MiniCPM4-3B 构建,总参数量为 4.1B 。它继承了 MiniCPM-V 2.6 强大的单图、多图和视频理解性能,效率大幅提升。面壁智能还同步开源了适用于 iPhone 和 iPad 的 iOS 应用。 MiniCPM-V 4.0 在 OpenCompass 评测中图像理解能力超越了 GPT-4.1-mini-20250414 、 Qwen2.5-VL-3B-Instruct 和 InternVL2.5-8B 。相关论文成果为 MiniCPM-V: A GPT-4V Level MLLM on Your Phone 。

该教程算力资源采用单卡 RTX 4090 。提供 Chat with single or multiple images 、 Chat with video 和 Few shot 三个示例供测试。

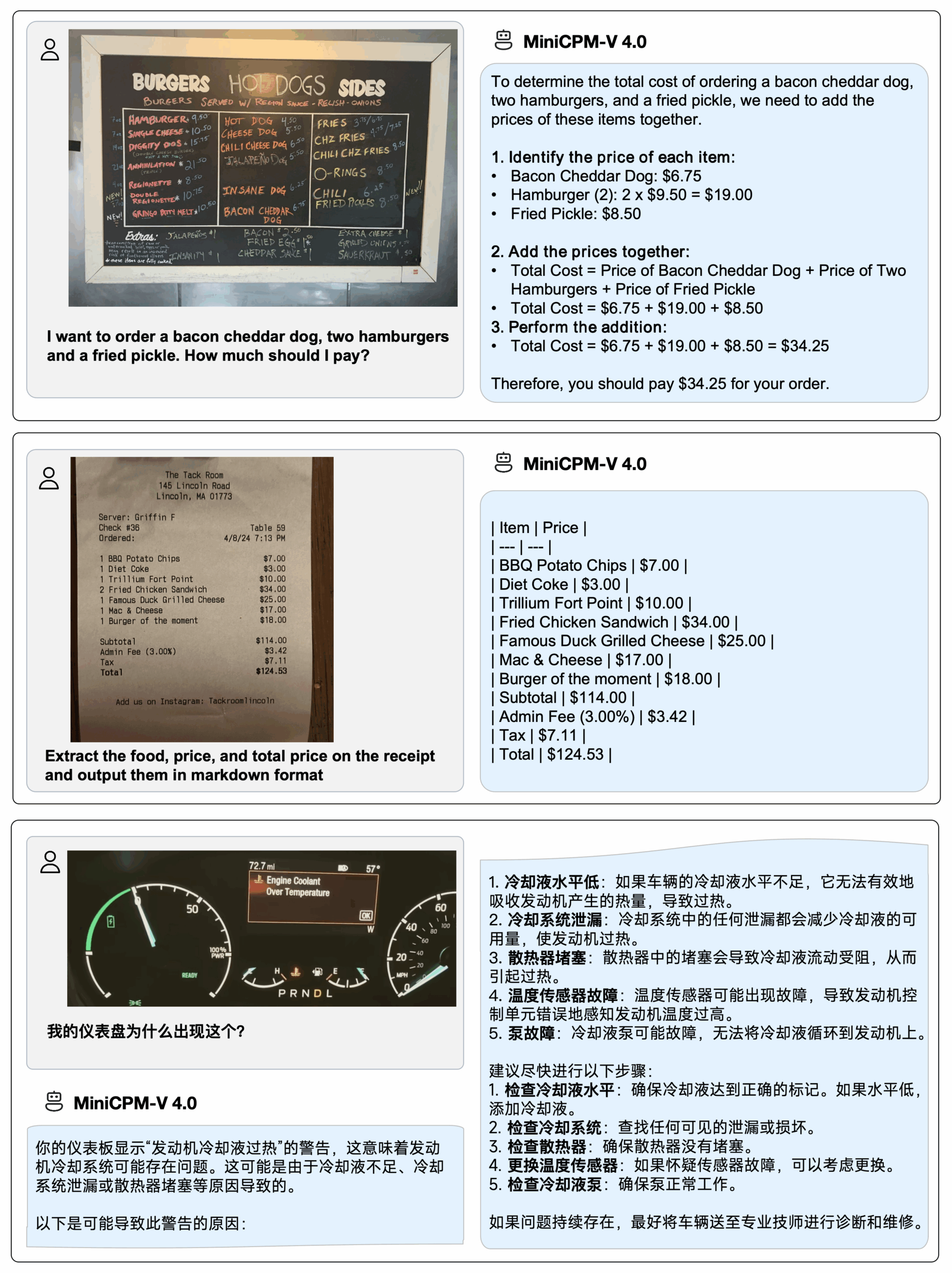

二、效果展示

在 iPhone 16 Pro Max 上部署 MiniCPM-V 4.0,iOS 演示。演示视频是未经编辑的原始屏幕录制:

三、运行步骤

1. 启动容器

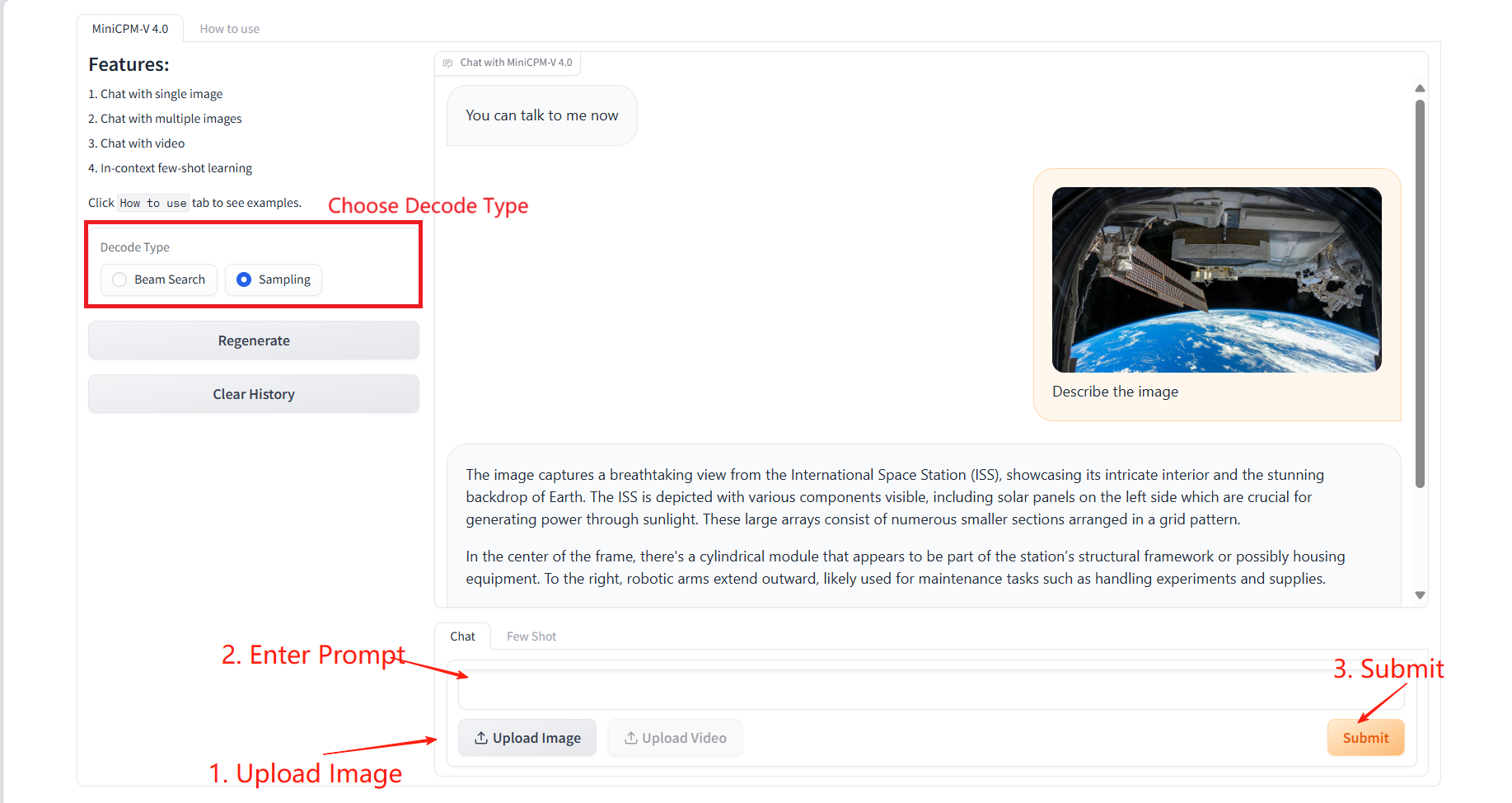

2. 使用步骤

若显示「Bad Gateway」,这表示模型正在初始化,由于模型较大,请等待约 2-3 分钟后刷新页面。

点击「How to use」查看使用指南。

1. Chat with single or multiple images

具体参数:

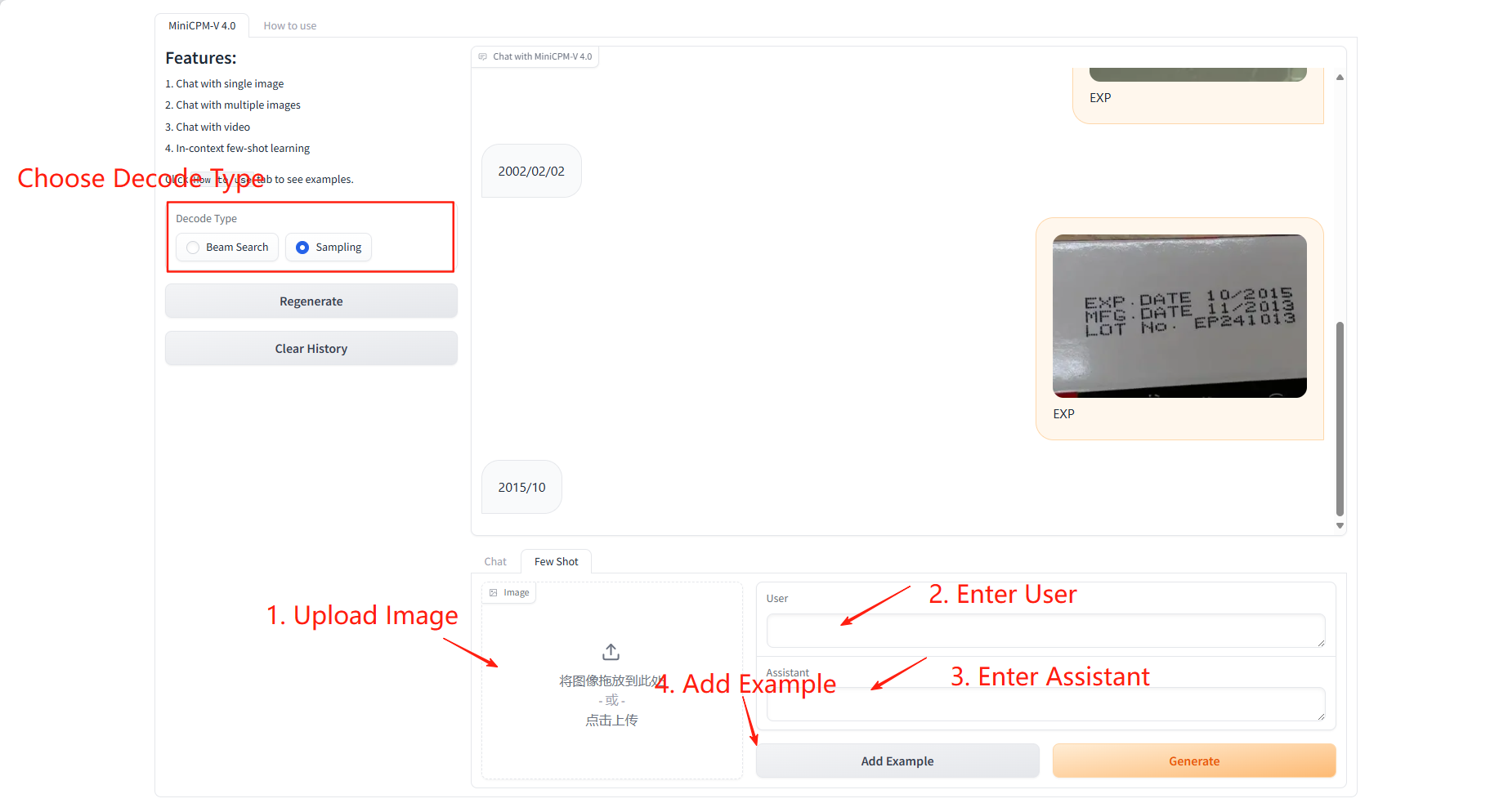

- Decode Type:

- Beam Search:一种确定性较强的解码方法,尝试保留最有可能的几个候选序列,更适合需要准确、一致输出的场景。

- Sampling:基于概率分布随机采样下一个词,输出更具创造性,但可能不稳定。

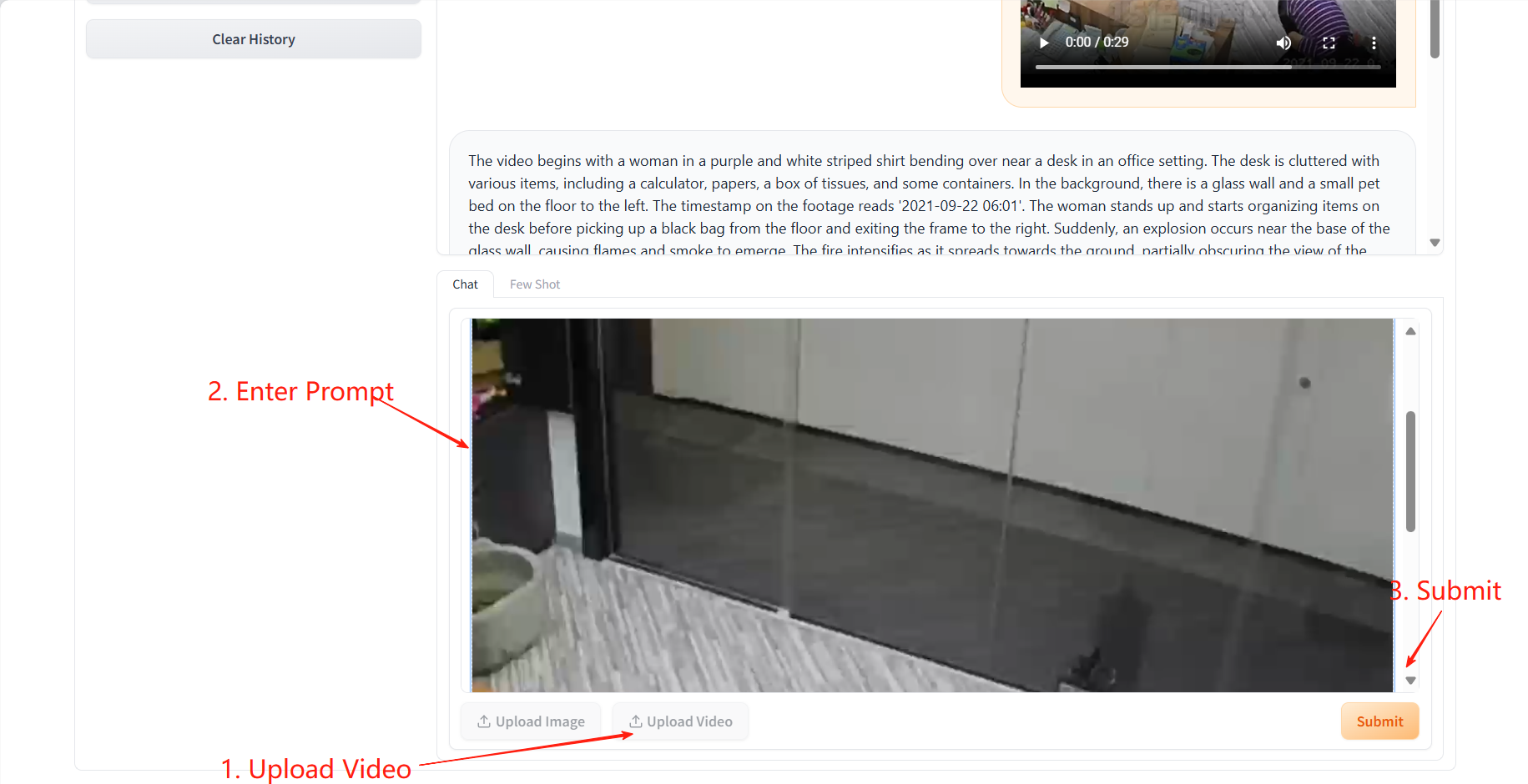

2. Chat with video

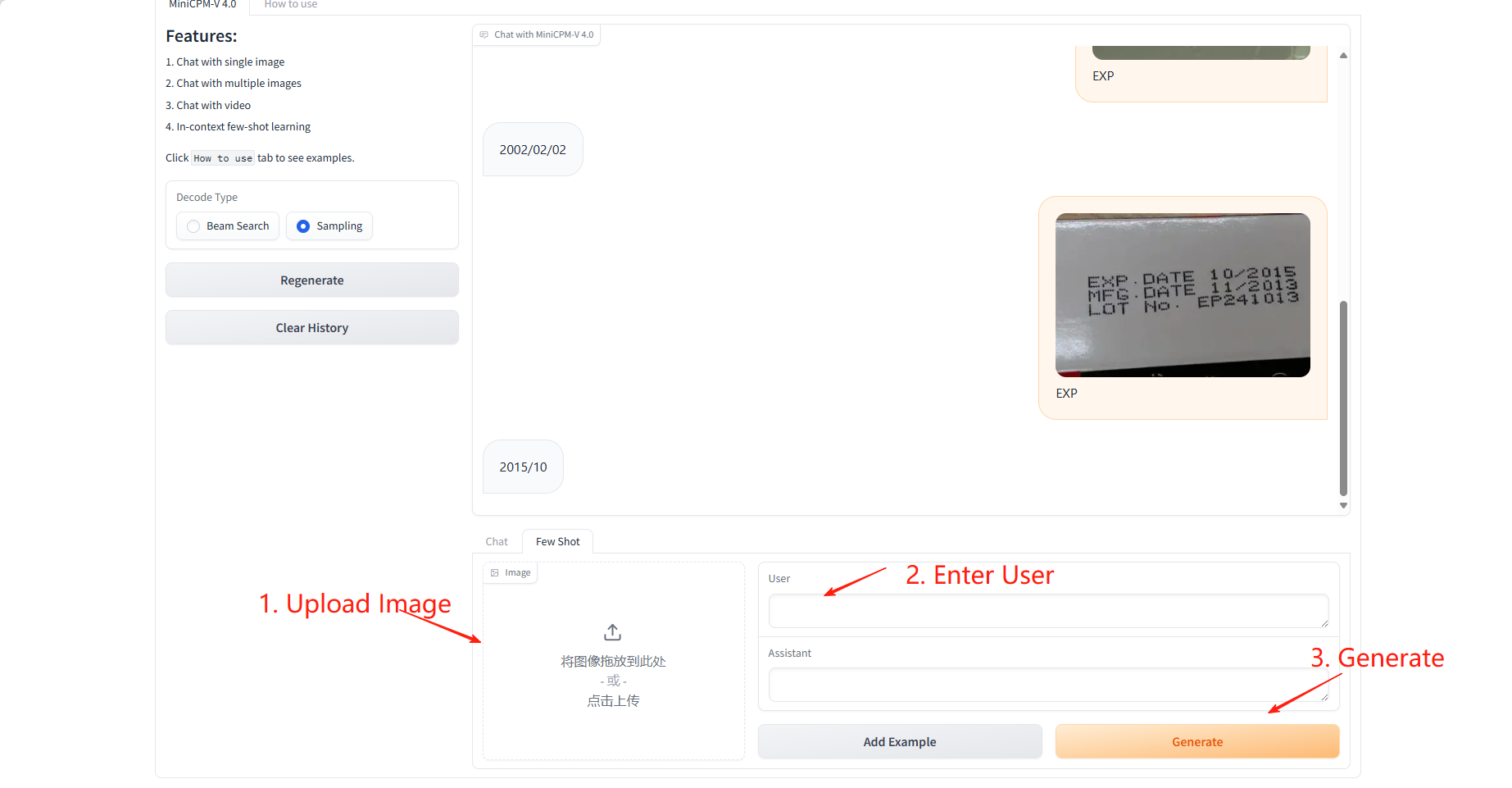

3. Few shot

样本学习

具体参数:

- User:输入该样本需预测或学习的字段。

- Assistant:输入该样本需学习字段对应的值。

结果预测

四、交流探讨

🖌️ 如果大家看到优质项目,欢迎后台留言推荐!另外,我们还建立了教程交流群,欢迎小伙伴们扫码备注【SD 教程】入群探讨各类技术问题、分享应用效果↓

引用信息

本项目引用信息如下:

@article{yao2024minicpm,

title={MiniCPM-V: A GPT-4V Level MLLM on Your Phone},

author={Yao, Yuan and Yu, Tianyu and Zhang, Ao and Wang, Chongyi and Cui, Junbo and Zhu, Hongji and Cai, Tianchi and Li, Haoyu and Zhao, Weilin and He, Zhihui and others},

journal={Nat Commun 16, 5509 (2025)},

year={2025}

}

@article{yao2024minicpm,

title={MiniCPM-V: A GPT-4V Level MLLM on Your Phone},

author={Yao, Yuan and Yu, Tianyu and Zhang, Ao and Wang, Chongyi and Cui, Junbo and Zhu, Hongji and Cai, Tianchi and Li, Haoyu and Zhao, Weilin and He, Zhihui and others},

journal={arXiv preprint arXiv:2408.01800},

year={2024}

}