Command Palette

Search for a command to run...

Soohak:由数学家精心策划的基准测试,用于评估大语言模型在研究级数学能力方面的表现

Soohak:由数学家精心策划的基准测试,用于评估大语言模型在研究级数学能力方面的表现

摘要

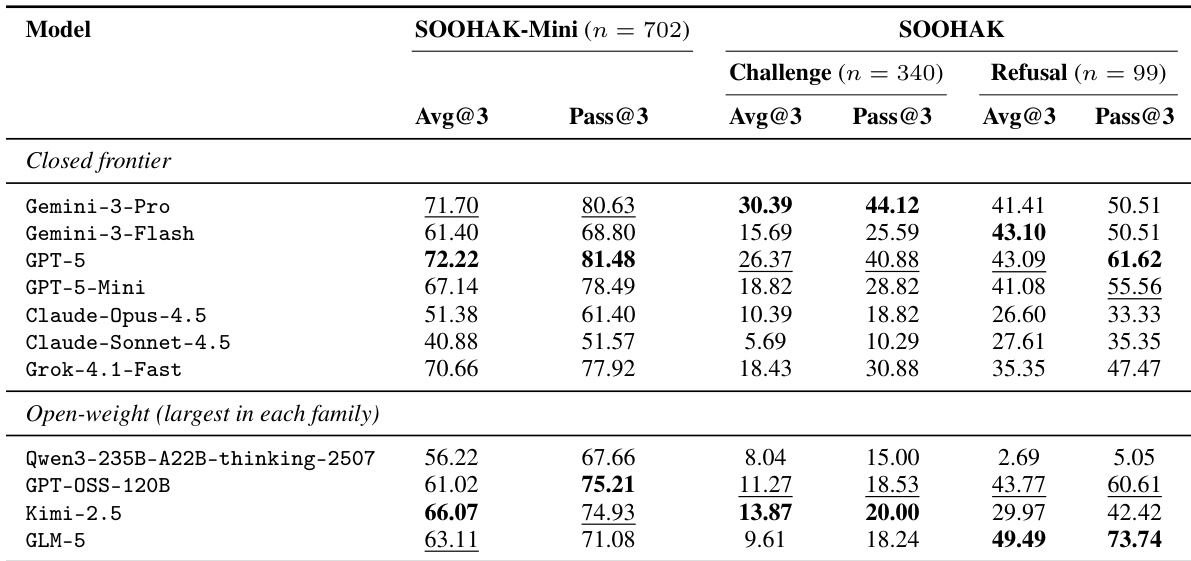

继前沿大型语言模型(LLMs)在国际数学奥林匹克竞赛(IMO)中取得金牌成绩后,学术界正在寻找下一个具有意义且具挑战性的目标,以衡量大模型的推理能力。尽管奥赛类题目主要考察逐步推理能力,但研究级数学问题则利用这种推理来推动数学知识本身的边界,从而成为更具吸引力的替代方案。然而,研究级数学基准测试依然稀缺,因为这类问题的来源难度极大(例如,Riemann Bench 和 FrontierMath-Tier 4 分别仅包含 25 道和 50 道题目)。为了支持对下一代前沿模型的可靠评估,我们推出了 Soohak,这是一个由 64 位数学家全新编写的、包含 439 道题目的基准测试集。Soohak 包含两个子集。在挑战子集中,包括 Gemini-3-Pro、GPT-5 和 Claude-Opus-4.5 在内的前沿模型分别达到了 30.4%、26.4% 和 10.4% 的成绩,显示出巨大的提升空间;而 Qwen3-235B、GPT-OSS-120B 和 Kimi-2.5 等领先开源模型的成绩则均低于 15%。值得注意的是,除了标准的问题解决能力,Soohak 还引入了一个“拒绝子集”,旨在探测研究数学中固有的一种能力:识别不良定义的问题并暂停回答,而不是给出自信但缺乏依据的答案。在此子集中,没有任何模型得分超过 50%,表明“拒绝”成为当前模型尚未直接应对的一个新的优化目标。为防止数据污染,该数据集将于 2026 年底公开发布,在此之前,模型评估结果可根据申请提供。

一句话总结

由六十四位数学家从零原创编写,SOOHAK 是一个包含 439 道题目的基准测试,用于评估大型语言模型的研究级数学推理能力。该基准包含一个 Challenge 子集,用于评估 Gemini-3-Pro、GPT-5 和 Claude-Opus-4.5 等前沿架构的高级问题解决能力;以及一个 Refusal 子集,用于衡量系统是否能识别病态问题,从而将拒绝回答确立为当前模型尚未直接应对的新优化目标。

核心贡献

- 本文提出 SOOHAK,这是一个由 64 位数学家原创的包含 439 道研究级数学问题的基准测试,旨在评估前沿语言模型在推动数学知识进展方面的推理能力。

- 该基准测试包含一个专门的拒绝回答子集,用于衡量模型识别病态问题并避免生成自信但缺乏依据的答案的能力,从而为评估数学可靠性开辟了新维度。

- 在 Challenge 子集上的评估表明,领先的前沿模型准确率为 10.4% 至 30.4%,而开源权重系统得分低于 15%;在 Refusal 子集上,没有任何模型得分超过 50%。这提供了具体的基线数据,并将拒绝回答行为确立为新的优化目标。

引言

请提供源文本。收到后,将从科普视角起草一份简明的背景摘要,涵盖技术背景、既有局限以及作者的核心贡献。

数据集

-

数据集构成与来源

- 作者提出 SOOHAK,这是一个具备防污染特性的基准测试,包含 439 道由专家原创的数学问题,并附带一个名为 SOOHAK-Mini 的 702 题配套子集。

- 数据来自 105 位贡献者,通过两条渠道收集:主要提交系统(86 位通过定向邀请和公开申请招募的贡献者)以及从 ScienceBench 数据集批量采购(19 位贡献者)。

- 贡献者涵盖高校教师、研究生、博士后和本科生,提交内容涉及代数、数论、组合数学、分析学、几何学、拓扑学、概率论和微分方程。

-

各子集关键细节

- SOOHAK Challenge(340 题): 面向研究生级别及与研究密切相关的数学领域。题目来源于受邀专家,并补充了 112 道批量采购的题目。所有题目必须在评估面板的所有大型开源模型(如 gpt-oss-120B、Qwen3-235B、DeepSeek-R1)上均判定为失败。

- SOOHAK Refusal(99 题): 包含在质量控制阶段因存在矛盾、缺失假设或答案不唯一而被拒收的病态问题。旨在测试模型是否能识别无法回答的提示词,而非生成自信但错误的答案。

- SOOHAK-Mini(702 题): 一个配套子集,涵盖从高中数学竞赛到研究生初期阶段的内容。题目筛选标准为必须同时导致小型开源模型(Qwen3-7B、OpenThinker3-7B)和中型开源模型(gpt-oss-20B、Qwen3-32B)失败。

- 所有提交内容均经过包含自动化初筛、双人人工审核、贡献者自愿确认以及严格原创性验证的五阶段流程。作者明确禁止曾尝试提交 AI 生成题目的贡献者参与。

-

数据使用与处理

- 作者仅将该数据集用于模型评估和人类基线研究,未划分训练集或设置混合比例。为防止数据污染,完整数据集暂封至 2026 年底,期间评估结果可按需申请获取。

- 人类基线由五支背景各异的专业团队建立,成员包括国际数学奥林匹克(IMO)奖牌获得者及已发表论文的研究人员。团队在 79 题的子集上进行测试,以校准难度预期。

- 质量控制包含自动化一致性检查、针对模型生成答案与参考答案的人工审计,以及一次外部评估,该评估标记了约 5% 的题目存在潜在歧义或错误。

-

元数据构建与格式细节

- 每道题目均标注贡献者提供的关键词,以及由 GPT-5-mini 分类器生成的 LLM 分配数学主题分类(MSC)类别,以标准化覆盖统计。

- 约 92% 的题目最初以英文撰写。作者通过保留 LaTeX 格式的机器翻译工作流将所有题目译为韩文,随后进行专业人工校对、术语规范化及独立质量保障,构建出平行的双语基准测试。

- 提交内容仅限纯文本 LaTeX,需包含明确的答案和完整解题过程。最终数据集以结构化 JSON 格式序列化,并经过严格的自动化检查以确保公式等价性与可渲染性。

方法

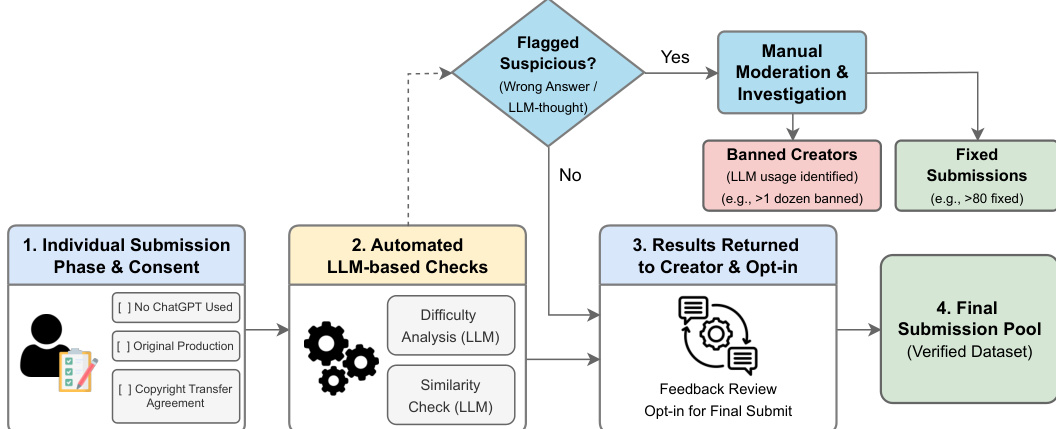

作者采用结构化的多阶段流程以确保 SOOHAK 基准测试的完整性与质量。流程始于贡献者提供的原创数学问题提交。每次提交均需经过初步审核,以确认符合关键标准,包括未使用 ChatGPT、内容为原创制作,以及签署版权转让协议。该初始阶段确保源材料既真实可靠又符合法律使用规范。

如图所示,第二阶段采用基于大语言模型的自动化检查来评估提交内容。这些检查包括难度分析和相似度检查,均通过大语言模型执行。难度分析用于评估问题的复杂程度,而相似度检查则识别与公共数据集中现有问题的潜在重叠,从而最大限度地减少冗余和数据污染。这些自动化评估充当过滤器,用于精简数据集并提升其新颖性。

通过自动化检查的提交内容进入第三阶段,结果将返回给创作者以供审核并提供可选反馈。该反馈机制使贡献者能够根据模型响应优化题目,并确保最终内容符合预期的难度与正确性。在此阶段,系统会判断提交内容是否被标记为可疑,例如答案错误或推理存在缺陷。若被标记,该提交将进入人工审核与调查流程,由人工评审员评估具体问题。被判定涉及违规使用的提交(例如同一个模型重复尝试或过度依赖大语言模型)将被归类为违规创作者并予以排除。否则,经核实的提交内容将被标记为已修正并整合至最终提交池中。

最终阶段将所有经过验证的贡献整合至已验证数据集中,随后用于模型评估。这一严谨的工作流程确保基准测试在原创性、难度和可靠性方面维持高标准,从而支持不同模型之间公平且具有意义的对比。

实验

本次评估在三个基准划分上对比了十一款闭源与开源权重语言模型以及人类参与者,分别验证基线推理能力、前沿数学问题解决能力以及对病态提示词的处理严谨性。结果表明,尽管闭源系统在复杂问题上普遍保持优势,但在高难度推理任务上的表现随模型规模与扩展测试算力呈可预测的缩放规律,而拒绝回答行为则遵循独立模式。人类评估显示,竞赛型训练与时间优化的协作策略比深厚的研究专长更能有效提升表现,凸显出学术数学家在任务形式上的不匹配。最终,研究证明前沿数学能力取决于算力扩展、精细的提示词处理与专用推理训练的综合结合,而非单纯依赖参数量。

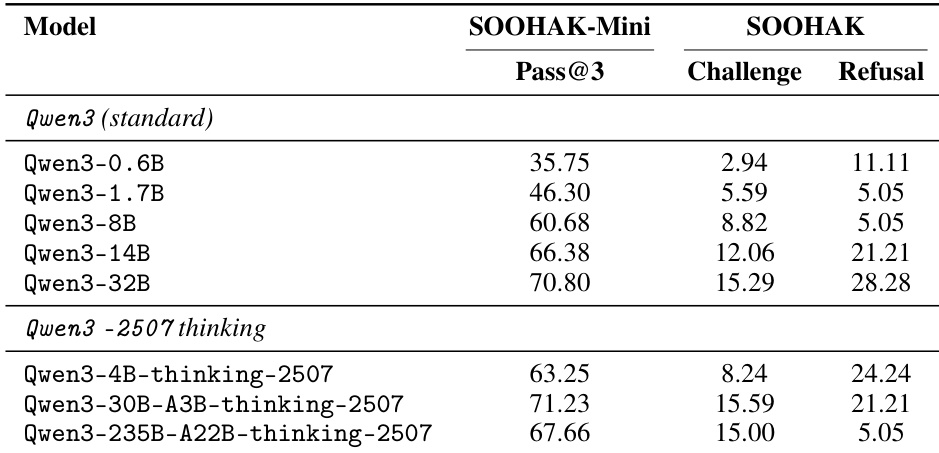

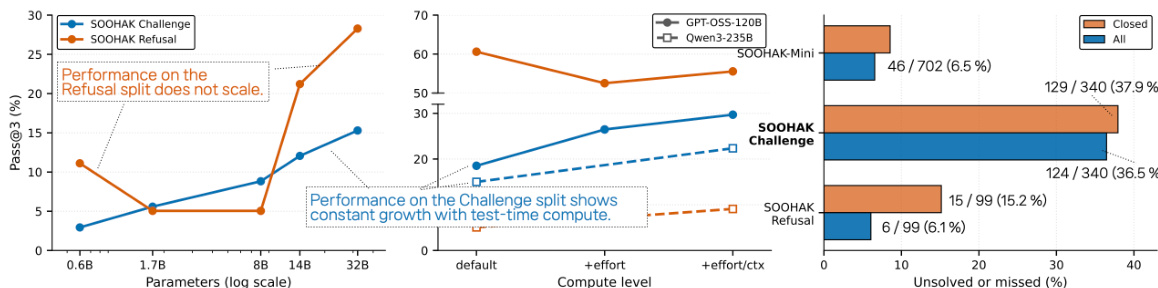

表格展示了 Qwen3 模型家族在不同参数量与配置下的 Pass@3 性能,对比了标准版与思维调优版在 SOOHAK-Mini、Challenge 和 Refusal 基准上的表现。结果表明,较大模型通常获得更高分数,思维调优版在 SOOHAK-Mini 和 Challenge 上表现有所提升,尽管最大模型在标准版中显示性能回落。所有模型的 Refusal 得分均维持在较低水平,表明其正确拒绝不当查询的能力有限。较大的 Qwen3 模型在 SOOHAK-Mini 和 Challenge 上稳定获得更高 Pass@3 分数,性能随参数量增长而提升。Qwen3 的思维调优版相较于标准版在 SOOHAK-Mini 和 Challenge 上表现更佳,但最大模型的标准版出现性能退化。所有模型在 Refusal 基准上表现不佳,分数持续偏低且在不同配置间改善有限。

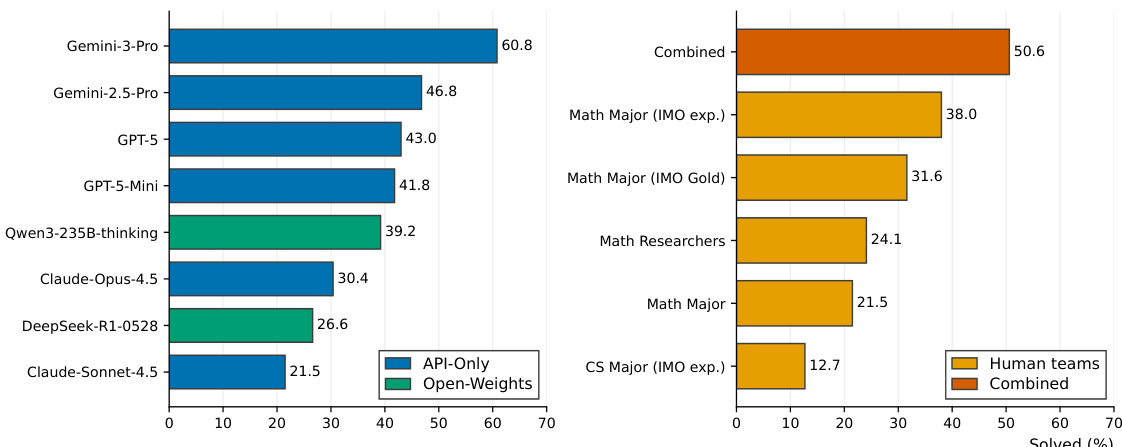

作者在数学推理基准测试上评估了一系列语言模型与人类参与者,对比了不同模型类型与人类团队的表现。结果表明,闭源模型在推理任务上普遍优于开源权重模型,而 GLM-5 等开源权重模型在拒绝回答任务上表现突出。人类团队(尤其是具备竞赛经验的团队)取得优异表现,其综合覆盖率超越单一模型,尽管部分模型在覆盖率上仍超过最佳人类团队。闭源模型在挑战性数学问题上展现出高于开源权重模型的推理性能。开源权重模型在拒绝回答任务上表现强劲,其中 GLM-5 在所有评估模型中位居首位。具备竞赛经验的人类团队表现优异,其综合覆盖率超过任何单一模型或团队。

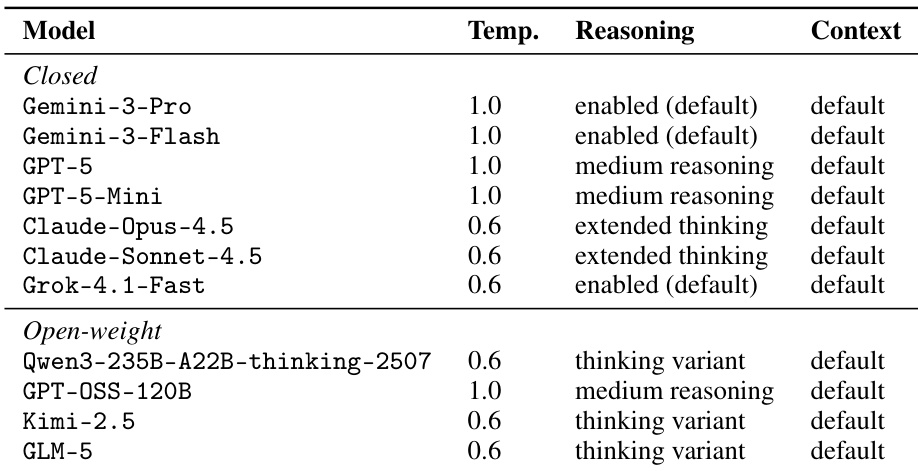

作者在包含推理与拒绝回答任务的基准测试上评估了一组闭源与开源权重语言模型,采用 avg@3 与 pass@3 等指标衡量表现。模型在标准化解码设置下进行评估,部分系统探索了推理努力程度与上下文长度的变化。结果表明,闭源模型在推理任务上普遍优于开源权重模型,而开源权重模型表现出更强的拒绝回答行为,说明不同任务类型具备各自的优势。评估显示,表现因数学子领域差异显著,顶尖模型在不同领域各不相同;增加模型规模与测试算力可提升推理性能,但并非在所有任务中均呈均匀改善。闭源模型在推理性能上高于开源权重模型,但开源权重模型在拒绝回答行为上更为突出。性能随模型规模扩大与上下文延长而提升,尤其在推理任务上,但并非所有模型均呈现一致改善。表现优异的模型因数学子领域而异,无单一模型在所有领域占据主导,表明各领域具备多样化的优势。

作者在 SOOHAK 基准测试上评估了一系列语言模型,该基准包含两个主要部分:SOOHAK-Mini 与 SOOHAK,后者进一步划分为 Challenge 和 Refusal 子任务。结果表明,闭源前沿模型在 SOOHAK-Mini 和 Challenge 上普遍优于开源权重模型,而开源权重模型(尤其是 GLM-5)在 Refusal 子任务上获得最高分。评估揭示了不同模型家族与子领域间的表现模式差异,部分模型在特定数学领域表现卓越,另一些则展现更广泛但专业性较弱的能力。相较于开源权重模型,闭源前沿模型在 SOOHAK-Mini 和 Challenge 上取得更高性能,GPT-5 在两项指标中均居首位。开源权重模型在 Refusal 子任务上超越其他所有模型,表明其具备更强的拒绝回答能力。性能在不同数学子领域间差异显著,各领域的领先模型各不相同,说明优势呈现专业化特征而非全面领先。

作者在 SOOHAK 基准测试上评估了一系列语言模型,重点关注不同模型家族与配置下的推理与拒绝回答能力。结果表明,闭源模型在 Challenge 划分上普遍优于开源权重模型,而 GLM-5 等开源权重模型在 Refusal 划分上取得更高性能。性能随模型规模与测试算力呈缩放规律,尤其在 Challenge 划分上表现明显,但 Refusal 性能未遵循相同的缩放模式。评估还显示,模型优势因数学子领域差异显著,不同领域由不同模型领先。闭源模型在 Challenge 划分上性能高于开源权重模型,但 GLM-5 等开源权重模型在 Refusal 划分上领先。Challenge 划分的性能随模型规模与测试算力提升,而 Refusal 性能未呈现一致的缩放规律。模型优势在不同数学子领域间有所差异,不同模型依据题目类型在各领域占据领先。

本次评估采用标准化解码与不同计算设置,在数学推理与拒绝回答基准测试上对比了闭源与开源权重语言模型以及专业人类团队。结果表明,前沿闭源模型在复杂推理任务上稳定优于开源系统,而开源架构展现出显著更强的拒绝回答能力。推理性能随模型规模与测试算力增加而可靠缩放,但拒绝回答行为遵循不同模式,并未随规模扩大而持续改善。此外,模型优势在不同数学子领域间呈现高度领域特定性,表明专项能力优于全面领先,而经验丰富的人类团队经常能达到或超越单一模型的覆盖范围。