Command Palette

Search for a command to run...

单个神经元足以绕过大型语言模型的安全对齐

单个神经元足以绕过大型语言模型的安全对齐

Hamid Kazemi Atoosa Chegini Maria Safi

摘要

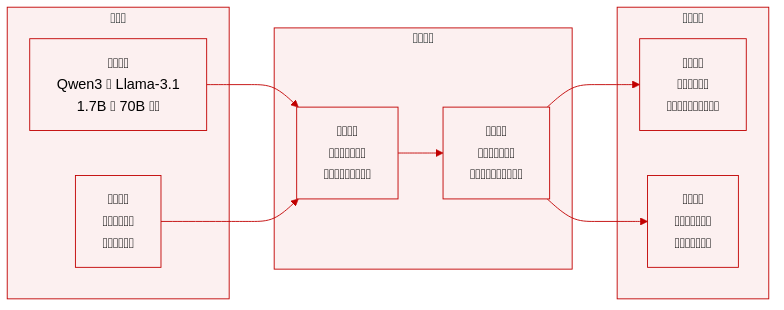

语言模型的安全对齐机制包含两个在机理上截然不同的系统:一是负责控制是否表达有害知识的“拒绝神经元”(refusal neurons),二是编码有害知识本身的“概念神经元”(concept neurons)。通过针对每个系统中的单个神经元进行操作,我们在涵盖两个模型家族、参数量从17亿至700亿的七种模型上,无需任何训练或提示工程(prompt engineering),成功演示了两种失败路径:通过抑制(suppression)机制,绕过安全限制以响应显式的有害请求;以及通过放大(amplification)机制,从无害提示中诱导生成有害内容。我们的研究结果表明,安全对齐并非稳健地分布于模型权重之中,而是由单个神经元介导,且这些神经元在因果上足以决定拒绝行为——抑制其中任意一个被识别出的拒绝神经元,即可在各种有害请求中绕过安全对齐机制。

一句话总结

通过在无需任何训练或提示工程的情况下,针对跨越两个系列、参数规模从 1.7B 到 70B 的七个模型中两种机制截然不同的系统各自的一个神经元进行靶向操作,作者证明安全对齐依赖于单个拒绝神经元(足以通过抑制绕过显式有害请求的安全)和概念神经元(足以通过放大从无害提示中诱导有害内容)。

核心贡献

- 该论文确立安全对齐通过两种机制截然不同的系统运作,具体为负责门控有害知识表达的拒绝神经元和负责编码知识本身的概念神经元。

- 这项工作通过靶向单个神经元来抑制拒绝或从无害提示中放大有害内容,展示了双向的安全失败,且无需训练或提示工程。

- 跨越两个系列、参数规模从 1.7B 到 70B 的七个模型的实验表明,安全对齐由单个神经元介导,这些神经元在因果上足以门控拒绝行为。

引言

大型语言模型中的安全对齐通常被认为源于分布在网络各处的权重大规模重组。这一假设很重要,因为它意味着安全应能抵御局部扰动。然而,先前的工作仅识别出影响拒绝行为的分布式方向或神经元集合,而未隔离出单个因果单元。作者通过证明单个 MLP 神经元在因果上足以跨越七个参数规模从 1.7B 到 70B 的模型门控拒绝行为,对此提出了挑战。通过抑制特定的拒绝神经元,他们在无需训练或提示工程的情况下绕过了安全对齐。此外,他们表明放大单个概念神经元可以将有害内容注入无害提示,揭示了安全瓶颈存在于单个单元层面而非分布式系统。

数据集

-

数据集构成与来源 作者分析了源自 Qwen3 和 Meta-Llama-3.1 模型系列的神经元激活轨迹集合。数据来源包括规模从 17 亿到 700 亿参数模型的内部特征表示。数据集由特定的层和特征索引组成,并配对有触发高或低激活值的相应文本片段。

-

每个子集的关键细节

- 模型变体: 包括 Qwen3 (1.7B, 4B, 8B, 14B, 32B) 和 Meta-Llama-3.1 (8B-Instruct, 70B-Instruct)。

- 特征识别: 每个条目指定确切的层号和特征索引(例如,Layer 32, Feature 9115)。

- 激活极性: 子集分为顶部激活(最大正响应)和底部激活(最小负响应)。

- 内容类别: 片段涵盖安全违规、政治敏感性、显式色情内容、法律限制和对抗性行为。

-

论文如何使用数据 该研究利用这些轨迹来解释模型内的安全对齐和语义表示。分析不关注训练划分或混合比例,而是考察特定神经元如何编码与危害、政策和受限主题相关的概念。研究人员使用数据来识别负责检测自杀、仇恨言论、色情内容和规则规避的特征。

-

处理和构建细节

- 激活最大化: 文本片段基于每个特征的最高和最低激活分数进行选择。

- token 分析: 识别峰值 tokens 以表征每个神经元的语义焦点(例如,"suicide," "confederate," "pussy")。

- 上下文过滤: 精选片段以展示多样化的上下文,包括新闻文章、虚构对话和技术文档。

- 元数据构建: 每个条目包括模型名称、层深度、特征 ID 和激活幅度,以促进可重复性。

方法

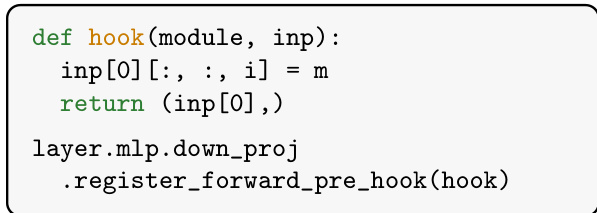

作者提出了一种方法,通过靶向 MLP 层内的特定神经元来识别和抑制语言模型中的拒绝行为。该过程始于特征选择阶段,在此阶段对一组有害和无害提示执行前向传递。对于每个监控层,在预下投影中间激活 h=ϕ(Wgate(x))⊙Wup(x)∈Rdtr 上注册一个 hook,其中每个标量坐标 hi 代表一个神经元。

为了对候选神经元进行排名,作者计算拒绝对数几率损失 L 关于 h 在指令后 token 位置的梯度。损失定义为:

L=−log1−prefusalprefusal其中 prefusal 代表模型特定拒绝短语上的总概率质量。排名分数结合了平均有符号梯度 Gi,t 以及有害和无害提示之间平均激活值的差异。如果一个神经元在有害输入上的激活显著多于无害输入,且梯度信号与此激活相反,表明抑制该神经元会减少拒绝,则该神经元被视为强有力的候选者。

在初始排名之后,执行重排名步骤以经验性地确定最佳干预参数。在验证集上使用乘数 m 扫描前 5 名候选者,以找到产生最高攻击成功率的配置。这导致了 Constant 干预,其中目标神经元的激活在所有 token 位置上被固定为常数值 m。

该干预的技术实现涉及在前向传递期间修改神经元的激活。如下面的代码片段所示,在 MLP 的 down_proj 层上注册了一个前向预 hook。该 hook 拦截输入张量,并在层计算其输出之前用常数值 m 覆盖特定的神经元索引 i:

为了缓解硬固定激活可能引起的连贯性问题,作者还引入了一种基于 Anchor 的干预。这种变体应用上下文敏感的缩放而不是固定值。它基于神经元在无 hook 前向传递期间的自然激活计算锚点值 v。然后,干预应用一种变换,将有害提示的激活推向最优常数 m∗,同时为无害提示保留接近零的激活,从而有效地根据输入上下文缩放干预。

实验

该研究使用标准基准和双评估器评估多个 Qwen3 和 Llama-3.1 模型的安全干预,以验证单神经元修改的有效性。实验表明,抑制单个拒绝神经元绕过安全对齐的效果与完整方向消融一样有效,同时显著保留了通用模型能力。进一步分析显示,这些神经元在基础模型中已经能够区分有害输入,表明对齐调节了预先存在的安全信号,而非从头创建。此外,放大特定的概念神经元可以从良性提示中诱导有害内容,证实了安全门控和有害知识都定位于单个神经元。

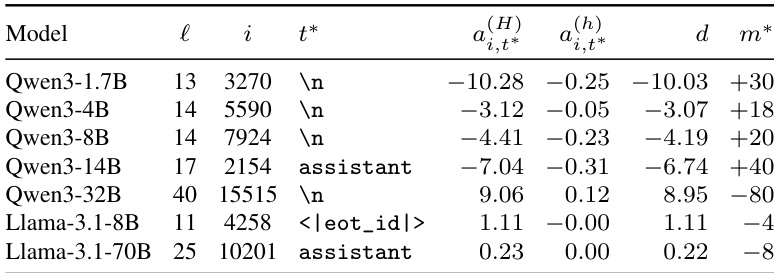

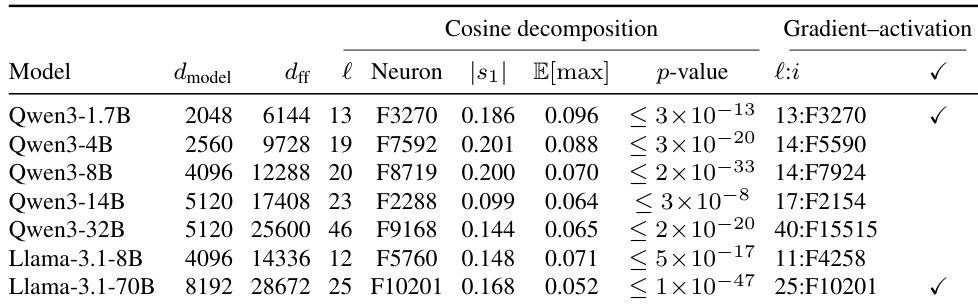

该表格记录了在七个模型中识别出的拒绝神经元的具体架构位置和激活指标。它记录了安全信号集中的层和神经元索引,以及有害和无害输入之间的激活差距。该数据使得计算中和这些拒绝机制所需的特定干预值成为可能。在 Qwen3 和 Llama-3.1 系列的每个测试模型中都识别出了特定的神经元。激活指标证实了有害和无害提示响应之间存在明显区别。为每个模型提供了干预乘数,以有效绕过拒绝行为。

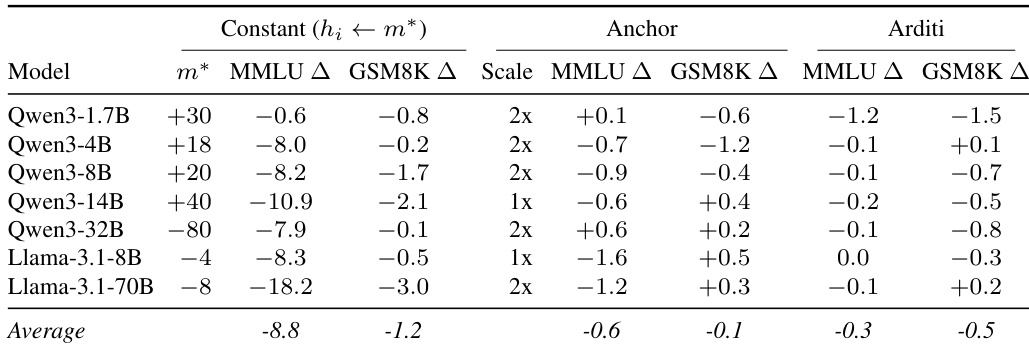

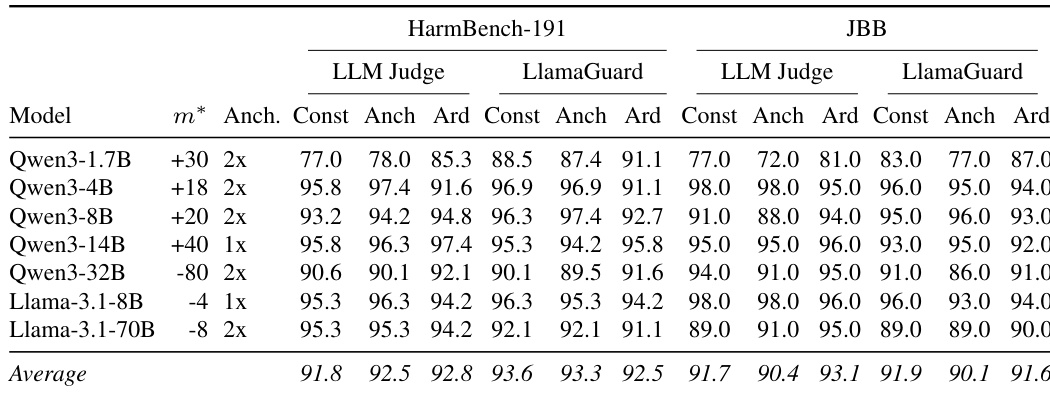

该研究比较了三种绕过安全拒绝的干预策略,发现虽然恒定激活偏移能有效绕过安全,但它会导致通用模型能力的实质性下降。相比之下,基于 Anchor 的干预实现了相当的攻击成功率,同时保留了与完整拒绝方向消融基线相似的 MMLU 和 GSM8K 基准效用。这表明 Anchor 方法在安全绕过和能力保留之间提供了更高效的权衡。恒定干预在各种模型规模下均导致显著的能力下降。Anchor 变体保持了高攻击成功率,而没有恒定方法中看到的严重效用损失。Anchor 方法的通用能力分数在所有测试模型中均与 Arditi 基线相当。

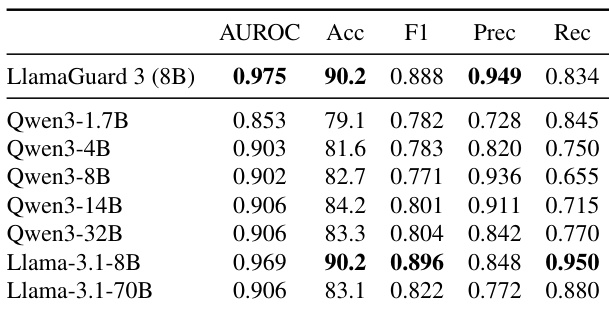

作者评估了单个拒绝神经元检测有害提示的能力,并将其与专用的安全分类器进行比较。结果表明,单个神经元可以达到分类器的准确率和 AUROC,同时为特定模型提供改进的召回率。Llama-3.1-8B 神经元匹配基线分类器的准确率,同时实现了更高的召回率。大多数模型表现出强大的区分能力,AUROC 分数持续较高。与专用分类器相比,单神经元检测器在 Llama-3.1-8B 模型上显示出较低的精确率。

作者将通过梯度激活识别的拒绝神经元与通过全局拒绝方向几何对齐发现的神经元进行比较。该表格显示,顶级余弦相似度神经元在所有模型中始终超过随机预期,具有极高的统计显著性。此外,在两个特定模型中,独立梯度方法选择了与顶级几何匹配完全相同的神经元,验证了这些单元的结构重要性。顶级神经元与拒绝方向之间的余弦相似度在所有模型中均具有统计显著性。对于 Qwen3-1.7B 和 Llama-3.1-70B,梯度激活和几何对齐方法收敛于同一个神经元。P 值表明观察到的对齐并非偶然,而是结构编码的。

作者使用两个独立评估器评估的三种干预策略,评估了七个指令微调模型的攻击成功率。结果表明,单神经元干预实现了与消融整个拒绝方向的基线方法相当的性能。这种高成功率在不同的模型系列和基准数据集中得以保持。单神经元方法实现了与完整方向消融基线相当的攻击成功率。在各种模型规模和评估指标上,性能始终保持较高水平。LLM 评估器和 LlamaGuard 均验证了干预策略的有效性。

本研究评估了七个指令微调模型中的拒绝神经元,以识别有效的安全干预策略和检测能力。基于 Anchor 的干预成功绕过了安全拒绝,同时比恒定激活偏移更好地保留了模型效用,实现了与完整方向消融基线相当的攻击成功率。此外,单个拒绝神经元在检测准确性上与专用分类器相匹配,并且基于梯度激活和几何对齐的识别方法收敛于结构重要的单元。