Command Palette

Search for a command to run...

技能1:基于强化学习的技能增强代理统一进化

技能1:基于强化学习的技能增强代理统一进化

Yaorui Shi Yuxin Chen Zhengxi Lu Yuchun Miao Shugui Liu Qi GU Xunliang Cai Xiang Wang An Zhang

摘要

持久化的技能库使语言模型 agent 能够在不同任务间复用成功的策略。维护此类技能库需要三种相互耦合的能力:agent 需选择相关技能,在执行过程中利用该技能,并从经验中提炼出新技能。现有方法往往孤立地优化这些能力,或使用独立的奖励信号进行训练,导致能力的演化呈现片面性甚至相互冲突。为此,我们提出了 Skill1 框架,该框架训练一个单一策略,使其在选择、利用和提炼技能方面协同演化,共同指向统一的任务结果目标。该策略首先生成查询以检索技能库,对候选技能进行重排序并选定其一,随后基于所选条件求解任务,并从执行轨迹中提炼出新技能。所有的学习均源自单一的任务结果信号:其低频趋势用于归因于技能选择,而其高频变化则用于归因于技能提炼。在 ALFWorld 和 WebShop 上的实验表明,Skill1 优于以往的基于技能的方法和强化学习基线。训练动态分析证实了这三种能力的协同演化,消融实验进一步显示,移除任何一项信用(credit)信号均会导致演化效果下降。

一句话总结

Skill1 是一个统一的强化学习框架,训练单一策略以实现技能选择、利用与蒸馏的共同演化,并面向共享的任务结果目标。该方法利用基于频率的信用分配机制,将低频趋势归因于选择,将高频变化归因于蒸馏,从而在 ALFWorld 和 WebShop 上超越先前的基线方法。

核心贡献

- Skill1 提出了一种统一框架,训练单一策略以实现技能选择、利用与蒸馏的共同演化,并面向共享的任务结果目标。该方法从单一信号中获取所有学习过程,将低频趋势归因于选择信用,将高频变化归因于蒸馏信用。

- 在 ALFWorld 和 WebShop 基准上的实验表明,该框架优于现有的基于技能的强化学习基线方法。

- 训练动态证实了三项能力的同步共同演化,而消融实验验证了移除任一信用信号均会导致整体学习过程性能下降。

引言

采用强化学习训练的大型语言模型 agent 通常将每次交互视为独立回合,导致任务结束后丢弃已验证的成功策略。为这些 agent 配备持久的技能库可解决该问题,通过启用可复用的知识迁移,显著提升复杂交互环境中的样本效率与长期适应能力。先前的方法通常将技能选择、利用与蒸馏作为割裂的阶段进行优化,或依赖碎片化的奖励信号。这种割裂会产生相互冲突的优化压力,导致关键能力发育不足,最终制约 agent 的演进。作者提出名为 Skill1 的统一强化学习框架,训练单一策略以同步共同演化上述三项能力。通过将单一的任务结果奖励分解为低频趋势与高频变化,该方法无需辅助信号即可为技能选择与蒸馏分配精确信用,推动技能全生命周期内的一致联合提升。

数据集

- 数据集构成与来源: 作者未引入或发布任何新数据集或爬取数据。该工作完全依赖现有开源资产,明确引用了 Owen2.5(采用 Apache 2.0 许可证分发)。

- 子集详情: 该流程未构建传统的训练子集,而是采用基于提示词(prompt)的评估与蒸馏组件。其中一个模块处理 WebShop 购物轨迹,生成包含任务成功标记、动作经验、导航经验及通用使用上下文的 JSON 结构记录。另一组件维护检索到的 agent 技能库,通过过滤历史交互,基于先前的环境反馈提取最优工具使用方式。

- 数据使用与处理: 作者利用这些提示词与技能记录来蒸馏推理模式并指导模型决策。提供的文档未指定正式的训练集划分或混合比例,因为该方法强调指令蒸馏与轨迹评估,而非大规模模型训练。

- 其他处理详情: 未应用裁剪策略或自定义元数据构建。数据处理侧重于为经验提取提供标准化 JSON 格式,并对历史 agent 交互进行上下文过滤,以确保相关技能的准确检索。

方法

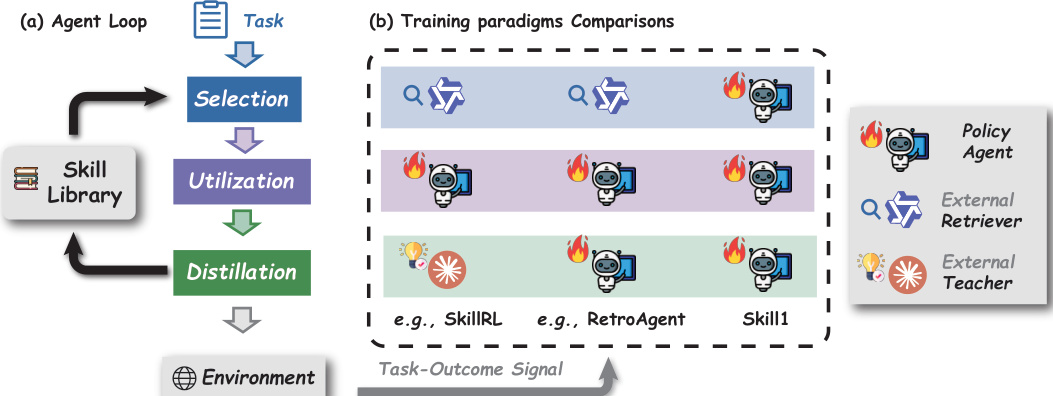

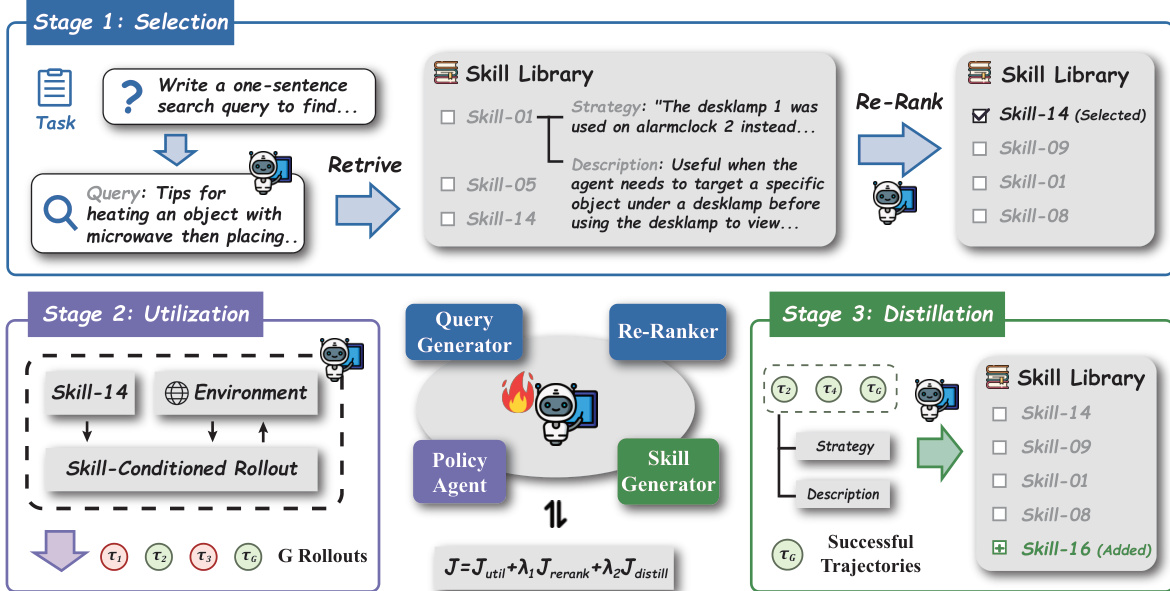

作者介绍了 Skill1,这是一个通过统一的任务结果目标训练单一策略 πθ 以实现技能选择、利用与蒸馏共同演化的框架。对于每个任务 x∼D,整体工作流程按顺序分为三个阶段:技能选择、技能利用与技能蒸馏,形成完整轨迹 τ=(q,z,a1,o1,…,aT,oT,snew)。该框架在部分可观测马尔可夫决策过程(POMDP)M 中运行,其中 agent 的状态 S 包含任务指令 x、环境状态 e 以及持久技能库 B。策略生成自然语言查询 q 以搜索技能库 B,随后由冻结编码器 E 检索得到前 K 个候选项 BK。策略随后对这些候选项重新排序,选择排名第一的技能 z 进行利用。在利用阶段,策略与环境进行最多 T 轮的交互,基于所选技能的策略 z.strat 生成动作-观测对。每次 rollout 结束后,策略会对轨迹进行反思以蒸馏出新技能 snew(包含策略与场景描述),仅当任务成功完成时才会将其加入库中。

参考框架示意图,该图展示了 agent 循环的三个核心阶段。选择阶段从任务开始,查询生成器生成搜索查询以从库中检索相关技能。检索到的技能由重排序器重新排序,排名第一的技能被选中用于利用。利用阶段涉及策略 agent 根据所选技能的策略与环境交互,生成多次 rollout。最后,蒸馏阶段涉及策略对成功轨迹进行反思以生成新技能,并将其添加至技能库。策略 agent 被描绘为核心组件,与外部检索器和外部教师交互,任务结果信号驱动所有三项能力的共同演化。

训练过程利用单一策略 πθ 生成轨迹的所有组件,包括选择查询、重排序排列、动作序列以及蒸馏后的技能。每个片段在单次梯度步中通过组相对策略优化(GRPO)进行联合优化,该方法计算相对于从同一任务采样的 rollout 组的优势值。利用奖励 Riutil 直接设置为任务结果 r(τi),为动作生成提供直接信号。选择过程通过两种机制进行优化:查询生成通过利用目标接收策略梯度,因为更优的查询能带来更高的任务结果;重排序则使用归一化折扣累积增益(NDCG)指标进行显式监督,奖励策略生成与检索技能效用排序一致的排列。每项技能的效用分数 U(s) 在每次 rollout 后通过指数移动平均更新,以捕捉其长期性能趋势。蒸馏奖励 Ridistill 源自当前结果相对于库趋势的变化,定义为 r(τi)−U^i,其中 U^i 是检索候选项中的最高趋势值。该信号鼓励策略蒸馏出能够超越现有库覆盖范围的技能。总优化目标结合这三个组件:I(θ)=Iutil(θ)+λ1Irerank(θ)+λ2Idistill(θ),并对利用与蒸馏奖励分别进行优势归一化。

如图所示,流程始于选择阶段,策略生成查询以从库中检索技能。检索到的技能随后被重排序,并选中排名第一的技能。该技能在利用阶段使用,策略在此阶段与环境交互并生成多次 rollout。蒸馏阶段涉及策略对成功轨迹进行反思以生成新技能,并将其添加至技能库。策略 agent 是核心组件,与外部检索器和外部教师交互,任务结果信号驱动所有三项能力的共同演化。该图展示了 agent 循环的三个阶段,突出了策略 agent、技能库与环境之间的交互。

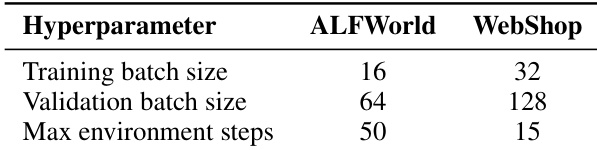

实验

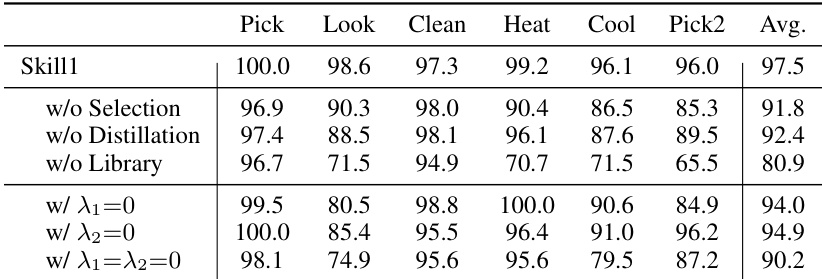

在 ALFWorld 和 WebShop 环境上的实验将提出的 Skill1 方法与免训练 agent 以及缺乏技能或以割裂方式优化技能管理的强化学习基线进行了基准测试。消融实验与共同演化分析证实,联合优化技能选择、利用与蒸馏会形成相互促进的循环,与孤立优化或仅优化参数的方法相比,显著提升了性能与训练稳定性。定性分析表明,该统一框架使 agent 能够生成更精确的选择查询,蒸馏出质量更高且更多样的策略,并有效利用可复用技能进行失败规避与错误修正。最终结果表明,显式且共同演化的技能库大幅增强了多步规划与执行能力,超越了隐式参数学习或静态技能管理所能达到的水平。

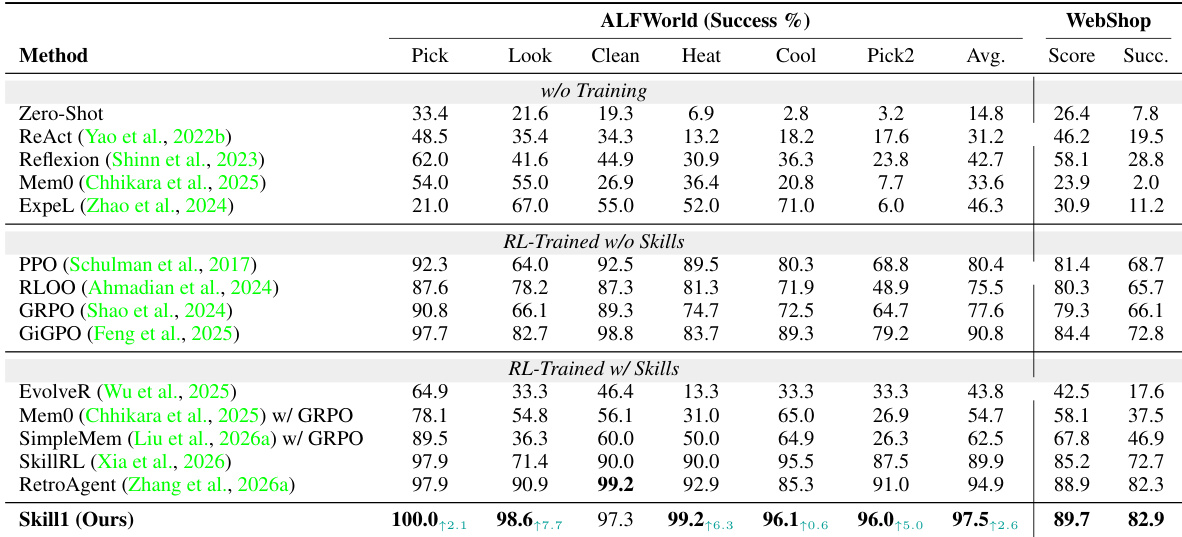

作者展示了在 ALFWorld 和 WebShop 两个环境上,将 Skill1 方法与多种基线进行对比的实验,重点考察成功率。Skill1 在两个环境中均取得最高性能,超越先前最优方法 RetroAgent,并证明了统一优化框架在共同演化技能选择、利用与蒸馏方面的优势。结果表明,显式技能库与所有阶段的联合优化对高性能与鲁棒性至关重要。Skill1 在 ALFWorld 和 WebShop 上均取得最高成功率,超越先前最优方法。性能提升归因于技能选择、利用与蒸馏的联合优化,该机制实现了跨阶段的相互促进。显式技能库不可或缺,移除它会导致性能显著下降,尤其在需要多步规划的复杂任务中表现明显。

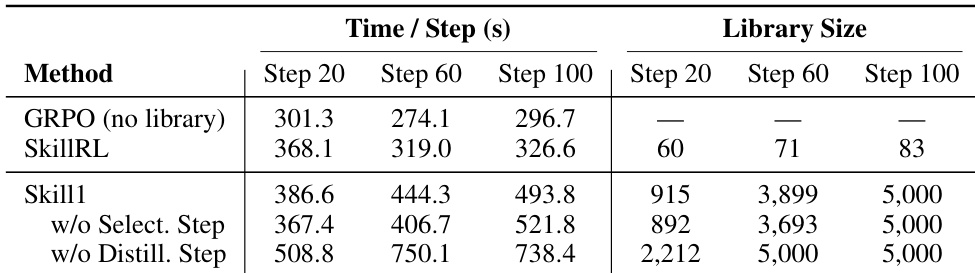

作者对比了 Skill1 与基线方法及消融实验的计算效率,重点关注每步实际耗时与训练步数中的技能库规模。结果表明,由于库上下文持续增长,Skill1 的计算成本高于 GRPO,在同时禁用选择与蒸馏时增幅最大。缺乏蒸馏会导致技能库规模迅速膨胀,引发显著的性能延迟。Skill1 通过蒸馏机制维持受控的库规模,平衡了性能与效率。Skill1 的计算成本高于 GRPO,原因在于库上下文的增长,且在同时禁用选择与蒸馏时增幅最大。缺失蒸馏会导致库规模快速膨胀,引发严重延迟并提前达到技能容量上限。Skill1 借助蒸馏控制库规模,兼顾了性能与计算效率。

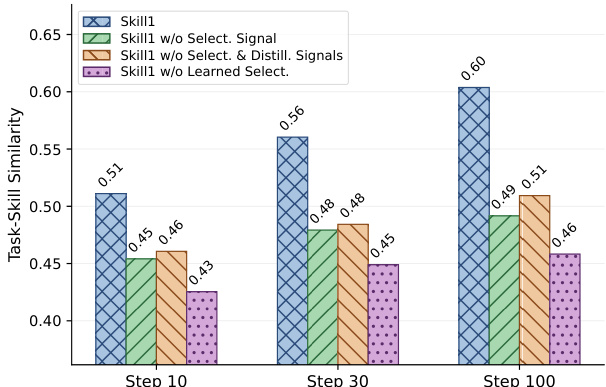

作者通过跟踪训练步数中的任务-技能相似度,分析了框架内技能选择、利用与蒸馏的共同演化。结果表明,完整系统在相似度上优于移除选择或蒸馏信号的消融实验,说明统一训练提升了策略生成精确选择查询的能力。该趋势表明三项能力之间存在相互促进关系,某一阶段的改进会加速其他阶段的进展。完整系统实现的任务-技能相似度高于移除选择或蒸馏信号的消融实验。任务-技能相似度随时间推移而增加,完整系统表现出最显著的改善。移除选择信号会减缓精确选择查询的学习速度,而移除蒸馏信号则会降低技能检索的有效性。

作者评估了 Skill1 在 ALFWorld 和 WebShop 两个环境上的表现,并与多种基线进行对比,包括免训练 agent、无技能的 RL 训练方法以及带技能的 RL 训练方法。Skill1 在两个环境中均取得最高性能,尤其在需要多步规划与对象交互的任务中表现突出。结果表明,针对技能选择、利用与蒸馏的统一优化框架,相较于分别优化这些组件或完全不优化的方法,能带来更优越的性能。Skill1 在 ALFWorld 和 WebShop 上均取得最高成功率,超越所有基线方法。引入技能库显著提升了性能,在需要多步子程序组合的任务中增益最大。技能选择、利用与蒸馏的联合优化带来了更好的性能,优于分别优化这些阶段或遗留生命周期部分未优化的方法。

作者评估了 Skill1 在两个环境上的表现,并与多种基线进行对比。结果表明,Skill1 取得最高的整体性能,尤其在需要多步规划与对象交互的任务中表现突出。消融实验证实,技能库以及选择与蒸馏的统一优化对实现高性能与高效技能管理至关重要。与所有基线相比,Skill1 在所有任务与环境中均取得最高成功率。技能库对性能不可或缺,移除它会导致成功率出现最大幅度的下降。选择与蒸馏的联合优化带来了更快的收敛速度与更优的技能管理,优于分别优化这些阶段或完全不优化的方法。

在 ALFWorld 和 WebShop 环境上针对多种基线的评估实验验证了 Skill1 在保持计算效率的同时实现了更优的任务成功率。消融实验与共同演化跟踪表明,显式维护技能库并联合优化技能选择、利用与蒸馏对于稳健性能至关重要,尤其在复杂的多步规划场景中。结果证实,该统一框架促进了所有阶段的相互促进,实现了精确的查询生成与高效的知识蒸馏,且未产生过高的计算开销。