Command Palette

Search for a command to run...

RLDX-1 技术报告

RLDX-1 技术报告

摘要

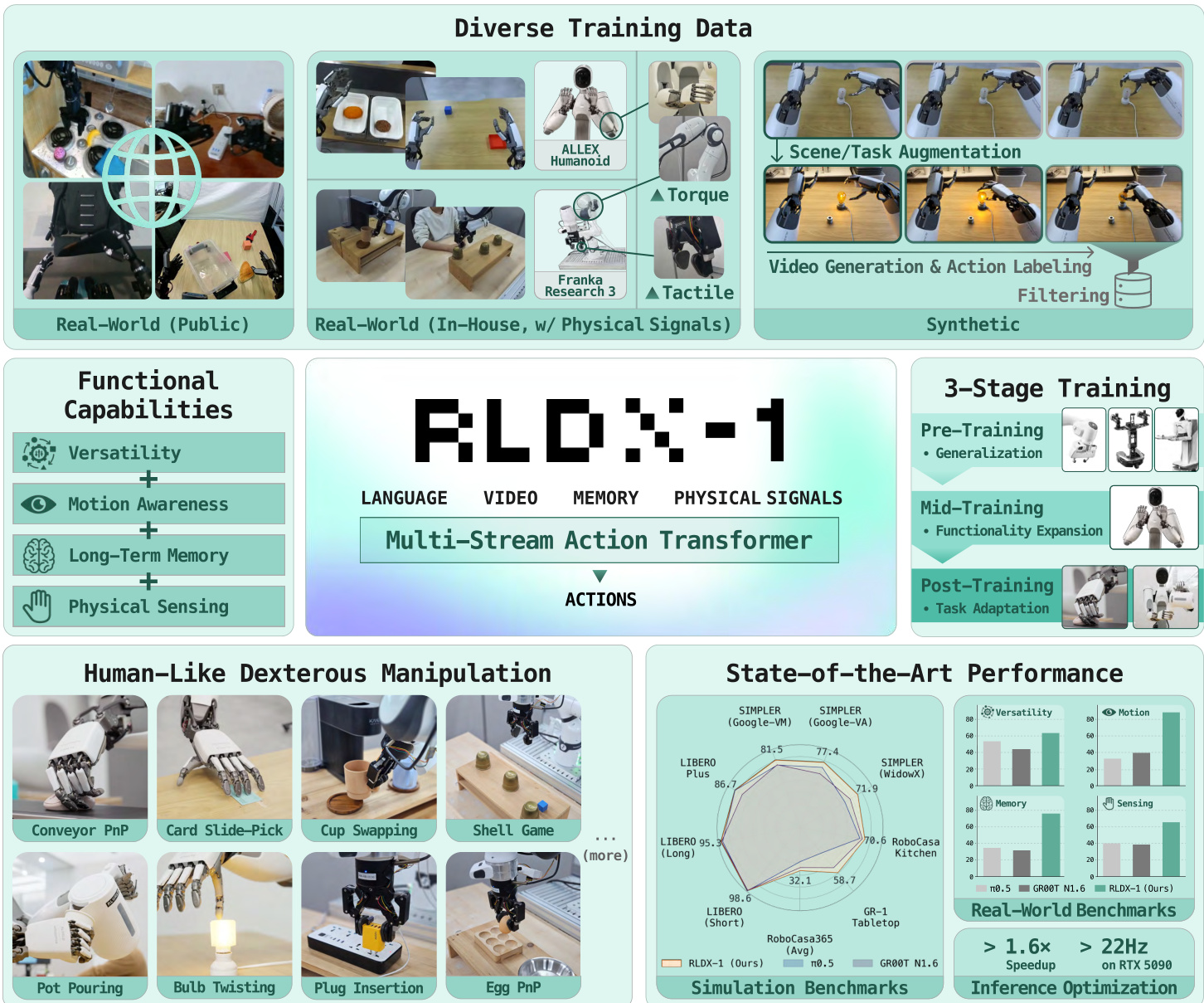

尽管视觉-语言-动作模型(Vision-Language-Action models, VLAs)通过继承预训练视觉-语言模型的通用智能(即广泛的场景理解和基于语言条件的泛化能力),在迈向类人通用机器人策略方面取得了显著进展,但它们仍难以应对需要更广泛功能能力的复杂现实世界任务(例如运动感知、记忆感知决策以及物理传感)。为解决这一挑战,我们引入了 RLDX-1,这是一种基于多流动作Transformer(Multi-Stream Action Transformer, MSAT)架构构建的用于灵巧操作通用机器人策略。MSAT 通过模态特定流与跨模态联合自注意力机制,整合异构模态,从而统一了上述能力。RLDX-1 进一步将该架构与系统级设计选择相结合,包括为罕见操作场景合成训练数据、学习专为类人操作定制的流程,以及针对实时部署进行的推理优化。通过实证评估,我们表明,在不仅需要通用泛化能力、更要求广泛功能能力的模拟基准和真实世界任务中,RLDX-1 持续优于近期领先的 VLA 模型(例如 π0.5 和 GR00T N1.6)。特别是在 ALLEX 人形机器人任务中,RLDX-1 表现出显著优势,成功率达到 86.8%,而 π0.5 和 GR00T N1.6 的成功率仅为 40% 左右,这突显了 RLDX-1 在多样化功能需求下控制高自由度人形机器人的能力。综上所述,这些结果将 RLDX-1 定位为迈向适用于复杂、高接触性及动态现实环境中灵巧操作的可信 VLA 的重要一步。

一句话总结

本技术报告介绍了 RLDX-1,这是一种视觉-语言-动作(VLA)模型,集成了多种功能能力,以实现真实世界部署中的灵巧操作。

核心贡献

- 提出 RLDX-1,一种将运动感知、长期记忆和物理传感统一为单一端到端策略的视觉-语言-动作模型,用于处理复杂的灵巧操作。

- 提出一种合成数据框架,生成带有动作标注的视觉逼真机器人视频。尽管缺乏显式的扭矩信号,该数据仍能有效扩充真实世界的扭矩标注数据。

- 通过在 ALLEX 人形机器人上进行真实世界部署来验证该框架,展示了在倒水、拧灯泡等接触密集型任务中的可靠执行能力。

引言

视觉-语言-动作模型已成为开发通用机器人策略的前沿框架,该策略利用了预训练视觉-语言模型广泛的环境理解能力和语言条件控制能力。尽管这些系统在多功能任务泛化方面表现优异,但在需要运动感知、长期记忆和物理感知的复杂真实环境中,它们始终面临挑战。为弥补这一差距,本文提出 RLDX-1,这是一种基于多流动作变换器(Multi-Stream Action Transformer)架构的统一机器人策略。该策略利用特定模态的流与跨模态注意力机制相结合,在单一端到端模型中同时处理时间动态、历史上下文和触觉反馈。此外,该架构还辅以针对罕见操作场景的合成数据流水线、专用的三阶段训练方案以及实现实时控制的推理优化措施。因此,在仿真基准测试和接触密集的真实世界人形机器人任务中,RLDX-1 的成功率均显著高于现有前沿模型。

数据集

数据集构成与来源

- 研究团队结合真实世界与合成机器人数据,构建了一个覆盖单臂机械夹爪、双臂系统及具备灵巧手的人形机器人平台的多具身训练语料库。

- 真实数据源包括广泛采用的公开基准测试,以及在触觉增强型 Franka Research 3 和 ALLEX 人形机器人平台上收集的两组内部数据集。

- 合成数据用于补充难以通过直接物理采集进行规模化的专用操作场景。

各子集关键细节

- Open-X-Embodiment 提供了精心整理的二十种具身形态数据混合体,包含超过一百万条轨迹。

- DROID 提供了来自 Franka Research 3 平台的 92,000 条野外采集轨迹。

- Galaxea Open-World 提供了 100,000 条带有子任务级语言标注的双臂轨迹。

- Agibot World 的数据经过采样精简至 275,000 个片段,专注于手部操作。

- Fourier ActionNet 和 Humanoid Everyday 分别提供 30,000 条和 10,300 条轨迹,涵盖双臂操作与人形交互任务。

- 内部 Franka 系统通过 VR 遥操作记录关节扭矩与触觉反馈,而 ALLEX 数据集则利用多设备 VR 追踪与电流到扭矩的估算,捕捉完整的上肢灵巧控制数据。

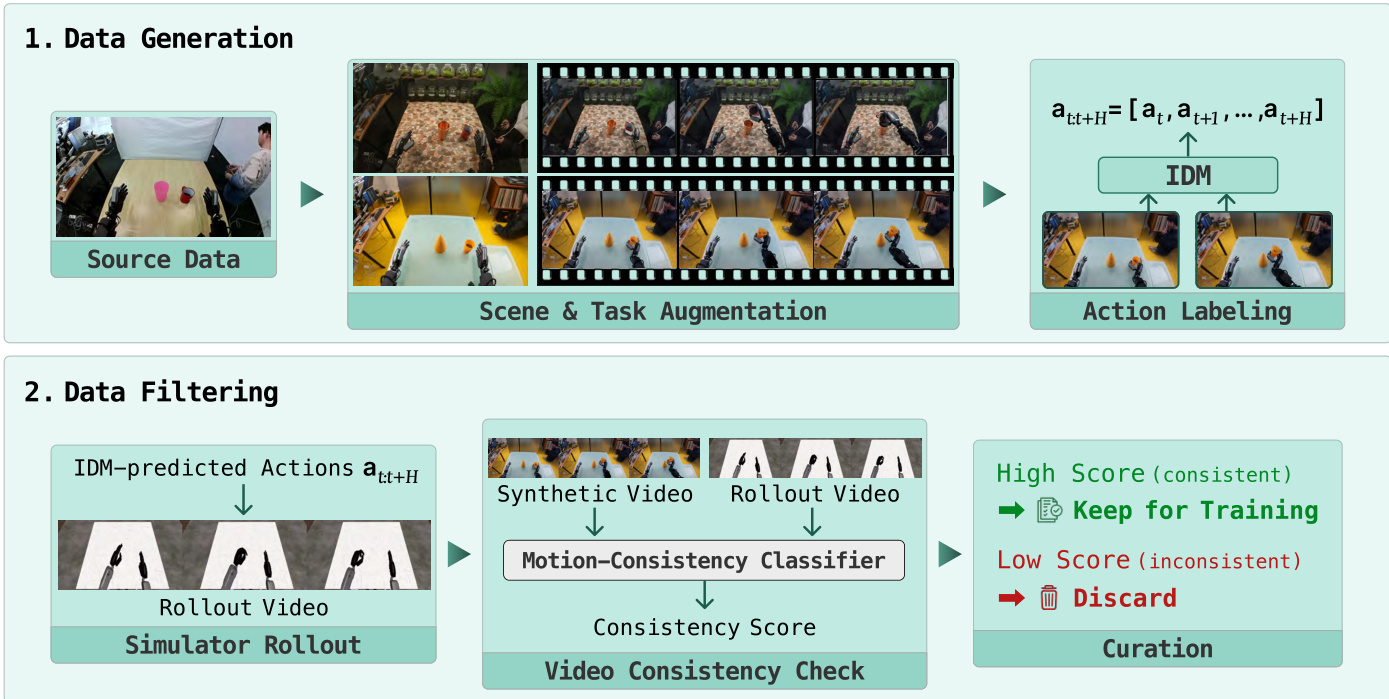

- 合成子集源自公开的 GR-1 演示数据和内部 ALLEX 演示数据,通过任务与场景增强进行扩展,并使用评估视觉合理性与动作一致性的两阶段流水线进行过滤。

数据使用与训练策略

- 研究团队在所有真实与合成子集的异构混合数据上对模型进行预训练,通过流匹配目标学习具身无关的操作策略。

- 为解决人形机器人数据稀缺问题,将 150,000 个合成 GR-1 片段整合至预训练语料库中。

- 中期训练按目标平台划分数据:Franka 平台结合内部数据集与 DROID 数据,ALLEX 平台则搭配内部数据与合成生成数据。

- 团队使用各数据集的第 1 和第 99 百分位数,将本体感觉状态与动作归一化至 [-1, 1] 范围。

- 模型以固定的时间偏移处理四帧图像,并将批次数据路由至具身特定层与共享的具身无关投影层。

预处理、裁剪与元数据构建

- 研究团队应用统一的视觉流水线,将所有输入帧调整大小以适配 256×256 像素的预算限制,同时严格保留原始宽高比。

- 通过采用原生分辨率视觉编码器,模型动态将维度缩放至 32 的倍数,并将每帧的视觉 token 数量限制在 64 以内,从而避免裁剪或填充操作。

- 合成动作标签通过逆动力学模型离线生成,该模型根据连续观测序列预测动作序列。

- 增强视频的指令通过视觉语言模型合成,采用分解式组合与技能原语条件控制。

- 过滤流水线首先利用视觉语言模型对指令对齐度和空间合理性进行评分,随后在物理仿真器中重放预测动作,通过轻量级视频编码器探针验证运动一致性。

方法

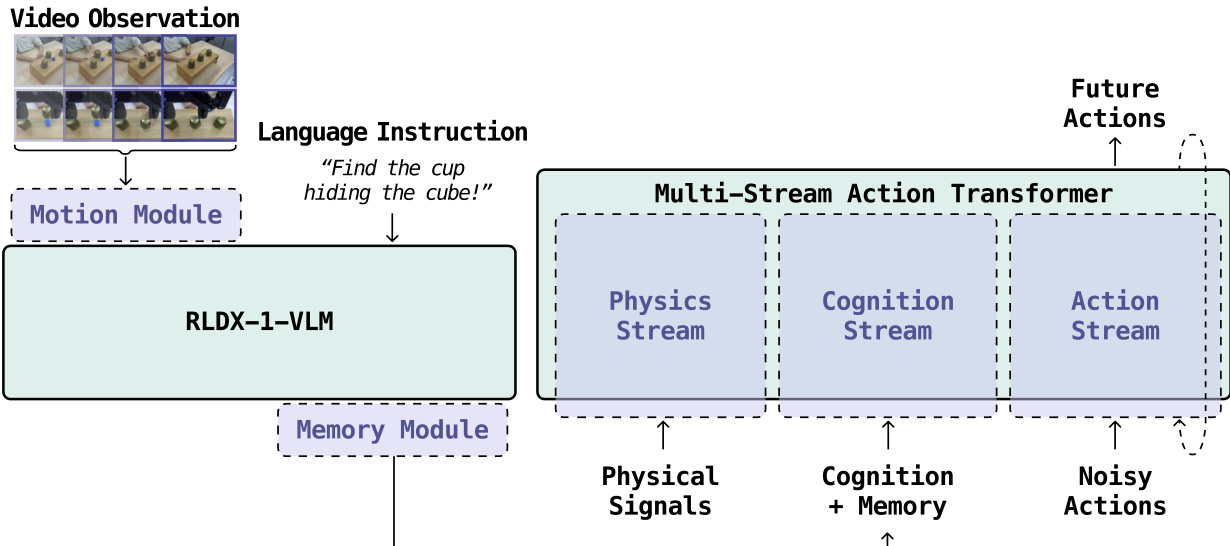

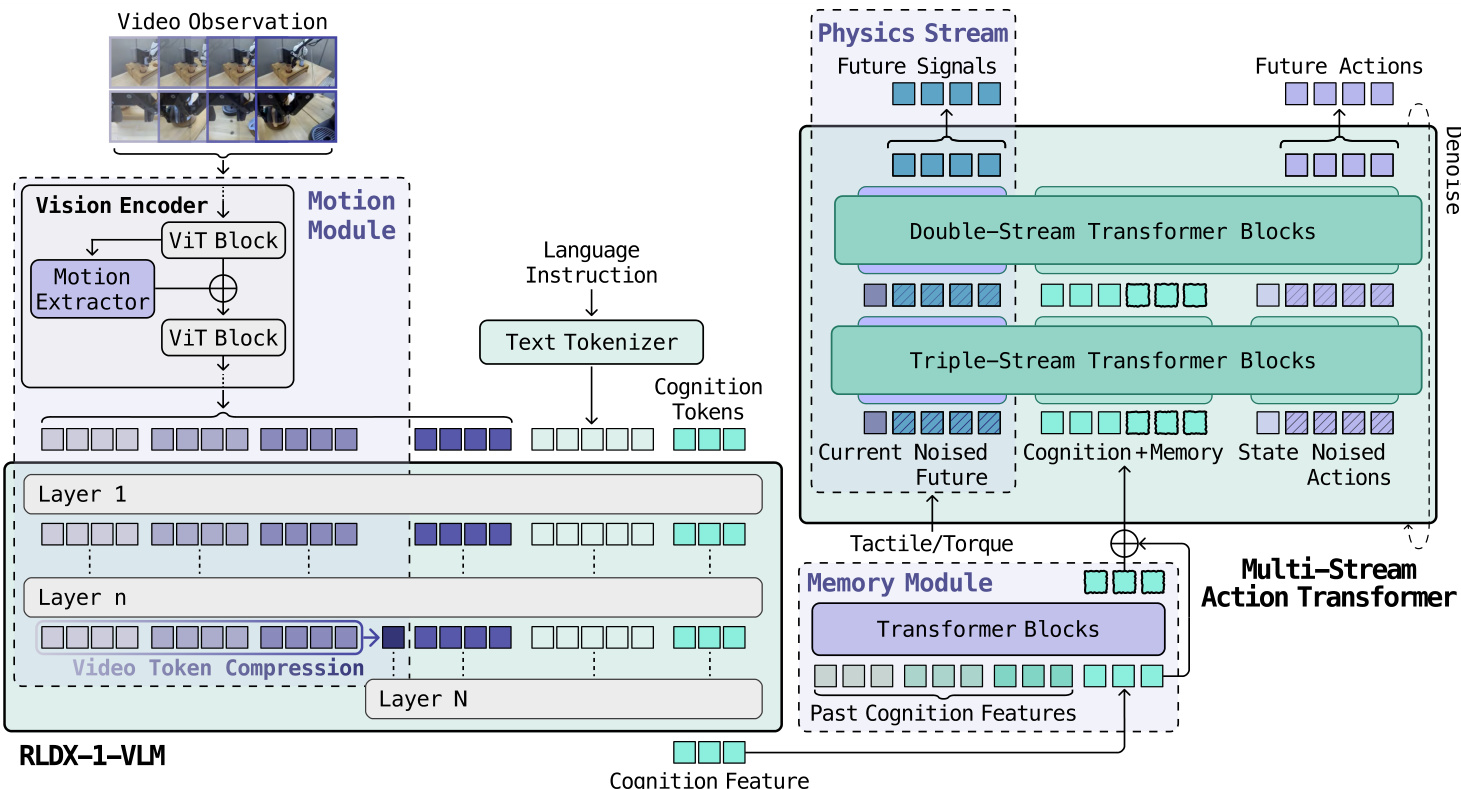

RLDX-1 模型架构旨在整合视觉、语言与动作能力,以支持真实世界机器人操作中的灵巧控制。该架构包含两个核心组件:视觉-语言模型(VLM)与多模态动作模型。VLM 处理多模态输入,包括 K+1 帧视频序列、语言指令和本体感觉状态,以生成具有历史感知能力的认知特征表示。该表示通过记忆模块与长期记忆特征进行增强,随后传递至动作模型。动作模型根据记忆增强后的认知特征、当前本体感觉状态以及可用的物理传感信号,生成 H+1 个未来动作序列。整体框架如下图所示。

视觉-语言模型(VLM)负责从输入数据中提取具有运动感知能力的视觉-语言表示。该过程首先通过视觉编码器处理视频观测数据,编码器包含 ViT 模块与运动提取器,用于捕捉时间动态变化。语言指令经过分词处理,并通过文本分词器进行处理。处理后的视觉与文本特征随后进行融合,并经过多层变换器处理,最终生成压缩的视频 token 表示。生成的认知特征被传递至记忆模块,该模块维护一个历史认知特征队列以实现长期记忆。记忆模块负责存储与检索这些特征,利用历史上下文增强当前认知特征。增强后的表示结合当前本体感觉状态与物理信号,共同输入至动作模型。

动作模型实现为流匹配扩散变换器(DiT),用于学习动作轨迹上的去噪速度场。训练过程中,通过采样去噪时间步 τ 并向干净动作块添加噪声 ϵ,构建带噪动作块。该动作模型参数化为神经向量场 uθ,训练目标是预测使带噪样本向干净动作块移动的速度。该目标通过流匹配损失函数实现,旨在最小化预测速度与真实速度之间的差异。推理阶段,模型采用欧拉法从随机噪声开始,经过多次去噪步骤生成动作块。

为处理输入数据(认知特征、本体感觉状态与物理传感信号)的异构特性,模型采用多流动作变换器(MSAT)架构。该架构通过专用流处理各模态,同时通过联合自注意力机制实现跨模态交互。在早期的双流块中,认知特征与带噪动作配对后通过认知流(C),本体感觉状态则通过动作流(A)进行处理。随后,这些流被合并为单一序列,供后续的单流块进行联合处理。当物理信号可用时,会引入额外的物理流(P),使模型能够整合触觉与扭矩反馈。这种可扩展设计在保留模态特定参数的同时,实现了跨模态信息交换。MSAT 架构进一步针对动作流引入了旋转位置编码以捕捉时间结构,为流匹配时间步添加了上下文内 token,并采用带 SwiGLU 激活函数的 RMSNorm 以提升性能。

物理感知能力通过物理模块集成,该模块将物理传感信号与认知流和动作流分离处理,并通过联合自注意力机制实现跨模态交互。该模块设计为在物理信号不可用时可被禁用,以确保灵活性。训练过程中,采用辅助目标预测未来物理信号,促使模型内化物理交互动态。动作模型对两个序列进行联合去噪:C 流中的带噪未来动作块与 P 流中的带噪未来物理信号,从而增强模型利用物理反馈生成动作的能力。

RLDX-1 的训练分为三个阶段:预训练、中期训练与后训练。在大规模多具身数据上的预训练使模型能够学习通用操作与时间理解能力。中期训练使模型适配特定具身形态,并引入长期记忆与物理感知等新能力。该阶段涉及在具身特定数据集上进行微调,以增强运动感知、长期记忆与物理感知能力。后训练阶段针对下游任务进一步微调模型,并可选择使用自适应数据收集或强化学习来提升挑战性灵巧操作任务的性能。三阶段训练流水线确保 RLDX-1 同时发展通用技能与专家级技能,使其适用于广泛的真实世界应用场景。

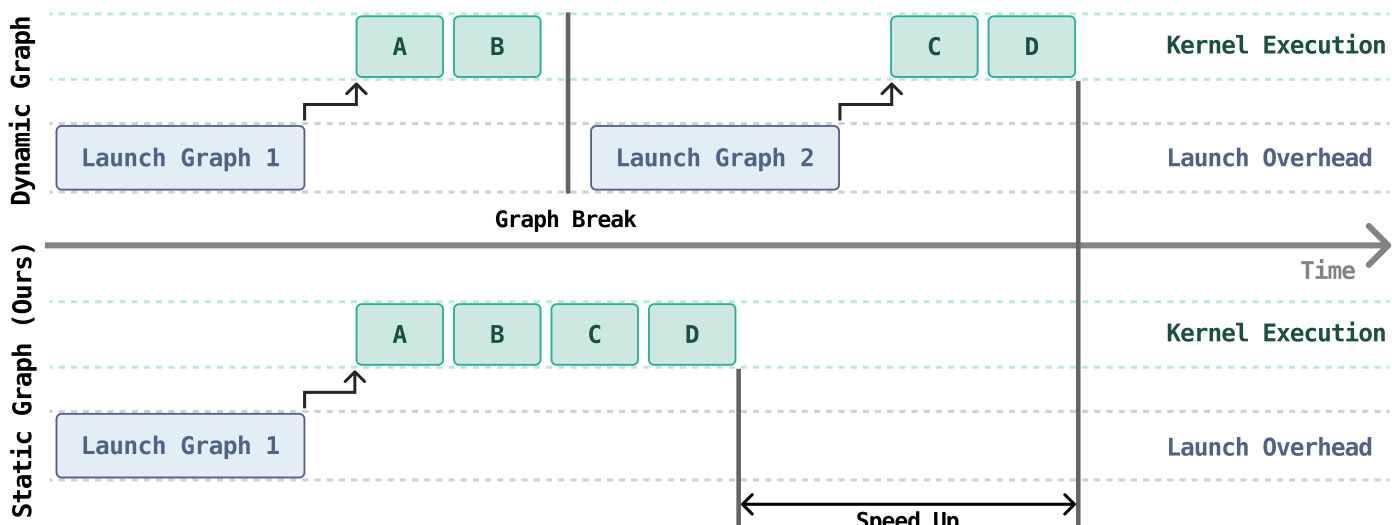

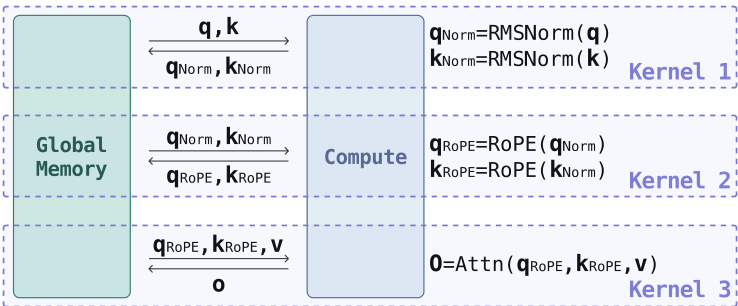

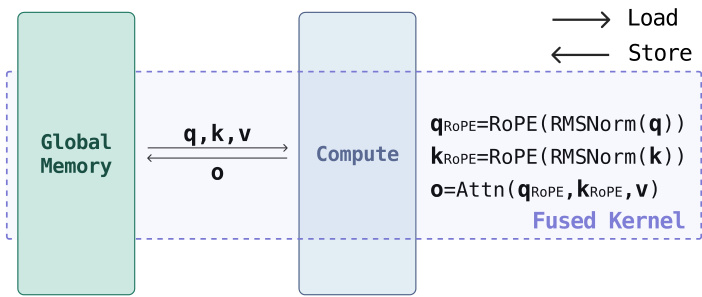

在推理阶段,模型采用优化流水线以降低延迟。该流水线包含图捕获优化与内核优化。图捕获优化通过将模型转换为静态图来消除内核启动开销,使前向传播能够被捕获为单个 CUDA 图。此举降低了动态图执行过程中产生的碎片化与启动开销。内核优化包含针对 RLDX-1 工作负载定制的手写内核,以更高效地协调数据移动与计算过程。这些优化对实时控制至关重要,因为它们确保模型能够足够快速地生成动作,以匹配机器人的闭环感知与执行周期。

实验

评估涵盖多个仿真基准测试与真实世界机器人平台,旨在验证 RLDX-1 的多功能智能与专用功能能力。在人形机器人与单臂系统上的测试表明,该模型成功应对了需要运动感知、长期记忆与物理感知的复杂场景,其表现持续超越通常在动态或接触密集环境中失效的现有视觉-语言-动作模型。互补的消融实验进一步证实,优化的特征提取、针对特定机器人的视觉适配以及可扩展的合成数据生成,均能显著提升策略泛化能力与任务特定性能。结合强化学习微调与推理优化,这些结果确认 RLDX-1 能够在多样化的操作环境中提供稳健的实时灵巧操作能力。

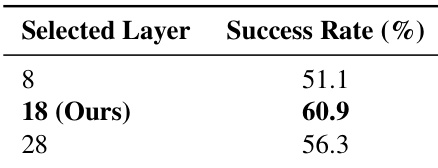

研究团队分析了在视觉-语言-动作模型中选择视觉-语言模型(VLM)不同层进行特征提取的影响。结果表明,使用中间层(具体为第 18 层)的特征可获得最高成功率,优于较早与较晚的层。这表明中间表示在动作生成的视觉接地与语义抽象之间提供了最佳平衡。相较于其他层级,第 18 层的特征提取取得了最优的成功率表现。选择 VLM 的中间层有助于在动作生成任务中更好地平衡视觉接地与语义抽象。第 8 层的特征导致成功率最低,第 28 层相较于第 8 层虽有适度提升,但仍不及第 18 层的表现。

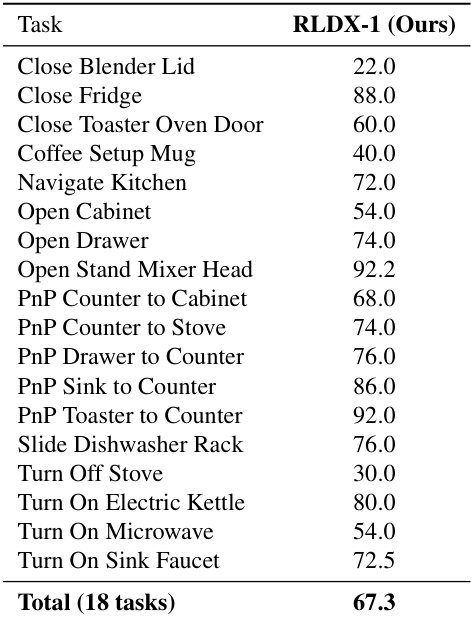

研究团队在 18 项厨房操作任务上评估了 RLDX-1 的性能,报告了每项任务的成功率及总体平均值。结果显示,RLDX-1 在这些任务上的总成功率为 67.3%,具体表现因所需操作类型而异。该模型在涉及物体操作与导航的任务中表现稳定,但在需要精确控制电器的任务中性能较低。在 18 项厨房操作任务中,RLDX-1 的整体成功率达到 67.3%。该模型在处理开抽屉及在表面间移动物体等涉及物体操作与导航的任务中表现良好。各任务间性能差异显著,需要精确控制电器的任务成功率相对较低。

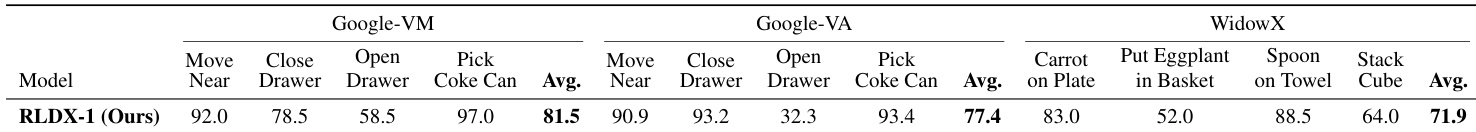

研究团队在 SIMPLER 基准测试上评估了 RLDX-1 的性能,并在多项任务中与基线模型进行对比。结果表明,在 Google-VM 和 Google-VA 子基准测试中,RLDX-1 取得了所有模型中最高的平均成功率,在“拿起可乐罐”和“关闭抽屉”等任务中表现尤为突出。RLDX-1 在 WidowX 基准测试中同样超越基线模型,展现出在不同机器人平台与任务类型上的一致优势。RLDX-1 在 Google-VM 与 Google-VA 子基准测试中均取得最高平均成功率。该模型在“拿起可乐罐”与“关闭抽屉”等高难度任务中展现出强劲性能。RLDX-1 在 WidowX 基准测试中领先于基线模型,表明其在不同机器人平台上均具备稳定的有效性。

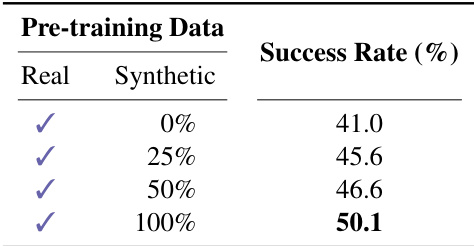

该表格展示了在预训练阶段使用不同比例合成数据训练的模型成功率,结果表明随着合成数据比例的增加,性能呈现提升趋势。结果表明,引入合成数据能够提升模型有效性,当预训练数据完全为合成数据时,成功率达到最高。预训练阶段合成数据占比越高,成功率随之上升。模型在 100% 合成数据条件下取得最优成功率。相较于仅使用真实数据,预训练阶段使用合成数据显著改善了模型性能。

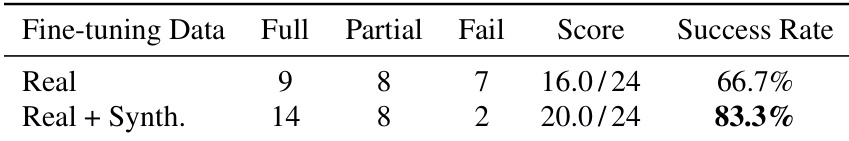

研究团队评估了合成数据对 RLDX-1 在“壶倒水入杯”任务中性能的影响,对比了仅使用真实数据微调与真实及合成数据混合微调的效果。结果表明,引入合成数据显著提升了整体成功率并减少了失败案例,显示出抓取任务中空间泛化能力与鲁棒性的增强。性能提升主要归功于完全成功次数的增加与失败次数的减少,表明合成数据有效扩充了训练分布。在“壶倒水入杯”任务中,引入合成数据使整体成功率从 66.7% 提升至 83.3%。性能增益源于失败案例的减少与完全成功次数的增加,进一步增强了空间泛化能力。合成数据有效扩充了训练分布,使模型在不同物体位置下均能表现出更稳健的抓取行为。

实验通过测试不同 VLM 层的特征提取、评估多样化厨房与基准操作任务的性能,以及衡量预训练与微调阶段合成数据的影响,全面检验了模型架构与训练策略。研究结果表明,VLM 的中间层在视觉接地与语义抽象之间提供了最佳平衡,且该模型在各类机器人平台与任务复杂度上均持续超越基线模型。此外,整合合成数据显著提升了整体性能与空间泛化能力,其中完全采用合成数据进行预训练取得了最稳健的结果。综合来看,这些结果证实,策略性的表示选择与合成数据增强对于开发高效且适应性强的视觉-语言-动作系统至关重要。