Command Palette

Search for a command to run...

HEAVYSKILL:作为代理驾驭中内在能力的深度思考

HEAVYSKILL:作为代理驾驭中内在能力的深度思考

摘要

近期,结合编排框架的 Agent 系统在协调拥有记忆、技能和工具使用能力的多个 Agent 方面取得了显著进展,并在复杂推理任务中表现出色。然而,真正驱动性能提升的底层机制仍隐匿在错综复杂的系统设计之后。在本文中,我们提出了 HEAVYSKILL 视角,该视角认为“深度思考”不仅是编排系统中的一个最小执行单元,更是一种内化于模型参数内部的内在技能,能够驱动编排器解决复杂任务。我们将这种技能识别为两阶段流水线:即并行推理随后进行总结,该机制可在任何 Agent 编排框架之下运行。我们对 HEAVYSKILL 在不同领域进行了系统的实证研究。结果表明,这种内在技能一致优于传统的 Best-of-N (BoN) 策略;值得注意的是,更强的 LLM 甚至能够逼近 Pass@N 的性能。关键在于,我们证明了作为可学习技能的深度思考的广度和深度可以通过强化学习进一步扩展,这为开发不依赖脆弱编排层、能够将复杂推理内化于自身的自我进化 LLM 提供了一条极具前景的路径。

一句话总结

作者提出了 HEAVYSKILL,这是一种将深度思考不仅视为最小执行单元,而是视为内化于模型参数中的内在技能的视角,并被识别为并行推理和总结的两阶段流程,通过系统实证研究表明其优于传统的 Best-of-N 策略,并允许更强的 LLM 接近 Pass@N 性能,同时通过强化学习进行扩展,为不依赖脆弱编排层的自演进 LLM 提供了一条路径。

核心贡献

- 本工作引入了 HEAVYSKILL,这是一个无需训练的框架,通过并行推理和顺序审议的两阶段流程为复杂推理任务重现深度思考。

- 跨多种模型规模和任务领域的全面实证研究确立了该方法的有效性,表明其始终优于传统的 Best-of-N 策略。

- 系统分析表明,来自可验证奖励的强化学习可以扩展深度思考的深度和宽度,以改善 Heavy-Mean@k 和 Pass@k 等推理指标。

引言

agent 驾驭技术的最新进展协调多个 agent 解决复杂推理任务,然而驱动此性能的机制仍被复杂的系统设计所掩盖。现有的并行推理方法通常依赖于静态调度或手工设计的启发式方法,缺乏适应性并严重依赖脆弱的编排层。为解决此问题,作者引入了 HEAVYSKILL,这是一种将深度思考视为内化于模型参数中的内在技能而非仅仅是一个执行单元的视角。他们提出了一个涉及并行推理后接顺序审议的两阶段流程,在任何 agent 驾驭层之下运行。系统实证研究表明,该方法始终优于传统的 Best-of-N 策略,并可通过强化学习扩展以改善推理深度和宽度,无需外部编排。

方法

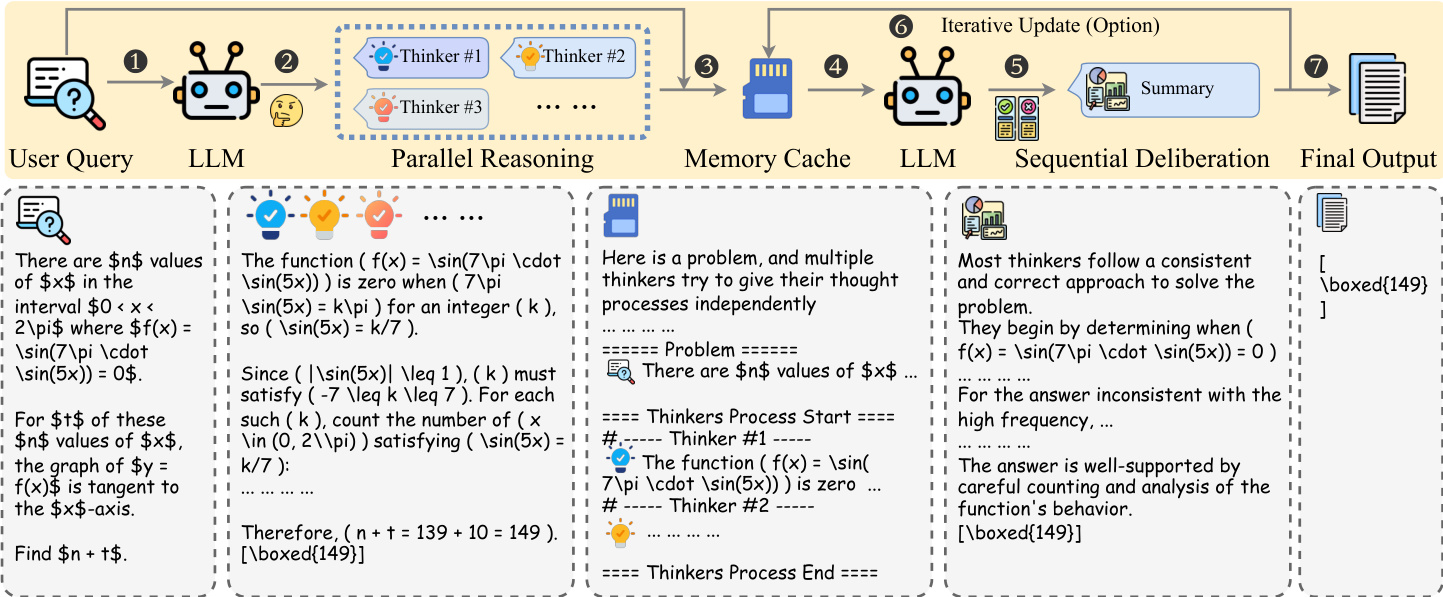

深度思考框架通过设计用于在测试时扩展推理能力的结构化推理流程运行。如下图所示,该架构将流程分解为两个不同的阶段:并行推理和顺序审议。

在第一阶段,并行推理中,系统旨在为给定问题 q 生成多个独立轨迹。形式上,模型 πθ 生成一组轨迹 Tπθ(q,K)={y1,⋯,yK},其中 K 代表并行 agents 的数量。每个轨迹 yi 都是自回归生成的。此阶段鼓励多样化的问题解决策略,而 agents 之间不共享上下文或查看彼此的工作。

为了促进过渡到下一阶段,该框架采用序列化内存缓存机制。由于完整的推理轨迹可能超出上下文限制,轨迹被修剪和打乱以创建序列化上下文 C(xc)。这确保后续模型不会发展位置偏差,并能在 token 约束内处理信息。

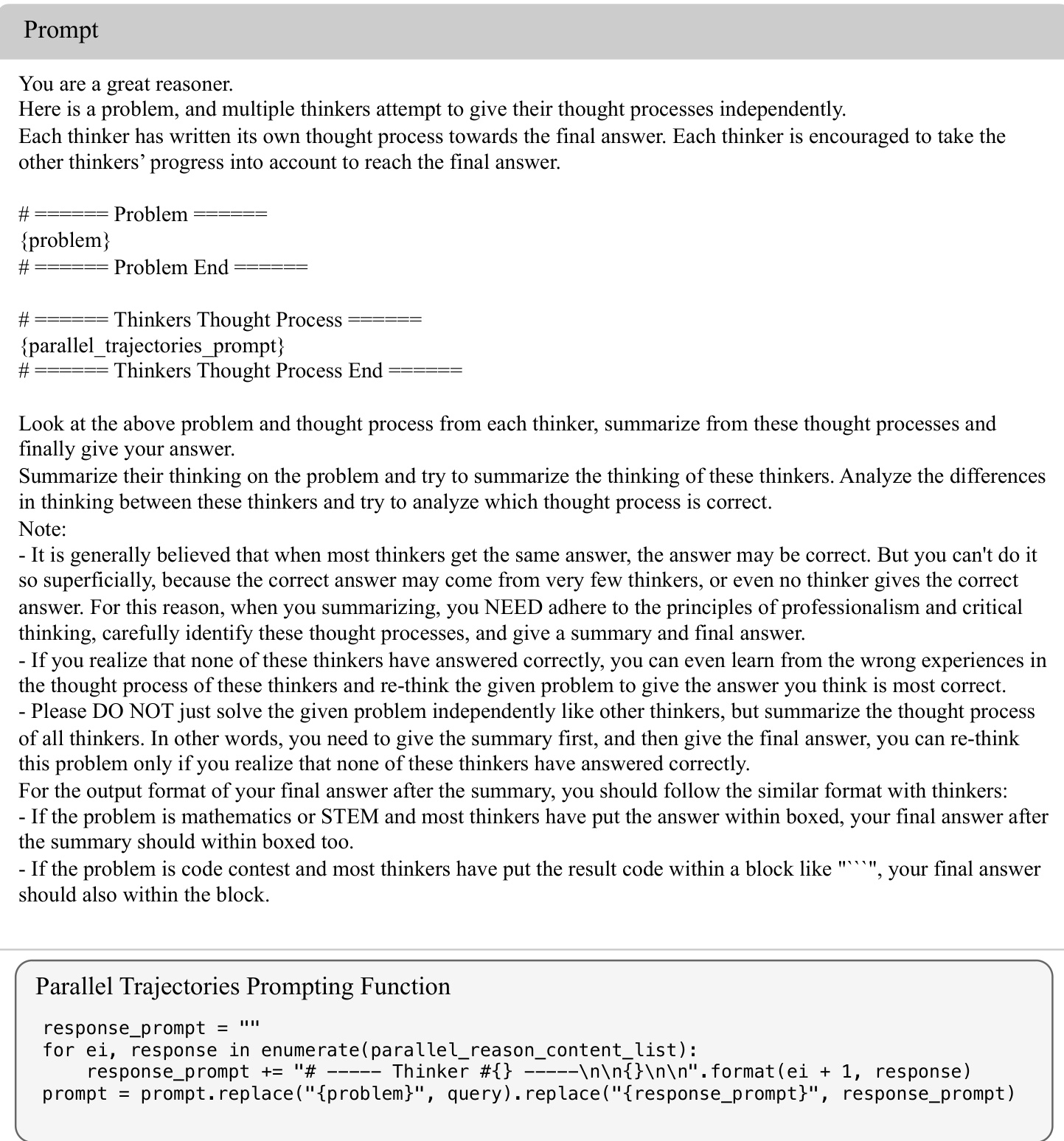

第二阶段,顺序审议,涉及一个单独的 LLM πϕ 聚合来自缓存的信息。该模型充当元推理器,负责综合独立的思维过程。用于此审议的提示结构如下图中所示。

审议提示明确指示模型分析每个思考者的推理质量,而不是依赖简单的多数投票。它要求模型识别逻辑错误,交叉验证方法,并应用专业怀疑态度。如果模型确定所有提供的轨迹都有缺陷,则指示其独立重新思考问题以得出正确答案。

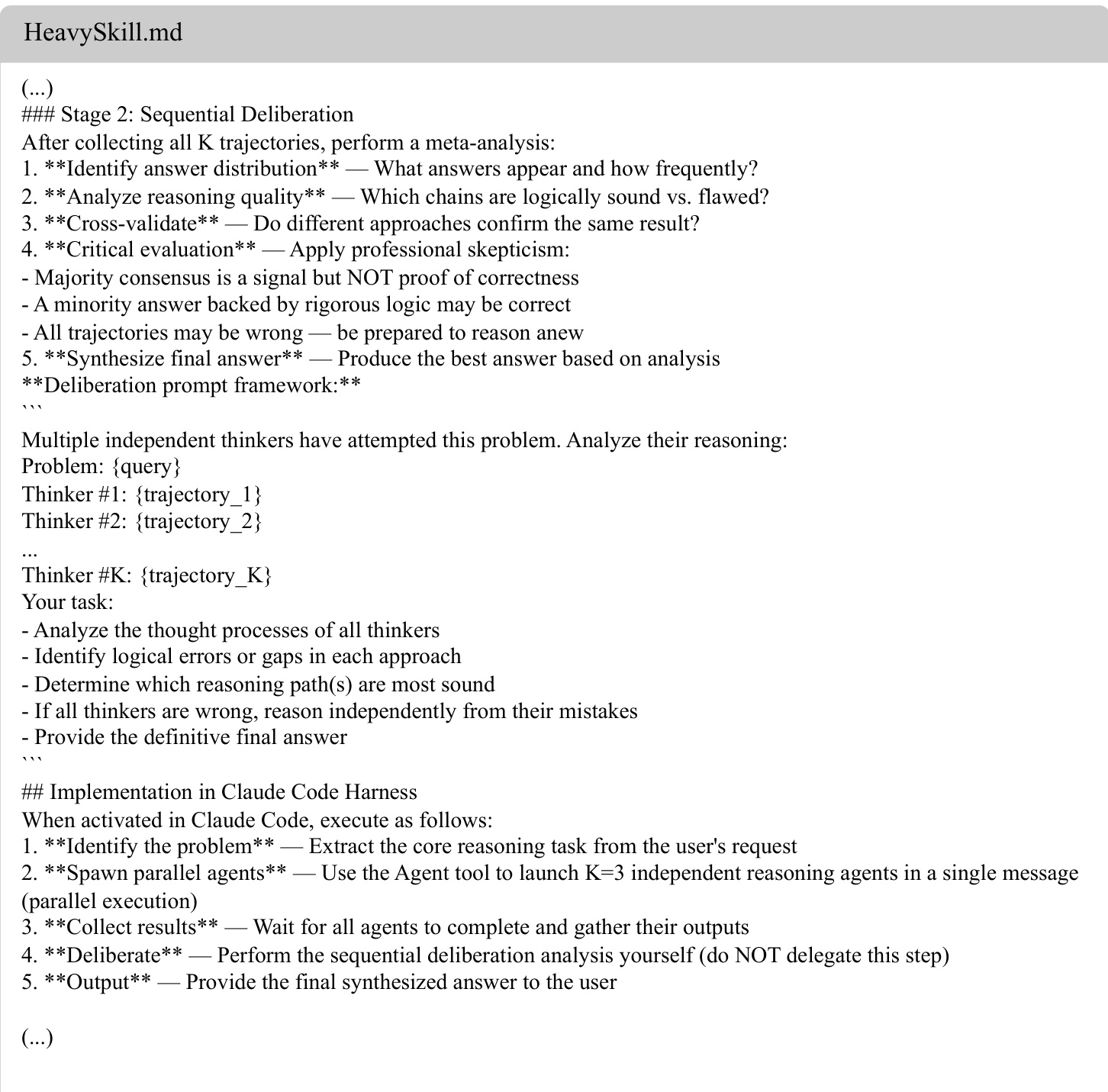

此工作流的实现在以下图片所示的可读技能文档中进一步详述。

该文档概述了编排器的具体协议,例如生成并行 agents 和管理审议过程。它强调最终输出应仅包含适当格式的综合答案(例如,数学问题加框),而不是元分析本身。

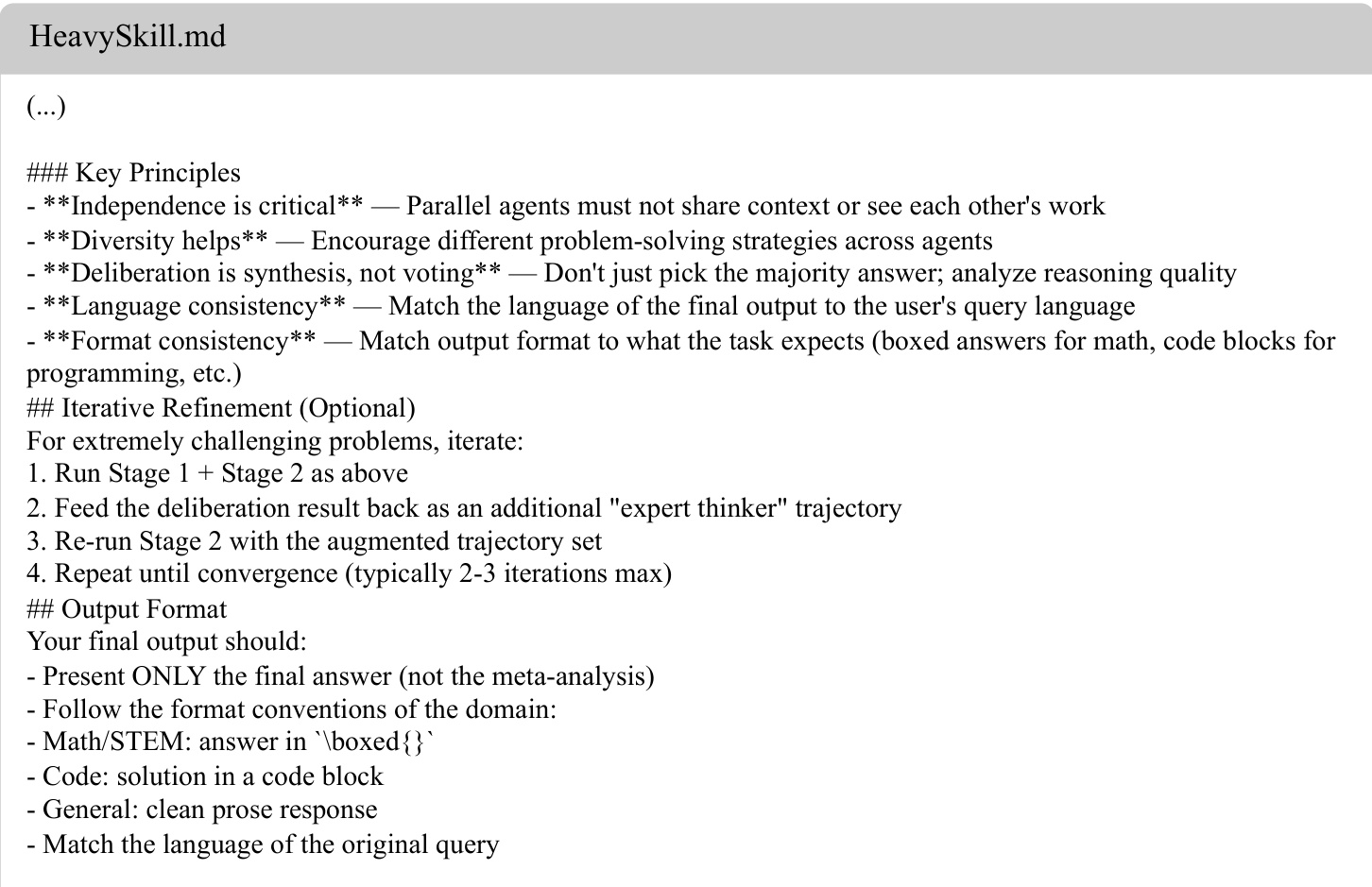

此外,技能定义包括有效执行的关键原则,如下图中所示。

这些原则规定并行 agents 保持独立,且审议侧重于综合而非投票。对于特别具有挑战性的问题,该框架支持可选的迭代细化循环。在此模式下,顺序审议的结果作为额外的专家轨迹反馈到内存缓存中,允许系统重新运行审议阶段直到达到收敛。

实验

评估利用了 STEM 和一般推理基准上的多种模型,将深度思考框架与标准基线(如多数投票)进行比较。实验验证了顺序审议始终优于单轨迹尝试,特别是在客观任务上,它综合出超越原始推理潜力的正确解决方案。虽然该框架展示了稳健的测试时扩展和与 agent 工具使用的兼容性,但发现表明迭代深度与信息一致性之间存在权衡,性能增益因任务主观性而异。

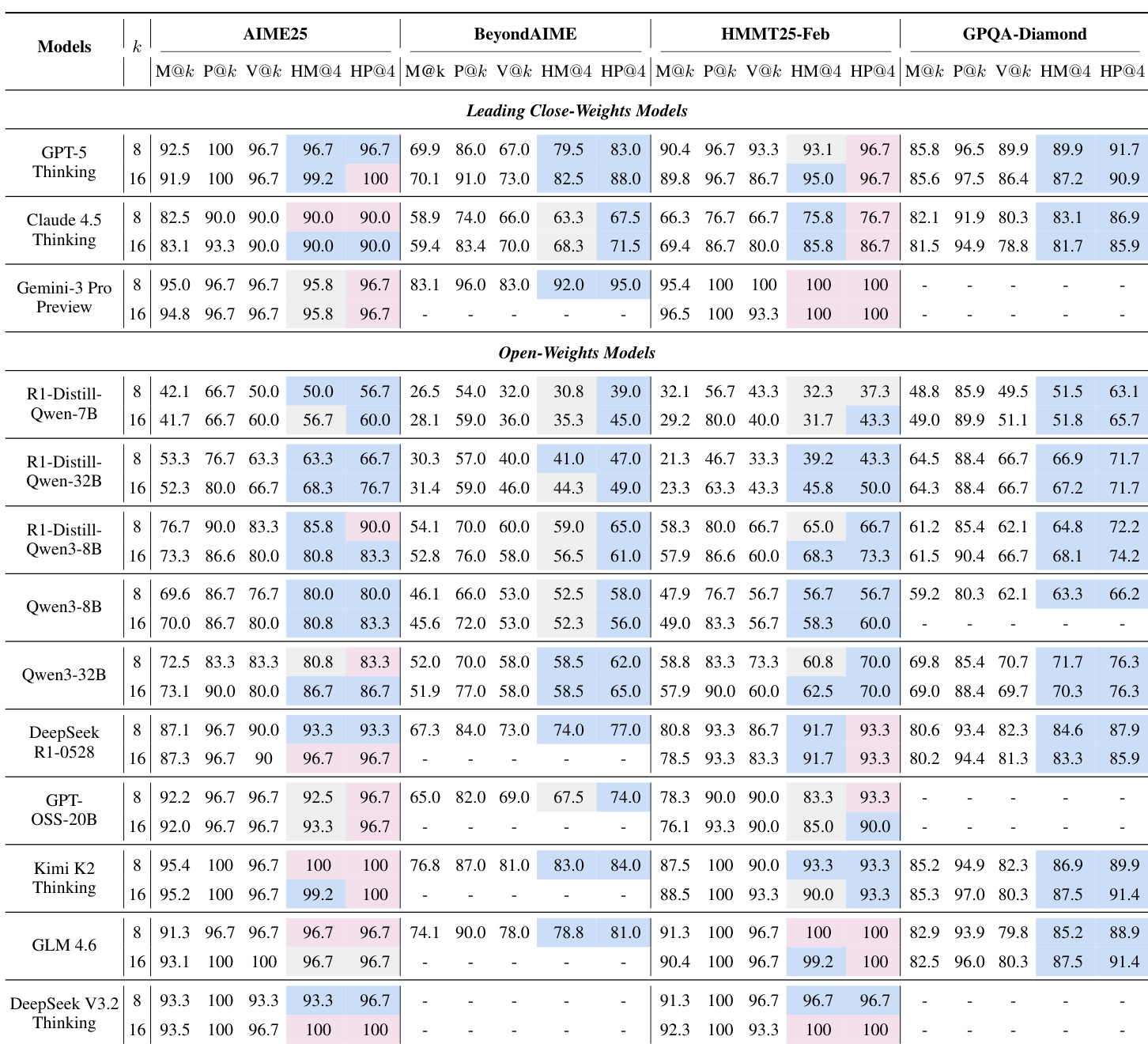

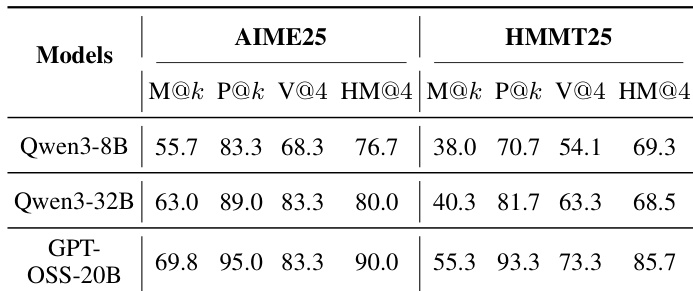

作者在各种 STEM 基准上使用闭源和开源权重模型评估了深度思考框架。结果表明,结合并行推理与顺序审议始终产生比标准指标(如平均准确率和多数投票)更高的性能。此外,该框架展示了接近或超过模型内在推理潜力的能力,特别是在复杂任务上。深度思考指标始终优于所有测试模型中并行轨迹的平均准确率。顺序审议被证明比启发式投票策略更有效,特别是在具有挑战性的基准上。审议过程的潜力通常匹配或超过并行采样的原始通过率,表明综合推理增益。

作者在 STEM 基准上评估了结合并行推理与顺序审议的深度思考框架。结果表明,深度思考指标始终超越多数投票和平均准确率等标准指标,证明了综合多条推理路径的有效性。此外,更大的模型实现了更高的性能,该框架帮助它们接近其理论推理极限。深度思考始终优于所有评估模型上的启发式多数投票策略。顺序推理提供了比并行推理轨迹平均准确率显著的提升。更大的模型表现出更优越的性能,深度思考分数接近原始轨迹的内在潜力。

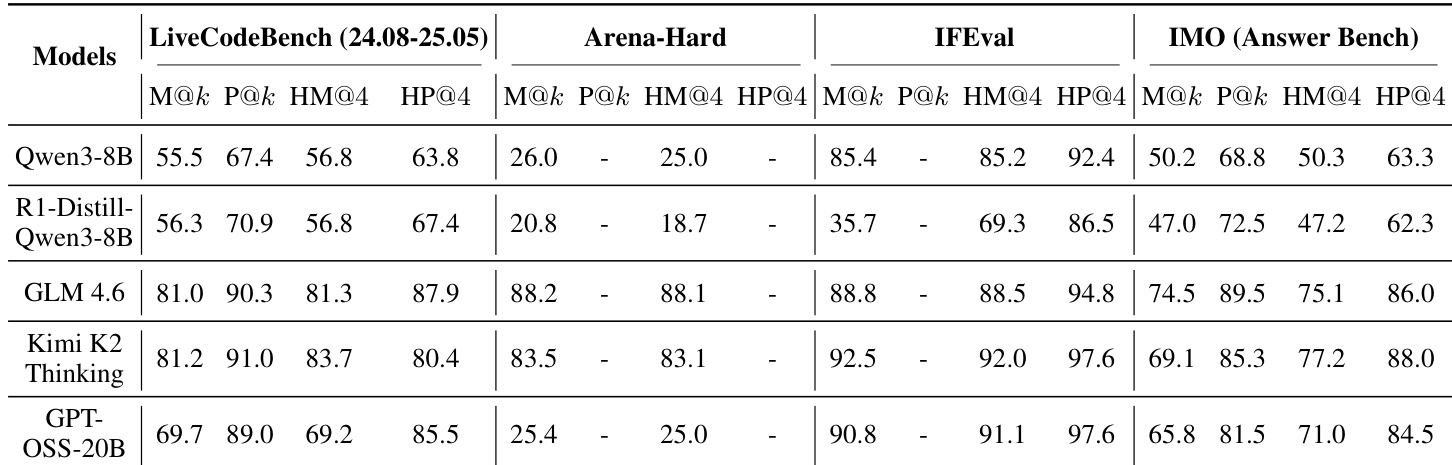

作者在各种模型和基准上评估了结合并行推理与顺序审议的深度思考框架。结果表明,这种方法在涉及编码和指令遵循的客观任务上产生了实质性改进,而在主观偏好对齐上显示出更有限的益处。此外,审议过程始终解锁比初始并行采样单独更高的性能潜力。顺序审议在 LiveCodeBench 和 IFEval 等客观基准上产生了实质性性能增益,优于标准并行推理。该框架在 Arena-Hard 等主观任务上提供边缘或不一致的改进,其中偏好对齐是关键。审议阶段始终实现比原始并行轨迹更高的潜在通过率,表明综合新正确解决方案的能力。

作者在包括 STEM、编码和指令遵循在内的多种模型和基准上评估了集成并行推理与顺序审议的深度思考框架。实验表明,顺序审议始终优于标准启发式投票策略,在客观任务上解锁了比单独并行采样更高的性能潜力。虽然更大的模型通过此方法接近其内在推理潜力,但该框架在主观偏好对齐基准上仅产生边缘改进。