Command Palette

Search for a command to run...

PRISM:面向多模态强化学习的黑盒在线蒸馏预对齐

PRISM:面向多模态强化学习的黑盒在线蒸馏预对齐

摘要

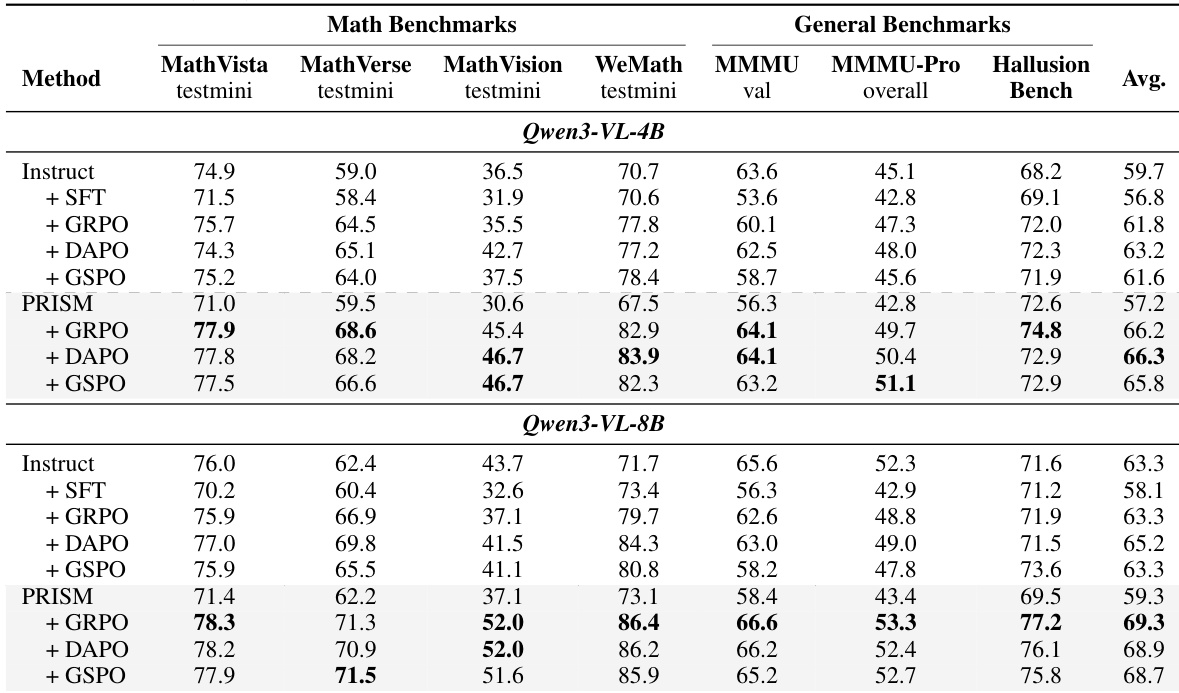

大型多模态模型(LMMs)的标准后训练流程通常包括在精心筛选的演示数据上进行监督微调(SFT),随后进行基于可验证奖励的强化学习(RLVR)。然而,SFT 会引入分布偏移(distributional drift),既无法保留模型的原有能力,也未能忠实地匹配监督分布。在涉及多模态推理的场景中,这一问题被进一步放大,因为感知错误和推理失败遵循不同的偏移模式,并在后续的 RL 过程中相互叠加。为此,我们提出了 PRISM,这是一种三阶段流水线,通过在 SFT 和 RLVR 之间插入显式的分布对齐阶段来缓解这种偏移。PRISM 基于策略内蒸馏(on-policy distillation, OPD)的原则,将对齐过程构建为一个黑盒、响应级别的对抗博弈,策略模型与一个包含专用感知和推理专家的混合专家(MoE)判别器进行博弈。该方法提供了解耦的修正信号,引导策略模型向监督分布靠拢,而无需访问教师模型的 logits。虽然 126 万条公开演示数据足以支持广泛的 SFT 初始化,但分布对齐需要更高保真度的监督信号;因此,我们从 Gemini 3 Flash 中筛选了 113,000 条额外演示数据,这些数据针对最难解的问题,具备密集的视觉定位(visual grounding)和逐步推理(step-by-step reasoning)特性。在 Qwen3-VL 上的实验表明,PRISM 在多种 RL 算法(GRPO、DAPO、GSPO)和不同的多模态基准测试中 consistently 提升了下游 RLVR 的性能。与仅使用 SFT 到 RLVR 的基线相比,4B 和 8B 模型的平均准确率分别提升了 4.4 和 6.0 个点。我们的代码、数据和模型检查点已公开在 https://github.com/XIAO4579/PRISM。

一句话总结

PRISM 是一个三阶段后训练流程,通过在监督微调与可验证奖励的强化学习之间插入黑盒在线策略蒸馏,缓解大型多模态模型中的分布漂移问题。该方法利用具有专用感知与推理专家的混合专家(MoE)判别器,在不依赖教师模型 logits 的情况下生成解耦的修正信号,从而实现稳健的多模态推理。

核心贡献

- 本文提出 PRISM,一种三阶段后训练流程,在监督微调与可验证奖励的强化学习之间插入显式的分布对齐阶段,以缓解大型多模态模型中的异构分布漂移。

- 该对齐机制以无 logits 的对抗博弈形式运行,其中配备专用视觉与推理模块的混合专家判别器提供解耦的修正信号,引导策略 rollout 向目标监督分布靠拢。

- 一个经过精心筛选的包含 113,000 个高保真演示的集合支持该对齐阶段,这些演示具备密集视觉定位与逐步推理能力。在 Qwen3-VL 上的广泛评估证实,该方法相较于标准流程能带来一致的性能提升,并显著缩小了微调后的分布差距。

引言

大型多模态模型通常依赖结合监督微调与强化学习的后训练流程来提升推理能力,然而这种标准方法面临关键的初始化挑战,限制了下游性能。先前的研究表明,监督微调往往会引发分布漂移,导致模型丧失原有的推理优势,同时无法准确匹配目标监督分布。这种性能退化在多模态场景中尤为严重,因为感知错误与推理失败遵循不同的模式,并在优化过程中相互叠加。为此,本文提出 PRISM,一种三阶段框架,在微调与强化学习之间插入显式的预对齐阶段,以便在策略优化开始前修复该漂移。该方法利用黑盒在线策略蒸馏,将其构建为策略与具有专用感知及推理专家的混合专家判别器之间的对抗博弈,从而在不依赖教师模型 logits 的情况下生成解耦的修正信号,引导模型向监督分布靠拢。该方法有效弥合了继承自监督微调的分布差距,在多种强化学习算法与模型规模下均实现了稳定的准确率提升。

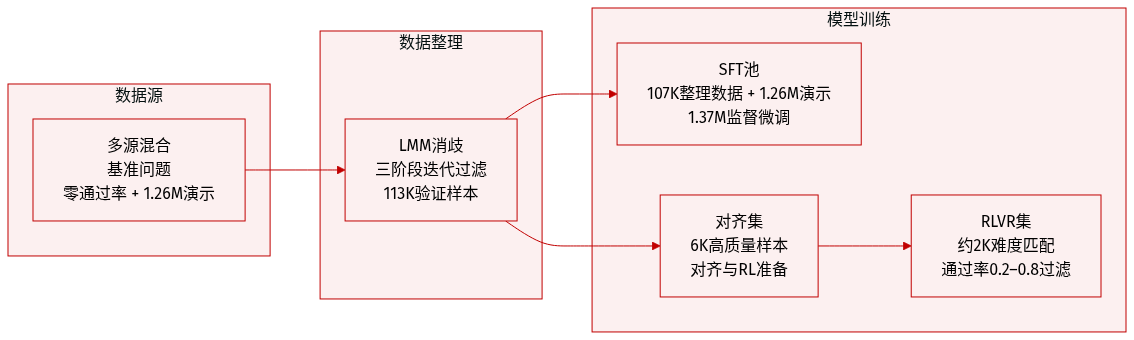

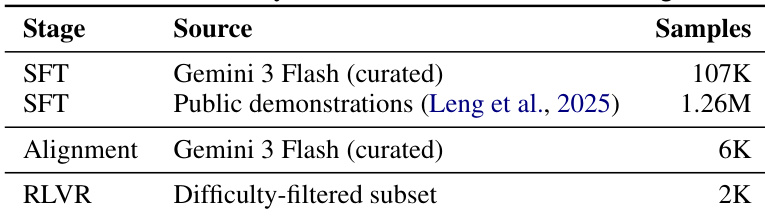

数据集

- 数据集构成与来源: 本文构建了一个多模态推理语料库,数据源自涵盖数学推理、科学图表理解、图表解读与空间推理的公开基准测试。最初筛选出在当代强模型上通过率为零的题目以保证高难度。为扩展覆盖范围与稳定性,在此精选集合基础上补充了由同系列 Gemini 模型生成的 126 万条公开演示数据。

- 子集详情与过滤规则: 核心集合包含 113,000 个已验证样本。生成前,多模态大模型(LMM)通过识别精确的提示-答案对并剔除无关部分,对包含多个子问题的图像进行消歧,以强制实施严格的一对一映射。随后,Gemini 3 Flash 使用严格模板生成详细解答。原始输出经过迭代三阶段过滤:截断与失败检查、格式验证(要求

<caption>、<thought>与<answer>标签内包含非空内容),以及基于大语言模型裁判的正确性验证。未通过前两项过滤的样本将被重新生成,而正确性失败的样本则在附加标准答案以引导模型后重新提交过滤。 - 训练划分与使用: 在 113,000 个已验证样本中,107,000 个分配至监督微调池,质量最高的 6,000 个保留用于对齐与强化学习。本文将 107,000 个精选样本与 126 万条补充演示合并,构建出包含 137 万样本的 SFT 语料库,用于训练模型的初始多模态推理策略。针对可验证奖励的强化学习,采用基于难度的过滤机制,仅保留约 2,000 道题目,这些题目在对齐后策略进行 16 次 rollout 时通过率介于 0.2 至 0.8 之间。

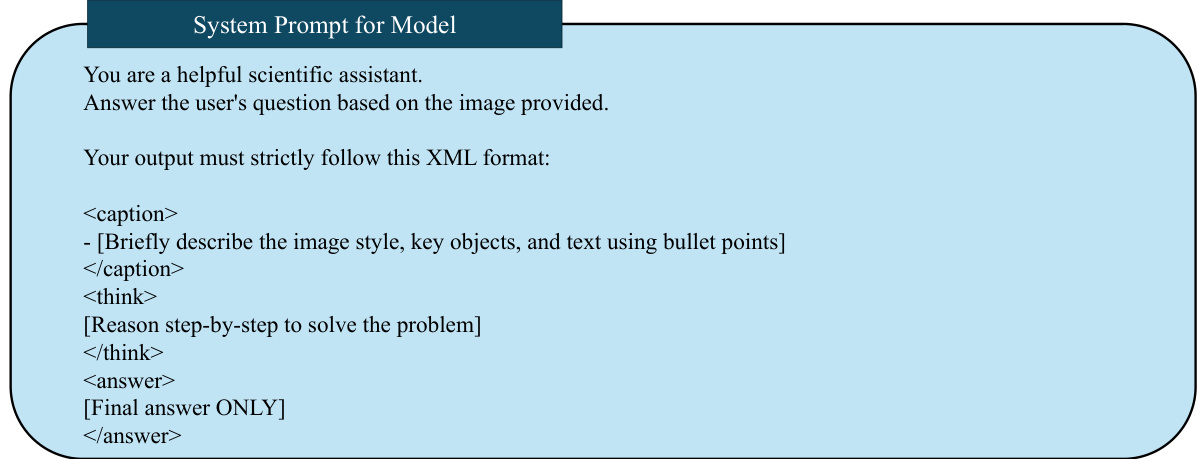

- 元数据构建与处理: 该流程优先处理结构化元数据与精确视觉定位。每个训练样本均使用明确的类 XML 标签进行格式化,以分离视觉定位(

<caption>)、思维链推理(<thought>)与最终输出(<answer>)。迭代重生成策略与难度匹配采样确保模型在既非过于简单也非过于困难的高保真轨迹上进行训练,为后续分布级修正提供稳定基础。

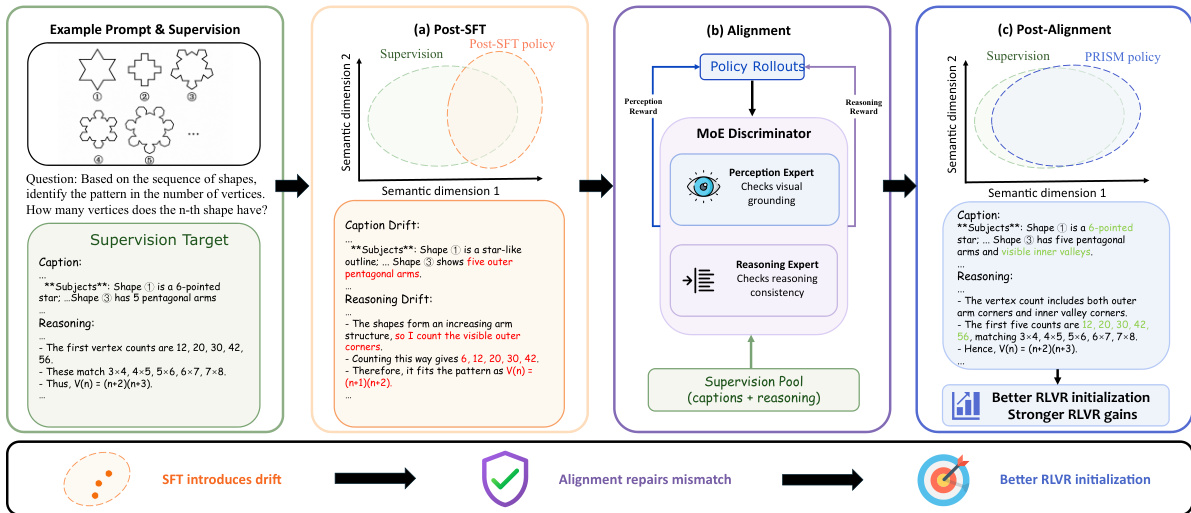

方法

PRISM 框架采用三阶段后训练流程,通过引入中间对齐阶段对传统的 SFT→RLVR 范式进行增强。该阶段作为专用中间步骤,用于在模型进入最终 RLVR 优化之前缓解由 SFT 引入的分布漂移。流程始于在高质量精选多模态推理语料库上进行标准监督微调(SFT),以获得初始策略。随后,该初始策略通过带有混合专家(MoE)判别器的对抗性在线策略蒸馏进行优化,判别器为感知与推理错误提供解耦的修正信号。生成的检查点用于初始化最终的可验证奖励强化学习(RLVR)阶段,在此阶段策略借助基于结果的奖励进一步提升。

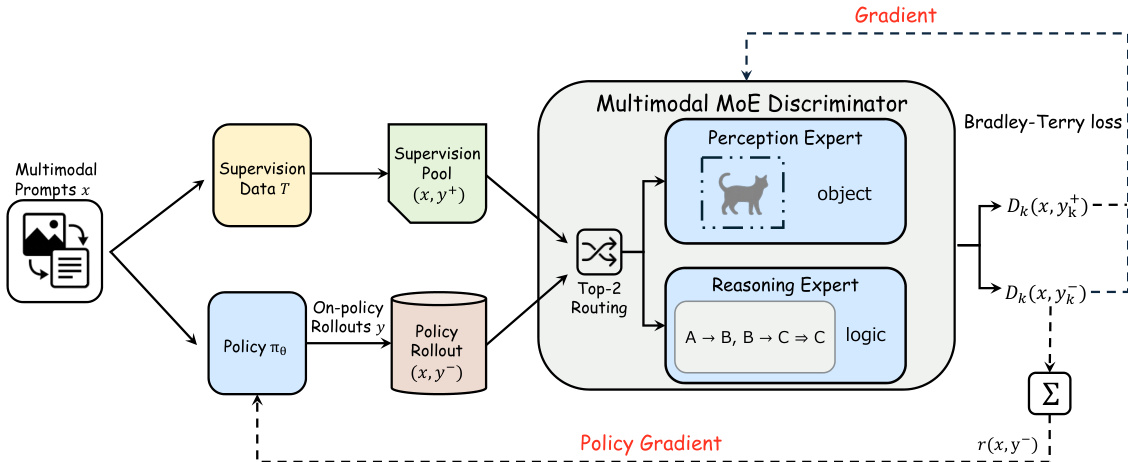

如图所示,对齐阶段旨在修复 SFT 后策略与监督分布之间的分布失配。该框架利用 MoE 判别器将对齐任务分解为两个专用专家。感知专家评估响应的视觉描述部分,以衡量其与输入图像的对应关系;推理专家则评估逐步推理轨迹的逻辑一致性与有效性。整体判别器得分为两个专家得分的加权组合,其中权衡参数 α 控制感知与推理反馈的相对影响。该设计为对抗对齐目标提供了更细粒度的基础,能够针对性地修正由视觉定位失败与推理失败引发的异构错误。

对抗性在线策略蒸馏过程被构建为策略与 MoE 判别器之间的极小极大博弈。策略被优化以生成越来越接近高质量参考演示的响应,而判别器则被训练用于区分监督数据与策略 rollout。判别器采用 Bradley-Terry 损失进行训练,促使其为参考响应分配更高分,为策略生成的响应分配更低的分数。策略通过策略梯度进行更新,以 MoE 判别器的奖励作为学习信号。该奖励针对每次策略 rollout 计算感知与推理专家得分的加权和。策略优化使用 GRPO 执行,并采用组级优势归一化,以鼓励策略在针对同一提示的多个响应中提升其相对排名。值得注意的是,通常用于将策略锚定在初始化附近的 KL 正则化项已被移除,以便对 SFT 引发的分布漂移进行更大幅度的修正。

策略与 MoE 判别器均在对抗阶段开始前进行初始化,以防止判别器因能力差距过大而饱和。策略从 SFT 检查点初始化,该检查点提供了足够接近监督分布的近似。MoE 判别器从相同的预训练主干网络初始化,并在其指定组件上进行热启动:感知专家基于视觉描述的偏好对进行初始化,推理专家基于推理轨迹的偏好对进行初始化。在此初始化阶段应用辅助负载均衡损失,以防止专家坍塌。对齐阶段运行固定步数后,最终检查点将用于初始化 RLVR 阶段。最终 RLVR 阶段使用结合答案准确率与格式合规性的确定性可验证奖励,策略则使用 GRPO、DAPO 或 GSPO 等标准强化学习算法进行优化。

实验

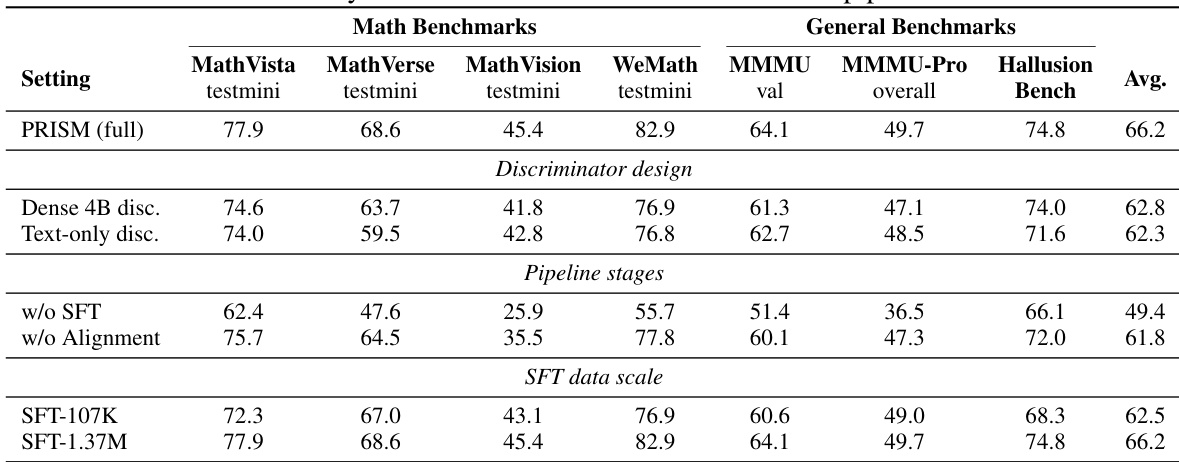

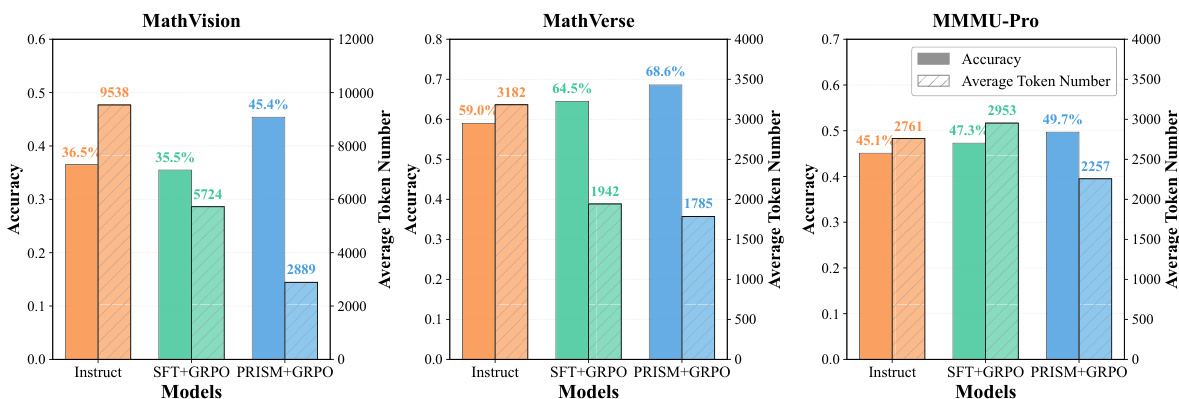

在多个模型规模与强化学习算法及标准多模态基准测试上的评估表明,PRISM 框架整合了监督微调、分布对齐与强化学习,以提升多模态推理能力。定性分析显示,对齐阶段通过建立稳健的初始化有效修复了标准微调固有的分布漂移,尤其对大型模型而言,这显著提升了下游性能。消融研究进一步验证,MoE 判别器的专用专家、联合视觉-语言处理以及互补的数据扩展,对于维持稳定的对抗训练并防止策略输出退化至关重要。最终,该框架始终产生更简洁且结构对齐的推理轨迹,证实显式分布修正能大幅释放后续强化学习阶段的有效性。

本文描述了一个包含监督微调、对齐与视觉推理强化学习的三阶段训练流程。对齐阶段利用混合专家判别器分别优化视觉感知与推理组件,从而在多个基准测试上提升下游性能。结果表明,对齐阶段修正了微调引入的分布漂移,并为强化学习提供了更优的初始化,从而在消耗更少 tokens 的情况下实现更高准确率。混合专家判别器实现了对视觉感知与推理的独立优化,其性能优于单一密集模型。三阶段流程不可或缺,各阶段在缩小模型与监督分布差距方面发挥独特作用。

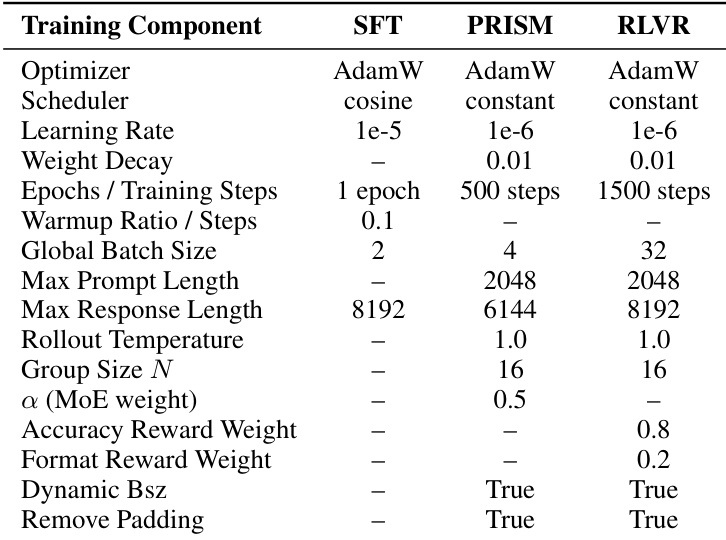

本文对比了 SFT、PRISM 与 RLVR 三个阶段的训练配置。表格显示,PRISM 采用与 SFT 和 RLVR 不同的学习率与优化器,并引入了具有特定超参数的基于 MoE 的奖励机制。RLVR 采用更长的训练周期与不同的奖励权重,而 PRISM 与 RLVR 均使用动态批次大小并去除填充。这些差异反映了各阶段不同的优化目标与训练策略。

本文对 PRISM 框架进行了全面评估,证明对齐阶段在多个基准测试与模型规模上显著提升了下游强化学习性能。结果显示,完整流程始终优于基线方法,性能提升主要集中在数学推理任务上,且 MoE 判别器设计与三阶段训练过程是实现这些改进的关键。消融研究进一步表明,SFT 数据规模与判别器的视觉-语言特性在实现有效分布对齐方面发挥核心作用。PRISM 在多个基准与模型规模上稳定提升下游 RLVR 性能,数学推理任务提升最大。MoE 判别器设计对性能至关重要,将其替换为密集模型会导致显著性能下降,尤其在需要视觉感知的任务上。三阶段流程必不可少,移除 SFT 或对齐阶段均会导致大幅性能跌落,表明各阶段在训练过程中均发挥不可替代的作用。

本文展示了在不同数学推理与多模态基准测试上对比不同训练流程的结果,表明 PRISM 方法在模型规模与算法上均能稳定提升下游强化学习性能。PRISM 流程在消耗更少 tokens 的情况下实现更高准确率,表明推理效率更高,且对齐阶段有效修正了监督微调引入的分布漂移。性能提升在各任务中保持一致,在要求强视觉定位与推理的基准测试上提升最为显著。PRISM 在准确率上持续优于基线且 tokens 消耗更少,表明推理更高效有效。对齐阶段修正了监督微调的分布漂移,带来更好的下游强化学习性能。改进在需要强视觉定位与复杂推理的任务上最为明显,凸显了分布对齐在多模态场景中的重要性。

本文展示了在不同多模态推理基准测试上对比不同训练流程的结果,表明 PRISM 方法在模型规模与算法上均能稳定提升下游强化学习性能。PRISM 中的对齐阶段修正了监督微调引入的分布漂移,带来更优的初始化与更高准确率,且未增加 tokens 使用量。PRISM 在不同模型与算法上持续改善下游强化学习性能,数学与视觉基准测试提升最大。对齐阶段修正了监督微调的分布漂移,优化了模型强化学习的初始化。PRISM 以更少 tokens 实现更高准确率,表明相比基线方法推理更高效有效。

该评估在多样化的多模态与数学推理基准测试上将完整三阶段训练流程与既定基线方法进行对比,同时消融研究隔离了监督微调、对齐与强化学习的具体贡献。这些实验验证了对齐阶段有效修正了初始训练产生的分布漂移,并为后续强化学习提供了更优初始化,且混合专家判别器成功独立优化了视觉感知与推理能力,无需依赖密集架构。最终,该框架始终以更低的 tokens 消耗实现更高准确率,证明靶向分布对齐能显著提升复杂多模态推理任务的效率与有效性。